De nombreux développeurs, lors de leur première utilisation de l'interface d'édition d'images gpt-image-2, ont le réflexe de poster l'image originale directement. Après tout, la documentation officielle indique clairement une limite de 50 Mo par image, alors pourquoi ne pas en profiter ? Pourtant, après quelques dizaines de tests, vous constaterez qu'entre une image originale de 20 Mo et une version compressée de 1,5 Mo, la vitesse de génération peut varier du simple au triple, et le taux d'échec (notamment les erreurs 413 Request Entity Too Large) augmente considérablement.

Cet article s'appuie sur une solide expérience de terrain pour vous proposer 5 bonnes pratiques pour le téléversement d'images gpt-image-2, en répondant aux deux questions qui posent le plus de problèmes aux développeurs : quelle est la taille idéale pour la compression et qu'est-ce qui détermine réellement la résolution de sortie.

🎯 Conclusion clé : Pour le téléversement d'images gpt-image-2, il est conseillé de limiter la taille à 1,5 Mo maximum. La résolution de sortie est déterminée par le paramètre

size; mentionner "8K" ou "4K" dans votre invite ne sert strictement à rien. Tout le code présenté ici peut être exécuté directement via le service proxy API APIYI (apiyi.com), sans avoir besoin d'un accès réseau international.

Spécifications de téléversement pour gpt-image-2 : limites officielles vs limites réelles

La documentation officielle d'OpenAI pour les spécifications d'entrée d'images de gpt-image-2 est très souple, et à première vue, il n'y a pas de limite particulière à craindre. Cependant, il y a une grande différence entre ce qui est "possible" et ce qui est "optimisé". En pratique, vous devez vous fixer une limite plus stricte.

Le tableau suivant compare les limites officielles aux valeurs recommandées basées sur les statistiques d'utilisation de nombreux développeurs :

| Dimension | Limite officielle | Recommandation pratique | Raison de la différence |

|---|---|---|---|

| Taille par image | 50 Mo | ≤ 1,5 Mo | Le transfert et le décodage côté serveur augmentent le temps total |

| Nombre d'images | 16 | 1-4 | La superposition d'images réduit le taux de succès |

| Formats supportés | PNG / WEBP / JPG | WEBP / JPG (compressé) | Le PNG est souvent trop lourd, le WEBP est le meilleur compromis |

| Pixels (côté) | Max 3840 | Pas plus de 2048 | Le modèle effectue de toute façon un sous-échantillonnage |

| Ratio d'aspect | 1:3 ~ 3:1 | Proche du ratio de sortie | Un mauvais ratio déclenche des remplissages/recadrages inutiles |

Pourquoi fixer la limite à 1,5 Mo ? C'est le point d'équilibre idéal entre le temps de transfert, le temps de décodage et la stabilité du réseau. En dessous de 1,5 Mo, la plupart des connexions domestiques permettent un transfert en 1 à 2 secondes. Au-delà de 5 Mo, le temps total de transfert et de décodage augmente de manière non linéaire, et vous sentirez clairement que l'interface "rame".

💡 Retour d'expérience : Nous recommandons de faire de 1,5 Mo une contrainte stricte dans votre code, en utilisant des bibliothèques comme PIL pour automatiser la compression avant l'appel. En utilisant le service proxy API APIYI (apiyi.com) pour invoquer gpt-image-2, l'optimisation du transfert des petits fichiers via les nœuds IDC domestiques est particulièrement efficace.

Pourquoi est-il conseillé de compresser les images en dessous de 1,5 Mo ?

De nombreux développeurs demandent : « Puisque la limite officielle est de 50 Mo, pourquoi s'acharner à atteindre 1,5 Mo ? » En réalité, il existe quatre raisons techniques majeures qui justifient de prendre très au sérieux la taille de vos images.

La première raison est la latence de transfert, souvent le facteur le plus sous-estimé. Une image de 25 Mo nécessite environ 4 secondes de transfert pur sur une bande passante montante de 50 Mbps, alors qu'une image compressée à 1,5 Mo ne prend que 0,24 seconde. Ce temps s'ajoute directement au temps de réponse total de l'API.

La deuxième raison est le risque d'erreur 413. Les erreurs « 413 Request Entity Too Large » avec gpt-image-1 / gpt-image-2 sont fréquentes. Même en restant sous la limite des 50 Mo, une image peut être rejetée par une passerelle intermédiaire (CDN, proxy inverse, équilibreur de charge). Compresser en dessous de 1,5 Mo permet d'éliminer presque totalement ce risque et d'améliorer la stabilité des appels.

La troisième raison est le temps de décodage côté serveur. Une fois l'image reçue, le serveur OpenAI doit la décoder, extraire les caractéristiques et effectuer une vectorisation. Ces étapes prennent un temps proportionnel au nombre total de pixels. Même si la bande passante n'est pas un goulot d'étranglement, les images trop lourdes ralentissent le temps de génération.

La quatrième raison est le coût des tentatives (retry). En cas d'échec, il faut renvoyer la totalité des 25 Mo ; alors qu'une image de 1,5 Mo se renvoie instantanément, ce qui améliore considérablement la fiabilité globale de bout en bout.

Si l'on quantifie ces raisons avec des données réelles, la comparaison est frappante : en testant une même image à 25 Mo / 5 Mo / 1,5 Mo / 500 Ko sur l'interface d'édition de gpt-image-2 (50 répétitions), on observe un point d'inflexion très net. 1,5 Mo semble être le point optimal de la courbe ; compresser davantage n'apporte qu'un gain marginal au prix d'une perte de qualité inutile.

🔧 Conseil d'optimisation : En production, je vous recommande vivement d'intégrer la « compression avant envoi » comme une étape standard de votre code. En utilisant les nœuds de transfert via apiyi.com pour vos tâches par lots, combiné à une stratégie de compression à 1,5 Mo, vous pouvez faire passer le taux d'échec par lot de 5-8 % à moins de 1 %. Un écart significatif lorsque vous atteignez des dizaines de milliers d'appels par mois.

La compression ne signifie pas perte de qualité : une idée reçue tenace

C'est une erreur très répandue : « Compression = perte de qualité = moins bons résultats AI ». Ce raisonnement était peut-être vrai à l'époque du JPEG en 2010, mais à l'ère du WebP et des JPEG haute qualité de 2026, il est totalement obsolète.

Voici un tableau comparatif pour vous aider à y voir plus clair :

| Idée reçue | Réalité |

|---|---|

| La compression dégrade toujours la qualité | WebP qualité 85+ est visuellement identique, idem pour JPEG 90+ |

| Plus l'image est grande, mieux l'AI la voit | gpt-image-2 sous-échantillonne les images ; tout ce qui dépasse la résolution de travail est inutile |

| Le PNG est sans perte, donc idéal | Le PNG est 3 à 5 fois plus lourd que le WebP, pour un résultat identique après décodage |

| Les outils de compression altèrent les couleurs | Les outils modernes (Squoosh / TinyPNG / Sharp) conservent les profils ICC |

| Pas besoin de compresser si l'invite est bonne | L'invite et la taille de l'image sont indépendantes ; la compression n'affecte que le transfert |

Pour le choix des outils, voici quelques options adaptées :

| Outil | Scénario d'usage | Avantages |

|---|---|---|

| PIL / Pillow | Traitement par lots (Backend Python) | Intégration simple, ajustement dynamique de la qualité |

| Sharp (Node.js) | Service Node | Performances optimales, traite des dizaines d'images par seconde |

| Squoosh | Compression unitaire (Frontend) | WASM dans le navigateur, pas besoin d'envoyer au serveur |

| TinyPNG | Traitement manuel par lots | Réduction intelligente de la palette, visuellement sans perte |

| Outils système | macOS / Windows | Choisir JPEG 80% suffit largement |

Considérer la « compression » comme une étape de prétraitement nécessaire, plutôt que comme une concession, est la base pour bien utiliser les API d'image.

Note importante : gpt-image-2 effectue en interne un sous-échantillonnage des images trop grandes. Sa « résolution de travail » réelle est bien inférieure à la limite maximale autorisée. Si vous envoyez une image de 4000×3000 pixels, le modèle ne verra probablement qu'une version réduite en 1024×1024. Les pixels excédentaires sont immédiatement écartés par le modèle, ce qui représente une perte de bande passante inutile.

Une fois ce point compris, le fait que « la qualité reste identique après compression » n'est plus une intuition, mais une conclusion basée sur des faits techniques. Compresser vos images dans une fourchette de 1024 à 2048 pixels permet d'atteindre la résolution de travail optimale du modèle, sans gaspillage.

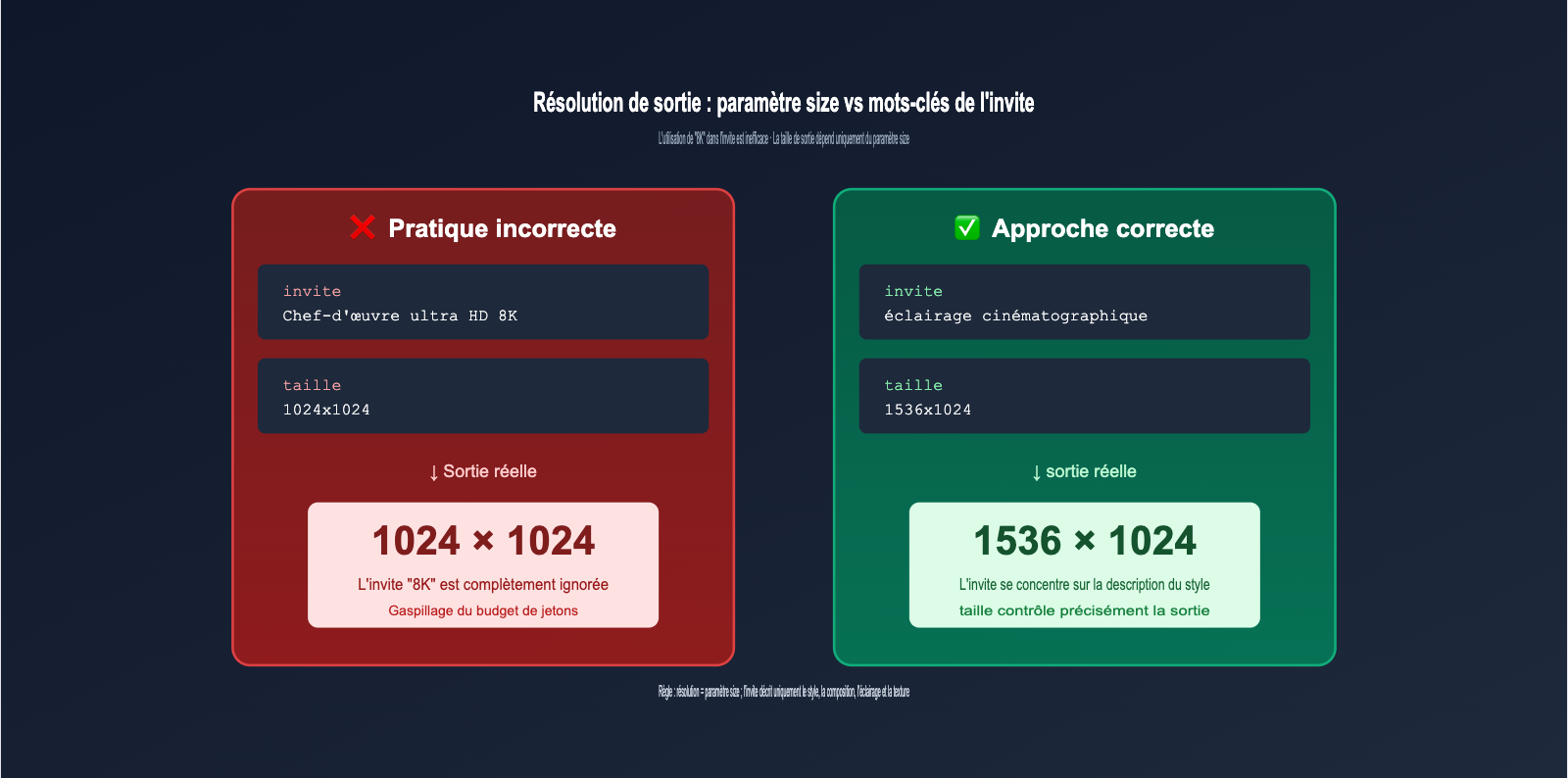

Résolution de sortie de gpt-image-2 : le paramètre size est le seul levier

Si la « compression sans perte » est une idée reçue côté téléchargement, croire que « demander du 8K dans l'invite suffit à obtenir du 8K » est la plus grande erreur côté sortie. Dans cette section, nous clarifions enfin ce qui détermine réellement la résolution de sortie de gpt-image-2.

Le seul paramètre qui influence la résolution de sortie est size, rien d'autre. C'est une règle cruciale mais souvent mal comprise. Voici une expérience comparative pour vous aider à mieux comprendre :

| Configuration de l'appel API | Résolution de sortie réelle |

|---|---|

size="1024x1024" + invite sans mention 4K/8K |

1024×1024 |

size="1024x1024" + invite avec "8K resolution" |

Toujours 1024×1024 |

size="1024x1024" + invite avec "ultra HD 4K" |

Toujours 1024×1024 |

size="1536x1024" + invite avec "low resolution" |

1536×1024 (priorité à size) |

size="3840x2160" + n'importe quelle invite |

3840×2160 (expérimental) |

La conclusion est sans appel : accumuler des mots-clés comme "8K", "4K", "ultra HD" ou "HQ" dans votre invite ne rendra pas votre image plus grande ou plus nette ; cela gaspille inutilement votre budget de jetons (tokens).

Quelles valeurs le paramètre size accepte-t-il ? gpt-image-2 est bien plus flexible que la génération précédente, acceptant à la fois des préréglages et des valeurs personnalisées :

| Mode de configuration | Plage de valeurs | Remarques |

|---|---|---|

| Préréglages standards | 1024×1024 / 1536×1024 / 1024×1536 | Le plus stable, recommandé |

| Personnalisé (standard) | Multiples de 16 pour la largeur/hauteur | Ex: 1280×720, 1600×900 |

| Personnalisé (grande image) | Max 3840px sur un côté | Au-delà de 2560×1440, c'est expérimental |

| Contrainte de ratio | Entre 1:3 et 3:1 | Les ratios extrêmes ne sont pas supportés |

| Contrainte de pixels totaux | 655 360 ~ 8 294 400 | Limites haute et basse |

Réservez vos descriptions dans l'invite pour des éléments à plus forte valeur ajoutée, comme le style ("style peinture à l'huile"), le cadrage ("prise de vue en contre-plongée"), l'éclairage ("lumière de l'heure dorée") ou les textures ("surface en céramique mate"). Ce sont ces éléments qui influencent réellement la qualité visuelle.

Un détail contre-intuitif mais important : choisir une grande valeur pour size ne garantit pas une image plus détaillée. Lorsque vous choisissez une haute résolution expérimentale comme 3840×2160, le modèle effectue en réalité un suréchantillonnage interne après une génération à basse résolution. La densité des détails n'augmente pas linéairement avec le nombre de pixels, et cela peut même entraîner une baisse de cohérence due à un temps de génération plus long. Pour un flux de travail quotidien, les formats 1024×1024 ou 1536×1024 sont idéaux : rapides, détaillés et plus économiques en termes de coût API.

📌 Conseil de nettoyage d'invite : Avant d'appeler gpt-image-2, supprimez tous les mots-clés inutiles comme "8K", "4K", "ultra HD" ou "high resolution" pour laisser de la place aux descriptions réellement utiles. Nous vous recommandons d'utiliser la plateforme APIYI pour comparer les résultats d'une même invite avec différents paramètres

sizeafin de mieux appréhender le lien entre résolution et densité d'image.

Appel pratique de gpt-image-2 : code complet Python pour compression et envoi

La théorie étant posée, passons au code. Le script Python ci-dessous implémente le flux complet : « compression automatique sous 1,5 Mo → appel de l'interface d'édition gpt-image-2 → enregistrement de la sortie ». Vous pouvez le copier-coller dans vos projets.

import io

import base64

from PIL import Image

from openai import OpenAI

# Appel via le service proxy API APIYI, pas besoin de VPN

client = OpenAI(

base_url="https://vip.apiyi.com/v1",

api_key="Votre clé API APIYI"

)

def compress_image(input_path: str, target_kb: int = 1500) -> bytes:

"""Compresse automatiquement l'image sous la limite de KB, format WebP privilégié"""

img = Image.open(input_path).convert("RGB")

# Limite le côté le plus long à 2048px, redimensionnement proportionnel

if max(img.size) > 2048:

img.thumbnail((2048, 2048), Image.LANCZOS)

# Réduction de la qualité par paliers de 5 jusqu'à atteindre la cible

quality = 90

while quality >= 50:

buf = io.BytesIO()

img.save(buf, format="WEBP", quality=quality)

if len(buf.getvalue()) <= target_kb * 1024:

return buf.getvalue()

quality -= 5

# Solution de secours : qualité minimale

buf = io.BytesIO()

img.save(buf, format="WEBP", quality=50)

return buf.getvalue()

# Appel de l'interface d'édition gpt-image-2

image_bytes = compress_image("./input.png", target_kb=1500)

result = client.images.edit(

model="gpt-image-2",

image=("input.webp", image_bytes, "image/webp"),

prompt="Transforme cette photo en style cyberpunk, néons, rue sous la pluie",

size="1536x1024", # La résolution de sortie est définie ici

output_format="webp", # Format de sortie

output_compression=85 # Niveau de compression de sortie 0-100

)

# Enregistrement de la sortie

output_b64 = result.data[0].b64_json

with open("./output.webp", "wb") as f:

f.write(base64.b64decode(output_b64))

Ce code comporte quelques points clés. Premièrement, la fonction compress_image utilise une stratégie de « réduction de qualité par boucle », commençant à 90 et diminuant par paliers de 5 jusqu'à atteindre la taille cible, ce qui maximise la qualité visuelle.

Deuxièmement, le paramètre output_compression=85 ne s'applique qu'aux formats WebP/JPEG pour contrôler la compression de l'image retournée (par défaut 100). Si vous affichez l'image sur le web, une valeur entre 80 et 90 offre un excellent compromis entre qualité et temps de chargement.

Troisièmement, la ligne size="1536x1024" définit réellement la résolution de sortie : peu importe ce que vous écrivez dans l'invite, l'image générée sera en 1536×1024.

🚀 Conseil d'intégration : gpt-image-2 est compatible avec le SDK natif OpenAI. Il suffit de modifier

base_urletapi_keypour utiliser la plateforme APIYI (apiyi.com). Cette plateforme optimise spécifiquement les interfaces d'imagerie pour réduire drastiquement les délais d'attente et les erreurs 413.

FAQ sur le téléchargement d'images pour gpt-image-2

Q1 : Est-il préférable de télécharger des images au format PNG ou WebP ?

À qualité égale, le poids d'un fichier WebP représente 1/3 à 1/5 de celui d'un PNG. Comme gpt-image-2 décode les deux formats de manière quasi identique, privilégiez le WebP. Sauf si votre image nécessite un canal alpha crucial (comme pour le détourage d'un logo), il n'y a aucune raison d'utiliser le PNG.

Q2 : Combien d'images de référence puis-je transmettre en une seule fois ?

La limite officielle est de 16 images, mais en pratique, le taux de réussite diminue nettement au-delà de 4 images, car l'attention du modèle sur les références est diluée. Nous recommandons d'utiliser 1 image de référence principale et 1 à 2 images de style ; en ajouter davantage risque de rendre le style de sortie confus.

Q3 : Si j'écris "8K" dans mon invite, ai-je vraiment besoin de compresser l'image ?

Le terme "8K" dans une invite est un mot-clé inefficace. Il ne permet ni d'obtenir une sortie en 8K (cela dépend uniquement du paramètre size), ni de faire sauter l'étape de compression de gpt-image-2. Nous vous conseillons de comparer les résultats via la console apiyi.com avant et après compression : vous constaterez qu'il est visuellement impossible de faire la différence.

Q4 : Quelle est la résolution de sortie maximale supportée par le modèle ?

Le paramètre size supporte jusqu'à 3840×2160, mais tout ce qui dépasse 2560×1440 est considéré comme "expérimental" par l'éditeur, avec une stabilité et une cohérence moindres. Pour un environnement de production, nous recommandons de s'en tenir à 1536×1024, un format à la fois rapide et stable.

Q5 : Est-il possible d'ajuster des zones de détail après le téléchargement ?

Oui, via le paramètre mask, vous pouvez spécifier un masque de même dimension. Le modèle ne générera du nouveau contenu que dans les zones transparentes du masque, tout en conservant le reste intact. C'est une fonctionnalité très puissante de l'interface d'édition de gpt-image-2, idéale pour le "inpainting" (retouche locale) ou le changement de vêtements.

Q6 : Que faire si le taux d'échec de l'invocation du modèle gpt-image-2 est élevé depuis la France/Chine ?

Une connexion directe vers OpenAI peut entraîner des délais d'attente ou des échecs de handshake SSL, surtout avec les interfaces d'images qui, en raison de leur charge utile (payload) plus importante, sont plus susceptibles d'être interrompues que les interfaces textuelles. En basculant le base_url vers un service proxy API comme apiyi.com, déployé localement, et en utilisant une stratégie de compression à 1,5 Mo, le taux de réussite global peut être stabilisé au-delà de 99 %.

Q7 : La qualité est-elle vraiment préservée après compression, ou risque-t-on une sur-compression ?

Avec une qualité WebP supérieure à 85 ou JPEG supérieure à 90, il n'y a aucune différence visuelle sur des images naturelles (personnages, paysages, produits). Cependant, pour les contenus riches en texte (affiches, captures d'écran PPT) ou aux lignes très nettes (schémas techniques, pixel art), nous recommandons de monter la qualité à 92-95 ou de conserver le PNG pour éviter des artefacts de compression légers sur les bords des caractères. La fonction de compression Python fournie dans cet article fixe le seuil de départ à 90, ce qui est stable pour la plupart des scénarios.

Q8 : Quelles sont les différences de stratégie de téléchargement entre gpt-image-2 et gpt-image-1.5 ?

La stratégie globale est identique : 1,5 Mo par image, priorité au WebP, et le paramètre size détermine la sortie. Ces règles s'appliquent aux deux modèles. La différence réside principalement dans le fait que gpt-image-2 supporte des résolutions personnalisées (contraintes par des multiples de 16) et des résolutions élevées expérimentales, tandis que gpt-image-1.5 ne propose que des préréglages fixes. Si vous effectuez une migration, vous pouvez réutiliser votre code de compression sans crainte.

Conclusion

Pour revenir aux deux questions fondamentales posées au début de cet article, les réponses sont désormais limpides.

Première question : Quelle est la taille idéale pour le téléchargement d'images gpt-image-2 ? Bien que la limite officielle soit de 50 Mo, fixez votre limite réelle à 1,5 Mo. C'est le compromis idéal entre latence de transfert, risque d'erreur 413, temps de décodage et coût de réessai. Avec les algorithmes modernes, la compression ne dégrade quasiment pas la qualité ; il est inutile de s'obstiner à envoyer l'image originale.

Deuxième question : Qu'est-ce qui détermine la résolution de sortie ? La seule réponse est le paramètre size, et non l'invite. Supprimez définitivement les termes comme "8K", "4K" ou "ultra HD" de vos modèles d'invite pour réserver votre précieux budget de jetons (tokens) à des descriptions utiles sur le style, la composition et la lumière.

En intégrant ces deux règles, la vitesse et le taux de réussite de vos invocations de gpt-image-2 s'amélioreront considérablement. Nous vous recommandons de commencer avec le code de compression Python fourni ici, de tester rapidement via l'interface apiyi.com, et de consacrer une journée ou deux à trouver votre combinaison de paramètres optimale.

📌 Auteur : APIYI Team — Spécialistes de l'ingénierie des API multimodales OpenAI / Anthropic / Google. Retrouvez plus d'usages avancés de gpt-image-2 et des modèles d'invites sur le centre de documentation apiyi.com.