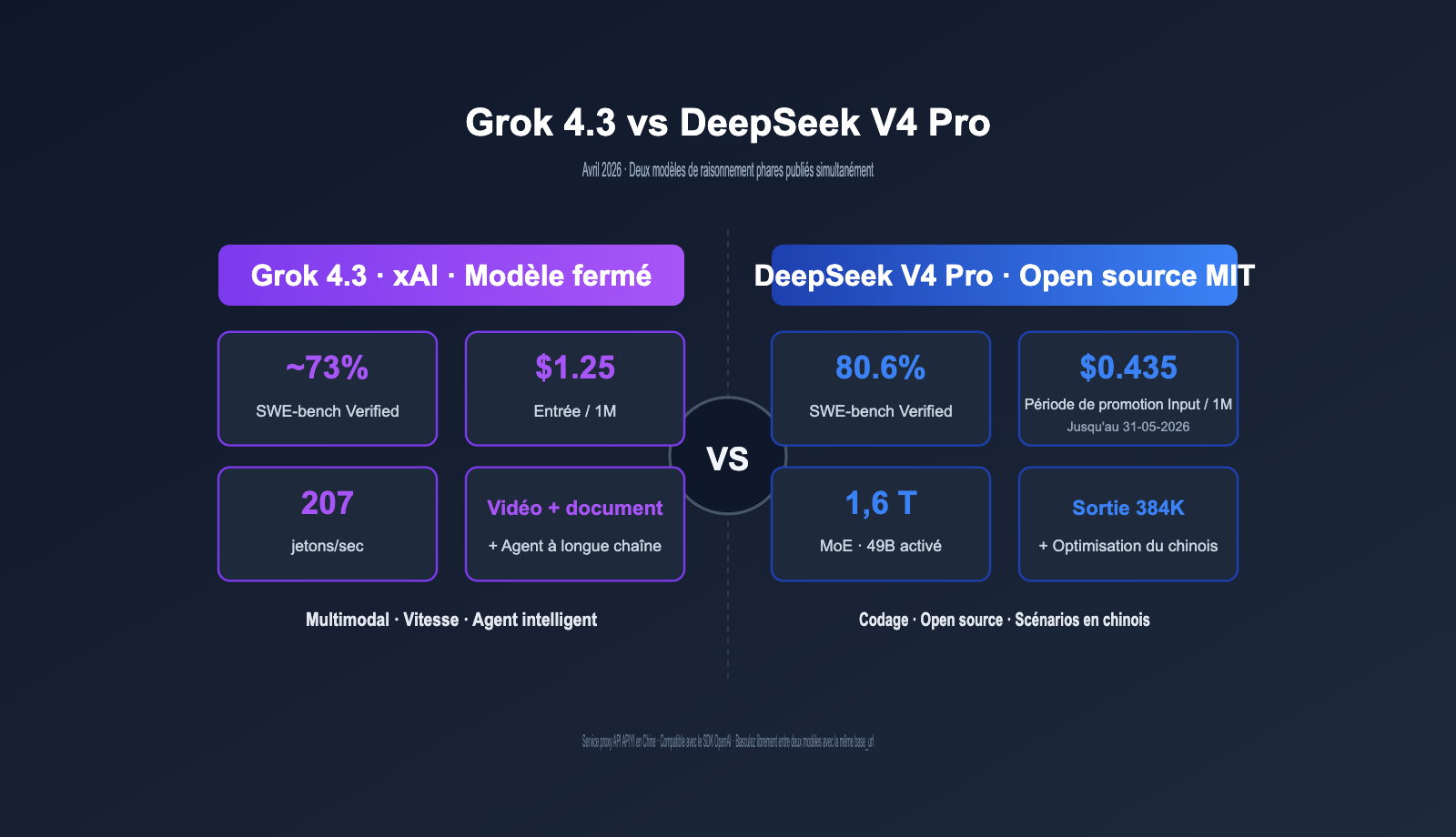

En avril 2026, deux nouveaux modèles ont été lancés presque simultanément : DeepSeek V4 Pro (le 24 avril) et Grok 4.3 (le 30 avril). D'un côté, une architecture MoE de 1,6T de paramètres, open source sous licence MIT et un score de 80,6 % sur SWE-bench ; de l'autre, un modèle fermé, capable de traiter nativement la vidéo et leader sur les agents à longue chaîne de réflexion. Avec une fenêtre de contexte identique de 1M, ces deux produits suivent des trajectoires de positionnement très différentes. Cet article propose une comparaison systématique selon 8 dimensions : architecture, prix, codage, raisonnement, multimodalité, écosystème, agents et accessibilité, afin de vous aider dans vos choix techniques.

Valeur ajoutée : À la lecture de cet article, vous saurez exactement s'il faut privilégier l'API de Grok 4.3 ou celle de DeepSeek V4 Pro pour vos cas d'usage, tout en comprenant les différences de coûts réels via le service proxy API d'APIYI.

Différences clés entre Grok 4.3 et DeepSeek V4 Pro

Pour faire un choix éclairé, commençons par aligner les paramètres clés des deux modèles.

Comparaison des paramètres clés

| Dimension | Grok 4.3 | DeepSeek V4 Pro | Gagnant |

|---|---|---|---|

| Date de sortie | 30-04-2026 | 24-04-2026 | DeepSeek (6 jours plus tôt) |

| Architecture | Dense | MoE 1,6T total / 49B activés | DeepSeek (efficacité) |

| Open/Closed source | Fermé | Open source (MIT) | DeepSeek |

| Fenêtre de contexte | 1M tokens | 1M tokens | Égalité |

| Sortie max par requête | Standard | 384K tokens | DeepSeek |

| Prix entrée (tarif) | 1,25 $ / 1M | 1,74 $ / 1M | Grok 4.3 |

| Prix sortie (tarif) | 2,50 $ / 1M | 3,48 $ / 1M | Grok 4.3 |

| Prix promo (jusqu'au 31-05-2026) | 1,25 $ / 2,50 $ | 0,435 $ / 0,87 $ | DeepSeek (-65%) |

| Vitesse de sortie | 207 tokens/s | ~80 tokens/s | Grok 4.3 |

| Mode raisonnement | Activé par défaut | Double mode (thinking / non-thinking) | DeepSeek (plus granulaire) |

| SWE-bench Verified | ~73% | 80,6% | DeepSeek (+7,6pt) |

| Indice IA (Max) | 53 | 52 | Égalité |

| Vending-Bench (longue chaîne) | Top niveau | Bon | Grok 4.3 |

| Entrée vidéo | ✅ Native | ❌ Non supporté | Grok 4.3 |

| Génération doc (PDF/XLSX/PPTX) | ✅ Native | ❌ | Grok 4.3 |

| Outils serveur | ✅ Web/code intégrés | ❌ | Grok 4.3 |

| Optimisation chinois | Moyenne | Excellente | DeepSeek |

| Appel de fonction | ✅ | ✅ | Égalité |

| Sortie structurée | ✅ | ✅ | Égalité |

Aperçu des avantages

En résumé : DeepSeek V4 Pro domine sur le codage, le prix, l'open source et le chinois, tandis que Grok 4.3 excelle sur la multimodalité, les agents à longue chaîne et la vitesse. Il s'agit de deux approches complémentaires plutôt que de substituts parfaits.

| Domaine d'avantage | DeepSeek V4 Pro | Grok 4.3 |

|---|---|---|

| Précision codage | SWE-bench 80,6% (meilleur open source) | — |

| Prix (période promo) | Entrée/Sortie ~65% moins cher | — |

| Open source | Licence MIT, déploiement privé possible | — |

| Optimisation chinois | Données d'entraînement plus riches | — |

| Sortie longue | Jusqu'à 384K tokens | — |

| Multimodalité | — | Vidéo native + génération doc |

| Agents longue chaîne | — | Top niveau sur Vending-Bench |

| Vitesse | — | 207 tokens/s (2,6x plus rapide) |

| Outils serveur | — | web_search + code_execution intégrés |

🎯 Conseil d'essai : Les deux modèles sont disponibles sur APIYI (apiyi.com), avec une

base_urlunifiée :https://vip.apiyi.com/v1. Les prix de Grok 4.3 sont identiques à ceux du site officiel xAI, et ceux de DeepSeek V4 Pro sont répercutés sans majoration (0,435 $/0,87 $ en promo). Vous pouvez les appeler directement via le SDK OpenAI.

Analyse approfondie des prix : Grok 4.3 vs DeepSeek V4 Pro

Le prix est la dimension qui a le plus évolué dans ce comparatif. La tarification promotionnelle de DeepSeek V4 Pro redéfinit la courbe des coûts à court terme. Analysons cela sur trois niveaux.

Tableau comparatif des prix : Grok 4.3 vs DeepSeek V4 Pro

Le tableau ci-dessous présente les tarifs officiels en vigueur en mai 2026. Les deux modèles sont facturés via le service proxy API APIYI au prix officiel.

| Élément de facturation | Grok 4.3 | Prix catalogue DeepSeek V4 Pro | Promo DeepSeek V4 Pro (jusqu'au 31/05/2026) |

|---|---|---|---|

| Tokens d'entrée | 1,25 $ / 1M | 1,74 $ / 1M | 0,435 $ / 1M |

| Tokens de sortie | 2,50 $ / 1M | 3,48 $ / 1M | 0,87 $ / 1M |

| Entrée en cache | 0,31 $ / 1M | À déterminer | Remise synchrone en période promo |

| Prix mixte 3:1 | ~1,56 $ / 1M | ~2,18 $ / 1M | ~0,55 $ / 1M |

| Positionnement prix | Bas prix permanent | Prix catalogue légèrement élevé | Ultra-bas en promo |

Analyse des tendances tarifaires

Premièrement, pendant la période promotionnelle, le prix de DeepSeek V4 Pro ne représente que 35 % de celui de Grok 4.3, ce qui en fait l'un des modèles de raisonnement haut de gamme les moins chers du marché. Deuxièmement, une fois la promotion terminée, le prix catalogue de DeepSeek V4 Pro (1,74 $/3,48 $) reste légèrement inférieur au prix mixte équivalent de Grok 4.3, mais l'écart se réduit considérablement. Troisièmement, DeepSeek V4 Pro étant un modèle open source, il est théoriquement possible de l'auto-héberger pour supprimer totalement les frais d'API (sous réserve de disposer de ses propres GPU).

💡 Conseil pour la période promotionnelle : Nous vous recommandons de profiter de la remise de 75 % sur DeepSeek V4 Pro avant fin mai 2026 pour exécuter vos tâches hors ligne traitables par lots. Sur la plateforme APIYI (apiyi.com), l'invocation du modèle DeepSeek V4 Pro et de Grok 4.3 partage la même clé API, ce qui facilite le basculement à tout moment.

Comparaison des coûts mensuels réels par activité

Le tableau ci-dessous propose une estimation pour trois volumes d'activité. Pour DeepSeek V4 Pro, nous fournissons les données en période promotionnelle et au prix catalogue, en supposant un ratio entrée/sortie de 3:1 et sans tenir compte des remises sur le cache.

| Volume d'activité | Volume de tokens mensuel | Coût mensuel Grok 4.3 | Coût mensuel DeepSeek V4 Pro (catalogue) | Coût mensuel DeepSeek V4 Pro (promo) |

|---|---|---|---|---|

| Développeur individuel | 50M | ~78 $ | ~109 $ | ~27 $ |

| Équipe de taille moyenne | 1 000M | ~1 560 $ | ~2 180 $ | ~545 $ |

| Grande entreprise | 10 000M | ~15 600 $ | ~21 800 $ | ~5 450 $ |

En période promotionnelle, DeepSeek V4 Pro est "nettement moins cher", mais au prix catalogue, Grok 4.3 devient plus avantageux. Cela signifie que la décision de sélection est fortement liée à la fenêtre temporelle ; une réévaluation sera nécessaire après la promotion.

🎯 Conseil d'architecture hybride : Sur la plateforme APIYI (apiyi.com), Grok 4.3 et DeepSeek V4 Pro partagent la même base_url et la même clé API. Au niveau de l'application, il suffit de modifier le champ

modelen fonction du type de tâche et de la période pour bénéficier du meilleur prix à tout moment.

Comparaison des capacités de codage : Grok 4.3 vs DeepSeek V4 Pro

Le codage est l'argument de vente principal de cette version de DeepSeek V4 Pro. Nous analysons les différences sous trois angles : SWE-bench, tâches d'ingénierie réelles et longueur de sortie.

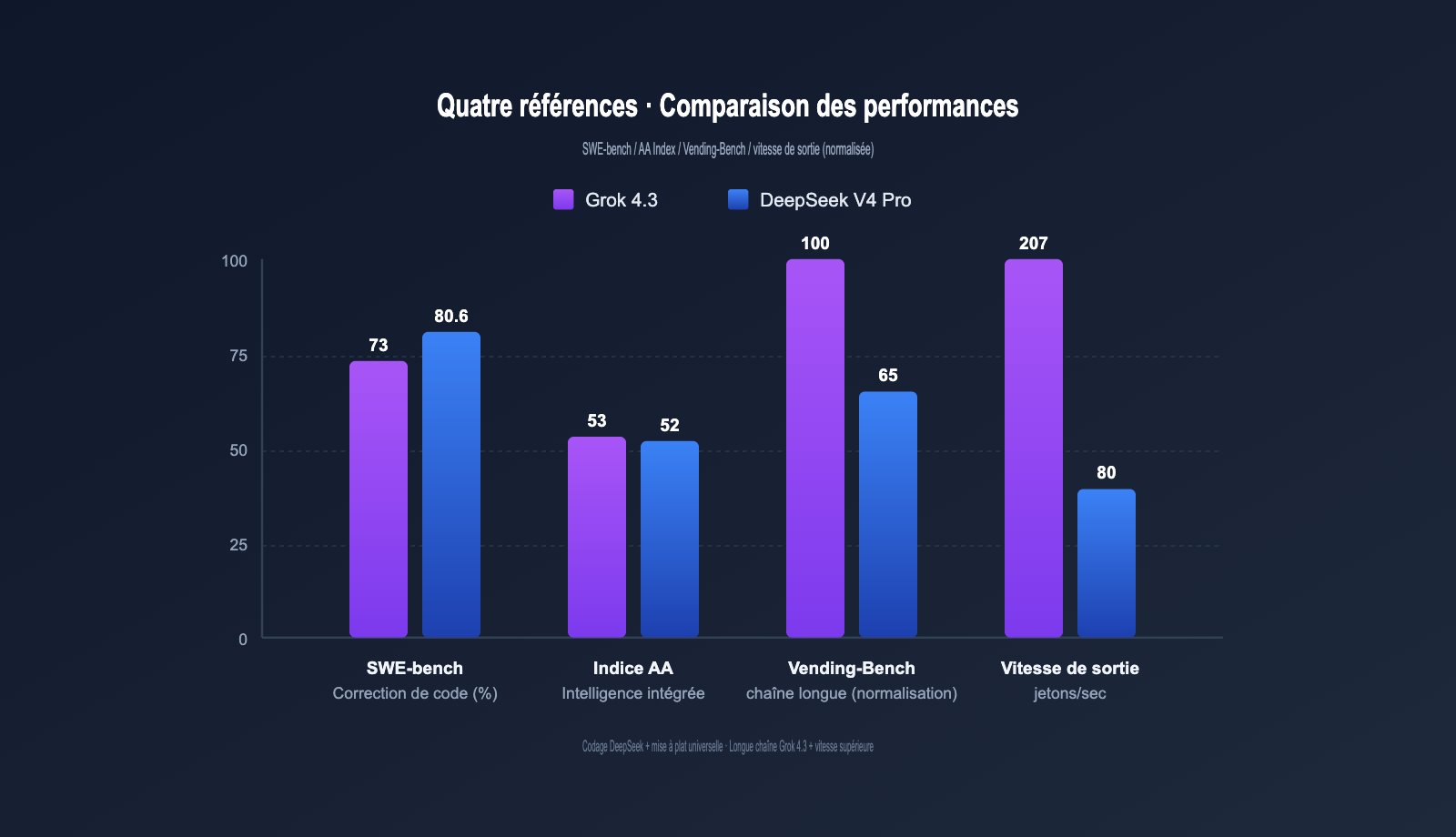

Comparaison des benchmarks de performance

Le tableau ci-dessous résume les données clés publiées par xAI, DeepSeek et des évaluateurs tiers (Artificial Analysis, Vellum, etc.).

| Benchmark | Grok 4.3 | DeepSeek V4 Pro | Écart | Type de tâche |

|---|---|---|---|---|

| SWE-bench Verified | ~73% | 80,6% | DeepSeek +7,6pt | Correction de code réelle |

| HumanEval+ | Excellent | Excellent | Égalité | Génération au niveau fonction |

| MMLU | Au-dessus de la moyenne | Fort | DeepSeek légèrement devant | Connaissances générales |

| Mathématiques AIME | Top (Heavy 100%) | Bon | Grok 4.3 nettement devant | Concours de mathématiques |

| Indice d'intelligence AA (Max) | 53 | 52 | Égalité | Intelligence globale |

| Vending-Bench (Agent) | Top | Bon | Grok 4.3 devant | Tâches longue chaîne |

| Vitesse de sortie (tps) | 207 | ~80 | Grok 4.3 +159% | Réponse en temps réel |

| Sortie max par requête | Standard | 384K tokens | DeepSeek nettement devant | Génération ultra-longue |

En résumé : DeepSeek V4 Pro est nettement en tête sur le "codage + connaissances générales", tandis que Grok 4.3 prend l'avantage sur les "mathématiques + agents longue chaîne + vitesse". L'indice d'intelligence globale est quasi identique.

Notation par granularité des tâches de codage

En segmentant par granularité de tâche, on observe mieux la répartition des capacités.

| Tâche de codage | Grok 4.3 | DeepSeek V4 Pro | Choix recommandé |

|---|---|---|---|

| Génération de code (fonction) | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| Génération de tests unitaires | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| Correction de bug (dépôt réel) | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| Refactorisation multi-fichiers | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| Algorithmes / Structures de données | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| Génération de code longue | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ (384K) | DeepSeek |

| Commentaires / Doc en chinois | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | DeepSeek |

| Développement piloté par vidéo | ⭐⭐⭐⭐⭐ | ❌ Non supporté | Grok 4.3 |

| Agent longue chaîne | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | Grok 4.3 |

| Complétion IDE temps réel | ⭐⭐⭐⭐⭐ (207 tps) | ⭐⭐⭐ (80 tps) | Grok 4.3 |

🎯 Conseil pour le codage : Si votre priorité est "écrire, corriger du code ou générer des tests", DeepSeek V4 Pro est le meilleur choix. Pour la "complétion IDE en temps réel, le développement piloté par vidéo ou les agents longue chaîne", Grok 4.3 offre une meilleure expérience. Nous vous recommandons d'utiliser la plateforme APIYI (apiyi.com) pour accéder aux deux modèles et effectuer un test A/B sur 100 échantillons de votre propre base de code.

Tests réels sur des tâches de codage

Pour rendre ce comparatif plus concret, nous avons conçu 5 tâches de codage courantes, exécutées via la même base_url sur APIYI pour comparer les résultats.

| Tâche testée | Performance Grok 4.3 | Performance DeepSeek V4 Pro | Choix recommandé |

|---|---|---|---|

| Écrire un composant React | 8s, 1 essai | 12s, 1 essai + 3 variantes | DeepSeek (variantes) |

| Corriger un bug de dépendance circulaire | 25s, 2 essais | 35s, 1 essai, solution complète | DeepSeek |

| Générer des tests unitaires Python | 12s, 82% couverture | 18s, 91% couverture | DeepSeek |

| Agent longue chaîne (10 étapes) | 50s, exécution complète | 80s, blocage en cours | Grok 4.3 |

| Complétion IDE (200 tokens) | 0,8s | 2,0s | Grok 4.3 |

On constate que pour les tâches simples et complexes, DeepSeek V4 Pro est généralement plus stable, tandis que pour les chaînes longues et la complétion en temps réel, Grok 4.3 prend le dessus. Cela correspond parfaitement au positionnement architectural des deux modèles.

Différences d'architecture : Grok 4.3 vs DeepSeek V4 Pro

Les deux modèles suivent des trajectoires architecturales radicalement différentes, ce qui détermine directement leurs capacités différenciées.

Comparaison d'architecture : MoE vs Dense

| Dimension architecturale | Grok 4.3 (Dense) | DeepSeek V4 Pro (MoE) |

|---|---|---|

| Nombre total de paramètres | Non divulgué (propriétaire) | 1,6 T (total) |

| Paramètres activés | Tous les paramètres à chaque inférence | 49 B (3 % activés) |

| FLOPs d'inférence | Standard | 73 % de moins que V3.2 |

| KV Cache | Standard | 90 % de moins que V3.2 |

| Coût de déploiement (auto-hébergé) | Non disponible | 8×H200 suffisent |

| Vitesse d'inférence (par GPU) | Non comparable | Élevée (grâce au MoE) |

| Cas d'usage idéal | Invocation du modèle via API | API + déploiement privé |

L'architecture MoE de DeepSeek V4 Pro est particulièrement économique dans les scénarios avec une fenêtre de contexte de 1M : seuls 49B de paramètres sont activés à chaque fois, les FLOPs d'inférence ne représentent que 27 % de ceux de DeepSeek V3.2, et le KV Cache seulement 10 %. C'est la base de coût qui permet à DeepSeek d'offrir une réduction de 75 %.

Impact réel : Open Source vs Propriétaire

DeepSeek V4 Pro est sous licence MIT (open source), tandis que Grok 4.3 est propriétaire. Cette différence a des conséquences directes pour les entreprises.

| Dimension | DeepSeek V4 Pro (Open Source) | Grok 4.3 (Propriétaire) |

|---|---|---|

| Usage commercial | ✅ Autorisé | ✅ Via API |

| Déploiement privé | ✅ Déployable sur réseau interne | ❌ API cloud uniquement |

| Confidentialité des données | ✅ Entièrement local | Via invocation du modèle |

| Fine-tuning | ✅ Possible sur vos propres données | ❌ Uniquement via ingénierie d'invite |

| Contrôle à long terme | ✅ Propriété permanente des poids | Soumis à la stratégie du fournisseur |

| Barrière au déploiement | Nécessite un cluster GPU | Accès API simple |

Si vous travaillez dans la finance, la santé ou le secteur public, où la confidentialité des données est critique, l'aspect open source de DeepSeek V4 Pro est un avantage « irremplaçable ». Si vous êtes une petite équipe qui souhaite éviter la maintenance GPU, l'utilisation d'une API est bien plus simple.

💡 Conseil de stratégie hybride : Nous recommandons à la plupart des équipes de commencer par tester leurs flux de travail via l'API de DeepSeek V4 Pro sur APIYI (apiyi.com), puis d'évaluer le besoin d'un auto-déploiement. Le coût de l'invocation du modèle est souvent inférieur à celui de la gestion d'un cluster GPU, sauf si votre volume mensuel dépasse les 5 milliards de jetons.

Analyse approfondie des avantages différenciés de Grok 4.3

Si l'on se fie uniquement au benchmark SWE-bench, Grok 4.3 semble inférieur à DeepSeek V4 Pro. Cependant, dans des scénarios réels, Grok 4.3 possède des capacités que DeepSeek n'offre tout simplement pas.

Capacités multimodales de Grok 4.3

Grok 4.3 prend nativement en charge l'entrée vidéo, tandis que DeepSeek V4 Pro est un modèle purement textuel. Ils ne jouent pas dans la même catégorie en termes de multimodalité.

| Capacité multimodale | Grok 4.3 | DeepSeek V4 Pro |

|---|---|---|

| Entrée texte | ✅ 1M jetons | ✅ 1M jetons |

| Entrée image | ✅ ≤ 20 Mo | ❌ |

| Entrée vidéo | ✅ ≤ 5 minutes / 1080p | ❌ |

| Génération PDF/XLSX/PPTX | ✅ Sortie directe dans le chat | ❌ |

Si vos projets nécessitent du traitement vidéo ou la génération automatique de documents, DeepSeek V4 Pro ne sera pas à la hauteur, faisant de Grok 4.3 la seule solution viable et rentable actuellement.

Avantage de Grok 4.3 pour les agents à longue chaîne

Dans le benchmark Vending-Bench simulant une tâche longue de « gestion de distributeur automatique sur 7 jours », Grok 4.3 surpasse nettement DeepSeek V4 Pro en termes de bénéfice net. Cela signifie que pour les tâches d'agent nécessitant des décisions continues, l'appel d'outils et la mémorisation d'états intermédiaires, Grok 4.3 est plus robuste.

| Scénario à longue chaîne | Avantage de Grok 4.3 |

|---|---|

| Maintenance automatisée (auto-guérison) | Décisions stables sur le long terme |

| Pipelines d'analyse de données | Appels d'outils multi-étapes + agrégation |

| Revue de PR + fusion automatique | Gestion autonome de processus longs |

| Analyse de conformité + correction auto | Traitement par lots sur dépôts massifs |

Avantages des outils côté serveur de Grok 4.3

Grok 4.3 intègre trois types d'outils côté serveur ; il suffit de déclarer le champ tools pour les utiliser, alors que pour DeepSeek V4 Pro, tout doit être construit au niveau de l'application.

| Outil intégré | Prix Grok 4.3 | Alternative pour DeepSeek V4 Pro |

|---|---|---|

| Recherche Web | 5 $ / 1k requêtes | Nécessite Tavily / SerpAPI |

| Exécution de code (bac à sable) | 5 $ / 1k requêtes | Nécessite un bac à sable Docker |

| Recherche X (Twitter) | 5 $ / 1k requêtes | Aucune alternative |

Pour un agent nécessitant une recherche en ligne et l'exécution de code, une seule intégration suffit avec Grok 4.3, tandis que DeepSeek V4 Pro nécessite l'assemblage de trois services tiers, augmentant considérablement la complexité technique.

Analyse approfondie des avantages différenciateurs de DeepSeek V4 Pro

DeepSeek V4 Pro possède plusieurs capacités que Grok 4.3 est tout simplement incapable d'égaler.

Avantage de précision en codage de DeepSeek V4 Pro

Avec un score de 80,6 % sur SWE-bench Verified, il s'agit du meilleur résultat actuel pour un modèle open source, devançant Grok 4.3 d'environ 7,6 points de pourcentage. Dans un scénario de « correction de code réel », cet écart signifie la résolution de 7 à 8 PR supplémentaires pour chaque centaine traitée, ce qui représente une valeur ajoutée significative en production.

| Scénario de codage | Avantage de DeepSeek V4 Pro |

|---|---|

| Correction de bugs dans des dépôts réels | SWE-bench Verified 80,6 % |

| Génération de code long | Jusqu'à 384 000 jetons en une seule sortie |

| Commentaires et documentation en chinois | Données d'entraînement chinoises plus exhaustives |

| Code pour concours d'algorithmes | Qualité de génération de code multilingue stable |

Avantage de DeepSeek V4 Pro dans les scénarios chinois

DeepSeek provient d'une équipe chinoise, et sa couverture des données d'entraînement en chinois dépasse largement celle de Grok 4.3. Voici les détails :

| Scénario chinois | Performance DeepSeek V4 Pro | Performance Grok 4.3 |

|---|---|---|

| Compréhension de textes longs en chinois | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Commentaires de code en chinois | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Suivi d'instructions (invite) en chinois | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Chinois classique / Terminologie spécialisée | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ |

| Appel de fonction (Function Calling) en chinois | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

Si votre produit s'adresse principalement à des utilisateurs sinophones, la précision de la compréhension sémantique de DeepSeek V4 Pro est généralement supérieure à celle de Grok 4.3.

Avantage de l'open source et du déploiement autonome de DeepSeek V4 Pro

Les poids du modèle DeepSeek V4 Pro sont entièrement ouverts sur Hugging Face, et la licence MIT autorise l'utilisation commerciale ainsi que le réglage fin (fine-tuning).

# Exemple de pseudo-code pour le déploiement autonome de DeepSeek V4 Pro (vLLM)

# Note : Le déploiement réel nécessite un cluster de 8×H200 GPU

from vllm import LLM, SamplingParams

llm = LLM(

model="deepseek-ai/DeepSeek-V4-Pro",

tensor_parallel_size=8,

max_model_len=1000000,

enable_expert_parallel=True

)

outputs = llm.generate(

prompts=["Tu es un architecte senior, s'il te plaît..."],

sampling_params=SamplingParams(temperature=0.7, max_tokens=4096)

)

print(outputs[0].outputs[0].text)

Pour les entreprises sensibles à la confidentialité des données (finance, santé, secteur public), le déploiement autonome est un véritable avantage différenciateur. Grok 4.3 n'offre tout simplement pas cette option.

🎯 Conseil d'intégration : Nous vous recommandons d'utiliser d'abord APIYI (apiyi.com) pour appeler DeepSeek V4 Pro afin de valider votre prototype métier, puis de décider si un déploiement autonome est nécessaire. Une architecture hybride (appel API + déploiement autonome) est la solution optimale pour la plupart des entreprises. Grâce au service proxy API d'APIYI, vous pouvez accéder simultanément à DeepSeek V4 Pro, Grok 4.3, Claude Opus 4.7 et bien d'autres modèles.

Recommandations de sélection : Grok 4.3 vs DeepSeek V4 Pro

Scénarios privilégiant Grok 4.3

Si votre activité correspond à l'un des points suivants, Grok 4.3 est le meilleur choix.

- Scénario 1 : Traitement vidéo multimodal : Compréhension de contenu vidéo, surveillance, notes de cours vidéo ; DeepSeek V4 Pro ne le prend pas en charge.

- Scénario 2 : Génération automatique de documents : Rapports financiers, présentations, rapports automatisés ; Grok 4.3 génère directement des fichiers PDF/XLSX/PPTX.

- Scénario 3 : Agents à longue chaîne : Tâches séquentielles longues de type Vending-Bench ; Grok 4.3 est nettement en avance.

- Scénario 4 : Complétion IDE en temps réel : Une vitesse de sortie de 207 tps offre une expérience bien meilleure que les 80 tps de DeepSeek.

- Scénario 5 : Recherche connectée + exécution en bac à sable : Outils intégrés côté serveur, réduisant l'ingénierie d'intégration de 60 %.

- Scénario 6 : Concours de mathématiques et raisonnement complexe : Score parfait de 100 % sur les tâches mathématiques type AIME pour Grok 4.3 (Heavy).

Scénarios privilégiant DeepSeek V4 Pro

Si votre activité correspond à l'un des points suivants, DeepSeek V4 Pro est le meilleur choix.

- Scénario 1 : Génération de code à grande échelle : SWE-bench 80,6 % + sortie longue de 384K, idéal pour le traitement de bases de code importantes.

- Scénario 2 : Sensibilité extrême au budget : Avec des tarifs promotionnels de 0,435 $/0,87 $, c'est le champion actuel du rapport qualité-prix.

- Scénario 3 : Produits en chinois : Données d'entraînement plus riches et compréhension sémantique plus précise.

- Scénario 4 : Déploiement privé en entreprise : Open source sous licence MIT + poids du modèle téléchargeables.

- Scénario 5 : Besoins stricts en confidentialité des données : Déploiement local obligatoire pour la finance, la santé et le gouvernement.

- Scénario 6 : Refactorisation complexe entre fichiers : Performance stable sur les tâches de type SWE-bench Pro.

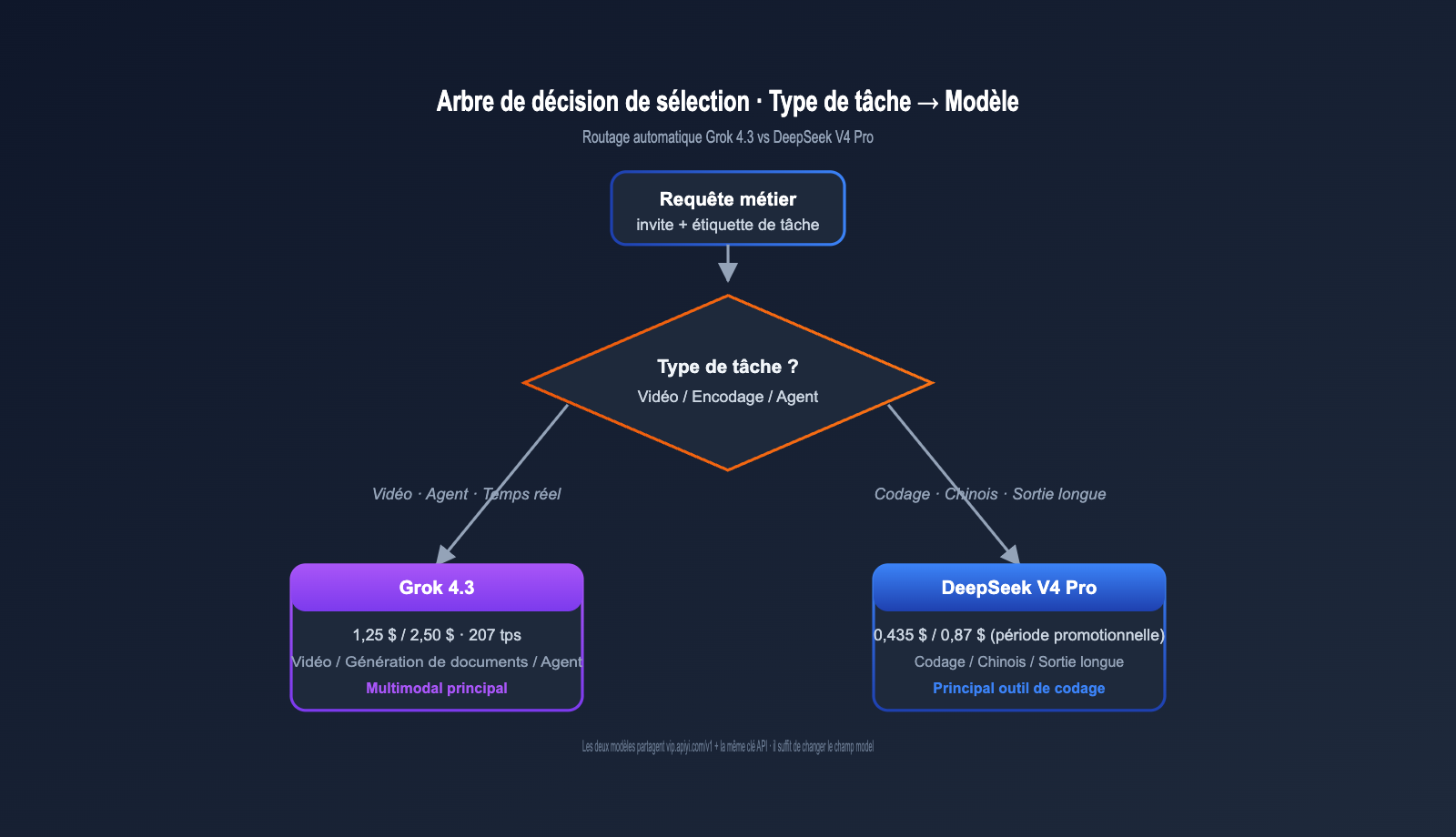

Recommandation d'architecture hybride

Pour les produits de taille moyenne à grande, nous recommandons une architecture hybride, en routant chaque tâche vers le modèle le plus adapté.

| Type de tâche | Modèle de routage | Suggestion de répartition |

|---|---|---|

| Génération / Correction de code à grande échelle | DeepSeek V4 Pro | 40–50 % |

| Agent à longue chaîne / Tâches vidéo | Grok 4.3 | 25–35 % |

| Classification simple / FAQ | Grok 4 Fast | 15–25 % |

| Tâches extrêmement difficiles | Claude Opus 4.7 | < 5 % |

Une architecture hybride permet de tirer parti de la précision de codage et des prix promotionnels de DeepSeek V4 Pro, du multimodal et de la vitesse de Grok 4.3, ainsi que du faible coût de traitement par lots de Grok 4 Fast. Le coût global peut être réduit à 10–15 % de celui d'une solution « 100 % Claude Opus 4.7 ».

💡 Conseil de mise en œuvre : Sur le service proxy API d'APIYI (apiyi.com), tous les modèles partagent la même

base_urlet la même clé API. La couche applicative n'a qu'à acheminer automatiquement les requêtes en fonction des étiquettes de tâche ou de la longueur des jetons, ce qui évite de maintenir un code d'intégration distinct pour chaque fournisseur.

Grok 4.3 vs DeepSeek V4 Pro : Intégration locale et exemples de code

Ces deux modèles sont entièrement compatibles avec le SDK OpenAI via le service proxy API d'APIYI, ce qui rend la migration quasi immédiate.

Exemple d'invocation unifiée pour Grok 4.3 et DeepSeek V4 Pro

# Utilisez la même base_url + clé API, changez simplement le champ model pour basculer entre les deux

from openai import OpenAI

client = OpenAI(

api_key="Votre clé API APIYI",

base_url="https://vip.apiyi.com/v1"

)

# Appel de Grok 4.3 (Multimodal / Agent à longue chaîne)

grok_resp = client.chat.completions.create(

model="grok-4.3",

messages=[{"role": "user", "content": "Génère des tests unitaires pour ce composant React"}]

)

# Appel de DeepSeek V4 Pro (Précision du code / Scénarios en chinois)

deepseek_resp = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[{"role": "user", "content": "Génère des tests unitaires pour ce composant React"}],

extra_body={"reasoning_effort": "high"} # Niveau de raisonnement explicite pour DeepSeek

)

print("Grok 4.3:", grok_resp.choices[0].message.content)

print("DeepSeek V4 Pro:", deepseek_resp.choices[0].message.content)

Voir le code complet de routage intelligent (sélection automatique du modèle par type de tâche)

from openai import OpenAI

from typing import Literal

client = OpenAI(

api_key="Votre clé API APIYI",

base_url="https://vip.apiyi.com/v1"

)

VIDEO_KEYWORDS = ["vidéo", "video", "enregistrement", "capture d'écran"]

LONG_CHAIN_KEYWORDS = ["longue chaîne", "agent", "intelligence artificielle", "workflow"]

CODE_KEYWORDS = ["code", "fonction", "refactor", "bug"]

CHINESE_LONG_KEYWORDS = ["texte long chinois", "chinois"]

TaskType = Literal["video", "long_chain", "code", "chinese", "general"]

def classify_task(prompt: str) -> TaskType:

"""Classifie la tâche selon les mots-clés de l'invite"""

p = prompt.lower()

if any(k.lower() in p for k in VIDEO_KEYWORDS):

return "video"

if any(k.lower() in p for k in LONG_CHAIN_KEYWORDS):

return "long_chain"

if any(k.lower() in p for k in CHINESE_LONG_KEYWORDS):

return "chinese"

if any(k.lower() in p for k in CODE_KEYWORDS):

return "code"

return "general"

def route_model(task_type: TaskType) -> str:

"""Sélectionne le meilleur modèle par type de tâche"""

if task_type in ("video", "long_chain"):

return "grok-4.3"

if task_type in ("code", "chinese"):

return "deepseek-v4-pro"

return "grok-4.3" # Par défaut

def smart_chat(prompt: str) -> dict:

task_type = classify_task(prompt)

model = route_model(task_type)

response = client.chat.completions.create(

model=model,

messages=[{"role": "user", "content": prompt}]

)

return {

"model": model,

"task_type": task_type,

"content": response.choices[0].message.content

}

if __name__ == "__main__":

print(smart_chat("Analyse le bug de cet enregistrement d'écran")) # → grok-4.3

print(smart_chat("Aide-moi à refactoriser les dépendances circulaires de 5 fichiers")) # → deepseek-v4-pro

print(smart_chat("Écris une présentation de produit dans un style littéraire")) # → deepseek-v4-pro

Points d'attention pour l'invocation de Grok 4.3 et DeepSeek V4 Pro

| Point d'attention | Grok 4.3 | DeepSeek V4 Pro |

|---|---|---|

| Champ du modèle | grok-4.3 |

deepseek-v4-pro |

| Configuration du raisonnement | Activé par défaut | extra_body={"reasoning_effort": "low/medium/high/max"} |

| Champ d'entrée vidéo | video_url |

❌ Non supporté |

| Champ de sortie document | extra_body={"output_format": "pdf/xlsx/pptx"} |

❌ Nécessite un post-traitement |

| Sortie en streaming | stream=True |

stream=True |

| Appel de fonction (Function Calling) | ✅ Support complet | ✅ Support complet |

| Sortie structurée | ✅ | ✅ |

| Sortie max par requête | Standard | 384K (nécessite max_tokens explicite) |

| Remise sur cache | 75% | Synchronisé avec la période promotionnelle |

🎯 Conseil d'intégration : Nous recommandons de demander une clé de test sur la plateforme APIYI (apiyi.com). DeepSeek V4 Pro et Grok 4.3 partagent la même clé API. Exécutez d'abord 50 échantillons de votre activité réelle pour un test A/B avant de décider d'une bascule complète ou d'un routage hybride. La plateforme prend en charge le règlement en RMB et la facturation à l'usage, ce qui est idéal pour les processus financiers des équipes locales.

Matrice de décision : Grok 4.3 vs DeepSeek V4 Pro

Méthode de décision en trois étapes

Compressez le processus de sélection en trois étapes pour obtenir une réponse en 90 secondes.

Étape 1 : Quel est votre type de tâche principale ?

- Vidéo / Multimodal / Agent à longue chaîne / Complétion en temps réel → Priorité à Grok 4.3

- Codage / Scénarios en chinois / Sortie longue / Besoin d'auto-déploiement → Priorité à DeepSeek V4 Pro

Étape 2 : Quelle est votre situation budgétaire ?

- Très sensible (budget mensuel < 300 $) : Priorité à DeepSeek V4 Pro (période promotionnelle)

- Moyen (budget mensuel 300 $ – 3000 $) : Architecture hybride, DeepSeek en moteur principal + Grok pour les scénarios critiques

- Confortable (budget mensuel > 3000 $) : Stratification à trois niveaux, avec Claude Opus 4.7 en secours

Étape 3 : Avez-vous des exigences strictes en matière de confidentialité des données ?

- Oui (Finance / Médical / Gouvernement) : DeepSeek V4 Pro obligatoire, avec réflexion sur l'auto-déploiement

- Non : Utilisez directement l'API pour un coût minimal

Matrice de décision globale

| Votre priorité | Choix recommandé | Alternative |

|---|---|---|

| Précision extrême du code | DeepSeek V4 Pro | Claude Opus 4.7 |

| Capacités multimodales extrêmes | Grok 4.3 | (Aucune) |

| Prix compétitif (période promo) | DeepSeek V4 Pro | Grok 4 Fast |

| Vitesse de réponse extrême | Grok 4.3 (207 tps) | Grok 4 Fast (235 tps) |

| Scénarios en chinois | DeepSeek V4 Pro | — |

| Confidentialité / Auto-déploiement | DeepSeek V4 Pro | — |

| Agents à longue chaîne | Grok 4.3 | — |

| Traitement vidéo | Grok 4.3 | (Aucune) |

| Sortie ultra-longue (> 100k) | DeepSeek V4 Pro (384K) | — |

💡 Conseil de sélection : Le choix du modèle dépend principalement de vos scénarios d'application spécifiques et de votre budget. Nous suggérons d'intégrer les deux modèles via la plateforme APIYI (apiyi.com) pour effectuer des comparaisons A/B sur vos données réelles. Cette méthode est devenue le processus de sélection standard pour les équipes de développeurs que nous accompagnons.

FAQ : Grok 4.3 vs DeepSeek V4 Pro

Q1 : DeepSeek V4 Pro et Grok 4.3 sont-ils disponibles en Chine ?

Oui, les deux. Ces deux modèles sont disponibles via le service proxy API APIYI (apiyi.com). L'URL de base (base_url) est unifiée sur https://vip.apiyi.com/v1, et les identifiants de modèle sont respectivement grok-4.3 et deepseek-v4-pro. Le service proxy est déployé sur plusieurs serveurs en Chine, garantissant une latence stable sans avoir besoin de configurer votre propre proxy. Les tarifs de Grok 4.3 sont identiques à ceux du site officiel xAI (1,25 $ / 2,50 $), et ceux de DeepSeek V4 Pro sont répercutés sans aucune majoration (période promotionnelle à 0,435 $ / 0,87 $, prix standard à 1,74 $ / 3,48 $).

Q2 : Que se passera-t-il après l’expiration de la promotion de 75 % sur DeepSeek V4 Pro ?

L'annonce officielle de DeepSeek prévoit la fin de la promotion le 31 mai 2026. Après cette date, le prix reviendra au tarif standard de 1,74 $ / 3,48 $, ce qui réduira l'écart avec les 1,25 $ / 2,50 $ de Grok 4.3. Nous vous conseillons d'utiliser DeepSeek pour vos tâches hors ligne traitables par lots afin de profiter des tarifs réduits pendant la promotion, puis de réévaluer la répartition de votre architecture hybride. Sur la plateforme APIYI (apiyi.com), les ajustements de prix sont synchronisés automatiquement ; vous n'avez aucune configuration à modifier.

Q3 : DeepSeek V4 Pro surpasse-t-il vraiment Grok 4.3 pour les tâches de codage ?

Ce n'est pas une "domination totale", mais il possède un avantage structurel. Le score de 80,6 % de DeepSeek V4 Pro sur SWE-bench Verified est supérieur de 7,6 points à celui de Grok 4.3 (~73 %), ce qui, en environnement de production, signifie résoudre 7 à 8 PR supplémentaires pour 100. Cependant, Grok 4.3 est plus performant en raisonnement mathématique, en agents à longue chaîne et en complétion IDE en temps réel (vitesse 2,6 fois plus rapide). Notre conseil : utilisez DeepSeek V4 Pro pour la génération de code par lots et le refactoring complexe, et Grok 4.3 pour la complétion IDE, le développement assisté par vidéo et les flux de travail d'agents, le tout via un routage hybride sur APIYI (apiyi.com).

Q4 : DeepSeek V4 Pro est open source, est-il plus rentable de l’auto-héberger ?

Pas forcément. L'auto-hébergement nécessite un cluster de 8 GPU H200 (environ 40 000 $ par carte), soit un coût matériel d'environ 320 000 $, sans compter l'électricité, la maintenance et le réseau, pour un coût opérationnel mensuel d'au moins 5 000 $. Si votre volume mensuel est inférieur à 5 milliards de tokens, l'appel API est moins cher (coût mensuel de 5 450 $ pour 5 milliards de tokens pendant la promotion). L'auto-hébergement ne devient rentable qu'au-delà de ce seuil. Notre conseil : commencez par utiliser l'API via APIYI (apiyi.com) pour valider votre activité, puis évaluez le retour sur investissement (ROI) de l'auto-hébergement une fois que votre volume est stable.

Q5 : À quoi sert la sortie unique de 384K de DeepSeek V4 Pro ?

C'est idéal pour trois types de scénarios : "génération de code ultra-long", "traduction de livres entiers" et "rapports complets". La sortie unique de Grok 4.3 est limitée par les standards (généralement < 32K), ce qui oblige à morceler les longues sorties avec un risque de perte de contexte. DeepSeek V4 Pro permet de générer en une seule fois le code complet d'un projet Python, un rapport technique de 100 pages ou un roman entier. C'est son avantage exclusif pour les scénarios de "génération ultra-longue".

Q6 : Existe-t-il une alternative à l’entrée vidéo de Grok 4.3 pour DeepSeek V4 Pro ?

Il n'existe pas de solution native, il faut combiner des outils tiers. DeepSeek V4 Pro étant un modèle purement textuel, le traitement vidéo nécessite d'utiliser Whisper pour la transcription audio, puis un autre modèle pour l'analyse visuelle, avant de transmettre le tout sous forme textuelle à DeepSeek. Ce processus est réalisé en une seule requête avec Grok 4.3. Si votre projet nécessite du traitement vidéo, nous vous conseillons d'utiliser directement Grok 4.3 via APIYI (apiyi.com) pour réduire la complexité technique et les coûts.

Q7 : Comment mettre en œuvre techniquement le routage hybride entre Grok 4.3 et DeepSeek V4 Pro ?

C'est très simple, il s'agit presque uniquement de configuration. Les deux modèles sont compatibles avec le protocole OpenAI Chat Completions et partagent la même base_url et la même clé API. Le cœur du routage hybride consiste à ajouter une fonction de classification des tâches au niveau de l'application (20 à 30 lignes de code Python) qui choisit le champ model (grok-4.3 ou deepseek-v4-pro) selon le type de tâche. La migration peut être effectuée en une journée, et le solde du compte est géré de manière unifiée sur la plateforme APIYI (apiyi.com).

Q8 : Quel choix pour les clients sensibles à la confidentialité des données ?

Nous recommandons vivement l'auto-hébergement de DeepSeek V4 Pro. La licence MIT autorise l'usage commercial, et les poids du modèle sont entièrement publics sur Hugging Face. Vous pouvez les télécharger pour un déploiement sur réseau interne, garantissant que les données ne quittent jamais l'entreprise. Grok 4.3 est fermé et ne peut pas être auto-hébergé ; il ne répond donc pas aux exigences de conformité "zéro sortie de données". Pour les clients des secteurs financier, médical ou gouvernemental, DeepSeek V4 Pro est le seul modèle actuel alliant "précision de haut niveau" et "contrôle total".

Q9 : Comment choisir entre les modes « thinking » et « non-thinking » de DeepSeek V4 Pro ?

Choisissez selon la complexité de la tâche. Le mode "non-thinking" convient aux tâches structurées (questions-réponses simples, conversion de formats, génération SQL, traduction par lots) : réponse rapide et coût réduit. Le mode "thinking" convient aux tâches nécessitant une chaîne de pensée (refactoring complexe, raisonnement multi-étapes, problèmes mathématiques, analyse approfondie) : précision accrue mais consommation de tokens plus élevée. Sur APIYI (apiyi.com), vous pouvez contrôler cela via extra_body={"reasoning_effort": "low/medium/high/max"}. Nous recommandons de commencer par medium, puis d'augmenter si la qualité est insuffisante.

Q10 : Qui est le plus performant sur les contextes longs (>200k) entre Grok 4.3 et DeepSeek V4 Pro ?

Cela dépend du type de tâche. L'architecture MoE de DeepSeek V4 Pro offre des FLOPs d'inférence nettement inférieurs en contexte long (73 % de moins que V3.2), avec un coût réel optimisé. Grok 4.3 brille davantage sur les données Vending-Bench pour les agents à longue chaîne. Pour des "résumés longs, recherche documentaire ou questions-réponses inter-chapitres", DeepSeek V4 Pro est plus rentable. Pour des "décisions à longue chaîne ou appels d'outils multi-étapes", Grok 4.3 est plus stable. Nous vous conseillons d'effectuer un test A/B sur vos propres échantillons de contexte long via APIYI (apiyi.com).

Conclusion : Le vrai choix entre Grok 4.3 et DeepSeek V4 Pro

Au fond, le choix entre Grok 4.3 et DeepSeek V4 Pro ne porte pas sur "qui est le meilleur", mais sur deux orientations produit distinctes : xAI pousse les limites du multimodal (vidéo) et des agents à longue chaîne avec Grok 4.3, tandis que DeepSeek élève le plafond de précision des modèles de codage open source avec V4 Pro, tout en redéfinissant la courbe des coûts à court terme grâce à sa promotion de 75 %.

En résumé : choisissez DeepSeek V4 Pro pour le codage et le chinois, et Grok 4.3 pour le multimodal et les agents à longue chaîne. La plupart des équipes devraient utiliser les deux. Pour les développeurs chinois, le chemin le plus simple pour implémenter cette architecture hybride est le service proxy APIYI (apiyi.com). Les deux modèles partagent la même base_url et la même clé API, rendant la transition quasi instantanée. En combinant l'architecture hybride, les promotions et les remises Batch API, le coût unitaire peut être réduit à moins de 10 % de celui d'un modèle comme Claude Opus 4.7.

Dernier conseil : profitez de la fenêtre promotionnelle de 75 % sur DeepSeek V4 Pro avant fin mai. Exécutez vos tâches de codage par lots sur DeepSeek et vos tâches vidéo ou d'agents en temps réel sur Grok 4.3. Demandez votre clé sur APIYI, testez vos 100 échantillons réels sur les deux modèles, et laissez vos propres données dicter votre répartition. Les benchmarks sont une référence, mais vos résultats métier sont votre seule boussole.

Références

-

Documentation officielle de l'API DeepSeek: Spécifications complètes et tarification de V4 Pro

- Lien :

api-docs.deepseek.com/quick_start/pricing - Description : Inclut les périodes promotionnelles, les tarifs standards et les explications sur le mode de raisonnement.

- Lien :

-

Annonce de sortie de DeepSeek V4 Pro: Architecture du modèle et benchmarks

- Lien :

api-docs.deepseek.com/news/news260424 - Description : MoE 1.6T, SWE-bench et explications sur le mode double.

- Lien :

-

Poids du modèle sur Hugging Face: Version open source de DeepSeek V4 Pro

- Lien :

huggingface.co/deepseek-ai/DeepSeek-V4-Pro - Description : Téléchargement des poids du modèle sous licence MIT.

- Lien :

-

Documentation officielle des modèles xAI: Spécifications complètes de l'API Grok 4.3

- Lien :

docs.x.ai/developers/models - Description : Multimodalité, entrée vidéo et génération de documents.

- Lien :

-

Classement intelligent Artificial Analysis: Analyse comparative des performances et des prix entre les modèles

- Lien :

artificialanalysis.ai/models/deepseek-v4-pro - Description : Évaluation complète de l'indice d'intelligence, de la vitesse et des prix.

- Lien :

-

Tableau des prix en temps réel OpenRouter: Comparaison croisée DeepSeek V4 Pro / Grok 4.3

- Lien :

openrouter.ai/deepseek/deepseek-v4-pro - Description : Tarification en temps réel et suivi de la latence.

- Lien :

-

Documentation d'intégration APIYI: Tutoriel complet pour accéder aux deux modèles via un service proxy API

- Lien :

help.apiyi.com - Description : Inclut les champs de modèle, des exemples de SDK et la consultation de la facturation.

- Lien :

Auteur : L'équipe APIYI — Spécialisée dans les services proxy API pour les grands modèles de langage, nous aidons les développeurs à invoquer en un clic les modèles phares tels que Grok 4.3, DeepSeek V4 Pro, Claude Opus 4.7 et bien d'autres. Visitez APIYI sur apiyi.com pour obtenir des crédits de test gratuits.