Conclusion en une phrase : L'utilisation de gpt-image-2 via un relais officiel (Official Relay) ne présente aucun risque juridique supplémentaire, à condition d'en faire un usage raisonnable — la structure des risques est identique à celle d'une entreprise appelant directement l'API officielle d'OpenAI. Cependant, si le fournisseur de service proxy API utilise des canaux inversés (Reverse-engineered), les risques de conformité se transmettent à l'entreprise tout au long de la chaîne d'appel. Cet article propose une méthode de jugement rigoureuse et une liste de contrôle juridique en 8 points.

Depuis le lancement officiel de gpt-image-2 par OpenAI le 21 avril 2026, ce modèle a été largement adopté dans les scénarios B2B en Chine. Les trois questions les plus fréquemment posées par les équipes juridiques des entreprises sont : Pouvons-nous l'utiliser directement ? Existe-t-il des risques de conformité ? À qui appartiennent les images générées ?

Ces questions semblent simples, mais elles impliquent réellement les conditions de service d'OpenAI, les politiques d'utilisation, les clauses d'indemnisation, les mécanismes de sécurité du contenu, les droits de propriété commerciale et, surtout, la "différence de type de fournisseur de service proxy API" que les entreprises nationales négligent trop souvent. Sans avoir lu les trois documents originaux en anglais des conditions d'OpenAI, il est facile pour un service juridique de tirer une conclusion prudente mais erronée.

Cet article décompose le panorama de conformité de gpt-image-2 en suivant l'ordre des processus d'approbation réels des entreprises.

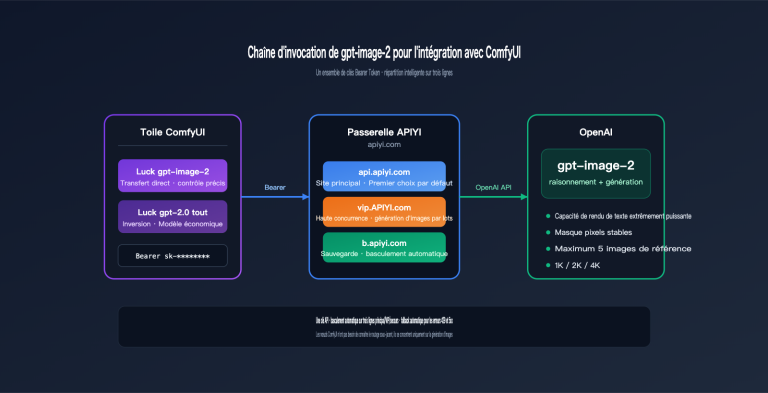

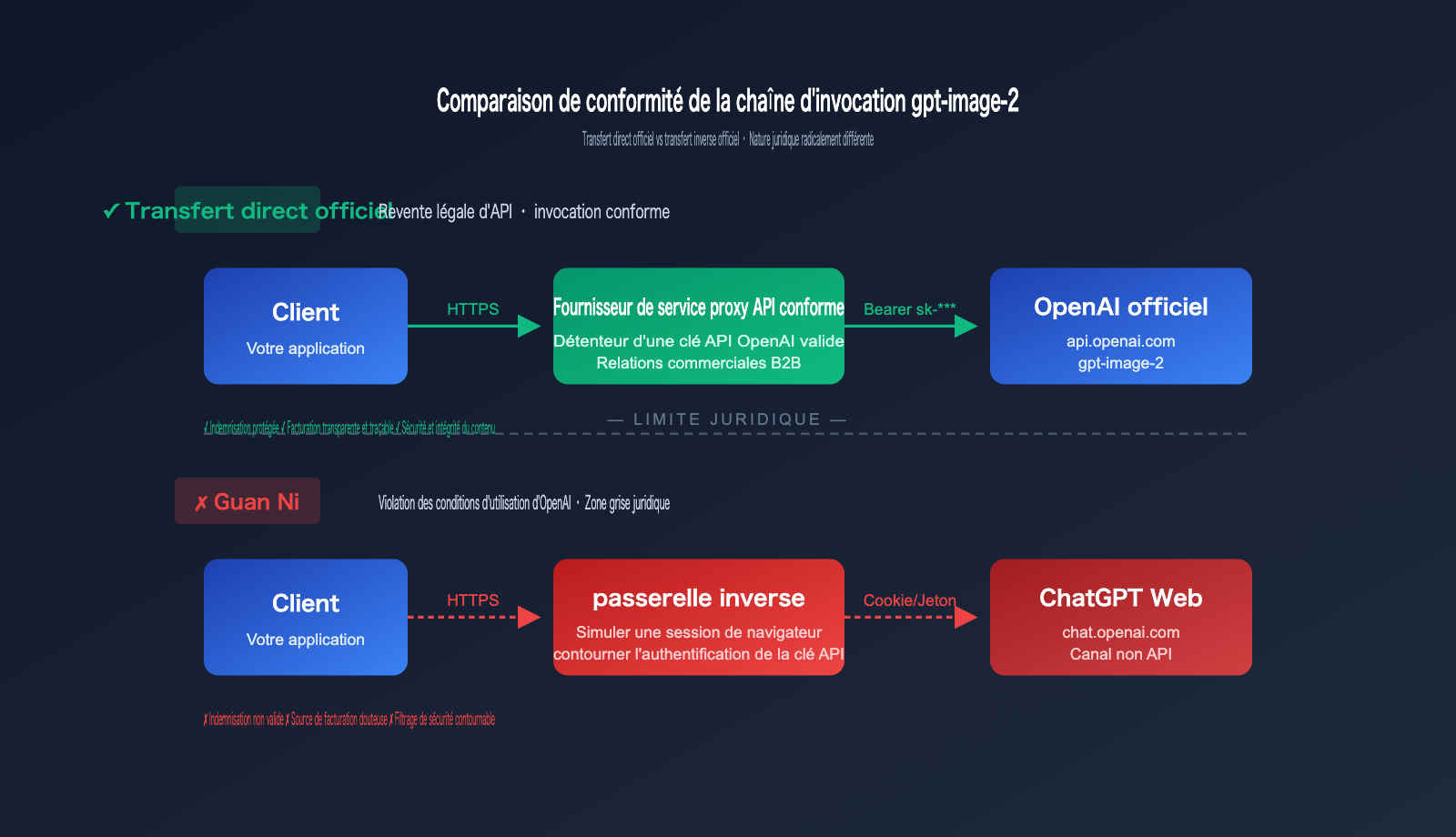

I. Deux canaux à distinguer avant toute intégration de gpt-image-2

Pour le service juridique en Chine, l'examen de conformité des services d'IA ne porte pas sur le modèle lui-même, mais sur la question de savoir si "la chaîne d'appel peut être retracée jusqu'à une autorisation légale". C'est pourquoi il faut d'abord clarifier le rôle du "fournisseur de service proxy API".

1.1 Relais officiel vs Inversion : La différence fondamentale de nature juridique

| Type de canal | Implémentation technique | Méthode d'authentification OpenAI | Source de facturation | Qualification juridique |

|---|---|---|---|---|

| Relais officiel (Relay) | Le fournisseur détient une clé API OpenAI légale, reçoit et relaie les requêtes | Standard Authorization: Bearer sk-xxx |

Payé via la facture officielle OpenAI | Revente légale d'API |

| Inversion (Reverse) | Session/compte web ChatGPT inversé, contourne l'authentification API | Simulation de session/cookie de navigateur | Rotation de comptes multiples / contournement de facturation | Violation des ToS d'OpenAI, zone grise juridique |

| Auto-hébergé (Self-hosted) | L'entreprise détient sa propre clé API et appelle directement | Sa propre clé | Paiement direct | Utilisateur standard, totalement conforme |

Jugement clé : Lorsque vous envoyez une requête à un point de terminaison tel que https://api.example.com/v1/images/generations, vous devez savoir comment le fournisseur accède réellement à OpenAI en arrière-plan.

🎯 Note importante : Lors du choix d'un service proxy, assurez-vous que le fournisseur utilise un canal de relais officiel. Par exemple, la plateforme APIYI (apiyi.com) accède à l'API officielle d'OpenAI et utilise en interne des clés API de niveau entreprise légalement détenues, entretenant une relation commerciale B2B standard avec OpenAI. Ce point détermine les limites de conformité pour les entreprises utilisatrices en aval.

1.2 Pourquoi l'inversion expose l'entreprise à des risques solidaires

Les [Conditions de service] d'OpenAI stipulent explicitement que les utilisateurs de l'API ne doivent pas "contourner, entraver ou perturber les restrictions d'accès d'OpenAI". Si le fournisseur réalise l'intégration par inversion de ChatGPT :

- La responsabilité contractuelle se transmet le long de la chaîne : Le fournisseur viole le contrat → L'entreprise, en tant qu'utilisateur en aval, peut toujours être considérée comme "en violation indirecte" même si elle prouve qu'elle n'était pas au courant.

- L'indemnisation d'OpenAI ne s'applique pas : Nous expliquerons cela en détail plus loin, mais en bref, avec un canal inversé, vous ne bénéficiez pas de la protection d'"indemnisation" d'OpenAI contre les allégations de violation de propriété intellectuelle par des tiers.

- Les mécanismes de sécurité du contenu peuvent être contournés : Les canaux inversés modifient souvent les paramètres de sécurité comme la

modération, ce qui peut entraîner la génération d'images par l'entreprise qui tombent sous le coup de catégories strictement interdites par OpenAI, sans que l'entreprise ne le sache.

1.3 Comment identifier rapidement le type de canal de relais

Lors de la vérification préalable des fournisseurs de services, l'équipe juridique de l'entreprise peut utiliser les questions suivantes pour une identification rapide :

✅ Trois questions pour juger de la conformité du canal

Q1 : "Veuillez fournir une preuve de votre relation de service API avec OpenAI

(par exemple, type de compte OpenAI, capture d'écran du compte entreprise, facture mensuelle)"

Q2 : "Le point de terminaison que vous appelez est-il api.openai.com ou une interface

dérivée de chat.openai.com ?"

Q3 : "Si notre requête déclenche la modération de contenu d'OpenAI,

le code d'erreur est-il renvoyé tel quel ? Ou a-t-il été réécrit par vos soins ?"

Le relais officiel peut généralement répondre directement aux deux premières questions, et la réponse à la troisième question est "renvoi tel quel 400/safety_violations". L'inversion est souvent évasive ou refuse de fournir des justificatifs.

二、OpenAI 官方条款下的 gpt-image-2 商用边界

Une fois la conformité du canal confirmée, le point juridique suivant est crucial : « Pouvons-nous utiliser directement les images générées à des fins commerciales ? » Cette question est régie par trois documents : les Conditions d'utilisation (Terms of Use), les Conditions de service (Service Terms) et les Politiques d'utilisation (Usage Policies) d'OpenAI.

2.1 Propriété des résultats : OpenAI les cède explicitement à l'utilisateur

L'article 3 "Content" des Conditions d'utilisation d'OpenAI stipule clairement :

"OpenAI hereby assigns to you all its right, title and interest in and to Output."

Points clés à retenir :

- L'utilisateur conserve la propriété de ses entrées (Input).

- L'utilisateur détient l'intégralité des droits sur les sorties (Output), OpenAI transférant activement ces droits à l'utilisateur.

- Cela signifie que, sur le plan juridique, vous êtes le titulaire des droits sur les images générées par

gpt-image-2.

2.2 Étendue de l'usage commercial : Tous les actes commerciaux, y compris la revente

| Usage commercial | Autorisé ? | Base juridique OpenAI |

|---|---|---|

| Usage interne (promotion, PPT, prototypes) | ✅ Oui | Terms §3 |

| Publicité et marketing | ✅ Oui | Terms §3 |

| Emballage de produits / Supports imprimés | ✅ Oui | Terms §3 |

| Vente de produits dérivés / Vente directe d'images | ✅ Oui | Terms §3 |

| Revente en tant que service SaaS (API vers clients) | ✅ Oui | Terms §3 + Service Terms |

| Entraînement de modèles concurrents | ❌ Non | Service Terms §2(c) |

Ligne rouge unique : Il est interdit d'utiliser les sorties de gpt-image-2 pour entraîner tout modèle concurrent des services d'OpenAI. C'est le seul usage commercial explicitement proscrit par OpenAI.

🎯 Conseil pour les entreprises : Si votre activité consiste à fournir un service SaaS de génération d'images par IA à vos clients, cette voie est autorisée par les conditions d'OpenAI. Nous recommandons d'utiliser la plateforme APIYI (apiyi.com) pour tester plusieurs modèles. Cette plateforme prend en charge une interface unifiée pour

gpt-image-2,Imagen 4,Flux 1.1 Proet d'autres modèles majeurs, facilitant ainsi la sélection technique tout en restant conforme.

2.3 La réalité de la protection des droits d'auteur : "Posséder" n'est pas "revendiquer"

C'est le point qui prête le plus à confusion pour les services juridiques. Le fait qu'OpenAI vous "cède" ses droits ne signifie pas que l'image bénéficie automatiquement d'une protection par le "droit d'auteur".

| Dimension | Conditions d'OpenAI | Droit d'auteur (Pratique judiciaire courante) |

|---|---|---|

| Propriété | OpenAI transfère tous les droits à l'utilisateur | Variable selon les cas |

| Droits d'auteur complets | Non garanti | Bureau du droit d'auteur (USA) : Pas de copyright pour le 100% IA ; certains précédents en Chine reconnaissent la contribution humaine |

| Droits commerciaux | Totalement autorisés, y compris la revente | N'affecte pas le droit d'auteur (ce sont des droits contractuels distincts) |

| Protection contre le vol | Aucune exclusivité promise | Difficile de revendiquer une violation du droit d'auteur |

Conclusion pratique : Vous pouvez utiliser les images de gpt-image-2 à des fins commerciales en toute sérénité, mais ne présumez pas qu'elles bénéficient de la même protection qu'une œuvre créée par un designer. Pour des actifs à haute valeur ajoutée (logos, mascottes de marque), nous suggérons qu'un designer humain effectue une création secondaire substantielle sur la base de l'image générée par l'IA afin de garantir la possibilité de revendiquer des droits d'auteur.

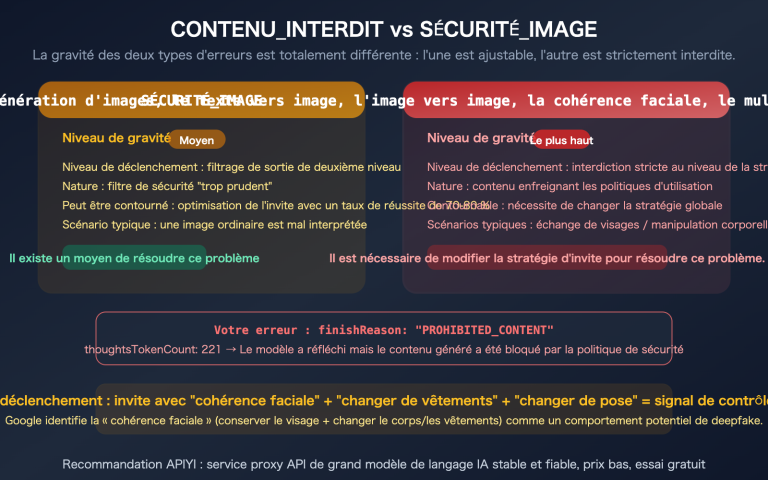

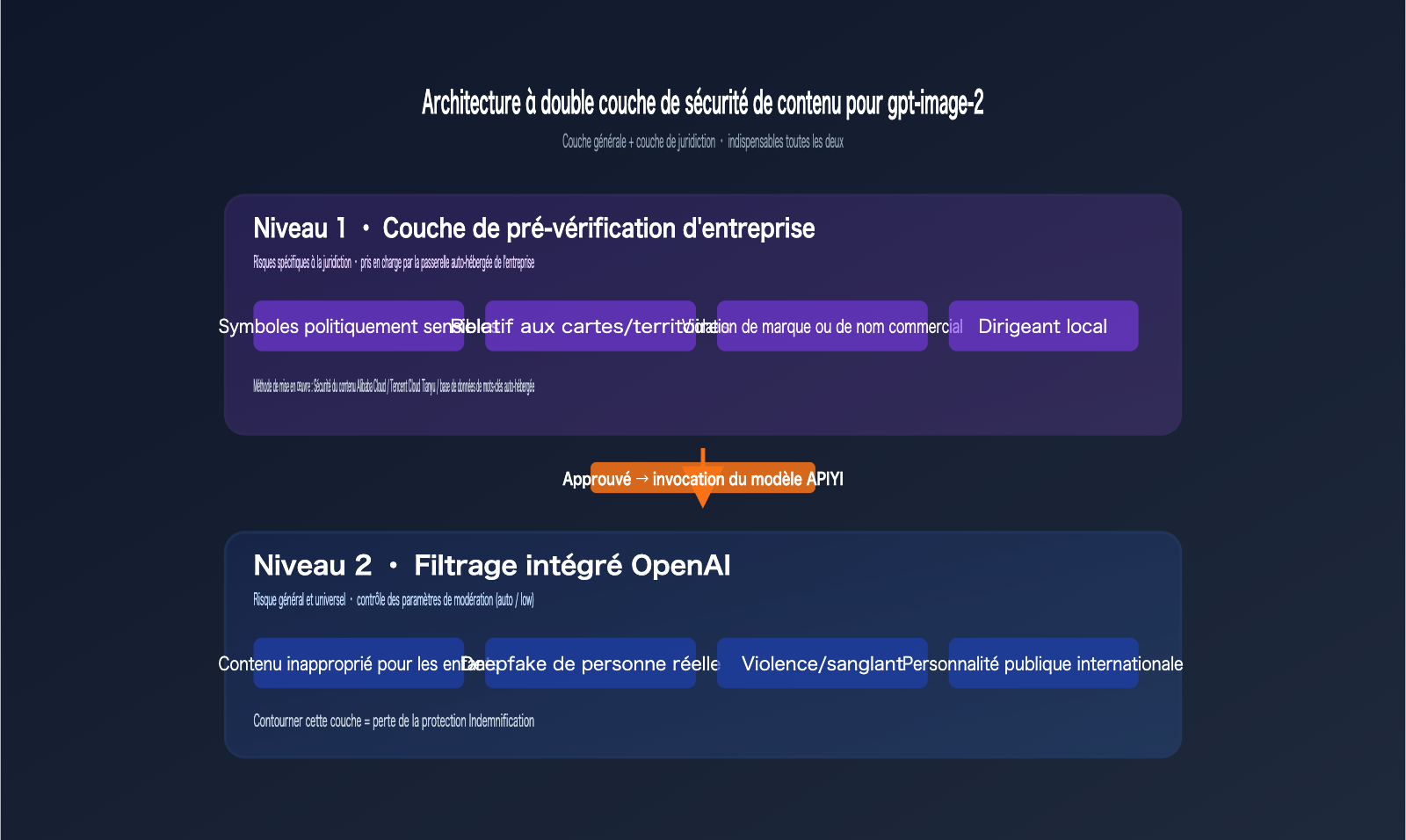

三、Mécanismes de sécurité du contenu de gpt-image-2 et obligations de contrôle préalable

La sécurité du contenu chez OpenAI est un aspect souvent sous-estimé de la conformité. De nombreux services juridiques pensent à tort que "les filtres de sécurité du modèle suffisent", ce qui est une erreur dangereuse.

3.1 Les deux niveaux de sécurité intégrés dans gpt-image-2

L'API gpt-image-2 intègre deux niveaux de contrôle de sécurité lors de la génération :

# Premier niveau : vérification de l'invite (avant la génération)

# Second niveau : vérification de l'image générée (avant le renvoi)

# Paramètres contrôlables par l'entreprise :

{

"model": "gpt-image-2",

"prompt": "votre invite ici",

"moderation": "auto", # Valeur par défaut, filtrage standard

# "moderation": "low", # Optionnel, filtrage plus souple, mais impossible à désactiver

"size": "1024x1024",

"quality": "high"

}

Important : Le paramètre moderation ne peut être choisi qu'entre auto (par défaut) et low. Il n'y a pas d'option "off". Cela signifie qu'OpenAI conserve toujours un filtrage minimal (contenus nuisibles aux mineurs, deepfakes de personnalités publiques, etc.), qui sera appliqué quel que soit le mode choisi.

3.2 Catégories de contenu non couvertes par les filtres d'OpenAI

Les filtres d'OpenAI se concentrent sur les risques universels, mais ne couvrent pas les risques spécifiques à la juridiction locale de l'entreprise :

| Catégorie de risque | Filtrage OpenAI | Exigences en Chine continentale |

|---|---|---|

| Contenu inapproprié pour mineurs | ✅ Filtrage fort | ✅ Cohérent |

| Deepfakes de personnes réelles | ✅ Filtrage fort | ✅ Cohérent |

| Violence / Sang | ⚠️ Selon la gravité | ✅ Contrôle strict |

| Symboles politiquement sensibles | ⚠️ Partiel | ❗️ Nécessite un contrôle préalable |

| Image de dirigeants nationaux | ⚠️ Couvre seulement les personnalités internationales | ❗️ Nécessite un contrôle préalable |

| Cartes / Territoires | ❌ Non couvert | ❗️ Nécessite un contrôle préalable |

| Logos commerciaux / Violation de marque | ❌ Non couvert | ❗️ Nécessite un contrôle préalable |

Enseignement clé : La sécurité d'OpenAI constitue une couche générique. Les entreprises opérant en Chine continentale ont des obligations de conformité au niveau juridictionnel. Même en utilisant un canal conforme pour gpt-image-2, l'entreprise doit mettre en place un "contrôle de contenu préalable" sur son client ou sa propre passerelle.

🎯 Conseil d'intégration : En pratique, nous recommandons aux entreprises d'utiliser une API de sécurité de contenu locale (comme Alibaba Cloud Content Security ou Tencent Cloud Tianyu) pour filtrer les mots-clés de l'invite avant d'appeler

gpt-image-2. Une fois l'image reçue, effectuez une seconde vérification via une API de contrôle de contenu visuel. Les plateformes de service proxy API comme APIYI (apiyi.com) renvoient les codes d'erreursafety_violationsd'OpenAI tels quels, ce qui facilite la journalisation unifiée des résultats des deux niveaux de contrôle.

3.3 Sécurité, conformité et lien fort avec l'indemnisation

C'est le détail juridique le plus souvent négligé. L'article 7 des Conditions de service d'OpenAI prévoit une clause d'Indemnisation (Indemnification) :

Lorsqu'un utilisateur de l'API utilise les résultats dans un cadre légal et qu'il fait l'objet d'une poursuite pour violation de propriété intellectuelle par un tiers, OpenAI prendra en charge les frais de défense et d'indemnisation raisonnables.

Cependant, cette protection comporte deux conditions d'exclusion :

- L'utilisateur sait ou devrait savoir que le résultat pourrait être contrefaisant, et l'utilise quand même.

- L'utilisateur a désactivé ou contourné les mécanismes de sécurité fournis par OpenAI.

Implication pratique : Si vous insistez pour utiliser moderation: low, ou si vous contournez les filtres de sécurité d'OpenAI par des moyens techniques, vous renoncez activement à la protection par indemnisation. Même si vous obtenez une sortie d'API parfaite, si vous êtes poursuivi pour contrefaçon, OpenAI ne viendra pas assurer votre défense.

IV. Conformité du transfert de données pour gpt-image-2 : PIPL et Loi sur la sécurité des données

Pour les entreprises en Chine continentale, l'intégration de gpt-image-2 soulève une question plus fondamentale et prioritaire que le simple choix d'un service proxy API : la conformité du transfert de données hors des frontières. C'est un sujet hautement surveillé par les services juridiques, mais que beaucoup d'équipes techniques négligent lors de la sélection de leurs solutions.

4.1 Quelles données sont considérées comme étant "transférées hors des frontières" ?

Les serveurs de traitement de l'API OpenAI étant situés aux États-Unis, toute requête envoyée à gpt-image-2 implique un transfert de données hors du territoire. Dans le cadre de la génération d'images, les données suivantes sont transmises :

| Type de données | Transfert hors frontières | Sensibilité PIPL |

|---|---|---|

| Texte de l'invite | ✅ Oui | Selon le contenu |

| Image de référence (scénario image vers image) | ✅ Oui | Élevée (peut contenir des visages/scènes) |

| Image générée | ✅ Oui (retour après transfert) | Moyenne |

| IP/UA de l'utilisateur | ✅ Oui (si connexion directe) | Faible |

| Données métier associées (user_id, session_id) | ⚠️ Selon l'implémentation | Moyenne |

🎯 Conseil pour le flux de données : Utilisez un service proxy API conforme en Chine (comme la plateforme APIYI apiyi.com). L'invite arrive d'abord sur un serveur national avant d'être transmise via le réseau local, ce qui réduit les risques de conformité liés à une "connexion directe de l'utilisateur final vers l'étranger". L'architecture d'entrée nationale de cette plateforme répond aux exigences de conformité de la PIPL pour le rôle de "responsable du traitement des données".

4.2 Les trois voies de conformité sous le cadre de la PIPL

L'article 38 de la Loi sur la protection des informations personnelles (PIPL) définit trois voies pour le transfert de données hors des frontières :

Voie 1 : Évaluation de sécurité organisée par l'administration du cyberespace

- Application : Opérateurs d'infrastructures critiques, traitement de plus d'un million de données personnelles

- Difficulté : ★★★★★ (Évaluation gouvernementale, cycle de 6 à 12 mois)

Voie 2 : Certification de protection des informations personnelles

- Application : Entreprises générales, via une certification par un organisme professionnel

- Difficulté : ★★★ (Certification par organisme, cycle de 2 à 3 mois)

Voie 3 : Dépôt de contrat type (SCC)

- Application : La plupart des entreprises, signature d'un contrat type et dépôt

- Difficulté : ★★ (Relativement simple, mais nécessite un suivi réglementaire)

Pour l'intégration de gpt-image-2, la grande majorité des entreprises relèvent de la voie 3 (contrat type). Cela signifie que vous devez :

- Signer un accord incluant les clauses SCC avec vos utilisateurs finaux.

- Évaluer la nature et la sensibilité des données transférées.

- Effectuer le dépôt auprès du bureau local de l'administration du cyberespace.

4.3 Bonnes pratiques pour réduire la sensibilité des données transférées

Sans nuire à votre activité, plusieurs méthodes permettent de réduire la complexité de la conformité :

| Méthode | Coût d'implémentation | Gain en conformité |

|---|---|---|

| Modèles d'invite standardisés (éviter l'insertion dynamique de données privées) | Faible | Élevé |

| Anonymisation des images de référence (floutage de visage/remplacement de fond) | Moyen | Élevé |

| Hachage des ID utilisateur (ne pas transmettre le vrai user_id) | Faible | Moyen |

| Prétraitement local (filtrage des mots-clés sensibles) | Moyen | Élevé |

| Service proxy API conforme (traitement délégué à un prestataire local) | Faible | Élevé |

4.4 Correspondance entre conformité PIPL et activité gpt-image-2

| Scénario métier | Complexité des données transférées | Voie de conformité recommandée |

|---|---|---|

| Illustration de documents internes | Faible (pas de données personnelles) | Dépôt de contrat type suffisant |

| Génération de supports marketing (sans visage) | Faible | Dépôt de contrat type |

| Génération de profils utilisateur (avec visage) | Élevée | Certification PIPL + SCC |

| Photos de produits e-commerce (avec mannequin) | Moyenne | Dépôt de contrat type + autorisation droit à l'image |

| Génération d'avatars réseaux sociaux (avec photo utilisateur) | Élevée | Certification PIPL + Consentement spécifique de l'utilisateur |

V. 8 points de contrôle juridiques pour l'intégration de gpt-image-2 en entreprise

Voici une synthèse des analyses précédentes sous forme de liste de contrôle, prête à être transmise à votre équipe juridique ou de conformité.

5.1 Checklist complète (par ordre d'approbation)

| N° | Point de contrôle | Norme de validation | Niveau de risque |

|---|---|---|---|

| 1 | Type de canal du service proxy API | Doit être un accès officiel, avec preuve de facturation OpenAI | Élevé |

| 2 | Qualifications du fournisseur | Société légalement enregistrée (domestique/étrangère), avec licences d'exploitation | Élevé |

| 3 | Chemin de transmission des données | Clarifier si l'invite/l'image est chiffrée (SSL) et si elle est stockée | Moyen |

| 4 | Couche de modération préalable | Mécanisme double : vérification de l'invite + vérification de l'image générée | Élevé |

| 5 | Stratégie du paramètre moderation |

Utilisation par défaut sur auto ; si low est requis, une dérogation écrite est nécessaire |

Moyen |

| 6 | Déclaration de limites commerciales | Clause dans les CGU interdisant l'utilisation pour entraîner des modèles concurrents | Moyen |

| 7 | Transfert de propriété des images | Accord explicite sur la propriété avec les clients finaux | Moyen |

| 8 | Plan de réponse aux incidents | Procédure de traitement en cas de plainte ou de litige lié à une image générée | Élevé |

5.2 Différences de priorité selon le rôle de l'entreprise

| Rôle de l'entreprise | Points de contrôle prioritaires | Focus juridique |

|---|---|---|

| Appel direct (usage interne) | 1, 4, 5 | Conformité du canal, sécurité du contenu |

| Fournisseur SaaS (revente) | 1, 6, 7 | Limites commerciales, droits contractuels avec les clients |

| Société cotée / Entreprise d'État | Les 8 points | Piste d'audit complète, preuves traçables |

| E-commerce transfrontalier | 1, 4, 7 | Conformité multi-juridictionnelle, gestion des droits |

🎯 Conseil d'intégration : Pour les sociétés cotées et les entreprises d'État, nous recommandons de privilégier les fournisseurs de services proxy API capables de fournir des factures officielles, des paiements par virement bancaire et des accords SLA. La plateforme APIYI (apiyi.com) prend en charge la facturation pour les comptes entreprises et permet la signature d'accords de service formels, répondant ainsi à toutes les exigences d'audit de conformité.

5.3 Modèle de « Lettre d'engagement de conformité du fournisseur »

Pour intégrer cette checklist au niveau contractuel, il est conseillé d'exiger du fournisseur qu'il confirme par écrit les clauses suivantes :

Clauses clés de la lettre d'engagement de conformité (pour le service juridique)

1. Conformité du canal : Le fournisseur s'engage à ce que toutes les

requêtes API soient transmises via le point de terminaison officiel

d'OpenAI (api.openai.com), sans ingénierie inverse ni contournement

de l'authentification.

2. Conservation des preuves : Le fournisseur s'engage à conserver les

preuves de sa relation de service avec OpenAI pendant au moins 36 mois

et à les fournir lors des audits de conformité du client.

3. Transparence des paramètres de sécurité : Le fournisseur s'engage à

ne pas modifier le paramètre 'moderation' transmis par le client sans

notification écrite préalable.

4. Transmission des codes d'erreur : Le fournisseur s'engage à transmettre

au client, sans modification, tous les codes d'erreur liés aux

violations de sécurité ou de politique d'OpenAI.

5. Non-conservation des données : Le fournisseur s'engage à ne stocker

l'invite et l'image que temporairement pendant le traitement, et à les

supprimer dans les N heures suivant l'opération.

VI. Intégration pratique de gpt-image-2 : Exemple de code minimal conforme

Maintenant que les aspects juridiques sont couverts, voici un exemple de code minimal exécutable avec modération préalable, pour aider votre équipe technique à établir une base de conformité.

6.1 Code d'appel minimaliste

# pip install openai

from openai import OpenAI

# Via un proxy conforme (ex: APIYI apiyi.com), en conservant l'appel standard du SDK OpenAI

client = OpenAI(

api_key="sk-votre-cle",

base_url="https://api.apiyi.com/v1" # Remplacer par le point de terminaison du proxy

)

response = client.images.generate(

model="gpt-image-2",

prompt="Un espace de travail de bureau minimaliste moderne, éclairage naturel",

size="1024x1024",

quality="high",

moderation="auto" # Valeur par défaut, conserve la protection Indemnification

)

print(response.data[0].url)

📦 Version complète avec double vérification (cliquer pour dérouler)

import os

import logging

from openai import OpenAI

from openai import BadRequestError

# Remplacer par votre point de terminaison conforme, ex: APIYI apiyi.com

client = OpenAI(

api_key=os.environ["OPENAI_API_KEY"],

base_url="https://api.apiyi.com/v1"

)

def pre_check_prompt(prompt: str) -> bool:

"""

Vérification préalable : Appel à une API de sécurité du contenu locale

Exemple, à remplacer par votre service de sécurité du contenu

"""

forbidden_keywords = [

# Mots-clés sensibles

"dirigeants politiques", "termes politiquement sensibles",

# Risques commerciaux

"nom de marque connue + contrefaçon", "logo concurrent"

]

return not any(kw in prompt for kw in forbidden_keywords)

def post_check_image(image_url: str) -> bool:

"""

Vérification a posteriori : Appel à une API de vérification d'image

"""

# Dans un environnement réel, appeler un service de sécurité d'image

return True

def generate_compliant_image(prompt: str):

# Étape 1 : Vérification préalable

if not pre_check_prompt(prompt):

logging.warning("L'invite n'a pas passé la vérification préalable")

return None

# Étape 2 : Appel à gpt-image-2

try:

response = client.images.generate(

model="gpt-image-2",

prompt=prompt,

size="1024x1024",

quality="high",

moderation="auto" # Doit rester par défaut pour conserver l'Indemnification

)

image_url = response.data[0].url

except BadRequestError as e:

# Les safety_violations d'OpenAI sont transmises ici

logging.error(f"OpenAI a refusé la génération : {e}")

return None

# Étape 3 : Vérification a posteriori

if not post_check_image(image_url):

logging.warning("L'image n'a pas passé la vérification a posteriori")

return None

return image_url

if __name__ == "__main__":

url = generate_compliant_image(

"Un espace de travail de bureau minimaliste moderne, éclairage naturel"

)

print(f"URL de l'image conforme : {url}")

6.2 Journalisation à trois niveaux : Pour les audits juridiques

Un détail souvent négligé dans les intégrations conformes est la conservation des journaux (logs). Voici les trois niveaux de journaux recommandés :

[L1] Journaux de couche requête

- request_id, timestamp, user_id

- prompt (anonymisé ou haché)

- valeur du paramètre moderation

[L2] Journaux de couche réponse

- status_code retourné par OpenAI

- En cas de safety_violations, enregistrer le type d'erreur

- url et hash de l'image générée

[L3] Journaux de couche vérification

- Résultat (accepté/refusé) de la vérification préalable

- Résultat (accepté/refusé) de la vérification a posteriori

- Raison du refus et mots-clés détectés

🎯 Conseil de conservation des logs : Les audits juridiques exigent généralement une conservation des journaux complets pendant au moins 6 à 12 mois. APIYI (apiyi.com) propose des capacités de recherche de journaux au niveau de la requête pour les entreprises, permettant de filtrer par user_id, plage horaire ou type d'erreur, facilitant ainsi vos audits de conformité internes.

VII. Matrice de risques pour gpt-image-2 : Priorités de conformité par cas d'usage

Tous les scénarios d'application de gpt-image-2 ne nécessitent pas une "conformité totale". Fournir à votre équipe juridique une matrice de risques permet aux équipes métier de prioriser l'allocation des ressources de conformité.

7.1 Matrice de risques (selon les axes "Sensibilité des données" × "Usage commercial")

| Cas d'usage | Sensibilité des données | Usage commercial | Risque global | Niveau de conformité recommandé |

|---|---|---|---|---|

| Illustrations PPT internes | Faible | Faible (usage interne) | 🟢 Faible | Basique : Enregistrement SCC |

| Supports marketing (sans visage) | Faible | Moyen (publication externe) | 🟡 Moyen | Standard : SCC + filtrage de contenu général |

| Images produits e-commerce | Moyen | Élevé (vente directe) | 🟡 Moyen | Standard : SCC + vérification IP/marques |

| Génération d'avatars (avec visage) | Élevé | Moyen (usage utilisateur) | 🟠 Élevé | Avancé : Certification PIPL + consentement spécifique |

| Génération d'images de célébrités | Élevé | N'importe lequel | 🔴 Très élevé | Déconseillé : Risque juridique trop important |

| Projets gouvernementaux/publics | Élevé | Faible | 🟠 Élevé | Avancé : Évaluation de sécurité + alternative locale |

| Revente SaaS | Moyen | Élevé | 🟠 Élevé | Avancé : Chaîne de conformité complète + CGU |

7.2 Trois parcours de conformité types pour les entreprises

Type A : PME (moins de 100 employés)

Stratégie de conformité : Pragmatique

- Canal : Choisir un service proxy API local réputé

- Documentation : Contrat standard (SCC) suffisant

- Filtrage de contenu : API de sécurité de contenu (Alibaba Cloud/Tencent Cloud)

- Journaux : Conservation sur 6 mois

- Budget : 50 000 - 100 000 RMB / an

Type B : Grande entreprise / Société cotée

Stratégie de conformité : Rigoureuse

- Canal : Priorité aux services proxy certifiés (Xinchuang/MLPS)

- Documentation : Contrat standard + certification PIPL + manuel de conformité interne

- Filtrage de contenu : Double vérification + échantillonnage manuel

- Journaux : Conservation sur 12 mois, auditables

- Budget : 300 000 - 500 000 RMB / an

Type C : Entreprise d'État / Projet gouvernemental

Stratégie de conformité : Évitement des risques

- Canal : Uniquement prestataires certifiés, priorité aux modèles locaux

- Documentation : Évaluation de sécurité par l'administration du cyberespace

- Filtrage de contenu : Triple vérification (pré-traitement/intermédiaire/post-traitement)

- Journaux : 36 mois et plus, piste d'audit complète

- Budget : 1 million RMB+ / an

7.3 Plan de réponse aux incidents de conformité

Peu importe la qualité de votre conformité, un plan d'urgence est indispensable. Les risques liés à gpt-image-2 se divisent en trois catégories :

| Type d'incident | Scénario déclencheur | Réponse immédiate | Action sous 7 jours |

|---|---|---|---|

| Plainte pour violation de droits d'auteur | Réclamation IP d'un tiers | Retrait immédiat de l'image | Lancer la procédure d'indemnisation OpenAI |

| Fuite de contenu illicite | Notification des autorités | Suspension du service, retrait du contenu | Coopération avec l'enquête, soumission des logs |

| Problème de conformité du proxy | Prestataire sanctionné / faillite | Basculement vers un point de terminaison de secours | Évaluation des risques, notification aux utilisateurs |

| Attaque par injection de prompt | Contournement des filtres | Désactivation temporaire des entrées utilisateur | Mise à jour du mécanisme de filtrage |

🎯 Renforcement des capacités d'urgence : Une réponse efficace nécessite que le prestataire de service proxy fournisse une capacité de "recherche rapide dans les logs au niveau de la requête". APIYI (apiyi.com) propose des interfaces de logs de niveau entreprise, permettant une recherche en temps réel par

request_id,user_id, plage horaire ou type d'erreur, réduisant considérablement les délais de réponse lors d'audits ou de plaintes.

7.4 Équilibre entre coûts de conformité et valeur métier

Voici une vue d'ensemble du retour sur investissement (ROI) des efforts de conformité :

| Poste d'investissement | Coût initial | Coût récurrent | Valeur métier |

|---|---|---|---|

| Choisir le bon canal proxy | 0 | Proche de 0 | ⭐⭐⭐⭐⭐ |

| Déployer une double vérification | 50k-150k | 10k-20k/mois | ⭐⭐⭐⭐⭐ |

| Enregistrement SCC | 20k-50k | 0 | ⭐⭐⭐⭐ |

| Certification PIPL | 100k-300k | 0 | ⭐⭐⭐ |

| Évaluation de sécurité | 500k-1M | 0 | ⭐⭐⭐ |

| Système complet de logs d'audit | 50k-100k | 10k/mois | ⭐⭐⭐⭐⭐ |

Conclusion : Choisir le bon canal proxy est la décision de conformité avec le meilleur ROI : le coût est quasi nul, mais cela couvre plus de 60 % des risques de conformité.

VIII. FAQ juridique sur la conformité de gpt-image-2

Q1 : Si notre entreprise est en Chine, l'utilisation directe de gpt-image-2 est-elle considérée comme un "accès illégal à un service étranger" ?

Non. Les lois chinoises sur la cybersécurité et la sécurité des données n'interdisent pas aux entreprises d'accéder à des API étrangères pour leurs besoins métier. Les points clés sont : (a) la conformité du transfert de données hors frontières (le prompt contient-il des données personnelles ?) ; (b) le prestataire a-t-il une entité légale en Chine ? Passer par un service proxy conforme réduit considérablement les frictions juridiques.

Q2 : Si un problème survient, qui est responsable ?

La responsabilité doit être définie par strates contractuelles :

- OpenAI : Responsable des violations de propriété intellectuelle (sous réserve d'une utilisation conforme, via l'indemnisation).

- Prestataire proxy : Responsable de la conformité du canal, de l'authenticité des clés API et de la précision de la facturation.

- Entreprise : Responsable de la légalité des entrées, de l'usage final et des CGU.

- Utilisateur final : Responsable de l'usage secondaire (si vous êtes un fournisseur SaaS).

Q3 : Quelles sont les différences juridiques entre gpt-image-2 et gpt-image-1 ?

Au niveau des conditions d'utilisation, il n'y a pas de changement. Cependant, gpt-image-2 introduit un raisonnement agentique, ce qui signifie que le filtrage de sécurité sera plus intelligent mais aussi plus strict. Il est conseillé aux équipes juridiques de demander un test de régression sur les anciens prompts lors de la montée de version.

Q4 : Peut-on enregistrer le droit d'auteur des images générées par gpt-image-2 ?

Théoriquement oui, mais le taux de succès varie selon la juridiction :

- États-Unis : Refusent explicitement les contenus générés uniquement par IA.

- Chine : Certains tribunaux reconnaissent la contribution créative de l'ingénieur de prompt, mais au cas par cas.

- Europe : Très conservateur.

Conseil pratique : Pour les actifs IP clés (logos, personnages), effectuez une retouche substantielle par un designer après la génération initiale pour augmenter vos chances.

Q5 : Si le prestataire proxy fait faillite, les images générées restent-elles utilisables ?

Oui. OpenAI attribue la propriété des images à l'utilisateur ayant appelé l'API. C'est un droit contractuel indépendant du prestataire. Assurez-vous simplement de conserver les logs de requête/réponse comme preuve.

Q6 : Doit-on mentionner gpt-image-2 dans nos CGU / politique de confidentialité ?

Fortement recommandé. Divulguez trois points :

- L'utilisation du modèle OpenAI gpt-image-2.

- Le transfert des prompts vers OpenAI/le prestataire.

- Le périmètre d'utilisation des images générées.

Q7 : Les clients gouvernementaux peuvent-ils utiliser gpt-image-2 ?

Oui, sous deux conditions :

- Utiliser un prestataire certifié "Xinchuang/MLPS".

- Appliquer une désensibilisation stricte des prompts (aucune donnée confidentielle ou politique).

Q8 : Faut-il marquer les images générées par gpt-image-2 comme "générées par IA" ?

Fortement recommandé. La réglementation chinoise sur les services d'IA générative impose un marquage.

- Marquage explicite : Mention "Généré par IA" sur l'image ou dans les métadonnées.

- Marquage implicite : Filigrane numérique invisible.

gpt-image-2intègre par défaut les métadonnées C2PA, mais un marquage explicite reste nécessaire selon les lois locales.

Q9 : Comment gérer les droits d'auteur pour le i2i (image-to-image) ?

| Scénario | Droits de l'image source | Droits de l'image générée |

|---|---|---|

| Photo personnelle | Utilisateur | Utilisateur (création dérivée) |

| Œuvre d'un tiers | Tiers | Risque juridique élevé |

| Visage d'une célébrité | Droit à l'image | Risque juridique très élevé |

Conseil : Exigez dans vos CGU que l'utilisateur garantisse la conformité des droits sur les images importées.

Q10 : Que faire si OpenAI restreint l'accès depuis la Chine ?

Les prestataires de proxy conformes disposent généralement de nœuds à l'étranger et de configurations multi-endpoints pour basculer sans interruption. C'est l'une des raisons majeures de privilégier une solution proxy plutôt qu'une connexion directe. Inscrivez un SLA de haute disponibilité dans votre contrat.

IX. Conclusion : Les trois piliers de la conformité juridique pour gpt-image-2

Revenons à la question posée en introduction. Si vous devez répondre aux préoccupations de votre service juridique de la manière la plus concise possible, voici les trois points clés :

9.1 Trois jugements fondamentaux

✅ Jugement 1 : L'usage commercial de gpt-image-2 ne présente pas de risque juridique supplémentaire

Condition : Passer par le canal officiel + ne pas contourner les mécanismes de sécurité + ne pas utiliser pour entraîner un modèle concurrent

✅ Jugement 2 : La propriété des images générées appartient à l'entreprise utilisatrice de l'API

Attention : Propriété ne signifie pas droit d'auteur complet ; pour les actifs IP critiques, une retouche humaine est recommandée

✅ Jugement 3 : L'entreprise a une obligation de "modération de contenu préalable"

Raison : OpenAI n'effectue qu'un filtrage général ; les risques spécifiques à la juridiction locale incombent à l'entreprise

9.2 Trois recommandations d'action pour le service juridique

- Établir une liste de contrôle pour le service proxy API : Elle doit inclure au minimum trois points cruciaux : le type de canal, les qualifications de l'entité et la politique de conservation des données.

- Mettre en place un mécanisme de sécurité du contenu à double niveau : Filtrage de sécurité d'OpenAI + API de sécurité de contenu locale, pour garantir la couverture des risques spécifiques à votre juridiction.

- Instaurer un système complet de journaux d'invocation : Conservez les journaux de requêtes, de réponses et de modération pendant au moins 12 mois à des fins d'audit.

9.3 Recommandations de bonnes pratiques

🎯 Conseil global :

gpt-image-2est parfaitement sûr à utiliser dans un contexte professionnel, à condition de choisir le bon mode d'accès et de mettre en place les mécanismes de conformité adéquats. Nous recommandons aux entreprises de passer par des plateformes comme APIYI (apiyi.com), qui offrent une chaîne de conformité complète. Ces plateformes permettent une facturation adaptée aux entreprises, fournissent des journaux d'invocation complets et transmettent fidèlement les codes d'erreur de sécurité, répondant ainsi aux exigences de la plupart des équipes juridiques.

La conformité ne sert pas à bloquer l'activité, mais à mettre les risques sur la table. Lorsque vous présentez à votre équipe juridique un dossier complet comprenant "preuve de conformité du canal + double sécurité du contenu + 12 mois de journaux d'audit", l'approbation pour l'intégration de gpt-image-2 est généralement très rapide.

gpt-image-2 est l'un des modèles de génération d'images les plus puissants d'OpenAI à ce jour, excellant dans des domaines comme la résolution 2K, le rendu de texte et les compositions complexes. En faisant vos devoirs en matière de conformité, vos itérations produits et votre stratégie de commercialisation seront bien plus fluides.

Un dernier mot pour les équipes juridiques : "L'objectif d'un examen de conformité n'est pas de dire 'non', mais de définir clairement 'comment utiliser l'outil en toute sécurité'." Cet article se veut un point de départ pour votre prise de décision concernant l'adoption de gpt-image-2.

Si vous rencontrez des problèmes spécifiques lors de vos examens de conformité — comme des listes de contrôle pour les fournisseurs, des modèles de contrats SCC ou le choix d'une API de modération de contenu — ce sont des sujets que nous pourrons approfondir dans de futurs guides pratiques.

Auteur : L'équipe APIYI — Plateforme d'accès aux API de grands modèles de langage pour entreprises, apiyi.com. Nous prenons en charge l'invocation unifiée de plus de 200 modèles leaders tels que gpt-image-2, Claude 4.7 et Gemini 3 Pro, répondant aux besoins de conformité des sociétés cotées, des entreprises d'État et des entreprises internationales.

Clauses de référence : Conditions d'utilisation d'OpenAI, Conditions de service d'OpenAI, Politiques d'utilisation d'OpenAI, Politique d'indemnisation d'OpenAI. Cet article ne constitue pas un avis juridique ; pour toute décision de conformité, veuillez consulter votre service juridique ou un avocat spécialisé.