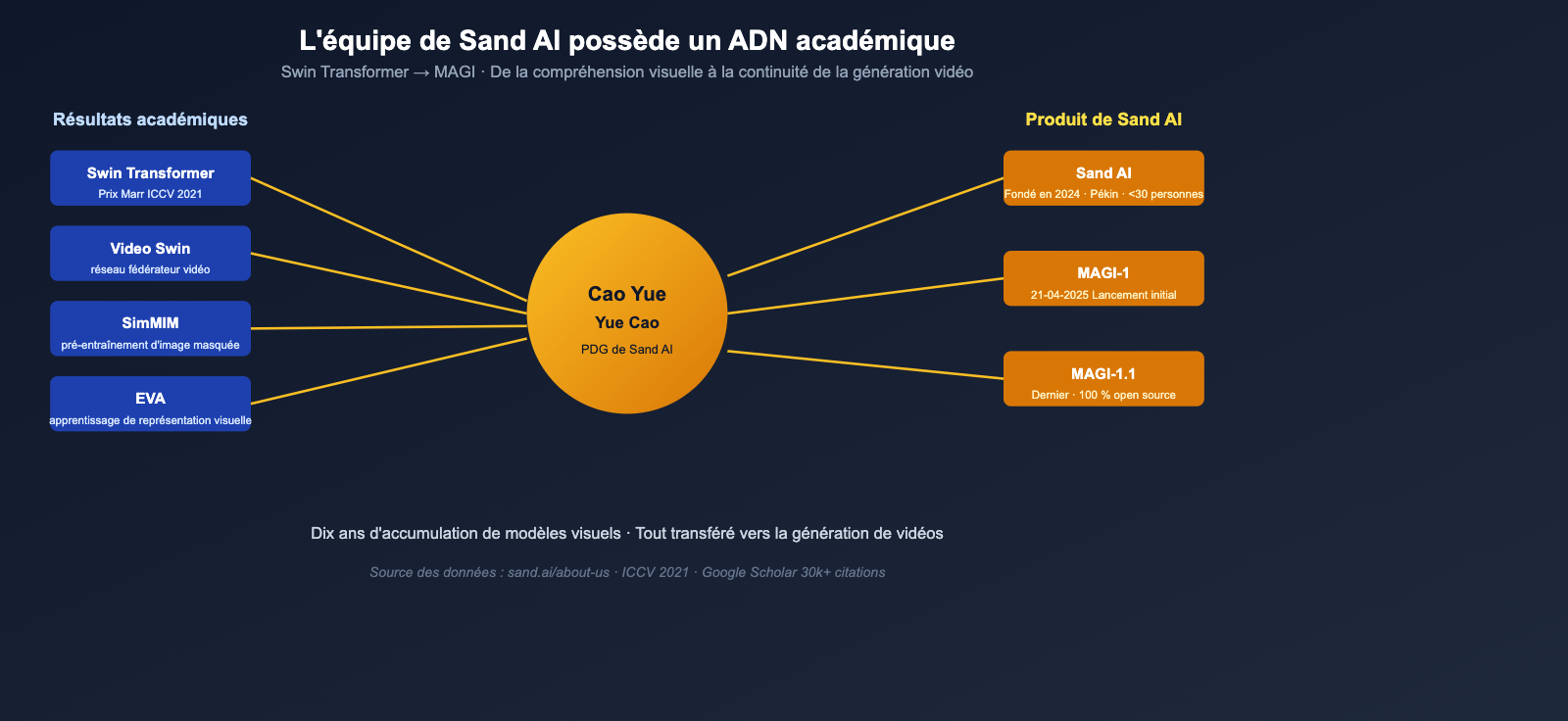

Si vous avez croisé le nom de Sand AI à plusieurs reprises sur Hugging Face, GitHub ou sur la scène IA anglophone de Twitter, et que vous êtes curieux de découvrir MAGI-1 / MAGI-1.1, cet article est fait pour vous. Contrairement à beaucoup d'équipes "sorties de nulle part" dans le domaine de la génération vidéo, Sand AI possède un pedigree technique très solide : son CEO, Cao Yue, est l'un des auteurs principaux du Swin Transformer. Ce papier a remporté le prix du meilleur article (Marr Prize) à l'ICCV 2021, cumule plus de 30 000 citations sur Google Scholar et est largement adopté par des géants comme Microsoft Office 365, Azure, TikTok ou Kuaishou. En d'autres termes, Sand AI n'est pas une équipe improvisée, mais le fruit d'une décennie d'expertise en modèles visuels, transposée à la génération vidéo par l'équipe originale du Swin Transformer.

Ce qui enthousiasme particulièrement la communauté internationale, c'est que Sand AI n'a pas seulement conçu un modèle de génération vidéo performant, mais a choisi de le rendre entièrement open source : poids complets de MAGI-1, code et outils d'inférence, le tout sous licence Apache 2.0, disponible directement sur GitHub et Hugging Face. Dans cette vague de "modèles vidéo nationaux en open source" qui marque la période 2025-2026, Sand AI est l'une des rares équipes à avoir validé et ouvert la voie de la "génération vidéo autorégressive". Cet article détaille ce qu'est Sand AI à travers 6 axes : contexte de l'entreprise, parcours du fondateur, architecture technique de MAGI, stratégie open source et public cible.

Aperçu des informations clés sur Sand AI

Avant d'entrer dans les détails, voici un tableau récapitulatif des faits essentiels pour comprendre ce qu'est Sand AI.

| Dimension | Informations publiques Sand AI |

|---|---|

| Nom anglais | Sand AI (site sand.ai) |

| Origine | Fondé par Cao Yue, auteur principal du Swin Transformer |

| Siège social | Pékin, Chine |

| Taille de l'équipe | Moins de 30 personnes, âge moyen inférieur à 30 ans |

| Mission | "Promouvoir l'IA pour le bénéfice de tous", favoriser l'open source et la collaboration ouverte |

| CEO | Cao Yue (Yue Cao), ancien responsable du centre de recherche sur les modèles visuels à l'Institut de recherche IA de Pékin (BAAI) |

| Produit phare | Modèles de génération vidéo autorégressive MAGI / MAGI-1 / MAGI-1.1 |

| Première publication | 21 avril 2025 (MAGI-1) |

| Dernière version | MAGI-1.1 (100% open source) |

| Spécifications | Versions 24B et 4.5B de paramètres |

| Licence open source | Apache 2.0, GitHub SandAI-org/MAGI-1 + Hugging Face sand-ai/MAGI-1 |

| Innovation majeure | Combinaison autorégressive + diffusion (Autoregressive Denoising Diffusion) |

| Accès Web | magi.sand.ai/app/projects |

| Plateforme API | platform.sand.ai/docs |

| Principaux concurrents | Séries Wan, HunyuanVideo, Hailuo, Sora, etc. |

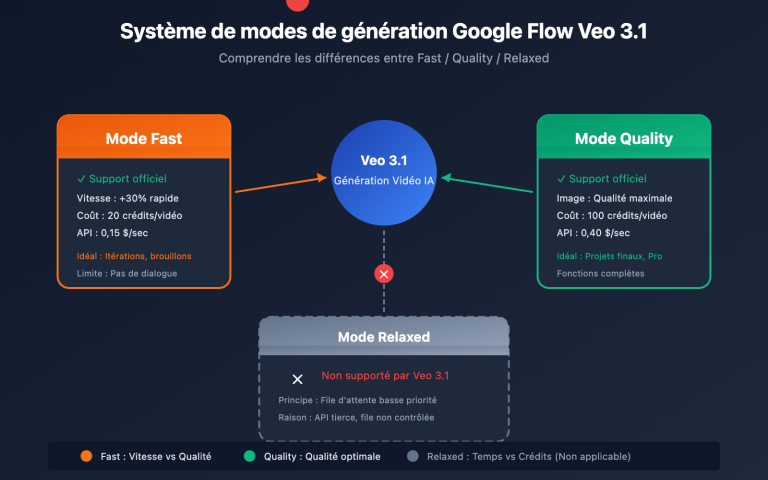

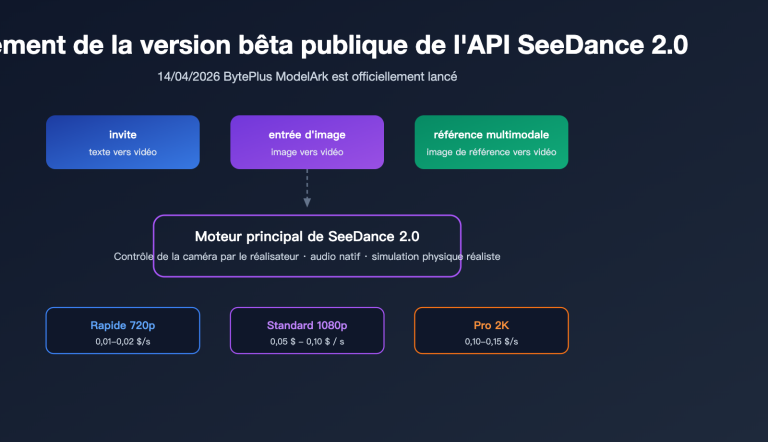

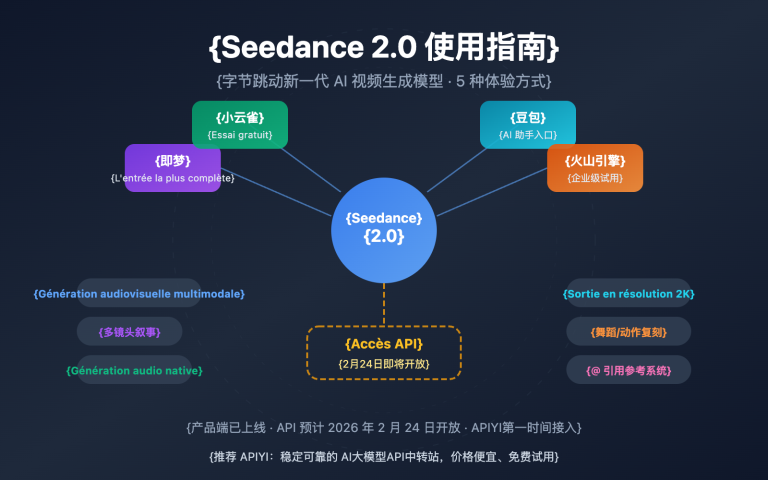

🎯 Conseil pour une compréhension rapide : Si vous ne deviez retenir qu'une phrase sur Sand AI, ce serait : "C'est une startup open source qui a transposé l'expertise en modélisation visuelle du Swin Transformer à la génération vidéo." Si vous souhaitez tester dès maintenant les différences entre MAGI et d'autres modèles vidéo, nous vous suggérons d'utiliser une plateforme unifiée comme APIYI (apiyi.com) pour tester d'abord des modèles matures comme Sora 2 / Veo 3.1 / Kling, puis de récupérer MAGI-1.1 sur sand.ai / Hugging Face pour comparer. Vous verrez immédiatement la différence apportée par l'approche "autorégressive".

Contexte de l'entreprise Sand AI et ADN de l'équipe

Pour comprendre pourquoi Sand AI a réussi à concevoir un modèle vidéo compétitif dès son lancement, il faut d'abord se pencher sur le parcours de son équipe.

Le fondateur : Cao Yue, père du Swin Transformer

Le PDG de Sand AI, Cao Yue (Yue Cao), est un nom bien connu dans la sphère de l'IA en Chine, tout comme dans le milieu académique international. Son parcours professionnel peut se résumer ainsi :

| Période | Expérience |

|---|---|

| 2019-2022 | Chercheur senior chez Microsoft Research Asia, auteur principal du Swin Transformer |

| 2021 | Le Swin Transformer remporte le prix du meilleur article (Marr Prize) à l'ICCV 2021 |

| 2022-2023 | Cofondateur de Lightyear AI (acquis plus tard par Meituan) |

| 2023-2024 | Responsable du centre de recherche sur les modèles visuels à l'Académie d'intelligence artificielle de Pékin (BAAI), spécialisé dans les modèles visuels fondamentaux et les grands modèles multimodaux |

| 2024 à aujourd'hui | Fondateur et PDG de Sand AI |

L'influence du Swin Transformer perdure encore aujourd'hui : cet article a été cité plus de 30 000 fois sur Google Scholar et est largement utilisé dans les chaînes de compréhension visuelle de produits comme Microsoft Office 365, Azure Cognitive Service, TikTok et Kuaishou. Il constitue également le socle du Video Swin Transformer. D'une certaine manière, Cao Yue incarne à lui seul la continuité technologique "de la compréhension visuelle à la génération vidéo".

Taille de l'équipe : une "super-équipe d'élite" de moins de 30 personnes

La structure de l'équipe de Sand AI diffère radicalement de la plupart des entreprises de grands modèles de langage : elle compte moins de 30 personnes au total, couvrant les domaines du produit, du marketing, de l'ingénierie et de la recherche, avec une moyenne d'âge inférieure à 30 ans. Cette structure de petite équipe est relativement rare dans la vague actuelle de startups spécialisées dans les grands modèles, mais elle implique :

- Une chaîne de décision courte et une vitesse d'itération rapide ;

- Une ingénierie et une recherche hautement couplées, permettant de transformer directement des innovations issues de publications scientifiques en produits ;

- L'absence de silos organisationnels typiques des grandes entreprises : 3 personnes suffisent pour mettre en place une nouvelle chaîne de traitement.

Cet ADN "petit mais robuste" est la raison majeure pour laquelle Sand AI a pu sortir un modèle aussi abouti que MAGI-1 dès avril 2025.

Mission de l'entreprise et approche open source

Sur sa page "À propos", Sand AI définit sa mission comme suit : "Faire progresser l'IA pour le bénéfice de tous", et exprime clairement sa volonté d'"adopter l'open source, de favoriser le progrès par la collaboration ouverte et de rendre l'IA de pointe accessible à tous". Ce n'est pas qu'un slogan marketing : les modèles MAGI-1 et MAGI-1.1 lancés par Sand AI sont entièrement open source sous licence Apache 2.0. Ils ont publié les poids, le code d'inférence et les versions distillées sur GitHub et Hugging Face. Cette approche open source est particulièrement audacieuse dans le secteur actuel de la génération vidéo.

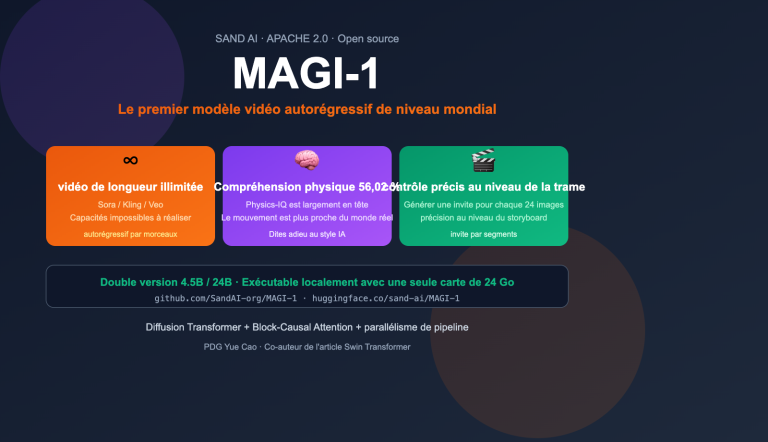

Le produit phare de Sand AI, MAGI : un nouveau paradigme de génération vidéo autorégressive

Après avoir présenté l'équipe, passons au cœur du sujet : la gamme de produits phare de Sand AI, MAGI. Elle se distingue fondamentalement des solutions dominantes comme Sora, Kling, Veo ou HunyuanVideo : il ne s'agit pas d'un modèle de diffusion pur qui "génère toute la vidéo en une seule fois", mais d'une approche combinant "autorégression" et "diffusion" pour générer la vidéo par blocs (chunks).

Faits marquants sur MAGI

| Dimension | MAGI / MAGI-1 / MAGI-1.1 |

|---|---|

| Première publication | 21 avril 2025 |

| Dernière version | MAGI-1.1 (100% open source) |

| Spécifications des paramètres | 24B (version complète) + 4.5B (version légère) |

| Versions distillées | 4.5B Distill + Distill+Quant (publiées le 26 mai 2025) |

| Licence open source | Apache 2.0 |

| Dépôts | github.com/SandAI-org/MAGI-1 / huggingface.co/sand-ai/MAGI-1 |

| Durée de génération vidéo | Actuellement 1-10 secondes, supporte une extension infinie |

| Images par segment | 24 images par chunk, débruitage conjoint |

| Capacité de concurrence | Traitement simultané de jusqu'à 4 chunks |

| Temps de génération | Généralement 1-2 minutes pour un résultat |

| Styles supportés | Vidéo réaliste + style 3D semi-cartoon |

| Capacités de contrôle | Contrôle temporel à la seconde + prompting par segment |

| Compréhension physique | Avance significative sur la continuation vidéo via le benchmark Physics-IQ |

| Positionnement de performance | SOTA parmi les modèles open source, supérieur à Wan-2.1 / HunyuanVideo, dépasse Hailuo (modèle fermé) |

Autorégression + Diffusion : pourquoi est-ce un nouveau paradigme ?

Les modèles de diffusion vidéo dominants (Sora, Veo, Kling, etc.) traitent généralement la vidéo entière comme un seul tenseur pour le débruitage. Cette méthode est très performante en termes de qualité d'image, mais présente deux défauts inhérents :

- Difficulté à prolonger indéfiniment : la durée de la vidéo générée en une seule fois est limitée par la mémoire vidéo (VRAM) et la latence lors de l'inférence ;

- Faible cohérence physique : la génération en un bloc unique manque de la chaîne de causalité "déduire l'image suivante à partir de la précédente".

MAGI a choisi de diviser la vidéo en chunks de 24 images, effectuant le débruitage par diffusion à l'intérieur de chaque chunk, tout en suivant une contrainte causale autorégressive entre les chunks. Cela signifie que :

- Vous voulez une vidéo plus longue ? Il suffit de continuer l'autorégression, sans limite théorique — c'est pourquoi le site officiel de sand.ai met en avant ses "capacités d'extension vidéo infinie" ;

- Vous voulez une physique plus réaliste ? Chaque image est basée sur les images précédemment générées, ce qui confère un avantage structurel sur les benchmarks de prédiction physique comme Physics-IQ ;

- Vous voulez un contrôle plus fin ? Vous pouvez fournir un prompt spécifique pour chaque chunk, créant un effet de "réalisation par segments".

Cette conception s'est avérée très efficace lors des tests internes de Sand AI : elle a surpassé des concurrents solides comme Wan-2.1 et HunyuanVideo parmi les modèles open source, et a également dépassé Hailuo dans les comparaisons avec des modèles fermés, avec des résultats "nettement supérieurs à tous les modèles existants" sur le benchmark Physics-IQ.

Innovations en ingénierie dans l'architecture de MAGI

Pour que l'approche autorégression + diffusion fonctionne réellement, Sand AI a intégré toute une série de modifications architecturales dans MAGI :

| Module | Rôle |

|---|---|

| Block-Causal Attention | Permet une connexion causale entre les chunks, évitant les fuites d'informations futures |

| Parallel Attention Block | Améliore l'efficacité du parallélisme au sein d'un même chunk |

| QK-Norm + GQA | Stabilise l'entraînement + réduit la charge du KV Cache |

| Sandwich Normalization in FFN | Stabilise davantage l'entraînement des grands modèles |

| SwiGLU | Améliore la capacité d'expression non linéaire |

| Softcap Modulation | Contrôle les valeurs extrêmes de la distribution de l'attention |

| Transformer-based VAE | Décodage plus rapide |

Prises individuellement, ces innovations ne sont pas "révolutionnaires", mais combinées, elles permettent à MAGI-1 de posséder simultanément quatre capacités souvent difficiles à concilier : vidéo longue, physique robuste, contrôlabilité et extensibilité.

🎯 Conseil de sélection d'architecture : Si votre activité nécessite de la "continuation de vidéo longue" ou une "contrôlabilité au niveau du découpage", le paradigme autorégression + diffusion de MAGI mérite d'être pris en considération. Avant qu'il ne propose une API commerciale officielle, vous pouvez utiliser des modèles déjà commercialisés comme Sora 2, Veo 3.1 ou Kling 3.0 sur APIYI (apiyi.com) pour réaliser vos prototypes de produits, puis migrer de manière transparente une fois que l'API commerciale de MAGI sera mature.

Comment Sand AI livre MAGI aux développeurs

Avoir un modèle puissant ne suffit pas. Sand AI a conçu son parcours de livraison de manière très ingénieuse. De l'utilisateur lambda au développeur, en passant par le chercheur, sand.ai propose trois points d'entrée distincts.

Trois façons d'utiliser MAGI

| Point d'entrée | Adresse | Public cible |

|---|---|---|

| Application Web | magi.sand.ai/app/projects |

Créateurs de contenu / Utilisateurs, pour générer des images directement dans le navigateur |

| Plateforme API | platform.sand.ai/docs |

Développeurs souhaitant intégrer MAGI dans leurs propres produits |

| Dépôt Open Source | github.com/SandAI-org/MAGI-1 + huggingface.co/sand-ai/MAGI-1 |

Chercheurs / Équipes d'auto-hébergement, pour exécuter les poids localement |

Ces trois voies couvrent l'ensemble du spectre des besoins, du « zéro code pour générer des images » à « l'intégration technique » jusqu'à « l'auto-hébergement complet ». Comparé aux équipes qui se contentent de publier des articles sans les poids ou des démos sans code source, Sand AI adopte une approche beaucoup plus radicale.

L'importance technique des versions 24B et 4.5B

Le fait que MAGI-1 soit proposé en deux formats de paramètres, 24B et 4.5B, montre clairement que Sand AI souhaite satisfaire deux types d'utilisateurs :

- Version complète 24B : destinée aux chercheurs et aux entreprises disposant de ressources GPU suffisantes et recherchant la meilleure qualité d'image possible ;

- Version distillée 4.5B : destinée aux équipes axées sur le déploiement technique, cherchant un équilibre entre coût et latence. En mai, une version Distill+Quant a été ajoutée, réduisant encore davantage l'empreinte mémoire.

Ce rythme de publication, combinant « modèle haut de gamme et modèle léger » avec une distillation continue, est devenu la norme pour les grands modèles de langage open source en 2025-2026. Sur ce point, Sand AI reste parfaitement aligné avec des acteurs majeurs comme Mistral ou Qwen.

La position de Sand AI et les enseignements dans la course à la génération vidéo

En reliant le contexte, le produit et le parcours de livraison, la position de Sand AI dans la course à la génération vidéo de 2026 devient très claire.

Pourquoi suivre ce projet de près ?

| Angle | Valeur différenciante de Sand AI |

|---|---|

| Profondeur académique | ADN de l'équipe Swin Transformer, innovation continue dans l'architecture réseau |

| Choix de la voie | L'approche auto-régressive + diffusion est une troisième voie peu explorée, loin du simple clonage de Sora |

| Transparence Open Source | Apache 2.0 + poids + code + version Distill, tout est public |

| Forme du produit | Trois points d'entrée : Web, API et auto-hébergement |

| Compréhension physique | Référence Physics-IQ nettement en avance, idéal pour le contenu éducatif, scientifique et de vulgarisation |

| Vidéo longue | La voie auto-régressive permet naturellement une extension illimitée |

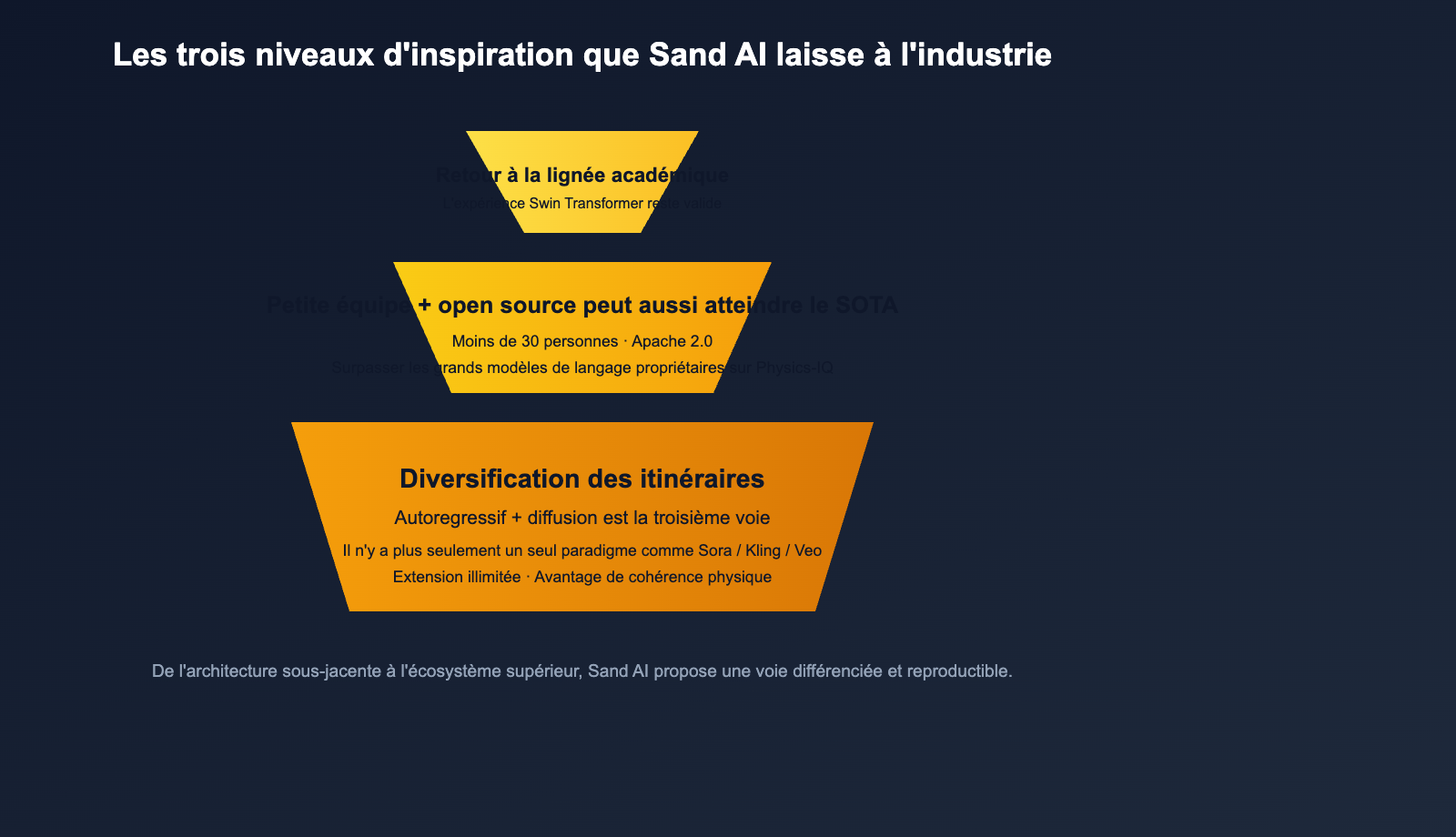

Trois enseignements pour l'industrie

L'ascension rapide de Sand AI laisse au moins trois enseignements majeurs pour tout le secteur de la génération vidéo :

- Diversification des approches : Au-delà de Sora, Veo ou Kling, la voie « auto-régressive + diffusion » est viable et offre un avantage structurel en termes de cohérence physique ;

- Une petite équipe + l'open source peuvent atteindre le SOTA : Avec moins de 30 personnes et une licence Apache 2.0, il est possible de surpasser de nombreux géants aux modèles fermés sur le benchmark Physics-IQ ;

- Le retour de l'héritage académique : L'expérience acquise avec les « modèles visuels classiques » comme Swin Transformer conserve une valeur immense à l'ère de la génération vidéo.

Ces trois points sont une référence directe pour les équipes souhaitant se lancer dans la génération vidéo en 2026. Vous n'avez pas besoin de 1000 cartes H100 pour créer un modèle décent, mais vous avez besoin d'une culture technique qui « comprend l'architecture, ose l'open source et s'investit dans la cohérence physique ».

🎯 Conseil d'intégration écosystémique : Pour les équipes souhaitant intégrer à la fois des modèles vidéo « open source » et « fermés », nous recommandons de gérer Sora 2, Veo 3.1, Kling 3.0 et MAGI-1 sous une interface unifiée. En attendant que l'API commerciale de MAGI soit largement ouverte, vous pouvez passer par APIYI (apiyi.com) pour accéder aux modèles vidéo déjà commercialisés afin de tester vos flux de travail, en attendant l'ouverture complète de platform.sand.ai par Sand AI.

Sand AI : pour qui, pour quoi ?

Revenons à une question très concrète : devez-vous utiliser MAGI de Sand AI dès maintenant ? La réponse dépend de vos besoins spécifiques en matière de génération vidéo.

À qui cela s'adresse-t-il ?

| Public | Raisons |

|---|---|

| Chercheurs / Auteurs | Open source complet + nouveau paradigme autorégressif, idéal pour les travaux académiques |

| Équipes en auto-hébergement | Licence Apache 2.0 + version distillée 4.5B, poids exécutables en local |

| Vulgarisation scientifique / Éducation | Avance sur le Physics-IQ, excellente cohérence physique |

| Besoins en vidéos longues | L'approche autorégressive permet naturellement une extension infinie |

| Créateurs de produits "contrôlables" | Support de la timeline à la seconde + invites par blocs (chunk-wise) |

| Écosystème IA chinois | Équipe basée à Pékin, très bonne gestion des invites en chinois |

À qui cela s'adresse moins ?

| Public | Raison |

|---|---|

| Utilisateurs "zéro code" cherchant juste le résultat | L'UX de produits matures comme Sora 2 ou Kling reste plus légère |

| Petites équipes refusant l'auto-hébergement | L'API commerciale platform.sand.ai est encore en cours de perfectionnement |

| Besoins 4K + longue durée + audio | Positionnement actuel axé sur la recherche / création, pas sur la post-production |

| Utilisateurs purement applicatifs | L'appel direct d'API propriétaires est plus simple à gérer |

🎯 Conseil d'essai : Si vous voulez "voir le résultat immédiatement", nous vous suggérons d'aller sur magi.sand.ai pour tester l'application web sans connexion ou avec une inscription rapide. Si vous souhaitez comparer les différences réelles entre Sand AI et d'autres modèles, vous pouvez utiliser le service proxy API APIYI (apiyi.com) pour invoquer Sora 2, Veo 3.1 ou Kling 3.0. Utilisez le même jeu d'invites pour comparer les résultats et déterminer si l'approche autorégressive de MAGI est réellement adaptée à votre activité.

FAQ Sand AI

Q1 : Qu'est-ce que Sand AI ? Est-ce la même chose que Stability AI ou Midjourney ?

Sand AI est une startup spécialisée dans l'IA, basée à Pékin, fondée par Cao Yue (auteur principal de Swin Transformer). L'équipe compte moins de 30 personnes. Contrairement à Stability AI (orienté image) ou Midjourney (modèle fermé par abonnement), Sand AI se concentre sur la génération vidéo et a choisi la voie de l'open source complet (Apache 2.0). Son produit phare est le modèle de génération vidéo autorégressif MAGI-1 / MAGI-1.1.

Q2 : Quelle est la différence fondamentale entre MAGI-1 et Sora, Kling ou Veo ?

La différence majeure réside dans l'approche technique : Sora / Veo / Kling génèrent la vidéo entière en une seule fois, tandis que MAGI découpe la vidéo en blocs (chunks) de 24 images. Chaque bloc subit une diffusion de débruitage, et les blocs sont reliés entre eux par un mécanisme autorégressif causal. Ce paradigme confère à MAGI un avantage structurel sur l'extension infinie de vidéos et la cohérence physique. Les résultats officiels sur le benchmark Physics-IQ montrent une avance significative.

Q3 : MAGI-1 est-il vraiment open source ? Peut-on l'utiliser commercialement ?

Oui. MAGI-1 et MAGI-1.1 sont publiés sous licence Apache 2.0 sur GitHub (SandAI-org/MAGI-1) et Hugging Face (sand-ai/MAGI-1). Le code, les poids et les outils d'inférence sont fournis. La licence Apache 2.0 est très permissive : elle autorise l'usage commercial, la modification et la création de dérivés fermés, à condition de conserver la mention de copyright. Vous pouvez donc intégrer MAGI-1 dans vos produits ou l'utiliser pour un entraînement secondaire.

Q4 : Quel matériel est nécessaire pour faire tourner MAGI-1 en local ?

La version complète de MAGI-1 possède 24 milliards de paramètres ; l'inférence locale nécessite des GPU professionnels multi-cartes. Si votre budget matériel est limité, nous recommandons la version distillée 4.5B ou la version Distill+Quant publiée en mai 2025, dont les besoins en VRAM sont nettement réduits et permettent une exécution sur un GPU grand public haut de gamme. Pour un simple test, utilisez l'application web magi.sand.ai.

Q5 : Sand AI propose-t-il une API commerciale ? Comment se compare-t-elle à Sora ou Kling ?

La plateforme d'API commerciale de Sand AI, platform.sand.ai, est en ligne, mais sa maturité écosystémique est encore en phase de rattrapage par rapport à des modèles comme Sora ou Kling. Si vous développez un produit nécessitant une disponibilité immédiate, des quotas importants et une gestion fluide des invites en chinois, nous vous conseillons d'utiliser le service proxy API APIYI (apiyi.com) pour appeler Sora 2, Veo 3.1 ou Kling 3.0. Suivez parallèlement l'évolution de l'API de Sand AI pour envisager une migration ou une intégration hybride au moment opportun.

Q6 : Sand AI mérite-t-il d'être suivi ?

Absolument. Deux raisons : premièrement, l'héritage académique de l'équipe Swin Transformer suggère que les futures itérations de MAGI innoveront probablement au niveau de l'architecture, plutôt que par la simple accumulation de données. Deuxièmement, Sand AI a choisi une voie différenciée : "autorégressif + diffusion + open source complet". Si cette approche réussit, elle influencera le choix des paradigmes pour le secteur de la génération vidéo open source en 2026-2027. Que vous soyez chercheur, développeur ou créateur, nous vous recommandons d'ajouter sand.ai à votre liste de veille.

Résumé : Quelle est la réponse définitive sur Sand AI ?

Pour revenir à la question initiale — "Qu'est-ce que Sand AI ?" — nous pouvons désormais apporter une réponse complète : Sand AI est une startup spécialisée dans l'IA, composée d'une petite équipe de moins de 30 personnes basée à Pékin et fondée par Cao Yue, l'un des auteurs principaux du Swin Transformer. Son produit phare est le modèle de génération vidéo autorégressif open source MAGI-1 / MAGI-1.1. Ce modèle a surpassé la plupart des modèles open source et certains modèles propriétaires sur des benchmarks de cohérence physique comme Physics-IQ, tout en publiant l'intégralité des poids et du code sous licence Apache 2.0 sur GitHub et Hugging Face. C'est un véritable outsider de la génération vidéo, caractérisé par une "solide lignée académique, une approche innovante et un engagement total envers l'open source".

Pour les développeurs et les chercheurs, la véritable importance de Sand AI ne réside pas dans le fait qu'il y ait "un modèle vidéo de plus", mais dans le fait qu'il offre une voie différenciée et reproductible pour l'ensemble du secteur de la génération vidéo : sans s'appuyer sur une puissance de calcul démesurée, sans enfermer les utilisateurs dans un écosystème propriétaire et sans matraquage marketing, mais grâce à une expertise académique, une innovation architecturale et une transparence totale. Si le secteur de la génération vidéo avant 2025 était dominé par Sora, l'émergence de Sand AI prouve qu'en 2026, l'écosystème open source peut démontrer qu'une "petite équipe peut aussi atteindre l'état de l'art (SOTA)".

🎯 Conseil final : Pour suivre au plus près les avancées de Sand AI et de MAGI, nous vous recommandons trois actions : 1) Suivez les mises à jour sur sand.ai et sur l'organisation

sand-aisur Hugging Face ; 2) Testez vos propres besoins réels via l'application web magi.sand.ai pour vous faire une première idée ; 3) Intégrez MAGI ainsi que d'autres modèles commerciaux comme Sora 2, Veo 3.1 ou Kling 3.0 à une plateforme unifiée comme APIYI (apiyi.com) pour effectuer des comparaisons transversales et évaluer sa valeur réelle pour vos projets sur la base de vos propres critères. Une fois ce processus terminé, la réponse à la question "Sand AI mérite-t-il d'être intégré à votre stack d'outils de génération vidéo ?" s'imposera d'elle-même.

Auteur : Équipe APIYI | Passionnés par le déploiement des grands modèles de langage et l'écosystème open source. Pour plus d'évaluations sur les modèles vidéo et multimodaux, visitez APIYI sur apiyi.com.