Nota del autor: El modelo gpt-5.5-pro, lanzado recientemente por OpenAI, ya está disponible oficialmente en la API, ofreciendo una ventana de contexto de 1M y capacidades de razonamiento de primer nivel. Este artículo analiza en profundidad sus especificaciones técnicas, estructura de precios, límites de grupos SVIP y soluciones de acceso desde el país.

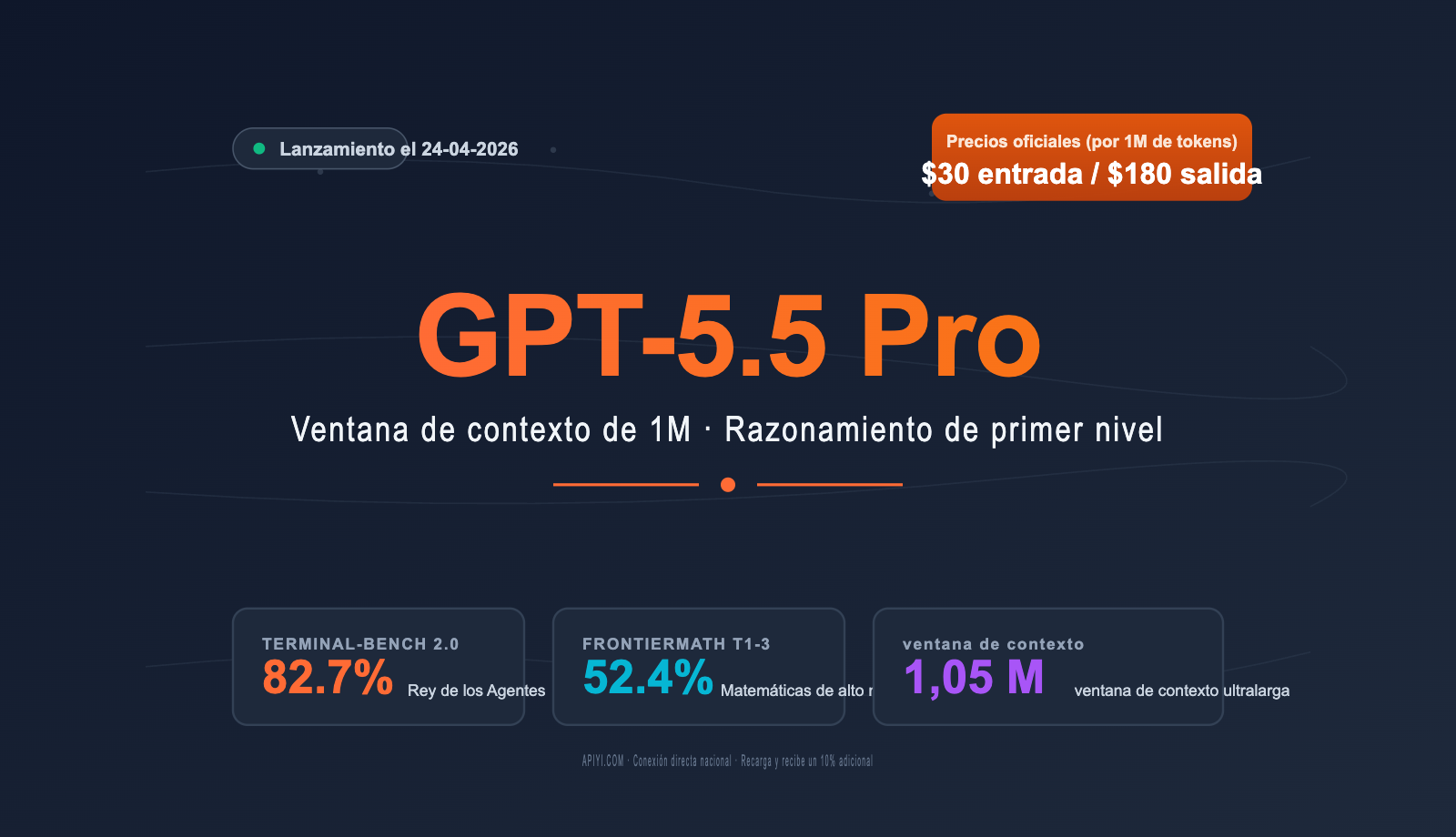

OpenAI lanzó oficialmente GPT-5.5 el 23-04-2026 y, el 24-04-2026, abrió la versión de razonamiento avanzado gpt-5.5-pro en la API. Este es el modelo insignia de la serie GPT-5.5, diseñado específicamente para tareas complejas de múltiples pasos, razonamiento profundo y escenarios de alto valor, proporcionando una ventana de contexto de 1,050,000 tokens y una salida máxima de 128K.

Esto no es una promesa vacía de marketing; la documentación oficial de OpenAI ya está disponible y los desarrolladores pueden invocar la API directamente. Sin embargo, dado que su precio es 6 veces superior al del GPT-5.5 estándar ($30 / $180 por cada 1M de tokens), el costo de una sola invocación puede alcanzar varios dólares, lo que plantea desafíos únicos de control de costos para los usuarios locales.

Valor central: Este artículo analiza la solución de acceso a la API de GPT-5.5 Pro desde cuatro ángulos: especificaciones del modelo, estructura de precios, datos de referencia (Benchmark) y el mecanismo de protección de grupos SVIP, además de proporcionar ejemplos de invocación minimalistas listos para ejecutar.

Puntos clave de la API de GPT-5.5 Pro

| Punto clave | Descripción | Valor |

|---|---|---|

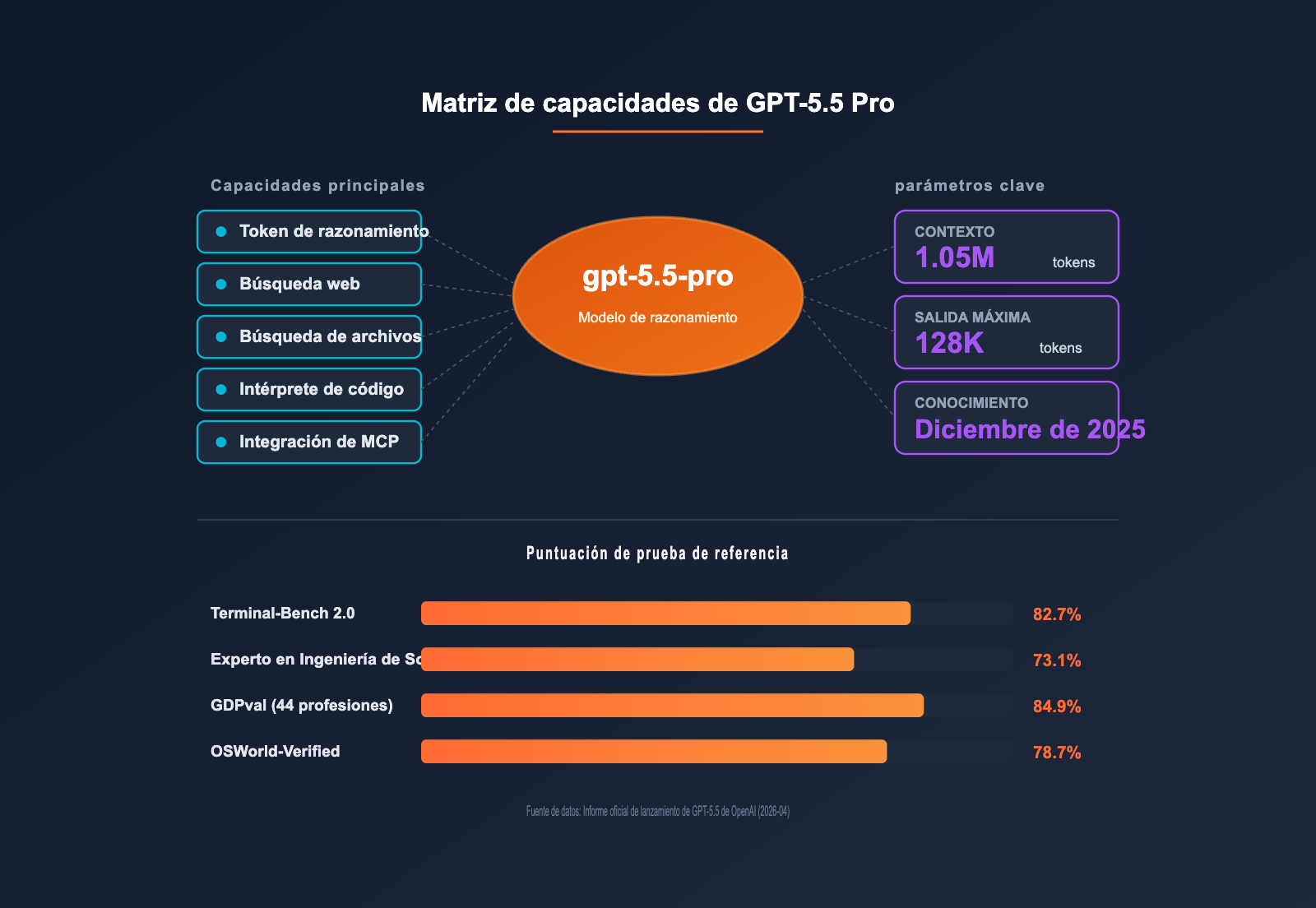

| Contexto ultra largo de 1M+ | 1,050,000 tokens de entrada + 128K de salida | Entrada de libros completos o bases de código masivas de una sola vez |

| Capacidad de razonamiento superior | 52.4% en FrontierMath niveles 1-3 | La mejor opción para matemáticas, investigación y decisiones complejas |

| Rey de la codificación Agentic | 82.7% en Terminal-Bench 2.0 | Completado autónomo de tareas de múltiples pasos de hasta 20 horas |

| Comprensión multimodal | Entrada/salida de texto + entrada de imagen | Análisis de documentos, comprensión de UI, razonamiento visual |

| Acceso a grupos SVIP | APIYI solo permite llamadas en el grupo SVIP | Evita llamadas accidentales a modelos de alto costo, control de costos |

Diferencias fundamentales entre GPT-5.5 Pro y la versión estándar

GPT-5.5 Pro es una versión optimizada de OpenAI basada en GPT-5.5, diseñada específicamente para razonamiento profundo y tareas de alta precisión. La descripción oficial indica que "produce respuestas más inteligentes y precisas", intercambiando mayor potencia de cómputo por una mayor exactitud en las respuestas. La versión Pro admite un mecanismo completo de Reasoning Token, donde el modelo genera internamente cadenas de razonamiento invisibles antes de producir la respuesta final, lo que le permite liderar significativamente en evaluaciones de alta dificultad como FrontierMath y Expert-SWE.

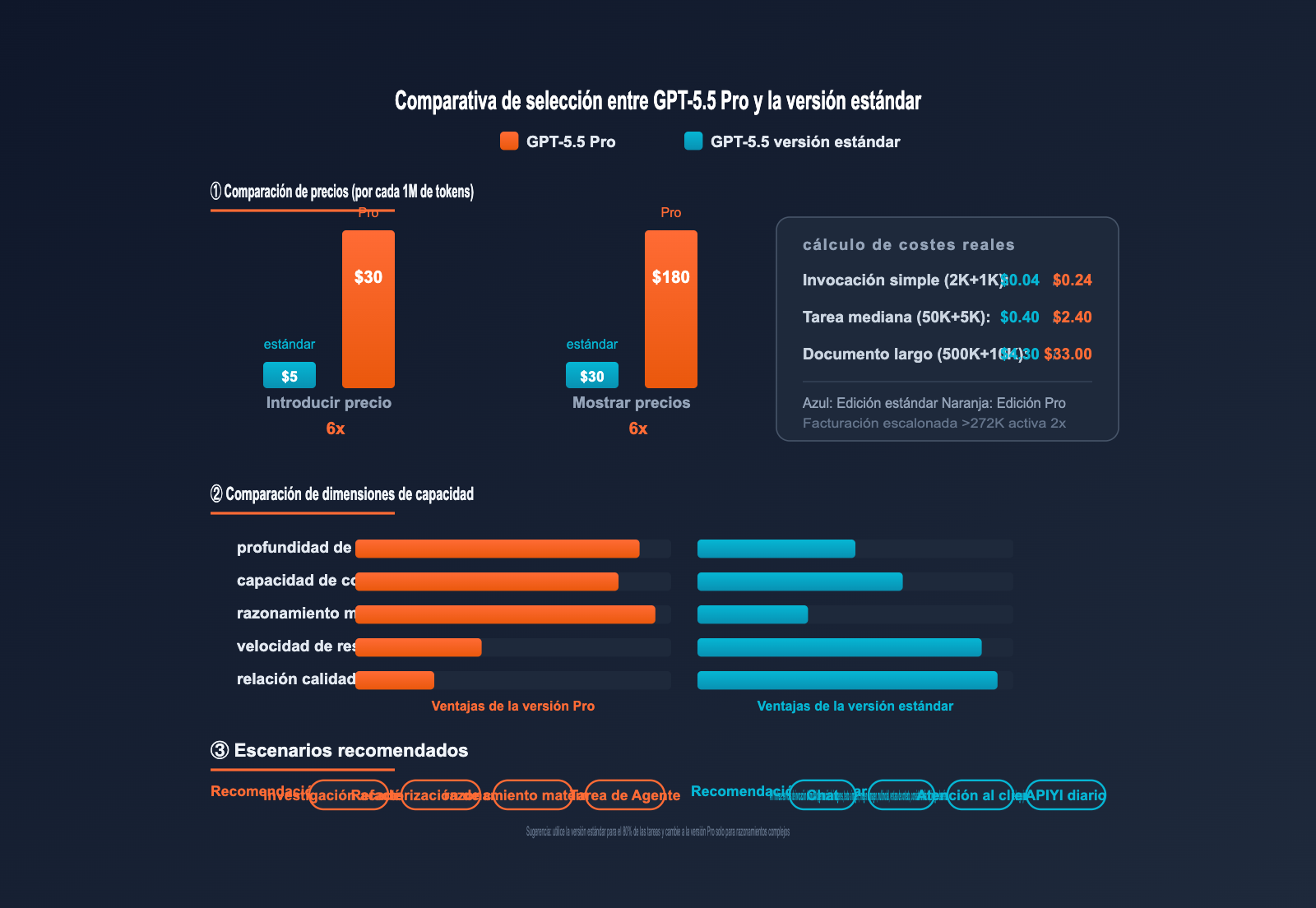

En cuanto a precios, el costo de entrada de la versión Pro es 6 veces mayor que el de la versión estándar ($30 vs $5), y el costo de salida también es 6 veces mayor ($180 vs $30). Esto significa que el costo de una sola invocación de razonamiento complejo puede saltar de unos pocos centavos en la versión estándar a varios dólares, por lo que elegir con precisión cuándo usar la versión Pro es la clave para controlar los costos de la API.

Inicio rápido con la API de GPT-5.5 Pro

Ejemplo minimalista en Python

A continuación, te muestro la forma más sencilla de invocar GPT-5.5 Pro, manteniendo total compatibilidad con el SDK de OpenAI:

import openai

client = openai.OpenAI(

api_key="TU_CLAVE_API",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.5-pro",

messages=[

{"role": "user", "content": "Demuestra la proposición equivalente de la hipótesis de Riemann: todos los ceros no triviales tienen una parte real de 1/2."}

]

)

print(response.choices[0].message.content)

Ejemplo minimalista con cURL

curl https://vip.apiyi.com/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer TU_CLAVE_API" \

-d '{

"model": "gpt-5.5-pro",

"messages": [

{"role": "user", "content": "Analiza esta base de código de 200K tokens y refactorízala"}

]

}'

Ver código completo para entorno de producción (incluye manejo de errores y estimación de costos)

import openai

from typing import Optional, List, Dict

# Precios de la versión Pro (por cada 1M de tokens)

PRICE_INPUT_BASE = 30.0 # Precio de entrada 0-272K

PRICE_OUTPUT_BASE = 180.0 # Precio de salida 0-272K

PRICE_INPUT_HIGH = 60.0 # Precio de entrada >272K

PRICE_OUTPUT_HIGH = 270.0 # Precio de salida >272K

def call_gpt55_pro(

messages: List[Dict],

api_key: str,

max_tokens: int = 4096,

estimate_cost: bool = True

) -> Dict:

"""

Invocación de GPT-5.5 Pro en producción, con estimación de costos y manejo de errores

Args:

messages: Lista de mensajes

api_key: Clave API

max_tokens: Máximo de tokens de salida

estimate_cost: Si se debe imprimir la estimación de costos

Returns:

Diccionario con el contenido de la respuesta y el costo real

"""

client = openai.OpenAI(

api_key=api_key,

base_url="https://vip.apiyi.com/v1"

)

try:

response = client.chat.completions.create(

model="gpt-5.5-pro",

messages=messages,

max_tokens=max_tokens

)

usage = response.usage

input_tokens = usage.prompt_tokens

output_tokens = usage.completion_tokens

# Cálculo de facturación escalonada

if input_tokens <= 272_000:

input_cost = input_tokens / 1_000_000 * PRICE_INPUT_BASE

output_cost = output_tokens / 1_000_000 * PRICE_OUTPUT_BASE

else:

input_cost = input_tokens / 1_000_000 * PRICE_INPUT_HIGH

output_cost = output_tokens / 1_000_000 * PRICE_OUTPUT_HIGH

total_cost = input_cost + output_cost

if estimate_cost:

print(f"📊 Tokens de entrada: {input_tokens:,}")

print(f"📊 Tokens de salida: {output_tokens:,}")

print(f"💰 Costo de esta invocación: ${total_cost:.4f}")

return {

"content": response.choices[0].message.content,

"input_tokens": input_tokens,

"output_tokens": output_tokens,

"cost_usd": total_cost

}

except openai.RateLimitError:

return {"error": "Límite de tasa excedido, por favor verifica tu cuota del grupo SVIP"}

except openai.APIError as e:

return {"error": f"Error de API: {str(e)}"}

# Ejemplo de uso

result = call_gpt55_pro(

messages=[

{"role": "system", "content": "Eres un experto en matemáticas"},

{"role": "user", "content": "Deriva la forma de ecuación diferencial parcial de Black-Scholes"}

],

api_key="TU_CLAVE_API"

)

print(result["content"])

🎯 Consejo para empezar: Las invocaciones de GPT-5.5 Pro tienen un costo elevado. Te recomendamos obtener primero los permisos del grupo SVIP a través de la plataforma APIYI (apiyi.com) antes de comenzar. La plataforma es totalmente compatible con el SDK de OpenAI. Recibe un 10% adicional al recargar 100 USD, lo que equivale a un descuento del 15% respecto al costo oficial, y permite conexión directa sin necesidad de VPN.

Detalles de precios de la API de GPT-5.5 Pro

Estructura oficial de facturación escalonada

OpenAI utiliza un mecanismo de facturación escalonada por contexto largo para la serie GPT-5.5: cuando los tokens de entrada de una solicitud superan los 272K, el precio se ajusta automáticamente.

| Rango de entrada | Precio de indicación (por 1M tokens) | Precio de finalización (por 1M tokens) |

|---|---|---|

| 0 – 272K tokens | $30.00 | $180.00 |

| 272K – ∞ tokens | $60.00 (2x) | $270.00 (1.5x) |

⚠️ Recordatorio importante: La fijación de precios escalonada se calcula sobre la solicitud completa, no solo sobre el exceso. Es decir, si la entrada supera los 272K, tanto la entrada como la salida de toda la solicitud se facturarán a la tarifa más alta. Se recomienda implementar una estrategia de fragmentación (chunking) al analizar documentos largos.

Comparativa de precios: Versión Pro vs. Versión Estándar

| Modelo | Precio de entrada | Precio de salida | Multiplicador | Ventana de contexto |

|---|---|---|---|---|

| gpt-5.5 | $5.00 / 1M | $30.00 / 1M | 1x (base) | 1M tokens |

| gpt-5.5-pro | $30.00 / 1M | $180.00 / 1M | 6x | 1.05M tokens |

Ejemplos de cálculo de costos reales:

- Invocación simple (2K entrada + 1K salida): Estándar $0.04 vs Pro $0.24

- Tarea intermedia (50K entrada + 5K salida): Estándar $0.40 vs Pro $2.40

- Análisis de documento largo (500K entrada + 10K salida): Estándar $4.30 vs Pro $33.00

💡 Consejo de optimización de costos: Para tareas rutinarias que no requieran razonamiento profundo, recomendamos usar la versión estándar de GPT-5.5. El valor de la versión Pro solo se justifica en escenarios donde realmente necesites capacidad de razonamiento de primer nivel. Puedes alternar entre ambas versiones sin problemas en la misma plataforma a través de APIYI (apiyi.com), facilitando la gestión según tus necesidades.

Benchmark de rendimiento de la API de GPT-5.5 Pro

Datos de pruebas oficiales

OpenAI ha publicado los resultados de la serie GPT-5.5 en varios conjuntos de evaluación autorizados, donde la versión Pro destaca especialmente en matemáticas y tareas complejas:

| Conjunto de evaluación | Dimensión de evaluación | Puntuación GPT-5.5 Pro | Descripción |

|---|---|---|---|

| Terminal-Bench 2.0 | Ejecución de comandos de terminal | 82.7% | Capacidad central para completar tareas largas de forma autónoma |

| Expert-SWE | Tareas de programación de 20 horas | 73.1% | Refactorización de bases de código complejas |

| SWE-Bench Pro | GitHub Issue real | 58.6% | Corrección de código en entornos de producción |

| GDPval (44 profesiones) | Cobertura de trabajo de conocimiento | 84.9% | Tareas profesionales interdisciplinarias |

| OSWorld-Verified | Operaciones informáticas | 78.7% | Automatización de Computer Use |

| FrontierMath Nivel 1-3 | Matemáticas de alta dificultad | 52.4% | Rendimiento superior en razonamiento matemático |

| FrontierMath Nivel 4 | Problemas matemáticos extremadamente difíciles | 39.6% | Avance exclusivo de la versión Pro |

Interpretación del Benchmark

Terminal-Bench 2.0 alcanza el 82.7%: Esto significa que GPT-5.5 Pro puede completar de forma autónoma operaciones complejas de decenas de pasos en la terminal, incluyendo la configuración del entorno, la instalación de dependencias y la depuración de código. Para flujos de trabajo de codificación con agentes, la estabilidad de la versión Pro es significativamente mayor que la de la versión estándar.

FrontierMath Nivel 4 alcanza el 39.6%: FrontierMath Nivel 4 es el nivel más difícil en las evaluaciones matemáticas, incluyendo problemas de nivel de la Medalla Fields. La versión Pro es el primer modelo público en superar el 35% en el Nivel 4, lo que marca un progreso importante en el campo de la investigación matemática de vanguardia.

Comparativa de selección: GPT-5.5 Pro vs. Versión Estándar

| Dimensión de comparación | GPT-5.5 Pro | GPT-5.5 Estándar | Elección recomendada |

|---|---|---|---|

| Razonamiento matemático | FrontierMath 52.4% | Menos del 30% | Pro |

| Capacidad de programación | Expert-SWE 73.1% | Expert-SWE ~55% | Pro (tareas complejas) |

| Conversación convencional | Más lento, mayor costo | Rápido, bajo costo | Estándar |

| Resumen de documentos largos | 1.05M de contexto | 1M de contexto | Cualquiera |

| Atención al cliente/Traducción | Rendimiento excesivo | Suficiente | Estándar |

| Investigación/Academia | Profundidad de razonamiento superior | Profundidad de razonamiento media | Pro |

| Flujo de trabajo de agentes | Terminal 82.7% | Terminal ~70% | Pro (alta complejidad) |

| Costo por uso | $0.24-$33+ | $0.04-$4.30 | Según necesidad |

Recomendaciones para la toma de decisiones

Análisis de la versión Pro: GPT-5.5 Pro mantiene el liderazgo en evaluaciones de alta dificultad como FrontierMath y Expert-SWE. Sin embargo, su precio 6 veces mayor lo hace inadecuado para tareas rutinarias. En comparación, el costo de la versión Pro solo se traduce en valor real cuando la tarea realmente requiere una profundidad de razonamiento de primer nivel (problemas científicos, refactorización de código compleja, tareas de agentes de larga duración).

Análisis de la versión Estándar: La versión estándar de GPT-5.5 destaca en relación costo-beneficio y velocidad. No obstante, carece de capacidad para tareas extremadamente difíciles como el nivel 4 de FrontierMath. Para el 80% de los escenarios de invocación del modelo mediante API, la versión estándar sigue siendo la opción más sensata.

📊 Consejo de selección: Utilice primero la versión estándar de GPT-5.5 para completar el 80% de las tareas rutinarias y cambie a la versión Pro solo en escenarios de razonamiento complejo que la versión estándar no pueda resolver. Puede hacerlo a través de la plataforma APIYI apiyi.com cambiando el parámetro

modelen la misma interfaz, sin necesidad de modificar el resto de su código.

Escenarios de aplicación para la API de GPT-5.5 Pro

El alto costo de GPT-5.5 Pro determina que solo es adecuado para escenarios específicos de alto valor:

- Investigación académica y razonamiento matemático: Problemas matemáticos de nivel 4 de FrontierMath, deducciones físicas y demostraciones de teoremas.

- Refactorización de bases de código extensas: Procesamiento de bases de código completas con más de 200K tokens en una sola entrada para refactorizaciones a nivel de arquitectura.

- Investigación científica profunda: Diseño de rutas de síntesis química, análisis complejo de bioinformática y razonamiento de diagnóstico médico.

- Automatización de Computer Use: Tareas que requieren múltiples pasos durante horas, garantizando una estabilidad del 78.7% en OSWorld.

- Flujos de trabajo de agentes de múltiples pasos: Tareas compuestas que involucran búsqueda, investigación, generación de documentos y ejecución de código.

- Aplicaciones de toma de decisiones de alto valor: Análisis de contratos legales, informes de investigación de inversiones y deducciones de estrategia comercial.

🎯 Evaluación de escenarios: Si su tarea puede completarse con GPT-4o-mini o la versión estándar de GPT-5.5, no utilice la versión Pro. El valor de la versión Pro solo se manifiesta en escenarios que la versión estándar no puede resolver. Se recomienda utilizar la plataforma APIYI apiyi.com para probar primero con la versión estándar y, tras confirmar que la capacidad es insuficiente, actualizar a la versión Pro.

Guía de integración de GPT-5.5 Pro en APIYI

¿Por qué el acceso está limitado al grupo SVIP?

Dado que el costo por invocación del modelo GPT-5.5 Pro puede alcanzar varios dólares, la plataforma APIYI ha implementado un mecanismo de protección mediante aislamiento de grupos:

- ✅ Grupo SVIP: Acceso total a la invocación de gpt-5.5-pro.

- ❌ Grupo Default (Predeterminado): Acceso restringido para evitar cargos inesperados por uso accidental de nuevos usuarios.

La razón principal de este diseño es que muchos usuarios, al integrar una API por primera vez, desconocen la diferencia de precio entre la versión Pro y la estándar; una llamada de código errónea podría consumir el presupuesto de todo un mes. Mediante el aislamiento en el grupo SVIP, garantizamos que solo los usuarios que comprenden plenamente los costos del modelo puedan invocar la versión Pro.

Cómo solicitar acceso al grupo SVIP

- Inicia sesión en el panel de usuario de APIYI en apiyi.com.

- Contacta al servicio de atención al cliente y proporciona una descripción de tu caso de uso.

- Una vez que el equipo verifique tus necesidades, se habilitarán los permisos para el grupo SVIP.

- Al realizar la invocación del modelo, especifica el parámetro

group=svip(o utiliza el endpoint dedicado).

Comparativa de costos: APIYI vs. Sitio oficial

| Proyecto | Sitio oficial de OpenAI | APIYI apiyi.com |

|---|---|---|

| Precio base | $30 / $180 por 1M | $30 / $180 por 1M (mismo precio) |

| Bonificación por recarga | Ninguna | Recarga $100 y recibe $10 extra (10%) |

| Costo real | 100% precio estándar | Aprox. 90% del precio estándar (aprox. 15% de descuento) |

| Acceso desde China | Requiere VPN | Conexión directa, sin VPN |

| Métodos de pago | Tarjeta de crédito internacional | Soporta RMB, Alipay, WeChat Pay |

| Compatibilidad SDK | Nativo de OpenAI | Totalmente compatible con el SDK de OpenAI |

| Recarga mínima | $5 | Desde $1 |

💰 Optimización de costos: Gracias al mecanismo de bonificación del 10% por recargas de 100 USD en APIYI apiyi.com, el costo real equivale a un descuento aproximado del 15% respecto al sitio oficial. Para equipos que utilizan GPT-5.5 Pro con alta frecuencia, este beneficio reduce significativamente los costos de API a lo largo del año.

Preguntas frecuentes (FAQ)

Q1: ¿Qué es GPT-5.5 Pro? ¿Cuál es la diferencia principal con la versión estándar de GPT-5.5?

GPT-5.5 Pro es la versión de razonamiento avanzado lanzada por OpenAI el 24-04-2026, optimizada para tareas de razonamiento profundo y alta precisión. Diferencia clave: el precio de la versión Pro es de $30/$180 por 1M de tokens (6 veces el precio de la versión estándar), pero supera significativamente a esta en tareas de alta dificultad como FrontierMath y Expert-SWE. La versión Pro admite un mecanismo de tokens de razonamiento más profundo, generando cadenas de inferencia más largas internamente.

Q2: ¿Cuándo se lanzó GPT-5.5 Pro? ¿En qué plataformas está disponible actualmente?

OpenAI lanzó oficialmente la serie GPT-5.5 el 23-04-2026 y abrió el modelo gpt-5.5-pro en la API el 24-04-2026. Actualmente se puede invocar a través de la API oficial de OpenAI, OpenRouter y plataformas de agregación como APIYI apiyi.com. Ten en cuenta que en APIYI solo está disponible para el grupo SVIP; el grupo Default no tiene acceso por el momento.

Q3: ¿Por qué APIYI solo permite el acceso a GPT-5.5 Pro en el grupo SVIP y no en el grupo Default?

Es un mecanismo de protección de costos de APIYI. El costo por invocación de GPT-5.5 Pro puede ser de varios dólares, y los nuevos usuarios pueden generar gastos inesperados por error al integrar el modelo. Mediante el aislamiento en el grupo SVIP, aseguramos que solo los usuarios que conocen la estructura de costos de la versión Pro puedan invocarla, evitando pérdidas presupuestarias por desconocimiento. Los usuarios interesados pueden contactar al soporte de APIYI para solicitar permisos SVIP.

Q4: ¿Para qué casos de uso es más adecuado GPT-5.5 Pro? ¿Cuándo debería usarlo en lugar de la versión estándar?

La versión Pro solo se recomienda para los siguientes escenarios de alto valor:

- Investigación académica: Problemas matemáticos/científicos de nivel 4 en FrontierMath.

- Refactorización de código complejo: Refactorización integral de bases de código de más de 200K tokens.

- Tareas de agentes de múltiples pasos: Automatización de "Computer Use" que dura varias horas.

- Aplicaciones de toma de decisiones profundas: Revisión de contratos legales, informes de investigación de inversiones.

Principio de decisión: Prueba primero con la versión estándar; si puede resolverlo, no cambies a Pro. El precio de la versión Pro es 6 veces mayor, así que actualiza solo cuando las capacidades de la versión estándar sean insuficientes.

Q5: ¿Cómo invocar GPT-5.5 Pro a través de APIYI? ¿Necesito modificar la base_url?

APIYI es totalmente compatible con el SDK de OpenAI. Pasos para la invocación:

- Visita APIYI apiyi.com, registra una cuenta y completa la solicitud para el grupo SVIP.

- Obtén tu clave API.

- Modifica la

base_urlde tu código ahttps://vip.apiyi.com/v1. - Establece el parámetro

modelcomogpt-5.5-pro.

client = openai.OpenAI(

api_key="TU_CLAVE",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.5-pro",

messages=[...]

)

Al recargar 100 USD recibes un 10% adicional, lo que equivale a un descuento del 15% respecto al precio oficial.

Q6: ¿Cómo cambia la facturación de la ventana de contexto de 1M de GPT-5.5 Pro cuando supera los 272K?

La serie GPT-5.5 utiliza una facturación escalonada: cuando la entrada de una solicitud supera los 272K tokens, el precio de entrada de toda la solicitud se duplica ($60/1M) y el precio de salida aumenta 1.5 veces ($270/1M). Nota: La facturación escalonada se aplica a toda la solicitud, no solo a la parte excedente. Se recomienda utilizar una estrategia de fragmentación para el análisis de documentos largos: dividir el documento en varias solicitudes de unos 250K para evitar activar la tarifa más alta.

Q7: ¿Qué limitaciones conocidas tiene GPT-5.5 Pro?

Las principales limitaciones incluyen:

- No admite Streaming: Debes esperar la respuesta completa para obtener resultados, lo cual no es ideal para escenarios de interacción en tiempo real.

- No admite descuentos por caché: A diferencia de la versión estándar, la versión Pro no tiene descuentos por prompt caching.

- Velocidad de respuesta lenta: Debido a que requiere un razonamiento profundo, el tiempo de cada invocación suele oscilar entre 30 segundos y varios minutos.

- Entrada de imágenes solamente: No admite la generación de imágenes (debe combinarse con otros modelos).

- Recargo del 10% por residencia de datos: El uso de endpoints de residencia de datos conlleva costos adicionales.

Para escenarios que requieren alta inmediatez, se recomienda utilizar la versión estándar de GPT-5.5.

Q8: ¿Cómo controlar los costos con precisión al invocar GPT-5.5 Pro?

Tres estrategias clave para el control de costos:

- Programación jerárquica: Usa la versión estándar para tareas rutinarias y solo la versión Pro para tareas complejas.

- Establecer un límite de

max_tokens: Evita salidas excesivamente largas; se recomienda establecer un límite razonable de 1K-8K según la tarea. - Monitorear el uso de tokens: Calcula en tiempo real los tokens de entrada/salida en tu código de producción y estima los costos.

- Evitar el escalón de 272K: Procesa documentos largos por partes para evitar activar el precio doble.

A través de la plataforma APIYI apiyi.com, también puedes aprovechar la bonificación del 10% por recarga para reducir aún más el costo real.

Puntos clave de la API de GPT-5.5 Pro

- Referente en razonamiento de alto nivel: Alcanza un 39,6% en el nivel 4 de FrontierMath, estableciendo el récord más alto para un modelo público.

- Contexto ultralargo de 1M+: Admite 1,05 millones de tokens de entrada y 128K de salida; capaz de procesar libros técnicos completos de una sola vez.

- Rey de los agentes: Logra un 82,7% en Terminal-Bench 2.0, permitiendo completar de forma autónoma tareas de programación de hasta 20 horas.

- Precio 6 veces superior a la versión estándar: $30/$180 por cada millón de tokens; requiere una gestión precisa según la demanda.

- Protección de grupo SVIP: Disponible exclusivamente para usuarios SVIP en APIYI para evitar que errores de configuración generen costos elevados de varios dólares por solicitud.

- Acceso en China con 15% de descuento: Al recargar 100 en APIYI (apiyi.com) obtienes 10 adicionales, lo que equivale a un costo un 15% menor que en el sitio oficial.

- Compatibilidad total con SDK: Solo necesitas reemplazar la

base_urlporvip.apiyi.comen el SDK de OpenAI para comenzar la invocación del modelo.

Resumen

Puntos clave de la API de GPT-5.5 Pro:

- Posicionamiento de capacidades: Diseñado específicamente para razonamiento profundo y tareas de alto valor; es el modelo con mayor capacidad de razonamiento de OpenAI hasta la fecha.

- Estructura de precios: $30/$180 por cada millón de tokens. Al superar los 272K se activa una facturación escalonada 2x, por lo que la gestión debe ser precisa.

- Método de acceso: A través del grupo SVIP de APIYI (apiyi.com), con recargas de 100 que incluyen 10 de regalo y conexión directa nacional sin necesidad de VPN.

GPT-5.5 Pro no es un modelo para uso cotidiano, sino una herramienta profesional orientada a razonamiento complejo, investigación científica, refactorización de bases de código extensas y tareas de agentes de múltiples pasos. Para el 80% de las invocaciones de API convencionales, la versión estándar de GPT-5.5 sigue siendo la opción más económica. Antes de usar la versión Pro, recomendamos evaluar si la tarea realmente requiere una capacidad de razonamiento de nivel superior.

Recomendamos acceder rápidamente a GPT-5.5 Pro a través de la plataforma APIYI (apiyi.com) para disfrutar de la protección de costos del grupo SVIP, el descuento del 10% por recarga y la estabilidad de una red con conexión directa.

Lecturas complementarias

Si te interesa la API de GPT-5.5 Pro, te recomiendo seguir leyendo:

- 📘 Guía de integración de la API estándar de GPT-5.5 – Conoce la versión de entrada de la serie GPT-5.5 y las mejores prácticas para el 80% de los escenarios.

- 📊 Comparativa profunda: GPT-5.5 Pro vs Claude Opus 4.7 – Domina las diferencias de capacidad y las recomendaciones de selección entre los dos modelos de razonamiento insignia.

- 🚀 Práctica de flujo de trabajo con agentes de OpenAI: GPT-5.5 Pro + Computer Use – Explora el despliegue a nivel de producción para tareas automatizadas de varios pasos a largo plazo.

📚 Referencias

-

Documentación oficial del modelo GPT-5.5 Pro de OpenAI: Especificaciones del modelo, puntos finales de API e información de precios.

- Enlace:

developers.openai.com/api/docs/models/gpt-5.5-pro - Descripción: Obtén los parámetros técnicos más recientes y autorizados de GPT-5.5 Pro.

- Enlace:

-

Blog de lanzamiento de la serie GPT-5.5 de OpenAI: Capacidades del modelo, datos de referencia (benchmark) y escenarios de uso.

- Enlace:

openai.com/index/introducing-gpt-5-5 - Descripción: Declaración oficial sobre el posicionamiento de capacidades de la serie GPT-5.5.

- Enlace:

-

Documentación de integración de GPT-5.5 Pro en APIYI: Soluciones de invocación local y proceso de solicitud de grupos SVIP.

- Enlace:

docs.apiyi.com - Descripción: Guía práctica de integración ideal para desarrolladores locales.

- Enlace:

-

Página de precios de OpenAI: Tabla completa de precios y reglas de facturación escalonada.

- Enlace:

developers.openai.com/api/docs/pricing - Descripción: Estándares de facturación más recientes para todos los modelos.

- Enlace:

Autor: Equipo técnico de APIYI

Intercambio técnico: Te invitamos a discutir tu experiencia con GPT-5.5 Pro en la sección de comentarios. Para más información sobre la integración de modelos, visita el centro de documentación de APIYI en docs.apiyi.com.