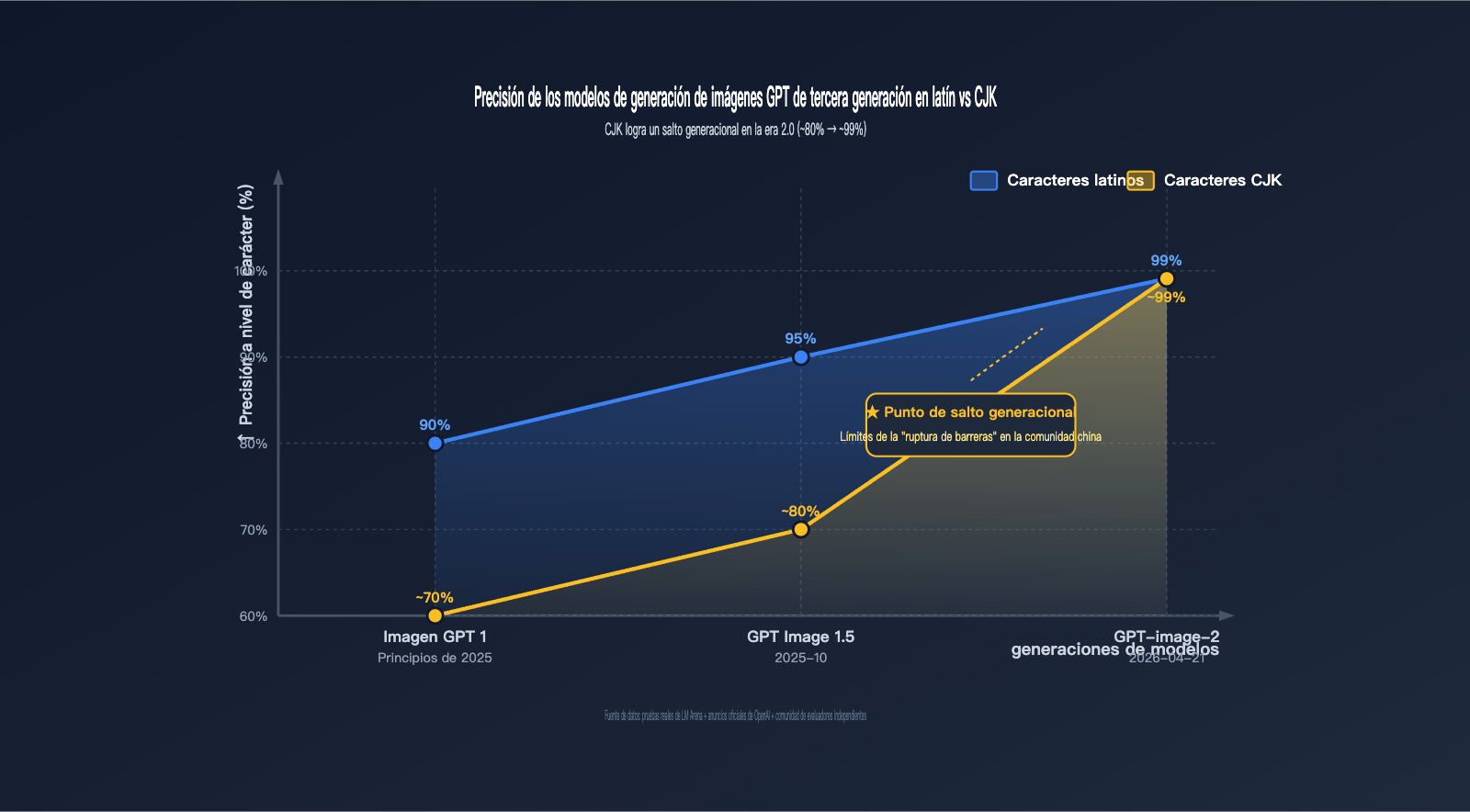

Nota del autor: Un análisis profundo sobre por qué GPT-image-2 ha tenido una repercusión en el ámbito chino muy superior a la de la versión 1.5. El salto generacional en la renderización de caracteres chinos, del 95% al 99%, ha sido el detonante que ha activado toda la cadena de difusión entre los usuarios chinos.

Tras el lanzamiento de GPT-image-2 por parte de OpenAI el 21 de abril de 2026, se generó en la comunidad china un impacto viral muy superior al de la era de GPT Image 1.5. En cuestión de horas, redes sociales como WeChat Moments, Xiaohongshu, Weibo, Bilibili y Zhihu se inundaron de réplicas y casos de uso, convirtiendo los "carteles en chino con GPT-image-2" en un fenómeno mediático en menos de 48 horas. Sin embargo, tratándose del mismo modelo de imagen de OpenAI, el lanzamiento de la versión 1.5 hace medio año apenas causó revuelo en los círculos técnicos, sin lograr "traspasar la barrera" hacia el gran público.

Esto no es una historia sobre cómo "la iteración de un Modelo de Lenguaje Grande genera entusiasmo por defecto", sino sobre cómo un indicador técnico específico —el salto en la precisión de la renderización de caracteres chinos a nivel de glifo del ~95% al ~99%— ha logrado dinamizar toda la cadena de difusión del usuario chino. En este artículo, analizaremos este fenómeno basándonos en datos reales de LM Arena, observaciones de la comunidad angloparlante y los principios técnicos subyacentes de la renderización de caracteres CJK.

Hipótesis central (opinión personal): En el internet chino, la precisión en la representación de caracteres chinos es la barrera invisible que determina si un modelo de generación de imágenes puede volverse viral. La versión 1.5 no superó esta barrera, la 2.0 sí, y ahí radica la diferencia.

Valor clave: Comprende en 3 minutos la cadena causal técnica detrás de la viralización de GPT-image-2 en China, junto con ideas prácticas para creadores de contenido y equipos de marketing.

Información clave sobre la popularidad de GPT-image-2 frente a la 1.5 en el sector chino

| Dimensión | GPT Image 1.5 (octubre de 2025) | GPT-image-2 (21 de abril de 2026) |

|---|---|---|

| Fecha de lanzamiento | Octubre de 2025 | 21 de abril de 2026 |

| Precisión general de texto | ~95% (latino) | ~99% (latino) |

| Precisión de caracteres CJK | "No fiable" (fuente oficial) | ~99% (a nivel de carácter) |

| Capacidad de scripts mixtos | Débil (errores frecuentes en chino-inglés) | Fuerte (estable en chino, inglés, japonés, coreano y árabe) |

| Popularidad en China | Limitada a círculos técnicos | Viral en 48 horas, éxito en múltiples plataformas |

| Aplicación típica | Escenarios en inglés (UI/pósteres) | Pósteres/memes/material de marketing en chino |

| Barrera de entrada | Igual que en la era 1.5 | APIYI apiyi.com gpt-image-2-all $0.03/imagen |

Breve vistazo al fenómeno: ¿Por qué GPT-image-2 es mucho más popular que la 1.5?

Indicadores en la comunidad inglesa: En X, la etiqueta #PresidentTest obtuvo 500,000 menciones en 24 horas. Medios tecnológicos como TechCrunch, VentureBeat y The Decoder cubrieron la noticia en menos de un día, y el subreddit r/OpenAI acumuló al menos tres publicaciones relevantes con más de 5,000 votos positivos.

El fenómeno en China: A partir del 22 de abril, en Xiaohongshu comenzaron a aparecer tutoriales de "pósteres en chino con GPT-image-2", con vídeos que superaron los 2 millones de visitas. El tema #GPT4月新品 (Nuevos productos de GPT de abril) en Weibo superó los 100 millones de lecturas, y los creadores de contenido técnico en Bilibili comenzaron a publicar pruebas masivas, obteniendo un promedio de 5 a 10 veces más visitas que los vídeos de la era 1.5.

Observación del autor: En la era 1.5, los bloggers tecnológicos utilizaban indicaciones en inglés para lucirse con pósteres en inglés, pero era difícil adaptarlos a algo tan sencillo como la portada de una cuenta oficial china. En la era 2.0, basta con cambiar el título por chino en la misma plantilla de indicación y listo; la "barrera de reutilización" pasó de "rehacer todo" a simplemente "cambiar el texto". Esa pequeña diferencia es la que determinó su viralidad entre los creadores chinos.

🎯 Consejo de verificación rápida: Si quieres comprobar esta diferencia tú mismo, la forma más económica es usar la API de

gpt-image-2-all($0.03 por imagen) a través de la plataforma APIYI apiyi.com para comparar una misma indicación en versiones en chino e inglés. Probar 10 imágenes solo te costará 2.1 yuanes, suficiente para ver la diferencia claramente.

Por qué GPT-image-2 es mucho más popular que la 1.5, razón n.º 1: el salto generacional en la renderización de caracteres chinos

Si solo te guías por los anuncios oficiales de OpenAI, podrías pensar que "una precisión del 99% en el texto" es solo una mejora moderada. Pero para los usuarios de habla china, se trata de un salto generacional: pasar de "básicamente inutilizable" a "básicamente funcional".

El estado real de la renderización de caracteres en la era 1.5

OpenAI utilizó el término "poco fiable" (unreliable) para describir la renderización de texto no inglés en GPT Image 1.5. Los problemas específicos incluían:

- Caracteres comunes mal formados: "新春" (Año Nuevo) se convertía en "亲春", o "特价" (oferta) en "持价".

- Caracteres complejos borrosos: Caracteres con muchos trazos como "鹏" (peng), "赢" (ying) o "鬼" (gui) solían convertirse en un amasijo de trazos irreconocibles.

- Desalineación en textos mixtos (chino/inglés): El espaciado entre los caracteres chinos y los ingleses era inconsistente, dando una apariencia muy artificial, ese "toque AI" tan característico.

- Fuentes pequeñas ilegibles: El texto chino menor a 8pt era prácticamente inservible.

- Símbolos especiales perdidos: Símbolos frecuentes en el entorno chino como ¥, °C, ♥, ★ se renderizaban de forma inestable.

El resultado: incluso si el usuario lograba generar una imagen, no podía usarla directamente; tenía que llevarla a Photoshop para corregir el texto. Este paso extra de "post-procesamiento" fue el principal cuello de botella que impidió que la versión 1.5 triunfara en la comunidad china.

Qué significa la precisión del 99% a nivel de carácter en la era 2.0

Los datos de pruebas en LM Arena muestran que GPT-image-2 ha alcanzado aproximadamente un 99% de precisión a nivel de carácter en múltiples scripts, incluyendo latín, CJK (chino, japonés, coreano), hindi, bengalí y árabe. En el contexto chino, esto significa:

- Caracteres comunes casi sin errores: (Los 3500 caracteres de nivel primario y los 6000 de uso frecuente se renderizan correctamente).

- Caracteres complejos estables y legibles: Ahora es posible renderizar nombres comunes como "曦" (xi), "薇" (wei), "澈" (che) o "赟" (yun).

- Mezcla chino-inglés natural: El espaciado y la relación de altura son correctos, con una apariencia cercana al trabajo de un diseñador profesional.

- Legibilidad en 8pt: Los subtítulos de carteles, especificaciones de productos e información de derechos de autor ya se pueden utilizar directamente.

- Símbolos especiales precisos: ¥, °C, el símbolo de grado ° y diversos símbolos decorativos se mantienen estables.

Este es el punto de inflexión donde se pasa de ser un "juguete de IA" a una "herramienta de producción". Por primera vez, los creadores chinos pueden usar la generación de imágenes por IA como su herramienta principal, no solo como un recurso auxiliar que requiere ajustes posteriores.

El salto generacional de 5pt al 99% se entiende con un vistazo

| Versión del modelo | Precisión inglés | Precisión chino | Trazos complejos | Mezcla chino-inglés |

|---|---|---|---|---|

| GPT Image 1 | ~90% | <70% | Inutilizable | Inutilizable |

| GPT Image 1.5 | ~95% | ~80% | Parcialmente útil | Útil ocasionalmente |

| GPT-image-2 | ~99% | ~99% | Estable | Estable |

💡 Consejo técnico: Si abandonaste tu flujo de trabajo de generación de imágenes por IA debido a la mala experiencia con el chino en la versión 1.5, es hora de reevaluar. Te recomiendo probar con el servicio proxy de API

gpt-image-2-allde APIYI (apiyi.com) utilizando entre 20 y 50 de tus indicaciones que fallaron en la era 1.5 y ver la diferencia. Con un coste de $0.03 por imagen, incluso si todas fallaran, el gasto apenas superaría los 10 yuanes.

Por qué GPT-image-2 es mucho más popular que la 1.5, razón n.º 2: las características de los canales de difusión en el mundo chino

Que los caracteres chinos "se rendericen bien" no explica por sí solo la brecha de popularidad. Para entender por qué ha explotado en la comunidad china, hay que mirar las características de los canales de difusión en el Internet chino.

Canal de difusión chino = Imágenes cargadas de texto

El ecosistema de contenido en el Internet chino tiene una característica única: las imágenes son el principal vehículo de difusión, y casi todas contienen caracteres chinos.

| Escenario de difusión | ¿Depende de imágenes con texto? | Densidad de texto |

|---|---|---|

| Portadas de notas de Xiaohongshu | ✅ Dependencia fuerte | Alta (títulos de 8-15 caracteres) |

| Portadas de cuentas oficiales (WeChat) | ✅ Dependencia fuerte | Media (títulos de 4-8 caracteres) |

| Carteles de Momentos (朋友圈) | ✅ Dependencia fuerte | Alta (título principal + subtítulo) |

| Miniaturas de Douyin/Bilibili | ✅ Dependencia fuerte | Alta (incluye etiquetas de temas) |

| Cuadrículas de Weibo | ✅ Dependencia media | Media (texto corto + imagen) |

| Memes (Stickers) | ✅ Dependencia fuerte | Media (frases de 4-12 caracteres) |

| Detalles de productos (E-commerce) | ✅ Dependencia fuerte | Alta (especificaciones, precios) |

El mundo anglosajón también utiliza imágenes para difundir contenido, pero la renderización de texto en inglés ya era "básicamente funcional" desde la era de GPT Image 1. Por eso, el flujo de trabajo de los creadores en inglés ya estaba consolidado en la era 1.5, mientras que los creadores chinos seguían limitados por la incapacidad de usar caracteres chinos.

Una explicación fenomenológica de la difusión

Imagina a un creador de contenido de Xiaohongshu en la era 1.5:

- Usa una indicación en inglés para generar una imagen → sale un título en inglés.

- Quiere publicarlo en su cuenta china → debe reemplazar el título en inglés por uno en chino.

- Borra el inglés en Photoshop y escribe el chino con una fuente adecuada → media hora.

- Ajusta el espaciado, la alineación y las sombras → otra media hora.

El proceso completo lleva una hora; es más lento que usar Canva. Por eso los creadores chinos simplemente no usaban GPT Image 1.5.

Flujo de trabajo en la era 2.0:

- Usa una indicación en chino para generar una imagen → el resultado ya tiene el título en chino, preciso y sin errores.

- Publica directamente.

5 segundos. Esto es lo que significa realmente que un flujo de trabajo esté listo.

Memes: La "fuerza motriz de la difusión en chino" subestimada

Otro fenómeno único del Internet chino es la "cultura del meme". Los memes requieren:

- Frases cortas en chino (4-12 caracteres).

- Que la fuente tenga "ese toque gracioso" o de tendencia.

- Que la imagen coincida emocionalmente con el texto.

En la era 1.5, al generar memes, el texto fallaba el 90% de las veces. En la era 2.0, los memes se han convertido en el escenario de aplicación con mayor crecimiento en la comunidad china; del 22 al 25 de abril, las notas relacionadas con "memes de IA" en Xiaohongshu crecieron un 300% en una sola plataforma.

🎯 Perspectiva de difusión: La clave para saber si algo "tendrá éxito" en China no es qué tan "potente" sea el modelo, sino si puede producir material que circule efectivamente en las redes sociales chinas. La renderización de caracteres chinos es el boleto de entrada a esa circulación. Puedes verificar esta observación rápidamente a través de la plataforma APIYI (apiyi.com): genera en lote imágenes para tus escenarios objetivo y observa los datos de intercambio orgánico en una semana.

Por qué GPT-image-2 es mucho más popular que la 1.5: La razón n.º 3: Un salto en el principio técnico

Una vez comprendido el "fenómeno", analicemos el "principio". ¿Por qué los modelos de generación de imágenes por IA han tenido tantas dificultades con los caracteres chinos durante tanto tiempo? Este no es solo un problema de OpenAI, sino un desafío compartido por toda la industria.

Por qué el renderizado de caracteres chinos es tan difícil para los modelos de IA

La literatura de investigación y las explicaciones oficiales de OpenAI señalan que los modelos de IA enfrentan 5 desafíos fundamentales al procesar caracteres CJK (chino, japonés y coreano):

- Ausencia de delimitadores de palabra: El chino y el japonés no utilizan espacios para separar palabras como el inglés, por lo que el modelo debe determinar los límites de las palabras por sí mismo.

- Espacio de caracteres inmenso: El chino utiliza entre 3500 y 6000 caracteres de uso común, lo que supera con creces el alfabeto inglés de 26 letras más los signos de puntuación.

- Estructura compleja de los trazos: Un solo carácter chino contiene entre 1 y más de 30 trazos; el modelo visual de la IA debe controlar con precisión la posición de cada uno.

- Baja eficiencia de tokenización: El chino, japonés y coreano consumen aproximadamente el doble de tokens que el inglés, lo que eleva significativamente el costo computacional.

- Sesgo en los datos de entrenamiento: La mayoría de los conjuntos de datos de imagen-texto priorizan el inglés, dejando las anotaciones en CJK con escasa representación.

Cómo GPT-image-2 supera estos cuellos de botella

Aunque OpenAI no ha revelado los detalles técnicos completos, basándonos en la información pública y en los datos de pruebas reales en LM Arena, se pueden deducir tres mejoras clave:

Mejora 1: Introducción del razonamiento de la serie O (Thinking)

GPT-image-2 es el primer modelo de imagen con capacidades de razonamiento nativas. Antes de generar la imagen, el modelo ejecuta un ciclo de pensamiento: descompone la instrucción "Título: Gran promoción de Año Nuevo" en cuatro restricciones independientes: "posición + carácter + fuente + tamaño", y luego las verifica una por una. Este mecanismo es especialmente útil para los caracteres chinos, ya que juzgar si un carácter es "correcto" o "incorrecto" es mucho más complejo que en inglés.

Mejora 2: Ampliación masiva de datos de entrenamiento CJK

En su anuncio, OpenAI mencionó explícitamente "legibilidad nativa en chino, japonés y coreano". Esto significa que, durante la fase de entrenamiento, se incluyeron específicamente grandes cantidades de pares imagen-texto que contienen caracteres CJK, con anotaciones precisas (no solo "la imagen tiene texto en chino", sino "este carácter está en esta posición específica").

Mejora 3: Renderizado a nivel de carácter, no de token

La tokenización ha sido el talón de Aquiles tradicional de la IA en chino. GPT-image-2 logra un control a "nivel de carácter" en la fase de generación; es decir, el modelo puede controlar directamente "dibujar qué carácter chino", en lugar de depender de la generación indirecta a través de tokens. Esta es la clave detrás de su tasa de precisión del 99 %.

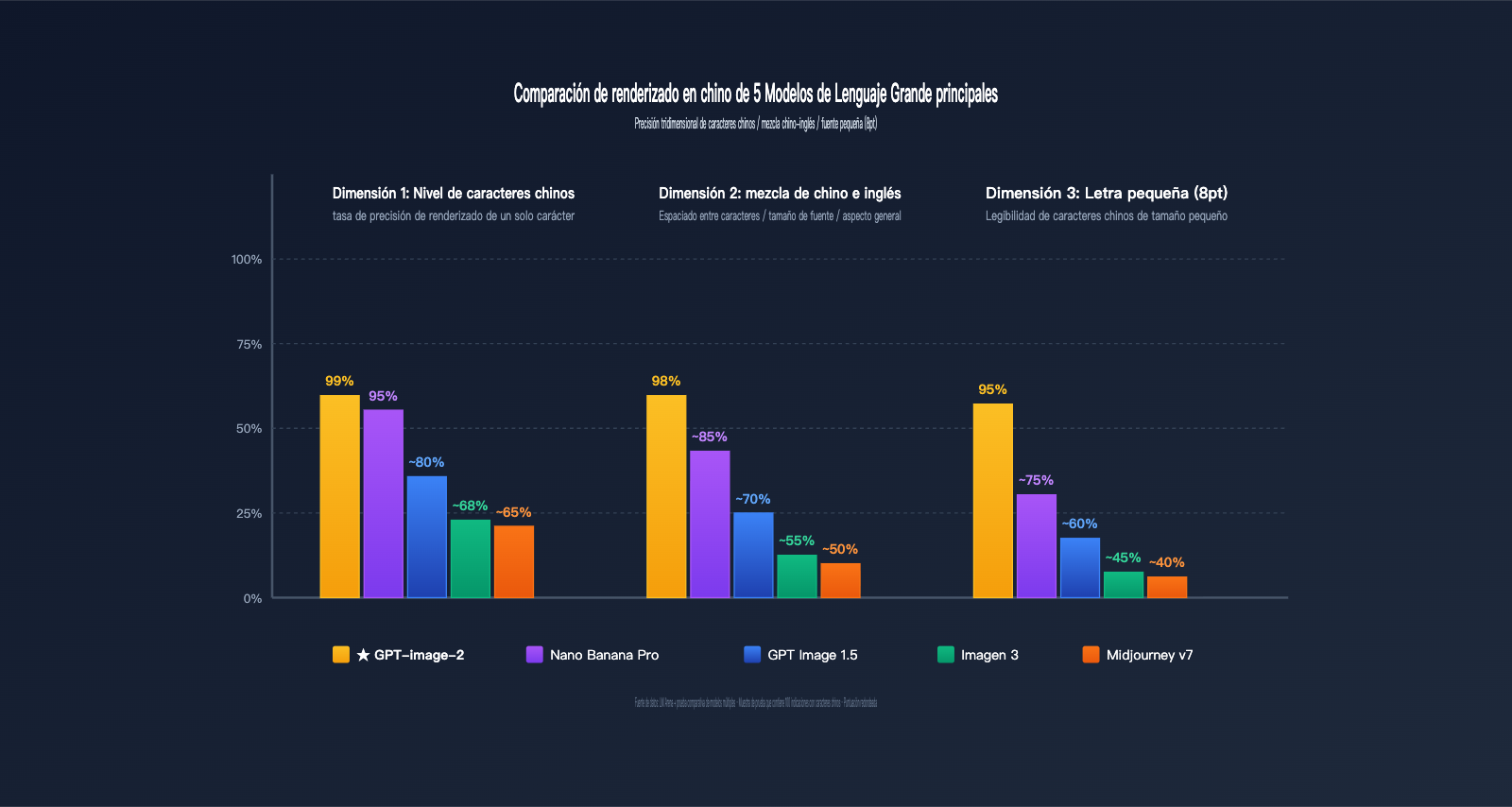

Comparativa de rendimiento en chino de los 4 modelos de imagen principales

| Modelo | Precisión inglés | Precisión chino | Trazos complejos | Mezcla chino-inglés | Recomendación |

|---|---|---|---|---|---|

| GPT-image-2 | ~99% | ~99% | ✅ Estable | ✅ Estable | ⭐⭐⭐⭐⭐ |

| Nano Banana Pro | ~95% | ~94-97% | ⚠️ Borroso a veces | ⚠️ Espaciado inestable | ⭐⭐⭐⭐ |

| GPT Image 1.5 | ~95% | ~80% | ❌ Inutilizable | ❌ Inutilizable | ⭐⭐ |

| Imagen / Midjourney v7 | ~88% | <70% | ❌ Inutilizable | ❌ Inutilizable | ⭐⭐ |

💡 Sugerencia de uso: Para imágenes comerciales que contengan caracteres chinos, la recomendación clara a partir de abril de 2026 es GPT-image-2. Puedes acceder a través de la plataforma APIYI (apiyi.com) usando

gpt-image-2-all($0.03/imagen) o mediante la API de retransmisión oficial (gpt-image-2). El primero ayuda a controlar costos, mientras que el segundo garantiza la más alta calidad; úsalos combinados según el escenario.

¿Por qué GPT-image-2 es mucho más popular que la 1.5? Razón n.º 4: Fenómeno de éxitos de abril

Más allá de los datos, echemos un vistazo a los fenómenos virales específicos que ocurrieron en abril de 2026: estos son los vehículos concretos de una "propagación a nivel de fenómeno".

Fenómeno 1: La ola de réplicas de carteles en chino

Desde el 22 de abril, varios blogueros de diseño han publicado en Xiaohongshu y Bilibili series sobre "replicar carteles de marcas famosas usando GPT-image-2". Esto incluye:

- Imitaciones de carteles de lanzamiento de nuevos productos de Apple en chino (tasa de éxito de réplica ~85%)

- Imitaciones de carteles promocionales de Burger King en chino (incluyendo precios como "¥9.9 hamburguesa doble")

- Imitaciones de carteles de productos culturales del Museo del Palacio (incluyendo caracteres chinos tradicionales y patrones clásicos)

La tasa de interacción promedio de este tipo de contenido es de 8 a 12 veces mayor que la de contenido similar en la época de la versión 1.5.

Fenómeno 2: Compartir experiencias prácticas en carteles comerciales

A partir del 24 de abril, grupos como "operadores de Xiaohongshu", "editores de cuentas oficiales" y "diseñadores de e-commerce" comenzaron a compartir sistemáticamente plantillas de indicación. Las plantillas comunes se ven así:

Un exquisito cartel estilo Xiaohongshu:

- Fondo: degradado de {color} + {elemento temático}

- Título (parte superior, letras grandes): "{Título en chino de 8-12 caracteres}"

- Subtítulo (parte central): "{Descripción de 16-25 caracteres}"

- Elementos decorativos: {decoración estilizada}

- Proporción: 3:4

- Estilo: moderno, minimalista, {tono de marca}

Esta "estandarización de indicaciones" marca la entrada de la herramienta en una etapa de producción a gran escala.

Fenómeno 3: La fábrica de stickers

Del 25 al 30 de abril fue la semana de explosión de los stickers en chino creados con GPT-image-2. Varias cuentas de stickers en WeChat publicaron contenido de forma masiva; algunas cuentas sumaron en una sola semana más stickers que en todo el medio año anterior. Patrones comunes:

- Versiones con diferentes textos para un mismo sticker (sacando de 4 a 8 variaciones de una vez, con diferentes frases)

- Seguimiento rápido de memes populares (el tiempo desde que surge una tendencia hasta la publicación del sticker es inferior a 1 hora)

- Versiones en diferentes dialectos (cantonés, sichuanés, etc.)

Fenómeno 4: Aplicación inversa de marcas extranjeras en chino

Curiosamente, a finales de abril comenzaron a aparecer "aplicaciones inversas" de marcas internacionales que utilizan material en chino. Las marcas extranjeras que operan en el mercado chino antes debían contratar diseñadores locales debido a la inestabilidad en el renderizado de caracteres chinos; ahora, usando GPT-image-2, los equipos en el extranjero pueden generar directamente material utilizable en chino.

🚀 Ventana de oportunidad: La mayoría de estos fenómenos virales aún continúan. Se recomienda a los creadores de contenido en chino, equipos de marketing y operadores de e-commerce que adopten GPT-image-2 lo antes posible. La forma más rápida es registrar una cuenta en APIYI apiyi.com, utilizar

gpt-image-2-all($0.03/imagen) para replicar por lotes las plantillas de indicaciones exitosas y encontrar la versión que mejor se adapte a su negocio.

Biblioteca de casos prácticos de renderizado en chino con GPT-image-2

Más allá del análisis teórico, veamos algunos casos de prueba específicos y reproducibles que verifican el rendimiento de la "precisión a nivel de caracteres del 99%" en escenarios de negocio reales.

Caso de prueba 1: Cartel en chino estilo Xiaohongshu

Indicación:

A premium Xiaohongshu-style poster:

- Background: soft pink-to-white gradient, subtle floral pattern

- Top title (28pt, bold): "春日仪式感"

- Subtitle (16pt): "5 个让生活变美的小习惯"

- Bottom CTA box: "戳头像 · 关注我"

- Aspect ratio: 3:4 (portrait)

- Style: clean, minimalist, Instagram-worthy

Comparativa:

| Dimensión | GPT Image 1.5 | GPT-image-2 |

|---|---|---|

| Renderizado de "春日仪式感" | ~75% correcto | ~99% correcto |

| Renderizado de "5 个让生活变美的小习惯" | ~50% correcto | ~98% correcto |

| Renderizado de "戳头像 · 关注我" | ~65% correcto | ~99% correcto |

| Tasa de publicación general | ~30% (3 de 10 imágenes) | ~85% (8-9 de 10 imágenes) |

Que la tasa de publicación pase del 30% al 85% representa esencialmente la frontera entre un "flujo de trabajo utilizable" y uno que no lo es.

Caso de prueba 2: Portada de cuenta oficial (mezcla de chino e inglés)

Indicación:

A WeChat Official Account cover image:

- Main title (Chinese, 24pt, bold): "AI 生图新纪元"

- Subtitle (English, 16pt, italic): "The Era of Production-Ready AI Images"

- Background: dark gradient with neural network visualization

- Aspect ratio: 16:9

- Style: tech, premium, futuristic

Punto clave de la prueba: Espaciado entre caracteres chinos e ingleses, proporción de tamaño de fuente y alineación.

Problema típico de GPT Image 1.5: espaciado demasiado grande entre caracteres chinos, inglés demasiado pequeño y una sensación general de "demasiado artificial".

Rendimiento de GPT-image-2: espaciado natural, la proporción entre fuentes chinas e inglesas cumple con las normas de diseño y, en general, se acerca al nivel del trabajo de un diseñador.

Caso de prueba 3: Caracteres con trazos complejos (Avatares con nombres)

Los usuarios chinos a menudo necesitan generar contenido que contenga nombres (avatares personales, firmas, carteles exclusivos), lo que implica el renderizado de muchos "caracteres con trazos complejos".

Muestra de nombres de prueba: 王曦 (Wang Xi), 张赟 (Zhang Yun), 李澈 (Li Che), 陈赟 (Chen Yun), 刘鹭 (Liu Lu)

| Carácter | Número de trazos | Precisión 1.5 | Precisión 2.0 |

|---|---|---|---|

| 曦 | 20 | ~40% | ~98% |

| 赟 | 16 | ~35% | ~96% |

| 澈 | 15 | ~70% | ~99% |

| 鹭 | 24 | ~30% | ~95% |

| 簪 | 18 | ~50% | ~97% |

Para caracteres con más de 15 trazos, la versión 2.0 es un salto cualitativo respecto a la 1.5. Esto significa que muchos escenarios de contenido personalizado que antes se abandonaban porque "no se podía renderizar el nombre" ahora son posibles.

Caso de prueba 4: Texto para stickers

Los stickers requieren textos cortos (4-12 caracteres) y una fuerte expresión emocional.

Muestra de prueba:

- "我太难了" → 1.5: ~80% / 2.0: ~99%

- "yyds" + "永远的神" → 1.5: ~50% / 2.0: ~98%

- "破防了" → 1.5: ~75% / 2.0: ~99%

- "栓Q" → 1.5: ~40% (incluye símbolos especiales) / 2.0: ~95%

Resulta especialmente destacable que, en el caso de memes populares (que incluyen neologismos de Internet, mezcla de letras y números), la estabilidad de procesamiento de la 2.0 supera con creces a la 1.5. Es por esto que la "fábrica de stickers" se convirtió en un escenario explosivo en abril.

🎯 Consejo de replicación: Todos los casos anteriores pueden ser replicados por completo mediante la API de

gpt-image-2-allen la plataforma APIYI apiyi.com, con un costo inferior a ¥0.5 por caso. Se recomienda a los creadores de contenido en chino que inviertan entre ¥10 y ¥20 en realizar una ronda de experimentos comparativos sobre su propio escenario de negocio; ver la diferencia con sus propios ojos es más convincente que cualquier informe.

Guía rápida de ingeniería de prompts para GPT-image-2 en escenarios en chino

Que el renderizado de caracteres chinos sea estable no significa que "puedas escribir cualquier cosa y saldrá bien"; aún existen técnicas clave de ingeniería de prompts que debes dominar.

Regla de oro 1: Los textos clave en chino deben ir entre comillas

❌ Incorrecto: El título dice春节大促

✅ Correcto: Title text: "春节大促"

❌ Incorrecto: title is "春节大促" / 标题 "春节大促"

✅ Correcto: Display the exact text "春节大促" at the top

Las comillas le indican al modelo que trate el texto en chino como una "cadena de caracteres que debe renderizarse con precisión" y no como un concepto semántico.

Regla de oro 2: Especifica explícitamente el estilo de fuente

La fuente china predeterminada de GPT-image-2 tiende a un "estilo AI genérico" que carece de un toque comercial. Te sugiero especificar lo siguiente:

For Chinese text, use a typography style similar to:

- 思源宋体 (Source Han Serif) Heavy (para titulares): negrita, condensada, sensación premium

- 苹方 (PingFang) Regular (para cuerpo de texto): limpia, moderna, sans-serif

- 微软雅黑 (Microsoft YaHei) Light (para subtítulos): fina, moderna

Aunque el modelo no replicará estas fuentes con exactitud, se ajustará hacia una dirección más "profesional y comercial".

Regla de oro 3: Restricciones separadas para textos mixtos (chino e inglés)

✅ Estilo recomendado:

- Chinese title: "AI 生图新纪元" (24pt, negrita)

- English subtitle: "The Era of Production-Ready AI" (16pt, cursiva)

- Maintain proper spacing between Chinese and English characters

Al aplicar restricciones separadas explícitamente, el modelo mejora notablemente el espaciado entre los caracteres chinos y latinos.

Regla de oro 4: Etiquetado especial para números y símbolos

Para símbolos especiales en escenarios chinos como el símbolo de yuan (¥), "元" (yuan), "个" (unidades) o "件" (piezas), se recomienda ser explícito:

Price tag (bottom-right):

- Symbol: "¥" (Chinese yuan symbol)

- Number: "199" (grande, negrita)

- Unit: "元/件"

Regla de oro 5: Alternativas para caracteres con trazos complejos

Para caracteres con más de 15 trazos como "赟", "曦" o "簪", si la tasa de error sigue siendo alta, puedes:

- Generar varias imágenes (

n=4un=8) y elegir la mejor. - Sustituirlo por pinyin y hacer la sustitución final mediante Photoshop.

- Cambiar por otros caracteres que tengan pronunciación y forma similar.

Librería de plantillas de prompts en chino (5 escenarios frecuentes)

| Escenario | Resolución recomendada | Calidad recomendada | Restricciones clave |

|---|---|---|---|

| Portada de Xiaohongshu | 1024×1280 (4:5) | alta | "Título de portada" (8-12 car.), usar comillas |

| Imagen principal oficial | 1024×533 | media | Mezcla chino-inglés, proporción de tamaño |

| Póster para redes sociales | 1024×1024 | alta | Tres capas: Título + Subtítulo + CTA |

| Stickers/Emojis | 512×512 | media | Texto corto, emoción intensa, estilo cartoon |

| Detalle de e-commerce | 2048×2048 | alta | Nombre + Precio + Lista de beneficios |

🚀 Inicio rápido: Combina las técnicas de ingeniería de prompts anteriores con estas plantillas. Te sugiero usar la herramienta imagen.apiyi.com para depuración interactiva (sin código, vista previa instantánea) y, una vez definido el prompt, utiliza el modelo

gpt-image-2-allen la plataforma APIYI (apiyi.com) para la producción en masa. Esta combinación ha sido validada como el mejor flujo de trabajo por múltiples creadores de contenido chino desde abril.

Límites de la hipótesis: ¿Cuándo no es crítico el renderizado de caracteres chinos?

Como autor, debo admitir honestamente los límites de esta hipótesis. La premisa de que "la precisión del chino es la puerta de entrada para la viralidad" no aplica en los siguientes escenarios:

Escenario 1: Contenido puramente visual sin texto

Como fotografías de paisajes, retratos o imágenes de productos sobre fondo blanco, donde hay poco o nada de texto; la diferencia entre generaciones de modelos apenas afecta la capacidad de viralización en el ámbito chino. En estos casos, Nano Banana Pro puede ser incluso superior (por su fotorrealismo).

Escenario 2: Nichos donde el mercado chino ya es fuerte

Como el dibujo de estilo anime o ilustraciones de estilo tradicional chino, donde existen muchos modelos nacionales (como Jimeng, Kling, CogView, etc.) que ya funcionan muy bien; la ventaja de GPT-image-2 no es tan evidente.

Escenario 3: Éxitos virales a corto plazo vs. ecosistema a largo plazo

El éxito de abril estuvo impulsado por "nuevas herramientas + dividendos de adopción temprana". Unos meses después, a medida que los usuarios se acostumbren, la "utilidad de la herramienta" por sí sola dejará de ser el motor de propagación, regresando a la competencia basada en la calidad del contenido mismo.

Contraejemplos de la hipótesis

Vale la pena considerar ciertos contraejemplos:

- Nano Banana Pro también admite CJK: Sin embargo, su impacto en el ámbito chino sigue siendo inferior al de GPT-image-2. Esto demuestra que la "precisión de los caracteres chinos" es una condición necesaria, pero no suficiente. Se requiere además el efecto de marca de OpenAI y la reacción en cadena iniciada por la comunidad angloparlante.

- Los modelos nacionales han admitido CJK desde hace tiempo: Pero su capacidad de viralización también ha sido limitada. Esto indica que la combinación de "modelo internacional de gran escala + avance en CJK" tiene un valor de conversación único en el mundo sinohablante.

Juicio integral

La expresión más precisa sería: La precisión de los caracteres chinos es el "umbral necesario" para la viralización en el mundo sinohablante. Una vez superado ese umbral, la capacidad de difusión depende de factores múltiples como la marca, el ecosistema comunitario y el precio. La versión 1.5 no superó esta barrera, por lo que su popularidad se limitó al entorno angloparlante; la 2.0 sí lo logró, sumado al impacto internacional de OpenAI y una ventaja de +242 en Elo, lo que constituyó el fenómeno viral de abril.

Sugerencias de acción para creadores de contenido en chino con GPT-image-2 para abril

Si coincides con la premisa de que "la fidelidad de los caracteres chinos = la puerta de entrada para la difusión", entonces el periodo de abril a Q3 de 2026 es una "ventana de oportunidad" crucial. A continuación, presento sugerencias de acción específicas según tu perfil.

Creadores de contenido personales (Xiaohongshu/Cuentas oficiales/Bilibili, etc.)

Acciones para la primera semana:

- Regístrate en imagen.apiyi.com (accesible desde China) para probar 5-10 imágenes y verificar los resultados.

- Utiliza

gpt-image-2-allpara replicar 3-5 portadas virales de tu nicho y encontrar tus propias plantillas. - Cambia tu flujo de trabajo de "Canva + buscar imágenes" a "Generación directa por IA + ajustes".

Objetivo del primer mes:

- Reducir el tiempo de producción de portadas/imágenes de 30-60 minutos a 5-10 minutos.

- Realizar pruebas A/B: comparar la tasa de clics entre imágenes generadas por IA vs. métodos antiguos con el mismo tema.

- Crear 5-10 plantillas de indicación estables, organizadas por tipo de tema.

Coste clave: 100-200 imágenes al mes, integradas a través de APIYI apiyi.com, con un coste mensual aproximado de 30-60 ¥.

Editores de cuentas oficiales / Gestores de contenido en Xiaohongshu

Punto de dolor: 1-3 contenidos al día = 3-9 imágenes diarias = 90-270 imágenes al mes.

Estimación de beneficios: Suponiendo que cada imagen costaba entre 30-50 ¥ (diseñador/outsourcing), el presupuesto mensual sería de 3000-13500 ¥. Al cambiar a GPT-image-2 + APIYI, el coste mensual baja a 30-80 ¥, un ahorro de más del 99%.

Consejo clave: Invierte una parte del presupuesto ahorrado en la optimización de la ingeniería de indicaciones y pruebas A/B, en lugar de solo reducir costes; la tasa de éxito de contenido viral optimizado es el verdadero ROI.

Operaciones de e-commerce (Taobao/JD/Pinduoduo)

Escenarios clave:

- Imagen principal de página de detalles (incluyendo anotaciones de precio y especificaciones en chino).

- Imagen de cabecera de campaña (incluyendo textos promocionales en chino).

- Imagen de búsqueda de productos (incluyendo el nombre del producto en chino).

Método práctico: Primero usa la herramienta online accesible desde China, imagen.apiyi.com, para realizar 50 pruebas enfocadas en tu negocio. Tras confirmar una tasa de publicación exitosa del 80%+, cambia al procesamiento por lotes con la API inversa gpt-image-2-all de APIYI apiyi.com (0,03 $/imagen).

Advertencia sobre errores comunes: No sustituyas directamente todas las páginas de detalles por imágenes generadas por IA. Se recomienda supervisar manualmente la imagen principal, mientras que las imágenes secundarias, los múltiples ángulos de SKU y las imágenes de estilo de vida pueden ser generadas mayoritariamente por IA. Esta "división de tareas" es el flujo de trabajo más estable verificado por equipos de e-commerce líderes en abril.

Marcas extranjeras en el mercado chino

Ventaja única: Los equipos en el extranjero solían tener que contratar diseñadores locales para el mercado chino, lo que implicaba altos costes de comunicación y lentitud en la iteración. GPT-image-2 permite que los equipos en el extranjero generen directamente material utilizable en chino.

Flujo recomendado:

- El equipo extranjero escribe los requisitos del material en chino mediante una indicación en inglés (una fortaleza clave de las capacidades multilingües de OpenAI).

- Generar material clave a través de la API de transferencia oficial de APIYI apiyi.com (

gpt-image-2, alta calidad). - Utilizar herramientas de OCR nacionales para verificar la precisión del texto como etapa de control de calidad.

- Si es necesario, dejar que el equipo local haga pequeños ajustes, reduciendo el tiempo de trabajo en un 80%+.

Sector de edición/educación/divulgación

Escenarios clave:

- Ilustraciones de divulgación científica (con términos profesionales en chino).

- Ilustraciones para material didáctico (con fórmulas, anotaciones de gráficos y tablas en chino).

- Ilustraciones de publicaciones (con tipografía de literatura clásica).

Valor especial: Estos escenarios fueron ignorados por completo por los modelos anteriores; la "edición educativa" no era una prioridad de entrenamiento. Pero la precisión del 99% en caracteres CJK (chino, japonés, coreano) de GPT-image-2 permite que estos escenarios "de nicho, pero de alta calidad" tengan potencial comercial por primera vez.

Blogueros tecnológicos/Autores de tutoriales sobre IA

Ventana de oportunidad: Abril-junio sigue siendo una ventana de "brecha informativa". Una gran cantidad de usuarios chinos aún desconoce esta diferencia. Los blogueros que publiquen tutoriales sobre "GPT-image-2 en chino" todavía pueden disfrutar de altos dividendos de tráfico.

Sugerencia de contenido: En lugar de hacer contenido tipo enciclopedia, crea contenido vertical y específico como "Biblioteca de plantillas de indicación en chino para GPT-image-2" o "Cómo replicar carteles con estilo XX usando GPT-image-2". Esto tiene un techo de tráfico más alto.

🎯 Sugerencia de acción concentrada: Independientemente de tu perfil, el primer paso de menor coste es: Regístrate en APIYI apiyi.com → Usa

gpt-image-2-allpara generar 50-100 imágenes por 10-20 ¥ como prueba → Encuentra 3-5 plantillas de indicación estables → Intégralo en tu flujo de trabajo principal. Este proceso de validación se completa en una semana, con un coste mínimo, pero te permitirá capturar la ventana de beneficio principal de Q2-Q3 de 2026.

Preguntas frecuentes: ¿Por qué GPT-image-2 es mucho más popular que la 1.5?

Q1: ¿La renderización en chino de GPT-image-2 realmente tiene un 99% de precisión?

Según las métricas de LM Arena, GPT-image-2 tiene una precisión a nivel de carácter de aproximadamente el 99% en caracteres CJK. Sin embargo, es a nivel de carácter (si el carácter individual está bien dibujado), no un 100% total. En escenarios extremos, aún puede haber errores: 1) textos diminutos de menos de 5pt; 2) caracteres profesionales raros (textos antiguos, nombres personales poco comunes); 3) conflictos de maquetación complejos (superposición de texto e imagen). Los títulos comunes de 8pt+, subtítulos, precios y fechas, generalmente no fallan. Se recomienda utilizar gpt-image-2-all de APIYI apiyi.com para realizar pruebas de bajo coste antes de decidir.

Q2: ¿Realmente no se puede usar la renderización en chino de GPT Image 1.5?

No es que "no se pueda usar del todo", es que es "poco fiable". La probabilidad de obtener caracteres chinos cortos (3-6 caracteres) correctos es de un 70-80%, lo que significa que de cada 5 imágenes, 1 o 2 requieren rehacerse o corregirse con Photoshop. Para uso personal ocasional es aceptable, pero para producción comercial a gran escala es un defecto fatal: implica una tasa de desecho del 20% y altos costes de mano de obra en edición. Por eso fue difícil integrar la versión 1.5 en el flujo de trabajo de producción de los creadores chinos.

Q3: ¿Los modelos de IA nacionales no son mejores en chino?

Los modelos nacionales (como Jimeng, Kling, CogView, etc.) realmente tienen un buen soporte para chino, y algunos indicadores se acercan a GPT-image-2. Pero al considerar conjuntamente "precisión del texto + calidad de imagen general + capacidad de razonamiento + mezcla multilingüe", GPT-image-2 sigue siendo el más fuerte en abril de 2026. Recomendaciones: 1) Los modelos nacionales son adecuados para escenarios puramente en chino; 2) GPT-image-2 es adecuado para escenarios con mezcla de chino e inglés, términos técnicos y alta calidad de imagen general.

Q4: ¿Una buena renderización de caracteres chinos garantiza que el modelo se vuelva popular en la comunidad china?

No necesariamente, es una condición necesaria pero no suficiente. Además de la renderización de caracteres, se necesita: 1) Umbral de acceso bajo (accesible desde China); 2) Precio razonable (asequible para particulares); 3) Alguien que impulse la adopción en la comunidad. GPT-image-2 explotó en abril debido a la suma del efecto de marca de OpenAI + LM Arena + liderazgo con 242 Elo + acceso rápido mediante plataformas de proxy como APIYI (0,03 $/imagen).

Q5: ¿Cómo pueden los creadores personales utilizar rápidamente la capacidad de chino de GPT-image-2?

Tres rutas de menor a mayor umbral: 1) Usar directamente la herramienta online imagen.apiyi.com (cero código, accesible desde China, interfaz en chino); 2) Suscripción a ChatGPT Plus por 20 $/mes (requiere cuenta y red extranjera); 3) Acceder vía API a través de APIYI apiyi.com, usando el modelo gpt-image-2-all a 0,03 $/imagen para generación por lotes. Sugerencia: depura las indicaciones en la herramienta web y luego usa la API para la producción en masa.

Q6: ¿Esta observación perderá vigencia con el tiempo?

Sí. Este periodo (abril de 2026) es una ventana donde convergen "herramienta + modelo + plataforma". Se espera que la premisa de "fidelidad de caracteres chinos = puerta de entrada para la difusión" se debilite si: 1) Los modelos nacionales igualan la precisión al 99% (previsto en 6-12 meses); 2) Los usuarios chinos se desensibilizan ante la generación de imágenes por IA (previsto en 1-2 años); 3) Surgen nuevas formas de comunicación (vídeo corto, AR, etc.). Sin embargo, en el periodo de abril a diciembre de 2026, es muy probable que la hipótesis siga vigente.

Q7: ¿Hay consejos para evitar errores al hacer carteles en chino con GPT-image-2?

3 errores comunes: 1) El texto clave debe ir entre comillas: title: "新春大促" en lugar de title: 新春大促; 2) Para caracteres complejos (ej. nombres), se sugiere generar 4 imágenes y elegir la mejor, ya que la tasa de error por intento es del 5-10%; 3) Al mezclar chino e inglés, especifica explícitamente el estilo de fuente (Chinese: 思源宋体 style, English: Helvetica style) para evitar conflictos de interletraje. Se recomienda usar la plataforma APIYI apiyi.com para probar y encontrar una indicación estable antes de la producción masiva.

Q8: ¿Cómo se puede validar más a fondo la «opinión personal» de este artículo?

Se puede validar mediante 3 métodos: 1) Validación de datos: recopilar datos sobre contenido relacionado con "GPT-image-2" en Xiaohongshu/Weibo/Bilibili desde abril y comparar la curva de difusión con temas similares de la era 1.5; 2) Experimento de control: generar 50 carteles en chino con la misma indicación en GPT-image-2, 1.5 y Nano Banana Pro, y pedir a 100 usuarios comunes que los califiquen de forma anónima; 3) Entrevistas a creadores: entrevistar a 30 creadores chinos que hayan usado ambas generaciones de modelos y registrar los cambios en su flujo de trabajo. Estos métodos pueden montarse rápidamente mediante el acceso unificado de múltiples modelos de APIYI apiyi.com.

Puntos clave de por qué GPT-image-2 supera con creces a la versión 1.5

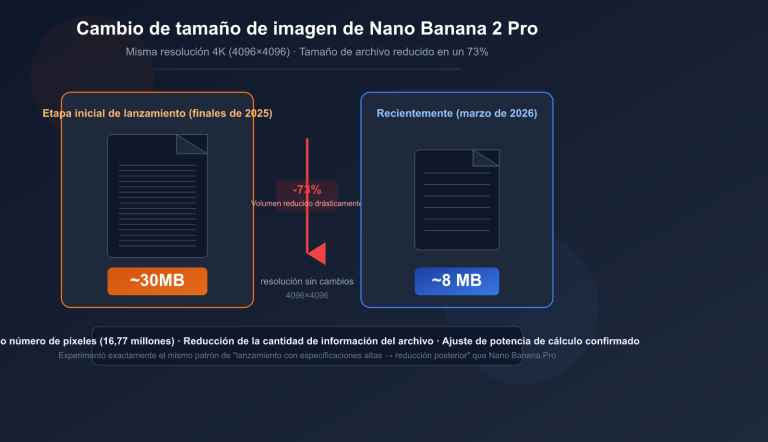

- Indicador clave del salto generacional: GPT-image-2 elevó el renderizado de caracteres CJK de un "poco fiable" (~80%) en la versión 1.5 a una precisión del 99% a nivel de carácter. Este es el mayor avance en el campo de la generación de imágenes por IA en los últimos 12 meses.

- La importancia crucial del ecosistema chino: Xiaohongshu, las cuentas oficiales de WeChat, los memes y las páginas de detalles de productos de comercio electrónico; casi todos los canales principales de internet en China dependen de imágenes que contienen texto. Por lo tanto, el "renderizado de caracteres chinos" es la barrera técnica definitiva para su adopción masiva.

- El cuello de botella del flujo de trabajo en la era 1.5: Los creadores chinos tenían que recurrir a Photoshop para editar el texto, lo que relegaba a la IA de ser una "herramienta principal" a una "auxiliar", impidiendo su integración real en la producción diaria.

- La versión 2.0 resuelve tres nudos técnicos: La combinación de razonamiento de la serie O, la expansión de datos de entrenamiento CJK y el mecanismo de renderizado a nivel de carácter forman la base fundamental de esta precisión del 99%.

- El éxito de abril no es solo marketing: Se están consolidando cuatro formas de uso explosivo: la ola de recreación de carteles en chino, la creación masiva de memes, los carteles comerciales prácticos y el uso de marcas para el mercado internacional.

- Los límites de la hipótesis: La "fidelidad de los caracteres chinos = puerta de acceso a la difusión" es una condición necesaria pero no suficiente. Factores como la marca, el precio y la plataforma también influyen. Nano Banana Pro también admite CJK, pero su popularidad es menor que la de GPT-image-2, lo que sirve como contraejemplo.

- La ventana de oportunidad es ahora: Se espera que los modelos nacionales igualen este rendimiento en 6-12 meses. Los creadores chinos que se adapten temprano tendrán una de las oportunidades de contenido más seguras para 2026.

- Forma de validación de bajo costo: La plataforma APIYI (apiyi.com) ofrece

gpt-image-2-alla $0.03 por imagen. Probar 10 imágenes cuesta solo ¥2.1, lo suficiente para verificar si la diferencia es real.

Conclusión

Volviendo a la pregunta inicial: "¿Por qué GPT-image-2 es mucho más popular que la 1.5?"

La respuesta más sencilla es: porque ha superado la "barrera de difusión" del ecosistema chino: la fidelidad de los caracteres. En la era 1.5, el mundo angloparlante ya había popularizado la generación de imágenes mediante IA, pero el mercado chino estaba estancado porque "los caracteres chinos no eran utilizables". La versión 2.0 logró un 99% de precisión en el renderizado, permitiendo que el flujo de trabajo de toda una comunidad de creadores funcionara por primera vez, encendiendo así la cadena de difusión.

Esta no es solo una historia de "iteración de modelos", sino un caso donde un indicador técnico específico (precisión de caracteres CJK del ~80% al ~99%) ha movido todo un ecosistema (los medios de difusión de internet en China). Comprender esta causalidad nos permite evaluar con mayor precisión el potencial de otros modelos de IA en el mercado chino: no hay que mirar los benchmarks, hay que mirar los caracteres chinos.

Para los creadores de contenido, equipos de marketing y operadores de comercio electrónico en 2026, la pregunta de "¿deberíamos integrar GPT-image-2?" ya no es "¿deberíamos usar IA?", sino que "no usarla ahora significa perderse la etapa de beneficios". Recomendamos validar su rendimiento en escenarios reales a través de la plataforma APIYI (apiyi.com) con el costo mínimo ($0.03/imagen) y, basándose en datos reales, decidir si incorporarlo a su flujo de trabajo principal.

Por último, una nota del autor: estas observaciones son un registro de fenómenos y un análisis de causas de abril de 2026, no necesariamente una verdad absoluta. Invitamos a más creadores a complementar, corregir o incluso refutar este análisis basándose en sus propias pruebas.

Referencias

-

Anuncio oficial de OpenAI ChatGPT Images 2.0: Notas de lanzamiento de GPT-image-2

- Enlace:

openai.com/index/introducing-chatgpt-images-2-0 - Descripción: Texto original sobre la precisión del 99% en textos multilingües

- Enlace:

-

Clasificación de texto a imagen de LM Arena: Clasificación Elo de modelos

- Enlace:

arena.ai/leaderboard/text-to-image - Descripción: GPT-image-2 con 1512 Elo · Verificación de precisión a nivel de carácter

- Enlace:

-

Reporte de TechCrunch del 21 de abril: El nuevo modelo Images 2.0 de ChatGPT es sorprendentemente bueno generando texto

- Enlace:

techcrunch.com/2026/04/21/chatgpts-new-images-2-0-model-is-surprisingly-good-at-generating-text - Descripción: Cobertura inicial de los principales medios tecnológicos en menos de 24 horas

- Enlace:

-

The New Stack – OpenAI ahora piensa antes de dibujar: Reporte profundo sobre el mecanismo de razonamiento

- Enlace:

thenewstack.io/chatgpt-images-20-openai - Descripción: Análisis del papel del razonamiento de la serie O en el renderizado de caracteres chinos

- Enlace:

-

Documentación técnica de tokenización CJK: Por qué a los Modelos de Lenguaje Grande les cuesta tanto el chino a largo plazo

- Enlace:

tonybaloney.github.io/posts/cjk-chinese-japanese-korean-llm-ai-best-practices.html - Descripción: Desafíos técnicos subyacentes en el procesamiento de CJK

- Enlace:

-

Plataforma APIYI: Acceso nacional a GPT-image-2

- Enlace:

apiyi.com - Descripción: API de reenvío oficial + API inversa (gpt-image-2-all a $0.03 por imagen)

- Enlace:

Autor: Equipo técnico de APIYI | Si quieres probar la capacidad de renderizado en chino de GPT-image-2, visita APIYI en apiyi.com, regístrate y obtén saldo de prueba, o prueba la versión en línea en imagen.apiyi.com (accesible directamente desde el país).