Nota del autor: Análisis profundo de las causas del error finishReason OTHER al generar imágenes con la API de Gemini, incluyendo el control de riesgos de personajes con derechos de autor y mecanismos de moderación de contenido. Se ofrecen soluciones para evitarlo y la alternativa de APIYI.

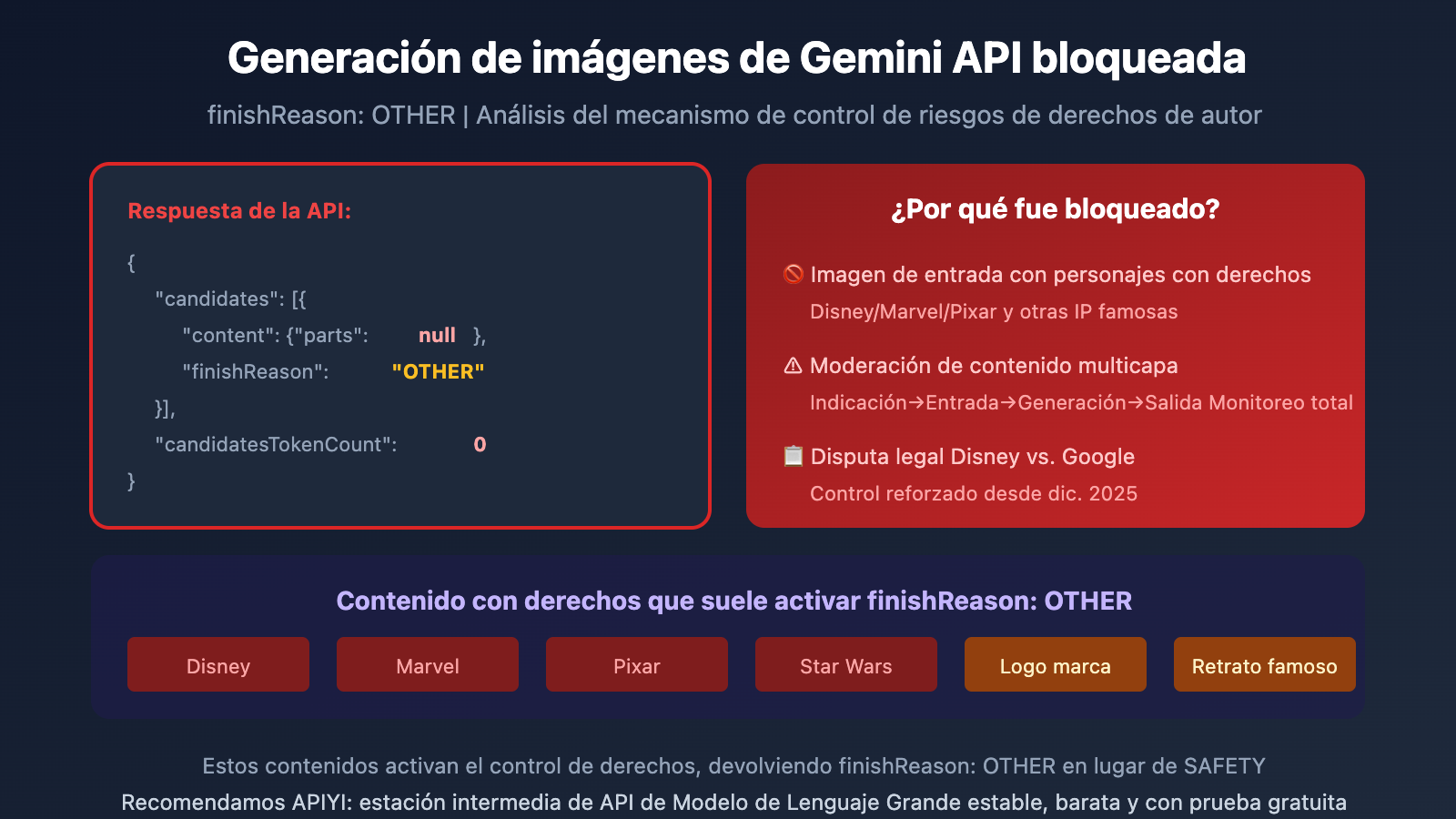

Al generar imágenes con la API de Gemini, de repente recibes un error extraño: finishReason: "OTHER", content.parts: null, sin ninguna imagen de vuelta. En este artículo analizaremos en profundidad la razón real de este error y cómo evitar problemas de control de riesgos por derechos de autor.

Valor principal: Al terminar de leer, comprenderás el mecanismo de moderación de contenido multicapa de la API de Gemini, entenderás por qué personajes de Disney, Marvel, etc., activan el control de riesgos y dominarás métodos para usar las API de generación de imágenes de forma conforme.

Análisis central del error finishReason OTHER

Cuando recibes la siguiente respuesta, significa que la generación de imágenes ha sido interceptada por el sistema de moderación de contenido de Google:

{

"candidates": [

{

"content": {

"parts": null

},

"finishReason": "OTHER",

"index": 0

}

],

"usageMetadata": {

"promptTokenCount": 306,

"candidatesTokenCount": 0,

"totalTokenCount": 478,

"thoughtsTokenCount": 172

},

"modelVersion": "gemini-3-pro-image-preview"

}

| Campo | Significado | Explicación |

|---|---|---|

finishReason: "OTHER" |

Motivo de terminación no estándar | No pertenece a STOP/SAFETY/MAX_TOKENS |

content.parts: null |

Sin contenido devuelto | La imagen fue interceptada, no se generará |

candidatesTokenCount: 0 |

Tokens de salida en 0 | Se confirma que no se generó ningún contenido |

thoughtsTokenCount: 172 |

Tokens de pensamiento consumidos | El modelo intentó generar pero fue detenido |

¿Por qué es OTHER y no SAFETY?

La API de Gemini tiene varios valores para finishReason:

| finishReason | Escenario de activación |

|---|---|

STOP |

Generación completada normalmente |

SAFETY |

Filtro de seguridad activado (erotismo/violencia/odio, etc.) |

MAX_TOKENS |

Se alcanzó el límite máximo de tokens |

RECITATION |

Detección de repetición de contenido con derechos de autor |

OTHER |

Moderación de contenido por derechos de autor/marcas/no clasificado |

finishReason: OTHER generalmente significa que se activó un control de riesgos relacionado con derechos de autor o marcas comerciales, en lugar de un filtro de contenido de seguridad tradicional.

¿Por qué se bloquean los personajes de Disney?

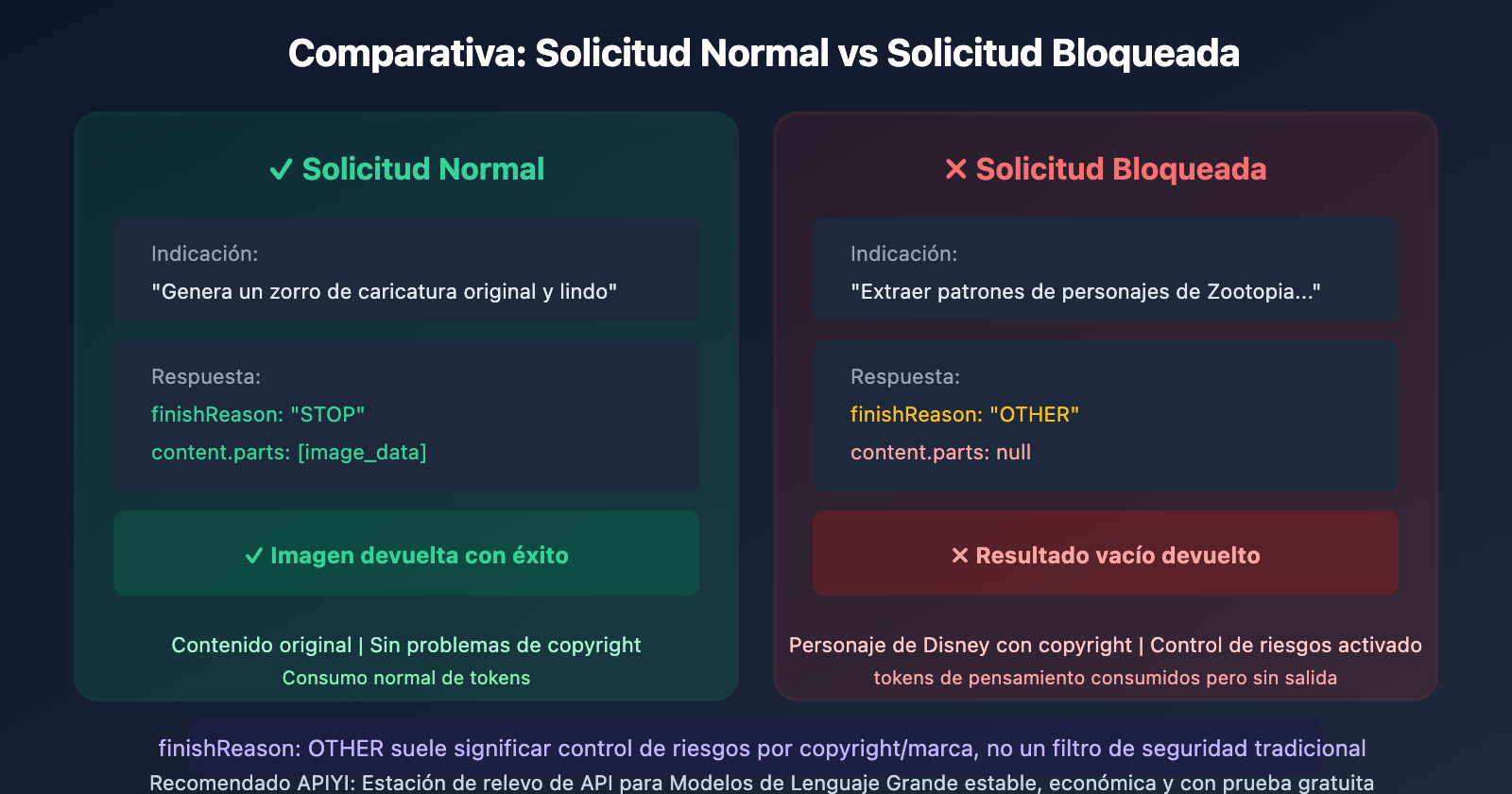

Caso: Error al extraer imágenes de Zootopia

Un usuario intentó procesar una imagen de un personaje de Zootopia con la siguiente indicación:

"Extrae estrictamente los patrones de la imagen proporcionada, identifica con precisión y restaura por completo los elementos de diseño como patrones y texturas, asegurando que no haya omisiones ni distorsiones. Elimina las arrugas. Restaura como una imagen de impresión plana que llene toda la pantalla."

Resultado: finishReason: OTHER, la generación de la imagen falló.

Análisis de causas

| Causa | Descripción |

|---|---|

| Identificación de personajes con copyright | Gemini identifica personajes de IPs famosas como Disney, Marvel, Pixar, etc. |

| Protección de marcas registradas | Nick Wilde y Judy Hopps son marcas registradas de Disney. |

| Mitigación de riesgos legales | En diciembre de 2025, Disney envió una carta de cese y desista a Google por infracción de derechos. |

| Mecanismo de filtrado de múltiples capas | Incluso si la indicación pasa el primer filtro, el proceso puede ser bloqueado durante la generación. |

El conflicto de copyright entre Disney y Google

El 10 de diciembre de 2025, Disney envió una notificación de infracción a Google, alegando que la IA Gemini estaba violando masivamente sus derechos de autor:

- Involucra personajes de The Avengers, Star Wars, entre otros.

- Disney presentó como evidencia imágenes de personajes como Darth Vader generadas por Gemini.

- Google reforzó posteriormente el control de riesgos para personajes de IPs conocidas.

Es por esto que ahora el procesamiento de imágenes que involucra personajes de Disney, Marvel o Pixar es bloqueado con frecuencia.

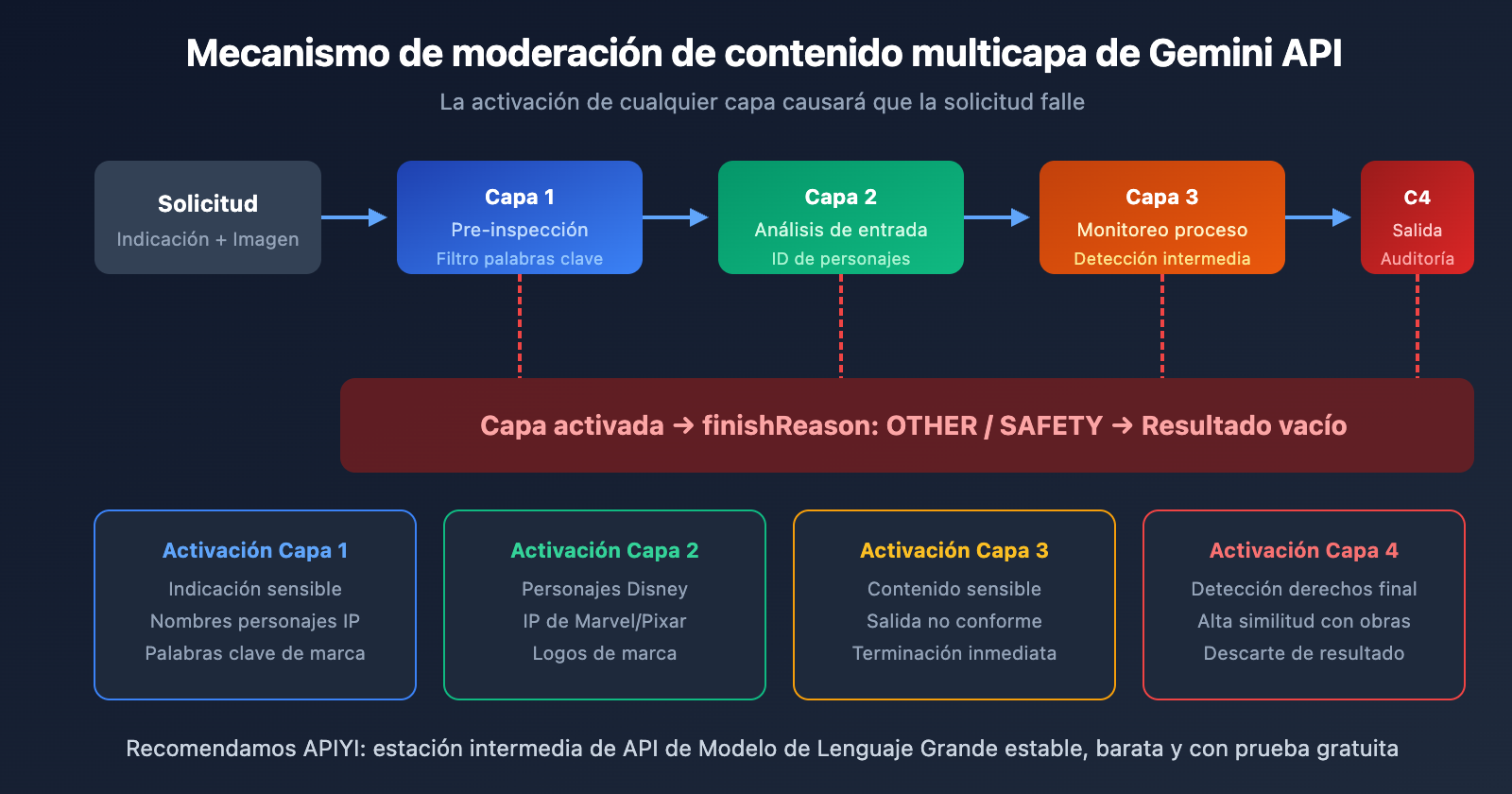

Mecanismo de revisión de contenido de múltiples capas de la API de Gemini

La generación de imágenes en Gemini utiliza un sistema de filtrado por capas; si cualquiera de ellas se activa, la solicitud fallará:

Primera capa: Pre-verificación de la indicación

Antes de llamar al modelo, el sistema comprueba si la indicación contiene:

- Palabras clave sensibles (pornografía, violencia, odio).

- Nombres de personajes con copyright (Disney, Marvel, etc.).

- Palabras clave de marcas registradas.

Segunda capa: Análisis de la imagen de entrada

Si se sube una imagen de referencia, el sistema analiza su contenido:

- Identifica personajes protegidos en la imagen.

- Detecta logotipos de marcas.

- Determina si se trata de una obra de arte protegida.

Tercera capa: Monitoreo durante la generación

Incluso si las dos primeras capas se superan, el monitoreo continúa durante el proceso:

- Si el resultado intermedio contiene contenido sensible, se detiene inmediatamente.

- Si la salida tiene una similitud demasiado alta con una obra protegida, se rechaza la entrega.

Cuarta capa: Revisión de salida

Una vez finalizada la generación, hay una última auditoría:

- Se realiza una detección de copyright sobre la imagen generada.

- Las imágenes no conformes se descartan y se devuelve un resultado vacío.

Qué contenido suele activar el finishReason OTHER

Según los comentarios de los usuarios y las políticas oficiales, el siguiente contenido es el que se bloquea con mayor frecuencia:

| Categoría | Ejemplos específicos | Nivel de riesgo |

|---|---|---|

| Personajes de Disney | Mickey Mouse, Zootopia, Frozen | 🔴 Muy alto |

| Personajes de Marvel | Iron Man, Spider-Man, Capitán América | 🔴 Muy alto |

| Personajes de Pixar | Toy Story, Cars | 🔴 Muy alto |

| Star Wars | Darth Vader, Yoda, Stormtroopers | 🔴 Muy alto |

| Anime japonés | IPs famosas específicas (depende del caso) | 🟡 Medio |

| Retratos de celebridades | Estrellas de cine, figuras políticas | 🟡 Medio |

| Logos de marcas | Nike, Apple, Coca-Cola | 🟡 Medio |

| Obras de arte originales | Reproducciones de pintores famosos | 🟡 Medio |

Escenarios propensos a "falsos positivos"

Incluso si no tienes malas intenciones, los siguientes escenarios podrían activar el control de riesgos:

- Extracción de patrones: Intentar extraer diseños de estampados de ropa o productos de merchandising.

- Transferencia de estilo: Pedir que una imagen adopte el estilo visual de una IP famosa.

- Sustitución de fondo: Procesar imágenes de fondo que contengan personajes protegidos por derechos de autor.

- Retoque y edición: Realizar ajustes en imágenes que incluyan personajes conocidos.

5 soluciones posibles

Solución 1: Ajustar la indicación (Prompt)

Evita mencionar directamente los nombres de personajes con derechos de autor y utiliza descripciones genéricas:

# ❌ Fácil de interceptar

prompt = "Extraer el patrón de Judy de Zootopia"

# ✅ Forma más segura

prompt = "Extraer el patrón del conejo de dibujos animados de la imagen y convertirlo en una imagen de impresión plana"

Solución 2: Evitar subir imágenes de personajes con copyright

Si es posible, realiza tus pruebas utilizando imágenes que no contengan personajes con derechos de autor evidentes.

Solución 3: Utilizar herramientas generales de procesamiento de imágenes

Para necesidades como la extracción de patrones o la eliminación de arrugas, puedes considerar:

- El Relleno según el contenido (Content-Aware Fill) de Adobe Photoshop.

- Software profesional de extracción de patrones textiles.

- Herramientas generales de super-resolución de imagen.

Solución 4: Ajustar los Safety Settings (Efectividad limitada)

Aunque puedes intentar ajustar la configuración de seguridad, su efecto sobre el control de derechos de autor es limitado:

from google.generativeai.types import HarmCategory, HarmBlockThreshold

safety_settings = {

HarmCategory.HARM_CATEGORY_HARASSMENT: HarmBlockThreshold.BLOCK_NONE,

HarmCategory.HARM_CATEGORY_HATE_SPEECH: HarmBlockThreshold.BLOCK_NONE,

HarmCategory.HARM_CATEGORY_SEXUALLY_EXPLICIT: HarmBlockThreshold.BLOCK_NONE,

HarmCategory.HARM_CATEGORY_DANGEROUS_CONTENT: HarmBlockThreshold.BLOCK_NONE,

}

Nota: Las interceptaciones relacionadas con derechos de autor no se pueden omitir mediante los Safety Settings; es una restricción estricta del sistema.

Solución 5: Usar la API de Gemini de APIYI (Recomendado)

APIYI (apiyi.com) ofrece un servicio de relevo para toda la serie de APIs de Gemini, con la misma potencia del modelo y una experiencia de llamada más estable:

import openai

client = openai.OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gemini-3-pro-image-preview",

messages=[

{

"role": "user",

"content": "Generar una escena de mercado de una ciudad de animales animados original, que incluya personajes de un zorro y un conejo"

}

]

)

Sugerencia: Llama a la API de Gemini a través de APIYI (apiyi.com) para disfrutar de un servicio más estable y soporte técnico en español. El precio es solo un 20% del costo oficial (imágenes 4K a $0.05/unidad), sin complicaciones con la vinculación de tarjetas.

Cómo determinar por qué se bloqueó una solicitud

Comprobar los campos de respuesta

def analyze_response(response):

candidate = response.candidates[0]

# Comprobar finishReason

finish_reason = candidate.finish_reason

# Comprobar si hay contenido

has_content = candidate.content and candidate.content.parts

# Comprobar promptFeedback

block_reason = getattr(response.prompt_feedback, 'block_reason', None)

print(f"finishReason: {finish_reason}")

print(f"Has content: {has_content}")

print(f"Block reason: {block_reason}")

if finish_reason == "OTHER" and not has_content:

print("⚠️ Es posible que se haya activado el control de riesgos de derechos de autor/marcas")

elif finish_reason == "SAFETY":

print("⚠️ Se activó el filtro de contenido de seguridad")

Tabla de referencia de códigos de error comunes

| Características de la respuesta | Causa más probable | Acción recomendada |

|---|---|---|

finishReason: OTHER, parts: null |

Control de riesgos de derechos de autor/marcas | Cambiar la imagen o modificar la indicación |

finishReason: SAFETY |

Filtro de seguridad de contenido | Ajustar Safety Settings |

blockReason: PROHIBITED_CONTENT |

Violación clara de la política de uso | Revisar la indicación y la imagen |

finishReason: RECITATION |

Se activó la detección de repetición de derechos de autor | Modificar la redacción de la indicación |

error 503: Model overloaded |

Servicio sobrecargado | Reintentar más tarde o usar APIYI |

Preguntas frecuentes

P1: ¿Por qué la misma solicitud a veces tiene éxito y otras falla?

La revisión de contenido de Gemini tiene cierta aleatoriedad, posiblemente debido a:

- Cambios en las estrategias de revisión por actualizaciones de la versión del modelo.

- Ajustes temporales en las reglas de filtrado del lado del servidor.

- Pequeñas diferencias en la imagen de entrada que resultan en juicios distintos.

Se recomienda utilizar un mecanismo de reintento para manejar fallos ocasionales.

P2: Solo quiero eliminar las arrugas de una imagen, ¿por qué se bloquea?

Si la imagen de entrada contiene personajes protegidos por derechos de autor, incluso si tu intención de procesamiento es completamente legal (como quitar arrugas o ajustar el color), se activará el control de riesgos. Esto se debe a que el sistema analiza el contenido de la imagen de entrada, no solo la indicación.

Se recomienda utilizar imágenes que no contengan personajes con derechos de autor o usar software de procesamiento de imágenes profesional.

P3: ¿La API de Gemini en APIYI tendrá las mismas restricciones?

APIYI ofrece un servicio intermediario de la API de Gemini; el modelo subyacente es el mismo, por lo que los mecanismos de control de riesgos relacionados con los derechos de autor son idénticos. Sin embargo, las ventajas de APIYI son:

- Precios más bajos (un 20% del precio oficial)

- No es necesario vincular una tarjeta de crédito internacional

- Soporte técnico en español (y otros idiomas)

- Una experiencia de servicio más estable

Visita apiyi.com para obtener más información.

Resumen

Puntos clave sobre el error finishReason: OTHER en la generación de imágenes con Gemini API:

- El control de riesgos de derechos de autor es la causa principal: Personajes de IP famosas como Disney, Marvel o Pixar activarán este control de riesgos.

- Mecanismo de filtrado de múltiples capas: Supervisión constante desde la indicación hasta el resultado final; cualquier etapa puede bloquear el proceso.

- No se puede omitir por completo: La configuración de seguridad (Safety Settings) no tiene efecto sobre las restricciones de derechos de autor, ya que se trata de un requisito de cumplimiento legal.

- Recomendaciones para solucionarlo:

- Evita procesar imágenes que contengan personajes con derechos de autor.

- Modifica la indicación utilizando descripciones genéricas.

- Utiliza APIYI (apiyi.com) para obtener una experiencia de servicio más estable.

Para los desarrolladores que requieren un uso intensivo de la generación de imágenes con Gemini, se recomienda realizar las llamadas a través de APIYI (apiyi.com). Las imágenes 4K cuestan solo $0.05 por unidad (un 80% de descuento respecto al precio oficial), con soporte para Alipay/WeChat y asistencia técnica en chino.

📚 Referencias

-

Documentación de Safety Settings de Gemini API: Configuración de ajustes de seguridad.

- Enlace:

ai.google.dev/gemini-api/docs/safety-settings - Descripción: Explicación oficial sobre la configuración del filtrado de seguridad.

- Enlace:

-

Documentación de la API de generación de contenido de Gemini: Explicación de los valores de enumeración de

finishReason.- Enlace:

ai.google.dev/api/generate-content - Descripción: Significado de los diversos valores de

finishReason.

- Enlace:

-

Política de uso prohibido de IA generativa: Política de uso de Google.

- Enlace:

support.google.com/gemini/answer/16625148 - Descripción: Explicación detallada de las restricciones de contenido.

- Enlace:

Autor: Equipo técnico

Intercambio técnico: Te invitamos a discutir problemas de uso de Gemini API en la sección de comentarios. Para más información, puedes visitar la comunidad técnica de APIYI (apiyi.com).