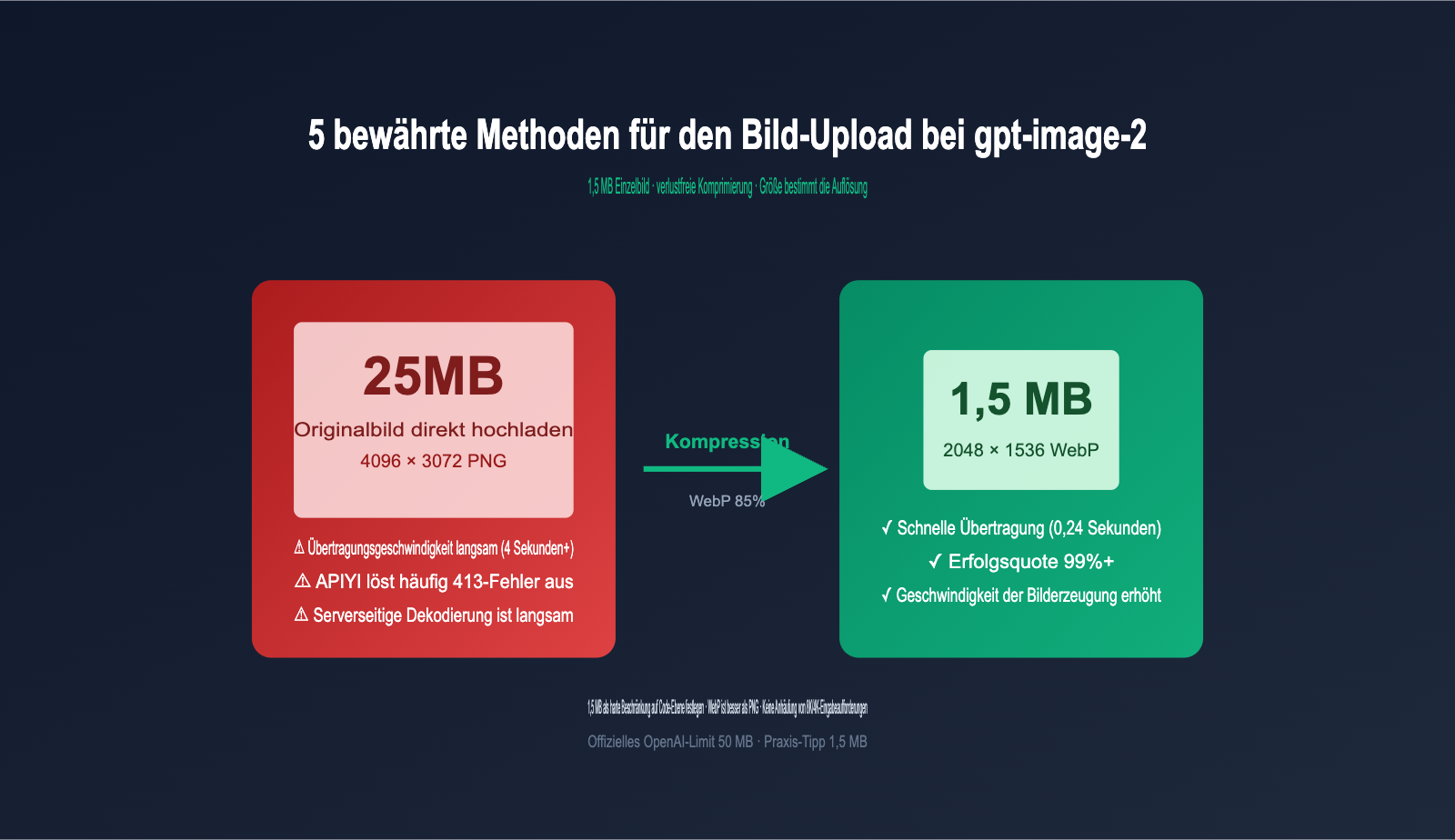

Viele Entwickler laden beim ersten Zugriff auf die gpt-image-2-Bildbearbeitungsschnittstelle das Originalbild intuitiv per POST hoch – schließlich gibt die offizielle Dokumentation ein Limit von 50 MB pro Bild an, und man möchte das Limit ja ausnutzen, oder? Wer jedoch Dutzende Testläufe durchgeführt hat, wird feststellen: Im Vergleich zu einem 1,5-MB-komprimierten Bild kann die Verarbeitungszeit bei einem 20-MB-Originalbild um das Dreifache höher sein, und die Fehlerrate (insbesondere bei „413 Request Entity Too Large“) steigt exponentiell an.

Basierend auf umfangreicher Praxiserfahrung bietet dieser Artikel 5 Best Practices für den gpt-image-2-Bild-Upload. Dabei konzentrieren wir uns auf die zwei Fragen, bei denen Entwickler am häufigsten stolpern: Wie stark sollte ein Bild komprimiert werden? und Wovon hängt die Ausgabeauflösung tatsächlich ab?

🎯 Fazit vorab: Für den Upload eines einzelnen Bildes bei gpt-image-2 empfehlen wir eine Größe von unter 1,5 MB. Die Ausgabeauflösung wird durch den

size-Parameter bestimmt; Angaben wie „8K“ oder „4K“ in der Eingabeaufforderung sind völlig wirkungslos. Alle in diesem Artikel gezeigten Codes können direkt über den API-Proxy-Dienst von APIYI (apiyi.com) ausgeführt werden, ohne dass eine ausländische Netzwerkumgebung erforderlich ist.

gpt-image-2 Bild-Upload-Spezifikationen: Offizielles Limit vs. Praxis-Limit

Die offizielle Dokumentation von OpenAI für die Bildeingabe bei gpt-image-2 ist sehr großzügig, und auf den ersten Blick scheint es keine Einschränkungen zu geben, über die man sich Sorgen machen müsste. Doch „nutzbar“ und „effizient nutzbar“ sind zwei verschiedene Dinge. In der Praxis sollte man sich eine strengere Grenze setzen.

Die folgende Tabelle vergleicht die offiziellen Limits mit unseren empfohlenen Praxiswerten, die auf statistischen Daten zahlreicher Entwickler basieren:

| Dimension | Offizielles Limit | Praxis-Empfehlung | Grund für den Unterschied |

|---|---|---|---|

| Einzelbildgröße | 50 MB | ≤ 1,5 MB | Übertragung und serverseitige Dekodierung dauern bei großen Dateien deutlich länger |

| Bilder pro Aufruf | 16 Bilder | 1–4 Bilder | Überlagerung mehrerer Bilder senkt die Erfolgsquote pro Aufruf |

| Unterstützte Formate | PNG / WEBP / JPG | WEBP / JPG (komprimiert) | PNG ist meist zu groß, WEBP bietet das beste Preis-Leistungs-Verhältnis |

| Kantenlänge (Pixel) | max. 3840 | nicht mehr als 2048 | Intern erfolgt ohnehin eine Downsampling-Merkmalsextraktion |

| Seitenverhältnis | 1:3 ~ 3:1 | nah am Ausgabeformat | Abweichungen führen zu zusätzlichem Auffüllen/Zuschneiden |

Warum liegt das Limit bei 1,5 MB? Dies ist der „Sweet Spot“, der ein Gleichgewicht zwischen Übertragungszeit, Dekodierungsaufwand und Netzwerkstabilität herstellt. Unter 1,5 MB können die meisten Breitbandanschlüsse das Bild in 1–2 Sekunden übertragen. Über 5 MB steigen die Gesamtzeit für Übertragung und serverseitige Dekodierung nicht-linear an, und man merkt deutlich, dass die Schnittstelle „hängt“.

💡 Praxiserfahrung: Wir empfehlen, 1,5 MB als harte Grenze in den Code zu integrieren und das Bild vor dem Aufruf automatisch mit Bibliotheken wie PIL zu komprimieren. Bei der Nutzung von gpt-image-2 über den API-Proxy-Dienst von APIYI (apiyi.com) ist die Optimierung der Übertragung kleiner Dateien über inländische IDC-Knoten besonders effektiv.

Warum Einzelbilder auf unter 1,5 MB komprimiert werden sollten

Viele Entwickler fragen sich: Wenn das offizielle Limit bei 50 MB liegt, warum sollte man dann auf 1,5 MB bestehen? Tatsächlich gibt es dafür vier technische Gründe, von denen jeder einzelne ausreicht, um das Thema Dateigröße ernst zu nehmen.

Der erste Grund ist die Übertragungszeit, die oft unterschätzt wird. Eine 25-MB-Datei benötigt bei einer Upload-Bandbreite von 50 Mbit/s etwa 4 Sekunden reine Übertragungszeit. Komprimiert auf 1,5 MB sind es nur 0,24 Sekunden. Diese Zeit addiert sich direkt zur gesamten Antwortzeit der API.

Der zweite Grund ist das Risiko von 413-Fehlern. In der Community sind "413 Request Entity Too Large"-Fehler bei gpt-image-1 / gpt-image-2 keine Seltenheit. Selbst wenn man das 50-MB-Limit nicht erreicht, kann die Datei an einem Gateway (CDN, Reverse Proxy, Load Balancer) blockiert werden. Bilder unter 1,5 MB zu halten, eliminiert diese Fehlerquelle fast vollständig und erhöht die Stabilität der Aufrufe.

Der dritte Grund ist die Dekodierungszeit auf dem Server. Sobald der OpenAI-Server das Bild erhält, muss es dekodiert, Merkmale extrahiert und in Vektoren eingebettet werden. Diese Schritte korrelieren direkt mit der Gesamtzahl der Pixel. Selbst wenn die Bandbreite kein Flaschenhals ist, verlangsamen große Bilder die Generierungsgeschwindigkeit.

Der vierte Grund sind die Kosten bei Wiederholungsversuchen. Schlägt ein Aufruf mit einem großen Bild fehl, müssen erneut 25 MB übertragen werden. Bei einem 1,5-MB-Bild ist ein erneuter Versuch kaum spürbar, was die End-to-End-Zuverlässigkeit massiv verbessert.

Quantifiziert man diese vier Gründe anhand echter Testdaten, wird der Vergleich deutlich: Bei 50 Testläufen mit derselben Vorlage (25 MB / 5 MB / 1,5 MB / 500 KB) an der gpt-image-2-Schnittstelle zeigt sich bei 1,5 MB ein klarer Wendepunkt in der Gesamtlaufzeit und Erfolgsquote. Eine weitere Komprimierung bringt kaum noch Vorteile für das Nutzererlebnis, während die Bildqualität unnötig leiden würde.

🔧 Optimierungsempfehlung: Bei der Verwendung von

gpt-image-2in der Produktion sollte die "Komprimierung vor dem Upload" ein fester Bestandteil Ihres Codes sein. Durch die Nutzung von APIYI-Proxy-Diensten in Kombination mit einer 1,5-MB-Strategie lässt sich die Fehlerrate pro Batch von 5–8 % auf unter 1 % senken – ein signifikanter Unterschied bei monatlich zehntausenden Aufrufen.

Komprimierung bedeutet nicht Qualitätsverlust: Ein weit verbreiteter Irrtum

Es hält sich hartnäckig das Vorurteil: "Komprimierung = Qualitätsverlust = schlechtere KI-Ergebnisse". Was in der JPEG-Ära von 2010 vielleicht stimmte, ist im Zeitalter von WebP und hochwertigem JPEG im Jahr 2026 längst überholt.

Die folgende Tabelle stellt häufige Mythen den Fakten gegenüber, um Ihnen bei der Bildverarbeitung die richtige Intuition zu vermitteln:

| Mythos | Fakt |

|---|---|

| Komprimierung mindert immer die Qualität | WebP (Qualität 85+) ist visuell kaum unterscheidbar, ebenso JPEG (90+) |

| Größere Bilder sind für die KI besser | gpt-image-2 führt ein Downsampling durch; alles über der Arbeitsauflösung ist Verschwendung |

| PNG ist verlustfrei und daher am besten | PNG-Dateien sind 3-5x größer als WebP, bei identischem Ergebnis nach der Dekodierung |

| Komprimierungstools verfälschen Farben | Gängige Tools (Squoosh / TinyPNG / Sharp) behalten ICC-Farbprofile bei |

| Bei starken Eingabeaufforderungen ist keine Komprimierung nötig | Eingabeaufforderung und Bildgröße sind unabhängig; Komprimierung beeinflusst nur die Übertragung |

Für die Wahl der Werkzeuge bieten sich je nach Szenario folgende Lösungen an:

| Werkzeug | Einsatzbereich | Vorteil |

|---|---|---|

| PIL / Pillow | Python-Backend (Batch) | Einfache Integration, iterative Qualitätsanpassung |

| Sharp (Node.js) | Node-Server | Höchste Performance, Dutzende Bilder pro Sekunde |

| Squoosh | Frontend (Einzelbild) | Browser-basiertes WASM, keine Server-Uploads nötig |

| TinyPNG | Manuelle Batch-Verarbeitung | Intelligente Farbreduktion, visuell verlustfrei |

| System-Tools | macOS / Windows | Einfaches Speichern als JPEG (80%) reicht aus |

Betrachten Sie "Komprimierung" als notwendigen Vorbereitungsschritt und nicht als Kompromiss, der die Qualität beeinträchtigt. Das ist die psychologische Grundlage für den effektiven Einsatz von Bild-APIs.

Ein wichtiger technischer Hinweis: gpt-image-2 führt intern ein Downsampling durch. Die tatsächliche "interne Arbeitsauflösung" ist weit geringer als das, was Sie hochladen können. Wenn Sie ein 4000×3000-Pixel-Bild einspeisen, sieht das Modell möglicherweise nur eine 1024×1024-Version. Die überschüssigen Pixel werden vom Modell verworfen – eine völlig unnötige Bandbreitenverschwendung.

Wenn Sie das verstanden haben, ist die Erkenntnis, dass "die Qualität vor und nach der Komprimierung nahezu identisch ist", kein bloßes Bauchgefühl mehr, sondern eine fundierte technische Tatsache. Eine Komprimierung auf den Bereich von 1024–2048 Pixeln trifft genau die Arbeitsauflösung des Modells – effizient und ohne Qualitätsverlust.

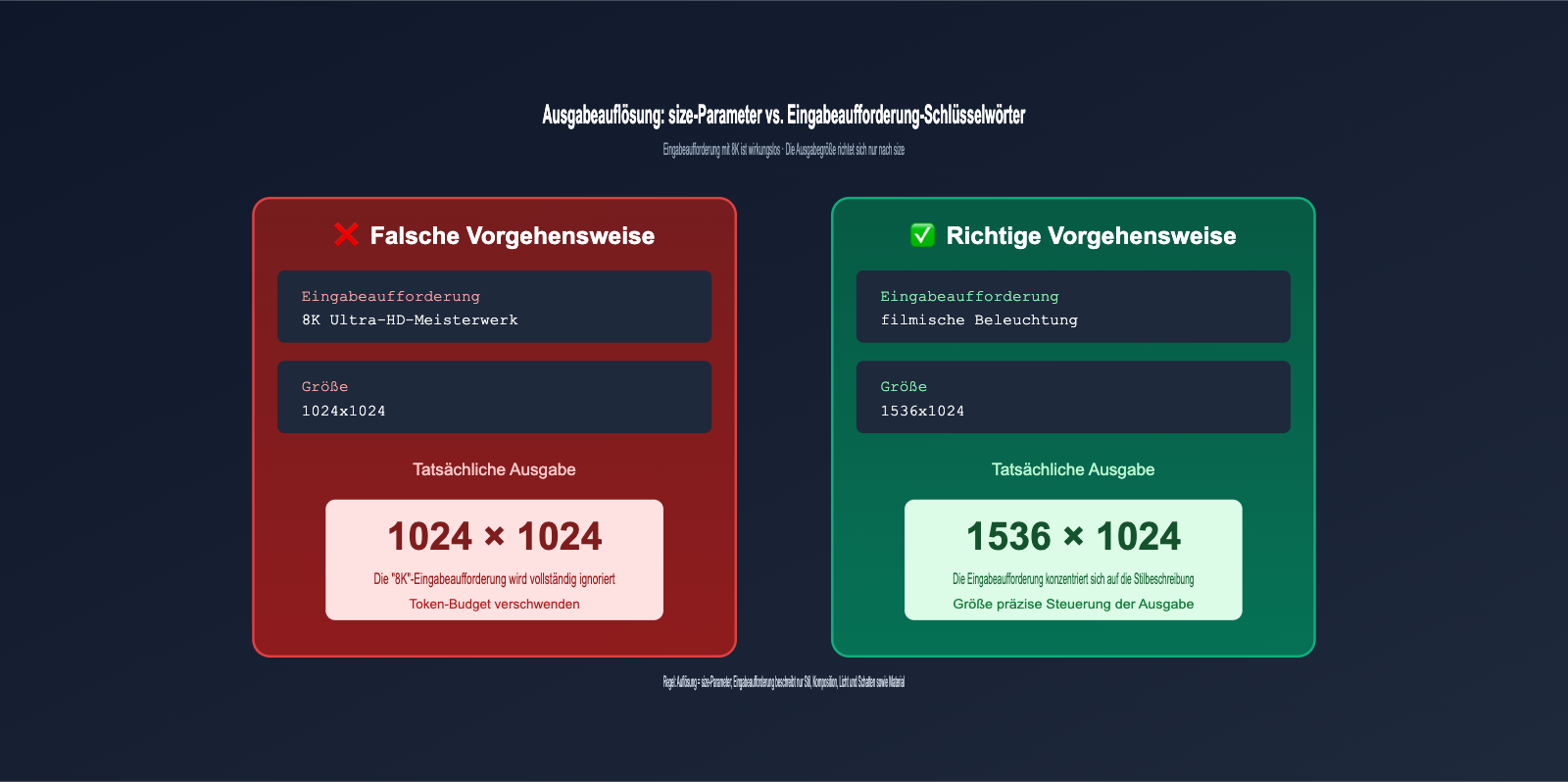

gpt-image-2 Ausgabeauflösung: Der size-Parameter ist der einzige Schalter

Wenn "verlustfreie Komprimierung" ein Missverständnis beim Hochladen ist, dann ist "8K in die Eingabeaufforderung schreiben führt zu 8K-Ausgabe" das größte Missverständnis bei der Ausgabe. In diesem Abschnitt klären wir endgültig, wie die Ausgabeauflösung von gpt-image-2 tatsächlich bestimmt wird.

Der einzige Parameter, der die Ausgabeauflösung beeinflusst, ist size; alles andere funktioniert nicht. Dies ist eine entscheidende, aber weit verbreitete Fehlannahme. Ich helfe dir mit einem Vergleichsexperiment, ein Gefühl dafür zu bekommen:

| API-Aufrufkonfiguration | Tatsächliche Ausgabeauflösung |

|---|---|

size="1024x1024" + Eingabeaufforderung ohne 4K/8K |

1024×1024 |

size="1024x1024" + Eingabeaufforderung mit "8K resolution" |

Immer noch 1024×1024 |

size="1024x1024" + Eingabeaufforderung mit "ultra HD 4K" |

Immer noch 1024×1024 |

size="1536x1024" + Eingabeaufforderung mit "low resolution" |

1536×1024 (size hat Vorrang) |

size="3840x2160" + beliebige Eingabeaufforderung |

3840×2160 (experimentell) |

Das Fazit ist eindeutig: Das Anhäufen von Auflösungs-Schlüsselwörtern wie "8K", "4K", "ultra HD" oder "HQ" in der Eingabeaufforderung macht dein Bild weder größer noch schärfer, sondern verbraucht nur unnötig Token-Budget.

Welche Werte unterstützt der size-Parameter nun? gpt-image-2 ist deutlich flexibler als die Vorgängergeneration und unterstützt sowohl Voreinstellungen als auch benutzerdefinierte Werte:

| Konfigurationsmethode | Wertebereich | Erläuterung |

|---|---|---|

| Standard-Voreinstellungen | 1024×1024 / 1536×1024 / 1024×1536 | Am stabilsten, für den täglichen Gebrauch empfohlen |

| Benutzerdefiniert (Standard) | Breite/Höhe jeweils Vielfache von 16 | z. B. 1280×720, 1600×900 |

| Benutzerdefiniert (Großbild) | Max. 3840px pro Seite | Über 2560×1440 ist experimentell |

| Seitenverhältnis-Einschränkung | Zwischen 1:3 ~ 3:1 | Zu extreme Verhältnisse werden nicht unterstützt |

| Gesamtpixel-Einschränkung | 655.360 ~ 8.294.400 | Ober- und Untergrenzen vorhanden |

Überlasse die "Auflösungsbeschreibungen" wertvolleren Inhalten in der Eingabeaufforderung, wie dem Stil ("Ölgemälde-Stil"), der Komposition ("Aufnahme aus niedriger Perspektive"), dem Licht ("Licht zur goldenen Stunde") oder der Textur ("matte Keramikoberfläche"). Das sind die Elemente, die das Bildergebnis wirklich beeinflussen.

Hier gibt es noch ein kontraintuitives, aber wichtiges Detail: Ein größerer size-Parameter führt nicht unbedingt zu einem detaillierteren Bild. Wenn du eine experimentelle hohe Auflösung wie 3840×2160 wählst, führt das Modell intern eine Super-Resolution-Abtastung nach der Generierung bei niedrigerer Auflösung durch. Die Detaildichte nimmt nicht linear mit der Pixelanzahl zu, sondern kann aufgrund der längeren Generierungszeit sogar zu einer geringeren Konsistenz führen. Die empfohlenen "Sweet Spots" für den täglichen Workflow sind 1024×1024 oder 1536×1024 – sie sind schnell, detailreich und preislich am attraktivsten.

📌 Empfehlung zur Bereinigung der Eingabeaufforderung: Lösche vor dem Aufruf von gpt-image-2 alle ineffektiven Schlüsselwörter wie "8K", "4K", "ultra HD" oder "high resolution" aus deiner Eingabeaufforderung, um Platz für nützliche Beschreibungen zu schaffen. Wir empfehlen, auf der Plattform apiyi.com dieselbe Eingabeaufforderung mit verschiedenen

size-Parametern zu vergleichen, um ein Gefühl für das Verhältnis zwischen Auflösung und Bilddichte zu entwickeln.

gpt-image-2 Praxisaufruf: Vollständiger Python-Code für Komprimierung und Upload

Nach der Theorie folgt der ausführbare Code. Das folgende Python-Skript implementiert den vollständigen Prozess: "Automatische Komprimierung auf unter 1,5 MB → Aufruf der gpt-image-2-Bearbeitungsschnittstelle → Speichern der Ausgabe". Du kannst es einfach kopieren und in deinem Projekt verwenden.

import io

import base64

from PIL import Image

from openai import OpenAI

# Aufruf über APIYI-Proxy-Dienst, kein Auslandsnetzwerk erforderlich

client = OpenAI(

base_url="https://vip.apiyi.com/v1",

api_key="Dein APIYI-Schlüssel"

)

def compress_image(input_path: str, target_kb: int = 1500) -> bytes:

"""Automatische Komprimierung des Bildes auf unter die angegebene KB-Zahl, bevorzugt WebP-Format"""

img = Image.open(input_path).convert("RGB")

# Begrenzung der längsten Seite auf 2048, proportionale Skalierung bei Überschreitung

if max(img.size) > 2048:

img.thumbnail((2048, 2048), Image.LANCZOS)

# Start bei Qualität 90, Reduzierung um 5, bis das Ziel erreicht ist

quality = 90

while quality >= 50:

buf = io.BytesIO()

img.save(buf, format="WEBP", quality=quality)

if len(buf.getvalue()) <= target_kb * 1024:

return buf.getvalue()

quality -= 5

# Fallback: Niedrigste Qualität

buf = io.BytesIO()

img.save(buf, format="WEBP", quality=50)

return buf.getvalue()

# Aufruf der gpt-image-2-Bearbeitungsschnittstelle

image_bytes = compress_image("./input.png", target_kb=1500)

result = client.images.edit(

model="gpt-image-2",

image=("input.webp", image_bytes, "image/webp"),

prompt="Ändere dieses Foto in einen Cyberpunk-Stil, Neonlichter, regnerische Straßenszene",

size="1536x1024", # Ausgabeauflösung wird hier bestimmt

output_format="webp", # Ausgabeformat

output_compression=85 # Ausgabekomprimierungsgrad 0-100

)

# Speichern der Ausgabe

output_b64 = result.data[0].b64_json

with open("./output.webp", "wb") as f:

f.write(base64.b64decode(output_b64))

Dieser Code enthält einige wichtige Punkte. Erstens verwendet die Funktion compress_image eine Strategie der "schrittweisen Qualitätsreduzierung", beginnend bei 90 in 5er-Schritten, bis die Dateigröße das Ziel erreicht. Dies maximiert die Bildqualität bei gleichzeitigem Einhalten der Größenbeschränkung.

Zweitens ist der Parameter output_compression=85 nur für WebP/JPEG-Formate wirksam und steuert die Komprimierung des zurückgegebenen Bildes (Standard ist 100, also keine Komprimierung). Wenn du das generierte Bild direkt auf einer Webseite anzeigen möchtest, bietet ein Wert zwischen 80 und 90 ein gutes Gleichgewicht zwischen Bildqualität und Ladezeit.

Drittens bestimmt die Zeile size="1536x1024" tatsächlich die Ausgabeauflösung – egal, was in der Eingabeaufforderung steht, das Ausgabebild wird 1536×1024 groß sein.

🚀 Hinweis zur Anbindung: gpt-image-2 ist mit dem nativen OpenAI-SDK kompatibel. Du musst lediglich die

base_urlund denapi_keyanpassen, um den Code auf der Plattform APIYI (apiyi.com) auszuführen. Die Plattform bietet netzwerkseitige Optimierungen für Bildschnittstellen, was die Wahrscheinlichkeit von Timeouts und 413-Fehlern erheblich reduziert.

gpt-image-2 Bild-Upload FAQ

Q1: Ist es besser, PNG oder WebP hochzuladen?

WebP benötigt bei gleicher Bildqualität nur 1/3 bis 1/5 des Speicherplatzes von PNG. Da gpt-image-2 die Bilder intern dekodiert, ist das Ergebnis nahezu identisch. Daher: Bevorzugen Sie WebP. Es sei denn, Ihr Bild benötigt einen Alphakanal für Transparenz (z. B. für Logo-Freistellungen), gibt es keinen Grund, PNG zu verwenden.

Q2: Wie viele Referenzbilder kann ich gleichzeitig hochladen?

Das offizielle Limit liegt bei 16 Bildern, aber in der Praxis sinkt die Erfolgsrate bei mehr als 4 Bildern deutlich, da die Aufmerksamkeit des Modells für die einzelnen Referenzbilder verwässert wird. Wir empfehlen 1 Haupt-Referenzbild + 1-2 Stil-Referenzbilder. Zu viele Bilder führen oft zu einem chaotischen Ausgabestil.

Q3: Wenn ich „8K“ in die Eingabeaufforderung schreibe, muss ich dann nicht komprimieren?

„8K“ in der Eingabeaufforderung ist ein wirkungsloses Schlüsselwort. Es sorgt weder dafür, dass die Ausgabe tatsächlich 8K ist (das wird durch den size-Parameter bestimmt), noch bewirkt es, dass gpt-image-2 die Komprimierung überspringt. Wir empfehlen, über das APIYI.com-Dashboard die Ergebnisse vor und nach der Komprimierung zu vergleichen – Sie werden feststellen, dass der visuelle Unterschied kaum wahrnehmbar ist.

Q4: Was ist die maximale Ausgabeauflösung des Modells?

Der size-Parameter unterstützt bis zu 3840×2160, jedoch wird alles über 2560×1440 offiziell als „experimentell“ eingestuft, was die Stabilität und Konsistenz beeinträchtigen kann. Für den produktiven Einsatz empfehlen wir 1536×1024; dies ist schnell und stabil.

Q5: Kann ich Bilddetails nach dem Hochladen noch anpassen?

Ja, über den mask-Parameter können Sie eine Maske in der gleichen Größe angeben. Das Modell generiert dann nur in den transparenten Bereichen der Maske neue Inhalte, während der Rest unverändert bleibt. Dies ist eine sehr leistungsstarke Funktion der gpt-image-2-Bearbeitungsschnittstelle, die sich ideal für Inpainting oder Outfit-Wechsel eignet.

Q6: Was tun, wenn die Erfolgsrate beim Aufruf von gpt-image-2 aus dem Inland niedrig ist?

Direktverbindungen zu OpenAI führen in China häufig zu Timeouts oder SSL-Handshake-Fehlern, insbesondere bei Bild-APIs, da die Payloads größer sind als bei Text-APIs. Wenn Sie den base_url auf einen API-Proxy-Dienst wie APIYI.com umstellen und eine 1,5-MB-Komprimierungsstrategie anwenden, kann die Erfolgsrate stabil auf über 99 % gehalten werden.

Q7: Sieht man nach der Komprimierung wirklich keinen Qualitätsunterschied? Gibt es Fälle von Überkomprimierung?

Bei WebP-Qualität ab 85 oder JPEG ab 90 gibt es bei natürlichen Bildern (Personen, Landschaften, Produkte) visuell keinen Unterschied. Bei textlastigen Inhalten (Poster, PPT-Screenshots) oder scharfen Linien (technische Zeichnungen, Pixel-Art) empfehlen wir jedoch eine Qualität von 92-95 oder die Verwendung von PNG, um leichte Artefakte an Texträndern zu vermeiden. Die im Artikel bereitgestellte Python-Komprimierungsfunktion setzt den Startwert bereits auf 90, was für die meisten Szenarien stabil funktioniert.

Q8: Was ist der Unterschied in der Upload-Strategie zwischen gpt-image-2 und gpt-image-1.5?

Die Strategie ist weitgehend identisch: 1,5 MB pro Bild / WebP bevorzugen / size bestimmt die Ausgabe. Diese Regeln gelten für beide Modelle. Der Hauptunterschied besteht darin, dass gpt-image-2 benutzerdefinierte Auflösungen (mit einer Einschränkung auf Vielfache von 16) und experimentelle hohe Auflösungen unterstützt, während gpt-image-1.5 nur feste Voreinstellungen bietet. Wenn Sie migrieren, können Sie Ihren bestehenden Komprimierungscode problemlos weiterverwenden.

Fazit

Die Antworten auf die beiden Kernfragen vom Anfang des Artikels sollten nun klar sein.

Erste Frage: Wie groß sollte ein Bild-Upload für gpt-image-2 sein? Offiziell sind 50 MB erlaubt, aber in der Praxis sollten Sie ein hartes Limit von 1,5 MB setzen. Dies ist der „Sweet Spot“ unter Berücksichtigung von Übertragungsverzögerungen, 413-Fehlern, Dekodierungszeit und Wiederholungskosten. Dank moderner Algorithmen geht bei der Komprimierung kaum Qualität verloren – es besteht kein Grund, starr auf dem Originalbild zu beharren.

Zweite Frage: Was bestimmt die Ausgabeauflösung? Die einzige Antwort ist der size-Parameter, nicht die Eingabeaufforderung. Löschen Sie Begriffe wie „8K“, „4K“ oder „Ultra HD“ aus Ihren Prompt-Vorlagen und nutzen Sie das wertvolle Token-Budget stattdessen für nützliche Beschreibungen von Stil, Komposition und Licht.

Wenn Sie diese Regeln verinnerlichen, werden sowohl die Geschwindigkeit als auch die Erfolgsrate Ihrer gpt-image-2-Aufrufe deutlich steigen. Wir empfehlen, direkt mit dem in diesem Artikel bereitgestellten Python-Code zu starten, die Schnittstelle über APIYI.com zu validieren und innerhalb von ein bis zwei Tagen Ihre optimale Parameterkombination zu ermitteln.

📌 Autor: APIYI Team — Wir beschäftigen uns intensiv mit der technischen Praxis der multimodalen APIs von OpenAI, Anthropic und Google. Weitere fortgeschrittene Nutzungsmöglichkeiten und Prompt-Vorlagen für gpt-image-2 finden Sie im Dokumentationszentrum unter apiyi.com.