Anmerkung des Autors: Das von OpenAI neu veröffentlichte Modell gpt-5.5-pro ist offiziell über die API verfügbar und unterstützt ein 1M-Kontextfenster sowie erstklassige Schlussfolgerungsfähigkeiten. Dieser Artikel bietet eine vollständige Analyse der technischen Spezifikationen, der Preisstruktur, der SVIP-Gruppenbeschränkungen und der Anbindungsmöglichkeiten für Nutzer in China.

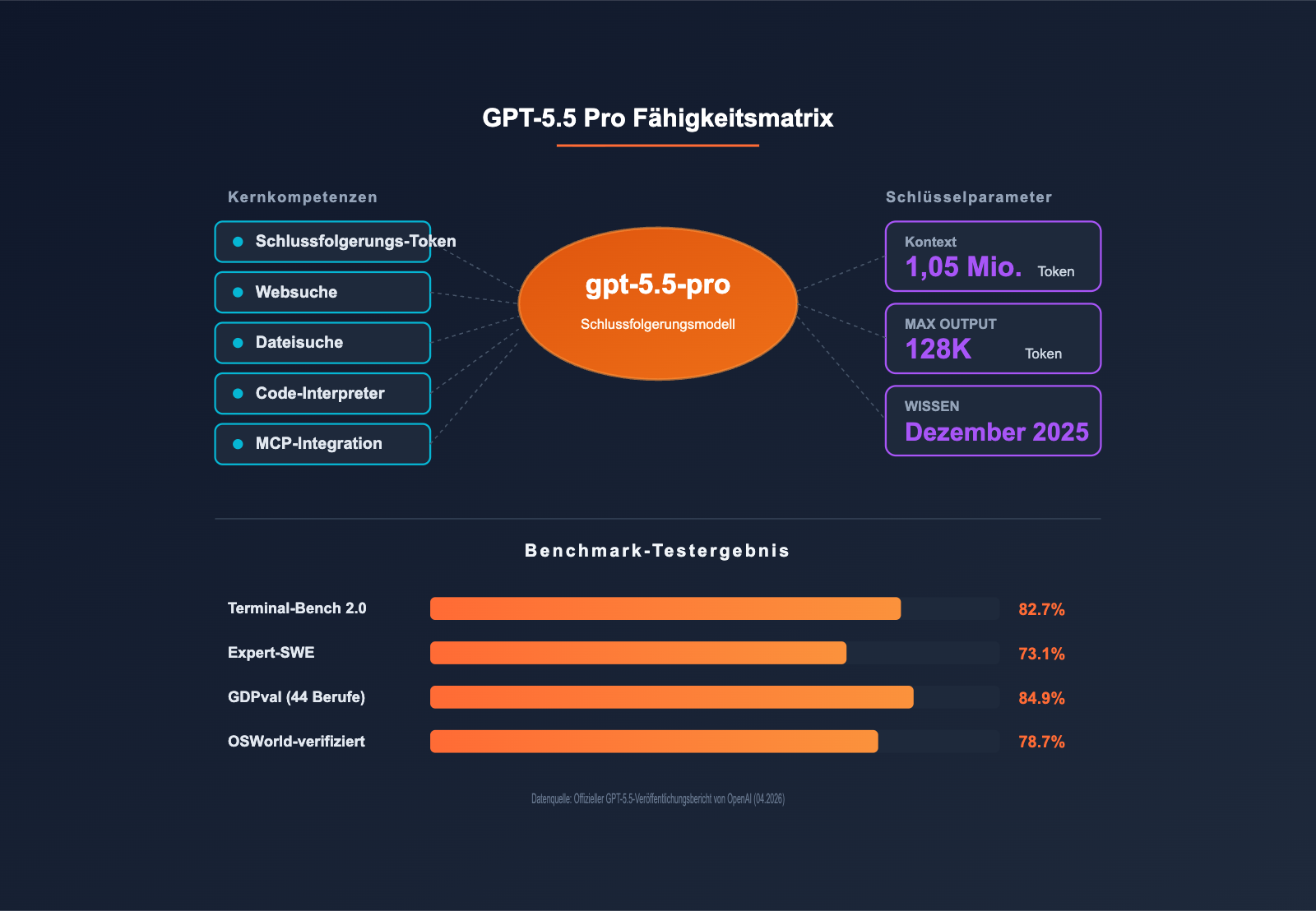

OpenAI hat am 23.04.2026 offiziell GPT-5.5 veröffentlicht und am 24.04.2026 die hochperformante Schlussfolgerungs-Version gpt-5.5-pro für die API freigeschaltet. Dies ist das Flaggschiff-Modell der GPT-5.5-Serie, das speziell für komplexe, mehrstufige Aufgaben, tiefgreifende Schlussfolgerungen und hochwertige Anwendungsszenarien entwickelt wurde. Es bietet ein Kontextfenster von 1.050.000 Tokens und eine maximale Ausgabe von 128K.

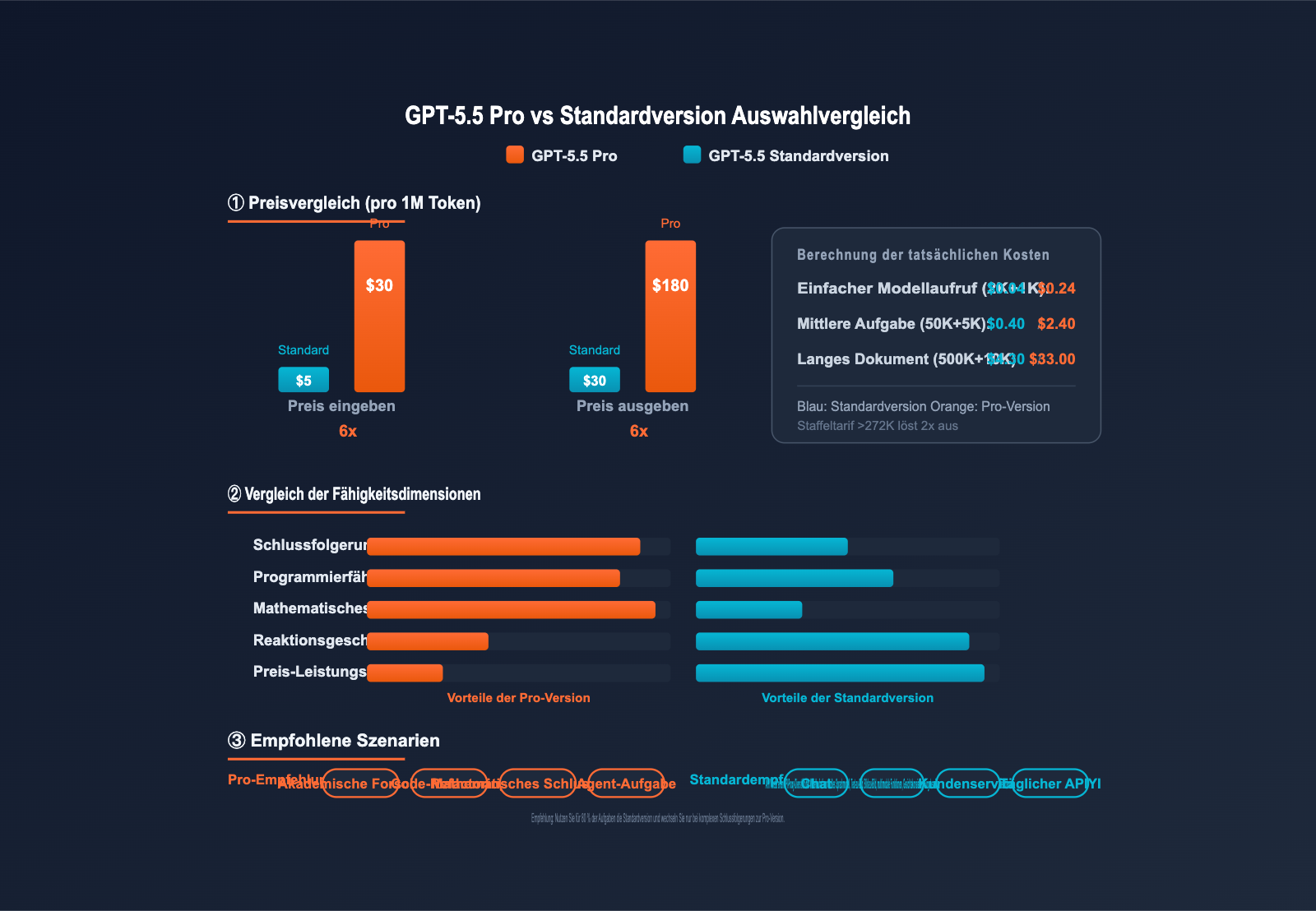

Dies ist kein leeres Marketingversprechen. Die offizielle Dokumentation von OpenAI wurde aktualisiert, und Entwickler können die API direkt aufrufen. Da der Preis jedoch sechsmal höher ist als beim Standard-GPT-5.5 ($30 / $180 pro 1M Tokens) und die Kosten für einen einzelnen Aufruf mehrere US-Dollar betragen können, stellt dies Nutzer in China vor besondere Herausforderungen bei der Kostenkontrolle.

Kernnutzen: Dieser Artikel analysiert die Anbindung von GPT-5.5 Pro über vier Aspekte: Modellspezifikationen, Preisstruktur, Benchmark-Daten und den SVIP-Gruppenschutzmechanismus. Zudem stellen wir ein sofort ausführbares, minimalistisches Aufrufbeispiel bereit.

Kernpunkte der GPT-5.5 Pro API

| Punkt | Beschreibung | Nutzen |

|---|---|---|

| 1M+ langes Kontextfenster | 1.050.000 Tokens Input + 128K Output | Ganze Bücher oder riesige Code-Repositories auf einmal verarbeiten |

| Erstklassige Schlussfolgerung | FrontierMath Tier 1-3 bei 52,4% | Erste Wahl für Mathematik, Forschung und komplexe Entscheidungen |

| Agenten-Coding-König | Terminal-Bench 2.0 bei 82,7% | Autonome Erledigung von Aufgaben bis zu 20 Stunden |

| Multimodales Verständnis | Text-Input/Output + Bild-Input | Dokumentenanalyse, UI-Verständnis, visuelle Schlussfolgerung |

| SVIP-Gruppenanbindung | APIYI nur für SVIP-Gruppen freigeschaltet | Vermeidung versehentlicher Nutzung teurer Modelle, Kostenkontrolle |

Hauptunterschiede zwischen GPT-5.5 Pro und der Standardversion

GPT-5.5 Pro ist eine auf GPT-5.5 basierende Version, die speziell für tiefgreifende Schlussfolgerungen und hochpräzise Aufgaben optimiert wurde. Laut offizieller Beschreibung liefert es "intelligentere und präzisere Antworten", wobei durch erhöhte Rechenleistung eine höhere Antwortgenauigkeit erreicht wird. Die Pro-Version unterstützt den vollständigen Reasoning-Token-Mechanismus; das Modell generiert intern unsichtbare Schlussfolgerungsketten, bevor es die endgültige Antwort ausgibt. Dies führt zu einem deutlichen Vorsprung bei anspruchsvollen Benchmarks wie FrontierMath oder Expert-SWE.

Auf der Preisseite ist der Input-Preis der Pro-Version 6-mal höher als bei der Standardversion ($30 vs. $5), ebenso wie der Output-Preis ($180 vs. $30). Das bedeutet, dass die Kosten für einen komplexen Schlussfolgerungsaufruf von wenigen Cent auf mehrere Dollar steigen können. Daher ist die gezielte Auswahl des Einsatzzeitpunkts für die Pro-Version entscheidend für die API-Kostenkontrolle.

Schnelleinstieg in die GPT-5.5 Pro API

Minimalistisches Python-Beispiel

Hier ist der einfachste Weg, GPT-5.5 Pro aufzurufen – vollständig kompatibel mit dem OpenAI SDK:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.5-pro",

messages=[

{"role": "user", "content": "Beweise die äquivalente Aussage der Riemannschen Vermutung: Der Realteil aller nicht-trivialen Nullstellen ist 1/2."}

]

)

print(response.choices[0].message.content)

Minimalistisches cURL-Beispiel

curl https://vip.apiyi.com/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer YOUR_API_KEY" \

-d '{

"model": "gpt-5.5-pro",

"messages": [

{"role": "user", "content": "Analysiere diese 200K Token umfassende Codebasis und refactore sie"}

]

}'

Vollständigen Produktionscode anzeigen (inkl. Fehlerbehandlung und Kostenschätzung)

import openai

from typing import Optional, List, Dict

# Preise für die Pro-Version (pro 1M Token)

PRICE_INPUT_BASE = 30.0 # 0-272K Eingabepreis

PRICE_OUTPUT_BASE = 180.0 # 0-272K Ausgabepreis

PRICE_INPUT_HIGH = 60.0 # >272K Eingabepreis

PRICE_OUTPUT_HIGH = 270.0 # >272K Ausgabepreis

def call_gpt55_pro(

messages: List[Dict],

api_key: str,

max_tokens: int = 4096,

estimate_cost: bool = True

) -> Dict:

"""

Aufruf von GPT-5.5 Pro in der Produktionsumgebung, inklusive Kostenschätzung und Fehlerbehandlung

Args:

messages: Liste der Nachrichten

api_key: API-Schlüssel

max_tokens: Maximale Anzahl der Ausgabe-Token

estimate_cost: Ob eine Kostenschätzung ausgegeben werden soll

Returns:

Dictionary mit Antwortinhalt und tatsächlichen Kosten

"""

client = openai.OpenAI(

api_key=api_key,

base_url="https://vip.apiyi.com/v1"

)

try:

response = client.chat.completions.create(

model="gpt-5.5-pro",

messages=messages,

max_tokens=max_tokens

)

usage = response.usage

input_tokens = usage.prompt_tokens

output_tokens = usage.completion_tokens

# Berechnung der gestaffelten Abrechnung

if input_tokens <= 272_000:

input_cost = input_tokens / 1_000_000 * PRICE_INPUT_BASE

output_cost = output_tokens / 1_000_000 * PRICE_OUTPUT_BASE

else:

input_cost = input_tokens / 1_000_000 * PRICE_INPUT_HIGH

output_cost = output_tokens / 1_000_000 * PRICE_OUTPUT_HIGH

total_cost = input_cost + output_cost

if estimate_cost:

print(f"📊 Eingabe-Token: {input_tokens:,}")

print(f"📊 Ausgabe-Token: {output_tokens:,}")

print(f"💰 Kosten für diesen Aufruf: ${total_cost:.4f}")

return {

"content": response.choices[0].message.content,

"input_tokens": input_tokens,

"output_tokens": output_tokens,

"cost_usd": total_cost

}

except openai.RateLimitError:

return {"error": "Ratenbegrenzung, bitte überprüfen Sie das SVIP-Gruppenkontingent"}

except openai.APIError as e:

return {"error": f"API-Fehler: {str(e)}"}

# Anwendungsbeispiel

result = call_gpt55_pro(

messages=[

{"role": "system", "content": "Du bist ein Experte im Bereich Mathematik"},

{"role": "user", "content": "Leite die partielle Differentialgleichung der Black-Scholes-Gleichung her"}

],

api_key="YOUR_API_KEY"

)

print(result["content"])

🎯 Tipp für den Schnelleinstieg: Da GPT-5.5 Pro pro Aufruf kostspieliger ist, empfiehlt es sich, zunächst über die Plattform APIYI (apiyi.com) SVIP-Gruppenrechte zu erwerben. Die Plattform unterstützt die vollständige Kompatibilität mit dem OpenAI SDK. Bei einer Aufladung von 100 USD erhalten Sie 10 % Bonus, was effektiv etwa 15 % Ersparnis gegenüber den offiziellen Preisen entspricht. Zudem ist ein direkter Zugriff aus dem Inland ohne VPN möglich.

Detaillierte Preisübersicht der GPT-5.5 Pro API

Offizielle gestaffelte Preisstruktur

OpenAI verwendet für die GPT-5.5-Serie einen Mechanismus zur gestaffelten Abrechnung bei langem Kontext: Wenn die Eingabe-Token einer einzelnen Anfrage 272K überschreiten, passen sich die Preise automatisch an.

| Eingabebereich | Preis für Eingabe (pro 1M Token) | Preis für Ausgabe (pro 1M Token) |

|---|---|---|

| 0 – 272K Token | $30.00 | $180.00 |

| 272K – ∞ Token | $60.00 (2x) | $270.00 (1.5x) |

⚠️ Wichtiger Hinweis: Die gestaffelte Preisgestaltung wird für die gesamte Anfrage berechnet, nicht nur für den Teil, der den Schwellenwert überschreitet. Das bedeutet: Sobald die Eingabe 272K überschreitet, werden sowohl die Eingabe als auch die Ausgabe der gesamten Anfrage zum höheren Tarif abgerechnet. Es wird empfohlen, bei der Analyse langer Dokumente eine Strategie zur Aufteilung in Blöcke zu verfolgen.

Preisvergleich: Pro-Version vs. Standard-Version

| Modell | Eingabepreis | Ausgabepreis | Preisunterschied | Kontextfenster |

|---|---|---|---|---|

| gpt-5.5 | $5.00 / 1M | $30.00 / 1M | 1x (Basis) | 1M Token |

| gpt-5.5-pro | $30.00 / 1M | $180.00 / 1M | 6x | 1.05M Token |

Beispiele für die tatsächliche Kostenkalkulation:

- Einfacher Aufruf (2K Eingabe + 1K Ausgabe): Standard $0.04 vs. Pro $0.24

- Mittlere Aufgabe (50K Eingabe + 5K Ausgabe): Standard $0.40 vs. Pro $2.40

- Analyse langer Dokumente (500K Eingabe + 10K Ausgabe): Standard $4.30 vs. Pro $33.00

💡 Empfehlung zur Kostenoptimierung: Für Standardaufgaben, die keine tiefgreifende Schlussfolgerung erfordern, empfiehlt sich die Nutzung der GPT-5.5 Standard-Version. Der Mehrwert der Pro-Version zeigt sich nur in Szenarien, in denen tatsächlich erstklassige Schlussfolgerungsfähigkeiten erforderlich sind. Über APIYI (apiyi.com) können Sie auf derselben Plattform nahtlos zwischen beiden Versionen wechseln und diese bedarfsgerecht steuern.

GPT-5.5 Pro API Performance-Benchmark

Offizielle Testergebnisse

OpenAI hat die Ergebnisse der GPT-5.5-Serie in mehreren maßgeblichen Benchmarks veröffentlicht. Die Pro-Version zeigt insbesondere bei mathematischen und komplexen Aufgaben deutliche Vorteile:

| Benchmark | Bewertungsdimension | GPT-5.5 Pro Score | Erläuterung |

|---|---|---|---|

| Terminal-Bench 2.0 | Ausführung von Terminalbefehlen | 82,7% | Kernfähigkeit für eigenständige lange Aufgaben |

| Expert-SWE | 20-Stunden-Programmieraufgabe | 73,1% | Komplexe Code-Refaktorierung |

| SWE-Bench Pro | Echte GitHub-Issues | 58,6% | Code-Korrekturen in Produktionsumgebungen |

| GDPval (44 Berufe) | Abdeckung von Wissensarbeit | 84,9% | Fachübergreifende professionelle Aufgaben |

| OSWorld-Verified | Computerbedienung | 78,7% | Automatisierung durch Computer-Nutzung |

| FrontierMath Tier 1-3 | Hochkomplexe Mathematik | 52,4% | Spitzenleistung bei mathematischer Schlussfolgerung |

| FrontierMath Tier 4 | Extrem schwierige Mathematik | 39,6% | Exklusiver Durchbruch der Pro-Version |

Benchmark-Interpretation

Terminal-Bench 2.0 erreicht 82,7%: Dies bedeutet, dass GPT-5.5 Pro im Terminal eigenständig komplexe Abläufe mit dutzenden Schritten durchführen kann, einschließlich Konfiguration der Umgebung, Installation von Abhängigkeiten und Debugging von Code. Bei agentenbasierten Workflows ist die Stabilität der Pro-Version deutlich höher als bei der Standardversion.

FrontierMath Tier 4 erreicht 39,6%: FrontierMath Tier 4 ist die schwierigste Stufe der mathematischen Evaluierung und umfasst Probleme auf dem Niveau der Fields-Medaille. Die Pro-Version ist das erste öffentlich verfügbare Modell, das in Tier 4 die 35%-Marke überschritten hat, was einen bedeutenden Fortschritt der KI in der mathematischen Spitzenforschung markiert.

Vergleich: GPT-5.5 Pro vs. Standard-Version

| Vergleichsdimension | GPT-5.5 Pro | GPT-5.5 Standard | Empfehlung |

|---|---|---|---|

| Mathematische Schlussfolgerung | FrontierMath 52,4 % | unter 30 % | Pro |

| Programmierfähigkeit | Expert-SWE 73,1 % | Expert-SWE ~55 % | Pro (komplexe Aufgaben) |

| Alltägliche Konversation | Langsamer, hohe Kosten | Schnell, kostengünstig | Standard |

| Zusammenfassung langer Dokumente | 1,05 Mio. Kontext | 1 Mio. Kontext | Beide geeignet |

| Kundenservice/Übersetzung | Überdimensioniert | Völlig ausreichend | Standard |

| Forschung/Wissenschaft | Erstklassige Tiefe | Durchschnittliche Tiefe | Pro |

| Agent-Workflow | Terminal 82,7 % | Terminal ~70 % | Pro (hohe Komplexität) |

| Kosten pro Aufruf | $0,24-$33+ | $0,04-$4,30 | Je nach Bedarf |

Entscheidungshilfe zur Modellauswahl

Analyse der Pro-Version: GPT-5.5 Pro bleibt bei anspruchsvollen Benchmarks wie FrontierMath und Expert-SWE führend. Aufgrund der sechsmal höheren Kosten ist sie jedoch für Routineaufgaben ungeeignet. Die Pro-Version bietet nur dann einen echten Mehrwert, wenn tatsächlich höchste Schlussfolgerungstiefe erforderlich ist (wissenschaftliche Fragestellungen, komplexe Code-Refactorings, langwierige Agent-Aufgaben).

Analyse der Standard-Version: Die GPT-5.5 Standard-Version überzeugt durch ihr hervorragendes Preis-Leistungs-Verhältnis und ihre Geschwindigkeit. Bei extrem schwierigen Aufgaben, wie FrontierMath Tier 4, stößt sie jedoch an ihre Grenzen. Für 80 % der täglichen Modellaufrufe bleibt die Standard-Version die vernünftigere Wahl.

📊 Empfehlung: Erledigen Sie 80 % Ihrer Routineaufgaben mit der GPT-5.5 Standard-Version und wechseln Sie nur bei komplexen Problemen, die Standardmodelle nicht lösen können, zur Pro-Version. Über die Plattform APIYI (apiyi.com) können Sie den

model-Parameter einfach in derselben Schnittstelle anpassen, ohne den restlichen Code ändern zu müssen.

Anwendungsbereiche für die GPT-5.5 Pro API

Die hohen Kosten von GPT-5.5 Pro machen sie ausschließlich für spezifische, hochwertige Szenarien sinnvoll:

- Wissenschaftliche Forschung und mathematische Schlussfolgerungen: Mathematische Probleme auf FrontierMath Tier 4-Niveau, physikalische Herleitungen, Beweisführungen.

- Refactoring umfangreicher Codebasen: Architektur-Refactoring bei Eingaben von über 200.000 Tokens.

- Tiefergehende Forschungsfragen: Design chemischer Synthesewege, komplexe bioinformatische Analysen, medizinische Diagnose-Schlussfolgerungen.

- Computer Use-Automatisierung: Aufgaben, die stundenlange, mehrstufige Prozesse erfordern (OSWorld 78,7 % Stabilitätsgarantie).

- Mehrstufige Agent-Workflows: Komplexe Aufgaben, die Recherche, Dokumentenerstellung und Codeausführung kombinieren.

- Hochwertige Entscheidungsanwendungen: Analyse von Rechtsverträgen, Investment-Research-Berichte, Simulation von Geschäftsstrategien.

🎯 Szenario-Check: Wenn Ihre Aufgabe mit GPT-4o-mini oder der GPT-5.5 Standard-Version lösbar ist, verwenden Sie nicht die Pro-Version. Der Wert der Pro-Version zeigt sich nur dort, wo Standardmodelle scheitern. Wir empfehlen, die Standard-Version über die Plattform APIYI (apiyi.com) zu testen und erst bei unzureichender Leistung auf die Pro-Version umzusteigen.

Anleitung zur Einbindung von GPT-5.5 Pro bei APIYI

Warum ist der Modellaufruf nur für die SVIP-Gruppe freigeschaltet?

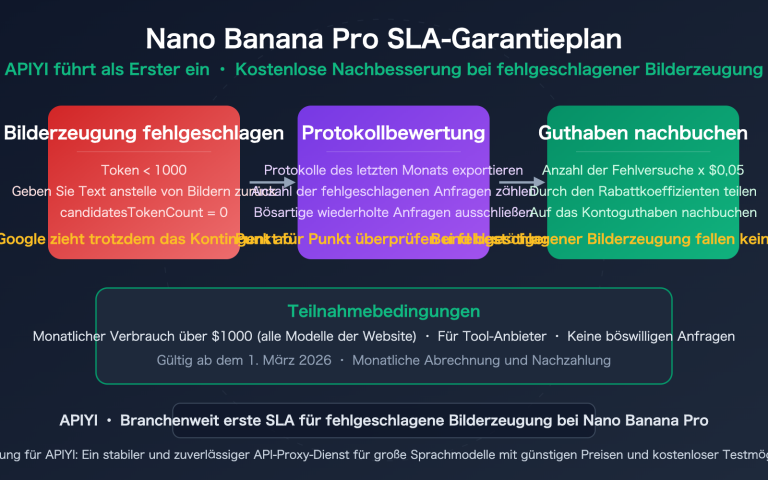

Da die Kosten für einen einzelnen Modellaufruf von GPT-5.5 Pro bis zu mehrere US-Dollar betragen können, hat die Plattform APIYI einen Schutzmechanismus durch Gruppenisolierung implementiert:

- ✅ SVIP-Gruppe: Vollständiger Zugriff auf den Aufruf von gpt-5.5-pro.

- ❌ Default-Gruppe: Der Aufruf ist derzeit nicht freigeschaltet, um versehentliche Kosten durch neue Benutzer zu vermeiden.

Der Hauptgrund für dieses Design ist, dass viele Benutzer bei der ersten Integration einer API den Preisunterschied zwischen der Pro-Version und der Standardversion möglicherweise nicht kennen. Ein einziger fehlerhafter Code-Aufruf könnte das Monatsbudget aufbrauchen. Durch die Isolierung in der SVIP-Gruppe wird sichergestellt, dass nur Benutzer, die sich der Kosten des Modells voll bewusst sind, die Pro-Version aufrufen können.

So beantragen Sie die SVIP-Gruppe

- Melden Sie sich im Benutzer-Backend von APIYI unter apiyi.com an.

- Kontaktieren Sie den Kundensupport und erläutern Sie Ihr Anwendungsszenario.

- Nach Überprüfung Ihres Bedarfs schaltet der Support die Berechtigung für die SVIP-Gruppe frei.

- Geben Sie beim API-Aufruf den Parameter

group=svipan (oder nutzen Sie den dedizierten Endpunkt).

Kostenvergleich: APIYI vs. offizielle Website

| Projekt | OpenAI Offiziell | APIYI apiyi.com |

|---|---|---|

| Basispreis | $30 / $180 pro 1M | $30 / $180 pro 1M (gleicher Preis) |

| Aufladebonus | Keiner | $100 aufladen, $10 geschenkt (10%) |

| Effektive Kosten | 100% Standardpreis | ca. 90% Standardpreis (ca. 15% Rabatt) |

| Zugriff (China) | VPN erforderlich | Direktzugriff, kein VPN nötig |

| Zahlungsmethoden | Internationale Kreditkarte | Unterstützt RMB, Alipay, WeChat |

| SDK-Kompatibilität | OpenAI nativ | Vollständig kompatibel mit OpenAI SDK |

| Mindestaufladung | $5 | Ab $1 möglich |

💰 Kostenoptimierung: Durch den Aufladebonus von APIYI apiyi.com (10% Bonus bei $100 Aufladung) liegen die effektiven Kosten bei etwa 85% des offiziellen Preises. Für Teams, die GPT-5.5 Pro häufig nutzen, senkt dieser Rabatt die API-Kosten innerhalb eines Jahres erheblich.

Häufig gestellte Fragen (FAQ)

Q1: Was ist GPT-5.5 Pro? Was ist der Hauptunterschied zur GPT-5.5 Standardversion?

GPT-5.5 Pro ist die am 24.04.2026 von OpenAI veröffentlichte High-End-Version für Schlussfolgerungen, die speziell für tiefgreifende Analysen und hochpräzise Aufgaben optimiert wurde. Der Hauptunterschied: Die Pro-Version kostet $30/$180 pro 1 Million Token (das 6-fache der Standardversion), erzielt jedoch bei anspruchsvollen Aufgaben wie FrontierMath oder Expert-SWE deutlich bessere Ergebnisse. Die Pro-Version unterstützt einen tieferen Reasoning-Token-Mechanismus, der intern längere Schlussfolgerungsketten generiert.

Q2: Wann wurde GPT-5.5 Pro veröffentlicht? Auf welchen Plattformen ist es verfügbar?

OpenAI hat die GPT-5.5-Serie am 23.04.2026 offiziell vorgestellt und das Modell gpt-5.5-pro am 24.04.2026 für die API freigeschaltet. Der Zugriff ist derzeit über die offizielle OpenAI-API, OpenRouter sowie Aggregator-Plattformen wie APIYI (apiyi.com) möglich. Bitte beachten Sie, dass bei APIYI nur die SVIP-Gruppe Zugriff hat; die Default-Gruppe ist derzeit nicht freigeschaltet.

Q3: Warum ist GPT-5.5 Pro bei APIYI nur für die SVIP-Gruppe verfügbar?

Dies ist ein Kostenschutzmechanismus von APIYI. Da ein einzelner Aufruf von GPT-5.5 Pro mehrere Dollar kosten kann, könnten neue Benutzer bei der ersten Integration durch fehlerhafte Aufrufe ungewollt hohe Kosten verursachen. Durch die SVIP-Gruppenisolierung stellen wir sicher, dass nur Benutzer, die die Kostenstruktur der Pro-Version verstehen, diese nutzen können. Benutzer, die Zugriff benötigen, können beim APIYI-Support die SVIP-Berechtigung beantragen.

Q4: Für welche Anwendungsszenarien ist GPT-5.5 Pro am besten geeignet? Wann sollte man es statt der Standardversion verwenden?

Die Pro-Version wird nur für die folgenden hochwertigen Szenarien empfohlen:

- Akademische Forschung: Mathematische/wissenschaftliche Probleme auf FrontierMath Tier 4 Niveau.

- Komplexe Code-Refaktorierung: Umfassende Refaktorierung von Codebasen mit über 200K Token.

- Mehrstufige Agenten-Aufgaben: Automatisierung von "Computer Use"-Prozessen, die mehrere Stunden dauern.

- Tiefe Entscheidungsanwendungen: Prüfung von Rechtsverträgen, Investment-Research-Berichte.

Entscheidungsprinzip: Testen Sie zuerst mit der Standardversion. Wenn diese ausreicht, wechseln Sie nicht zu Pro. Die Pro-Version ist 6-mal teurer und sollte nur dann genutzt werden, wenn die Kapazitäten der Standardversion nicht ausreichen.

Q5: Wie rufe ich GPT-5.5 Pro über APIYI auf? Muss die base_url geändert werden?

APIYI ist vollständig mit dem OpenAI SDK kompatibel. So gehen Sie vor:

- Besuchen Sie apiyi.com, registrieren Sie ein Konto und beantragen Sie die SVIP-Gruppe.

- API-Schlüssel abrufen.

- Ändern Sie die

base_urlim Code aufhttps://vip.apiyi.com/v1. - Setzen Sie den

model-Parameter aufgpt-5.5-pro.

client = openai.OpenAI(

api_key="IHR_SCHLUESSEL",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="gpt-5.5-pro",

messages=[...]

)

Bei einer Aufladung von 100 USD erhalten Sie 10% Bonus, was einem effektiven Rabatt von ca. 15% gegenüber dem offiziellen Preis entspricht.

Q6: Wie ändert sich die Abrechnung, wenn das 1M-Kontextfenster von GPT-5.5 Pro 272K überschreitet?

Die GPT-5.5-Serie verwendet eine gestaffelte Abrechnung: Wenn die Eingabe einer einzelnen Anfrage 272K Token überschreitet, verdoppelt sich der Eingabepreis für die gesamte Anfrage (2-fach, $60/1M) und der Ausgabepreis steigt auf das 1,5-fache ($270/1M). Hinweis: Die gestaffelte Abrechnung gilt für die gesamte Anfrage, nicht nur für den überschüssigen Teil. Bei der Analyse langer Dokumente empfiehlt sich eine Chunking-Strategie: Teilen Sie das Dokument in mehrere Anfragen von etwa 250K Token auf, um die höhere Preisstufe zu vermeiden.

Q7: Welche bekannten Einschränkungen hat GPT-5.5 Pro?

Die wichtigsten Einschränkungen sind:

- Kein Streaming: Sie müssen auf die vollständige Antwort warten, was für Echtzeit-Interaktionen weniger geeignet ist.

- Kein Cache-Rabatt: Im Gegensatz zur Standardversion bietet die Pro-Version keinen Rabatt für Prompt Caching.

- Langsamere Antwortzeit: Aufgrund der tiefgreifenden Schlussfolgerungen dauert ein Aufruf meist zwischen 30 Sekunden und mehreren Minuten.

- Nur Bildeingabe: Unterstützt keine Bildausgabe (muss mit anderen Modellen kombiniert werden).

- +10% Aufschlag für regionale Datenhaltung: Die Nutzung von Endpunkten zur Datenhaltung verursacht zusätzliche Kosten.

Für Szenarien, die eine hohe Echtzeitfähigkeit erfordern, empfehlen wir die Verwendung der GPT-5.5 Standardversion.

Q8: Wie kann ich die Kosten bei GPT-5.5 Pro präzise kontrollieren?

Drei Schlüsselstrategien zur Kostenkontrolle:

- Gestaffelte Planung: Nutzen Sie die Standardversion für Routineaufgaben und nur die Pro-Version für komplexe Aufgaben.

- max_tokens-Limit setzen: Vermeiden Sie zu lange Ausgaben; wir empfehlen ein vernünftiges Limit von 1K bis 8K Token je nach Aufgabe.

- Token-Verbrauch überwachen: Zählen Sie in Ihrem Produktionscode die Input/Output-Token in Echtzeit und schätzen Sie die Kosten.

- 272K-Schwelle vermeiden: Verarbeiten Sie lange Dokumente in Stücken, um die 2-fache Preisstufe zu vermeiden.

Über die Plattform APIYI apiyi.com können Sie zudem den 10%-Aufladebonus nutzen, um die tatsächlichen Kosten weiter zu senken.

GPT-5.5 Pro API – Die wichtigsten Punkte

- Spitzenreiter bei der Schlussfolgerung: Mit 39,6 % im FrontierMath Tier 4 setzt das Modell einen neuen Rekord für öffentlich zugängliche Modelle.

- 1M+ Kontextfenster: 1,05 Mio. Token Eingabe und 128K Ausgabe – ganze Fachbücher lassen sich in einem Durchgang verarbeiten.

- König der Agenten: Erreicht 82,7 % im Terminal-Bench 2.0 und kann selbstständig Programmieraufgaben mit einem Zeitaufwand von bis zu 20 Stunden bewältigen.

- Preisgestaltung: Kostet das Sechsfache der Standardversion ($30/$180 pro 1 Mio. Token). Eine präzise Steuerung nach Bedarf ist zwingend erforderlich.

- SVIP-Gruppenschutz: Bei APIYI exklusiv für SVIP-Nutzer verfügbar, um hohe Kosten durch versehentliche Fehlkonfigurationen zu vermeiden.

- 15 % Rabatt bei lokaler Anbindung: Über APIYI (apiyi.com) erhalten Sie bei einer Aufladung von 100 Einheiten 10 Einheiten gratis, was effektiv 85 % der offiziellen Kosten entspricht.

- Vollständige SDK-Kompatibilität: Ersetzen Sie einfach die

base_urlim OpenAI-SDK durchvip.apiyi.com, um den Dienst zu nutzen.

Zusammenfassung

Die wichtigsten Aspekte der GPT-5.5 Pro API:

- Leistungsprofil: Speziell für tiefgreifende Schlussfolgerungen und hochwertige Aufgaben entwickelt; es ist das aktuell leistungsfähigste Modell von OpenAI.

- Preisstruktur: $30/$180 pro 1 Mio. Token. Bei Überschreitung von 272K Token greift eine zweifache Staffelung – eine präzise Planung ist hier essenziell.

- Zugang: Über die SVIP-Gruppe von APIYI (apiyi.com). Mit dem Bonus von 10 % bei Aufladungen und der direkten Anbindung aus dem Inland profitieren Sie von stabilen Verbindungen ohne Umwege.

GPT-5.5 Pro ist kein Modell für den Alltag, sondern ein professionelles Werkzeug für komplexe Schlussfolgerungen, wissenschaftliche Forschung, die Refaktorisierung umfangreicher Codebasen und mehrstufige Agenten-Aufgaben. Für 80 % der regulären Modellaufrufe bleibt die Standardversion von GPT-5.5 die wirtschaftlichere Wahl. Wir empfehlen, vor der Nutzung der Pro-Version zu prüfen, ob die Aufgabe tatsächlich diese Spitzenleistung erfordert.

Für einen schnellen und stabilen Zugang zu GPT-5.5 Pro empfehlen wir die Plattform APIYI (apiyi.com), die durch den SVIP-Gruppenschutz, attraktive Rabatte und eine zuverlässige Anbindung überzeugt.

Weiterführende Artikel

Wenn Sie sich für die GPT-5.5 Pro API interessieren, empfehlen wir Ihnen folgende weiterführende Lektüre:

- 📘 GPT-5.5 Standard API-Integrationsleitfaden – Lernen Sie die Einstiegsversion der GPT-5.5-Serie und Best Practices für 80 % der Anwendungsfälle kennen.

- 📊 GPT-5.5 Pro vs. Claude Opus 4.7 im Tiefenvergleich – Meistern Sie die Leistungsunterschiede und Auswahlkriterien der beiden führenden Inferenzmodelle.

- 🚀 OpenAI Agent Workflow in der Praxis: GPT-5.5 Pro + Computer Use – Entdecken Sie den produktionsreifen Einsatz für langfristige, mehrstufige Automatisierungsaufgaben.

📚 Referenzen

-

Offizielle OpenAI GPT-5.5 Pro Modelldokumentation: Modellspezifikationen, API-Endpunkte, Preisinformationen

- Link:

developers.openai.com/api/docs/models/gpt-5.5-pro - Hinweis: Hier finden Sie die aktuellsten und autoritativen technischen Parameter für GPT-5.5 Pro.

- Link:

-

OpenAI GPT-5.5 Serien-Blog: Modellfähigkeiten, Benchmark-Daten, Anwendungsszenarien

- Link:

openai.com/index/introducing-gpt-5-5 - Hinweis: Offizielle Erläuterung zur Positionierung der Fähigkeiten der GPT-5.5-Serie.

- Link:

-

APIYI GPT-5.5 Pro Integrationsdokumentation: Lösungen für den Modellaufruf in China, Antragsprozess für SVIP-Gruppen

- Link:

docs.apiyi.com - Hinweis: Ein praktischer Integrationsleitfaden für Entwickler in China.

- Link:

-

OpenAI Preisseite: Vollständige Preisliste und gestaffelte Abrechnungsregeln

- Link:

developers.openai.com/api/docs/pricing - Hinweis: Die aktuellen Abrechnungsstandards für alle Modelle.

- Link:

Autor: APIYI Technik-Team

Technischer Austausch: Wir laden Sie herzlich ein, Ihre Erfahrungen mit GPT-5.5 Pro in den Kommentaren zu diskutieren. Weitere Informationen zur Modellintegration finden Sie im APIYI-Dokumentationszentrum unter docs.apiyi.com.