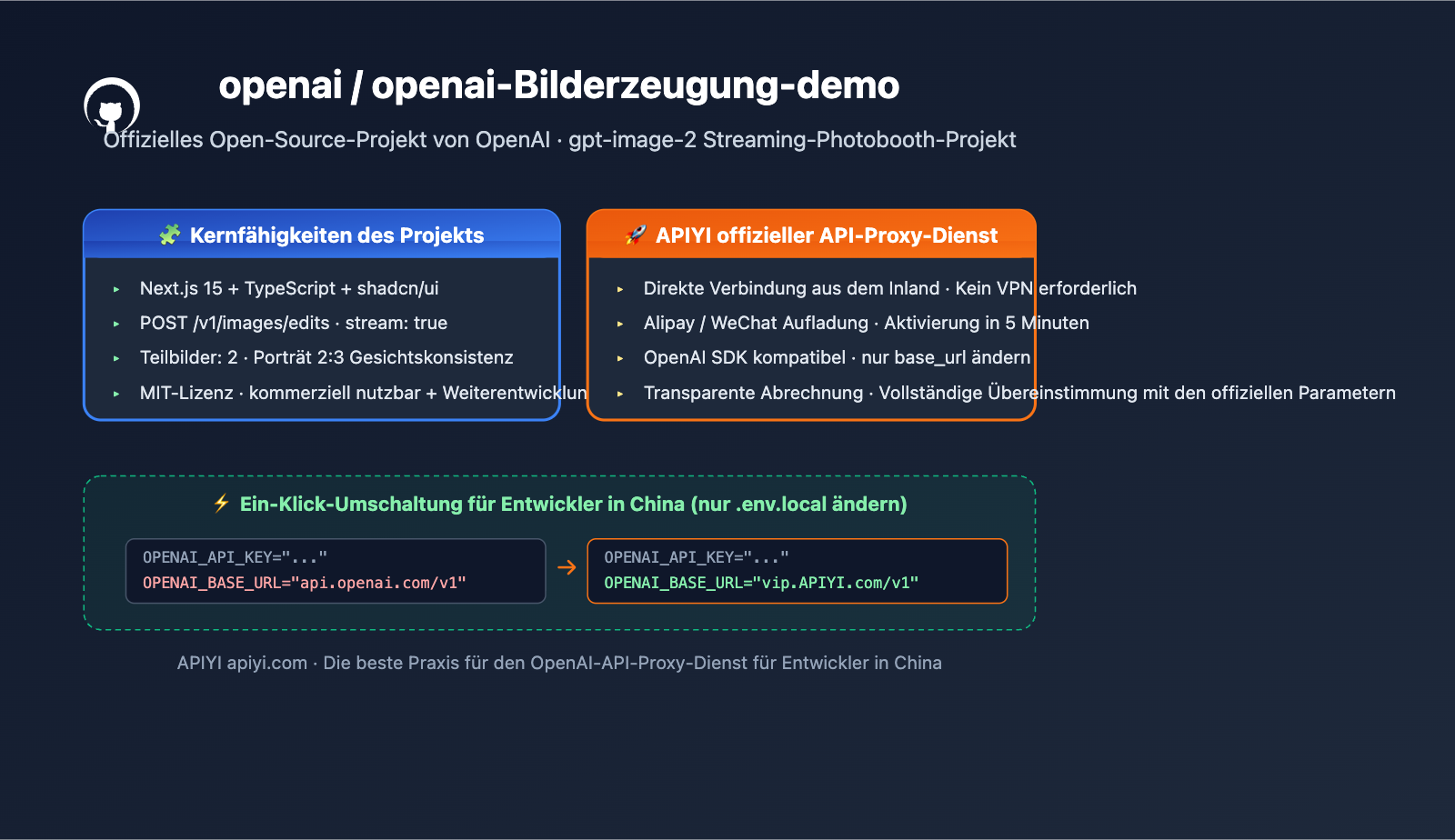

Anmerkung des Autors: OpenAI hat offiziell das auf gpt-image-2 basierende Photobooth-Demoprojekt als Open Source veröffentlicht. Dieser Artikel analysiert den Quellcode und die Prinzipien der Streaming-Implementierung im Detail und erklärt, wie Sie diese Funktion über den APIYI-Proxy-Dienst ohne Hürden reproduzieren können.

OpenAI hat das Projekt openai-imagegen-demo auf GitHub veröffentlicht. Dabei handelt es sich um eine Next.js-Demoanwendung, die zusammen mit gpt-image-2 herausgebracht wurde und die für das neue Modell einzigartigen Fähigkeiten wie Streaming-Bilderzeugung, Porträt-Stilisierung und parallele Mehrfach-Stilisierung demonstriert. Projekt-URL: github.com/openai/openai-imagegen-demo.

Dies ist nicht einfach nur ein weiteres "Hello World"-Beispiel. Der Quellcode enthält den von OpenAI offiziell empfohlenen progressiven Streaming-Ausgabemodus partial_images sowie die neueste Verwendung des Endpunkts /v1/images/edits für Szenarien mit Bildbearbeitung.

Kernnutzen: Nach dem Lesen dieses Artikels werden Sie die Architektur, die Schlüsselparameter und die Reproduktionsschritte dieser offiziellen Demo vollständig verstehen und wissen, wie Sie die gleiche gpt-image-2 API in Deutschland ohne VPN und ohne Wartezeiten über den APIYI-Proxy-Dienst nutzen können.

Kernpunkte der openai-imagegen-demo

| Punkt | Beschreibung | Wert |

|---|---|---|

| Projektfokus | Offizielle Photobooth-Demo von OpenAI, zeigt gpt-image-2 Porträt-Stilisierung |

Die maßgeblichste Referenz für gpt-image-2 Integration |

| Tech-Stack | Next.js 15 App Router + TypeScript + Tailwind + shadcn/ui | Moderner Web-Stack, produktionsreif und wiederverwendbar |

| Kern-Endpunkt | POST /v1/images/edits, kombiniert mit stream: true und partial_images |

Erste offizielle Demo für Streaming-Bilderzeugung |

| Modell | gpt-image-2, Qualitätsstufe high, Größe 1024x1536 (2:3 Porträt) |

Fokus auf Porträt-Treue und Ausdruckswiedergabe |

| Lizenz | MIT-Lizenz, frei für kommerzielle Nutzung und Weiterentwicklung | Direkt in kommerzielle Projekte integrierbar |

| Zugang | Offiziell via OpenAI API-Schlüssel; APIYI-Proxy-Dienst ermöglicht Direktverbindung | Niedrigere Hürden, kein VPN erforderlich |

Detaillierte Projektbeschreibung: imagegen-demo

Die openai-imagegen-demo ist im Wesentlichen ein interaktives Fotostudio (Photobooth): Benutzer laden ein Selfie hoch oder nehmen eines auf, wählen bis zu 4 voreingestellte Stile (z. B. Strick-Stil, digitale Kunst, Ölgemälde usw.), und die Anwendung ruft parallel den images/edits-Endpunkt von gpt-image-2 auf, um die Ergebnisse für jeden Stil schrittweise im Streaming-Verfahren zurückzugeben.

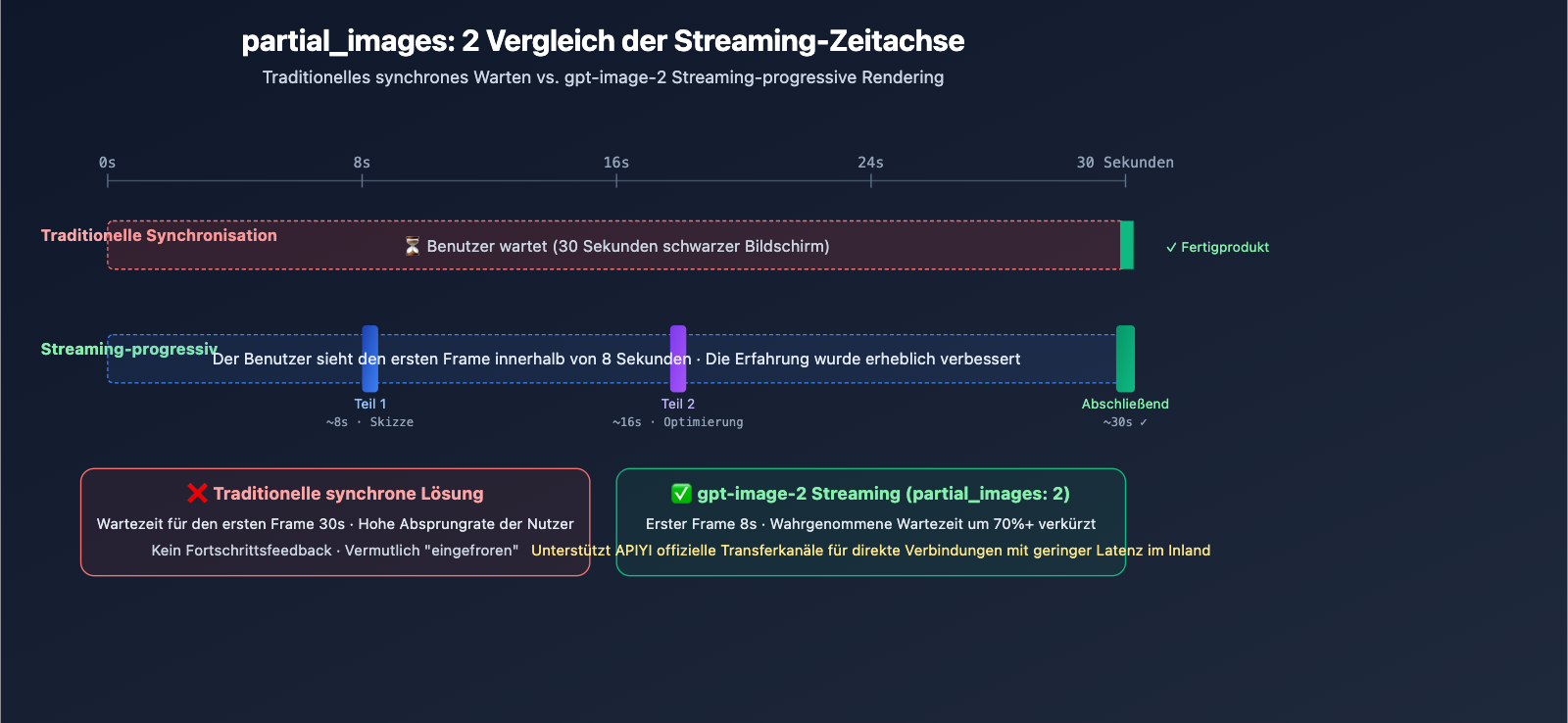

Im Gegensatz zu den üblichen "Text-zu-Bild-Demos" auf dem Markt konzentriert sich dieses offizielle Repository auf zwei neue Fähigkeiten: Bild-zu-Bild (Bildbearbeitung) und progressives Streaming (partial_images). Ersteres löst die technische Herausforderung der "Gesichtskonsistenz", während Letzteres die Wartezeit von einem 30-sekündigen schwarzen Bildschirm in eine schrittweise Frame-für-Frame-Anzeige verwandelt.

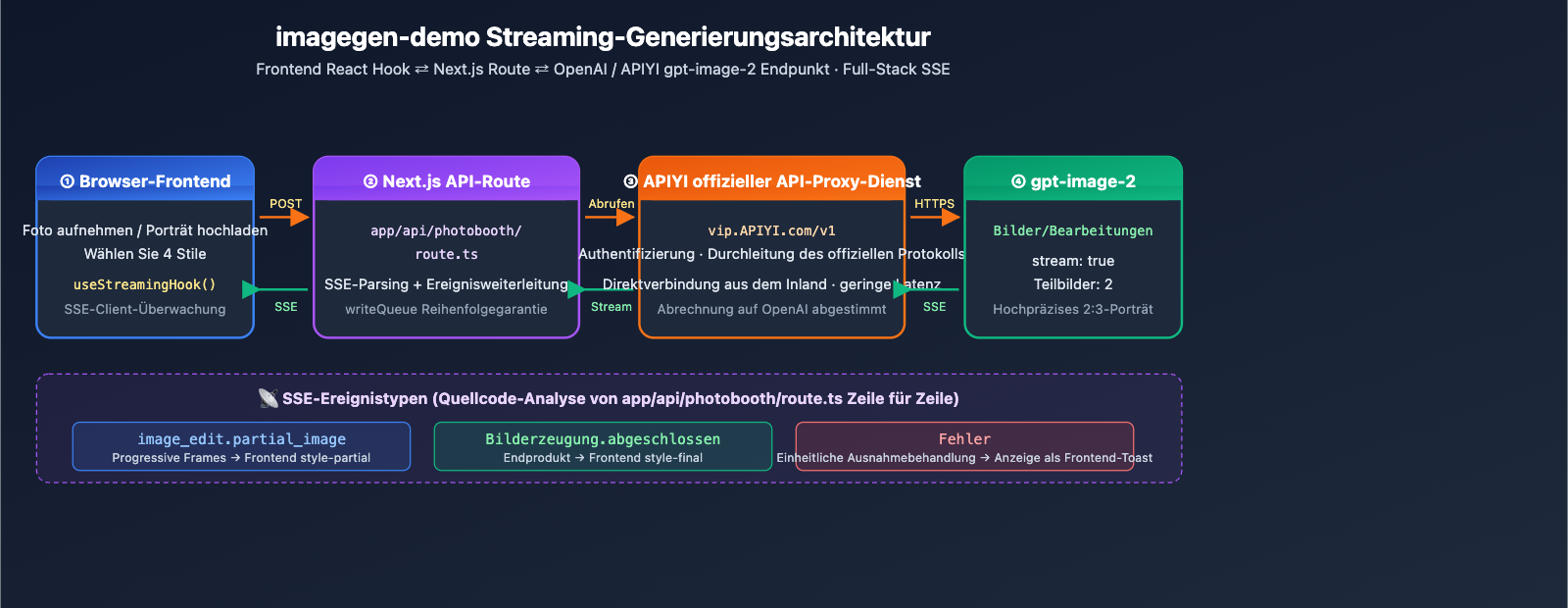

Analyse der imagegen-demo Projektarchitektur

Analyse des Kernquellcodes

Das Projekt besteht im Wesentlichen aus einer einzigen API-Route: app/api/photobooth/route.ts. Diese ist dafür verantwortlich, das Porträtbild und die Stil-Eingabeaufforderung vom Frontend zu bündeln und eine Anfrage im Streaming-Modus an den /v1/images/edits-Endpunkt von OpenAI zu senden. Die Struktur des Anfragekörpers sieht wie folgt aus:

const body = {

model: "gpt-image-2",

prompt: `${style.prompt}\n\n${OPENAI_IMAGE_OUTPUT_REQUIREMENTS}`,

images: [{ image_url: imageDataUrl }],

size: "1024x1536",

quality: "high",

output_format: "png",

stream: true,

partial_images: 2,

};

Drei Details sind besonders beachtenswert:

stream: true+partial_images: 2: Dies ist eine exklusive Streaming-Funktion von gpt-image-2. Der Server sendet zwei Zwischenbilder, bevor das finale Ergebnis geliefert wird.images-Parameter: Akzeptiert ein oder mehrere Referenzbilder als Data-URL und unterstützt die Bearbeitung durch Fusion mehrerer Bilder.OPENAI_IMAGE_OUTPUT_REQUIREMENTS: Erzwingt die Vorgaben "Porträt im 2:3-Format, Beibehaltung von Pose und Gesichtsausdruck". Dies ist das bewährte Muster für effektive Eingabeaufforderungen bei der Bildbearbeitung.

Analyse der Streaming-Ereignisse

Die Route überwacht die offizielle Antwort über SSE (Server-Sent Events) und verarbeitet drei Arten von Ereignissen:

image_edit.partial_image: Zwischenbild, sendetstyle-partialan das Frontend.image_edit.completed: Endprodukt, sendetstyle-finalan das Frontend.error: Wirft eine Ausnahme, die vom Frontend zentral abgefangen wird.

Im Frontend verwendet die React-Seite einen benutzerdefinierten Hook, der eine writeQueue (Promise-Kette) verwaltet. Dies stellt sicher, dass die Ereignisreihenfolge bei gleichzeitiger Anwendung mehrerer Stile nicht durcheinandergerät – ein Aspekt, der für die technische Umsetzung besonders wertvoll ist.

imagegen-demo: Schnelleinstieg

Minimale Schritte zur Inbetriebnahme

Gemäß der offiziellen README lässt sich das Projekt mit nur 5 Befehlen vollständig ausführen:

git clone https://github.com/openai/openai-imagegen-demo

cd openai-imagegen-demo

cp .env.example .env.local

echo "OPENAI_API_KEY=sk-xxxxx" >> .env.local

npm install && npm run dev

Vollständige .env.local-Konfiguration für die Nutzung über den APIYI-Proxy

# Option 1: Nutzung der offiziellen OpenAI API (erfordert Netzwerkzugriff im Ausland + API-Guthaben)

OPENAI_API_KEY="sk-proj-xxxxx"

# Option 2: Nutzung des APIYI-Proxy-Dienstes (direkte Verbindung, kein VPN erforderlich)

OPENAI_API_KEY="your-apiyi-key"

OPENAI_BASE_URL="https://vip.apiyi.com/v1"

# Optional: Organisations- und Projekt-ID

OPENAI_ORG_ID=""

OPENAI_PROJECT_ID=""

Anschließend muss lediglich der hartcodierte endpointBase-Wert in app/api/photobooth/route.ts so angepasst werden, dass er process.env.OPENAI_BASE_URL ?? "https://api.openai.com/v1" ausliest, um nahtlos zwischen dem offiziellen Endpunkt und dem Proxy-Dienst zu wechseln.

const endpointBase = process.env.OPENAI_BASE_URL ?? "https://api.openai.com/v1";

const response = await fetch(`${endpointBase}/images/edits`, {

method: "POST",

headers: {

"Authorization": `Bearer ${apiKey}`,

"Content-Type": "application/json",

},

body: JSON.stringify(body),

});

Empfehlung zur Anbindung: Entwickler in China stoßen bei der Nutzung der offiziellen OpenAI-Demo oft auf drei Hindernisse (Netzwerk, API-Guthaben, Zahlungsmethoden). Es wird empfohlen, einen kompatiblen Schlüssel über den APIYI-Proxy-Dienst (apiyi.com) zu beziehen und

OPENAI_BASE_URLaufhttps://vip.apiyi.com/v1zu setzen. So lässt sich das Projekt lokal mit einem Klick starten, wobei Streaming-Ereignisse und Parameter vollständig mit dem offiziellen Standard übereinstimmen.

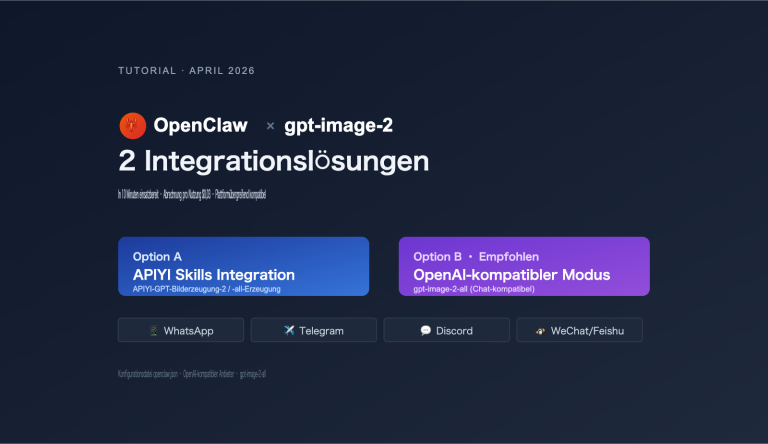

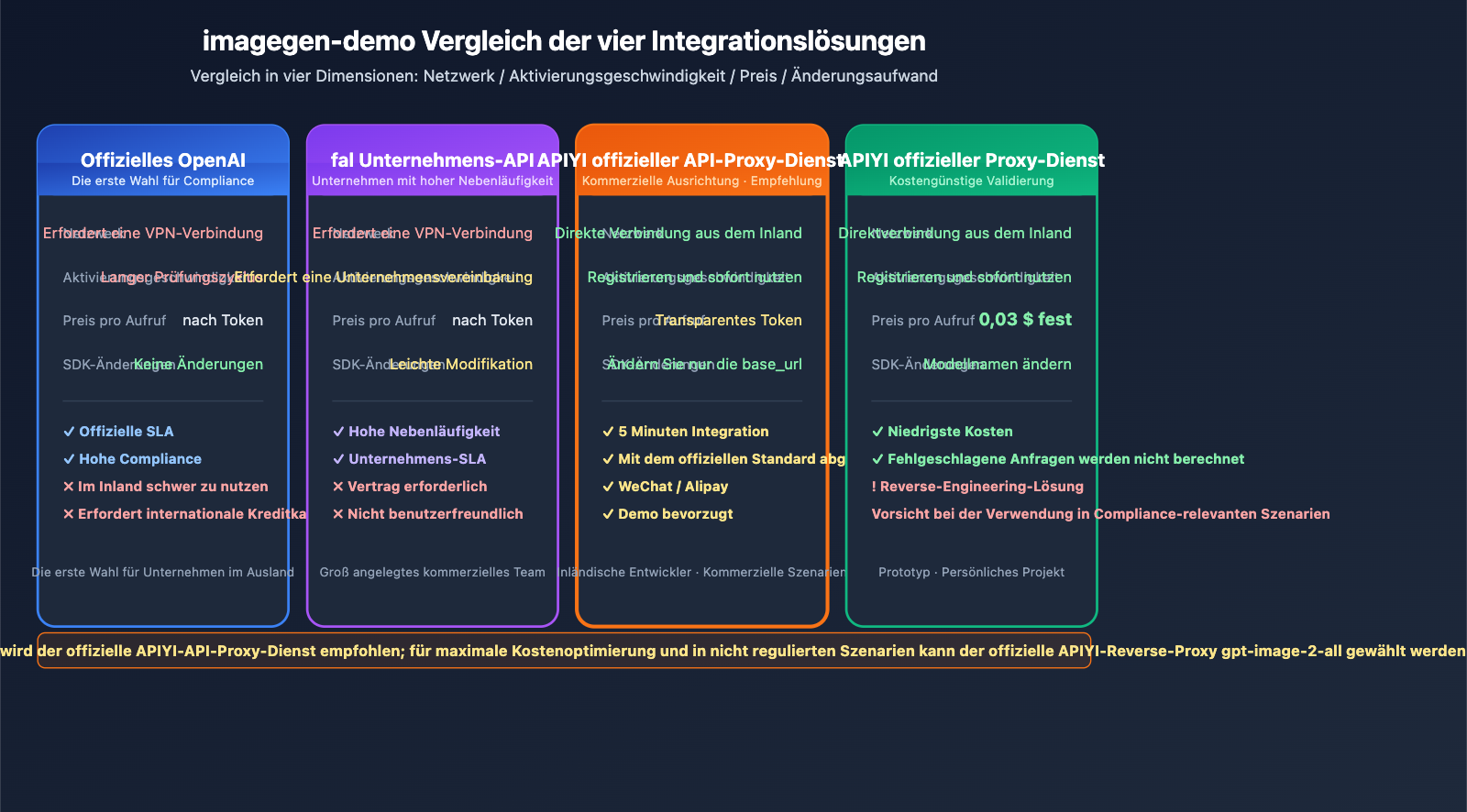

Vergleich der Integrationslösungen für imagegen-demo

| Integrationslösung | Netzwerkanforderung | Aktivierungsgeschwindigkeit | Preis pro Bild | SDK-Änderungsaufwand |

|---|---|---|---|---|

| OpenAI Offiziell | Ausländisches Netzwerk erforderlich | Kreditkarte & Prüfung nötig | Token-basiert (ca. $0,15+/Bild) | Keine |

| fal Enterprise API | Zugriff aus dem Ausland | Firmenvertrag erforderlich | Token-basiert | Geringe Anpassung |

| APIYI Offizieller Proxy | Direkte Verbindung (Inland) | Sofort nach Registrierung | Transparente Token-Abrechnung | Nur base_url anpassen |

| APIYI Reverse-Proxy | Direkte Verbindung (Inland) | Sofort nach Registrierung | Fix $0,03 / Bild | Nur Modellname anpassen |

Erläuterung der Lösungen

Analyse der offiziellen OpenAI-Direktanbindung: Der offizielle Kanal bietet die höchste Konformität und SLA-Sicherheit und ist das Standardziel für die imagegen-demo. Die Nutzung aus dem Inland erfordert jedoch ein VPN, eine internationale Kreditkarte und oft lange Wartezeiten für die API-Freischaltung. Im Vergleich dazu ist der APIYI-Proxy-Dienst hinsichtlich Netzwerkverfügbarkeit und Schnelligkeit besser für die Testphase und den produktiven Einsatz im Inland geeignet.

Analyse der fal Enterprise API: fal hat am 21. April 2026 den Unternehmens-Endpunkt für gpt-image-2 veröffentlicht, der durch exzellente SLA bei hoher Last überzeugt. Da er sich jedoch an Unternehmenskunden richtet, ist die Einstiegshürde für unabhängige Entwickler hoch. Für Entwickler, die imagegen-demo lokal ausführen möchten, ist APIYI die schlankere Lösung.

Unterschied zwischen APIYI Offiziell und Reverse-Proxy: Der offizielle Proxy leitet Ihre Anfragen direkt an die OpenAI-API weiter; Abrechnung, SLA und Funktionen sind identisch mit dem Original, was ihn ideal für kommerzielle Szenarien macht. Der Reverse-Proxy hingegen realisiert den Zugriff über die ChatGPT-Weboberfläche; mit einem Fixpreis von $0,03 pro Bild ist er deutlich günstiger und eignet sich hervorragend für Prototyping und Validierung. Beide Kanäle werden auf der APIYI-Plattform parallel angeboten und können je nach Bedarf gewechselt werden.

Hinweis zum Vergleich: Die oben genannten Daten basieren auf den offiziellen Preislisten von OpenAI, den Veröffentlichungen von fal sowie der technischen Dokumentation unter

docs.apiyi.comund können über APIYI (apiyi.com) in der Praxis verifiziert werden.

Detaillierte Erläuterung der Schlüsselparameter von gpt-image-2 (aus dem imagegen-demo Quellcode)

Basierend auf der Datei lib/constants.ts aus dem imagegen-demo, sind hier die offiziell empfohlenen Standard-Parameterkombinationen für gpt-image-2:

| Parameter | Demo-Standardwert | Beschreibung | Anpassungsempfehlung |

|---|---|---|---|

| model | gpt-image-2 |

Aktuelles Bildmodell | Unverändert lassen |

| size | 1024x1536 |

2:3 Hochformat | Für Social-Media-Querformat auf 1536x1024 ändern |

| quality | high |

Höchste Bildqualität | medium/low zur Kostenreduzierung |

| output_format | png |

Unterstützt transparenten Hintergrund | Für Web-Szenarien webp zur Bandbreiteneinsparung |

| stream | true |

SSE-Streaming aktiviert | Pflicht für Echtzeitanwendungen |

| partial_images | 2 |

Übermittelt 2 Zwischenbilder | Max. 3; Abwägung zwischen Wartezeit und Bandbreite |

Best Practices für das Prompt-Engineering

Die Konstante OPENAI_IMAGE_OUTPUT_REQUIREMENTS in der Demo ist eine äußerst wertvolle Prompt-Vorlage:

"portrait orientation (2:3 aspect ratio), preserve the exact people, poses, facial expressions, and scene composition as faithfully as possible"

Dieser Text offenbart das goldene Paradigma für die Bildbearbeitung mit gpt-image-2:

- Explizite Angabe des Seitenverhältnisses: Auch wenn der

size-Parameter gesetzt ist, sollte das Seitenverhältnis im Prompt wiederholt werden, um die Trefferquote zu erhöhen. - Betonung der Wiedergabetreue:

preserve the exact ...ist der entscheidende Befehl, um die Gesichtskonsistenz zu wahren. - Auflistung der Dimensionen: Personen, Posen, Gesichtsausdrücke und Szenenkomposition sollten explizit genannt werden – je spezifischer, desto höher die Wiedergabetreue.

Häufig gestellte Fragen (FAQ)

Q1: Was ist das Projekt openai-imagegen-demo?

openai-imagegen-demo ist eine von OpenAI offiziell auf GitHub veröffentlichte Photobooth-Demoanwendung. Sie nutzt Next.js 15 + TypeScript + gpt-image-2, um einen vollständigen Workflow von "Porträt hochladen → Stil wählen → Bilder in verschiedenen Stilen streamen" zu realisieren. Es ist die derzeit maßgeblichste Referenz für die Integration des images/edits-Endpunkts von gpt-image-2 und ist unter der MIT-Lizenz für die kommerzielle Nutzung freigegeben.

Q2: Was unterscheidet imagegen-demo von anderen Bilderzeugungs-Demos?

Der Unterschied liegt hauptsächlich in zwei Punkten: Erstens nutzt es den brandneuen /v1/images/edits-Endpunkt von gpt-image-2 für Bild-zu-Bild-Aufgaben (statt der klassischen Text-zu-Bild-Funktion von DALL-E), wodurch die Gesichtskonsistenz gewahrt bleibt. Zweitens aktiviert es die Streaming-Fähigkeiten mittels stream: true + partial_images, sodass Benutzer den schrittweisen Rendering-Prozess sehen können, anstatt 30 Sekunden auf einen schwarzen Bildschirm zu starren. Andere Community-Demos basieren meist auf DALL-E 3 (Text-zu-Bild) und verfügen nicht über diese beiden Funktionen.

Q3: Wann wurde imagegen-demo veröffentlicht?

Das Repository wurde zeitgleich mit der Veröffentlichung von ChatGPT Images 2.0 durch OpenAI am 21. April 2026 als Open Source bereitgestellt. Mit der offiziellen Einführung des gpt-image-2-Modells in der API und in Codex möchte OpenAI Entwicklern den Einstieg erleichtern. Die README-Datei wird laufend aktualisiert.

Q4: Für welche Anwendungsszenarien eignet sich imagegen-demo am besten?

Es eignet sich besonders für die folgenden vier Szenarien:

- Social-Media-Apps (Kostüm-/Stilwechsel): Benutzer laden Selfies hoch und generieren Versionen im chinesischen Stil, als Ölgemälde oder im Cyberpunk-Look.

- Einheitliche Produktbilder im E-Commerce: Stapelweise Umwandlung von Produktfotos in einen einheitlichen visuellen Markenstil.

- KI-Fotokabinen für Konferenzen / Events: Interaktive Fotoinstallationen bei Offline-Veranstaltungen.

- Lehr-Demos / Hackathon-Prototypen: Schnelle Demonstration der neuen Fähigkeiten von gpt-image-2.

Q5: Wie kann ich imagegen-demo schnell über eine API ausführen?

Wir empfehlen die Nutzung des APIYI-Proxy-Dienstes für eine schnelle Implementierung:

- Besuchen Sie APIYI (apiyi.com), registrieren Sie ein Konto und erstellen Sie einen API-Schlüssel.

- Klonen Sie das Repository:

git clone https://github.com/openai/openai-imagegen-demo - Tragen Sie in

.env.localdenOPENAI_API_KEYundOPENAI_BASE_URL=https://vip.apiyi.com/v1ein. - Passen Sie

route.tsso an, dassendpointBasedieprocess.env.OPENAI_BASE_URLausliest. npm install && npm run dev– das Ergebnis ist unterlocalhost:3000sichtbar.

APIYI unterstützt die einheitliche Anbindung verschiedener gängiger Bildmodelle wie gpt-image-2, Nano Banana Pro und Flux, was den lokalen Vergleich und Wechsel erleichtert.

Q6: Wie funktioniert der Parameter partial_images in imagegen-demo?

partial_images gibt an, wie viele Zwischenbilder der Server vor der Rückgabe des endgültigen Bildes übermitteln soll. Der Standardwert der Demo ist 2, was bedeutet, dass ein einzelner Generierungsvorgang die drei Phasen "Erste Skizze → Zweite Optimierung → Endprodukt" durchläuft. Jedes Zwischenbild wird über das SSE-Ereignis image_edit.partial_image übertragen, was dem Frontend ein Echtzeit-Rendering ermöglicht und die Wartezeit von 30 Sekunden ohne visuelles Feedback vermeidet. Der Parameter unterstützt maximal 3, wobei mehr Zwischenbilder den Bandbreitenverbrauch erhöhen.

Q7: Wie können Entwickler im deutschsprachigen Raum imagegen-demo ohne Hürden ausführen?

Die direkte Ausführung der offiziellen Demo kann auf Hürden stoßen (Netzwerkzugriff auf die OpenAI-API, internationale Kreditkartenanforderungen, lange Prüfzyklen für API-Kontingente). Über den APIYI-Proxy-Dienst lässt sich dies einfach lösen:

- Registrieren Sie sich bei

apiyi.com(unterstützt gängige Zahlungsmethoden). - Erhalten Sie einen API-Schlüssel, der mit dem OpenAI-Protokoll kompatibel ist.

- Setzen Sie in

.env.localdie VariableOPENAI_BASE_URL=https://vip.apiyi.com/v1. route.tsliest diese Umgebungsvariable aus; der restliche Code bleibt unverändert.

Der gesamte Prozess dauert etwa 5 Minuten, die Abrechnung erfolgt transparent und analog zu den offiziellen OpenAI-Preisen.

Q8: Welche bekannten Einschränkungen hat imagegen-demo?

Hier eine objektive Übersicht der aktuellen Einschränkungen:

- Generierungsdauer pro Bild: Bei hoher Qualität (

quality: high) dauert ein Bild etwa 20-30 Sekunden; für Stapelverarbeitung ist eine Optimierung der Nebenläufigkeit erforderlich. - Gesichtskonsistenz nicht bei 100%: Bei komplexen Posen oder Szenen mit mehreren Personen kann es zu leichten Verzerrungen kommen.

- Kostenaspekte: OpenAI berechnet nach Token; ein hochwertiges Bild kostet ab ca. $0,15. Für Massenanwendungen empfiehlt sich die Qualität

mediumoder die Nutzung des APIYI-Proxy-Dienstes ($0,03/Bild). - Begrenzte Stilvorgaben: Die Demo enthält nur ca. 10 integrierte Stile; Erweiterungen müssen in

lib/styles.tsvorgenommen werden. - Kompatibilität mobiler Kameras: Bei iOS Safari kann bei der ersten Nutzung eine manuelle Berechtigung für den Kamerazugriff erforderlich sein.

openai-imagegen-demo Wichtigste Erkenntnisse

- Offizielles Open-Source-Projekt von OpenAI: Ein maßgeblicher Demo-Code zur Veröffentlichung von gpt-image-2, lizenziert unter der MIT-Lizenz für kommerzielle Zwecke.

- Fokus auf Bild-zu-Bild-Fähigkeiten: Nutzung des Endpunkts

/v1/images/editsals technisches Paradigma zur Wahrung der Gesichtskonsistenz. - Streaming-Rendering-Technik:

stream: true+partial_images: 2verwandelt die Wartezeit von einem schwarzen Bildschirm in ein progressives Rendering. - Next.js 15 Full-Stack: Die Architektur aus App Router und SSE ist der moderne Standard für Anwendungen zur Bilderzeugung.

- Direkter Zugang aus China: Über den API-Proxy-Dienst von APIYI (apiyi.com) lässt sich die Verbindung einfach durch Ändern der

base_urlherstellen. - Goldene Prompt-Regel:

preserve the exact ...ist der entscheidende Befehl für hohe Wiedergabetreue und sollte in eigene Projekte übernommen werden. - Dualer Kanal (Offiziell vs. Reverse): Für kommerzielle Zwecke empfiehlt sich der offizielle Proxy (Abgleich mit OpenAI), für Tests der Reverse-Proxy (fixer Preis von $0,03 pro Bild).

Zusammenfassung

openai-imagegen-demo ist der beste Einstieg, um die neuen Funktionen von gpt-image-2 zu verstehen. Der Kernwert liegt in drei Punkten:

- Autoritative Referenz: Ein offiziell erstelltes Integrationsbeispiel, bei dem Parameter, Eingabeaufforderungen und die Streaming-Architektur dem aktuellen Standard entsprechen.

- Produktionsreifer Code: Next.js 15 + SSE + parallele Verarbeitung verschiedener Stile, direkt in eigene Projekte übertragbar.

- Reproduzierbarkeit in China: Über den API-Proxy-Dienst von APIYI können Entwickler in China die offizielle Demo in nur 5 Minuten zum Laufen bringen.

Wenn Sie die Streaming-Bildbearbeitungsfunktionen von gpt-image-2 sofort ausprobieren möchten, empfehlen wir Ihnen, einen kompatiblen Schlüssel über APIYI (apiyi.com) zu beziehen. Klonen Sie das openai-imagegen-demo-Repository und setzen Sie die OPENAI_BASE_URL auf https://vip.apiyi.com/v1, um die offizielle OpenAI-Demo lokal nachzubilden.

Weiterführende Artikel

Wenn du dich für gpt-image-2 und die openai-imagegen-demo interessierst, empfehlen wir dir folgende Lektüre:

- 📘 Wo finde ich die gpt-image-2 Reverse-API? In 3 Minuten zur APIYI-Schnittstelle – Erfahre mehr über die kostengünstige Lösung für 0,03 $ pro Bild.

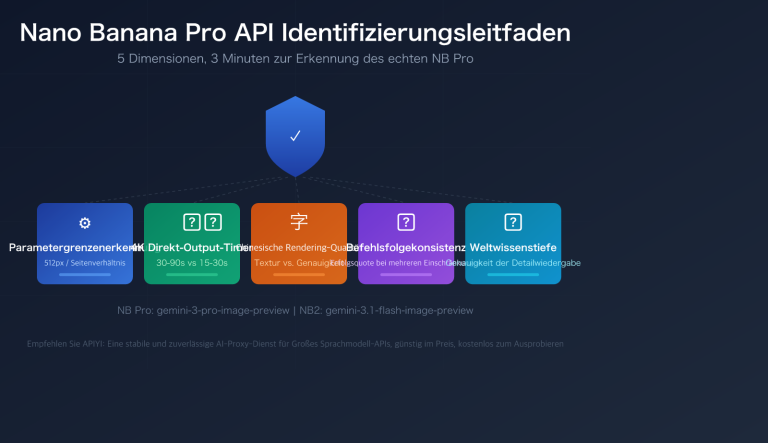

- 📊 gpt-image-2 vs. Nano Banana Pro: Vergleich der Bildmodelle – Eine Analyse der Leistungsunterschiede gängiger Bildmodelle.

- 🚀 gpt-image-2 Anwendungsbereiche: Leitfaden für 6 Branchen – Entdecke reale Einsatzszenarien in E-Commerce, Bildung, sozialen Medien und mehr.

📚 Referenzen

-

Offizielles Repository der OpenAI imagegen-demo: Vollständiger Quellcode, README und Installationsanleitung

- Link:

github.com/openai/openai-imagegen-demo - Hinweis: Der offizielle Quellcode und die Installationsanleitung – der maßgebliche Ausgangspunkt, um das Integrationsparadigma von gpt-image-2 zu verstehen.

- Link:

-

Offizielle OpenAI gpt-image-2 API-Dokumentation: Modellparameter, Endpunkte und Abrechnungsinformationen

- Link:

developers.openai.com/api/docs/models/gpt-image-2 - Hinweis: Hier findest du alle unterstützten Parameter, Preise und Ratenbegrenzungen.

- Link:

-

Veröffentlichungsseite zu OpenAI ChatGPT Images 2.0: Einführung in die neuen Modellfunktionen

- Link:

openai.com/index/introducing-chatgpt-images-2-0/ - Hinweis: Erfahre mehr über das Designkonzept, die Kernfähigkeiten und die Anwendungsfälle von gpt-image-2.

- Link:

-

Dokumentation zum APIYI gpt-image-2 API-Proxy-Dienst: Leitfaden für die direkte Anbindung aus dem Inland

- Link:

docs.apiyi.com/en/api-capabilities/gpt-image-2-all/overview - Hinweis: Erhalte Informationen zu kompatiblen API-Schlüsseln, base_url-Konfigurationen und Preisdetails.

- Link:

Autor: APIYI Technik-Team

Technischer Austausch: Teile deine Praxiserfahrungen mit der imagegen-demo gerne in den Kommentaren. Weitere Dokumentationen findest du im APIYI-Dokumentationszentrum unter docs.apiyi.com.