Sie möchten Ihre App-Ideen schnell in interaktive Interface-Prototypen verwandeln, scheitern aber am Design? Google Stitch ist genau dafür gemacht: Ein KI-gestütztes UI-Design-Tool, mit dem Sie professionelle Benutzeroberflächen allein durch natürliche Sprache generieren können.

Kernnutzen: Nach dem Lesen dieses Artikels kennen Sie die 5 wichtigsten KI-Fähigkeiten von Google Stitch, die konkrete Anwendung sowie praktische Einsatzszenarien – auch ohne jegliche Design-Vorkenntnisse.

Was ist Google Stitch: Ein 3-Minuten-Überblick

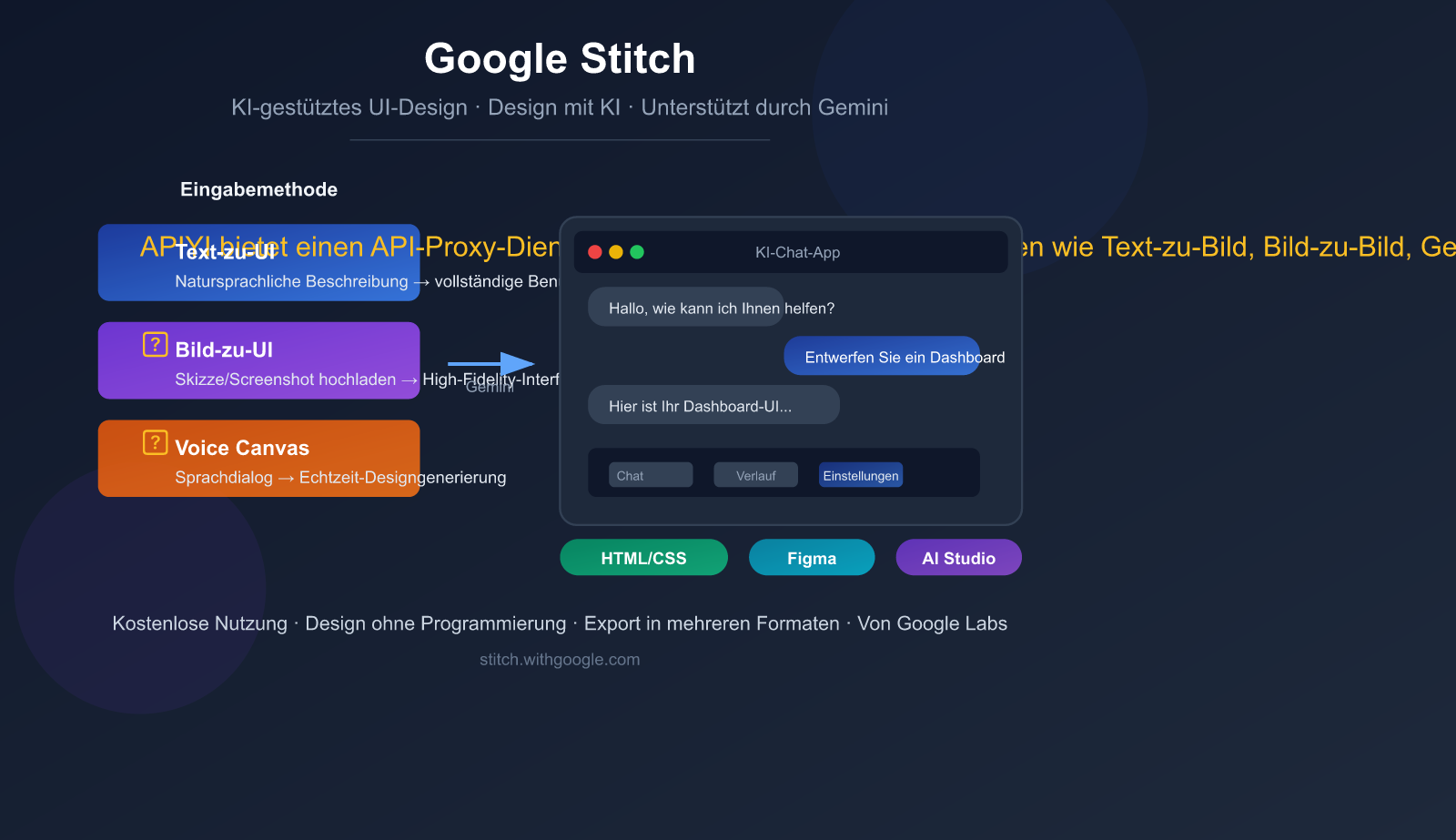

Google Stitch ist ein von Google Labs entwickeltes browserbasiertes KI-UI-Design-Tool, das erstmals im Mai 2025 auf der Google I/O vorgestellt wurde. Das Kernkonzept lautet "Design with AI" – Benutzeroberflächen durch KI gestalten.

Kurz gesagt: Stitch ermöglicht es Ihnen, durch Texteingaben, das Hochladen von Bildern, Handskizzen oder sogar Sprachdialoge hochauflösende Benutzeroberflächen zu generieren und automatisch sauberen, einsatzbereiten HTML/CSS-Code auszugeben.

Die wichtigsten Fakten zu Google Stitch

| Merkmal | Details |

|---|---|

| Produktname | Google Stitch |

| Entwicklerteam | Google Labs (experimentelles Produkt) |

| Veröffentlichung | Mai 2025 (Google I/O 2025) |

| Letztes Update | März 2026 (neue Sprachinteraktion, Vibe Design) |

| Zugang | stitch.withgoogle.com |

| Preis | Kostenlos (Google-Konto erforderlich) |

| KI-Engine | Gemini 2.5 Flash / Gemini 2.5 Pro / Gemini 3 |

| Ausgabeformate | HTML/CSS-Code, Figma-Dateien |

| Zielgruppe | Designer, Entwickler, Produktmanager, Gründer |

Was Google Stitch nicht ist

Bevor wir tiefer einsteigen, hier einige häufige Missverständnisse:

- Kein Ersatz für Figma: Stitch ist für die schnelle Prototypen-Erkundung gedacht, nicht als umfassendes Tool für Design-Systeme.

- Kein Full-Stack-Entwicklungstool: Es generiert nur Frontend-UI-Code (HTML/CSS), keine Backend-Logik.

- Kein offizielles Produkt: Es handelt sich derzeit um ein experimentelles Projekt von Google Labs, dessen Funktionen sich jederzeit ändern können.

- Keine Zusammenarbeit in Echtzeit: Derzeit nur für Einzelnutzer verfügbar.

🎯 Positionierung verstehen: Der Wert von Google Stitch liegt in der schnellen Prototypen-Validierung von 0 auf 1. Der branchenübliche Workflow lautet: „Ideen in Stitch erkunden → Feindesign in Figma → Implementierung in Entwicklungstools“. Wenn Sie KI-Modelle für die Backend-Logik benötigen, empfehlen wir die Nutzung der API-Schnittstellen von Gemini über die Plattform APIYI (apiyi.com).

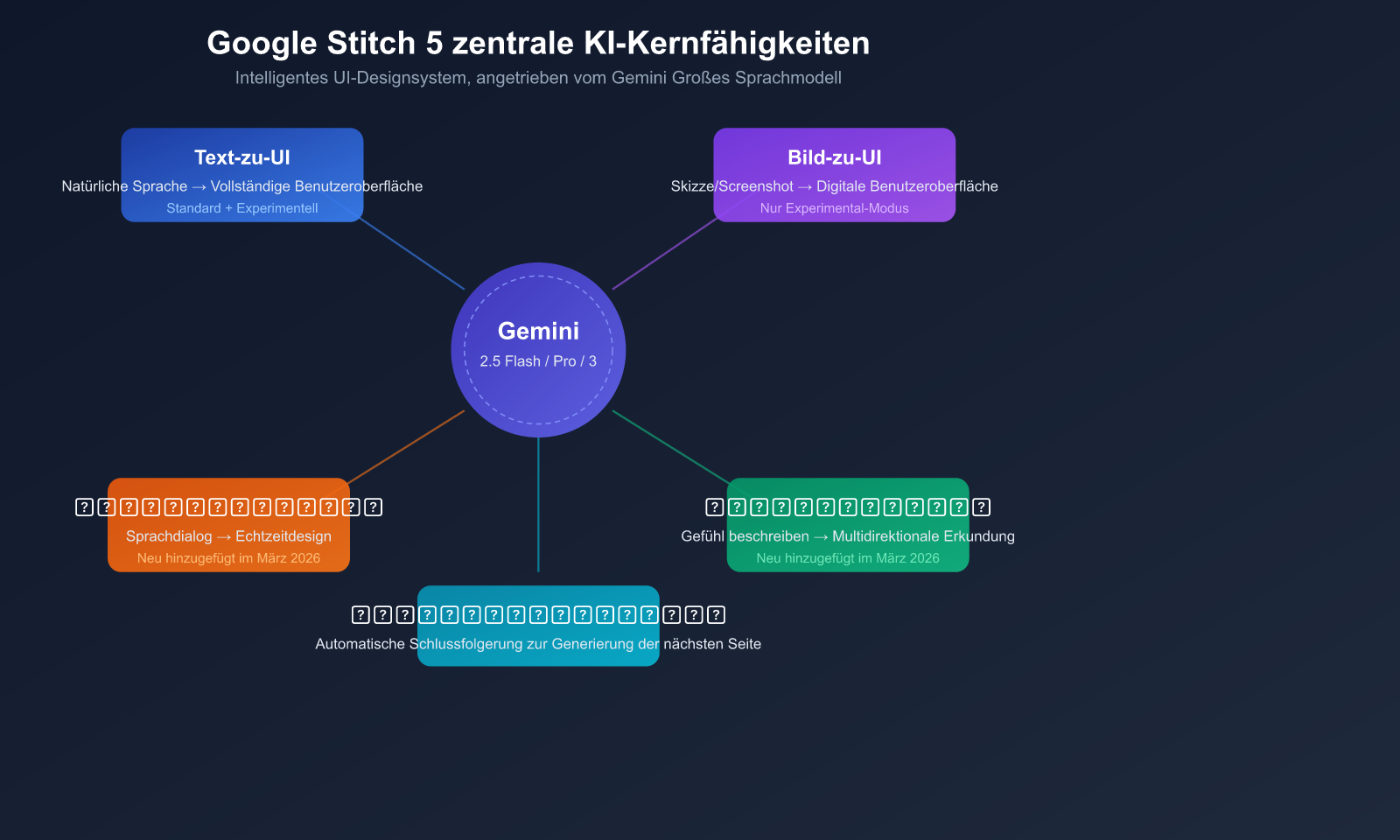

Die 5 KI-Kernfunktionen von Google Stitch im Detail

Der Grund, warum Stitch die Designwelt aufhorchen ließ (nach der Veröffentlichung fiel der Figma-Aktienkurs zeitweise um 8 %), liegt in der tiefen Integration der Gemini-Großsprachmodell-Fähigkeiten von Google in den UI-Design-Workflow. Hier ist eine detaillierte Analyse der 5 Kernfunktionen.

Funktion 1: Text-zu-UI – Interface-Generierung per Text

Dies ist die grundlegendste und zugleich leistungsstärkste Funktion von Stitch. Sie müssen die gewünschte Oberfläche lediglich in natürlicher Sprache beschreiben, und die KI generiert automatisch ein vollständiges UI-Layout.

Anwendung:

- Besuchen Sie

stitch.withgoogle.comund melden Sie sich mit Ihrem Google-Konto an. - Beschreiben Sie Ihre Anforderungen im Eingabefeld in natürlicher Sprache.

- Wählen Sie den Standard-Modus (schnell) oder den Experimental-Modus (hohe Qualität).

- Warten Sie einige Sekunden, bis die KI das vollständige Interface generiert hat.

Beispiel für eine Eingabeaufforderung:

Eine mobile Essensliefer-App mit weißem Hintergrund,

orangen Akzentfarben, einer Suchleiste oben,

Icons für Essenskategorien und einer Liste nahegelegener Restaurants

mit Bewertungen und Lieferzeit.

Wichtige Tipps:

- Je präziser die Beschreibung, desto besser das Ergebnis.

- Die Angabe von Farben, Layout-Stil und Plattform (Web/Mobil) erhöht die Genauigkeit.

- Arbeiten Sie schrittweise: Generieren Sie zuerst das Grundgerüst und fügen Sie dann Details hinzu.

Funktion 2: Bild-zu-UI – Interface-Generierung per Bild

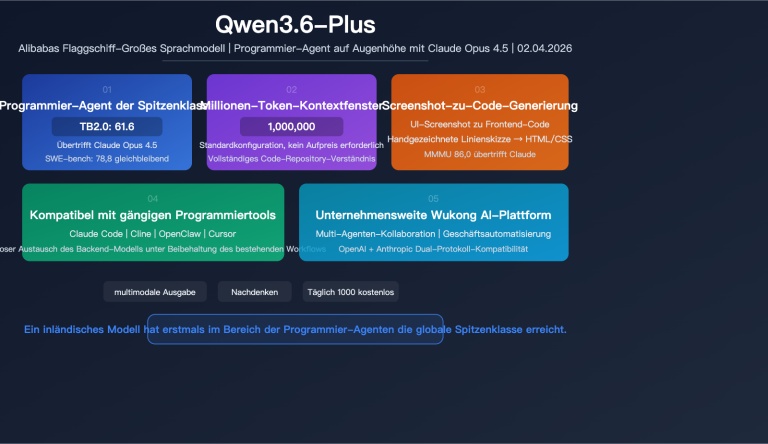

Mit dieser Funktion können Sie handgezeichnete Skizzen, Wireframes oder Screenshots von Konkurrenzprodukten hochladen, die Stitch in hochauflösende digitale Interfaces umwandelt.

Unterstützte Eingabetypen:

| Eingabetyp | Beschreibung | Empfohlener Anwendungsfall |

|---|---|---|

| Handskizze | Foto einer auf Papier gezeichneten Skizze | Schnelle Digitalisierung nach Brainstorming |

| Wireframe | Screenshot einer Wireframe-Datei | Schnelle High-Fidelity-Umsetzung von Produktkonzepten |

| Konkurrenz-Screenshot | Screenshot einer anderen App | Schnelles Design-Referenzieren |

| Stil-Referenz | Bild mit bevorzugtem visuellen Stil | Vereinheitlichung von Designsprache und Farbpalette |

Hinweis: Die Bild-zu-UI-Funktion ist nur im Experimental-Modus verfügbar, nutzt das Modell Gemini 2.5 Pro und ist auf 50–200 Nutzungen pro Monat begrenzt.

Funktion 3: Voice Canvas – Sprachgesteuerte Arbeitsfläche

Dies ist eine der innovativsten Funktionen, die im März 2026 eingeführt wurde.

Sie können Ihre Designanforderungen direkt per Sprache an die Arbeitsfläche übermitteln. Die KI versteht Ihre Anweisungen in Echtzeit und führt folgende Aktionen aus:

- Neues Interface erstellen: "Hilf mir beim Entwurf eines Musik-Players im Dark-Mode."

- Bestehendes Design anpassen: "Vergrößere die Schriftgröße der Überschrift und ändere die Button-Farbe in Blau."

- Design-Review: Die KI macht proaktiv Verbesserungsvorschläge, z. B. bei unzureichendem Kontrast oder unklarer Layout-Struktur.

- Interaktiver Dialog: Sie können mit der KI über die Vor- und Nachteile von Designlösungen diskutieren.

Diese Funktion wird durch die nativen Audio-Fähigkeiten von Gemini 2.5 Flash angetrieben und unterstützt Interaktionen in Echtzeit.

Funktion 4: Vibe Design – Atmosphärisches Design

Während man beim traditionellen Design jedes Attribut einer Komponente präzise festlegen muss, beschreiben Sie beim Vibe Design lediglich Gefühle und Ziele. Die KI generiert daraufhin automatisch mehrere passende Design-Richtungen.

Traditioneller Ansatz vs. Vibe Design:

| Dimension | Traditionelle Beschreibung | Vibe Design Ansatz |

|---|---|---|

| Eingabe | "Navigationsleiste 64px hoch, Hintergrund #1a1a2e" | "Technisch, professionell, vertrauenserweckend" |

| Farben | Spezifische Farbcodes erforderlich | "Warmes und lebendiges Gefühl" |

| Layout | Raster und Abstände müssen definiert werden | "Moderate Informationsdichte, angenehmes Browsen" |

| Ausgabe | Ein festes Design | Mehrere Design-Richtungen zur Auswahl |

Anwendungsbereiche:

- Frühe Projektphasen ohne klare Design-Vorgaben.

- Schnelle Exploration verschiedener visueller Stile.

- Produktmanager oder Gründer ohne Design-Hintergrund.

Funktion 5: Auto Screen – Intelligente Seitenfortführung

Wenn Sie eine Login-Seite entworfen haben, kann Stitch automatisch die nächste logische Seite im Nutzerfluss ableiten und generieren.

Beispiele:

- Login-Seite → Automatische Generierung der Startseite

- Produktliste → Automatische Generierung der Produktdetailseite

- Warenkorb → Automatische Generierung der Checkout-Seite

Diese Funktion beschleunigt das Prototyping von Multi-Page-Anwendungen erheblich und ermöglicht den schnellen Aufbau vollständiger Nutzerpfade.

💡 Entwicklungshinweis: Wenn die von Stitch generierten Frontends eine Anbindung an KI-Backend-Funktionen benötigen (z. B. intelligente Empfehlungen oder Inhaltsgenerierung), können Sie über den API-Proxy-Dienst APIYI (apiyi.com) schnell die APIs von Modellen wie Gemini oder GPT-4o einbinden, um KI-Anwendungsprototypen mit integriertem Frontend und Backend zu realisieren.

Vergleich und Nutzungsempfehlungen für die beiden Google Stitch-Modi

Stitch bietet zwei Generierungsmodi mit jeweils eigenen Stärken. Die Wahl des richtigen Modus kann Ihre Produktivität verdoppeln.

Detaillierter Vergleich: Standard vs. Experimental Modus

| Vergleichsdimension | Standard-Modus | Experimental-Modus |

|---|---|---|

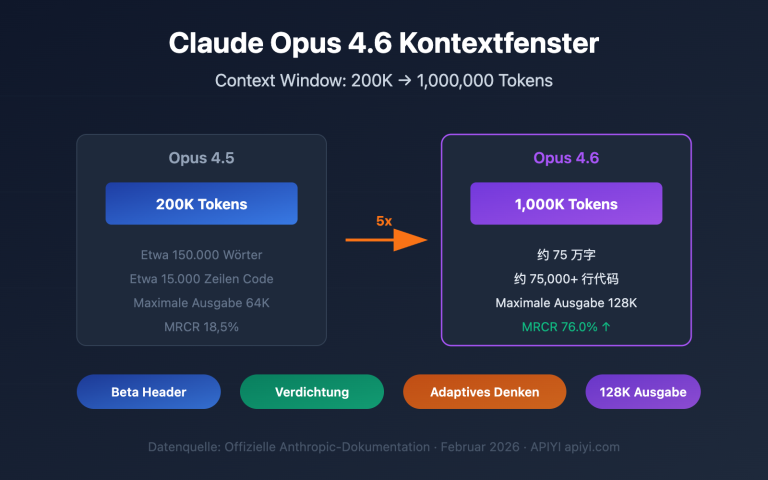

| Großes Sprachmodell | Gemini 2.5 Flash | Gemini 2.5 Pro |

| Generierungsgeschwindigkeit | Schnell (2-5 Sek.) | Langsamer (5-15 Sek.) |

| Monatliches Limit | 350 Anfragen | 50-200 Anfragen |

| Ausgabequalität | Gut, ideal für schnelle Iterationen | Höhere Wiedergabetreue, detailreicher |

| Bildeingabe | ❌ Nicht unterstützt | ✅ Unterstützt |

| Figma-Export | ✅ Unterstützt (Auto Layout) | ❌ Nicht unterstützt |

| Code-Export | ✅ HTML/CSS | ✅ HTML/CSS |

| Einsatzszenarien | Tägliche schnelle Prototypen, viele Iterationen | Wichtige Präsentationen, finale Entwürfe |

Nutzungsempfehlungen

Empfohlener Workflow:

- Erkundungsphase: Nutzen Sie den Standard-Modus, um schnell verschiedene Richtungen auszuprobieren (geringer Verbrauch, hohe Geschwindigkeit).

- Nach Richtungsbestätigung: Wechseln Sie in den Experimental-Modus, um eine hochauflösende Version zu generieren.

- Für Feinabstimmungen: Exportieren Sie das Ergebnis nach Figma für pixelgenaue Anpassungen.

- Backend-Logik hinzufügen: Exportieren Sie den Code nach Google AI Studio oder Antigravity.

🚀 Effizienz-Tipp: Wenn Sie in Stitch einen UI-Prototyp für eine KI-Anwendung erstellt haben und diesen mit echter KI-Backend-Funktionalität verbinden möchten, empfehlen wir die einheitliche API-Schnittstelle von APIYI (apiyi.com). Die Plattform unterstützt führende Modelle wie Gemini, Claude und GPT. Sie müssen sich nicht bei jedem Anbieter einzeln registrieren und können die Integration in nur 5 Minuten abschließen.

Google Stitch Schnellstart: Den ersten UI-Prototyp von Grund auf erstellen

Im Folgenden zeigen wir Ihnen anhand eines vollständigen Beispiels, wie Sie mit Stitch von Null an einen UI-Prototyp für eine KI-Chat-Anwendung erstellen.

Schritt 1: Zugriff und Anmeldung

- Öffnen Sie Ihren Browser und besuchen Sie

stitch.withgoogle.com. - Melden Sie sich mit Ihrem Google-Konto an.

- Wählen Sie nach dem Aufrufen der Hauptoberfläche den Standard-Modus, um zu beginnen.

Schritt 2: Eingabeaufforderung für den ersten Screen

Geben Sie die folgende Beschreibung in das Eingabefeld ein:

Design a mobile AI chat application with:

- Dark theme with gradient background

- Top bar showing AI model name and status

- Chat message list with user and AI bubbles

- Bottom input bar with send button and attachment icon

- Smooth, modern design inspired by ChatGPT

Warten Sie 2-5 Sekunden, und Stitch generiert die vollständige Chat-Oberfläche.

Schritt 3: Iterative Optimierung

Wenn Sie mit dem Ergebnis nicht zufrieden sind, können Sie weitere Optimierungsanweisungen eingeben:

Add a sidebar with conversation history list,

and make the AI response bubbles have a subtle

blue gradient background

Stitch unterstützt inkrementelle Änderungen am bestehenden Design, ohne dass Sie von vorne beginnen müssen.

Schritt 4: Verknüpfte Seiten generieren

Klicken Sie auf die Schaltfläche "Nächsten Screen generieren", woraufhin Stitch automatisch Folgendes ableitet und erstellt:

- Einstellungsseite (Modellauswahl, Themenwechsel)

- Verlauf der Unterhaltungen

- Benutzerprofilseite

Schritt 5: Seiten verbinden und Prototyp erstellen

Verwenden Sie die Stitch-Funktion (das namensgebende Kernfeature des Tools), um mehrere Seiten miteinander zu verknüpfen:

- Wählen Sie eine Schaltfläche oder einen anklickbaren Bereich auf der Seite aus.

- Verknüpfen Sie diesen mit der entsprechenden Zielseite.

- Klicken Sie auf die Play-Schaltfläche, um den interaktiven Prototyp in der Vorschau zu sehen.

Schritt 6: Ergebnisse exportieren

| Exportmethode | Format | Einsatzszenario |

|---|---|---|

| Code-Export | HTML/CSS | Direkte Nutzung durch Entwickler oder Weiterentwicklung |

| Figma-Export | Figma-Datei (inkl. Auto Layout) | Feinabstimmung durch Designer |

| AI Studio | Projektimport | Hinzufügen von API- und Backend-Logik |

| Antigravity | IDE-Integration | Full-Stack-Entwicklung im Google-Ökosystem |

🎯 Praxistipp: Wenn Sie nach der Erstellung eines KI-App-Prototyps die Backend-KI-Dialogfunktion schnell validieren möchten, können Sie über APIYI (apiyi.com) ein kostenloses Testguthaben erhalten. Mit nur wenigen Zeilen Code können Sie die Dialog-Schnittstellen von Modellen wie Gemini oder Claude anbinden.

Minimalistisches Code-Beispiel: Anbindung eines KI-Backends an die Stitch-Oberfläche

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI einheitliche Schnittstelle

)

# KI-Dialogfunktion für die in Stitch generierte Chat-Oberfläche anbinden

response = client.chat.completions.create(

model="gemini-2.5-flash",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Hello, introduce yourself!"}

]

)

print(response.choices[0].message.content)

Vollständigen Frontend-Backend-Integrationscode anzeigen

import openai

from flask import Flask, request, jsonify, send_file

app = Flask(__name__)

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI einheitliche Schnittstelle

)

@app.route("/")

def index():

# Laden der von Stitch exportierten HTML-Datei

return send_file("stitch_export.html")

@app.route("/api/chat", methods=["POST"])

def chat():

user_message = request.json.get("message", "")

history = request.json.get("history", [])

messages = [{"role": "system", "content": "You are a helpful AI assistant."}]

messages.extend(history)

messages.append({"role": "user", "content": user_message})

response = client.chat.completions.create(

model="gemini-2.5-flash",

messages=messages,

stream=False

)

return jsonify({

"reply": response.choices[0].message.content,

"model": response.model,

"usage": {

"prompt_tokens": response.usage.prompt_tokens,

"completion_tokens": response.usage.completion_tokens

}

})

if __name__ == "__main__":

app.run(port=5000, debug=True)

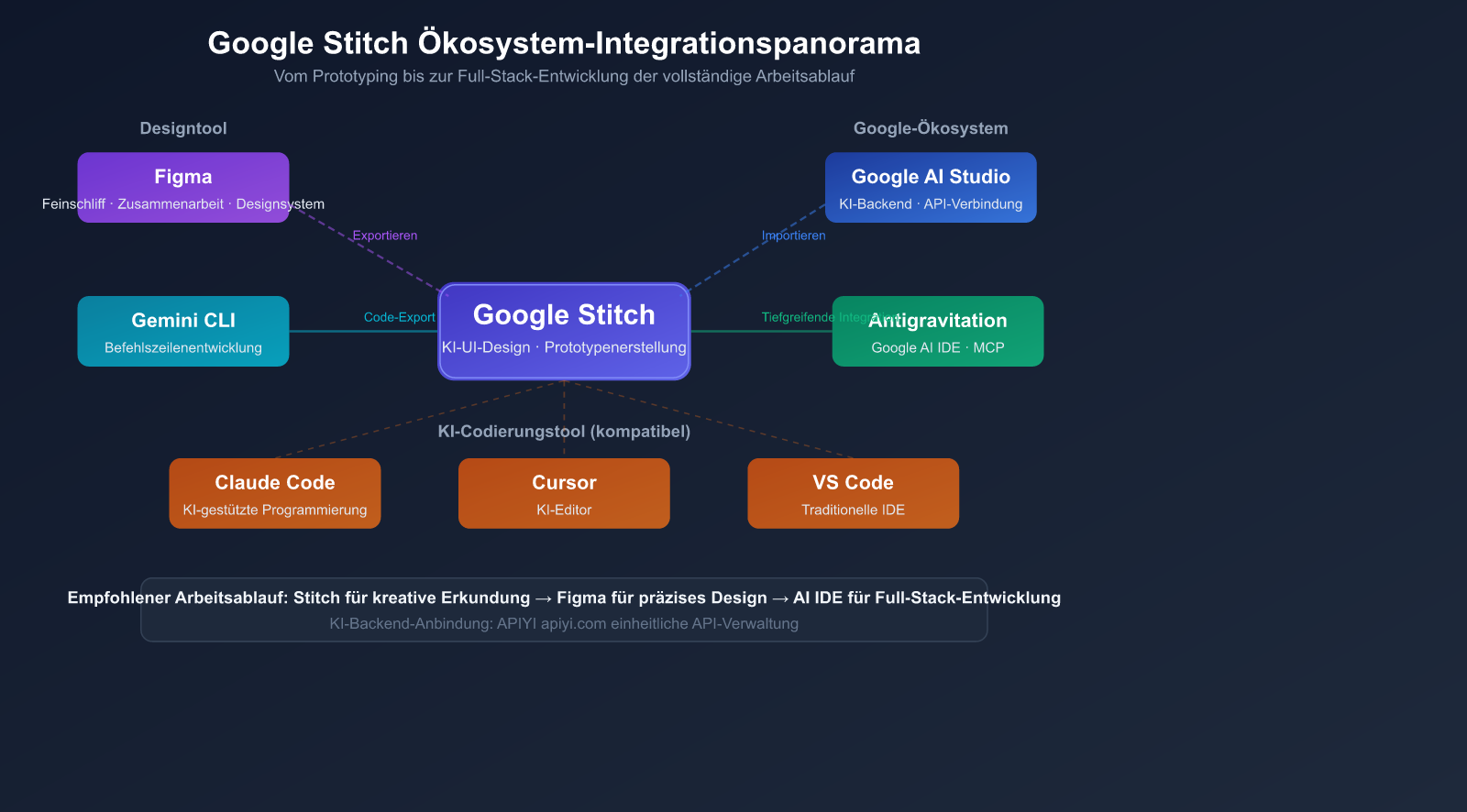

Google Stitch Ökosystem-Integration und Workflows

Stitch ist kein isoliertes Werkzeug, sondern tief in das KI-Entwicklungsökosystem von Google integriert.

Integration mit Entwicklungstools

| Tool | Integrationsmethode | Hauptzweck |

|---|---|---|

| Figma | Direkter Export | UI-Feinabstimmung und Team-Kollaboration |

| Google AI Studio | Projektimport | Hinzufügen von KI-Backend-Logik und API-Verbindungen |

| Antigravity | Tiefe MCP-Server-Integration | Full-Stack-Entwicklung mit Google AI IDE |

| Gemini CLI | Nutzung nach Code-Export | Entwicklung in der Befehlszeilenumgebung |

| Claude Code | Kompatibel | KI-gestützte Codierungsumgebung |

| Cursor | Kompatibel | KI-Editor-Umgebung |

Empfohlener Workflow: Von der Idee zum Produkt

Ideenfindung → Stitch Prototyping → Figma-Design-Feinschliff → Implementierung mit Dev-Tools

│ │ │ │

│ Text-/Bild-/Spracheingabe Export als Figma-Datei Export als HTML/CSS

│ │ │ │

└──────────────┴────────────────┴──── Anbindung KI-Backend-API

Phasenbeschreibung:

- Kreativphase (Stitch): Schnelle Validierung mehrerer Designrichtungen, Ergebnisse in 2-5 Sekunden pro Entwurf.

- Designphase (Figma): Aufbau eines Design-Systems, pixelgenaue Feinabstimmung und kollaborative Überprüfung im Team.

- Entwicklungsphase: Nutzung des exportierten Codes als Grundlage für die Implementierung.

- KI-Integration: Bei Bedarf an KI-Backend-Funktionen erfolgt die schnelle Anbindung über eine einheitliche API.

💰 Kostentipp: Stitch selbst ist komplett kostenlos. Wenn Ihre Anwendung für das KI-Backend mehrere Modelle wie Gemini, GPT-4o oder Claude benötigt, können Sie diese über die Plattform APIYI (apiyi.com) zentral verwalten. Dies erspart Ihnen die separate Registrierung und Aufladung bei verschiedenen Anbietern und senkt die Entwicklungs- und Betriebskosten.

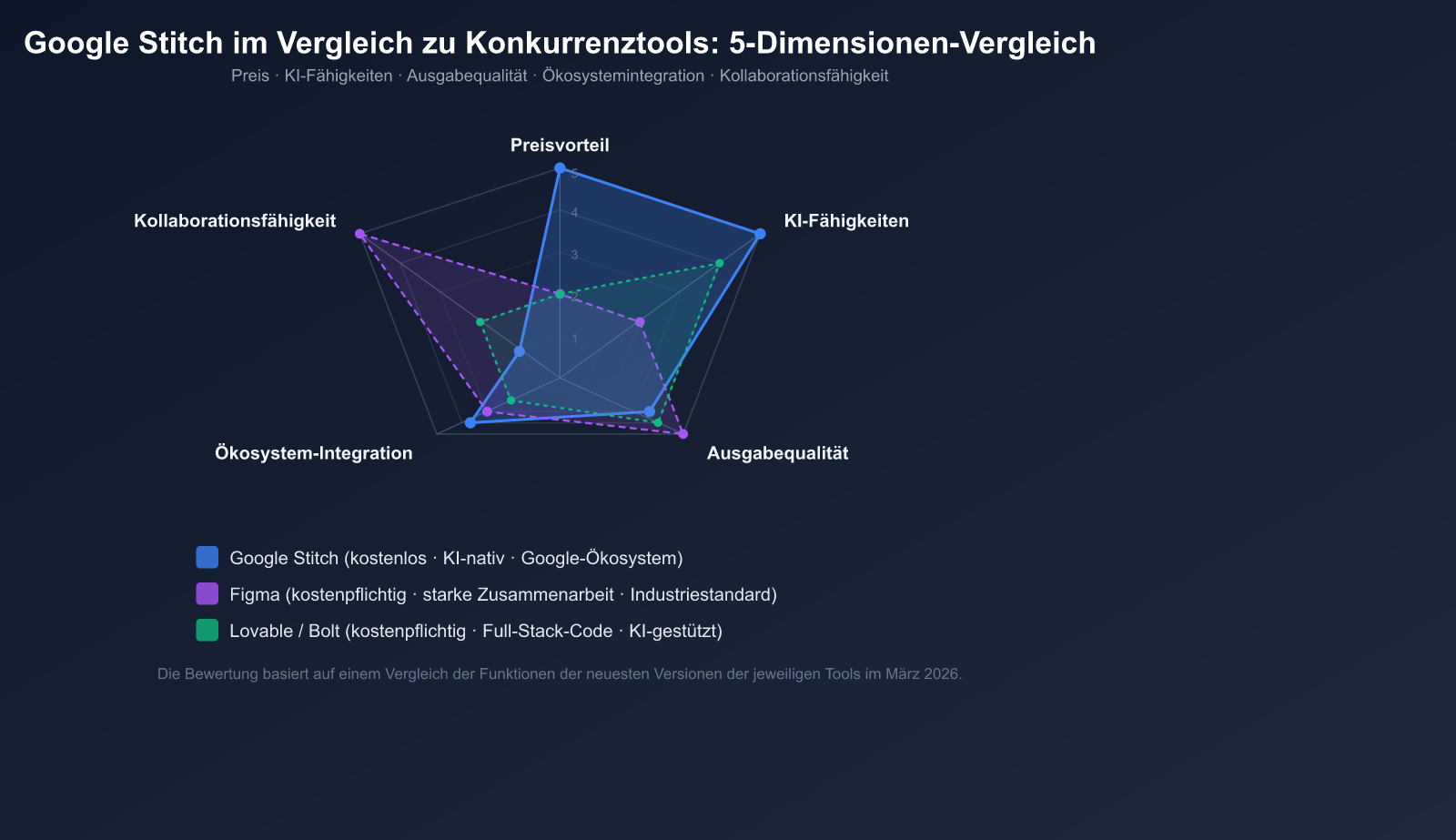

Vergleich von Google Stitch mit ähnlichen Tools

Als neuer Akteur im Bereich KI-Design: Welche Vor- und Nachteile bietet Stitch im Vergleich zu bestehenden Werkzeugen?

Multidimensionaler Vergleich

| Dimension | Google Stitch | Figma | Lovable | Bolt | UX Pilot |

|---|---|---|---|---|---|

| Preis | Kostenlos | Kostenpflichtig | $20+/Monat | $25+/Monat | $15/Monat |

| KI-Generierung | Kernfunktion | Zusatzfunktion | Kernfunktion | Kernfunktion | Kernfunktion |

| Eingabemethode | Text/Bild/Sprache/Skizze | Manuelles Design | Text | Text | Text/Wireframe |

| Code-Ausgabe | HTML/CSS | Erfordert Plugin | Full-Stack-Code | Full-Stack-Code | Vorhanden |

| Design-System | ❌ Nein | ✅ Industriestandard | Begrenzt | Begrenzt | ✅ Unterstützt |

| Zusammenarbeit | ❌ Nicht unterstützt | ✅ Echtzeit | Begrenzt | Begrenzt | ✅ Unterstützt |

| Prototyping | KI-gestützte Verknüpfung | Manuelle Einrichtung | Vollständige App | Vollständige App | Unterstützt |

| Reifegrad | Experimentell | Produktionsreif | In Entwicklung | In Entwicklung | Ausgereift |

Wann Sie sich für Stitch entscheiden sollten

Szenarien, in denen Stitch geeignet ist:

- Sehr frühe Projektphase, in der schnell verschiedene UI-Richtungen validiert werden müssen

- Nicht-Designer müssen Entwürfe erstellen (Produktmanager, Entwickler, Gründer)

- Begrenztes Budget, keine Kosten für Design-Tools erwünscht

- Integration in das Google-Ökosystem ist bereits vorhanden

- Schnelle Digitalisierung von handgezeichneten Skizzen erforderlich

Szenarien, in denen Stitch weniger geeignet ist:

- Aufbau und Pflege eines umfassenden Design-Systems

- Echtzeit-Zusammenarbeit im Team am Design

- Erstellung von Full-Stack-Anwendungen mit Backend

- Hohe Anforderungen an Design-Präzision (Brand-Design, pixelgenaue Umsetzung)

Tipps und Best Practices für Google Stitch

6 Tipps für das Schreiben von Eingabeaufforderungen

- Plattform angeben: Legen Sie fest, ob es sich um Mobile oder Web handelt, da dies das gesamte Layout beeinflusst.

- Farbschema beschreiben: Geben Sie konkrete Farbpräferenzen oder Referenzmarken an.

- Interaktionen erläutern: Beschreiben Sie wichtige Interaktionsverhalten und Benutzerabläufe.

- Schrittweise Iteration: Erstellen Sie zuerst den groben Rahmen und verfeinern Sie diesen schrittweise.

- Englisch verwenden: Eingabeaufforderungen auf Englisch liefern meist bessere Ergebnisse.

- Wettbewerber als Referenz: Nutzen Sie Formulierungen wie „inspiriert von [Produktname]“, um den gewünschten Stil zu vermitteln.

Häufige Fehler vermeiden

- Inkonsistente Ergebnisse: Dieselbe Eingabeaufforderung kann zu unterschiedlichen Ergebnissen führen. Speichern Sie zufriedenstellende Versionen, bevor Sie weiter iterieren.

- Komponenten-Fehlausrichtung: Bei komplexen Layouts kann es zu Ausrichtungsproblemen kommen. Korrigieren Sie diese nach dem Export in Figma manuell.

- Farbabweichungen: Markenfarben sind möglicherweise nicht präzise genug. Geben Sie daher spezifische Farbcodes direkt in der Eingabeaufforderung an.

- Kontingent erschöpft: Verteilen Sie die Nutzung von Standard- und Experimental-Modi sinnvoll.

🎯 Profi-Tipp: Wenn Sie mit Stitch schnell UI-Konzepte validiert haben und für eine Prototyp-Demo echte KI-Funktionen integrieren möchten, bietet APIYI (apiyi.com) sofort einsatzbereite API-Schnittstellen. Diese unterstützen über 200 gängige Modelle, einschließlich der Gemini-Serie, und ermöglichen es Ihnen, die Ergebnisse verschiedener Modelle über eine einheitliche Schnittstelle schnell zu vergleichen und zu wechseln.

Häufig gestellte Fragen

Q1: Ist Google Stitch kostenpflichtig? Gibt es Nutzungseinschränkungen?

Google Stitch ist derzeit komplett kostenlos und erfordert lediglich ein Google-Konto. Die Nutzungseinschränkungen beziehen sich hauptsächlich auf die monatliche Anzahl der Generierungen: 350 Generierungen pro Monat im Standard-Modus und 50–200 im Experimental-Modus. Es gibt derzeit keine Ankündigungen zu kostenpflichtigen Plänen, aber da es sich um ein Google Labs-Experiment handelt, könnten sich die Richtlinien in Zukunft ändern.

Q2: Wie ist die Qualität des von Stitch generierten Codes? Kann er direkt in der Produktion verwendet werden?

Der von Stitch generierte HTML/CSS-Code ist semantisch korrekt und klar strukturiert, was ihn zu einem guten Ausgangspunkt für die Entwicklung macht. Für die Produktionsumgebung sind jedoch meist weitere Optimierungen erforderlich, wie z. B. Responsive Design, Interaktionslogik und Zustandsverwaltung. Es empfiehlt sich, die Ausgabe von Stitch als Frontend-Grundgerüst zu nutzen und darauf aufzubauen. Wenn Sie Backend-Funktionen von KI-Modellen benötigen, können Sie diese über die Plattform APIYI (apiyi.com) schnell integrieren, um beispielsweise APIs von Gemini oder Claude einzubinden.

Q3: Unterstützt Stitch die Generierung von React/Vue-Komponentencode?

Derzeit unterstützt Stitch nur den Export von nativem HTML/CSS-Code; Framework-Formate wie React oder Vue werden noch nicht unterstützt. Laut Community-Informationen könnte die Unterstützung für Frameworks jedoch in zukünftigen Updates hinzugefügt werden. Die aktuelle Alternative besteht darin, das HTML/CSS zu exportieren und es mithilfe von KI-Codierungstools (wie Claude Code oder Cursor) in Framework-Komponenten umzuwandeln.

Q4: Wie kann ich die monatlichen kostenlosen Generierungen optimal nutzen?

Empfohlene Strategie: Nutzen Sie zuerst den Standard-Modus (350/Monat), um schnell verschiedene Richtungen zu erkunden. Sobald das Design feststeht, verwenden Sie den Experimental-Modus (50–200/Monat), um High-Fidelity-Versionen zu erstellen. Nutzen Sie zudem die Branch-Funktion, um verschiedene Designversionen zu speichern, ohne zusätzliche Kontingente zu verbrauchen. Für die Validierung von KI-Backend-Funktionen können Sie bei APIYI (apiyi.com) kostenlose Testguthaben für Prototyp-Tests erhalten.

Q5: Was ist der grundlegende Unterschied zwischen Stitch und Tools wie Lovable oder Bolt?

Der größte Unterschied liegt in der Ausrichtung: Lovable und Bolt zielen darauf ab, lauffähige Full-Stack-Anwendungen (inklusive Backend-Logik) zu generieren, während sich Stitch auf die schnelle Erstellung von UI-Prototypen konzentriert. Die Stärken von Stitch liegen in der Kostenlosigkeit, der multimodalen Eingabe (Text, Bild, Sprache) und der tiefen Integration in das Google-Ökosystem. Die Stärken von Lovable/Bolt liegen darin, dass sie direkt vollständige Anwendungen inklusive Datenbanken und APIs erstellen können. Die Wahl hängt davon ab, ob Sie einen „UI-Prototyp“ oder eine „vollständige Anwendung“ benötigen.

Zusammenfassung: Der Kernwert und die Anwendungsbereiche von Google Stitch

Google Stitch nutzt die Leistungsfähigkeit der Gemini-Großen Sprachmodelle, um die Hürden für UI-Design auf ein beispielloses Minimum zu senken. Die fünf KI-Kernfunktionen – Text-zu-UI, Bild-zu-UI, Voice Canvas, Vibe Design und Auto Screen – decken den gesamten Prozess von der kreativen Konzeption bis zur Prototypenvalidierung ab.

Die 3 idealen Nutzergruppen:

- Produktmanager und Gründer: Erstellen Sie schnell Prototypen ohne Design-Vorkenntnisse, um Produktideen zu validieren.

- Entwickler: Erhalten Sie zügig UI-Grundgerüste als Code und überspringen Sie die zeitaufwendige Phase des manuellen Designs.

- Designer: Erkunden Sie schnell verschiedene Designrichtungen und beschleunigen Sie die kreative Ideenfindung in der Anfangsphase.

Wir empfehlen, die mit Stitch erstellten UI-Prototypen über APIYI (apiyi.com) schnell mit KI-Backend-Funktionen zu verknüpfen, um einen vollständigen Validierungskreislauf vom Design bis zur Funktionalität zu realisieren.

Referenzen

-

Google Stitch Website: Produkt-Homepage und Zugang zum Tool

- Link:

stitch.withgoogle.com

- Link:

-

Google Developers Blog: Ankündigung und technische Details zu Stitch

- Link:

developers.googleblog.com

- Link:

-

Google Blog: Produkteinführung und Änderungsprotokoll zu Stitch

- Link:

blog.google

- Link:

Autor: APIYI Team | Für weitere Tipps zur Nutzung von KI-Modellen besuchen Sie APIYI unter apiyi.com, um technischen Support und kostenlose Testguthaben zu erhalten.