Der Sektor für KI-Short-Dramas boomt gerade. Von der Adaption von Web-Roman-IPs bis hin zur Distribution auf Kurzvideo-Plattformen sind Tools, die Textinhalte schnell in visuelle Kurzfilme verwandeln können, für Content-Ersteller unverzichtbar geworden.

Toonflow ist ein Open-Source-Tool zur automatisierten Erstellung von KI-Short-Dramas und Manga-Videos, das von HBAI Ltd entwickelt und auf GitHub unter der AGPL-3.0-Lizenz veröffentlicht wurde. Seine Kernkompetenz liegt darin, Roman- oder Skripttexte durch KI-Automatisierung den gesamten Prozess von der Charakter-Extraktion über die Skript-Generierung und das Storyboarding bis hin zur Videosynthese durchlaufen zu lassen.

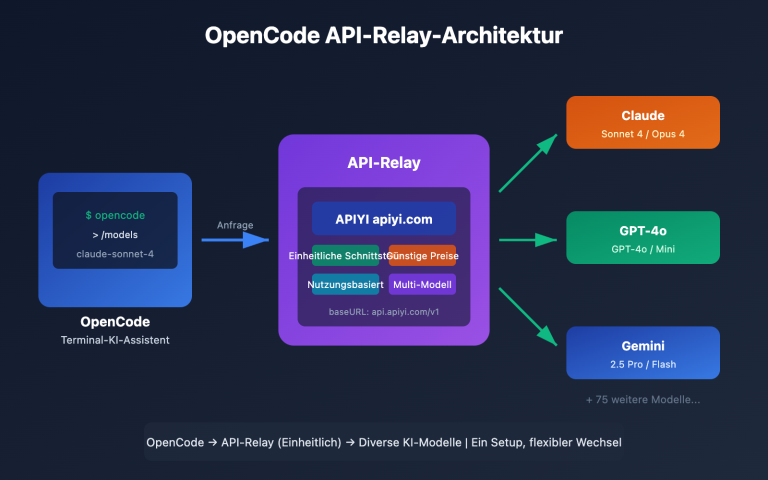

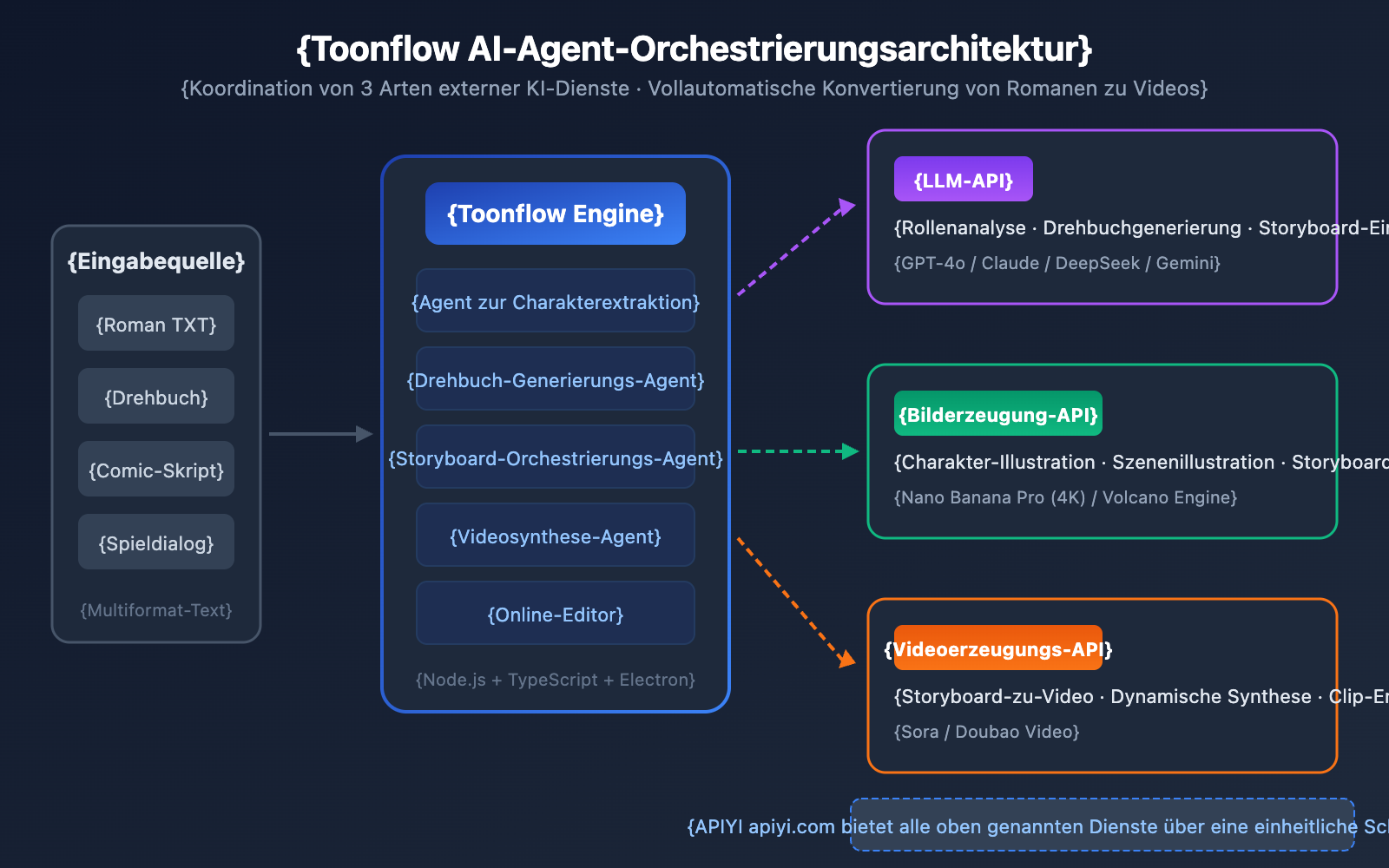

Toonflow selbst verfügt über keine integrierten KI-Modelle, sondern fungiert als KI-Agent-Orchestrierungs-Engine, die drei Arten von externen KI-Diensten koordiniert:

| KI-Diensttyp | Verwendungszweck | Empfohlene Modelle |

|---|---|---|

| Großes Sprachmodell (LLM) | Charakteranalyse, Skriptgenerierung, Storyboard-Eingabeaufforderungen | GPT-4o, Claude 3.5 Sonnet etc. |

| Bilderzeugungsmodell | Charakterdesign, Szenenillustrationen, Storyboard-Bilder | Nano Banana Pro |

| Videogenerierungsmodell | Storyboard-Bilder in Videoclips umwandeln | Sora, Doubao Video |

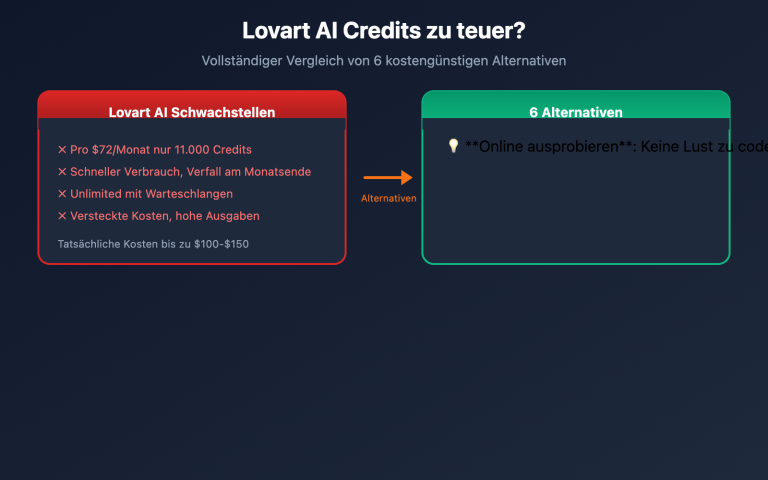

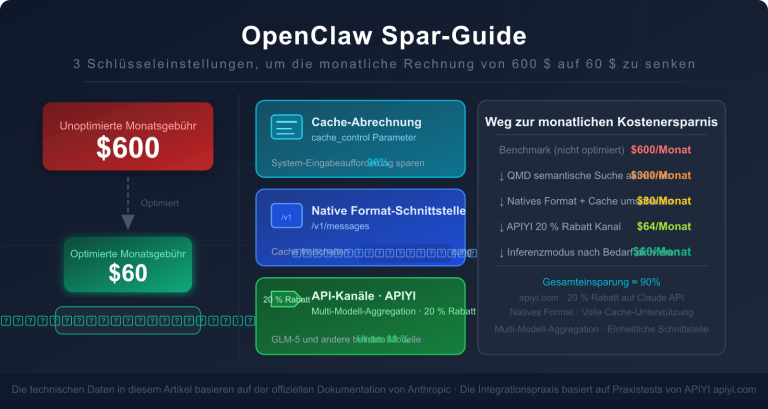

🚀 Schnellstart: Die drei für Toonflow erforderlichen API-Dienste (LLM, Bilderzeugung, Videogenerierung) können alle aus einer Hand über APIYI (apiyi.com) bezogen werden. Sie müssen sich nicht auf mehreren Plattformen registrieren und können die gesamte Konfiguration in nur 5 Minuten abschließen.

In diesem Artikel stellen wir Ihnen die Kernfunktionen von Toonflow vor und zeigen Ihnen, wie Sie das Tool installieren und die API-Dienste konfigurieren, um schnell mit der Produktion Ihrer eigenen KI-Short-Dramas zu beginnen.

Die 4 Kernfunktionen des Toonflow AI-Tools für Kurzdramen

Toonflow zerlegt den Prozess der Umwandlung von Romanen in Kurzdramen in vier automatisierte Phasen, von denen jede durch entsprechende AI-Dienste gesteuert wird:

Funktion 1: Automatische Extraktion und Generierung von AI-Charakteren

Toonflow nutzt ein Großes Sprachmodell, um den eingegebenen Romantext tiefgehend zu analysieren und Charakterinformationen automatisch zu identifizieren und zu extrahieren:

| Extraktionsdimension | Beschreibung | Beispiel |

|---|---|---|

| Äußere Merkmale | Beschreibung des Aussehens für die Charakter-Illustrationen | langes schwarzes Haar, blaue Augen, weißes Kleid |

| Persönlichkeitsmerkmale | Verhaltensmuster und psychologische Merkmale des Charakters | entschlossen und ruhig, introvertiert und sensibel |

| Identität & Hintergrund | Soziale Beziehungen und Rolle in der Geschichte | Firmen-CEO, beste Freundin der Protagonistin |

| Charakterkarte | Visualisierte Karte basierend auf den obigen Infos | Enthält Illustration + Textbeschreibung |

Die Qualität der Charakterextraktion bestimmt direkt die Gesichtskonsistenz in den folgenden Storyboard-Bildern. Toonflow nutzt strukturierte Vorlagen für die Eingabeaufforderung, um sicherzustellen, dass die LLM-Ausgabe der Charakterbeschreibung direkt als Prompt für die Bilderzeugung verwendet werden kann.

Funktion 2: Intelligente Skript- und Storyboard-Generierung

Nachdem der Benutzer die zu adaptierenden Kapitel ausgewählt hat, führt Toonflow automatisch folgende Schritte aus:

- Umwandlung von Romanabschnitten in ein strukturiertes Skript (einschließlich Dialogen, Szenenbeschreibungen und Regieanweisungen).

- Generierung von Storyboard-Prompts für jede Szene (einschließlich Vordergrund-, Mittelgrund- und Hintergrundkomposition, Charakterdynamik, Requisiten und Kamerawinkeln).

Dieser Schritt wird vollständig von einem LLM durchgeführt. Die generierten Storyboard-Eingabeaufforderungen werden direkt an das Modell zur Bilderzeugung weitergeleitet.

Funktion 3: AI-Bilderzeugung und Storyboard-Zeichnung

Toonflow sendet die Storyboard-Prompts an eine API zur Bilderzeugung, um automatisch jedes Einzelbild des Storyboards zu erstellen. Zu den derzeit unterstützten Backends für die Bilderzeugung gehören:

- Nano Banana Pro: Unterstützt 4K-Auflösung, bietet eine gute Gesichtskonsistenz und unterstützt mehrsprachiges Text-Rendering.

- Volcano Engine: Der Bilderzeugungsdienst unter der Marke Doubao.

Funktion 4: AI-Videosynthese und Online-Bearbeitung

Im letzten Schritt wandelt Toonflow die Storyboard-Bilder über eine API zur Video-Erzeugung in dynamische Videoclips um. Zudem bietet es eine Online-Bearbeitungsfunktion, mit der Benutzer die generierten Ergebnisse individuell anpassen können.

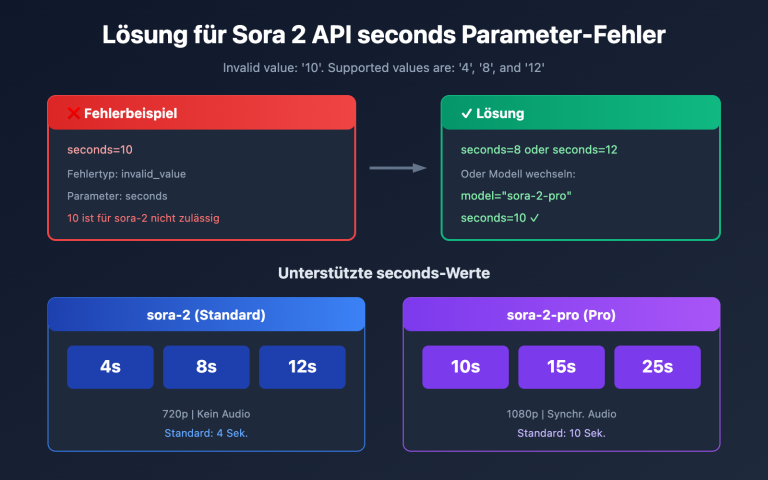

Zu den unterstützten Video-Erzeugungsdiensten gehören Sora (OpenAI) und die Doubao Video-Generierungs-API.

Toonflow Installation und Deployment: 3 Optionen nach Bedarf

Toonflow bietet drei Installationsmethoden an: Windows-Desktop-Anwendung, Docker-Deployment und manuelle Bereitstellung.

Toonflow Systemanforderungen

| Element | Mindestanforderungen |

|---|---|

| Node.js | v23.11.1 oder höher |

| Arbeitsspeicher | 2GB+ |

| Betriebssystem | Windows (Desktop-Version) / Linux (Server-Deployment) |

| Netzwerk | Zugriff auf externe KI-API-Dienste erforderlich |

Methode 1: Windows Desktop-App (Empfohlen für Anfänger)

Laden Sie das Electron-Desktop-Installationspaket direkt von den GitHub Releases herunter:

- GitHub Projekt-URL:

github.com/HBAI-Ltd/Toonflow-app - Standard-Benutzername:

admin - Standard-Passwort:

admin123

Nach dem Herunterladen und Installieren ist die App sofort einsatzbereit. Die Desktop-Version enthält bereits die Backend-Dienste, sodass keine zusätzliche Konfiguration der Laufzeitumgebung erforderlich ist.

Methode 2: Docker-Deployment (Empfohlen für Server)

# Projekt klonen

git clone https://github.com/HBAI-Ltd/Toonflow-app.git

cd Toonflow-app

# Mit Docker Compose per Ein-Klick-Befehl starten

docker-compose -f docker/docker-compose.yml up -d --build

Rufen Sie nach dem Start http://localhost:60000 auf, um zur Verwaltungsoberfläche zu gelangen.

Methode 3: Manuelle Bereitstellung (Für Entwickler geeignet)

# Abhängigkeiten installieren

yarn install

# Start im Entwicklungsmodus (nur Backend, Port 60000)

yarn dev

# Desktop-App + Backend gleichzeitig starten

yarn dev:gui

# Produktions-Build

yarn build

Bei der manuellen Bereitstellung wird die Verwendung von PM2 für das Prozessmanagement empfohlen, um einen stabilen Betrieb des Dienstes zu gewährleisten.

Toonflow API-Service-Konfiguration: Vollständiges Tutorial zur Anbindung von 3 KI-Schnittstellen

Nachdem Toonflow installiert ist, müssen die API-Schnittstellen für drei Arten von KI-Diensten konfiguriert werden, um die Anwendung nutzen zu können. Dies ist der wichtigste Schritt im gesamten Konfigurationsprozess.

🎯 Konfigurationsempfehlung: Wir empfehlen die Nutzung von APIYI (apiyi.com) als einheitlichen API-Service-Anbieter. Diese Plattform bietet eine zentrale Schnittstelle für LLM-, Bilderzeugungs- und Videoerzeugungs-APIs mit derselben base_url und Authentifizierungsmethode, was die Konfiguration von Toonflow erheblich vereinfacht.

<svg

Toonflow Workflow in der Praxis: In 5 Schritten vom Roman zum Kurzfilm

Nachdem die Konfiguration abgeschlossen ist, folgt hier der vollständige Prozess zur Erstellung eines KI-Kurzfilms mit Toonflow:

Schritt 1: Projekt erstellen und Roman importieren

Erstellen Sie in der Toonflow-Verwaltungsoberfläche ein neues Projekt und importieren Sie den Romantext (im TXT-Format). Das System unterstützt die automatische Aufteilung nach Kapiteln.

Schritt 2: KI-Charakterextraktion

Klicken Sie auf „Charaktergenerierung“. Das System ruft automatisch ein Großes Sprachmodell (LLM) auf, um den gesamten Text zu analysieren, Informationen zu den Hauptcharakteren zu extrahieren und Charakterkarten zu erstellen. Sie können die Charakterbeschreibungen manuell anpassen, um die spätere Bilderzeugung zu optimieren.

Schritt 3: Kapitel auswählen und Drehbuch generieren

Wählen Sie die zu produzierenden Kapitel aus und klicken Sie auf „Drehbuch generieren“. Das LLM wandelt die Romanabschnitte in ein strukturiertes Drehbuch mit Dialogen und Szenenanweisungen um.

Schritt 4: Storyboard-Bilderzeugung

Das System generiert basierend auf dem Drehbuch automatisch Eingabeaufforderungen (Prompts) für das Storyboard und nutzt Nano Banana Pro, um jedes Einzelbild zu erzeugen. In diesem Schritt können Sie eine Vorschau für jedes Bild anzeigen und bei Bedarf Anpassungen vornehmen.

Schritt 5: Videosynthese und Bearbeitung

Sobald Sie mit dem Storyboard zufrieden sind, werden die Video-APIs von Sora oder Doubao aufgerufen, um die statischen Bilder in dynamische Videos umzuwandeln. Toonflow bietet zudem einen Online-Editor für den finalen Feinschliff.

Toonflow Technische Architektur und Entwicklungsinformationen

| Tech-Stack | Spezifische Implementierung |

|---|---|

| Backend-Framework | Node.js + Express + TypeScript |

| Datenbank | SQLite3 (better-sqlite3) |

| KI-SDK | Vercel AI SDK, Aigne-Middleware |

| Bildverarbeitung | Sharp |

| Desktop-Anwendung | Electron |

| HTTP-Client | Axios |

| Parametervalidierung | Zod |

| Prozessmanagement | PM2 (Produktionsumgebung) |

| Containerisierung | Docker + Docker Compose |

Das Toonflow-Projekt steht unter der AGPL-3.0 Open-Source-Lizenz und ist für die persönliche sowie nicht-kommerzielle Nutzung kostenlos. Für eine kommerzielle Nutzung ist eine Lizenz von HBAI Ltd erforderlich (Kontakt-E-Mail: [email protected]).

Toonflow FAQ – Häufig gestellte Fragen

Q1: Benötigt Toonflow eine lokale GPU?

Nein. Toonflow selbst ist lediglich ein Orchestrierungstool. Alle KI-Inferenzaufgaben werden über Remote-APIs erledigt. Ihr Computer muss lediglich Node.js und einen Browser ausführen können. Sobald Sie API-Dienste über APIYI (apiyi.com) angebunden haben, müssen Sie sich keine Gedanken mehr über GPU-Ressourcen machen.

Q2: Welche Bilderzeugungsmodelle unterstützt Toonflow?

Derzeit werden hauptsächlich Nano Banana Pro und die Bilderzeugung von Volcengine unterstützt. Nano Banana Pro unterstützt Auflösungen bis zu 4K und bietet eine exzellente Gesichtskonsistenz, was es zur ersten Wahl für das Zeichnen von Storyboards in Kurzfilmen macht. Über die Plattform APIYI (apiyi.com) können Sie das Nano Banana Pro Modell direkt aufrufen.

Q3: Wie hoch sind die API-Kosten für die Produktion einer Kurzfilm-Episode etwa?

Die Kosten hängen von der Länge des Kapitels und der Anzahl der Storyboards ab. Im Allgemeinen gilt:

- LLM-Aufruf (Charakteranalyse + Skript + Storyboard-Eingabeaufforderung): ca. $0,5–2

- Bilderzeugung (20–50 Storyboards): ca. $1–5

- Videoerzeugung (20–50 Segmente): ca. $10–50

Die Videoerzeugung stellt den Hauptkostenfaktor dar. Wir empfehlen, die Ausgaben durch die flexiblen Abrechnungsmodelle von APIYI (apiyi.com) zu optimieren.

Q4: Gibt es eine Roadmap für Toonflow?

Das Projekt plant die folgenden Funktionen:

- Prompt-Refinement-Agent (Intelligente Optimierung von Video-Eingabeaufforderungen)

- Unterstützung für verschiedene Textformate (Comic-Skripte, Dialoge in Spielen usw.)

- Verwaltung von Charakter-Outfits und Requisiten (Konsistenz über lange Zeiträume)

- Aufgabenwarteschlange für die Stapelverarbeitung

- Ein-Klick-Vorlagen für Stilkonvertierungen

Fazit zum Toonflow AI-Kurzfilm-Tool

Toonflow bietet eine vollständige Automatisierungslösung für die Produktion von AI-Kurzfilmen und vereinfacht den Prozess von der Romanvorlage zum fertigen Kurzfilm in eine KI-Pipeline. Der Kernwert liegt in:

- Vollständige Automatisierung des Workflows: Charakterextraktion → Skriptgenerierung → Storyboard-Zeichnung → Videosynthese – alles aus einer Hand.

- Open Source und kostenlos: AGPL-3.0-Lizenz, keine Kosten für die persönliche Nutzung.

- Flexibles KI-Backend: Unterstützt verschiedene LLMs sowie Modelle zur Bilderzeugung und Videoerzeugung, ohne Bindung an einen bestimmten Anbieter.

- Vielfältige Bereitstellungsoptionen: Desktop-Anwendung, Docker oder manuelle Installation, passend für unterschiedliche Einsatzszenarien.

Wir empfehlen, alle für Toonflow benötigten KI-API-Dienste zentral über APIYI (apiyi.com) zu beziehen. Mit einer einheitlichen Schnittstelle und Abrechnung können Sie die Konfiguration schnell abschließen und direkt mit der Erstellung beginnen.

Referenzen

-

Toonflow GitHub-Repository: Offizielles Open-Source-Projekt

- Link:

github.com/HBAI-Ltd/Toonflow-app - Beschreibung: Enthält Quellcode, Installationsdokumentation und Releases

- Link:

-

Toonflow Gitee-Mirror: Beschleunigter Zugriff in China

- Link:

gitee.com/HBAI-Ltd/Toonflow-app - Beschreibung: Optimiert für chinesische Netzwerkumgebungen

- Link:

-

Offizielle APIYI-Dokumentation: Leitfaden für den Zugriff auf AI-API-Dienste

- Link:

help.apiyi.com - Beschreibung: Tutorials zur Nutzung von APIs für Große Sprachmodelle (LLM), Bilderzeugung und Videoerzeugung

- Link:

Dieser Artikel wurde vom APIYI-Technikteam verfasst. Wir konzentrieren uns auf die Anwendung und Entwicklungspraxis von Großen Sprachmodellen. Weitere technische Tutorials finden Sie bei APIYI unter apiyi.com.