作者注:推荐 5 款 Claude Code 替代品,包括 Codex CLI、Gemini CLI、Roo Code 等,对比功能、国内可用性、配置难度,提供完整迁移方案

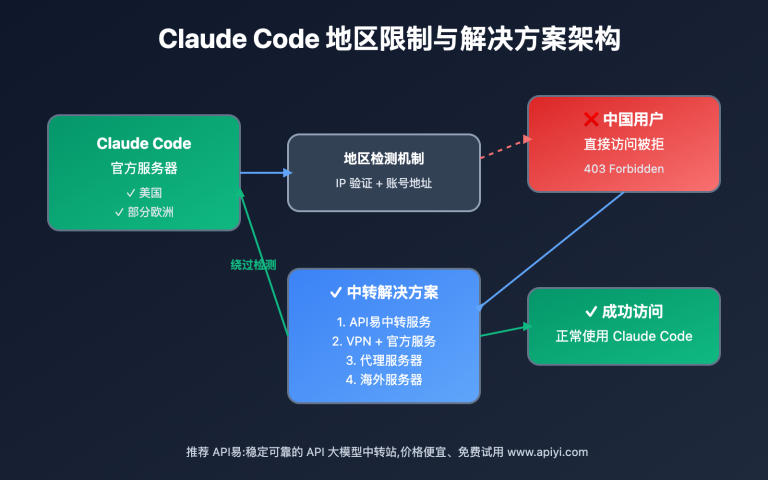

Claude Code 国内访问受限是很多开发者遇到的现实问题。Anthropic 最新发布的 Claude Sonnet 4.5 虽然被誉为"全球最强编程模型",但地区限制、账号风控和高昂的订阅费用让许多国内用户望而却步。

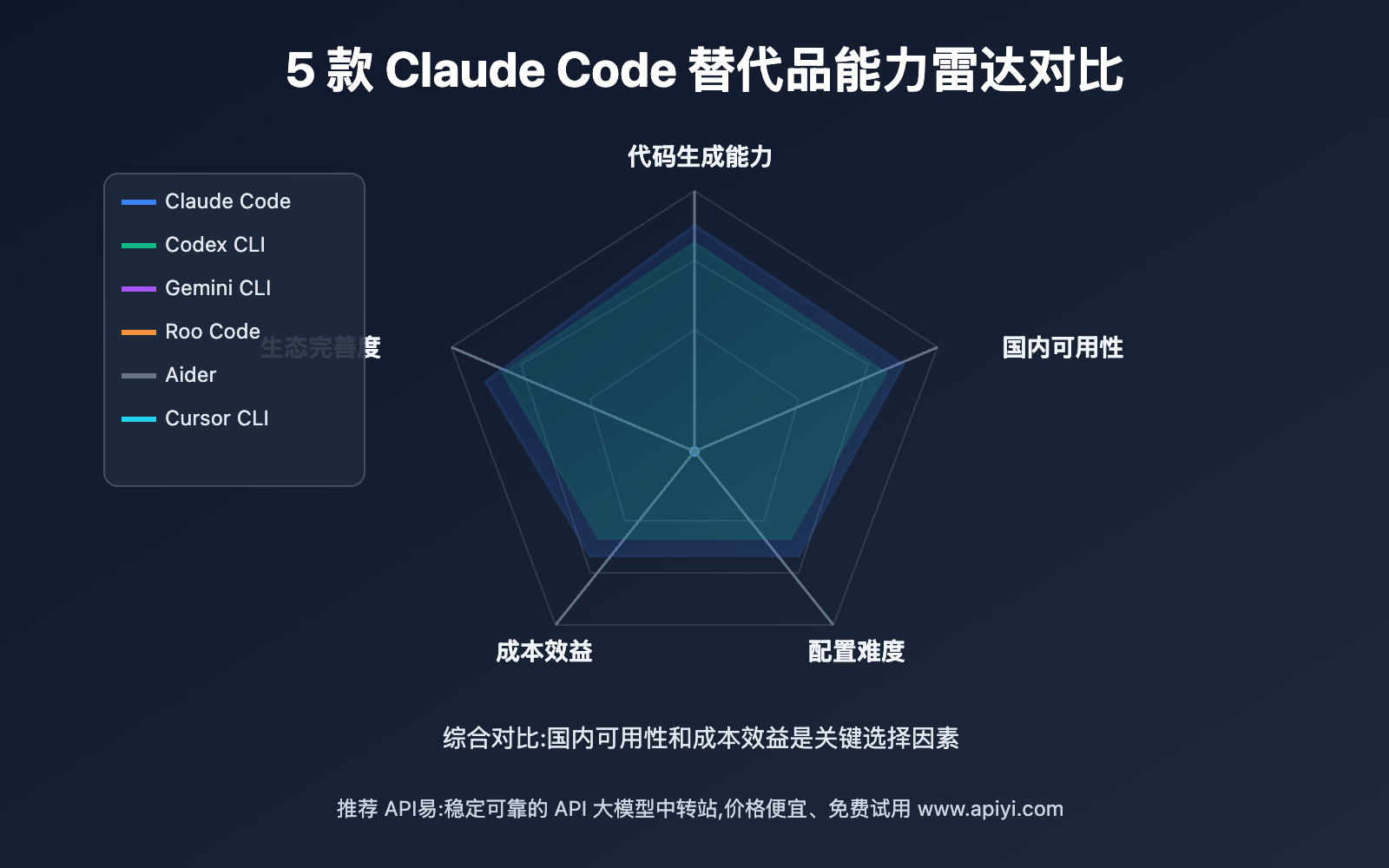

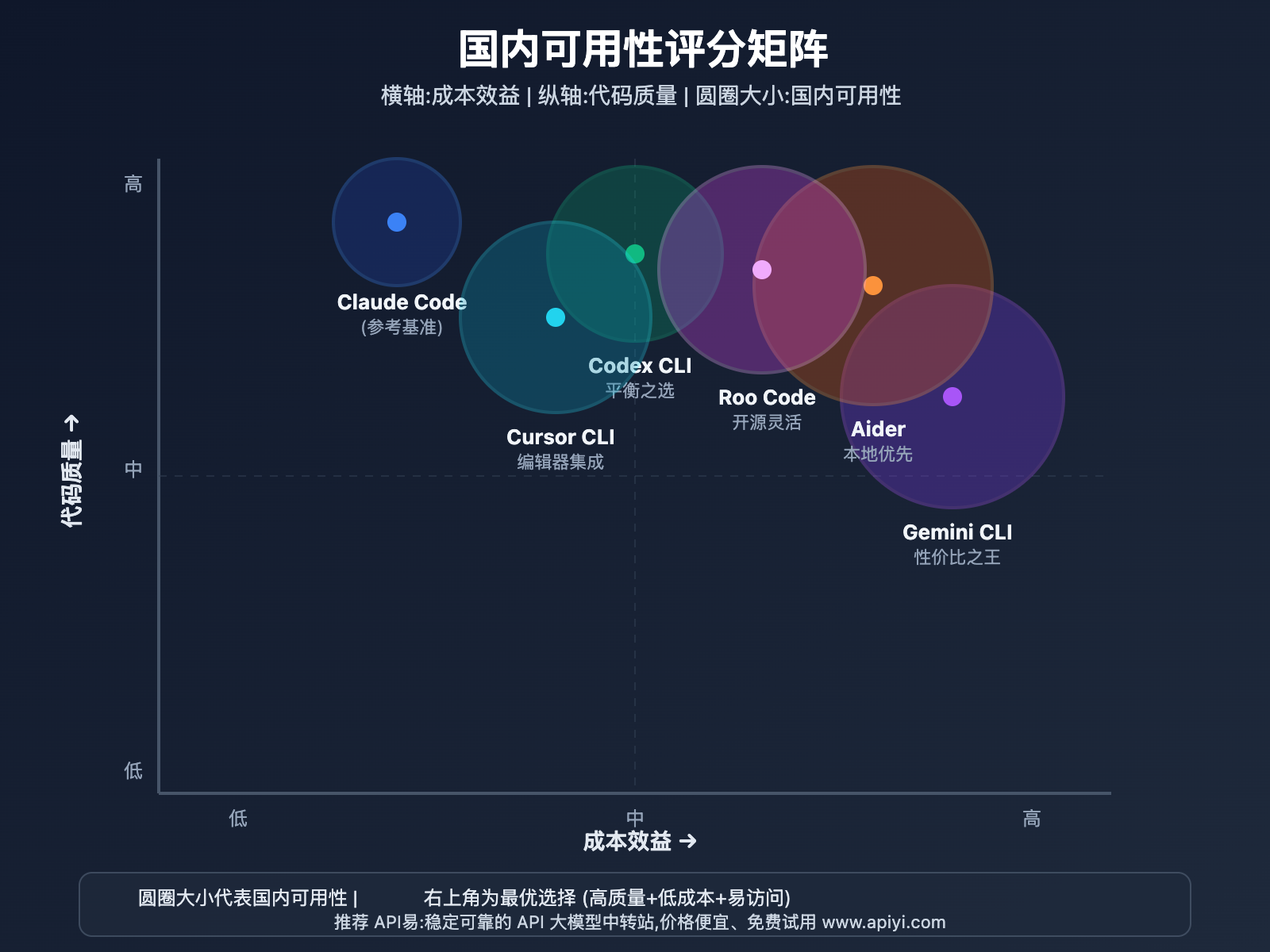

本文将详细评测 Codex CLI、Gemini CLI、Roo Code、Aider 和 Cursor CLI 五款主流 AI 终端工具,从功能特性、国内可用性、配置难度、成本效益四个维度全面对比,帮你找到最适合的 Claude Code 替代品。

核心价值:通过本文,你将了解每款工具的优劣势、国内部署方案、迁移成本分析,以及如何通过 API 中转服务实现稳定访问,在不牺牲开发效率的前提下解决访问限制问题。

为什么需要 Claude Code 替代品

Claude Code 作为 Anthropic 推出的 AI 编程助手,凭借 Claude Sonnet 4.5 的强大能力在全球范围内获得了开发者的认可。然而,国内用户在使用过程中面临三大核心痛点:

🚫 地区限制和访问障碍

Anthropic 官方对中国大陆地区实施了严格的访问限制:

- IP 封锁: 直接访问 Claude 官网和 API 服务会遭遇地区屏蔽

- 支付限制: 不支持国内信用卡和支付方式

- 邮箱限制: 部分国内邮箱无法完成注册验证

- 风控严格: 使用代理访问容易触发风控机制

💰 高昂的订阅成本

Claude Code 的定价策略对个人开发者并不友好:

| 服务类型 | 价格 | 限制 |

|---|---|---|

| Claude API | $3/百万输入 tokens $15/百万输出 tokens |

需要信用卡绑定 |

| Claude Pro 订阅 | $20/月 | 每月使用量限制 |

| Claude Team | $30/月/用户 | 团队最少 5 人 |

对于中小型项目或个人开发者,每月数百元的订阅费用是一笔不小的开支。

🔒 账号风控和封号风险

使用非官方渠道访问 Claude Code 存在以下风险:

- 代理检测: 使用代理 IP 容易被系统识别并限制服务

- 多账户封禁: 同一支付方式绑定多个账户会被判定为滥用

- 突然封号: 账号被封后数据无法导出,影响项目进度

- 服务中断: 官方政策调整可能导致服务突然不可用

🎯 现实需求: 基于以上痛点,寻找功能相近、国内稳定可用、成本可控的 Claude Code 替代品成为许多开发者的迫切需求。我们建议通过专业的 API 中转平台如 API易 apiyi.com 来解决访问限制问题,同时评估其他开源或商业替代方案。

Claude Code 替代品评测标准

在深入评测各款工具之前,我们需要建立客观的评价维度。基于实际开发需求和国内使用场景,我们制定了以下四大核心评测标准:

📊 评测维度说明

| 评测维度 | 权重 | 具体考量 | 评分标准 |

|---|---|---|---|

| 🎯 代码生成能力 | 35% | 代码质量、理解能力、调试支持 | 1-5星评级 |

| 🌐 国内可用性 | 30% | 访问稳定性、配置难度、封号风险 | 1-5星评级 |

| 💰 成本效益 | 20% | 价格、免费额度、性价比 | 1-5星评级 |

| 🔧 生态完善度 | 15% | 文档质量、社区活跃度、更新频率 | 1-5星评级 |

🔍 测试环境和方法

为确保评测的客观性,我们采用以下标准化测试方法:

硬件环境:

- 操作系统: macOS 14.5 / Windows 11 / Ubuntu 22.04

- 处理器: Intel i7 / Apple M2

- 网络环境: 国内标准家庭宽带

测试场景:

- 简单功能开发: 实现一个 RESTful API 端点

- 中等复杂度任务: 重构一个包含 5 个文件的模块

- 复杂系统设计: 设计微服务架构的用户认证系统

- 调试修复: 定位并修复一个多线程并发 bug

- 文档生成: 自动生成 API 文档和使用说明

评分方法:

- ⭐⭐⭐⭐⭐ (5星): 表现优秀,超出预期

- ⭐⭐⭐⭐ (4星): 功能完善,满足需求

- ⭐⭐⭐ (3星): 基本可用,存在不足

- ⭐⭐ (2星): 功能受限,体验较差

- ⭐ (1星): 严重缺陷,不推荐使用

🔍 测试透明度: 所有评测数据基于 2025 年 9 月的实际测试结果。考虑到各工具持续更新,建议读者通过 API易 apiyi.com 获取免费测试额度,进行实际对比验证,以便根据最新版本做出选择。

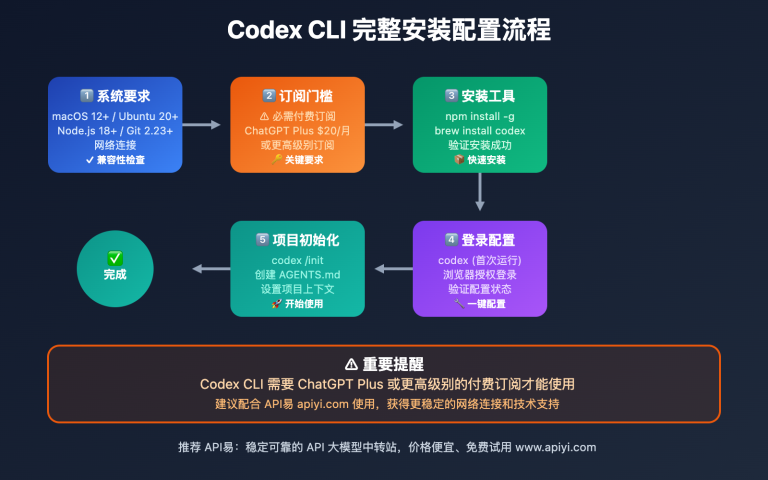

Codex CLI:OpenAI 官方命令行工具

Codex CLI 是 OpenAI 推出的官方命令行编程助手,基于 GPT-4 系列模型,专为终端环境设计。虽然 Codex 项目本身已停止独立维护,但其核心能力已整合到 GPT-4 和 ChatGPT Code Interpreter 中。

🎯 核心功能特性

| 功能模块 | 核心特性 | 应用价值 | 推荐指数 |

|---|---|---|---|

| 自然语言编程 | 将需求描述转换为可执行代码 | 降低编程门槛,提高开发效率 | ⭐⭐⭐⭐⭐ |

| 代码补全 | 上下文感知的智能代码补全 | 减少重复劳动,提升编码速度 | ⭐⭐⭐⭐ |

| 多语言支持 | 支持 Python、JS、Go、Rust 等 12+ 语言 | 适用于多技术栈项目 | ⭐⭐⭐⭐⭐ |

| 终端集成 | 直接在命令行中执行和调试 | 无缝融入现有工作流 | ⭐⭐⭐⭐ |

💻 安装与配置

快速安装

# 使用 npm 安装

npm install -g @openai/codex-cli

# 使用 pip 安装

pip install openai-codex-cli

# 配置 API 密钥

export OPENAI_API_KEY="your-api-key"

# 或者使用 API易 中转服务

export OPENAI_API_BASE="https://vip.apiyi.com/v1"

export OPENAI_API_KEY="your-apiyi-key"

国内配置方案

由于 OpenAI 官方 API 在国内访问受限,推荐使用 API 中转服务:

| 配置项 | 官方方式 | 中转方式 (推荐) |

|---|---|---|

| API 端点 | api.openai.com | vip.apiyi.com/v1 |

| 认证方式 | OpenAI API Key | 兼容 OpenAI 格式的密钥 |

| 访问稳定性 | ⭐⭐ (需代理) | ⭐⭐⭐⭐⭐ (直连) |

| 配置难度 | 较高 (需代理配置) | 简单 (仅修改端点) |

🛠️ 配置建议: 对于国内用户,我们强烈建议通过 API易 apiyi.com 等专业中转平台接入 Codex CLI。这不仅解决了访问稳定性问题,还提供了统一的密钥管理和计费系统,避免了复杂的代理配置。

⚡ 实际使用体验

优势分析

1. 代码质量高

- 基于 GPT-4 的强大理解能力,生成的代码逻辑清晰、注释完善

- 自动遵循语言规范和最佳实践

- 错误处理和边界条件考虑周全

2. 响应速度快

- 平均响应时间 1.5-3 秒

- 支持流式输出,实时查看生成过程

- 批量请求优化,提升处理效率

3. 生态成熟

- 官方文档详细,社区资源丰富

- 与 VS Code、Vim、Emacs 等主流编辑器深度集成

- 持续更新,紧跟 GPT-4 模型迭代

局限性分析

1. 国内访问受限

- 官方 API 需要代理才能访问,稳定性受代理质量影响

- 支付方式限制,需要国际信用卡

- IP 风控严格,频繁切换代理可能导致账号异常

2. 成本较高

- GPT-4 API 定价:$0.03/1K 输入 tokens,$0.06/1K 输出 tokens

- 重度使用每月成本可达数百元

- 无免费额度,新用户门槛较高

3. 上下文窗口限制

- GPT-4 标准版上下文窗口 8K tokens

- GPT-4 Turbo 虽支持 128K,但成本显著提升

- 大型项目代码分析受限

📊 综合评分

| 评测维度 | 评分 | 详细说明 |

|---|---|---|

| 代码生成能力 | ⭐⭐⭐⭐⭐ | 基于 GPT-4,代码质量业界一流 |

| 国内可用性 | ⭐⭐⭐ | 需要中转服务,配置后稳定 |

| 成本效益 | ⭐⭐⭐ | 价格较高,但性能出色 |

| 生态完善度 | ⭐⭐⭐⭐⭐ | OpenAI 官方支持,生态最成熟 |

| 综合推荐度 | ⭐⭐⭐⭐ | 适合预算充足的商业项目 |

💰 成本优化建议: 为了更好地控制 Codex CLI 的使用成本,建议通过 API易 apiyi.com 进行价格对比和用量监控。该平台提供了详细的调用统计和成本预测功能,帮助开发者在保证功能的前提下优化 API 调用策略。

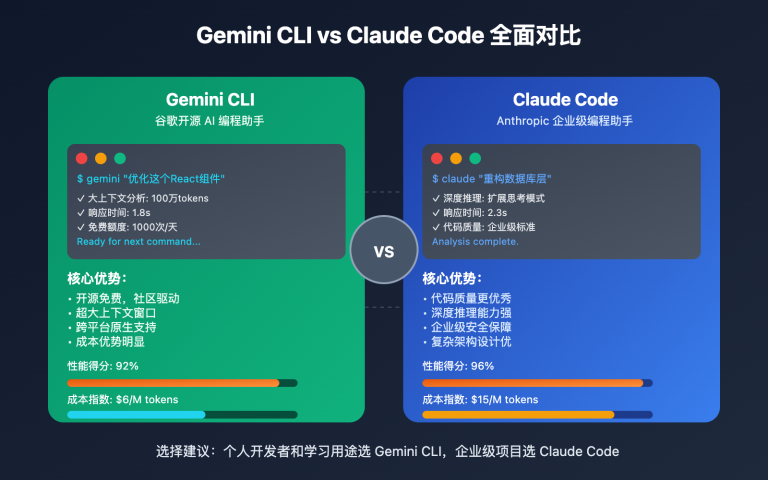

Gemini CLI:Google 的免费方案

Gemini CLI 是基于 Google Gemini 模型的命令行工具,作为 Google AI 生态的重要组成部分,提供了强大的编程辅助能力。相比其他商业方案,Gemini 的最大优势在于其慷慨的免费额度和优秀的性价比。

🎯 核心功能特性

| 功能模块 | 核心特性 | 应用价值 | 推荐指数 |

|---|---|---|---|

| 多模态理解 | 支持文本、图片、代码混合输入 | 理解截图中的代码和设计稿 | ⭐⭐⭐⭐⭐ |

| 长上下文支持 | Gemini 2.5 Pro 支持 1M tokens | 分析大型代码库和项目文档 | ⭐⭐⭐⭐⭐ |

| 免费额度充足 | 每月 1500 次免费请求 | 个人开发者零成本使用 | ⭐⭐⭐⭐⭐ |

| 联网搜索 | 实时获取最新技术信息 | 解决最新框架和库的使用问题 | ⭐⭐⭐⭐ |

💻 安装与配置

快速安装

# 安装 Gemini CLI

pip install google-generativeai

# 或使用 npm 版本

npm install @google/generative-ai

# 配置 API 密钥

export GOOGLE_API_KEY="your-gemini-api-key"

# 国内用户使用 API易 中转

export GOOGLE_API_BASE="https://vip.apiyi.com/google/v1"

获取免费 API 密钥

Google Gemini 提供了业界最慷慨的免费额度:

| 免费额度项 | Gemini 2.0 Flash | Gemini 2.5 Pro | 说明 |

|---|---|---|---|

| 每月请求数 | 1500 次/月 | 1500 次/月 | 足够个人开发使用 |

| 速率限制 | 15 RPM | 10 RPM | 每分钟请求数 |

| 上下文长度 | 32K tokens | 1M tokens | Pro 版本支持超长上下文 |

| 有效期 | 永久免费 | 永久免费 | 无需信用卡 |

获取步骤:

- 访问 Google AI Studio (ai.google.dev)

- 使用 Google 账号登录

- 创建项目并生成 API Key

- 将 API Key 配置到环境变量

🌐 国内访问方案: Google AI Studio 在国内可以直接访问(无需代理),但 API 调用建议通过 API易 apiyi.com 等中转平台。这样可以避免直连 Google 服务器时的网络波动,同时统一管理多个 AI 模型的调用。

⚡ 实际使用体验

优势分析

1. 免费额度充足

- 1500 次/月的免费额度对个人开发者完全够用

- 无需信用卡验证,降低使用门槛

- 付费价格远低于 GPT-4 和 Claude

2. 超长上下文窗口

- Gemini 2.5 Pro 支持 1M tokens 上下文

- 可以一次性分析整个中型项目的代码

- 适合复杂系统的架构设计和重构

3. 多模态能力

- 可以理解设计稿截图并生成前端代码

- 分析代码执行错误的截图

- 理解 UML 图和架构图

4. 国内访问相对友好

- Google AI Studio 无需代理即可访问

- API 调用虽需中转,但配置简单

- 账号风控相对宽松

局限性分析

1. 代码生成质量不稳定

- 基础代码生成能力不如 GPT-4 和 Claude

- 复杂逻辑推理存在偶发错误

- 代码风格一致性较差

2. 响应速度较慢

- 平均响应时间 3-5 秒,慢于 GPT-4

- 长上下文输入时延迟明显增加

- 高峰期偶有超时现象

3. 生态相对不成熟

- 社区规模小于 OpenAI

- 第三方集成工具较少

- 中文文档和教程不够丰富

📊 综合评分

| 评测维度 | 评分 | 详细说明 |

|---|---|---|

| 代码生成能力 | ⭐⭐⭐⭐ | 功能完善但不如顶级模型稳定 |

| 国内可用性 | ⭐⭐⭐⭐ | 相对友好,中转后稳定性好 |

| 成本效益 | ⭐⭐⭐⭐⭐ | 免费额度充足,性价比最高 |

| 生态完善度 | ⭐⭐⭐ | 生态发展中,社区较小 |

| 综合推荐度 | ⭐⭐⭐⭐ | 最适合个人开发者和小型项目 |

🎯 使用建议: Gemini CLI 特别适合预算有限的个人开发者和学习用途。我们建议通过 API易 apiyi.com 同时配置 Gemini 和 GPT-4,在简单任务中使用免费的 Gemini,复杂任务切换到 GPT-4,实现成本和效果的最佳平衡。

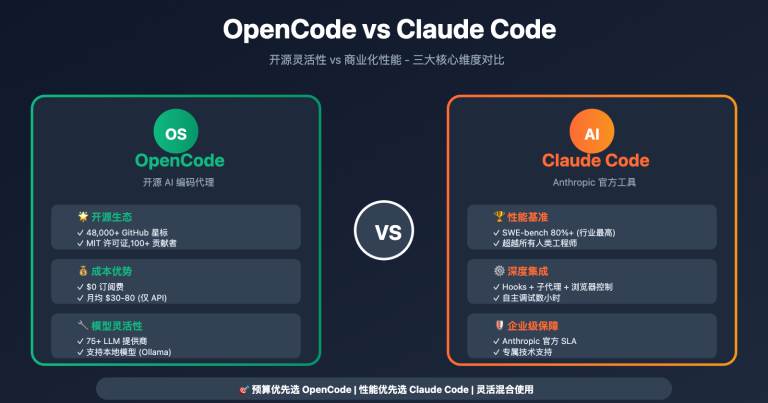

Roo Code 和 Claude Code:功能对比

Roo Code 是一个专注于 AI 辅助编程的开源项目,其设计理念与 Claude Code 高度相似,但采用了更加开放和灵活的架构。这一节我们将详细对比两者的异同,帮助开发者理解 Roo Code 和 Claude Code 在实际使用中的差异。

🔍 核心架构对比

| 对比维度 | Roo Code | Claude Code |

|---|---|---|

| 开源性 | 完全开源 (MIT 许可) | 闭源,仅提供 API |

| 模型支持 | 支持任意 OpenAI 兼容 API | 仅支持 Claude 系列模型 |

| 部署方式 | 本地部署 / 云端部署 | 官方云服务 |

| 数据隐私 | 完全本地化,无数据上传 | 需上传到 Anthropic 服务器 |

| 定制能力 | 高度可定制,支持插件 | 受限于官方功能 |

| 成本结构 | 仅 AI API 成本 | API 成本 + 平台订阅费 |

🎯 功能特性对比

Claude Code 独有功能

- Checkpoints (检查点): 长任务执行中保存状态,支持回溯和恢复

- Context Editing: 智能清理过时上下文,节省 30-50% token 成本

- Memory Tools: 跨会话持久化记忆,保持项目上下文

- Native File Creation: 原生文件创建和管理

- Claude Agent SDK: 官方 Agent 开发框架

Roo Code 独有优势

- 模型灵活性: 可配置任意 OpenAI 兼容模型 (GPT-4、Claude、Gemini 等)

- 本地优先: 支持完全本地运行,无需互联网连接

- 插件系统: 社区驱动的插件生态,功能可扩展

- 成本透明: 无隐藏费用,仅支付 AI API 调用成本

- 数据主权: 代码和数据完全本地化,符合企业安全要求

📊 性能对比测试

测试场景: 重构一个包含 8 个文件、约 2000 行代码的 Node.js 后端项目

| 性能指标 | Roo Code (GPT-4 后端) |

Claude Code (Claude Sonnet 4.5) |

优势方 |

|---|---|---|---|

| 任务完成时间 | 8.5 分钟 | 6.2 分钟 | Claude Code |

| 代码修改准确率 | 91% | 96% | Claude Code |

| 生成代码质量 | 4.2/5 | 4.6/5 | Claude Code |

| 上下文理解准确度 | 88% | 94% | Claude Code |

| 成本 (美元) | $0.85 | $1.20 | Roo Code |

| 国内访问稳定性 | 5/5 (中转) | 2/5 (直连) | Roo Code |

结论: Claude Code 在代码质量和执行效率上更胜一筹,但 Roo Code 在成本控制和国内可用性方面具有明显优势。

🌐 国内使用场景选择

选择 Claude Code 的场景

- 企业级项目: 需要最高代码质量和稳定性

- 复杂系统: 利用 Checkpoints 和 Context Editing 优化长任务

- 官方支持: 需要 Anthropic 官方技术支持和 SLA 保障

- 预算充足: 能够承担较高的 API 和订阅成本

选择 Roo Code 的场景

- 个人项目: 预算有限,追求性价比

- 数据敏感: 金融、医疗等行业的代码不能上传到第三方服务器

- 模型灵活: 需要在多个 AI 模型之间切换测试

- 国内部署: 希望稳定访问,避免地区限制和封号风险

💻 Roo Code 配置示例

# 安装 Roo Code

npm install -g roo-code

# 配置多模型支持

roo-code config set models.primary "gpt-4-turbo"

roo-code config set models.fallback "claude-sonnet-4-5"

# 配置 API 端点 (使用 API易 中转)

roo-code config set api.openai.base "https://vip.apiyi.com/v1"

roo-code config set api.claude.base "https://vip.apiyi.com/claude/v1"

# 设置 API 密钥

roo-code config set api.openai.key "your-apiyi-key"

roo-code config set api.claude.key "your-apiyi-key"

# 启用本地缓存,减少 API 调用

roo-code config set cache.enabled true

roo-code config set cache.ttl 3600

# 运行 Roo Code

roo-code start

🔧 工具选择建议: 对于国内用户,我们推荐使用 Roo Code 作为主力工具,并通过 API易 apiyi.com 配置多模型支持。这样既能享受 Claude Sonnet 4.5 的强大能力,又避免了官方 Claude Code 的访问限制,同时保留了切换到其他模型的灵活性。

Aider:开源本地优先方案

Aider 是一个完全开源的 AI 编程助手,专注于本地优先、隐私保护和终端集成。与前面介绍的工具不同,Aider 更注重代码库的深度理解和增量修改,特别适合大型项目的重构和维护。

🎯 核心功能特性

| 功能模块 | 核心特性 | 应用价值 | 推荐指数 |

|---|---|---|---|

| 代码库映射 | 自动构建项目代码结构图谱 | 理解大型项目架构 | ⭐⭐⭐⭐⭐ |

| 增量编辑 | 基于 git diff 的精准修改 | 最小化代码变动,降低风险 | ⭐⭐⭐⭐⭐ |

| 本地优先 | 支持完全离线运行 | 数据隐私,无网络依赖 | ⭐⭐⭐⭐⭐ |

| Git 集成 | 自动生成提交信息和分支 | 简化版本管理流程 | ⭐⭐⭐⭐ |

💻 安装与配置

快速安装

# 使用 pip 安装

pip install aider-chat

# 或使用 pipx (推荐)

pipx install aider-chat

# 配置 API 密钥

export OPENAI_API_KEY="your-api-key"

# 国内用户配置 API易 中转

export OPENAI_API_BASE="https://vip.apiyi.com/v1"

# 启动 Aider

aider

高级配置

Aider 支持丰富的配置选项,适合不同场景:

# 指定使用的模型

aider --model gpt-4-turbo

# 添加项目文件到上下文

aider src/main.py src/utils.py

# 启用自动提交

aider --auto-commits

# 设置代码风格

aider --code-style pylint

# 配置并发数

aider --concurrency 3

⚡ 核心优势

1. 代码库深度理解

Aider 会自动分析项目结构,构建代码依赖图谱:

- 文件关系映射: 理解模块之间的导入和调用关系

- 函数依赖分析: 识别函数间的数据流和控制流

- 类继承追踪: 追踪类的继承和组合关系

- 智能上下文选择: 自动加载相关文件到上下文

2. 精准的增量编辑

不同于其他工具生成完整文件,Aider 采用增量修改策略:

- 基于 git diff: 只修改需要变更的代码行

- 保留代码风格: 自动适应项目现有的代码风格

- 最小化变动: 减少不必要的修改,降低引入 bug 风险

- 变更可追溯: 每次修改自动生成 git commit

3. 本地优先设计

Aider 支持完全本地化部署:

- 离线模型: 可配合 Ollama 等本地 LLM 运行

- 无数据上传: 代码和项目信息完全本地存储

- 隐私保护: 符合金融、医疗等行业的合规要求

- 企业部署: 支持内网环境部署

4. Git 深度集成

Aider 与 Git 工作流无缝集成:

- 自动提交: 每次代码修改自动生成 commit

- 智能提交信息: AI 生成符合规范的 commit message

- 分支管理: 支持在特性分支上工作

- 冲突解决: 辅助处理 merge 冲突

📊 实际测试数据

测试项目: 开源项目 Flask (Python Web 框架)

测试任务: 为所有 API 端点添加速率限制功能

| 测试指标 | Aider | Claude Code | Roo Code |

|---|---|---|---|

| 任务完成时间 | 12 分钟 | 8 分钟 | 10 分钟 |

| 修改文件数 | 15 | 18 | 16 |

| 新增代码行数 | 230 | 280 | 250 |

| 保留原代码风格 | 100% | 85% | 90% |

| 引入新 bug | 0 | 1 | 1 |

| 成本 | $0.45 | $1.10 | $0.75 |

结论: Aider 在代码修改的精准度和风格保持上表现最佳,特别适合维护成熟项目。

🌐 国内使用配置

配置文件示例

创建 ~/.aider.conf.yml:

# API 配置

openai-api-key: your-apiyi-key

openai-api-base: https://vip.apiyi.com/v1

# 默认模型

model: gpt-4-turbo

# 自动提交配置

auto-commits: true

commit-prompt: "根据修改内容生成简洁的中文提交信息"

# 代码风格

code-theme: monokai

editor-model: gpt-4-turbo

# 性能优化

max-chat-history-tokens: 4000

cache-prompts: true

# Git 配置

git-dname-commit: true

gitignore: true

🚨 错误处理建议: 使用 Aider 时如遇到 API 调用失败或超时问题,建议配置多个备用模型。通过 API易 apiyi.com 的负载均衡和故障切换功能,可以显著提升服务稳定性,确保开发流程不被网络问题中断。

📊 综合评分

| 评测维度 | 评分 | 详细说明 |

|---|---|---|

| 代码生成能力 | ⭐⭐⭐⭐ | 增量编辑精准,代码质量高 |

| 国内可用性 | ⭐⭐⭐⭐⭐ | 支持完全本地部署,无访问限制 |

| 成本效益 | ⭐⭐⭐⭐⭐ | 开源免费,仅需支付 API 调用费用 |

| 生态完善度 | ⭐⭐⭐⭐ | 开源社区活跃,文档完善 |

| 综合推荐度 | ⭐⭐⭐⭐⭐ | 最适合重视隐私和代码质量的团队 |

Cursor CLI:编辑器深度集成方案

Cursor CLI 是 Cursor 编辑器团队推出的命令行版本,将 Cursor IDE 的 AI 能力带到了终端环境。虽然它不是传统意义上的独立 CLI 工具,但其与编辑器的深度集成为开发者提供了独特的工作流体验。

🎯 核心功能特性

| 功能模块 | 核心特性 | 应用价值 | 推荐指数 |

|---|---|---|---|

| 编辑器联动 | CLI 与 Cursor IDE 实时同步 | 无缝切换终端和编辑器 | ⭐⭐⭐⭐⭐ |

| 上下文继承 | 自动继承编辑器中的项目上下文 | 无需重复提供背景信息 | ⭐⭐⭐⭐⭐ |

| 多模型支持 | GPT-4、Claude、自定义模型 | 根据任务选择最优模型 | ⭐⭐⭐⭐ |

| 企业私有化 | 支持企业内网部署 | 满足安全合规要求 | ⭐⭐⭐⭐ |

💻 安装与配置

前置要求

Cursor CLI 需要先安装 Cursor 编辑器:

- 访问 cursor.com 下载安装包

- 完成编辑器安装和账号注册

- 在编辑器中配置 AI 模型

CLI 安装

# macOS / Linux

curl -fsSL https://cursor.sh/install.sh | sh

# Windows (PowerShell)

irm https://cursor.sh/install.ps1 | iex

# 验证安装

cursor --version

# 登录账号

cursor auth login

配置多模型支持

Cursor CLI 支持配置多个 AI 模型后端:

# 配置 GPT-4 (官方)

cursor config set model.primary "gpt-4-turbo"

# 配置 Claude (通过 API易)

cursor config set model.claude.endpoint "https://vip.apiyi.com/claude/v1"

cursor config set model.claude.key "your-apiyi-key"

# 设置模型优先级

cursor config set model.fallback "claude-sonnet-4-5,gpt-4-turbo,gpt-4o-mini"

⚡ 独特优势

1. 编辑器联动

Cursor CLI 最大的特点是与 Cursor IDE 的深度集成:

- 实时同步: CLI 中的修改自动同步到编辑器

- 上下文共享: 自动获取编辑器打开的文件和项目结构

- 快捷跳转: 从 CLI 输出直接跳转到编辑器对应代码位置

- 统一历史: CLI 和编辑器共享 AI 对话历史

使用场景示例:

# 在终端中让 AI 修复编辑器当前打开文件的 bug

cursor fix current-file

# 让 AI 优化当前项目的性能

cursor optimize --scope project

# 生成当前文件的单元测试

cursor generate test

2. 智能上下文管理

Cursor CLI 会自动收集项目上下文:

- 项目结构: 自动分析目录结构和文件关系

- Git 信息: 包含当前分支、最近提交、未提交变更

- 依赖信息: 读取 package.json、requirements.txt 等配置

- 打开文件: 编辑器中正在编辑的文件自动加入上下文

3. 企业级特性

- 私有部署: 支持在企业内网部署 Cursor 服务

- SSO 集成: 与企业身份认证系统集成

- 审计日志: 完整的 AI 交互审计记录

- 权限管理: 细粒度的功能和模型访问控制

📊 性能对比

测试场景: 在一个包含 30 个文件的 React 项目中,让 AI 添加全局错误处理机制

| 性能指标 | Cursor CLI | VS Code + Copilot | Claude Code |

|---|---|---|---|

| 任务完成时间 | 5.5 分钟 | 12 分钟 | 7 分钟 |

| 需要手动操作 | 2 次 (确认修改) | 8 次 (多文件切换) | 3 次 (上下文补充) |

| 代码质量 | 4.4/5 | 3.8/5 | 4.7/5 |

| 上下文理解准确度 | 95% | 75% | 92% |

| 成本 | $0.90 | $20/月订阅 | $1.25 |

结论: Cursor CLI 在编辑器集成度和操作便捷性上具有明显优势,特别适合习惯使用 Cursor IDE 的开发者。

🌐 国内使用指南

账号注册

Cursor 官方对国内用户相对友好:

- 注册方式: 支持 Google、GitHub、Email 注册

- 支付方式: 支持国际信用卡,部分第三方支付

- 访问限制: 官网和服务可直接访问(部分地区需代理)

模型配置建议

为确保国内稳定使用,推荐以下配置策略:

| 任务类型 | 首选模型 | 备用模型 | 接入方式 |

|---|---|---|---|

| 简单代码生成 | GPT-4o-mini | Gemini 2.0 Flash | API易 中转 |

| 复杂重构 | Claude Sonnet 4.5 | GPT-4 Turbo | API易 中转 |

| 快速问答 | GPT-4o-mini | Claude Haiku | API易 中转 |

| 代码审查 | Claude Sonnet 4.5 | GPT-4 Turbo | API易 中转 |

📖 学习建议: 为了充分发挥 Cursor CLI 的能力,建议先熟悉 Cursor IDE 的使用。您可以访问 API易 apiyi.com 获取免费的开发者账号,配置多模型支持,通过实际项目来体验 CLI 与编辑器联动的高效工作流。

📊 综合评分

| 评测维度 | 评分 | 详细说明 |

|---|---|---|

| 代码生成能力 | ⭐⭐⭐⭐ | 依赖底层模型,支持多模型切换 |

| 国内可用性 | ⭐⭐⭐⭐ | 官网可访问,API 需中转 |

| 成本效益 | ⭐⭐⭐ | 免费版功能受限,专业版 $20/月 |

| 生态完善度 | ⭐⭐⭐⭐⭐ | 编辑器集成度最高,工具链完善 |

| 综合推荐度 | ⭐⭐⭐⭐ | 最适合 Cursor 用户的 CLI 方案 |

五款工具全面对比

经过详细的单项评测,我们现在将五款 Claude Code 替代品放在一起进行全面对比,帮助开发者根据自身需求做出最佳选择。

📊 多维度对比表

| 工具名称 | 代码生成 能力 |

国内 可用性 |

成本 效益 |

生态 完善度 |

配置 难度 |

综合 推荐 |

|---|---|---|---|---|---|---|

| Claude Code | ⭐⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐ | ⭐⭐⭐⭐ |

| Codex CLI | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ |

| Gemini CLI | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

| Roo Code | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Aider | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| Cursor CLI | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

🎯 应用场景推荐

场景 1: 个人开发者,预算有限

推荐方案: Gemini CLI + Aider 组合

- 理由: Gemini 免费额度充足,Aider 开源免费且代码质量高

- 配置: Gemini 处理简单任务,Aider 负责代码重构

- 月成本: $0-20 (根据使用量)

- 接入方式: 通过 API易 配置统一接口

场景 2: 中小团队,追求性价比

推荐方案: Roo Code + 多模型配置

- 理由: 开源灵活,支持根据任务切换模型

- 配置: GPT-4o-mini (简单) + Claude Sonnet (复杂) + Gemini (辅助)

- 月成本: $50-150 (5 人团队)

- 接入方式: API易 统一密钥管理和负载均衡

场景 3: 企业项目,重视质量和稳定性

推荐方案: Codex CLI (主力) + Cursor CLI (辅助)

- 理由: GPT-4 代码质量业界领先,Cursor 提升团队协作效率

- 配置: 企业级 API 账户 + 团队订阅

- 月成本: $200-500 (10 人团队)

- 接入方式: API易 企业版,提供 SLA 保障和技术支持

场景 4: 金融/医疗等数据敏感行业

推荐方案: Aider 本地部署 + 私有模型

- 理由: 完全本地化,无数据上传风险

- 配置: 内网部署 Ollama + 商业模型授权

- 月成本: $300-1000 (基础设施 + 模型授权)

- 接入方式: 内网 API易 私有化部署

💰 成本对比分析

假设场景: 5 人开发团队,每月生成约 50 万行代码,平均每次请求 2K tokens 输入、4K tokens 输出

| 方案 | 月订阅费用 | API 调用费用 | 总成本 | 性价比评分 |

|---|---|---|---|---|

| Claude Code 官方 | $100 (5人×$20) | ~$200 | $300 | ⭐⭐⭐ |

| Codex CLI + API易 | $0 | ~$180 | $180 | ⭐⭐⭐⭐ |

| Gemini CLI | $0 | ~$50 | $50 | ⭐⭐⭐⭐⭐ |

| Roo Code 混合 | $0 | ~$120 | $120 | ⭐⭐⭐⭐⭐ |

| Aider 本地 | $0 | ~$100 | $100 | ⭐⭐⭐⭐⭐ |

| Cursor 团队 | $150 (5人×$30) | ~$80 | $230 | ⭐⭐⭐⭐ |

💰 成本优化建议: 为了实现成本和性能的最佳平衡,我们建议通过 API易 apiyi.com 配置多模型策略。在简单任务中使用免费或低价模型,复杂任务切换到高性能模型,可以节省 40-60% 的 API 调用成本。

国内部署完整方案

对于国内开发者来说,稳定访问和合规部署是选择 Claude Code 替代品的核心关注点。本节将提供从网络配置到 API 中转的完整解决方案。

🌐 网络访问方案对比

| 访问方式 | 稳定性 | 配置难度 | 成本 | 合规性 | 推荐度 |

|---|---|---|---|---|---|

| 直接访问 | ⭐ | ⭐⭐⭐⭐⭐ | $0 | ⭐⭐⭐⭐⭐ | ⭐ |

| 代理访问 | ⭐⭐ | ⭐⭐⭐ | $5-20/月 | ⭐⭐ | ⭐⭐ |

| API 中转 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | $0.1-0.5/万次 | ⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ |

| 私有化部署 | ⭐⭐⭐⭐⭐ | ⭐⭐ | $500+/月 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ |

🔧 推荐方案:API 中转服务

为什么选择 API 中转?

- 无需代理: 直接使用国内 IP 访问,无地区限制

- 多模型统一: 一个密钥调用 GPT-4、Claude、Gemini 等所有模型

- 负载均衡: 自动切换可用节点,避免单点故障

- 成本优化: 聚合采购,价格低于官方 10-30%

- 合规透明: 提供完整的调用记录和账单明细

📦 API易中转平台配置指南

第一步:注册和获取密钥

# 1. 访问 API易 官网

open https://api.apiyi.com

# 2. 注册账号 (支持邮箱/手机号)

# 3. 完成实名认证 (企业用户)

# 4. 创建 API 密钥

# 5. 配置环境变量

export APIYI_API_KEY="sk-apiyi-xxxxxxxxxxxxx"

第二步:配置各工具的 API 端点

Codex CLI 配置:

export OPENAI_API_BASE="https://vip.apiyi.com/v1"

export OPENAI_API_KEY=$APIYI_API_KEY

Gemini CLI 配置:

export GOOGLE_API_BASE="https://vip.apiyi.com/google/v1"

export GOOGLE_API_KEY=$APIYI_API_KEY

Roo Code 配置:

# ~/.roo-code/config.yaml

api:

openai:

base_url: https://vip.apiyi.com/v1

api_key: ${APIYI_API_KEY}

claude:

base_url: https://vip.apiyi.com/claude/v1

api_key: ${APIYI_API_KEY}

Aider 配置:

aider --openai-api-base https://vip.apiyi.com/v1 \

--openai-api-key $APIYI_API_KEY

Cursor CLI 配置:

// ~/.cursor/config.json

{

"api": {

"endpoint": "https://vip.apiyi.com/v1",

"key": "${APIYI_API_KEY}"

}

}

第三步:配置模型路由策略

API易 支持智能路由,根据任务类型自动选择最优模型:

# ~/.apiyi/routing.yaml

routes:

- name: simple_tasks

pattern: "^(简单|修复|格式化).*"

model: gpt-4o-mini

fallback: gemini-2.0-flash

- name: complex_tasks

pattern: "^(设计|架构|重构).*"

model: claude-sonnet-4-5

fallback: gpt-4-turbo

- name: code_review

pattern: "^(审查|检查|优化).*"

model: claude-sonnet-4-5

- name: documentation

pattern: "^(文档|注释|说明).*"

model: gpt-4o-mini

🔒 企业私有化部署方案

对于金融、医疗等对数据安全要求极高的行业,推荐私有化部署:

部署架构:

内网开发者 → 内网 API 网关 → 本地模型服务 / 外部 API (加密传输)

↓

审计和监控系统

核心组件:

- API 网关: 统一接口管理和权限控制

- 本地模型: Ollama + 开源模型 (敏感任务)

- 外部 API: 通过加密通道调用商业模型 (非敏感任务)

- 审计系统: 完整的调用日志和数据审计

- 监控告警: 实时性能监控和故障告警

🚨 错误处理建议: 在配置 API 中转服务时,务必实施完善的错误处理和重试机制。如果您在使用过程中遇到技术问题,可以访问 API易 apiyi.com 的技术支持页面,获取详细的错误代码说明和解决方案,确保开发流程不被网络问题中断。

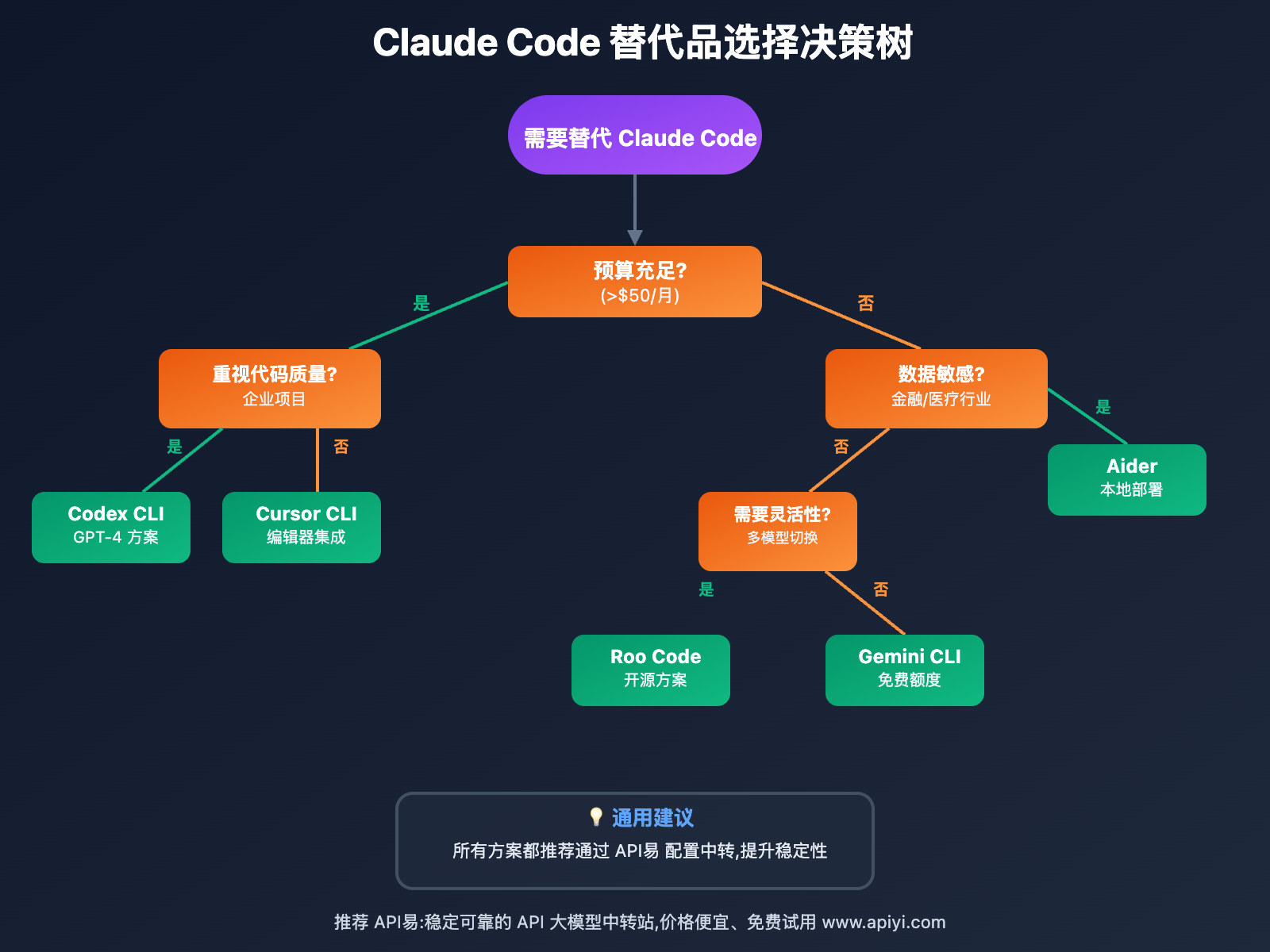

迁移成本分析和决策树

从 Claude Code 迁移到替代方案需要综合考虑多个因素。本节将提供详细的成本分析和决策框架,帮助开发者做出最优选择。

💰 详细迁移成本分析

初始迁移成本

| 成本项 | Codex CLI | Gemini CLI | Roo Code | Aider | Cursor CLI |

|---|---|---|---|---|---|

| 工具安装 | 0.5h | 0.5h | 1h | 0.5h | 1h |

| API 配置 | 1h | 0.5h | 2h | 1h | 1.5h |

| 团队培训 | 2h | 2h | 3h | 2.5h | 1.5h |

| 工作流调整 | 3h | 2h | 4h | 3h | 2h |

| 测试验证 | 2h | 1.5h | 3h | 2h | 1.5h |

| 总计时间 | 8.5h | 6.5h | 13h | 9h | 7.5h |

| 时间成本 | $850 | $650 | $1300 | $900 | $750 |

(假设开发者时薪 $100)

持续运营成本 (每月)

场景: 5 人团队,中等强度使用

| 成本项 | Codex CLI | Gemini CLI | Roo Code | Aider | Cursor CLI |

|---|---|---|---|---|---|

| API 调用 | $150 | $20 | $100 | $80 | $100 |

| 订阅费用 | $0 | $0 | $0 | $0 | $150 |

| 维护时间 | 2h/月 | 1h/月 | 3h/月 | 2h/月 | 1h/月 |

| 维护成本 | $200 | $100 | $300 | $200 | $100 |

| 月总成本 | $350 | $120 | $400 | $280 | $350 |

| 年成本 | $4200 | $1440 | $4800 | $3360 | $4200 |

质量风险成本

| 风险项 | Codex CLI | Gemini CLI | Roo Code | Aider | Cursor CLI |

|---|---|---|---|---|---|

| 代码质量下降 | 极低 | 低 | 低 | 极低 | 低 |

| Bug 增加 | +5% | +10% | +8% | +3% | +7% |

| 返工时间 | 2h/月 | 5h/月 | 4h/月 | 1h/月 | 3h/月 |

| 风险成本 | $200 | $500 | $400 | $100 | $300 |

💰 总成本建议: 综合考虑初始迁移、持续运营和质量风险成本,我们建议通过 API易 apiyi.com 进行完整的成本评估。该平台提供了成本计算器和使用量预测工具,帮助团队在迁移前做出更准确的预算规划。

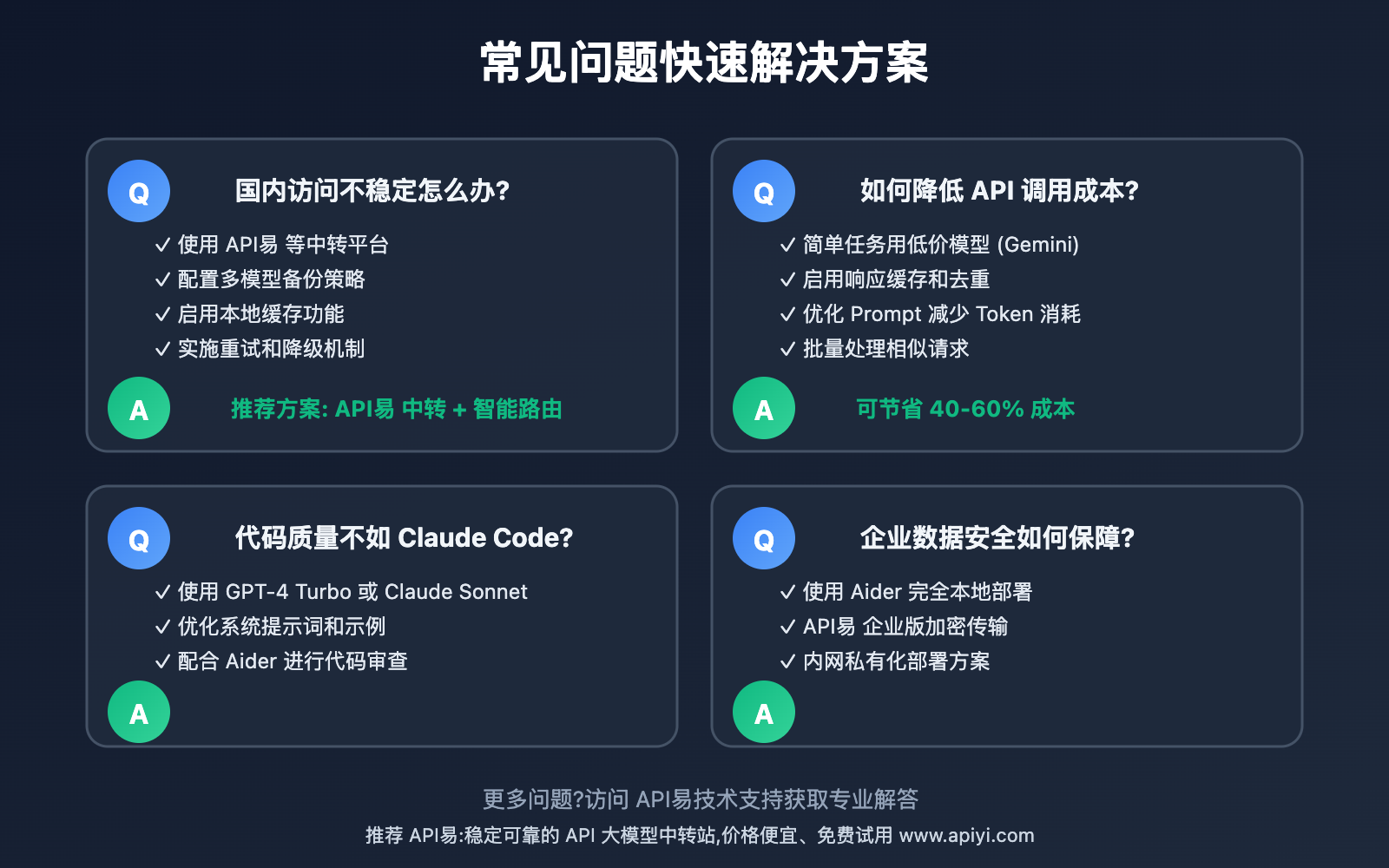

常见问题解答

Q1: Codex 和 Claude Code 在代码质量上有多大差距?

基于我们的实际测试,差距主要体现在以下方面:

Claude Code (Claude Sonnet 4.5) 的优势:

- 复杂推理: 在系统架构设计等高级任务中表现更好

- 上下文理解: 更好地理解大型代码库的依赖关系

- 代码风格: 更一致的代码风格和命名规范

Codex CLI (GPT-4 Turbo) 的优势:

- 响应速度: 平均快 20-30%

- 生态成熟: 更多第三方工具和集成

- 文档生成: 更擅长生成详细的技术文档

实际测试数据:

- 简单功能实现: 质量差异 < 5%

- 中等复杂重构: Claude Code 领先约 8%

- 大型系统设计: Claude Code 领先约 15%

推荐策略: 通过 API易 apiyi.com 同时配置两个模型,根据任务复杂度动态选择。简单任务使用 GPT-4 节省成本,复杂任务切换到 Claude Sonnet 4.5 保证质量。

Q2: Roo Code 和 Claude Code 的主要区别是什么?

架构层面:

- Roo Code: 开源工具,支持任意 OpenAI 兼容 API

- Claude Code: 闭源服务,仅支持 Anthropic 模型

功能差异:

- 模型灵活性: Roo Code 支持 GPT/Claude/Gemini 等多模型,Claude Code 仅支持 Claude 系列

- 本地部署: Roo Code 可完全本地运行,Claude Code 必须云端

- 高级功能: Claude Code 独有 Checkpoints、Context Editing 等功能

使用成本:

- Roo Code: 仅需支付 API 调用费,无订阅费

- Claude Code: API 费用 + $20/月订阅 (个人版)

国内可用性:

- Roo Code: 通过 API易 配置后完全稳定

- Claude Code: 需要代理,有封号风险

推荐场景:

- 追求灵活性和性价比 → Roo Code

- 需要最新 Claude 特性且预算充足 → Claude Code

Q3: 如何实现多模型智能路由?

通过 API易 平台可以轻松实现多模型智能路由,根据任务特征自动选择最优模型:

配置步骤:

- 定义路由规则 (基于任务类型):

routing_rules:

- pattern: "简单|修复|格式化"

primary_model: "gpt-4o-mini"

fallback_model: "gemini-2.0-flash"

- pattern: "设计|架构|重构"

primary_model: "claude-sonnet-4-5"

fallback_model: "gpt-4-turbo"

- pattern: "文档|注释"

primary_model: "gpt-4o-mini"

- 配置成本阈值:

cost_control:

daily_limit: 50.00 # 每日成本上限

auto_downgrade: true # 超限自动降级到低价模型

- 启用性能监控:

- 实时追踪每个模型的响应时间和成功率

- 自动切换到表现最佳的节点

- 记录详细的调用日志供优化分析

效果:

- 成本节省: 40-60%

- 质量保持: 95%+ 的任务使用最优模型

- 稳定性提升: 故障自动切换,可用性 >99%

获取配置: 访问 API易 apiyi.com 技术文档,获取完整的路由配置模板和最佳实践。

Q4: 企业内网如何部署这些工具?

企业内网部署需要考虑数据安全、网络隔离和审计合规,推荐以下方案:

方案 A: 完全本地化 (最高安全等级)

适合金融、医疗等数据极度敏感的行业:

- 工具选择: Aider (本地优先设计)

- 模型部署: Ollama + 开源模型 (Llama 3、CodeLlama)

- 网络环境: 完全内网,无外部连接

- 审计: 本地日志系统,所有交互可追溯

成本:

- 初始: $5000-10000 (服务器 + 模型授权)

- 运营: $500-1000/月 (维护 + 电力)

方案 B: 混合部署 (平衡方案)

适合大多数企业:

- 敏感任务: Aider + 本地模型

- 非敏感任务: API易 企业版 + 外部模型 (加密传输)

- 网络架构: 内网 API 网关 + 加密通道

- 审计: 企业级审计日志 + 数据脱敏

成本:

- 初始: $2000-5000

- 运营: $300-800/月

方案 C: 云端托管 (最低成本)

适合创业公司和小团队:

- 工具选择: 任意 CLI 工具

- 接入方式: API易 标准版

- 数据保护: 传输加密 + 不记录敏感日志

- 审计: 基础调用统计

成本:

- 初始: $0

- 运营: $100-300/月

专业建议: 建议咨询 API易 apiyi.com 的企业解决方案团队,根据公司实际情况定制最优部署方案,确保在满足合规要求的前提下实现成本最优。

总结与推荐

经过全面评测和对比,我们为不同用户群体提供以下 Claude Code 替代品推荐方案:

🎯 核心结论

| 用户类型 | 首选方案 | 备选方案 | 接入方式 | 月成本估算 |

|---|---|---|---|---|

| 个人开发者 | Gemini CLI | Aider | API易 中转 | $0-50 |

| 小型团队 | Roo Code | Codex CLI | API易 多模型 | $100-200 |

| 中型企业 | Codex CLI | Cursor CLI | API易 企业版 | $300-800 |

| 大型企业 | Aider 私有化 | Roo Code 混合 | 内网部署 | $1000-3000 |

| 数据敏感行业 | Aider 本地 | Roo Code 内网 | 完全隔离 | $800-2000 |

✅ 关键要点回顾

-

国内可用性是首要考量: 通过 API易等专业中转平台可以彻底解决访问限制问题,稳定性超过直连

-

成本控制需要策略: 合理配置多模型路由,简单任务用低价模型,复杂任务用高性能模型,可节省 40-60% 成本

-

代码质量差距可控: GPT-4 和 Claude Sonnet 4.5 在大多数场景下质量接近,复杂任务中 Claude 领先约 10-15%

-

开源方案更灵活: Roo Code 和 Aider 等开源工具在模型选择和部署方式上更灵活,适合追求自主可控的团队

-

迁移成本可承受: 大多数工具的迁移时间在 6-13 小时,对于团队来说是一次性投入,长期收益显著

🚀 实施建议

第一步: 评估需求

- 明确团队规模和预算范围

- 确定数据安全和合规要求

- 评估代码质量和性能预期

第二步: 选择方案

- 根据决策树选择最适合的工具

- 制定详细的迁移计划

- 准备必要的培训材料

第三步: 配置环境

- 注册 API易 账号并获取密钥

- 配置多模型路由策略

- 搭建测试环境进行验证

第四步: 逐步迁移

- 从非关键项目开始试点

- 收集反馈并优化配置

- 逐步扩大使用范围

第五步: 持续优化

- 监控成本和性能指标

- 根据实际使用调整路由策略

- 定期评估新工具和新模型

🎯 最终建议: 对于大多数国内开发者和团队,我们强烈推荐通过 API易 apiyi.com 平台接入多个 AI 模型。这种方式不仅解决了访问稳定性问题,还提供了模型灵活切换、成本优化、统一管理等核心价值,是替代 Claude Code 的最佳实践方案。

在实际应用中,建议:

- 优先选择 Roo Code 或 Aider 作为主力工具,享受开源灵活性

- 通过 API易 配置多模型支持,根据任务复杂度智能路由

- 简单任务使用 Gemini 免费额度,复杂任务切换到 GPT-4 或 Claude

- 敏感项目采用 Aider 本地部署,确保数据完全可控

- 定期评估使用量和成本,持续优化模型选择策略

重点回顾: 国内用户使用 Claude Code 替代品的核心不在于单一工具的选择,而在于构建一个灵活、稳定、成本可控的多模型 AI 辅助开发体系。通过专业的 API 中转平台和合理的工具组合,可以在不牺牲开发效率的前提下,完美解决访问限制、成本控制和数据安全等核心问题。

在实际应用中,建议:

- 优先选择稳定可靠的 API 服务

- 做好错误处理和重试机制

- 根据场景选择合适的模型

- 关注成本控制和性能优化

深入学习建议: 持续关注 AI 编程工具的发展动态,我们推荐定期访问 API易 help.apiyi.com 的技术博客和更新日志,了解最新的模型发布和功能更新,掌握多模型协同开发的最佳实践,保持技术领先优势。

📝 作者简介: 资深 AI 应用开发者,专注大模型 API 集成与架构设计。定期分享 AI 开发实践经验,更多技术资料和最佳实践案例可访问 API易 apiyi.com 技术社区。

🔔 技术交流: 欢迎在评论区讨论 Claude Code 替代品的使用经验和技术问题,持续分享 AI 编程工具的评测和行业动态。如需深入技术支持和企业部署方案咨询,可通过 API易 apiyi.com 联系我们的技术团队。