2026 年 5 月 11 日,多位 Reddit 用户在 Gemini 应用界面里发现了一张名为 Omni 的模型卡片,描述写着 「Create with Gemini Omni: meet our new video model, remix your videos, edit directly in chat, try templates, and more」。Google 暂时没有官方发声,但这次泄露已经把 Gemini Omni 推到了聚光灯下,距离 5 月 19-20 日的 Google I/O 2026 只剩一周时间。

本文基于 9to5google、TestingCatalog、ChromeUnboxed、Digit、WaveSpeed 等英文媒体的最新报道,把当前能确认的 Gemini Omni 视频模型情报集中整理为 8 个关键信号,覆盖产品定位、核心能力、性能边界和发布节奏。对于打算在大会前提前判断技术路线的开发者和内容团队,可以把这篇当作一份冷静的情报参考,而不是猜测合集。

核心价值: 3 分钟看懂 Gemini Omni 的定位、能力、性能与发布节奏,并掌握 I/O 2026 之前的应对建议。

Gemini Omni 视频模型核心信息速览

要看懂 Gemini Omni,首先要把围绕它的事实和猜测分清楚。下表把目前 6 家英文媒体能交叉验证的核心信息整合到一起,避免被零散爆料绕晕。

| 信息项 | 详情 |

|---|---|

| 首次曝光 | 2026-05-11,Gemini 应用 UI 中出现 Omni 模型卡片 |

| 曝光来源 | Reddit 用户截图,9to5google 与 TestingCatalog 跟进报道 |

| 模型类型 | 视频生成与编辑一体的多模态模型 |

| 关键描述 | Create with Gemini Omni: meet our new video model |

| 已展示 Demo | 数学证明黑板场景、海边餐厅人物对话场景 |

| 当前可见层级 | 推测来自 Flash 层级,Pro 层级尚未泄露 |

| 用量信号 | 两段视频生成耗尽 AI Pro 套餐日额度 86% |

| 预计正式发布 | Google I/O 2026,5 月 19-20 日,旧金山 |

需要强调的是,泄露的 UI 卡片只能证明 Google 已经把 Omni 推进到了灰度测试阶段,并不意味着所有能力都会在 I/O 当天对所有用户开放。建议关注 Gemini Omni 动态的开发者,先在 API易 apiyi.com 注册账号并准备好统一接口的 base_url,等 Google 正式发布后可以第一时间在同一套代码里切换模型,省去单独搭建调用链路的成本。

Gemini Omni 视频模型 5 大已知能力

Gemini Omni 不是单纯的「文生视频」工具,从 UI 描述和早期 Demo 来看,它把生成、编辑、模板和聊天式交互捏成了一个统一系统。以下 5 项能力是当前可以被多家媒体共同确认的部分,仍处在快速变化的窗口期。

第一是聊天式视频编辑。用户可以在对话框里直接说出修改诉求,例如更换主体物品、改写场景或者重写某段画面动作,模型会基于现有片段重新出片,而不是要求用户回到时间轴上手动剪辑。这条能力直接对标传统视频后期工具,是 Omni 区别于 Veo 3.1 的关键。

第二是水印移除与对象替换。早期试用者反馈,Omni 在「remove watermark」和「swap object」两类指令上的表现明显优于其原始画面生成能力,被视为 Omni 的差异化卖点。考虑到这类操作高度敏感,Google 大概率会在正式发布时叠加版权与合规审查。

第三是原生音视频联合生成。WaveSpeed 与 GeminiOmniAI 的解读指向同一个方向:Omni 在一次推理中同时输出画面和与之同步的空间音频,而不是先出视频再叠声。这种联合建模可以减少口型对齐、环境音不连贯等典型 AI 视频问题。

第四是超长脚本上下文。多家媒体提到 Omni 接受比 Veo 3 更长的提示词与脚本上下文,便于做多分镜叙事或长篇产品讲解。结合 Gemini 系列一向擅长的长上下文管理,这条能力如果成真,会显著拉开和 Sora 之类聚焦短视频模型的差距。

第五是参考图片驱动一致性。Omni 支持将参考图作为身份、光线、色彩的锚点,让生成动作保留人物或场景的视觉特征。这一点很适合品牌广告、IP 视频和数字人内容场景。

💡 快速上手建议: Gemini Omni 正式开放之前,可以先在 API易 apiyi.com 平台用 Veo 3.1、Seedance 2、Hailuo 等当下主流视频模型把整套提示词工程跑通,等 Omni 上线后再做平滑切换,降低试错成本。

Gemini Omni Flash 与 Pro 双层级架构猜测

TestingCatalog 和 WaveSpeed 都注意到,泄露版 UI 中只能看到一种 Omni 的命名,但模型卡片的命名规则、参数选项和耗费速度都和 Gemini 系列其他成员的「Flash + Pro」结构高度一致。下表把推测中的两条产品线的差异整理出来,便于开发者预判后续选型。

| 层级 | 推测定位 | 推测特点 | 适用场景 |

|---|---|---|---|

| Gemini Omni Flash | 高频出片层级 | 速度快、单条耗用低、画面质量中等 | 社媒短视频、广告 AB 测试、批量内容 |

| Gemini Omni Pro | 高质量生产层级 | 推理慢、画质细腻、原生音频更精致 | 品牌片、长视频脚本、影视级镜头 |

之所以判断目前公开 Demo 来自 Flash 层级,主要有两条线索:一是早期数学黑板和餐厅场景在质感上没有超过 Veo 3.1 的水准,二是 Pro 层级通常会和 Deep Think 这类高耗推理一起公布。等到 I/O 2026 当天 Google 公布 Pro 层级和定价,开发者就可以判断是否需要分场景调用两条产品线。

对正在做视频生成应用的团队来说,更现实的做法是先以 API易 apiyi.com 上的多模型聚合接口为基础,把业务侧的提示词、参数管理、回调流程做成「模型无关」的中间层。等 Omni Flash 与 Pro 真正开放,只要切换 model 字段,业务系统就能在不停机的情况下接入新能力。

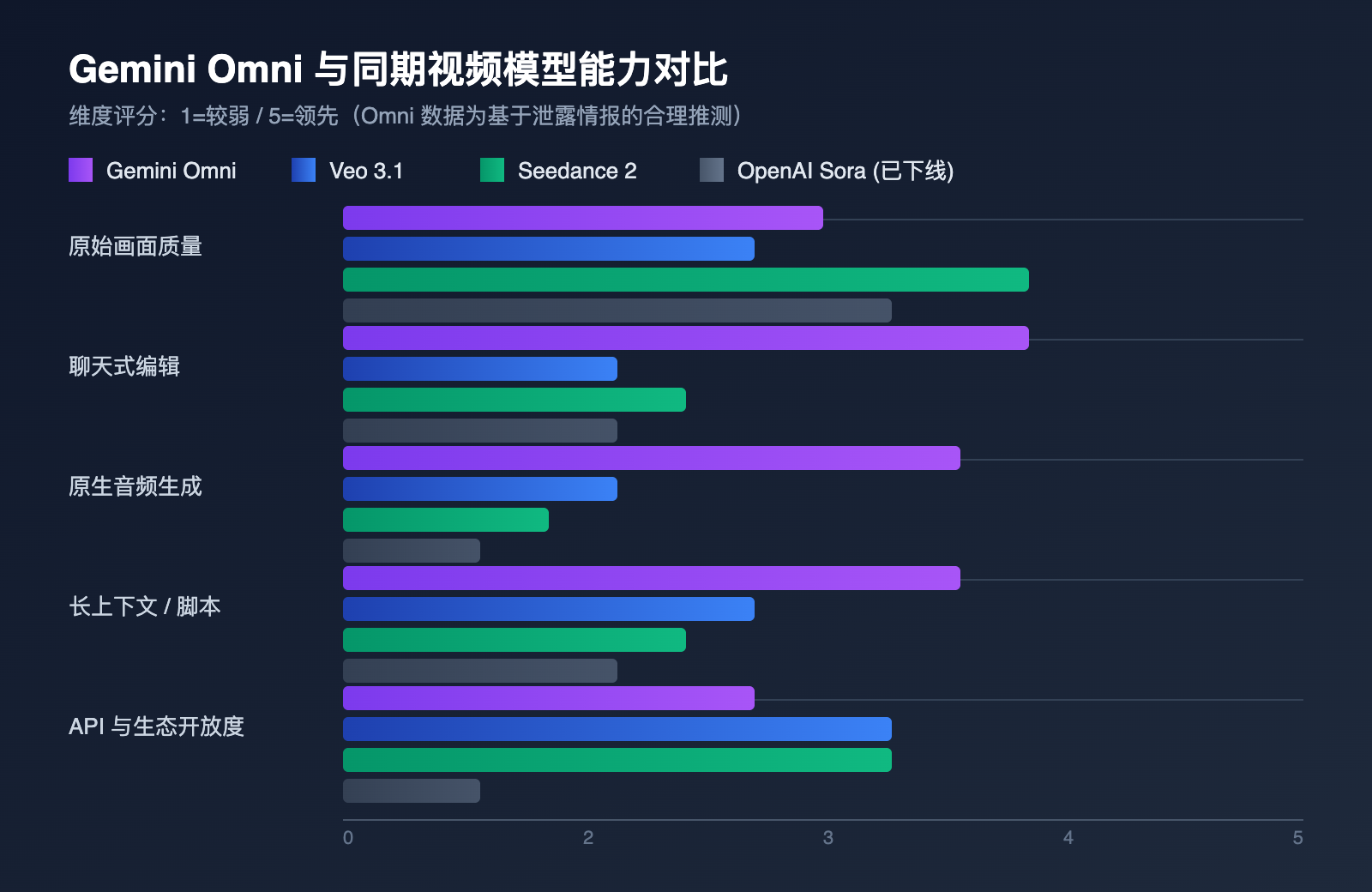

Gemini Omni 与 Veo 3.1、Seedance 2、Sora 关系分析

要理解 Gemini Omni 的市场位置,必须把它放到当前的视频模型版图里看。下面这张对比表整理了截至 2026 年 5 月 12 日最具关注度的几款模型在能力侧的差异,注意 Omni 相关数据仍属推测。

| 维度 | Gemini Omni | Veo 3.1 | Seedance 2 | OpenAI Sora |

|---|---|---|---|---|

| 主要定位 | 视频生成 + 聊天式编辑 | 视频生成 | 高保真视频生成 | 已于 2026 年初下线 |

| 原始画面质量 | 中等偏上(推测) | 中等 | 当前业界标杆 | 历史水平较高 |

| 聊天式编辑 | 一等亮点 | 不支持 | 弱支持 | 不再迭代 |

| 原生音频 | 一次推理同步输出 | 需后期 | 需后期 | 历史无原生音频 |

| API 开放度 | 预计随 I/O 开放 | Vertex AI / Gemini API | Volcengine 火山引擎 | 已关闭 |

| 商用授权 | 待官方公布 | 已商用 | 已商用 | 暂停 |

Gemini Omni 真正的杀手锏不是替代 Seedance 2 那种以画质取胜的模型,而是用 Gemini 的多模态能力把「生成 → 修改 → 再生成」这条工作流压缩到对话窗口里。对开发者而言,这意味着视频生成应用的产品形态可能要从「编辑器 + 模型」变成「对话 + 模型」。

OpenAI 在 2026 年早些时候关闭 Sora 后留下的内容生态空缺,恰好为 Gemini Omni 提供了上位的机会。如果团队还在评估是否要押注某一个视频生成生态,建议先通过 API易 apiyi.com 的统一中转接口同时接入 Veo 3.1 与 Seedance 2,在 Omni 正式发布后再补一条调用链,把选型决策延后到大会之后再做。

Gemini Omni Demo 实测观察与用量边界

除了能力清单和层级猜测,另一条值得关注的线索是早期 Demo 的实测表现和用量数据。9to5google 报道了两段公开 Demo,分别覆盖了文字渲染和长镜头叙事两类难点。

| Demo 主题 | 提示词关键要素 | 观察结论 |

|---|---|---|

| 数学证明黑板 | 教授在黑板上书写三角恒等式 | 文字渲染较稳定,仍有少量笔迹拼接瑕疵 |

| 海边餐厅场景 | 两位男士在高端海景餐厅享用意面 | 镜头层次、光影和情绪较自然 |

| 用量样本 | 两条视频提示 | 耗尽 AI Pro 套餐 86% 日额度 |

用量数据是这次泄露里最容易被忽视的细节。两条视频就吃掉一天大半的额度,意味着 Omni 在算力消耗上明显高于 Imagen 4 或者 Gemini 2.5 Flash 这类常规模型。Google 已经在另一条公告中明确将对 Gemini 帐号引入「explicit usage limits」,说明 Omni 上线后大概率会延续这种偏紧的额度策略。

对中小团队而言,最务实的做法是不要把视频生成绑在单一渠道。建议通过 API易 apiyi.com 平台调用 Gemini 系列时,先把每日预算切片成多个模型的混合调用:高频内容用 Veo 3.1 或 Seedance 2 跑,关键演示再调用 Omni 出片。这样既能享受 Omni 的差异化能力,又不至于被一家平台的额度策略卡死现金流。

Gemini Omni 视频模型对开发者和行业的影响

把上面这些信号整合起来,可以从开发者和行业两个维度评估 Gemini Omni 的潜在影响。这部分既不是技术规格的简单复述,也不是过度乐观的炒作,而是基于已知情报的合理推断。

对视频生成应用开发者的影响

第一波直接受影响的是构建视频生成 SaaS 的团队。Omni 把聊天式编辑做成了一等公民,意味着传统的视频编辑器 UI 不再是必选项,开发者需要重新思考是把对话界面作为唯一入口,还是保留时间轴作为兜底。

第二波是 AI 视频内容创作者和 MCN。原生音视频联合生成会显著降低后期合成的工作量,但日额度紧张又会限制单人能产出的视频体量。比较稳健的路径是把 Omni 作为「关键镜头放大器」,让常规内容继续依赖单价更低的模型。

如果你在做的产品依赖视频生成 API,建议从现在开始就在 API易 apiyi.com 平台上做几件事:一是统一所有视频模型调用的封装层;二是建立提示词 A/B 测试库;三是给关键业务流准备 Omni、Veo、Seedance 三套备份预设,避免发布日当天的额度抖动。

对 AI 视频行业格局的影响

OpenAI Sora 退出后,整个 AI 视频赛道的领头羊位置一直在 Veo、Seedance 和 Runway Gen-4 之间轮换。Gemini Omni 一旦真的支持原生音视频和长上下文,会把「Google 多模态护城河」直接迁移到视频生成领域,对其他厂商形成压力。

从生态角度看,Google 通过 Gemini App、Vertex AI、AI Studio 三条通路同时分发 Omni 的可能性极高。这意味着 Omni 既会出现在消费级聊天里,也会作为开发者 API 和企业代理工具被嵌入到现有产品里。如果团队需要在企业内部统一管理调用入口,可以通过 API易 apiyi.com 把 Omni、Veo、Seedance 的多个调用渠道收敛到同一份账单和审计日志下。

Gemini Omni 视频模型 I/O 2026 前后时间线

为了帮助团队制定接入计划,把当前公开情报按时间整理如下。注意 5 月 19 日之前的日期是已确认事件,之后是推测节奏。

| 阶段 | 时间 | 关键事件 |

|---|---|---|

| 灰度测试 | 2026-05-11 之前 | Google 内部测试 Omni 模型卡片 |

| UI 泄露 | 2026-05-11 | Reddit 截图曝光,多家英文媒体跟进 |

| 情报集中期 | 2026-05-12 至 5-18 | 各厂商、自媒体集中分析与预热 |

| 正式发布 | 2026-05-19 至 5-20 | Google I/O 2026 主题演讲与开发者通道 |

| API 上线 | 2026-05-20 之后 | Gemini API / Vertex AI / AI Studio 陆续开放 |

| 国内中转开放 | 与 API 上线同步 | API易 apiyi.com 等聚合平台跟进配置 |

常见问题

Q1: Gemini Omni 真的会在 I/O 2026 发布吗?

从 Google 的命名习惯和泄露节奏看,I/O 2026 是最合理的发布窗口,但是否在 5 月 19 日当天就开放 API 还要看 Google 的现场公告。建议把发布预期放在 5 月 19-20 日两天之内,再保留一周的灰度延后空间。

Q2: Gemini Omni 和 Veo 3.1 是什么关系?

目前有三种主流解读:Omni 是 Veo 的新对外名称、Omni 是 Veo 之外的新模型、Omni 是统一图像与视频的更上层 omni-model。结合泄露 UI 的描述,第三种可能性最高,但仍需 Google 官方确认。

Q3: 国内开发者能用上 Gemini Omni 吗?

只要 Google 在 Gemini API 与 Vertex AI 中开放 Omni 调用,国内开发者就可以通过 API易 apiyi.com 等聚合中转平台接入。建议提前在该平台上把 Gemini 系列的 base_url 配置好,避免发布当天临时折腾。

Q4: 早期 Demo 的画质看起来不如 Seedance 2,是否说明 Omni 不强?

不能简单这样判断。多家媒体推测当前 Demo 来自 Flash 层级,Omni Pro 仍未公开。同时 Omni 的差异化在编辑能力和原生音频,画质比拼并不是它的主战场。

Q5: 现在没必要等 Omni,先用哪个视频模型?

建议把 Veo 3.1 作为通用方案、Seedance 2 作为高画质方案、Hailuo 作为成本敏感方案。可以通过 API易 apiyi.com 一站式接入这三种模型,等 Omni 正式上线再加入第四条调用链。

总结

Gemini Omni 的提前曝光,把 Google I/O 2026 之前的视频模型讨论推到了最热位置。从已知情报看,它的核心卖点不在画质,而是聊天式编辑、原生音视频和长上下文这套组合拳,目标是把视频生成的工作流从编辑器搬进对话框。

在 5 月 19 日之前,最聪明的策略不是猜测细节,而是先把视频生成的基础设施搭好。把统一的多模型接口、提示词库、用量监控这三件事做好,Omni 来了切换成本就会很低。建议团队结合 API易 apiyi.com 等聚合平台提前做好部署,把后续接入 Gemini Omni 的工作量控制在 1-2 天之内。

作者: APIYI 技术团队

联系: 通过 API易 apiyi.com 获取 Gemini Omni 上线后的第一时间接入指南

更新时间: 2026-05-12