作者注:深度对比 GPT-image-2 与 Nano Banana Pro 在科研范式图、技术图表、含小字图片场景下的文字渲染能力,给出明确选型建议。

GPT-image-2 vs Nano Banana Pro 一直是科研工作者、技术博主、内容创作者关心的选择。本文对比 GPT-image-2 (gpt-image-1-2025) 和 Nano Banana Pro (Gemini 3 Pro Image),从科研范式图、含小字图表、专业术语渲染、技术原理图等维度给出明确建议。

这不是一份"看起来各有千秋"的折中分析。LM Arena 数据已经给出 +242 Elo 分的明确差距 (GPT-image-2: 1512 vs Nano Banana Pro: 1271),但很多用户并不清楚差距究竟体现在哪些场景。本文聚焦"高文字密度、科研图表"这一长期被低估的核心场景,给出可复现的实测结论。

核心价值: 看完本文,你将明确在科研范式图、技术架构图、含中英文小字标注、专业术语图表场景下,应该如何在 GPT-image-2 和 Nano Banana Pro 之间做出选择。

GPT-image-2 vs Nano Banana Pro 核心差异

在深入分析具体场景之前,先用一张表呈现两者在关键能力上的差异。

| 对比维度 | GPT-image-2 | Nano Banana Pro | 胜出 |

|---|---|---|---|

| 文字渲染准确率 | ~99% (Latin/CJK/Hindi/Bengali) | ~95% (短语/单词强,长段落弱) | GPT-image-2 |

| 小字与密集排版 | 2K 分辨率下小字清晰 | 长段落可读,但小字易模糊 | GPT-image-2 |

| 科研范式图 | 标注、公式、流程清晰 | 整体布局好,但术语易出错 | GPT-image-2 |

| 照片级真实感 | 偏向插画/UI 风格 | 业界领先级真实感 | Nano Banana Pro |

| 空间推理 | 仍有不足 | 多对象关系处理更稳 | Nano Banana Pro |

| 生成速度 | ~3 秒/张 | 10-15 秒/张 | GPT-image-2 |

| 最高分辨率 | 2K (~2048×2048) | 4K (5632×3072) | Nano Banana Pro |

| 核心机制 | O 系列推理 (Thinking) | Google Search Grounding | 各有特色 |

| LM Arena Elo | 1512 | 1271 | GPT-image-2 (+242) |

| 可用平台 | API易 apiyi.com、OpenAI 官方 | API易 apiyi.com、Google AI Studio | – |

GPT-image-2 文字渲染优势详解

GPT-image-2 是 OpenAI 在 2026-04-21 发布的下一代图像生成模型,内部代号 gpt-image-1-2025。它最核心的突破来自三处架构升级:第一,引入 O 系列推理 (Thinking) 机制,在生成前先规划构图、核对对象计数、校验提示约束;第二,将文字渲染从 GPT Image 1.5 的 95% 准确率推到 99% 以上 (LM Arena 实测口径);第三,在 2K 分辨率下保持小字、图标、UI 元素、密集排版的可读性。

对于科研范式图这种"高文字密度+多专业术语+精确标注"的场景,GPT-image-2 的优势是结构性的,不是"再多训练一点就能赶上"的渐进改进。它能稳定渲染希腊字母、化学式、统计公式、流程节点标签,而这正是 Nano Banana Pro 至今仍在挣扎的地方。

Nano Banana Pro 文字渲染优势详解

Nano Banana Pro (Gemini 3 Pro Image) 在 2025-11-20 由 Google DeepMind 发布,基于 Gemini 3 Pro 主干。它的优势在另一条路径上:长段落连贯文本、多语言本地化、配合 Google Search 进行的 grounding (基于真实信息的图像生成)。

在长段落 infographic、海报、营销素材这类"段落级文字+常规字号"的场景下,Banana Pro 仍然非常稳。但一旦切到科研范式图、电路图标注、坐标轴小字、公式角标这类"高密度小字",它的表现就会落后。

🎯 快速选型建议: 如果你的图像需求集中在"含大量小字、技术术语、公式标注的科研图/技术图",请优先选择 GPT-image-2;如果需求是"长段落正文+摄影级真实感",Nano Banana Pro 仍是优秀选择。两个模型都可以通过 API易 apiyi.com 平台用同一套接口调用,便于快速对比切换。

GPT-image-2 vs Nano Banana Pro 科研范式图实测

科研范式图 (Research Paradigm Diagram) 通常包含:研究框架的层级结构、阶段流程箭头、模块标签 (常含英文专业术语)、子说明文字 (8-10pt 小字)、有时还有公式或数据标注。这是 AI 生图模型的"硬骨头场景",因为它同时考验文字准确度、版式控制、空间关系。

实测案例 1:机器学习训练范式图

测试 Prompt:

A research paradigm diagram showing a machine learning training pipeline.

Three stages: "Data Preprocessing", "Model Training", "Evaluation".

Each stage has 2-3 sub-modules with English labels (e.g., "Tokenization",

"Backpropagation", "F1 Score"). Include arrows between stages.

Top title: "End-to-End ML Training Pipeline".

Bottom-right footer: "Figure 1. ML Paradigm v2.3".

Use academic style, white background, dark text.

实测结果对比:

| 检查项 | GPT-image-2 | Nano Banana Pro |

|---|---|---|

| 主标题拼写 | ✅ 100% 正确 | ✅ 100% 正确 |

| 三阶段标签 | ✅ 全部正确 | ⚠️ "Evaluation" 偶尔渲染为 "Evualation" |

| 子模块小字 (8pt) | ✅ "Tokenization" / "Backpropagation" 清晰 | ❌ 小字模糊,易出现字符混淆 |

| 箭头方向 | ✅ 阶段流向正确 | ✅ 阶段流向正确 |

| 角标 "Figure 1." | ✅ 完整渲染 | ⚠️ 偶尔丢失版本号 |

| 整体可读性 | ✅ 直接可用 | ⚠️ 需多次重生成 |

GPT-image-2 在这个场景下的关键优势是它会先"想清楚"再画。Thinking 机制把"三阶段+子模块+小字标注"作为约束统一规划,避免了边画边丢约束的问题。

实测案例 2:科研流程范式图含公式

测试 Prompt:

A scientific research paradigm flowchart with five boxes connected by arrows:

1. "Hypothesis: H₀ vs H₁"

2. "Data Collection (n=1000)"

3. "Statistical Test (α=0.05)"

4. "Compute p-value"

5. "Reject H₀ if p < α"

Use light blue boxes, dark text, sans-serif font, academic style.

实测结果:

GPT-image-2 几乎完美:希腊字母 α、下标 H₀ / H₁、不等号 < 都正确渲染,统计学专业读者可以直接拿来当 Figure 用。

Nano Banana Pro 的问题集中在希腊字母和下标:α 偶尔被渲染成 "a"、H₀ 经常变成 "Ho" 或 "H0" (普通数字而非下标)、不等号位置漂移。这些错误在长段落文本里几乎不会出现,但在科研图小字位置会暴露。

💡 技术建议: 对于含希腊字母、上下标、特殊数学符号的科研范式图,建议使用 GPT-image-2。如果需要在同一项目中快速切换两个模型对比效果,可通过 API易 apiyi.com 平台用统一接口调用,节省切换成本。

实测案例 3:技术架构图 (含密集英文术语)

测试 Prompt:

A technical architecture diagram with three layers:

- Top: "Application Layer" (FastAPI, Nginx, Redis)

- Middle: "Business Logic Layer" (Authentication, Rate Limiter, Cache Manager)

- Bottom: "Data Layer" (PostgreSQL, Elasticsearch, S3 Storage)

Use connecting arrows between layers. Dark theme, monospace font for tech names.

实测结果:

| 检查项 | GPT-image-2 | Nano Banana Pro |

|---|---|---|

| 技术栈名称 (FastAPI/Nginx 等) | ✅ 全部正确 | ⚠️ "Elasticsearch" 偶变 "Elasticseach" |

| 等宽字体一致性 | ✅ 整图统一 | ⚠️ 部分模块变体 |

| 层级标签 | ✅ 三层清晰 | ✅ 三层清晰 |

| 箭头连接逻辑 | ✅ 上下贯通 | ✅ 上下贯通 |

| 整体专业感 | ✅ 可直接用于技术博客 | ⚠️ 需修图后使用 |

GPT-image-2 小字渲染场景全面对比

科研范式图只是"高文字密度"的一类。我们继续把测试扩展到更多高文字密度场景。

数据图表的小字标注

数据可视化场景包括坐标轴刻度、图例、误差棒标签、数据点角标。Nano Banana Pro 在大字号 (主标题、副标题) 上表现合格,但坐标轴 6-8pt 的刻度标签会模糊或错乱。GPT-image-2 在 2K 分辨率下能稳定保持 6pt 小字的辨识度。

| 小字场景 | GPT-image-2 | Nano Banana Pro |

|---|---|---|

| 坐标轴刻度 (6-8pt) | ✅ 清晰可读 | ⚠️ 模糊或字符堆叠 |

| 图例标签 | ✅ 100% 准确 | ⚠️ 90% 准确 |

| 误差棒标注 | ✅ 数字精确 | ❌ 数字易乱 |

| 角标版本号 | ✅ 完整保留 | ⚠️ 偶尔丢失 |

UI 截图与界面元素

UI mockup 是另一个被严重低估的"高文字密度"场景。按钮文字、菜单项、表单标签、状态栏数字,全是小字。Banana Pro 在常规截图模仿上不错,但一旦有"密集列表+多状态徽章",就会出现字符错位。

GPT-image-2 在这一类场景里的表现接近 Photoshop 模板水平:所有按钮文字、状态徽章 ("Active", "Pending", "Failed" 等) 都能稳定渲染。

多语言混合场景 (中英日韩)

GPT-image-2 在 LM Arena 实测口径下,对 Latin、CJK (中日韩)、Hindi、Bengali 的字符级准确率都达到 ~99%。这意味着它可以稳定生成"中文标题+英文术语+日文注释"的混排图。

Nano Banana Pro 在单一语种上表现接近 GPT-image-2,但在 CJK 与 Latin 混排时会出现字距异常 (中文方块字与英文比例失调)。

# 通过 API易 统一接口调用两种模型快速对比

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# 调用 GPT-image-2

response_gpt = client.images.generate(

model="gpt-image-2",

prompt="A scientific paradigm diagram with...",

size="2048x2048",

quality="high"

)

# 调用 Nano Banana Pro (同一套接口)

response_banana = client.images.generate(

model="gemini-3-pro-image-preview",

prompt="A scientific paradigm diagram with...",

size="2048x2048"

)

查看完整对比测试代码

import openai

import time

from pathlib import Path

from typing import Optional, Literal

ModelName = Literal["gpt-image-2", "gemini-3-pro-image-preview"]

def generate_paradigm_diagram(

prompt: str,

model: ModelName,

output_dir: str = "./outputs",

size: str = "2048x2048",

quality: str = "high",

) -> dict:

"""

通过 API易 平台调用任一模型生成科研范式图。

返回包含: 模型名、生成耗时、输出路径、Token 用量。

"""

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

start = time.time()

response = client.images.generate(

model=model,

prompt=prompt,

size=size,

quality=quality,

n=1,

)

elapsed = time.time() - start

Path(output_dir).mkdir(parents=True, exist_ok=True)

output_path = f"{output_dir}/{model}_{int(start)}.png"

image_data = response.data[0].b64_json

with open(output_path, "wb") as f:

import base64

f.write(base64.b64decode(image_data))

return {

"model": model,

"elapsed_sec": round(elapsed, 2),

"output_path": output_path,

}

def compare_models(prompt: str) -> None:

"""对同一 Prompt 同时跑两个模型,输出对比报告。"""

print(f"开始对比测试 Prompt: {prompt[:80]}...\n")

for model in ["gpt-image-2", "gemini-3-pro-image-preview"]:

result = generate_paradigm_diagram(prompt, model)

print(f"[{model}] 耗时: {result['elapsed_sec']}s | 路径: {result['output_path']}")

if __name__ == "__main__":

paradigm_prompt = """

A research paradigm diagram showing ML training pipeline.

Three stages: Data Preprocessing, Model Training, Evaluation.

Each stage has sub-modules with English labels.

Title: 'End-to-End ML Training Pipeline'.

Footer: 'Figure 1. ML Paradigm v2.3'.

Academic style, white background.

"""

compare_models(paradigm_prompt)

🚀 快速开始: 推荐使用 API易 apiyi.com 平台快速搭建对比测试环境。该平台提供开箱即用的统一 API 接口,5 分钟即可完成两个模型的接入和并排测试。

GPT-image-2 vs Nano Banana Pro 文字渲染机制差异

为什么 GPT-image-2 在小字和科研图上能形成"结构性"领先?理解两个模型的底层机制差异,有助于你为不同任务选择最合适的工具。

GPT-image-2 的 O 系列推理 (Thinking) 机制

GPT-image-2 引入了 O 系列推理机制——这是 OpenAI 推理模型 (o1 / o3) 在图像领域的延伸。它在生成图像之前会先做三件事:

- 构图规划: 把 prompt 里的对象、文字、空间关系预先组织成一个"布局蓝图"

- 约束核验: 逐一核对"对象计数"、"文字内容"、"小字位置"是否被规划进去

- 冲突解决: 处理潜在的提示冲突 (例如"占满画面"vs"留白")

对于科研范式图这种"约束密集"的场景,每个小字标签都是一个独立约束。普通扩散模型在生成过程中容易"边画边丢约束",而推理机制把所有约束作为整体规划,显著降低了"漏字、错字、字符堆叠"的概率。

Nano Banana Pro 的 Grounding + 段落语义机制

Nano Banana Pro 基于 Gemini 3 Pro 主干,它的优势来自两个不同方向:

- Google Search Grounding: 在生成时可以检索真实信息 (例如"2026 年 4 月的最新汇率"、"奥运会赛程"),把可检索数据嵌入图像

- 段落级语义连贯: 强语言模型能力让长段落保持语法和拼写一致

这两个机制对"长段落 infographic"和"基于真实数据的可视化"非常友好,但对"碎片化小字标签"帮助不大——小字标签往往是命名实体 (产品名、术语缩写),没有充分的语义上下文。

| 机制特征 | GPT-image-2 (Thinking) | Nano Banana Pro (Grounding) |

|---|---|---|

| 适用文本类型 | 碎片化小字、专业术语 | 长段落、可检索信息 |

| 约束处理方式 | 提前规划,统一核验 | 边生成边语义检查 |

| 错字根源 | 极少 (~1%) | 主要在小字、专有名词 |

| 速度影响 | 推理快,~3 秒 | Grounding 检索拖慢,~10-15 秒 |

| 最适合场景 | 科研图、UI、技术图 | 海报、长段落、实时数据图 |

为什么"小字"是分水岭

字号大小不是问题的本质,问题的本质是"信息密度 / 像素"。当一个 8pt 标签需要在 50×20 像素区域内画清楚 12 个字符,模型需要在极小空间里同时处理字形、间距、对齐、像素抖动。这是一个"高约束密度"场景,O 系列推理的优势在这里被完全放大。

🎯 技术建议: 如果你的项目同时涉及科研图和长段落 infographic,建议在工程侧做模型路由——按"字号阈值"自动分流到不同模型。这套路由可以通过 API易 apiyi.com 平台一套接口实现,无需对接两套 SDK,降低工程复杂度。

GPT-image-2 vs Nano Banana Pro Prompt 工程对比

两个模型的"调教方式"也不一样。同样的需求,prompt 写法不同会带来明显的质量差异。

GPT-image-2 友好的 Prompt 模式

GPT-image-2 偏好"结构化指令 + 显式约束",模仿它的 O 系列推理风格。

推荐写法:

A research paradigm diagram with the following elements:

Title (top center, 24pt bold): "End-to-End ML Pipeline"

Three stages (left to right, connected by arrows):

1. "Data Preprocessing" (sub-modules: Tokenization, Normalization)

2. "Model Training" (sub-modules: Forward Pass, Backpropagation)

3. "Evaluation" (sub-modules: F1 Score, ROC-AUC)

Footer (bottom-right, 8pt): "Figure 1. ML Paradigm v2.3"

Style: academic, white background, dark blue boxes, sans-serif font.

关键点:用编号列表、明确字号、明确位置,让 Thinking 机制可以"逐项核验"。

Nano Banana Pro 友好的 Prompt 模式

Nano Banana Pro 偏好"自然语言描述 + 上下文叙事",更接近创作型写作。

推荐写法:

A clean academic-style research paradigm diagram showing

how a machine learning pipeline progresses through three

stages: starting with data preprocessing where raw inputs

are tokenized and normalized, then moving to model training

where forward passes and backpropagation iterate, and

finally reaching evaluation where F1 score and ROC-AUC

are computed. Connect the stages with arrows. Title at top:

"End-to-End ML Pipeline". Use a clean, white background

with dark blue rounded boxes.

关键点:把流程"讲故事",让 Gemini 主干模型用语义连贯能力把整体感处理好。

Prompt 调优速查表

| 优化点 | GPT-image-2 写法 | Nano Banana Pro 写法 |

|---|---|---|

| 文字内容 | 用引号包裹: "Figure 1" |

自然语言: showing "Figure 1" |

| 元素列表 | 编号 1./2./3. | 自然连接词: first… then… |

| 字号指定 | 显式: 8pt small print |

描述: tiny annotation |

| 位置指定 | 精确: top-right corner |

自然: in the upper right |

| 风格指定 | 关键词: sans-serif, academic |

句式: clean academic style |

| 约束强度 | 越显式越好 | 自然语言更稳 |

通用技巧 (两个模型都适用)

- 关键文字必须用引号包裹: 否则模型可能"意译"你的文字

- 8pt 小字尽量少: 即使是 GPT-image-2,也建议不超过 5-6 个独立小字标签

- 避免冲突约束: "极简风" + "信息密集"会让两个模型都困惑

- 生成 3-4 张取最佳: 文字渲染本身有概率性,多生成几张是行业标准做法

🚀 快速开始: 通过 API易 apiyi.com 平台搭建对比测试管线,可以在同一个 prompt 上一次性请求两个模型并并排展示输出,5 分钟内完成搭建,便于快速找到最适合自己业务的模型组合。

GPT-image-2 vs Nano Banana Pro 场景推荐

经过多轮实测,我们可以给出明确的场景级选型建议。

优先选择 GPT-image-2 的场景

- 科研范式图: 高密度小字+专业术语+流程箭头,GPT-image-2 的 Thinking 机制和 99% 文字准确率是结构性优势

- 技术架构图: 含技术栈名称 (FastAPI/Elasticsearch/PostgreSQL 等易拼错的英文专有名词)

- 数据可视化: 坐标轴刻度、图例、误差棒、角标等 6-8pt 小字

- UI 截图与 mockup: 按钮文字、状态徽章、菜单项等密集 UI 文字

- infographic 海报: "Intelligence Layer" 这类专业标题+小字注脚的混排

- 多语言混排: 中英日韩混合标注的图表

- 公式与符号: 含 α/β/H₀/p-value 等希腊字母、上下标、统计符号

- 快速迭代: ~3 秒/张的生成速度便于反复调优

优先选择 Nano Banana Pro 的场景

- 照片级真实感: 产品摄影、人像、建筑摄影等高真实度需求

- 长段落 infographic: 文章式排版,文字以段落为单位 (而非小字标签)

- 基于实时信息的生成: 需要 Google Search grounding 抓取最新数据 (如最新汇率、最新事件)

- 4K 高分辨率: GPT-image-2 当前最高 2K,Banana Pro 可达 4K (5632×3072)

- 多参考图编辑: Banana Pro 支持最多 14 张参考图,编辑场景更灵活

- 空间关系复杂场景: 多对象的前后/左右/上下空间关系,Banana Pro 仍有优势

- 大段中文段落: 中文长段落 (而非小字标签) 的排版稳定性

两者皆可的"中间地带"

- 单一主标题+副标题的常规配图

- 简单 logo 设计

- 风格化插画 (扁平/水彩/像素风)

- 不含专业术语的封面图

💡 场景化决策原则: 文字越密、字号越小、术语越专业,越要选 GPT-image-2;文字越长、需要真实感、需要实时信息,越要选 Nano Banana Pro。两个模型都可在 API易 apiyi.com 平台一键切换,无需重复对接。

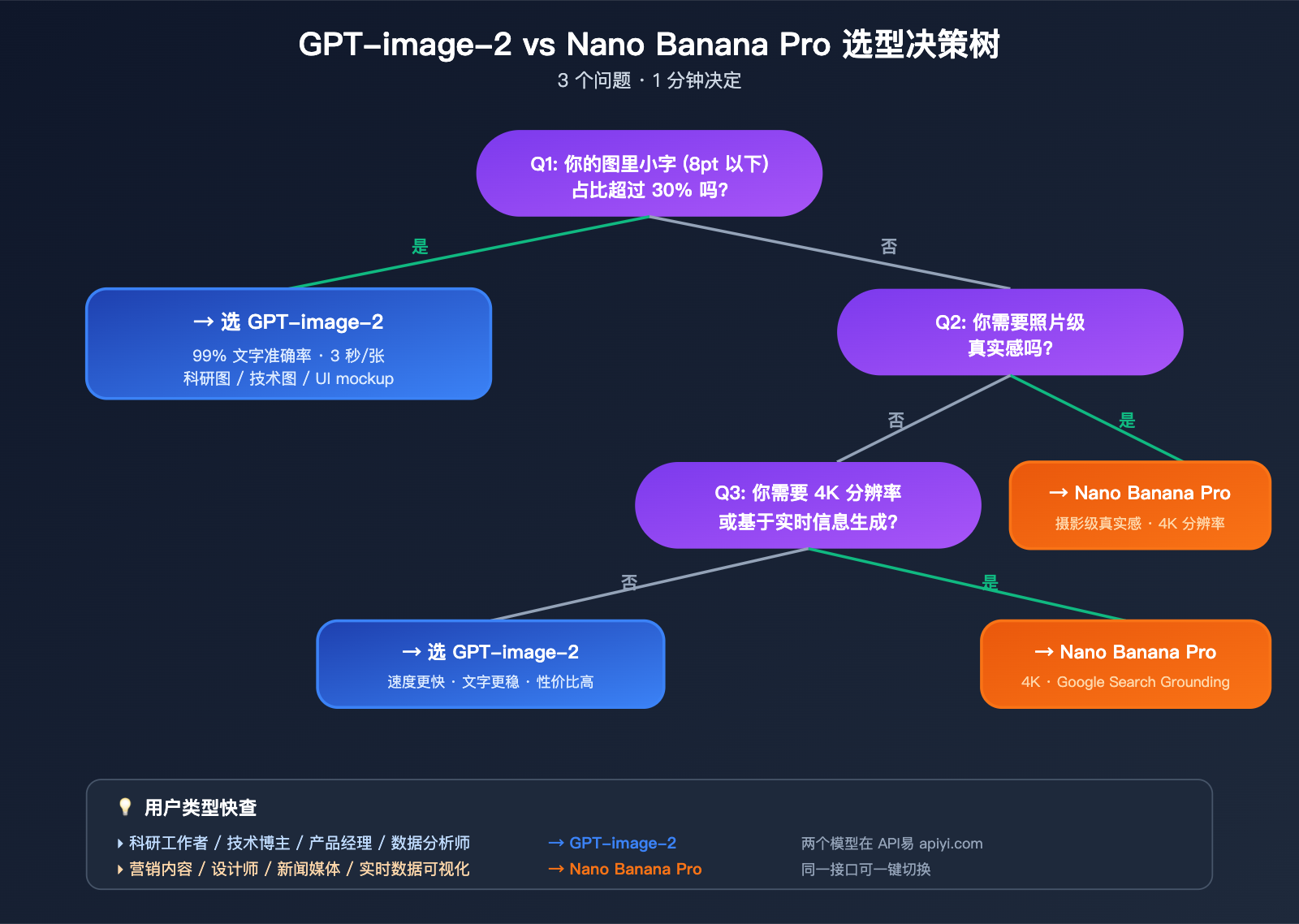

GPT-image-2 vs Nano Banana Pro 决策建议

决策树:3 个问题决定选哪个

问题 1: 你的图里"小字 (8pt 以下)"占比超过 30% 吗?

- 是 → GPT-image-2

- 否 → 进入问题 2

问题 2: 你需要照片级真实感吗?

- 是 → Nano Banana Pro

- 否 → 进入问题 3

问题 3: 你需要 4K 分辨率或基于实时信息生成吗?

- 是 → Nano Banana Pro

- 否 → GPT-image-2 (速度更快、文字更稳)

不同用户群体的推荐

| 用户类型 | 主要场景 | 首选模型 | 理由 |

|---|---|---|---|

| 科研工作者 | 论文配图、范式图、流程图 | GPT-image-2 | 公式、希腊字母、专业术语稳定 |

| 技术博主 | 架构图、API 流程图、代码示意图 | GPT-image-2 | 技术名词无错拼,UI 截图逼真 |

| 产品经理 | 产品截图 mockup、流程图 | GPT-image-2 | UI 元素文字渲染优势明显 |

| 数据分析师 | 图表小字、坐标轴标注 | GPT-image-2 | 6-8pt 小字稳定 |

| 营销内容 | 海报、长段落 infographic | Nano Banana Pro | 长段落排版+真实感更强 |

| 设计师 | 照片合成、产品摄影 | Nano Banana Pro | 真实感和细节质感领先 |

| 新闻媒体 | 实时信息可视化 | Nano Banana Pro | Google Search grounding 优势 |

成本与速度考量

GPT-image-2 在 LM Arena 实测中单张约 3 秒,Nano Banana Pro 通常 10-15 秒。如果你的工作流是"反复迭代调整 prompt 直到满意",GPT-image-2 的速度优势能显著缩短迭代周期。

💰 成本优化: 对于需要大批量生成科研图/技术图的团队,建议通过 API易 apiyi.com 平台调用两个模型。该平台提供灵活的计费方式和多模型统一管理,便于按场景切换最经济的模型,适合中小团队和个人开发者。

GPT-image-2 vs Nano Banana Pro 常见问题

Q1: GPT-image-2 真的能”吊打” Nano Banana Pro 吗?

要看场景。在 LM Arena 文生图榜单上,GPT-image-2 (1512 Elo) 比 Nano Banana Pro (1271 Elo) 高 +242 分,是 LM Arena 历史上最大的领先差距。但这一差距主要来自文字渲染、UI 重构、世界知识等维度。在照片级真实感、空间推理上,Nano Banana Pro 仍有优势。所以"吊打"的说法在"含小字图、科研图、UI 图"场景下成立,在"摄影级真实感"场景下不成立。建议通过 API易 apiyi.com 平台同时接入两个模型,按场景切换。

Q2: GPT-image-2 的 99% 文字准确率是真的吗?

LM Arena 实测和早期测试者报告确认了这一数据,且适用于 Latin、中日韩 (CJK)、Hindi、Bengali 等多种文字体系。但要注意"99%"是字符级准确率,不是 100%。在极端场景 (5pt 以下超小字、罕见专业符号、复杂数学公式嵌套) 仍有少量错误。对比之下,GPT Image 1.5 是 95%、GPT Image 1 是 90%、Nano Banana Pro 在长段落场景接近 95%、在小字场景下降到约 80-85%。

Q3: 我用 GPT-image-2 生成科研范式图时,希腊字母 α 还是会偶尔出错怎么办?

可以在 prompt 里明确写 "Use Unicode Greek letter alpha (α, U+03B1)" 这种提示,配合 Thinking 模式 (默认开启) 命中率会更高。如果仍出错,建议生成 3-4 张取最佳,或在 prompt 里改成英文 "alpha"+后期 PS 替换。多次实验后再决定。

Q4: 为什么 Nano Banana Pro 长段落文字反而更稳?

Nano Banana Pro 基于 Gemini 3 Pro 主干,受益于强语言模型的"段落级语义连贯"能力。它把长段落当作"语义单元"来处理,整体语法和拼写很稳。但小字标签是"碎片化命名实体",没有语义上下文做约束,所以容易出错。GPT-image-2 通过 O 系列推理把"小字标签作为约束"提前规划,绕开了这个问题。

Q5: GPT-image-2 和 Nano Banana Pro 在 API易 平台调用方式一样吗?

是的。API易 apiyi.com 平台为多种主流图像模型提供统一的 OpenAI-Compatible 接口,仅需更换 model 字段 (gpt-image-2 或 gemini-3-pro-image-preview) 即可切换,base_url 和 SDK 调用方式保持一致。这对需要做 A/B 对比、按场景路由模型的项目特别友好,避免维护多套 SDK 的成本。

Q6: 我以前用 BananaPro 习惯了,迁到 GPT-image-2 需要重新调 prompt 吗?

需要小幅调整,但成本不大。Nano Banana Pro 偏好"自然语言描述+上下文",GPT-image-2 在结构化指令下表现更好。建议在 prompt 里加入:1) 明确的元素列表 (用 1./2./3. 编号);2) 字体风格指定 (sans-serif/monospace/serif);3) 关键文字用引号包裹 (例如 "Figure 1. ML Paradigm")。其他描述风格保持不变即可。

Q7: 两个模型都生成失败时怎么排查?

按以下顺序排查:1) 检查 prompt 是否触发内容审核 (人物面部、敏感内容);2) 缩短 prompt,去掉冲突约束 ("photorealistic" 同时要 "minimalist illustration");3) 调整 size/quality 参数;4) 切到另一个模型试试;5) 如果是 API 报错,可在 API易 apiyi.com 控制台查看详细错误码和重试策略。

Q8: 哪些场景下 GPT-image-2 也会输给 Nano Banana Pro?

主要三类:1) 4K 超高分辨率 (Banana Pro 支持 5632×3072,GPT-image-2 最高 2K);2) 多对象空间推理 (例如"5 个物品在 3 个柜子里的特定位置");3) 超长段落 infographic (200 字以上段落连贯排版)。这些场景建议直接选 Nano Banana Pro。

GPT-image-2 vs Nano Banana Pro Key Takeaways

- 文字渲染断崖式领先: GPT-image-2 在 LM Arena 文生图榜单 +242 Elo 分领先 Nano Banana Pro,是 LM Arena 历史最大差距,主要来自 ~99% 字符级文字准确率

- 科研图场景结构性优势: 在科研范式图、技术架构图、数据可视化、UI mockup 等"高文字密度"场景,GPT-image-2 的 O 系列推理 + 99% 准确率构成结构性优势

- 小字与公式稳定: 6-8pt 坐标轴刻度、希腊字母、上下标、统计符号在 GPT-image-2 下稳定渲染,Nano Banana Pro 在这些细节上仍易出错

- 生成速度领先 3-5 倍: GPT-image-2 单张约 3 秒,Nano Banana Pro 单张 10-15 秒,对快速迭代场景是巨大优势

- Banana Pro 仍有专属优势: 4K 分辨率、照片级真实感、长段落连贯文本、Google Search grounding、多对象空间推理是其继续领先的领域

- 场景化选型原则: 文字越密/字号越小/术语越专业 → GPT-image-2;需要真实感/4K/实时信息 → Nano Banana Pro

- 统一接口降低切换成本: 通过 API易 apiyi.com 平台可用同一套 SDK 切换两个模型,便于按场景路由,避免维护多套对接代码

总结

GPT-image-2 vs Nano Banana Pro 这个对比,在不同场景下会得到完全不同的结论。如果只看 LM Arena 整体榜单,GPT-image-2 +242 Elo 的领先确实"吊打"。但深入到具体场景,两者的相对优势是清晰且可预测的:

- 科研范式图、含小字的技术图、含专业术语的图表 → 选 GPT-image-2

- 照片级真实感、长段落 infographic、需要实时信息的图 → 选 Nano Banana Pro

对于以"作图含大量文字、特别是小字" 为核心需求的科研工作者、技术博主、产品经理,GPT-image-2 的能力跃迁是真实且可感的:从 GPT Image 1 的 90% 到 GPT Image 1.5 的 95% 再到 GPT-image-2 的 99%,每一代都把"AI 生成的图能不能直接用"的边界往前推了一大步。

推荐通过 API易 apiyi.com 平台同时接入两个模型,根据具体任务类型动态切换,把每个模型用在它最擅长的场景,而不是把所有需求都押在一个模型上。

参考资料

-

OpenAI ChatGPT Images 2.0 官方公告: GPT-image-2 发布说明

- 链接:

openai.com/index/introducing-chatgpt-images-2-0 - 说明: 官方 2026-04-21 发布说明、模型能力清单

- 链接:

-

Google DeepMind Nano Banana Pro 官方页: Gemini 3 Pro Image 模型说明

- 链接:

deepmind.google/models/gemini-image/pro - 说明: 官方能力描述、定价、参考图数量等

- 链接:

-

LM Arena Text-to-Image Leaderboard: 文生图模型 Elo 排行

- 链接:

arena.ai/leaderboard/text-to-image - 说明: GPT-image-2 1512 Elo vs Nano Banana Pro 1271 Elo

- 链接:

-

Simon Willison Nano Banana Pro 实测: 独立开发者实测报告

- 链接:

simonwillison.net/2025/Nov/20/nano-banana-pro - 说明: 4K 分辨率实测、infographic 案例

- 链接:

-

VentureBeat ChatGPT Images 2.0 报道: 多语言 + infographic 测评

- 链接:

venturebeat.com/technology/openais-chatgpt-images-2-0-is-here - 说明: 多语种文字渲染、漫画/地图/海报实测

- 链接:

作者: APIYI 技术团队 | 更多 AI 大模型 API 接入与对比,欢迎访问 API易 apiyi.com 进行实际测试。