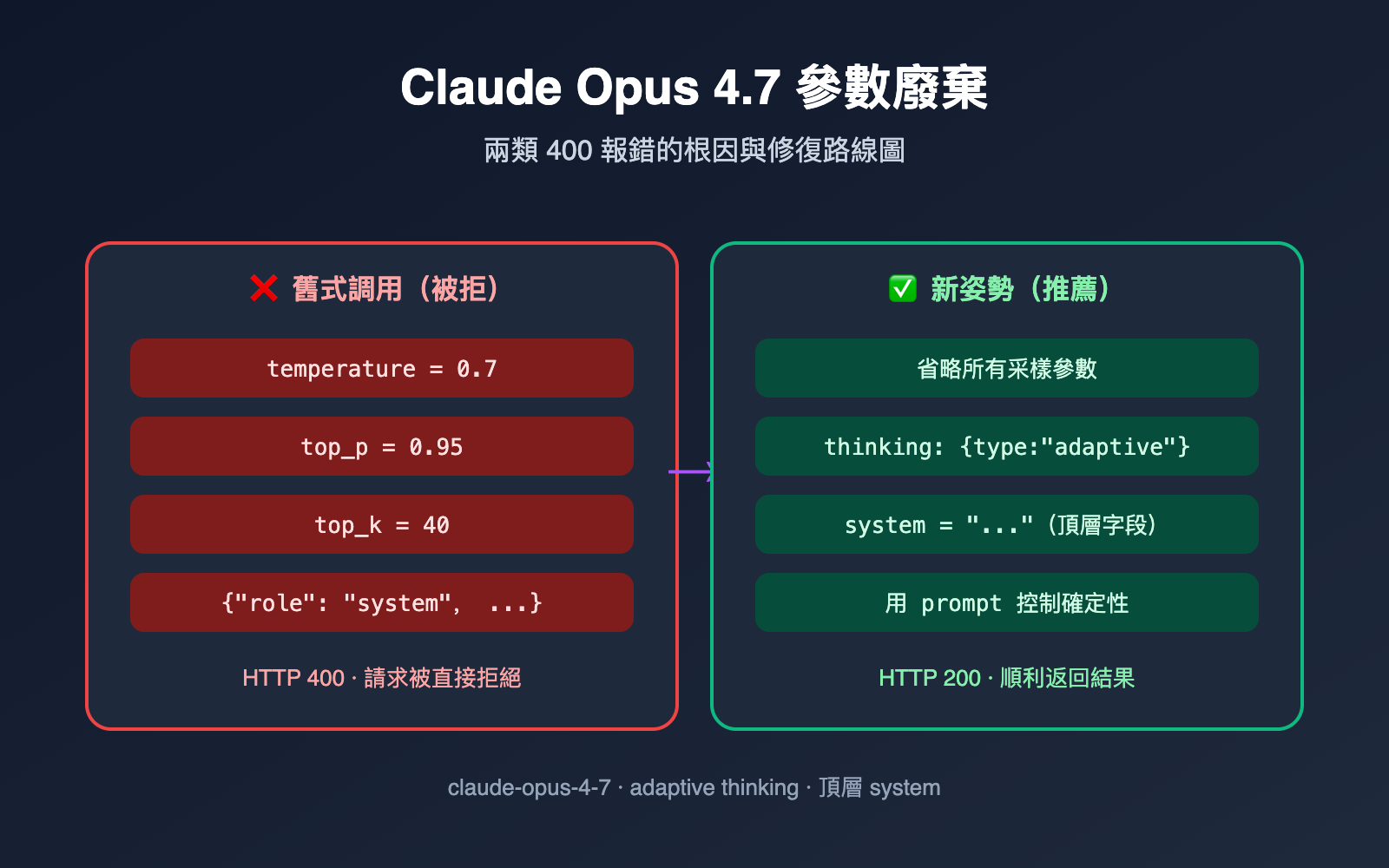

作者注:Claude Opus 4.7 廢棄了 temperature、top_p、top_k 等採樣參數,並要求 system 走頂層而非消息角色。本文講清 2 大常見 400 報錯的根因與代碼修復方案。

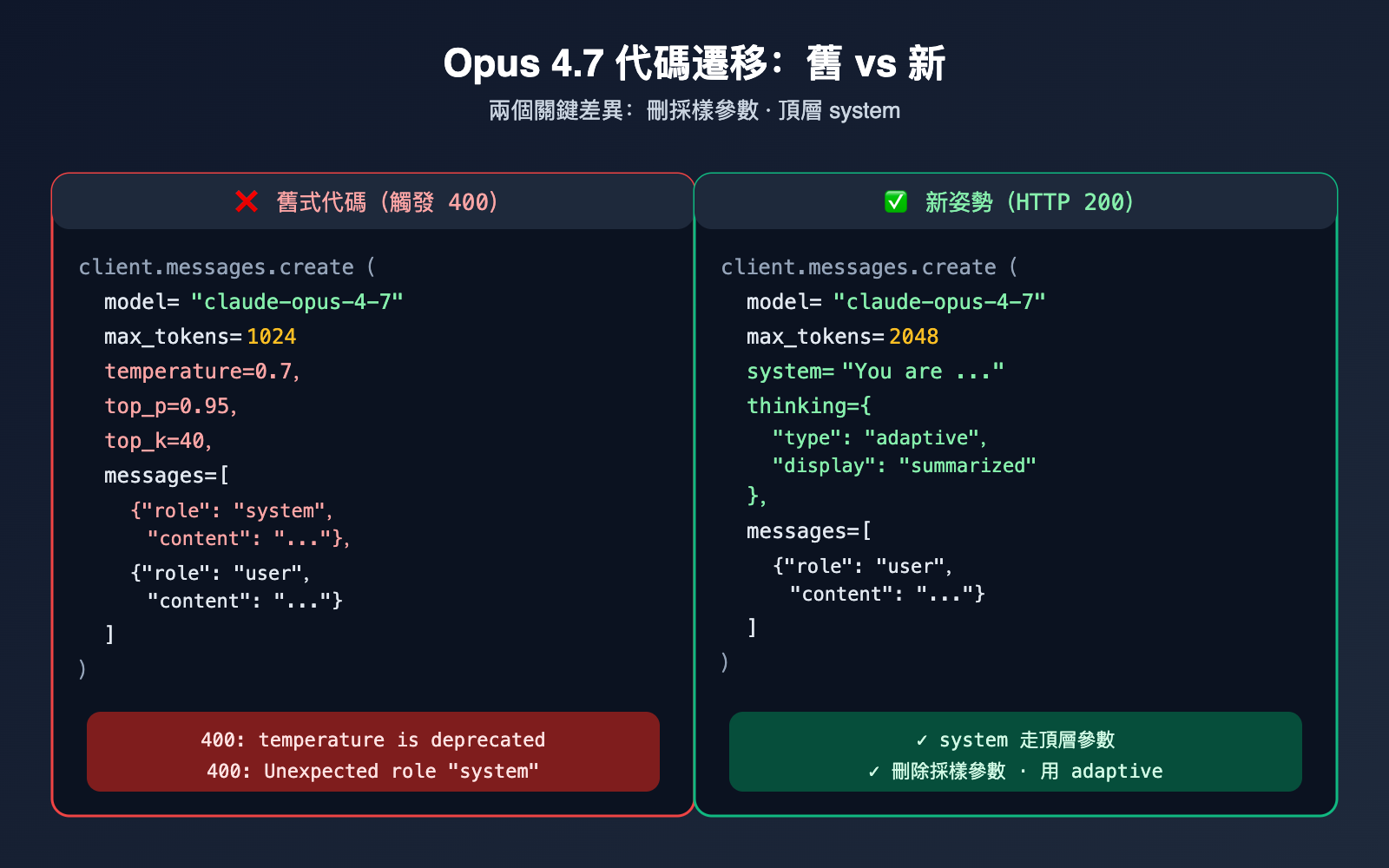

升級到 Claude Opus 4.7 之後,最容易被開發者卡住的不是模型本身,而是請求參數。第一個高頻報錯是 temperature is deprecated for this model,第二個則是 Unexpected role "system". The Messages API accepts a top-level system parameter, not "system" as an input message role。兩個錯誤都是 HTTP 400,看起來無關,背後卻指向同一個事實:Anthropic 在 Opus 4.7 上做了一次相對激進的 API 收斂。

很多團隊在沒看清這次變動前,會習慣性地把"溫度調到 0"或者"再加一條 system 消息"作爲提高確定性的銀彈。Opus 4.7 直接堵死了這兩條路。這篇指南會從原因、報錯、修復三個角度,把這兩類問題徹底講清楚,並附上能直接複製的遷移代碼。看完之後,你不僅能在 10 分鐘內排除掉手頭的 400 報錯,還能理解 Anthropic 這次設計變更背後的深層邏輯,避免在下一次模型升級時再次踩坑。

Claude Opus 4.7 廢棄了哪些參數

理解報錯之前,先看一份完整的"廢棄清單"。Anthropic 在 Opus 4.7 上做的變動比看起來要多,影響面也比 4.6 時代的 deprecation 大很多。

| 參數 | 狀態 | 行爲 | 替代方案 |

|---|---|---|---|

temperature |

廢棄 | 設置任意非默認值返回 400 | 完全省略,用 prompt 控制隨機性 |

top_p |

廢棄 | 同上 | 完全省略 |

top_k |

廢棄 | 同上 | 完全省略 |

thinking.budget_tokens |

移除 | 顯式預算返回 400 | thinking: { type: "adaptive" } |

reasoning_effort(舊式) |

移除 | 舊字段不再生效 | output_config: { effort: "max" } |

消息中的 role: "system" |

不支持 | 歷來如此,但在 4.7 報錯更嚴格 | 頂層 system 參數 |

🎯 升級前必看:若你用 Python SDK,舊代碼裏出現

temperature=0.7、top_p=0.95或messages=[{"role": "system", ...}]任意一項,都會在 Opus 4.7 上拋 400。我們建議通過 API易 apiyi.com 接入 Opus 4.7,平臺對參數兼容做了優雅降級,可以平滑過渡到新接口。

清單裏最容易忽視的是 thinking 參數。Opus 4.6 時代你可以傳 thinking: {"type": "enabled", "budget_tokens": 8000} 讓模型多想一會兒,但在 Opus 4.7 上這種用法直接被拒。新版本只接受 adaptive 類型,由模型自行決定推理強度,而且 adaptive thinking 默認是關閉的,需要顯式打開。

另一個隱藏的變動是 tokenizer。Opus 4.7 使用了新的 tokenizer,同一段文本在新模型上的 token 數會比 4.6 多 0% 到 35%。這意味着你按 4.6 估算的成本預算,在 4.7 上很可能"無聲漲價",需要重新覈對賬單。

爲什麼 Claude Opus 4.7 要廢棄 temperature 參數

理解這次變動的內在邏輯,能讓你少踩很多坑。Anthropic 之所以在 Opus 4.7 上"收回" temperature、top_p、top_k 這三個採樣參數,本質上是把模型從"可調參數庫"轉向了"自適應黑盒"。

從模型架構來看,Opus 4.7 把推理強度的控制權交給了 adaptive thinking 模塊,這一模塊本身就內含了對不確定性的調度。也就是說,溫度這一類"在採樣層調節隨機性"的手段,已經無法和模型內部的推理邏輯兼容,強行設置反而會破壞新版的優化路徑。Anthropic 在文檔裏直接給出了結論:在內部評測裏,adaptive thinking 穩定優於 extended thinking 加手動 temperature 的組合。

換個角度看,這次"砍掉旋鈕"也是一次面向新手的友好升級。過去開發者調 LLM 時,最容易陷入"是不是溫度調得不對"的玄學糾結,調來調去既找不到最優值,也無法解釋結果差異。Opus 4.7 直接把這條"似是而非"的優化路徑關上,讓大家把精力放到 prompt 設計和上下文管理這些真正能穩定帶來收益的事情上。

從工程實踐來看,三大采樣參數的廢棄也意味着 Anthropic 不再鼓勵"靠調溫度提穩定性"這種古早做法。新版的推薦姿勢是用 prompt 工程明確"你需要確定性的答案"、"請輸出嚴格 JSON"等,讓模型在語義層自我約束,而不是在採樣層硬控。我們建議團隊在用 API易 apiyi.com 調用 Opus 4.7 時,把原本依賴 temperature=0 的代碼逐步遷移到"在 system prompt 中明確要求確定性"的寫法。

這一思路其實和 GPT-5.5 的"五檔 reasoning effort"形成對照。OpenAI 是"給開發者更細的開關",Anthropic 是"把開關收回去交給模型自己",兩種哲學沒有誰對誰錯,但都明顯在弱化傳統 hyperparameter 調優的角色。對開發者最大的啓示是:未來的 LLM 調優,重心會從"調旋鈕"轉向"寫好提示詞與上下文"。

值得一提的是,Anthropic 這次"激進收斂"並非沒有先兆。Opus 4.6 時代就已經在文檔裏把 extended thinking 標記爲 deprecated,並提示開發者向 adaptive thinking 過渡。如果你那時就開始按推薦姿勢寫代碼,這次 4.7 升級幾乎是零成本的;反之,如果你一直靠"調高 temperature 拉創意、調低 temperature 拉穩定"這套老打法,那麼這次遷移會比較痛。

temperature 參數報錯 400 的修復方案

知道了原因,修復就很直接。下面給出最小修復示例,配合 API易 apiyi.com 的 base_url 即可在國內穩定運行。

# pip install anthropic

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # 通過 API易統一調用 Opus 4.7

)

# ❌ 舊代碼:會觸發 temperature is deprecated 400

# response = client.messages.create(

# model="claude-opus-4-7",

# max_tokens=1024,

# temperature=0.7,

# top_p=0.95,

# messages=[{"role": "user", "content": "Hello"}]

# )

# ✅ 新代碼:完全省略採樣參數

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You must return strict JSON. No extra commentary.",

messages=[{"role": "user", "content": "Hello"}]

)

🎯 快速修復建議:把

base_url切到https://api.apiyi.com,並使用 API易 apiyi.com 發放的 Anthropic 兼容 Key,舊代碼裏只需刪掉三行採樣參數即可跑通。如果你擔心一時改不完,API易 apiyi.com 默認對廢棄參數做了平滑降級,可以爲你的遷移留出緩衝期。

下面這張表整理了三種典型遷移姿勢,幫你選擇最合適的方案。

| 舊用法 | 新姿勢 | 收益 |

|---|---|---|

temperature=0 追求確定性 |

system prompt 寫"返回嚴格 JSON,不要多餘文字" | 輸出更穩,token 更省 |

temperature=1 追求創意 |

不設置任何採樣參數,讓模型自由發揮 | 更接近 4.7 的原生表現 |

top_p / top_k 限制採樣 |

配合 adaptive thinking 的 effort: "max" |

用推理深度替代採樣裁剪 |

如果你接的是 OpenAI 兼容協議(很多三方框架默認這一套),還需要額外檢查 SDK 是否在底層強塞 temperature=1.0。社區裏已經有不少 Issue 是因爲框架硬編碼默認值導致 Opus 4.7 拒絕請求,遇到這種情況要麼升級框架,要麼走 API易 apiyi.com 的兼容層。

system 角色報錯的本質與修復

第二個高頻 400 報錯和 temperature 沒關係,是個老問題在新模型上"重新被放大"。Anthropic 的 Messages API 從未支持過把 system 寫成消息角色,但很多從 OpenAI Chat Completions 遷移過來的代碼會下意識地這麼寫,於是就觸發了 Unexpected role "system" 報錯。

理解這件事的關鍵在於:Anthropic 把 system 視爲"會話級配置"而不是"對話內容"。它必須出現在請求體頂層,而不是 messages 數組裏。下面這張表對照了 OpenAI 和 Anthropic 的差異。

| 項目 | OpenAI Chat Completions | Anthropic Messages |

|---|---|---|

| system 位置 | messages 數組首條 |

請求體頂層 system 字段 |

| system 數量 | 可以多條 | 僅一個字符串 |

| 在 4.7 報錯 | 無 | Unexpected role "system" 400 |

| 遷移難度 | — | 低,僅需移動位置 |

🎯 遷移提示:如果你的項目裏有"OpenAI / Claude 雙跑"邏輯,建議封裝一層適配器:調 OpenAI 時把 system 放進 messages,調 Claude 時改成頂層

system。通過 API易 apiyi.com 接入兩邊模型,可以用同一套 Key 體系管理,避免重複配置。

修復方法非常直接。下面是錯誤寫法與正確寫法的對比,照搬即可。

# ❌ 錯誤寫法:觸發 Unexpected role "system" 400

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

messages=[

{"role": "system", "content": "You are a coding assistant."},

{"role": "user", "content": "Write a quicksort in Python."}

]

)

# ✅ 正確寫法:system 走頂層參數

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=1024,

system="You are a coding assistant.",

messages=[

{"role": "user", "content": "Write a quicksort in Python."}

]

)

需要補充一句的是,如果你確實想給 Claude"多段 system 指令",正確做法是把它們合併成一個字符串,用換行或者編號分隔。Anthropic SDK 也支持把 system 字段做成數組形式的 content block,但這是高階用法,新手按"單字符串"理解即可。這樣寫還有一個隱藏收益:合併成單字符串後,更容易觸發 API易 apiyi.com 的提示緩存命中,長跑任務的成本會進一步下降。

Claude Opus 4.7 完整遷移代碼模板

把兩類報錯的修復合在一起,下面這段代碼就是"一份能直接跑的 Opus 4.7 起手式",包含 adaptive thinking、system 頂層參數和緩存計費友好的寫法。

from anthropic import Anthropic

client = Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com" # 通過 API易調用 Opus 4.7

)

response = client.messages.create(

model="claude-opus-4-7",

max_tokens=2048,

system="You are an expert Python engineer. Always return strict JSON.",

thinking={

"type": "adaptive",

"display": "summarized"

},

messages=[

{"role": "user", "content": "Refactor my quicksort to be O(n log n) average."}

]

)

print(response.content[0].text)

🎯 生產環境建議:在 API易 apiyi.com 調用 Opus 4.7 時,把穩定不變的 system prompt 與工具描述前置,觸發緩存計費 0.1x,重複請求的成本能壓到原價的 10%。這對長跑 Agent、文檔生成類任務尤其友好。

實際遷移時還有幾個小細節值得留意。第一,thinking 字段不是必填,但如果你的任務對推理深度敏感,建議顯式打開 adaptive thinking,否則模型會保持默認的輕量推理模式。第二,由於新 tokenizer 會讓同樣的文本多算 0% 到 35% token,max_tokens 的預算要相應上調,否則可能在長輸出場景被截斷。第三,舊版的 thinking_budget 等周邊參數也要一併清掉,殘留字段不會報錯但會被忽略,容易讓你誤以爲還在生效。第四,如果你的應用同時調用 4.6 和 4.7,最好按模型名記錄賬單口徑,避免新舊 tokenizer 混淆導致成本歸因失真。

如果你正在維護一份既要兼容 Opus 4.6 又要兼容 Opus 4.7 的代碼庫,最穩的做法是按模型名做參數白名單。把"採樣參數 + 舊 thinking 字段"在調 4.7 時跳過,在調 4.6 時保留,這樣不必爲不同模型維護兩套調用函數。

下面這張報錯速查表彙總了 Opus 4.7 升級過程中最常見的幾類 400 錯誤,方便你按報錯文本直接定位修復點。

| 報錯關鍵字 | 報錯含義 | 修復方法 |

|---|---|---|

temperature is deprecated |

傳入了被廢棄的 temperature 字段 | 從請求體裏完全刪除 temperature |

top_p is deprecated |

傳入了被廢棄的 top_p 字段 | 刪除 top_p,讓模型自適應 |

top_k is deprecated |

傳入了被廢棄的 top_k 字段 | 刪除 top_k,讓模型自適應 |

| Unexpected role "system" | system 寫在了 messages 數組裏 | 改爲請求體頂層 system 字段 |

Invalid budget_tokens |

用了舊版 extended thinking 預算 | 改爲 adaptive thinking 不傳 budget |

Unknown parameter reasoning_effort |

用了舊版推理強度字段 | 改爲 output_config: {effort: "max"} |

Claude Opus 4.7 參數廢棄常見問題

Q1:爲什麼 Opus 4.7 要一次性廢棄這麼多參數?

核心原因是 adaptive thinking 接管了原本由 temperature、top_p、top_k、thinking budget 各自負責的"控制隨機性與推理深度"職責。Anthropic 內部評測顯示,adaptive thinking 穩定優於人工調參,所以選擇把入口收斂。

Q2:能不能把 temperature 設成 1.0 來"繞過"報錯?

不能。Opus 4.7 對採樣參數的判斷是"是否傳了",而不是"傳的是什麼值"。只要請求體出現這個 key,就會被識別爲非默認配置並返回 400。正確做法是請求裏完全不出現這個字段,讓 SDK 用模型自己的默認行爲去採樣。

Q3:用 OpenAI SDK 通過 API易調 Opus 4.7 會觸發 temperature 報錯嗎?

要看 SDK 版本和上層框架。OpenAI SDK 默認會帶上 temperature=1.0,如果直接轉發到 Anthropic 後端,仍會被 Opus 4.7 拒絕。通過 API易 apiyi.com 調用時,平臺已對這一類常見兼容性做了優雅處理,會自動把廢棄字段過濾掉。

Q4:system 報錯只在 4.7 出現嗎?以前的 Claude 模型不會嗎?

不是。Anthropic Messages API 從來不允許把 system 寫進 messages 數組,但 Opus 4.7 的校驗更嚴格了,部分早期模型可能會"寬鬆接收"。最佳實踐始終是把 system 放在請求體頂層,遷移到頂層之後所有 Claude 模型都能正常工作。

Q5:從 OpenAI 遷過來的代碼,最少改幾行能跑 Opus 4.7?

通常三處:1)model 改成 claude-opus-4-7;2)messages 裏的 system 條目搬到頂層 system 字段;3)刪除 temperature、top_p 等採樣參數。把 base_url 切到 https://api.apiyi.com,整個項目通常能在 10 分鐘內跑通。如果你的項目有幾十個調用點,建議先封裝一個統一的 call_claude() 工具函數,把這三處修改集中收口,未來再有 API 變動也只改一個地方。

Q6:adaptive thinking 默認開嗎?要不要顯式打開?

默認是關閉的。如果你的任務對推理深度敏感(數學推理、代碼重構、複雜規劃),建議顯式傳 thinking: {type: "adaptive"}。可以再配合 output_config: {effort: "max"} 獲得最強思考能力,代價是 token 用量上升,需要在質量與成本之間做權衡。

Q7:Opus 4.7 在國內調用穩定嗎?

直連 Anthropic 接口可能受到網絡環境影響,長跑任務尤其容易斷。通過 API易 apiyi.com 調用 Opus 4.7 可以解決境內訪問穩定性問題,平臺已穩定運行,配合緩存計費 0.1x 還能顯著降本。

Q8:新 tokenizer 讓成本上漲多少?怎麼應對?

新 tokenizer 在不同文本上的膨脹比例在 0% 到 35% 之間,平均約 10% 到 15%。最實用的應對是把可緩存的 system prompt、工具描述前置,觸發緩存計費 0.1x,單次成本會反向下降而不是上漲。

Claude Opus 4.7 參數廢棄核心要點

- Opus 4.7 完全廢棄

temperature、top_p、top_k三大采樣參數,傳任意值都會觸發 400 報錯。 - Extended thinking 已移除,僅支持 adaptive thinking,且默認關閉,需顯式啓用。

Unexpected role "system"是 Messages API 的歷史規則,system 必須走頂層而非消息角色。- 新 tokenizer 使同樣文本的 token 數比 4.6 多 0% 到 35%,預算和 max_tokens 都要重新覈算。

- 修復最少只需三步:刪除採樣參數、把 system 搬到頂層、模型名改爲

claude-opus-4-7。 - 通過 API易 apiyi.com 調用 Opus 4.7 可享受參數兼容優雅降級、緩存計費 0.1x 與境內穩定接入。

- adaptive thinking 配合

output_config: {effort: "max"}是 Opus 4.7 上獲取最強推理能力的標準姿勢。

總結

Claude Opus 4.7 的參數廢棄看上去是"破壞性變更",實質上是 Anthropic 把模型從一個"暴露細節的工具"演化成"自適應黑盒"的關鍵一步。對開發者而言,這意味着原來靠 temperature、thinking budget 等"開關"調出來的穩定性,要逐步遷移到 prompt 工程和 adaptive thinking 的組合上。短期內會帶來遷移成本,長期看會讓代碼更簡潔、模型表現更穩定。這條演化路徑並不孤立,主流大模型都在朝着"少參數、強自適應"的方向走,越早適應越有紅利。

如果你正在升級到 Opus 4.7 或評估這次變更對生產的影響,建議先在 API易 apiyi.com 上接入新版調試,平臺已穩定支持 Opus 4.7 並對廢棄參數做了兼容降級,配合緩存計費 0.1x 是當前最低門檻的遷移路徑。

願你少踩坑、早下班。

— APIYI 技術團隊,更多 AI 模型實戰教程見 API易 apiyi.com