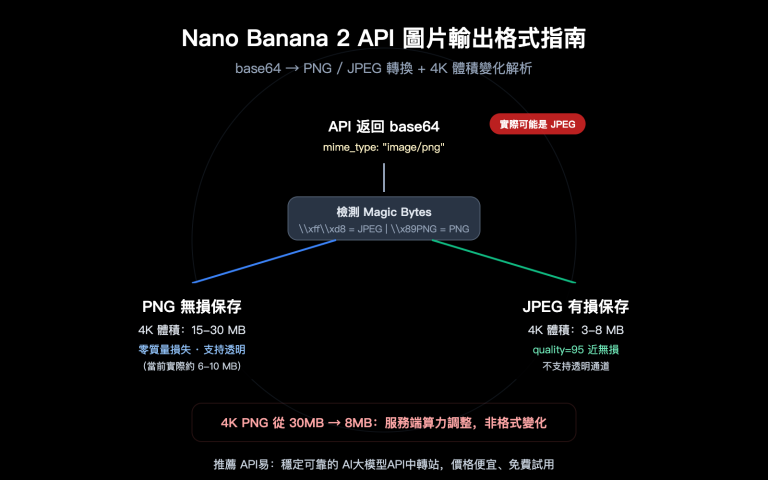

最近在幫客戶排查圖像生成需求時,我們發現一個值得分享的現象:GPT-Image-2 已經無法生成真正的透明背景 PNG。無論你在提示詞裏寫"背景必須是透明的",還是直接通過 API 傳入 background: "transparent" 參數,最新一代的 GPT-Image-2 都會返回一張實色背景的圖,或者直接報錯。這跟它的上一代 sora_image / gpt-4o-image 形成了非常明顯的能力反差,也讓一批做電商 SKU 摳圖、社交貼紙、PPT 插畫的團隊措手不及。

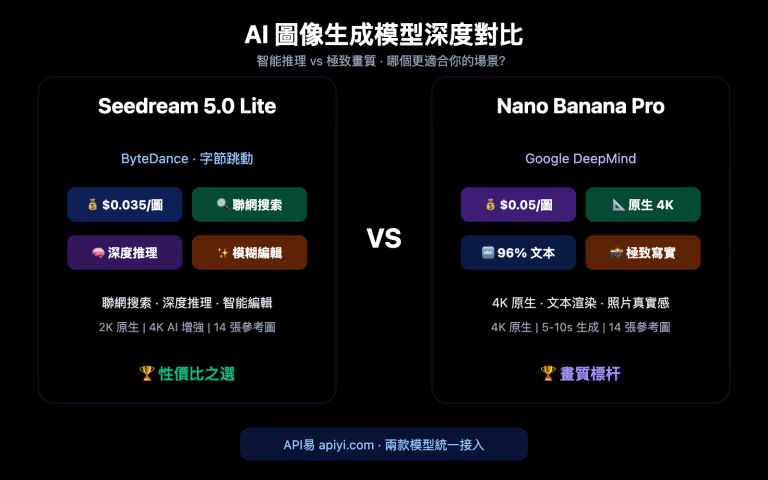

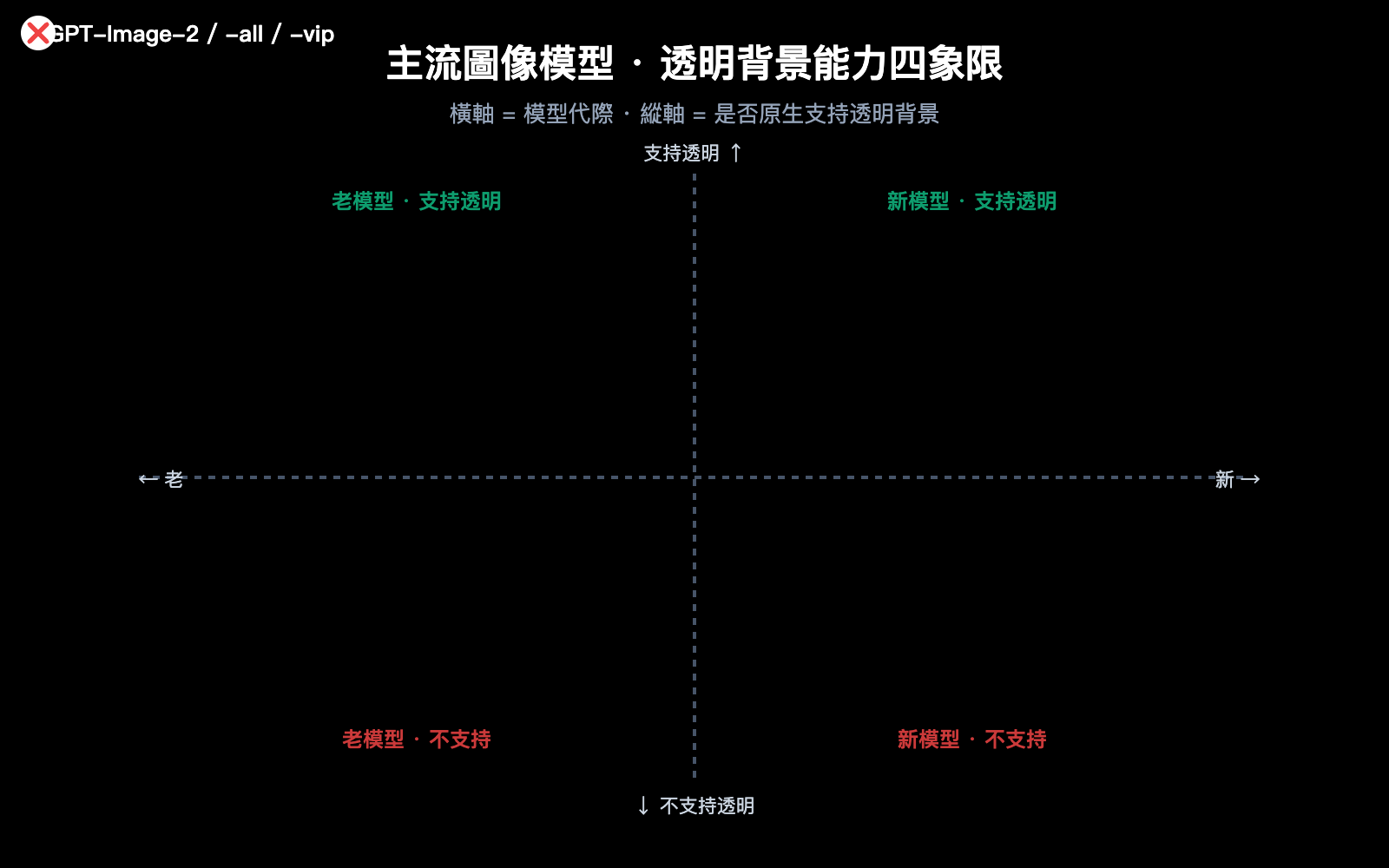

更巧的是,谷歌在 2025 年底推出的旗艦圖像模型 Nano Banana Pro(基於 Gemini 3 Pro Image)同樣不支持透明背景生成,連前一代的 Nano Banana 2 也是同樣的限制。換句話說,目前業界兩個最主流的圖像生成基座,都把"透明背景"這個看似基礎的功能給砍掉了。我們在 API易 apiyi.com 上跑了一整輪迴歸測試,把現象、根因、替代方案完整整理成本文,方便正在做產品集成的團隊快速決策。

GPT-Image-2 透明背景失敗的完整復現實驗

要理解這個能力差異,最直接的辦法就是把它跑一遍。我們用 API易 網關同時調用 gpt-image-2、gpt-image-1.5 和 gpt-image-2-all 三個版本,提示詞統一爲"a cute orange cat sticker, transparent background",並把 background 參數都顯式設置成 transparent。結果非常一致:gpt-image-2 系列要麼返回 4xx 錯誤,要麼生成實色或棋盤格底圖,唯獨 gpt-image-1.5 老老實實返回了帶 alpha 通道的真透明 PNG。

# 通過 API易 網關一次性測試 3 個版本的透明背景能力

from openai import OpenAI

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1"

)

# ❌ gpt-image-2 不支持 transparent,會被網關層提前拒絕

client.images.generate(

model="gpt-image-2",

prompt="a cute orange cat sticker",

background="transparent",

output_format="png"

)

# ✅ gpt-image-1.5 仍然原生支持透明背景輸出

client.images.generate(

model="gpt-image-1.5",

prompt="a cute orange cat sticker",

background="transparent",

output_format="png"

)

🎯 快速上手建議:如果你只是想把現成的工作流跑通,最低成本的做法是把 model 字段切回

gpt-image-1.5,base_url 指向 API易 apiyi.com,其它參數完全不動,5 分鐘內就能恢復透明輸出能力。

我們也復現了在提示詞裏硬塞"background must be transparent"、"isolated on transparent canvas"、"PNG with alpha channel"等表述的情況。GPT-Image-2 表現非常頑固:要麼直接給一個白底,要麼生成一張帶灰白棋盤格"貼圖"的實色圖,相當於把"表示透明的可視化標記"畫了上去。這點和 Nano Banana Pro 的失敗模式高度一致,是模型語義對齊層面的硬傷,而不是 prompt 寫得不夠精確。

| 觸發方式 | GPT-Image-2 表現 | gpt-image-1.5 表現 | 推薦做法 |

|---|---|---|---|

background="transparent" 參數 |

API 拒絕 / 實色 | 真透明 PNG | 直接換模型 |

| 提示詞寫"transparent background" | 白底或棋盤格圖案 | 真透明 PNG | 不要依賴文字 |

| 提示詞寫"isolated subject on white" | 淺灰背景 | 主體白底 | 配合參數一起用 |

輸出 output_format=webp |

仍爲實色 | 真透明 webp | webp 不影響能力 |

| Edit 接口 + alpha 蒙版 | 無效 | 局部透明 | 僅 1.5 可用 |

GPT-Image-2 透明背景被砍掉的 3 個根本原因

第一是架構層面的取捨。OpenAI 在 GPT-Image-2 的官方文檔中明確寫了"gpt-image-2 doesn't currently support transparent backgrounds",原因沒有公開,但行業內普遍推測和它升級到更強的"場景一致性"訓練目標有關——模型被訓練去補全一個真實世界的場景,而不是"摳圖",因此在底層就少了 alpha 通道的監督信號。這是一項產品級的設計取捨,不是 bug。

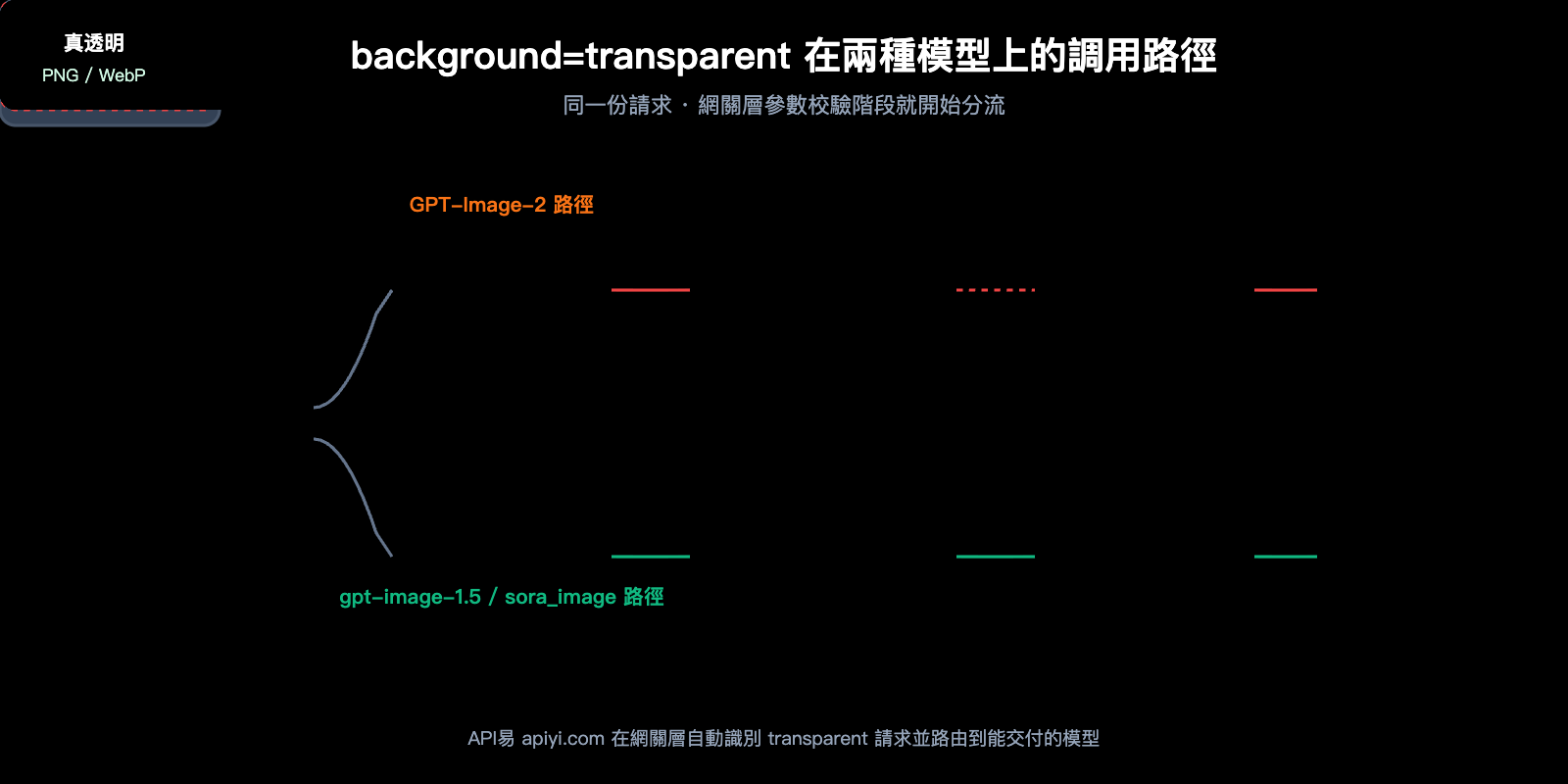

第二是API 網關的強制校驗。我們抓了一下 OpenAI 官方端點的響應,gpt-image-2 的 background 參數枚舉值只允許 auto 和 opaque,把 transparent 直接從參數空間裏刪掉了。這意味着任何上游平臺(包括 API易 網關)都會在請求階段就拒絕這種調用,根本到不了模型推理這一步。所以"換個第三方平臺就能繞過"是一種幻覺,gpt-image-2-all、gpt-image-2-vip 等"官逆"通道走的也是同一個後端模型。

第三是安全與版權過濾策略。透明背景圖常被用於二次合成,涉及肖像、品牌 Logo 的場景特別多。OpenAI 這兩年明顯在收緊"可二次合成素材"的輸出權限,gpt-image-2 也搭載了更嚴格的內容審覈流水線,這一定程度上和透明背景能力的下線是同向的。

🎯 架構理解建議:在 API易 apiyi.com 這種統一網關裏,我們會把 gpt-image-2 與 gpt-image-1.5 的參數空間分別校驗,遇到

transparent請求時自動給出降級建議,避免業務側出現"調用都失敗但不知道爲什麼"的情況。

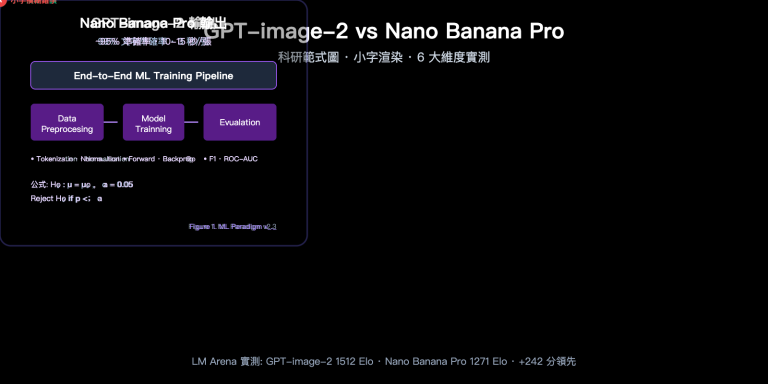

GPT-Image-2 與 Nano Banana Pro 透明背景能力對比

很多客戶問我們:"換成 Google Nano Banana 2 / Nano Banana Pro 是不是就行了?"答案非常殘酷——同樣不行。Nano Banana Pro 的失敗模式甚至比 GPT-Image-2 更"騷氣":它會生成一張表面上看起來"是透明背景"的圖,但仔細一看,那個棋盤格其實是被畫進圖片裏的實色像素,等於把 Photoshop 裏的透明指示圖案"原樣畫"了一遍。

社區目前主流的解釋是:模型的訓練數據裏大量出現"用棋盤格表示透明"的素材圖(Stock 圖庫、Photoshop 截圖、設計教程截圖等),導致模型形成了"透明 = 棋盤格"的錯誤關聯。Google 官方在 Gemini API 論壇裏也證實過 Nano Banana 系列暫時不會原生支持透明背景輸出,需要靠 Gemini 3 Flash + 代碼執行的組合拳來"曲線救國"。

| 模型 | 發佈時間 | 透明背景支持 | 失敗時表現 | 推薦場景 |

|---|---|---|---|---|

| GPT-Image-2 | 2026 年初 | ❌ 不支持 | 實色背景 / 報錯 | 寫實場景圖、海報 |

| GPT-Image-2-all(官逆) | 2026 年初 | ❌ 不支持 | 與官方一致 | 與 GPT-Image-2 等價 |

| GPT-Image-1.5 | 2025 年中 | ✅ 原生支持 | / | 貼紙、電商摳圖 |

| sora_image / gpt-4o-image | 2025 年 3 月 | ✅ 支持 | / | 兼容老工作流 |

| Nano Banana 2 | 2025 年下半年 | ❌ 不支持 | 灰白棋盤格圖案 | 二次創作、風格化 |

| Nano Banana Pro | 2025 年底 | ❌ 不支持 | 灰白棋盤格圖案 | 高保真編輯 |

| Stable Diffusion + LoRA | 持續更新 | ✅ 間接支持 | 需要後處理 | 自託管批量生產 |

🎯 選型提示:如果你只是要"把主體摳出來",2026 年最划算的組合是 GPT-Image-1.5 / sora_image 直接出圖,或者 Nano Banana Pro 出圖後跑一次背景移除。這兩條路在 API易 apiyi.com 上都能走統一的鑑權和計費,避免業務側維護兩套 key。

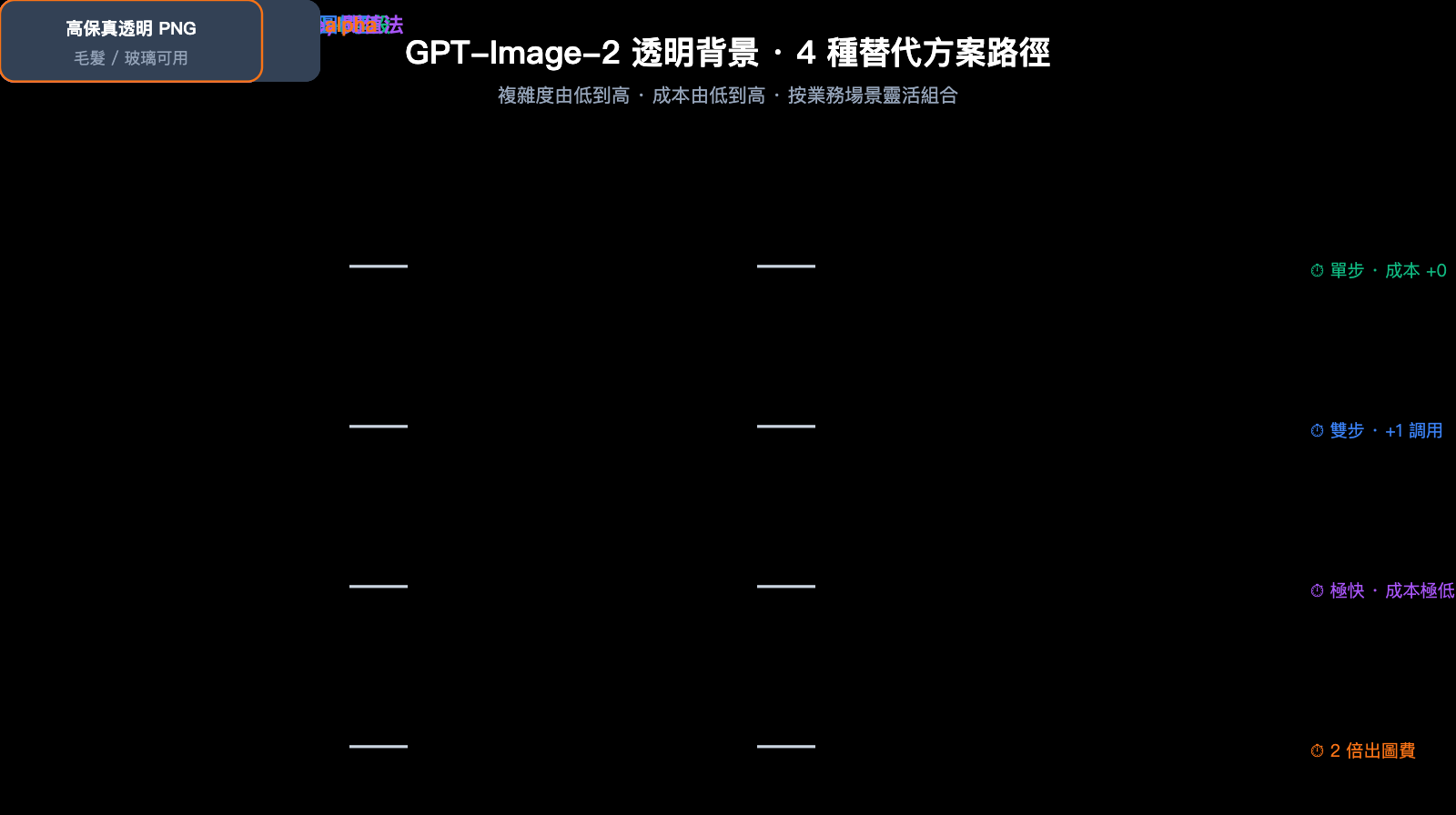

GPT-Image-2 透明背景的 4 種替代方案對比

雖然 GPT-Image-2 自己拒絕出透明圖,但要讓業務跑通其實有四種成熟的替代路徑,每種都有自己的成本和質量曲線,可以根據場景靈活組合。

第一種是直接降級到 sora_image / gpt-image-1.5。這是改動最小的方案:客戶端調用代碼幾乎不用動,只把 model 字段從 gpt-image-2 切到 gpt-image-1.5 或 sora_image,立刻就能恢復 alpha 通道輸出。代價是寫實度和長文本渲染能力會比 GPT-Image-2 弱一些,但對貼紙、Logo、電商主圖這類場景完全夠用。

第二種是GPT-Image-2 出圖 + 後處理摳圖。先用 GPT-Image-2 生成質量更高的實色背景圖,再串接一個摳圖模型(例如 851-labs/background-remover、RemBG、BiRefNet)做 alpha 通道剝離。這種方式能保留 GPT-Image-2 的寫實長處,但延遲會增加 1-3 秒,複雜邊緣(毛髮、玻璃、煙霧)的精度看摳圖模型本身。

第三種是Chroma Key 綠幕法。在提示詞裏強制要求"solid pure green background, hex #00ff00",讓 GPT-Image-2 生成一張乾淨的純色底圖,再用代碼做 HSV 色彩閾值替換。這種方式比通用摳圖更快、更便宜,缺點是會"啃"主體裏同色調的像素,不適合主體本身就是綠色的素材。

第四種是雙底圖相減法。讓 GPT-Image-2 用同一個 seed 生成兩張圖,一張白底、一張黑底,然後逐像素計算顏色差,反推出 alpha 值。這是 OpenAI 社區裏討論度比較高的"硬核"方案,質量最穩定,但成本是雙倍出圖費用。

| 替代方案 | 實現複雜度 | 單圖額外成本 | 邊緣質量 | 適用場景 |

|---|---|---|---|---|

| 切回 GPT-Image-1.5 / sora_image | ⭐ | 0 | 高 | 貼紙、電商主圖 |

| GPT-Image-2 + 通用摳圖模型 | ⭐⭐ | +1 次摳圖調用 | 中-高 | 寫實人物、產品圖 |

| Chroma Key 綠幕法 | ⭐⭐⭐ | 幾乎爲零 | 中 | 卡通形象、幾何圖形 |

| 雙底圖相減法 | ⭐⭐⭐⭐ | 2 倍出圖費 | 高 | 玻璃、毛髮等複雜邊緣 |

🎯 工程化建議:我們在 API易 apiyi.com 後臺默認會把"透明背景需求"路由到 gpt-image-1.5;如果客戶希望保留 GPT-Image-2 的寫實風格,可以通過統一接口把"出圖 + 摳圖"做成兩步串行調用,整套鏈路只暴露一個 endpoint,便於業務側封裝。

如果項目對邊緣質量和成本同時敏感,下面這張摳圖工具能力對照表可以作爲選型起點:

| 摳圖工具 | 邊緣精度 | 平均耗時 | 部署形態 | 推薦組合 |

|---|---|---|---|---|

| 851-labs/background-remover | 高 | 1.5-2 秒 | 雲端 API | 配 GPT-Image-2 寫實圖 |

| RemBG(U2Net) | 中 | 0.5 秒 | 自託管 | 配純色底圖、批量任務 |

| BiRefNet | 極高 | 2-3 秒 | 自託管 | 毛髮、複雜邊緣 |

| HSV 色彩閾值 | 中 | <0.1 秒 | 幾行 Python | 配 Chroma Key 綠幕 |

GPT-Image-2 透明背景常見問題 FAQ

Q1:在 GPT-Image-2 提示詞裏寫"背景必須透明"爲什麼必定失敗?

因爲模型沒有學習到"輸出 alpha 通道"這個目標,它只能在 RGB 空間裏畫圖。當你硬塞"transparent background"這種描述時,它會按字面意思去畫一個能"代表透明"的視覺符號——也就是棋盤格底圖。這是一種典型的語義對齊失敗,跟提示詞寫得多詳細無關。

Q2:gpt-image-2-all / gpt-image-2-vip 這種官逆通道爲什麼也不行?

官逆通道本質上還是調用同一個 OpenAI 後端模型,只是前端做了賬號池或代理。模型層面不支持的能力,前端怎麼包裝都補不上。如果你看到某些第三方平臺宣稱"GPT-Image-2 支持透明背景",多半是它在 API 網關層偷偷做了背景移除後處理,並不是真的讓 GPT-Image-2 原生輸出透明。

Q3:如果項目剛好需要透明背景,應該選哪個 API?

我們在 API易 apiyi.com 上的實測推薦是:貼紙 / 表情包 / 電商主圖選 GPT-Image-1.5,照片級寫實摳圖選 GPT-Image-2 配摳圖模型,國產合規場景可以考慮 Stable Diffusion 系列自託管。這三條路都能在同一個網關裏切換,便於做 AB 測試。

Q4:什麼時候 GPT-Image-2 / Nano Banana Pro 會重新支持透明背景?

OpenAI 和 Google 都沒有公開時間表。從過往迭代節奏看,OpenAI 通常會在小版本(如 GPT-Image-2.1、2.5)裏把缺失的參數補回來;Google 的 Nano Banana 系列會更傾向於通過 Gemini 3 Flash + 代碼執行的"組合拳"來解決,而不是改基座模型。

Q5:API易 apiyi.com 在這件事上能幫我做什麼?

我們做了三件事:①在網關層自動識別 transparent 請求並提示降級;②同時打通 GPT-Image-1.5、GPT-Image-2、Nano Banana Pro 等多模型路由;③提供統一的計費、配額、日誌,便於團隊對比不同方案的真實成本,無需自己維護多套 SDK。

GPT-Image-2 透明背景問題的 3 條總結

第一,GPT-Image-2 不支持透明背景是一項確定的產品策略,不是 prompt 寫法問題、也不是接入姿勢問題。任何在提示詞裏反覆嘗試"transparent"措辭的工作流,都應該儘快遷移到 1.5 或者後處理流水線,否則只會在棋盤格圖案裏反覆打轉。

第二,Nano Banana 2 / Pro 同樣不支持透明背景,目前這條賽道的"原生透明輸出"只能依賴上一代 GPT-Image-1.5、sora_image / gpt-4o-image,或者 Stable Diffusion 自託管。把希望寄託在某個"暗藏開關"是不現實的。

第三,業務側最穩的姿勢是把模型抽象到一層網關後面,讓"透明背景需求"在網關裏自動路由到能交付的模型。這套路由策略我們已經做成了默認行爲,團隊可以省下一次次踩坑的時間,把精力留給真正的業務邏輯。

如果你正在重構圖像生成相關的工作流,歡迎到 API易 apiyi.com 直接做一次迴歸測試:把現有提示詞同時跑 GPT-Image-2 與 GPT-Image-1.5,10 分鐘內就能拿到一份"什麼場景該用什麼模型"的對照表,再決定是直接降級、還是接摳圖後處理。

📌 作者:APIYI 技術團隊 — 持續追蹤 OpenAI、Google、Anthropic 等主流模型的能力變更,爲開發者提供統一的多模型 API 網關體驗,瞭解更多請訪問 API易 apiyi.com。