作者注:詳解 OpenClaw 新開對話的 3 種方法和 5 大 Token 優化策略,幫助用戶避免因歷史記錄累積導致的 API 費用暴漲問題

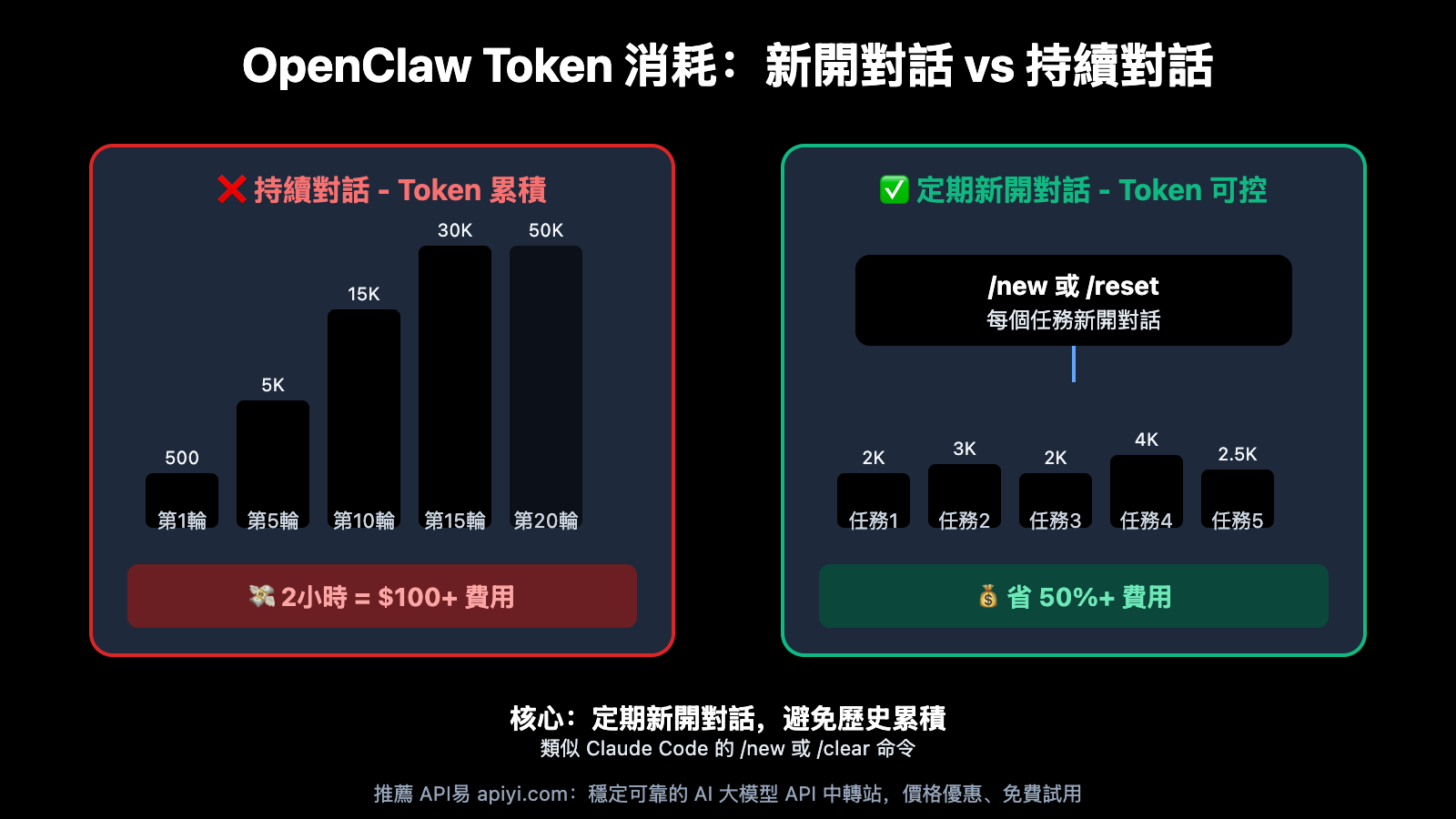

"兩小時燒了 100 美元" — 這是一位 OpenClaw 用戶使用 Claude Opus 4.5 模型時遇到的真實情況。問題的根源在於:同一個對話會累積所有歷史記錄傳遞給 API,導致 Token 消耗呈指數級增長。

核心價值: 讀完本文,你將學會 3 種新開對話的方法 + 5 個 Token 優化策略,讓 OpenClaw 的使用成本降低 50% 以上。

OpenClaw Token 消耗原理

要理解爲什麼費用會飆升,需要先了解 OpenClaw 的會話機制。

會話存儲架構

OpenClaw 通過 Gateway 進程維護會話狀態,使用兩層持久化存儲:

| 存儲層 | 文件位置 | 存儲內容 |

|---|---|---|

| 會話元數據 | sessions.json |

會話 ID、活動時間戳、Token 計數 |

| 對話記錄 | *.jsonl |

完整對話歷史、工具調用、壓縮摘要 |

關鍵點: 每次發送消息時,OpenClaw 會將以下內容全部傳遞給 API:

- 系統提示詞 (工具、技能、工作區文件)

- 完整對話歷史

- 工具調用結果

- 附件 (圖片、音頻、文件)

- 壓縮摘要

Token 累積示意

假設你使用 Claude Opus 4.5 進行 10 輪對話:

| 對話輪次 | 單輪輸入 | 累積上下文 | API 成本 (輸入) |

|---|---|---|---|

| 第 1 輪 | 500 tokens | 500 tokens | $0.0075 |

| 第 5 輪 | 500 tokens | 5,000 tokens | $0.075 |

| 第 10 輪 | 500 tokens | 15,000 tokens | $0.225 |

| 第 20 輪 | 500 tokens | 50,000 tokens | $0.75 |

問題暴露: 同一對話持續下去,每輪的 Token 消耗都在增加。使用 Claude Opus 4.5 (輸入 $15/M tokens) 時,20 輪對話的單輪成本已是第 1 輪的 100 倍。

🎯 成本警示: 如果你發現 API 費用異常增長,大概率是在同一個對話裏聊太久了。OpenClaw 會把之前的所有內容都傳遞給 API,這就是爲什麼"兩小時燒 100 美元"會發生。

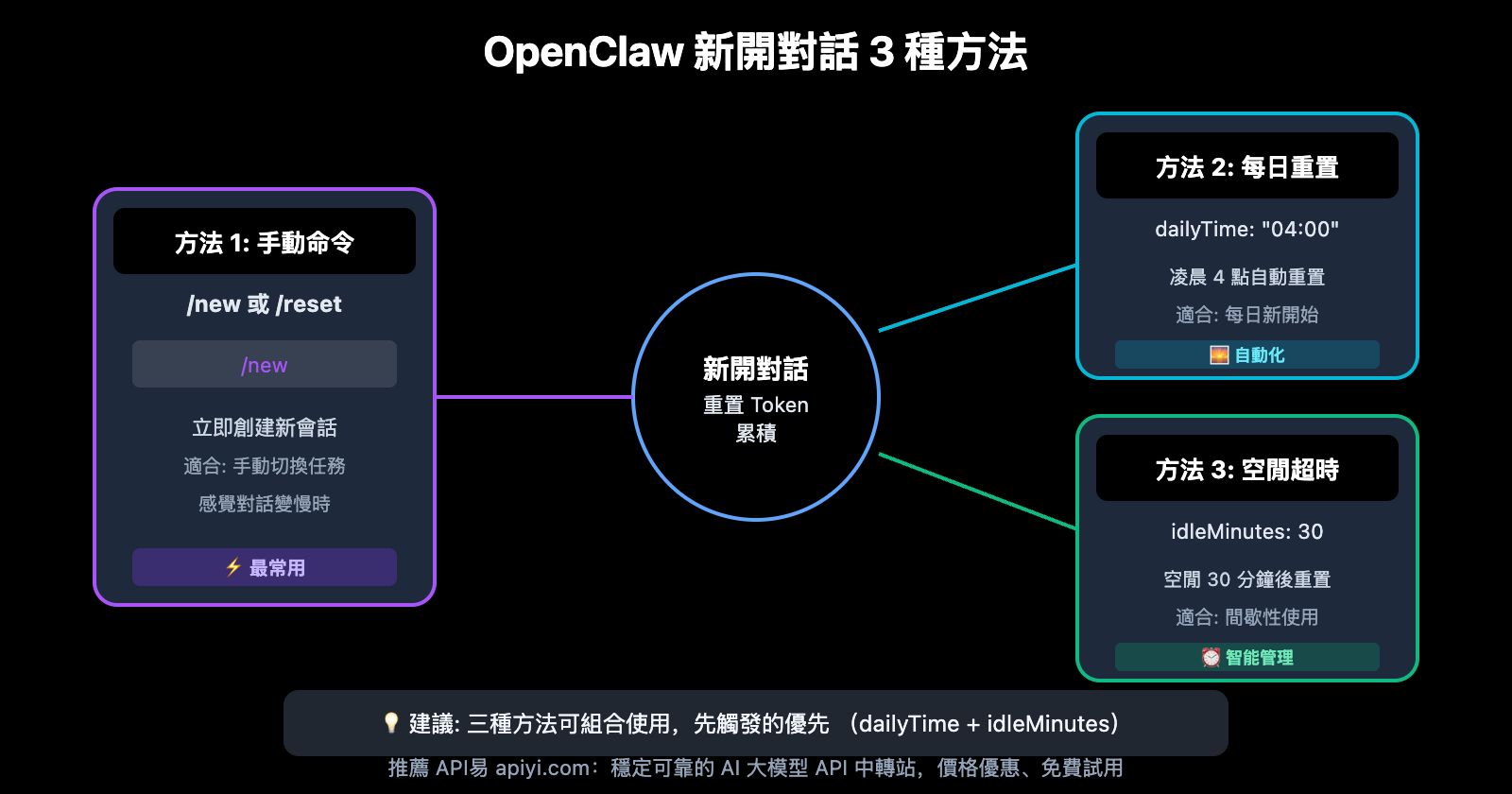

OpenClaw 新開對話 3 種方法

新開對話是控制 Token 成本最直接的方法,類似於 Claude Code 中的 /new 或 /clear 命令。

方法 1: 使用 /new 或 /reset 命令

這是最常用的手動重置方式:

# 在 OpenClaw 對話中輸入

/new

# 或者使用

/reset

原理: 這兩個命令會立即爲當前 sessionKey 創建新的 sessionId,開始一個全新的對話記錄文件。

適用場景:

- 切換到新任務時

- 感覺對話變慢時

- 每完成一個獨立任務後

方法 2: 配置每日自動重置

OpenClaw 支持在指定時間自動創建新會話:

{

"session": {

"reset": {

"dailyTime": "04:00"

}

}

}

原理: 默認在每天凌晨 4:00 (本地時間) 觸發重置。重置後的第一條消息會自動創建新的 sessionId。

適用場景:

- 每天開始工作時獲得乾淨的上下文

- 不想手動管理會話

方法 3: 配置空閒超時重置

當你一段時間不使用 OpenClaw 後,自動開始新對話:

{

"session": {

"reset": {

"idleMinutes": 30

}

}

}

原理: 當會話空閒超過指定時間後,下一條消息會觸發新會話創建。

配置組合: 可以同時設置每日重置和空閒超時,先觸發的優先:

{

"session": {

"reset": {

"dailyTime": "04:00",

"idleMinutes": 60

}

}

}

建議: 對於使用 Claude Opus 等高價模型的用戶,建議將

idleMinutes設置爲 30-60 分鐘。通過 API易 apiyi.com 平臺調用 Claude API 可以獲得更優惠的價格,配合會話管理策略,能顯著降低使用成本。

OpenClaw Token 優化 5 大策略

新開對話只是基礎,以下 5 個策略能進一步優化你的 Token 消耗。

策略 1: 啓用自動壓縮 (Compaction)

OpenClaw 內置了上下文壓縮機制,會將長對話摘要化:

| 觸發條件 | 說明 |

|---|---|

| 溢出恢復 | 模型返回上下文溢出錯誤時自動壓縮並重試 |

| 閾值維護 | contextTokens 超過 contextWindow – reserveTokens 時 |

手動觸發壓縮:

/compact

配置安全閾值:

{

"agents": {

"defaults": {

"reserveTokens": 20000

}

}

}

注意: 系統會確保至少保留 20,000 tokens 的空間用於多輪操作。

策略 2: 清理會話文件

一個被忽視的優化點是會話文件的清理。社區用戶發現刪除 .openclaw/agents.main/sessions/ 目錄下的 .jsonl 文件後,Token 消耗大幅下降。

# 查看會話文件

ls -la ~/.openclaw/agents.main/sessions/

# 清理舊會話 (謹慎操作)

rm ~/.openclaw/agents.main/sessions/*.jsonl

建議: 定期清理超過 7-14 天的會話文件。

策略 3: 配置 Cache-TTL 優化

利用 API 提供商的緩存機制減少重複 Token 消耗:

{

"cache": {

"ttl": "1h",

"pruneOnExpiry": true

}

}

優化技巧: 將 Heartbeat 間隔設置爲略低於 cache TTL:

- Cache TTL: 1 小時

- Heartbeat: 55 分鐘

這樣可以保持緩存熱度,避免重新緩存完整提示詞。

策略 4: 選擇合適的模型

不同模型的 Token 單價差異巨大:

| 模型 | 輸入價格 | 輸出價格 | 適用場景 |

|---|---|---|---|

| Claude Opus 4.5 | $15/M | $75/M | 複雜推理、關鍵任務 |

| Claude Sonnet 4 | $3/M | $15/M | 日常開發、代碼生成 |

| GPT-4o-mini | $0.15/M | $0.6/M | 簡單任務、快速迭代 |

| Gemini 3.0 Flash | $0.075/M | $0.3/M | 低成本日常使用 |

| Kimi K2.5 | 更低 | 更低 | 性價比首選 |

實際建議:

- 日常探索: GPT-4o-mini 或 Gemini Flash

- 代碼開發: Claude Sonnet 4

- 複雜任務: Claude Opus (配合嚴格的會話管理)

🎯 成本對比: 通過 API易 apiyi.com 平臺可以統一接入以上所有模型,並享受比官方更優惠的價格。平臺支持實時切換模型,便於在不同任務間靈活調整成本策略。

策略 5: 優化使用習慣

| 習慣 | 優化前 | 優化後 | 節省估算 |

|---|---|---|---|

| 對話長度 | 一個對話聊幾小時 | 每個任務新開對話 | 50%+ |

| 模型選擇 | 全程 Opus | 按需切換模型 | 30-70% |

| 瀏覽器截圖 | 頻繁截圖 | 減少不必要截圖 | 20%+ |

| Temperature | 默認值 | 設置爲 0.2 | 10%+ |

降低 Temperature 的好處:

{

"agents": {

"defaults": {

"temperature": 0.2

}

}

}

低 Temperature 讓模型輸出更確定,減少重試次數,從而降低 Token 消耗。

OpenClaw Token 監控實戰

實時查看 Token 使用

# 查看當前會話狀態

/status

# 啓用使用量顯示

/usage full

# 查看成本統計

/usage cost

監控輸出示例

執行 /status 後會顯示:

- 當前模型

- 上下文使用量

- 每輪響應 Token 數

- 預估成本 (僅 API Key 用戶可見)

設置成本警報

建議在模型提供商處設置使用量上限,避免意外超支:

- Anthropic Console: 設置月度限額

- OpenAI Dashboard: 配置使用上限

- API易平臺: 設置餘額預警

建議: 使用 API易 apiyi.com 的額度預警功能,當 API 消耗達到閾值時自動通知,避免"燒錢"事故發生。

常見問題

Q1: /new 和 /reset 命令在 Web UI 中不起作用怎麼辦?

這是一個已知 Bug (Issue #4446)。臨時解決方案:

- 使用其他渠道 (WhatsApp/Telegram) 執行命令

- 直接刪除會話文件:

rm ~/.openclaw/agents.main/sessions/*.jsonl - 等待官方修復後更新到最新版本

Q2: 如何判斷當前對話的 Token 消耗是否過高?

執行 /status 查看上下文使用量。一般建議:

- 上下文超過 50% 容量時考慮新開對話

- 單輪響應時間明顯變長時立即重置

- 使用高價模型 (如 Claude Opus) 時,每完成一個獨立任務就新開對話

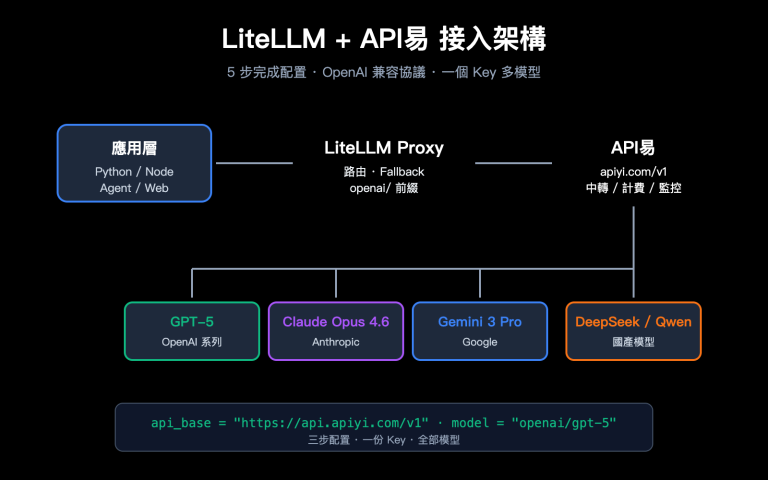

Q3: 有沒有更經濟的方式使用 Claude 模型?

推薦通過 API 聚合平臺降低成本:

- 訪問 API易 apiyi.com 註冊賬號

- 獲取 API Key,享受比官方更優惠的價格

- 配置 OpenClaw 使用聚合平臺的 endpoint

- 同時可以靈活切換多種模型,按需選擇性價比最高的方案

完整配置示例

以下是一個經過優化的 OpenClaw 配置文件示例:

{

"agents": {

"defaults": {

"model": {

"primary": "anthropic/claude-sonnet-4"

},

"temperature": 0.2,

"reserveTokens": 20000

}

},

"session": {

"reset": {

"dailyTime": "04:00",

"idleMinutes": 60

}

},

"cache": {

"ttl": "1h",

"pruneOnExpiry": true

}

}

查看使用 API易 平臺的配置示例

{

"models": {

"providers": {

"apiyi": {

"type": "openai",

"baseURL": "https://vip.apiyi.com/v1",

"apiKey": "YOUR_APIYI_KEY",

"models": [

"claude-opus-4-5-20251101",

"claude-sonnet-4-20250514",

"gpt-4o-mini",

"deepseek-chat"

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "apiyi/claude-sonnet-4-20250514"

},

"temperature": 0.2,

"reserveTokens": 20000

}

},

"session": {

"reset": {

"dailyTime": "04:00",

"idleMinutes": 30

}

}

}

總結

OpenClaw Token 優化的核心要點:

- 新開對話是關鍵: 使用

/new或/reset命令,避免歷史累積 - 配置自動重置: 設置

dailyTime和idleMinutes,讓系統自動管理 - 啓用壓縮機制: 使用

/compact或自動壓縮,減少上下文大小 - 選擇合適模型: 日常用低價模型,複雜任務再用高端模型

- 監控使用量: 定期執行

/status和/usage cost,及時發現異常

記住:"兩小時燒 100 美元"的悲劇完全可以避免,關鍵是養成定期新開對話的習慣。

推薦通過 API易 apiyi.com 接入 Claude 等模型,獲取更優惠的價格和完善的用量監控,讓你的 AI 助手既強大又經濟。

📚 參考資料

⚠️ 鏈接格式說明: 所有外鏈使用

資料名: domain.com格式,方便複製但不可點擊跳轉,避免 SEO 權重流失。

-

OpenClaw 會話管理文檔: Session Management Compaction

- 鏈接:

docs.openclaw.ai/reference/session-management-compaction - 說明: 官方會話管理和壓縮機制詳解

- 鏈接:

-

OpenClaw Token 使用指南: Token Use

- 鏈接:

docs.openclaw.ai/token-use - 說明: 官方 Token 監控和優化建議

- 鏈接:

-

社區討論 – Token 消耗問題: Burning through tokens

- 鏈接:

github.com/openclaw/openclaw/discussions/1949 - 說明: 用戶分享的 Token 優化經驗和解決方案

- 鏈接:

-

OpenClaw GitHub 倉庫: 官方源碼和文檔

- 鏈接:

github.com/openclaw/openclaw - 說明: 最新版本下載和 Issue 跟蹤

- 鏈接:

作者: 技術團隊

技術交流: 歡迎在評論區討論 OpenClaw 使用技巧,更多 AI API 資料可訪問 API易 apiyi.com 技術社區