作者注:深度解析 Nano Banana Pro API 返回 503 錯誤 The model is overloaded 的原因,提供 5 種有效解決方案,幫助開發者應對 Google 官方算力不足問題

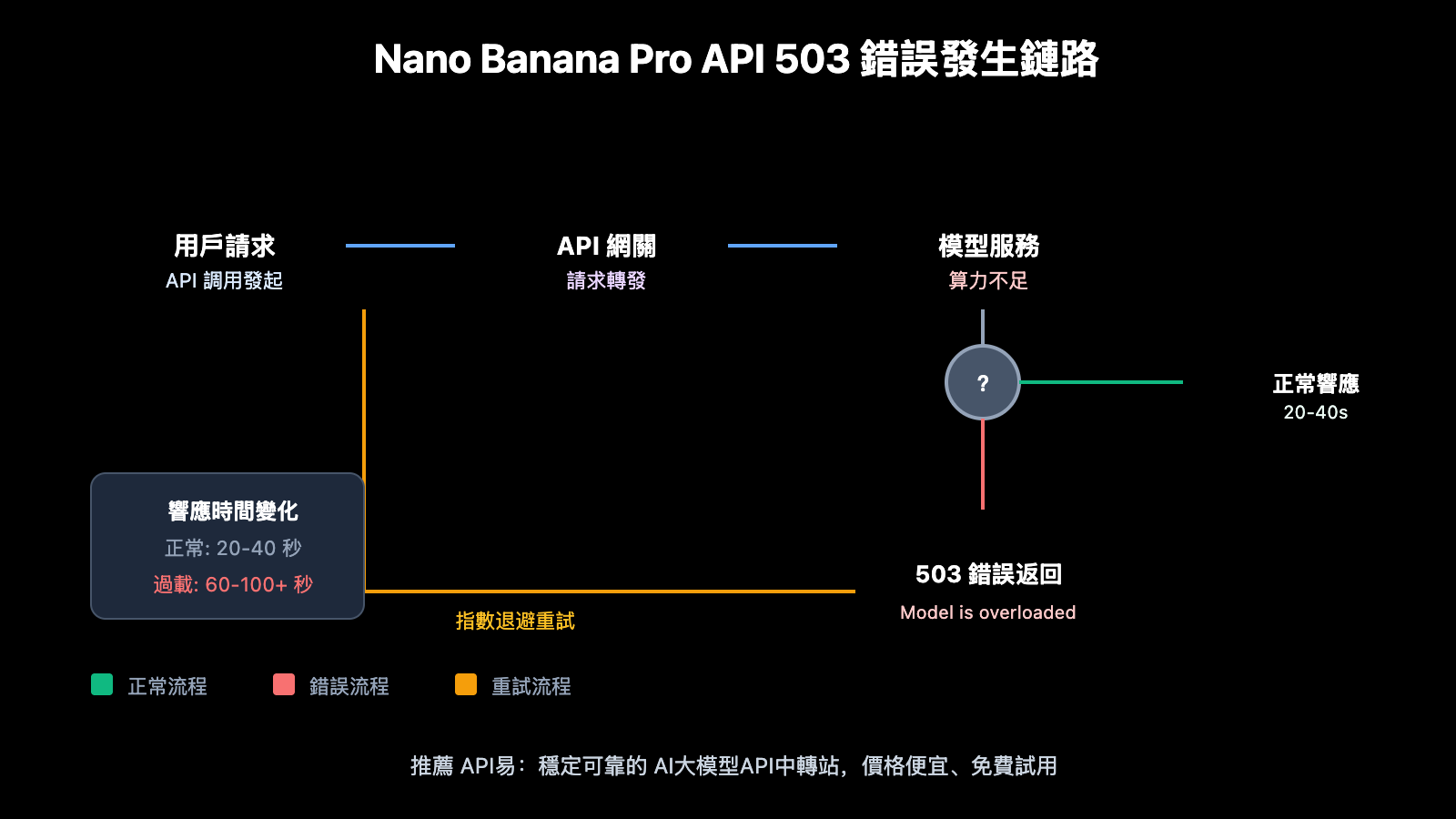

近期許多開發者反饋,調用 Nano Banana Pro API(gemini-2.0-flash-preview-image-generation)時頻繁遇到 "The model is overloaded. Please try again later." 錯誤,響應時間從原來的 30 秒飆升至 60-100 秒甚至更長。本文將深入分析這一問題的根本原因,並提供 5 種經過驗證的解決方案。

核心價值: 讀完本文,你將瞭解 Nano Banana Pro API 過載錯誤的真正原因,掌握有效的應對策略,確保你的圖像生成應用穩定運行。

Nano Banana Pro API 過載錯誤核心要點

| 要點 | 說明 | 影響 |

|---|---|---|

| 錯誤類型 | HTTP 503 UNAVAILABLE 服務端錯誤 | API 請求完全失敗,需重試 |

| 根本原因 | Google 官方算力資源不足 | 影響所有使用該模型的開發者 |

| 響應時間 | 從 30 秒延長至 60-100+ 秒 | 用戶體驗嚴重下降 |

| 影響範圍 | 全球所有 API 用戶(含付費用戶) | 不分層級普遍受影響 |

| 官方態度 | 狀態頁顯示正常,無明確修復時間 | 開發者需自行應對 |

Nano Banana Pro API 過載問題詳解

這個 503 錯誤並非開發者的代碼問題,而是 Google 服務器端的算力容量瓶頸。根據 Google AI 開發者論壇的多個討論帖,這一問題從 2025 年下半年開始頻繁出現,至今仍未完全解決。

錯誤的完整返回格式如下:

{

"error": {

"code": 503,

"message": "The model is overloaded. Please try again later.",

"status": "UNAVAILABLE"

}

}

值得注意的是,即使是 Tier 3 付費用戶(最高配額層級),在請求頻率遠低於配額限制的情況下,依然會遭遇這一錯誤。這表明問題出在 Google 的基礎設施層面,而非個人賬戶限制。

Nano Banana Pro API 過載的 5 種解決方案

方案一:實現指數退避重試機制

由於 503 錯誤是可恢復的臨時性故障,最有效的策略是實現智能重試:

import openai

import time

import random

def call_nano_banana_pro_with_retry(prompt: str, max_retries: int = 5):

"""

帶指數退避的 Nano Banana Pro API 調用

"""

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

for attempt in range(max_retries):

try:

response = client.chat.completions.create(

model="gemini-2.0-flash-preview-image-generation",

messages=[{"role": "user", "content": prompt}]

)

return response

except Exception as e:

if "503" in str(e) or "overloaded" in str(e).lower():

wait_time = (2 ** attempt) + random.uniform(0, 1)

print(f"模型過載,{wait_time:.1f}秒後重試...")

time.sleep(wait_time)

else:

raise e

raise Exception("達到最大重試次數,請稍後再試")

查看完整實現代碼(含異步版本)

import openai

import asyncio

import random

from typing import Optional

class NanoBananaProClient:

"""

Nano Banana Pro API 客戶端封裝

支持自動重試和錯誤處理

"""

def __init__(self, api_key: str, base_url: str = "https://vip.apiyi.com/v1"):

self.client = openai.OpenAI(api_key=api_key, base_url=base_url)

self.async_client = openai.AsyncOpenAI(api_key=api_key, base_url=base_url)

def generate_image(

self,

prompt: str,

max_retries: int = 5,

base_delay: float = 2.0

) -> dict:

"""同步調用,帶指數退避重試"""

for attempt in range(max_retries):

try:

response = self.client.chat.completions.create(

model="gemini-2.0-flash-preview-image-generation",

messages=[{"role": "user", "content": prompt}],

timeout=120 # 延長超時時間

)

return {"success": True, "data": response}

except Exception as e:

error_msg = str(e).lower()

if "503" in error_msg or "overloaded" in error_msg:

if attempt < max_retries - 1:

delay = (base_delay ** attempt) + random.uniform(0, 1)

print(f"[重試 {attempt + 1}/{max_retries}] 等待 {delay:.1f}s")

time.sleep(delay)

continue

return {"success": False, "error": str(e)}

return {"success": False, "error": "達到最大重試次數"}

async def generate_image_async(

self,

prompt: str,

max_retries: int = 5,

base_delay: float = 2.0

) -> dict:

"""異步調用,帶指數退避重試"""

for attempt in range(max_retries):

try:

response = await self.async_client.chat.completions.create(

model="gemini-2.0-flash-preview-image-generation",

messages=[{"role": "user", "content": prompt}],

timeout=120

)

return {"success": True, "data": response}

except Exception as e:

error_msg = str(e).lower()

if "503" in error_msg or "overloaded" in error_msg:

if attempt < max_retries - 1:

delay = (base_delay ** attempt) + random.uniform(0, 1)

await asyncio.sleep(delay)

continue

return {"success": False, "error": str(e)}

return {"success": False, "error": "達到最大重試次數"}

# 使用示例

client = NanoBananaProClient(api_key="YOUR_API_KEY")

result = client.generate_image("生成一隻可愛的貓咪")

建議: 通過 API易 apiyi.com 調用 Nano Banana Pro API,平臺已內置智能重試機制,可有效降低 503 錯誤對業務的影響。

方案二:選擇低峯時段調用

根據社區反饋,Nano Banana Pro API 的過載問題存在明顯的時段規律:

| 時段(UTC) | 負載情況 | 建議操作 |

|---|---|---|

| 00:00 – 06:00 | 較低 | 適合批量任務 |

| 06:00 – 12:00 | 中等 | 可正常使用 |

| 12:00 – 18:00 | 高峯 | 建議減少調用或增加重試 |

| 18:00 – 24:00 | 較高 | 需要耐心等待 |

方案三:使用可靠的 API 中轉服務

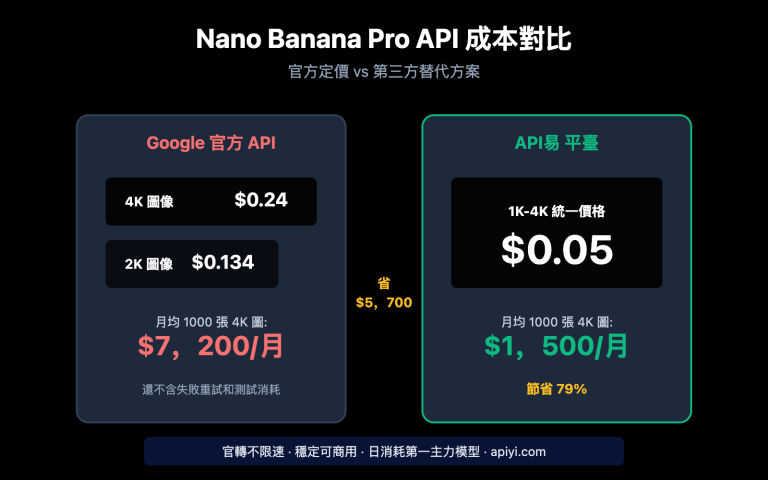

直接調用 Google 官方 API 會直接暴露在算力不足的風險下。使用專業的 API 中轉服務可以獲得以下優勢:

| 對比維度 | 直接調用官方 API | 使用 API易 中轉服務 |

|---|---|---|

| 錯誤處理 | 需自行實現重試邏輯 | 平臺內置智能重試 |

| 穩定性 | 受官方算力波動影響大 | 多節點負載均衡 |

| 響應速度 | 30-100+ 秒波動 | 相對穩定 |

| 技術支持 | 僅論壇社區 | 專業技術團隊 |

| 成本 | 按官方價格 | 高性價比方案 |

實測體驗: 通過 API易 apiyi.com 調用 Nano Banana Pro API,在高峯時段的成功率明顯高於直連官方接口,平臺會自動處理重試和降級策略。

方案四:配置合理的超時時間

由於響應時間顯著延長,需要調整客戶端的超時配置:

import openai

import httpx

# 配置更長的超時時間

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1",

timeout=httpx.Timeout(

connect=30.0, # 連接超時

read=180.0, # 讀取超時(圖像生成需要更長時間)

write=30.0, # 寫入超時

pool=30.0 # 連接池超時

)

)

方案五:實現請求隊列和限流

對於生產環境,建議實現請求隊列避免併發請求過多:

from queue import Queue

from threading import Thread

import time

class RequestQueue:

"""簡單的請求隊列實現"""

def __init__(self, requests_per_minute: int = 10):

self.queue = Queue()

self.interval = 60 / requests_per_minute

self.running = True

self.worker = Thread(target=self._process_queue)

self.worker.start()

def add_request(self, request_func, callback):

self.queue.put((request_func, callback))

def _process_queue(self):

while self.running:

if not self.queue.empty():

request_func, callback = self.queue.get()

result = request_func()

callback(result)

time.sleep(self.interval)

else:

time.sleep(0.1)

Nano Banana Pro API 官方狀態監控

如何查看 Google 官方算力狀態

雖然 Google 的狀態頁面經常顯示"一切正常",但你仍可以通過以下渠道獲取實時信息:

| 監控渠道 | 地址 | 說明 |

|---|---|---|

| Google AI Studio 狀態頁 | aistudio.google.com/status |

官方狀態,但更新可能滯後 |

| Vertex AI 狀態頁 | status.cloud.google.com |

企業級狀態監控 |

| Google AI 開發者論壇 | discuss.ai.google.dev |

社區實時反饋最及時 |

| StatusGator 第三方監控 | statusgator.com |

用戶上報的真實狀態 |

| GitHub Issues | github.com/google-gemini |

開發者問題彙總 |

重要提示: 根據社區反饋,即使狀態頁顯示"0 issues",實際服務也可能存在嚴重的可用性問題。建議同時關注開發者論壇的實時討論。

常見問題

Q1: 爲什麼付費用戶也會遇到 503 錯誤?

503 錯誤表示服務端整體算力不足,這是 Google 基礎設施層面的問題,與個人賬戶的付費層級無關。付費用戶確實享有更高的請求配額(RPM/RPD),但當整體算力不足時,所有用戶都會受到影響。付費用戶的優勢在於高峯時段的請求會被優先處理。

Q2: 響應時間從 30 秒變成 100 秒正常嗎?

這不是正常現象,而是 Google 服務器過載的典型症狀。正常情況下,Nano Banana Pro 的圖像生成應在 20-40 秒內完成。響應時間大幅延長說明服務正在排隊處理請求,建議實現更長的超時配置和重試機制來應對。

Q3: 如何降低 503 錯誤對業務的影響?

推薦綜合使用以下策略:

- 使用可靠的 API 中轉服務如 API易 apiyi.com,獲得內置的重試和降級能力

- 實現本地緩存,避免重複生成相同內容

- 設計優雅降級方案,在 API 不可用時提供備選功能

- 配置告警監控,及時發現服務異常

總結

Nano Banana Pro API 過載錯誤的核心要點:

- 錯誤本質: 這是 Google 服務端算力不足導致的 503 錯誤,非開發者代碼問題

- 應對策略: 實現指數退避重試機制是最有效的解決方案

- 推薦方案: 使用專業 API 中轉服務可獲得更穩定的調用體驗

面對 Google 官方算力波動的問題,開發者需要做好充分的容錯設計。通過合理的重試策略、超時配置和服務選擇,可以有效降低過載錯誤對業務的影響。

推薦通過 API易 apiyi.com 調用 Nano Banana Pro API,平臺提供穩定可靠的服務、智能重試機制和專業技術支持,幫助你的圖像生成應用穩定運行。

📚 參考資料

⚠️ 鏈接格式說明: 所有外鏈使用

資料名: domain.com格式,方便複製但不可點擊跳轉,避免 SEO 權重流失。

-

Google AI 開發者論壇 – Model is overloaded 討論: 官方社區關於 503 錯誤的討論帖

- 鏈接:

discuss.ai.google.dev/t/model-is-overloaded-gemini-2-5-pro/108321 - 說明: 瞭解其他開發者的遭遇和解決經驗

- 鏈接:

-

Google AI Studio 狀態頁: 官方服務狀態監控

- 鏈接:

aistudio.google.com/status - 說明: 查看 Gemini API 的官方運行狀態

- 鏈接:

-

GitHub gemini-cli Issues: 開發者問題彙總

- 鏈接:

github.com/google-gemini/gemini-cli/issues - 說明: 查看和上報 Gemini API 相關問題

- 鏈接:

-

Vertex AI Gemini 文檔: 官方圖像生成文檔

- 鏈接:

cloud.google.com/vertex-ai/generative-ai/docs/multimodal/image-generation - 說明: 瞭解 Gemini 圖像生成模型的官方用法

- 鏈接:

作者: 技術團隊

技術交流: 歡迎在評論區討論,更多資料可訪問 API易 apiyi.com 技術社區