作者注:深入解析 Gemini API 的 safetySettings 安全設置機制,包括四大危害類別、五級閾值配置、BLOCK_NONE 的實際作用,幫助開發者正確配置圖像生成模型的內容過濾

<!– 背景 –>

<!– 裝飾元素 –>

<!– 主標題 –>

<!– 中央 Gemini 核心 –>

<!– 安全盾牌環 –>

<!– 四大類別 –>

<!– 騷擾 –>

<!– 仇恨言論 –>

<!– 色情內容 –>

<!– 危險內容 –>

<!– 閾值級別條 –>

<!– 閾值級別從寬鬆到嚴格 –>

<!– 箭頭指示從寬鬆到嚴格 –>

<!– API易推廣文字 –>

使用 Gemini 圖像生成 API(如 gemini-2.0-flash-exp-image-generation 或 gemini-3-pro-image-preview)時,你可能見過這樣的配置代碼:

"safetySettings": [

{"category": "HARM_CATEGORY_HARASSMENT", "threshold": "BLOCK_NONE"},

{"category": "HARM_CATEGORY_HATE_SPEECH", "threshold": "BLOCK_NONE"},

{"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT", "threshold": "BLOCK_NONE"},

{"category": "HARM_CATEGORY_DANGEROUS_CONTENT", "threshold": "BLOCK_NONE"}

]

這段配置究竟是什麼意思?BLOCK_NONE 真的能讓模型生成任何內容嗎?本文將詳細解析 Gemini API 安全設置 的工作原理和正確使用方式。

核心價值: 讀完本文,你將理解 Gemini 安全設置的四大危害類別、五級閾值配置,以及 BLOCK_NONE 的真實作用和侷限性。

Gemini 安全設置核心要點

| 要點 | 說明 | 重要性 |

|---|---|---|

| 四大危害類別 | 騷擾、仇恨言論、色情內容、危險內容 | 可調節的內容過濾維度 |

| 五級閾值配置 | OFF、BLOCK_NONE、BLOCK_FEW、BLOCK_SOME、BLOCK_MOST | 控制過濾敏感度 |

| BLOCK_NONE 含義 | 關閉該類別的概率過濾,但不繞過核心保護 | 最寬鬆的可調節設置 |

| 不可調節的保護 | 兒童安全等核心危害始終被阻止 | 硬編碼保護,無法關閉 |

安全設置的設計理念

Gemini API 的安全設置採用分層防護機制:

- 可調節層:開發者可以根據應用場景調整四大類別的過濾閾值

- 不可調節層:針對兒童安全等核心危害,系統始終阻止,無法通過任何設置繞過

這意味着,即使你將所有類別都設置爲 BLOCK_NONE,模型仍然會拒絕生成涉及兒童安全等核心違規內容。

四大危害類別詳解

<!– 背景 –>

<!– 標題 –>

<!– 第一行:騷擾 & 仇恨言論 –>

<!– 騷擾 –>

<!– 仇恨言論 –>

<!– 第二行:色情 & 危險內容 –>

<!– 色情內容 –>

<!– 危險內容 –>

<!– 底部提示 –>

<!– API易推廣文字 –>

Gemini API 支持四個可調節的危害類別:

1. HARM_CATEGORY_HARASSMENT(騷擾)

定義: 針對身份認同或受保護屬性的負面或有害評論

包含內容:

- 人身攻擊和侮辱

- 針對特定羣體的歧視性言論

- 網絡霸凌相關內容

2. HARM_CATEGORY_HATE_SPEECH(仇恨言論)

定義: 粗魯、不尊重或褻瀆的內容

包含內容:

- 種族歧視言論

- 宗教仇恨

- 基於性別、性取向的歧視

3. HARM_CATEGORY_SEXUALLY_EXPLICIT(色情內容)

定義: 涉及性行爲或淫穢材料的引用

包含內容:

- 明確的性描述

- 裸露內容

- 色情暗示

4. HARM_CATEGORY_DANGEROUS_CONTENT(危險內容)

定義: 促進、協助或鼓勵有害行爲的內容

包含內容:

- 武器製造教程

- 自殘或傷害他人的指導

- 非法活動說明

| 類別 | API 常量 | 過濾對象 |

|---|---|---|

| 騷擾 | HARM_CATEGORY_HARASSMENT |

人身攻擊、歧視言論 |

| 仇恨言論 | HARM_CATEGORY_HATE_SPEECH |

種族/宗教仇恨 |

| 色情內容 | HARM_CATEGORY_SEXUALLY_EXPLICIT |

性描述、裸露 |

| 危險內容 | HARM_CATEGORY_DANGEROUS_CONTENT |

有害行爲指導 |

提示: 通過 API易 apiyi.com 調用 Gemini API 時,這些安全設置同樣適用,可以根據實際需求進行配置。

五級閾值配置詳解

<!– 背景 –>

<!– 標題 –>

<!– 概率指示器背景 –>

<!– 五級閾值條形圖 –>

<!– OFF / BLOCK_NONE –>

<!– BLOCK_ONLY_HIGH –>

<!– BLOCK_MEDIUM_AND_ABOVE –>

<!– BLOCK_LOW_AND_ABOVE –>

<!– 標註 –>

<!– API易推廣文字 –>

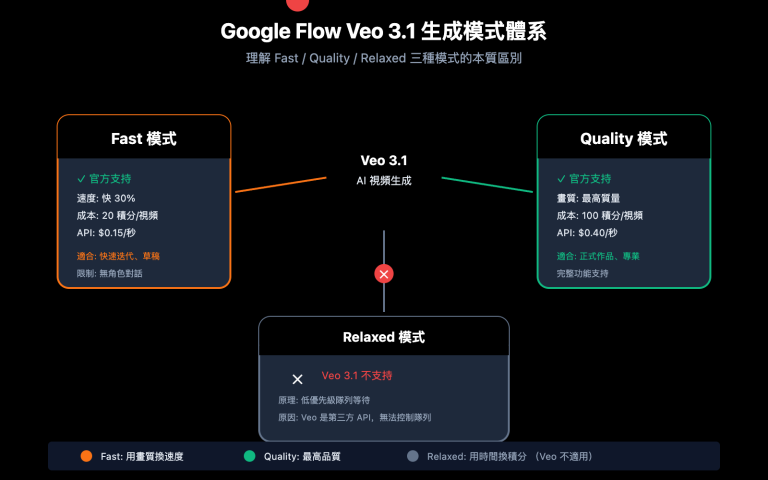

Gemini API 提供五個閾值級別,控制內容過濾的敏感度:

| 設置名稱 | API 值 | 過濾效果 | 適用場景 |

|---|---|---|---|

| 關閉 | OFF |

完全關閉安全過濾器 | Gemini 2.5+ 默認值 |

| 不阻止 | BLOCK_NONE |

無論概率評估如何都顯示內容 | 需要最大創作自由 |

| 阻止少量 | BLOCK_ONLY_HIGH |

僅阻止高概率有害內容 | 大多數應用場景 |

| 阻止部分 | BLOCK_MEDIUM_AND_ABOVE |

阻止中等及以上概率內容 | 需要適度過濾 |

| 阻止大部分 | BLOCK_LOW_AND_ABOVE |

阻止低概率及以上內容 | 最嚴格過濾 |

閾值工作原理

Gemini 系統會對每段內容進行概率評估,判斷其屬於有害內容的可能性:

- HIGH: 高概率(很可能是有害內容)

- MEDIUM: 中等概率

- LOW: 低概率

- NEGLIGIBLE: 可忽略的概率

關鍵點: 系統基於概率而非嚴重程度進行阻止。這意味着:

- 高概率但低嚴重程度的內容可能被阻止

- 低概率但高嚴重程度的內容可能通過

默認值說明

| 模型版本 | 默認閾值 |

|---|---|

| Gemini 2.5、Gemini 3 等新版 GA 模型 | OFF(關閉) |

| 其他舊版模型 | BLOCK_SOME(阻止部分) |

BLOCK_NONE 的真實作用

它能做什麼

設置 BLOCK_NONE 後:

- 關閉概率過濾: 該類別不再根據概率評估阻止內容

- 允許邊緣內容: 可能被誤判的合法內容不會被阻止

- 提升創作自由: 藝術、教育、新聞等場景下減少誤攔截

它不能做什麼

即使所有類別都設置爲 BLOCK_NONE:

- 核心保護仍有效: 兒童安全等硬編碼保護無法繞過

- 多層過濾存在: 生成過程中的實時監控和後處理檢查仍在運行

- 政策紅線不變: 明確違反 Google 政策的內容仍會被拒絕

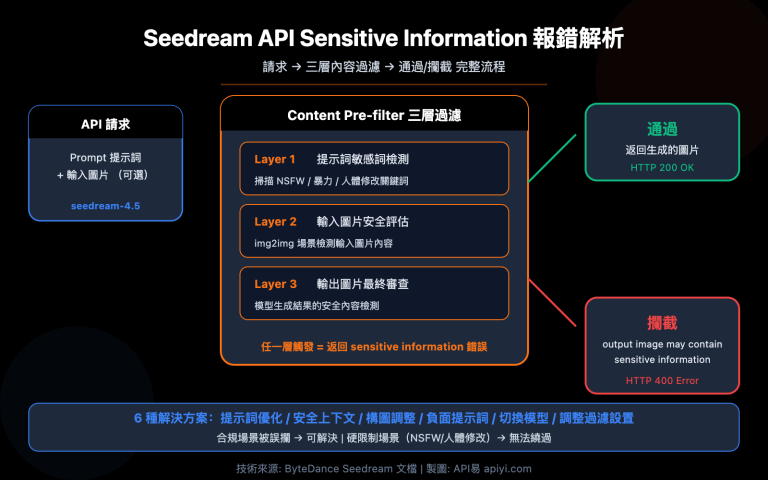

圖像生成的特殊性

對於圖像生成模型(如 gemini-2.0-flash-exp-image-generation),安全過濾更爲複雜:

- 提示詞過濾: 輸入的文本提示首先經過檢查

- 生成過程監控: 生成中間結果時持續監控

- 輸出後審查: 生成完成後還有一道合規檢查

研究表明,直接的明確提示通常會被阻止,但多輪對話升級等技術可能繞過部分檢查。

實際配置示例

Python SDK 配置

import google.generativeai as genai

# 配置安全設置

safety_settings = [

{

"category": "HARM_CATEGORY_HARASSMENT",

"threshold": "BLOCK_NONE"

},

{

"category": "HARM_CATEGORY_HATE_SPEECH",

"threshold": "BLOCK_NONE"

},

{

"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT",

"threshold": "BLOCK_NONE"

},

{

"category": "HARM_CATEGORY_DANGEROUS_CONTENT",

"threshold": "BLOCK_NONE"

}

]

# 創建模型實例

model = genai.GenerativeModel(

model_name="gemini-2.0-flash-exp",

safety_settings=safety_settings

)

# 生成內容

response = model.generate_content("你的提示詞")

查看 REST API 配置示例

{

"model": "gemini-2.0-flash-exp-image-generation",

"contents": [

{

"role": "user",

"parts": [

{"text": "生成一張藝術風格的圖像"}

]

}

],

"safetySettings": [

{

"category": "HARM_CATEGORY_HARASSMENT",

"threshold": "BLOCK_NONE"

},

{

"category": "HARM_CATEGORY_HATE_SPEECH",

"threshold": "BLOCK_NONE"

},

{

"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT",

"threshold": "BLOCK_NONE"

},

{

"category": "HARM_CATEGORY_DANGEROUS_CONTENT",

"threshold": "BLOCK_NONE"

}

],

"generationConfig": {

"responseModalities": ["image", "text"]

}

}

建議: 通過 API易 apiyi.com 可以快速測試不同安全設置的效果,平臺支持 Gemini 系列模型的統一接口調用。

使用場景與建議

適合使用 BLOCK_NONE 的場景

| 場景 | 說明 | 建議配置 |

|---|---|---|

| 藝術創作 | 人體藝術、抽象表現 | 色情類別可適當放寬 |

| 新聞報道 | 戰爭、衝突相關圖像 | 危險內容類別可放寬 |

| 教育用途 | 醫學、歷史教育內容 | 根據具體內容調整 |

| 內容審覈 | 需要分析可能違規的內容 | 全部設爲 BLOCK_NONE |

不建議使用 BLOCK_NONE 的場景

| 場景 | 說明 | 建議配置 |

|---|---|---|

| 面向公衆的應用 | 普通用戶使用的產品 | BLOCK_MEDIUM_AND_ABOVE |

| 兒童相關應用 | 教育、娛樂類兒童產品 | BLOCK_LOW_AND_ABOVE |

| 企業內部工具 | 需要合規審計的場景 | BLOCK_ONLY_HIGH |

最佳實踐

- 漸進式調整: 從默認設置開始,根據實際需求逐步放寬

- 分類別配置: 不同類別可以設置不同閾值,無需全部相同

- 監控與日誌: 記錄被阻止的請求,分析是否需要調整

- 用戶場景分析: 根據最終用戶羣體決定合適的過濾級別

常見問題

Q1: 設置 BLOCK_NONE 後爲什麼仍有內容被阻止?

BLOCK_NONE 只關閉該類別的概率過濾,但以下情況仍會阻止:

- 核心保護: 兒童安全等硬編碼保護無法關閉

- 其他類別: 如果只設置了部分類別爲 BLOCK_NONE

- 政策紅線: 明確違反 Google 使用政策的內容

- 生成過程檢查: 圖像生成有額外的實時監控

Q2: OFF 和 BLOCK_NONE 有什麼區別?

根據 Google 官方文檔:

- OFF: 完全關閉安全過濾器(Gemini 2.5+ 的默認值)

- BLOCK_NONE: 無論概率評估如何都顯示內容

實際效果非常接近,但 OFF 更徹底地禁用了該類別的過濾邏輯。對於新版模型,兩者效果基本相同。

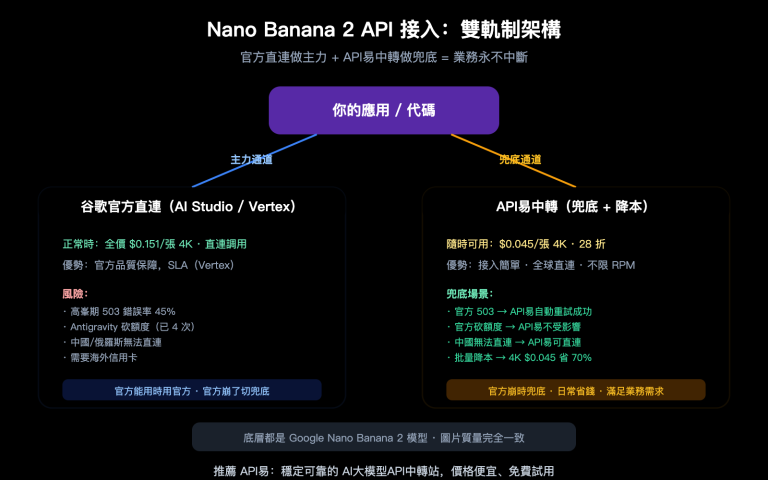

Q3: 如何通過 API 中轉服務使用安全設置?

通過 API易 apiyi.com 調用 Gemini API 時:

- 安全設置參數完全透傳給 Google API

- 配置方式與直接調用 Google API 相同

- 支持所有四大類別和五級閾值

- 可以在測試階段快速驗證不同配置的效果

總結

Gemini API 安全設置的核心要點:

- 四大可調類別: 騷擾、仇恨言論、色情內容、危險內容,開發者可根據需求調整

- 五級閾值配置: 從 OFF/BLOCK_NONE(最寬鬆)到 BLOCK_LOW_AND_ABOVE(最嚴格)

- BLOCK_NONE 的本質: 關閉概率過濾,但不繞過核心保護和政策紅線

- 分層防護機制: 可調節層 + 不可調節層,確保基本安全底線

- 圖像生成特殊性: 多層過濾(提示詞→生成過程→輸出審查)更爲嚴格

理解這些設置後,你可以根據應用場景合理配置安全參數,在創作自由和內容安全之間找到平衡。

通過 API易 apiyi.com 可以快速測試 Gemini 圖像生成模型的安全設置效果,平臺提供免費額度和多模型統一接口。

參考資料

⚠️ 鏈接格式說明: 所有外鏈使用

資料名: domain.com格式,方便複製但不可點擊跳轉,避免 SEO 權重流失。

-

Gemini API 安全設置官方文檔: Google 官方指南

- 鏈接:

ai.google.dev/gemini-api/docs/safety-settings - 說明: 權威的安全設置配置說明和 API 參考

- 鏈接:

-

Vertex AI 安全過濾器配置: Google Cloud 文檔

- 鏈接:

cloud.google.com/vertex-ai/generative-ai/docs/multimodal/configure-safety-filters - 說明: 企業級 Vertex AI 的安全配置詳解

- 鏈接:

-

Gemini 安全指南: 開發者最佳實踐

- 鏈接:

ai.google.dev/gemini-api/docs/safety-guidance - 說明: 安全使用 Gemini API 的官方建議

- 鏈接:

-

Firebase AI Logic 安全設置: Firebase 集成指南

- 鏈接:

firebase.google.com/docs/ai-logic/safety-settings - 說明: Firebase 環境下的安全設置配置

- 鏈接:

作者: 技術團隊

技術交流: 歡迎在評論區討論,更多資料可訪問 API易 apiyi.com 技術社區