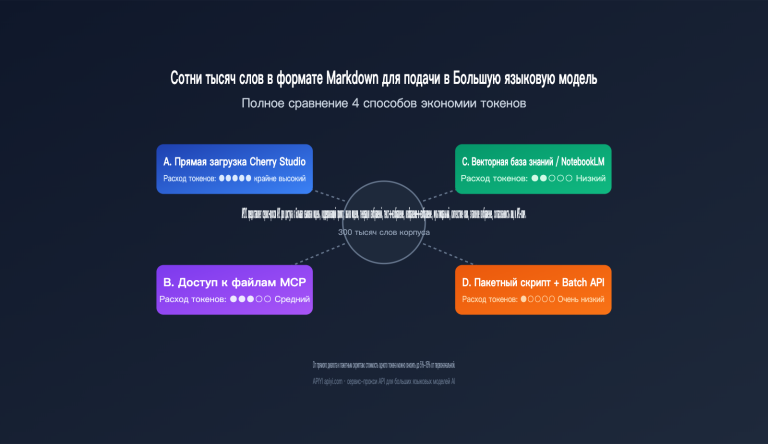

Полное сравнение 4 способов экономии токенов при обработке сотен тысяч слов Markdown-корпуса большой языковой моделью

Недавно получил типичный запрос: пользователь хочет «дистиллировать» сотни тысяч слов текстов талантливого автора, чтобы обучить большую языковую модель его стилю, но не знает, как наиболее выгодно «скормить» ей Markdown-материалы. Обычно рассматривают три пути: загружать файлы по одному в инструменты для чата вроде Cherry Studio, использовать MCP для прямого доступа модели к файлам на диске или…