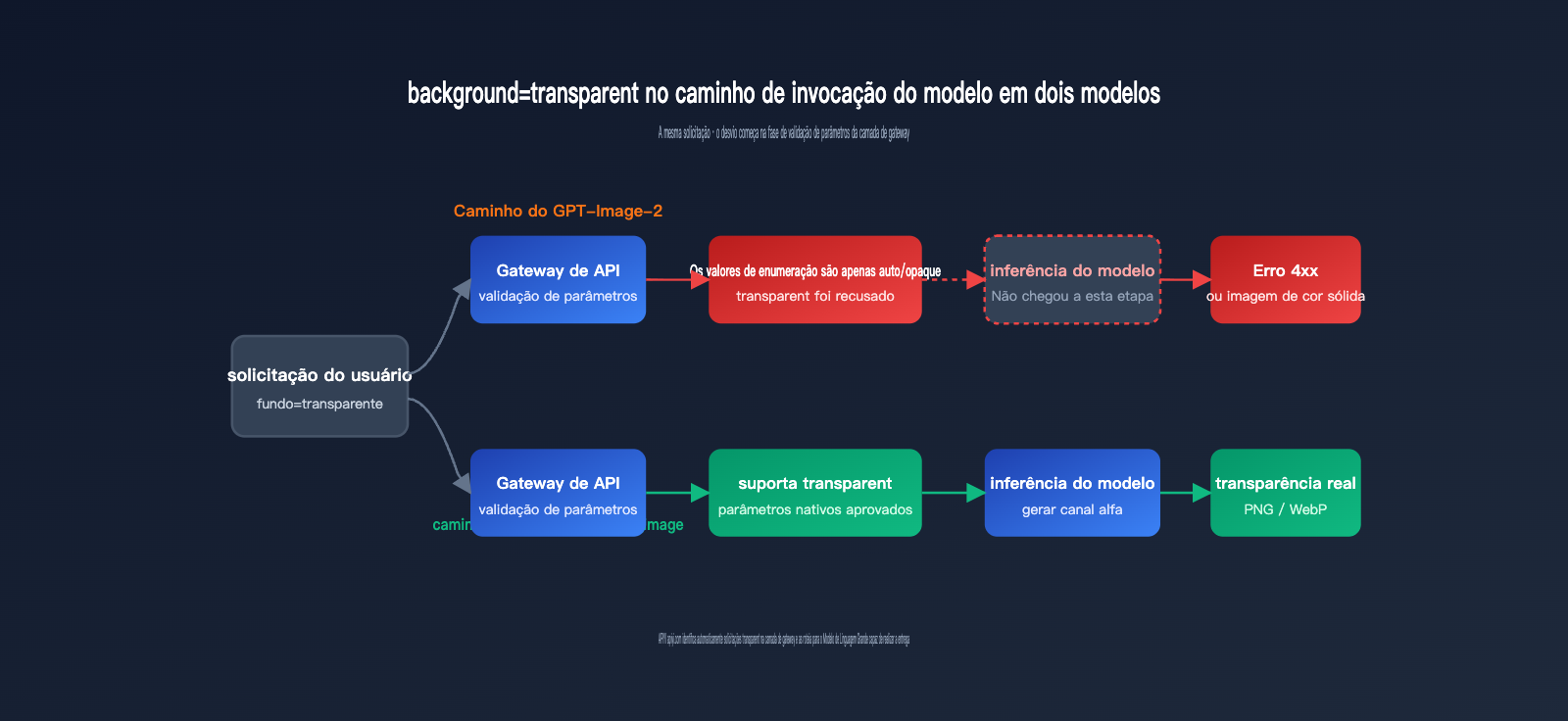

Recentemente, ao ajudar clientes a solucionar problemas com demandas de geração de imagens, notamos um fenômeno que vale a pena compartilhar: o GPT-Image-2 não consegue mais gerar PNGs com fundo verdadeiramente transparente. Não importa se você escreve "o fundo deve ser transparente" no comando ou se passa o parâmetro background: "transparent" diretamente via API, a última geração do GPT-Image-2 retornará uma imagem com fundo sólido ou simplesmente exibirá um erro. Isso cria um contraste de capacidade muito evidente em relação à geração anterior (sora_image / gpt-4o-image), deixando equipes que trabalham com recorte de SKU para e-commerce, adesivos para redes sociais e ilustrações para PPT em uma situação difícil.

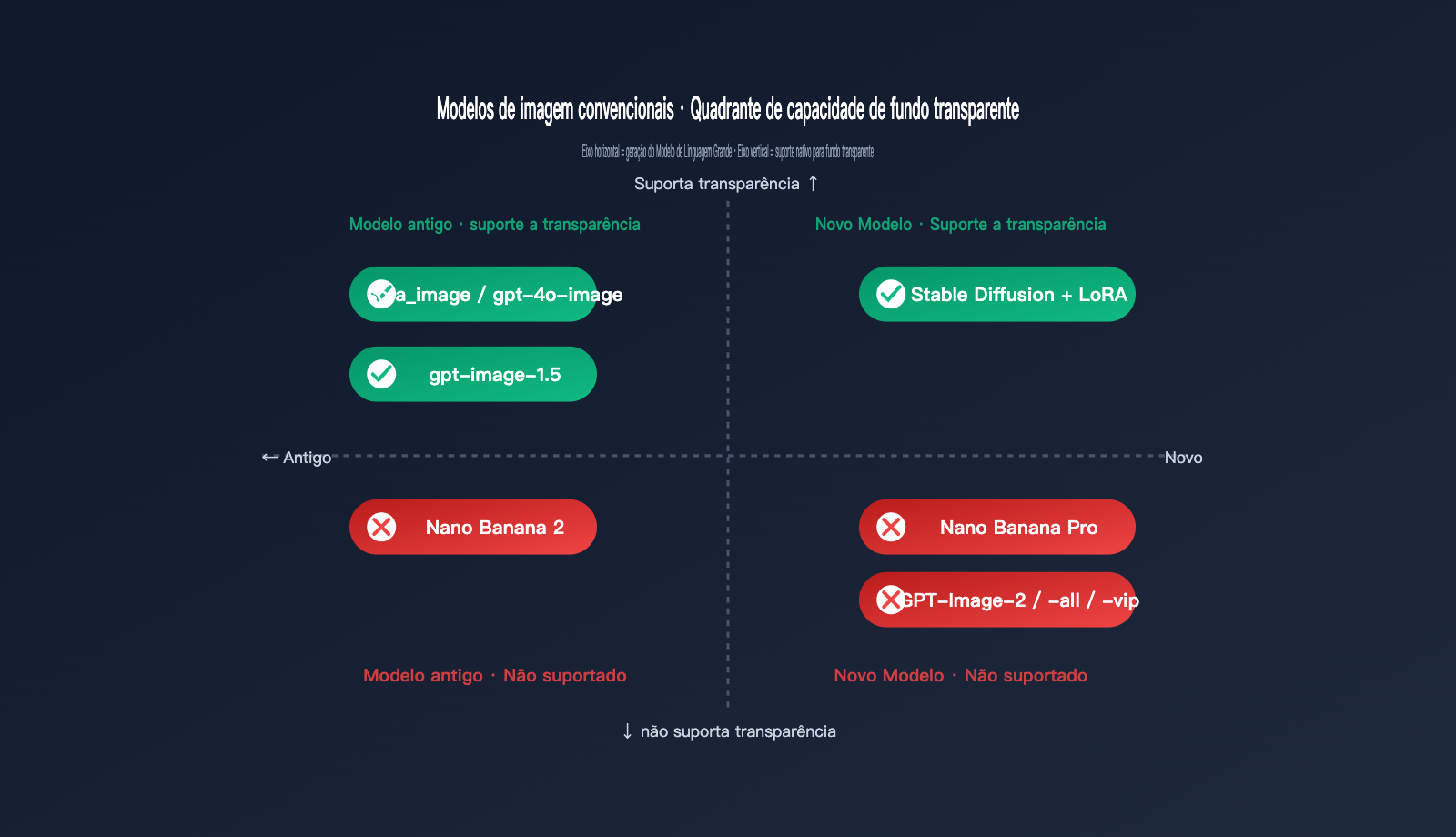

Curiosamente, o modelo de imagem topo de linha da Google lançado no final de 2025, o Nano Banana Pro (baseado no Gemini 3 Pro Image), também não suporta a geração de fundo transparente, e o seu antecessor, o Nano Banana 2, apresenta a mesma limitação. Em outras palavras, as duas bases de geração de imagem mais populares do setor removeram o que parecia ser uma funcionalidade básica: o "fundo transparente". Realizamos uma rodada completa de testes de regressão na APIYI (apiyi.com) e organizamos o fenômeno, a causa raiz e as alternativas neste artigo para facilitar a tomada de decisão rápida das equipes que estão integrando esses produtos.

Experimento de reprodução da falha de fundo transparente no GPT-Image-2

Para entender essa diferença de capacidade, a maneira mais direta é testar. Usamos o gateway da APIYI para chamar simultaneamente as versões gpt-image-2, gpt-image-1.5 e gpt-image-2-all, com o comando unificado "a cute orange cat sticker, transparent background" e definindo explicitamente o parâmetro background como transparent. O resultado foi muito consistente: a série gpt-image-2 retornou um erro 4xx ou gerou uma imagem com fundo sólido ou com o padrão de xadrez, enquanto apenas o gpt-image-1.5 retornou fielmente um PNG verdadeiramente transparente com canal alfa.

# Testando a capacidade de fundo transparente de 3 versões através do gateway da APIYI

from openai import OpenAI

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1"

)

# ❌ gpt-image-2 não suporta transparent, sendo rejeitado pela camada de gateway

client.images.generate(

model="gpt-image-2",

prompt="a cute orange cat sticker",

background="transparent",

output_format="png"

)

# ✅ gpt-image-1.5 ainda suporta nativamente a saída de fundo transparente

client.images.generate(

model="gpt-image-1.5",

prompt="a cute orange cat sticker",

background="transparent",

output_format="png"

)

🎯 Dica rápida: Se você só quer que seu fluxo de trabalho atual funcione, a maneira de menor custo é voltar o campo

modelparagpt-image-1.5, apontar abase_urlpara a APIYI (apiyi.com) e manter os outros parâmetros inalterados. Em 5 minutos, você restaurará a capacidade de saída transparente.

Também reproduzimos situações em que inserimos comandos como "background must be transparent", "isolated on transparent canvas" ou "PNG with alpha channel". O GPT-Image-2 se mostrou muito resistente: ou forneceu um fundo branco, ou gerou uma imagem sólida com um "adesivo" de xadrez cinza e branco, o que equivale a desenhar uma marca visual que representa a transparência. Isso é altamente consistente com o padrão de falha do Nano Banana Pro e é uma falha profunda na camada de alinhamento semântico do modelo, não uma falta de precisão no comando.

| Método de disparo | Comportamento do GPT-Image-2 | Comportamento do gpt-image-1.5 | Recomendação |

|---|---|---|---|

Parâmetro background="transparent" |

Rejeitado pela API / Fundo sólido | PNG verdadeiramente transparente | Troque o modelo |

| Comando "transparent background" | Fundo branco ou padrão xadrez | PNG verdadeiramente transparente | Não dependa apenas do texto |

| Comando "isolated subject on white" | Fundo cinza claro | Fundo branco do objeto | Use em conjunto com parâmetros |

Saída output_format=webp |

Ainda fundo sólido | Webp verdadeiramente transparente | Webp não afeta a capacidade |

| Interface Edit + máscara alfa | Inválido | Transparência parcial | Disponível apenas no 1.5 |

3 motivos fundamentais pelos quais o fundo transparente foi removido do GPT-Image-2

O primeiro motivo é uma escolha de design na arquitetura. A OpenAI declarou explicitamente na documentação oficial do GPT-Image-2 que "o gpt-image-2 não suporta atualmente fundos transparentes". Embora o motivo não tenha sido tornado público, a especulação geral na indústria é que isso está relacionado à atualização para um objetivo de treinamento focado em "consistência de cena" mais robusta — o modelo foi treinado para completar uma cena do mundo real, em vez de realizar "recortes", o que significa que, em nível fundamental, não há sinal de supervisão para o canal alfa. Esta é uma decisão de design a nível de produto, não um bug.

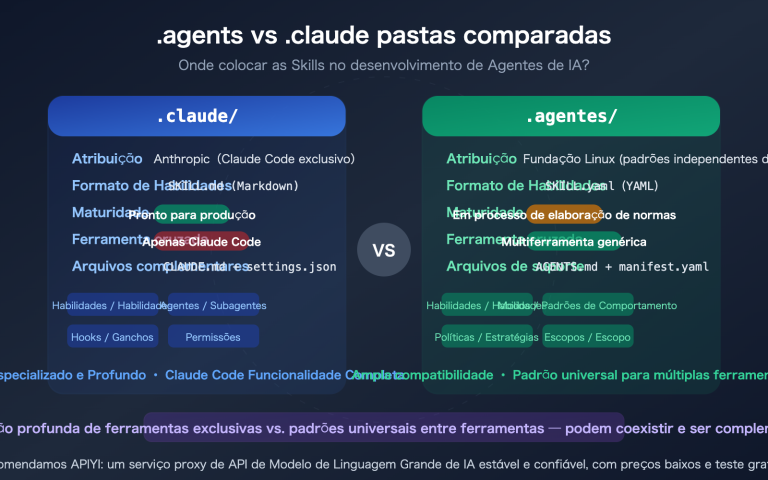

O segundo motivo é a validação forçada do gateway da API. Analisamos a resposta do endpoint oficial da OpenAI e os valores enumerados do parâmetro background para o gpt-image-2 permitem apenas auto e opaque, removendo o transparent do espaço de parâmetros. Isso significa que qualquer plataforma upstream (incluindo o gateway da APIYI) rejeitará essa chamada logo na fase de solicitação, antes mesmo de chegar à etapa de inferência do modelo. Portanto, acreditar que "trocar para uma plataforma de terceiros resolverá o problema" é uma ilusão; canais como gpt-image-2-all e gpt-image-2-vip utilizam o mesmo modelo de backend.

O terceiro motivo é a estratégia de filtragem de segurança e direitos autorais. Imagens com fundo transparente são frequentemente usadas para composição secundária, especialmente em cenários envolvendo retratos e logotipos de marcas. Nos últimos dois anos, a OpenAI tem restringido visivelmente as permissões de saída para "materiais passíveis de composição secundária", e o gpt-image-2 também adotou um pipeline de revisão de conteúdo mais rigoroso, o que, até certo ponto, está alinhado com a descontinuação da capacidade de fundo transparente.

🎯 Dica de compreensão da arquitetura: Em um gateway unificado como o da APIYI (apiyi.com), validamos os espaços de parâmetros do gpt-image-2 e do gpt-image-1.5 separadamente. Ao encontrar uma solicitação com

transparent, sugerimos automaticamente um downgrade para evitar que o lado do negócio sofra com "falhas de chamada sem saber o motivo".

Comparação entre GPT-Image-2 e Nano Banana Pro na capacidade de fundo transparente

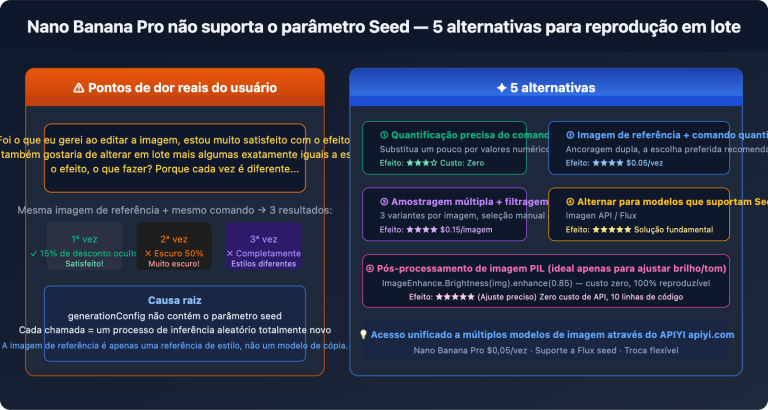

Muitos clientes nos perguntam: "Trocar para o Google Nano Banana 2 / Nano Banana Pro resolve o problema?". A resposta é bastante dura: não resolve. O modo de falha do Nano Banana Pro é até mais "peculiar" que o do GPT-Image-2: ele gera uma imagem que, à primeira vista, parece ter um "fundo transparente", mas, ao olhar de perto, aquele padrão de xadrez é, na verdade, composto por pixels sólidos desenhados na imagem, como se o modelo tivesse "copiado" o padrão de indicação de transparência do Photoshop.

A explicação predominante na comunidade é que os dados de treinamento do modelo contêm uma enorme quantidade de imagens com "xadrez representando transparência" (bancos de imagens, capturas de tela do Photoshop, tutoriais de design, etc.), o que levou o modelo a criar uma associação errônea de que "transparência = xadrez". O Google confirmou oficialmente no fórum da Gemini API que a série Nano Banana não terá suporte nativo para saída de fundo transparente por enquanto, sendo necessário recorrer à combinação de Gemini 3 Flash + execução de código para "dar um jeito".

| Modelo | Data de Lançamento | Suporte a Fundo Transparente | Comportamento na Falha | Cenário Recomendado |

|---|---|---|---|---|

| GPT-Image-2 | Início de 2026 | ❌ Não suportado | Fundo sólido / Erro | Imagens realistas, cartazes |

| GPT-Image-2-all (inverso oficial) | Início de 2026 | ❌ Não suportado | Igual ao oficial | Equivalente ao GPT-Image-2 |

| GPT-Image-1.5 | Meados de 2025 | ✅ Suporte nativo | / | Adesivos, recorte para e-commerce |

| sora_image / gpt-4o-image | Março de 2025 | ✅ Suportado | / | Compatível com fluxos antigos |

| Nano Banana 2 | 2º semestre de 2025 | ❌ Não suportado | Padrão xadrez cinza e branco | Criação secundária, estilização |

| Nano Banana Pro | Final de 2025 | ❌ Não suportado | Padrão xadrez cinza e branco | Edição de alta fidelidade |

| Stable Diffusion + LoRA | Atualização contínua | ✅ Suporte indireto | Requer pós-processamento | Produção em lote auto-hospedada |

🎯 Dica de Seleção: Se você só precisa "recortar o objeto", a combinação mais econômica em 2026 é usar o GPT-Image-1.5 / sora_image para gerar a imagem diretamente, ou usar o Nano Banana Pro e rodar uma remoção de fundo em seguida. Ambos os caminhos podem utilizar a autenticação e cobrança unificadas na APIYI (apiyi.com), evitando que sua equipe precise manter duas chaves API diferentes.

4 alternativas para o fundo transparente do GPT-Image-2

Embora o GPT-Image-2 se recuse a gerar imagens transparentes, existem quatro caminhos maduros para viabilizar o negócio, cada um com sua própria curva de custo e qualidade, que podem ser combinados conforme o cenário.

A primeira é fazer o downgrade direto para sora_image / gpt-image-1.5. Esta é a solução com menos alterações: o código de chamada do cliente quase não precisa mudar, basta alterar o campo model de gpt-image-2 para gpt-image-1.5 ou sora_image, e a saída do canal alfa será restaurada imediatamente. O custo é que o realismo e a capacidade de renderização de textos longos serão um pouco inferiores aos do GPT-Image-2, mas é perfeitamente adequado para adesivos, logotipos e imagens principais de e-commerce.

A segunda é geração pelo GPT-Image-2 + recorte pós-processamento. Primeiro, usa-se o GPT-Image-2 para gerar uma imagem de fundo sólido com maior qualidade e, em seguida, conecta-se um modelo de recorte (como 851-labs/background-remover, RemBG, BiRefNet) para remover o canal alfa. Esse método preserva as vantagens de realismo do GPT-Image-2, mas a latência aumenta de 1 a 3 segundos, e a precisão em bordas complexas (cabelos, vidro, fumaça) depende do modelo de recorte utilizado.

A terceira é o método de tela verde (Chroma Key). Exige-se no comando um "fundo verde puro sólido, hex #00ff00", fazendo com que o GPT-Image-2 gere uma imagem de fundo de cor sólida limpa, e então usa-se código para realizar a substituição por limite de cor HSV. Esse método é mais rápido e barato que o recorte genérico, mas tem o defeito de "comer" pixels do objeto que possuam tons de cor semelhantes, não sendo adequado para objetos que já sejam verdes.

A quarta é o método de subtração de duas imagens de fundo. Faz-se o GPT-Image-2 gerar duas imagens com a mesma semente (seed), uma com fundo branco e outra com fundo preto, e então calcula-se a diferença de cor pixel a pixel para deduzir o valor alfa. Esta é uma solução "hardcore" bastante discutida na comunidade OpenAI, com a qualidade mais estável, mas o custo é o dobro da taxa de geração.

| Alternativa | Complexidade de Implementação | Custo Adicional por Imagem | Qualidade de Borda | Cenário Aplicável |

|---|---|---|---|---|

| Voltar para GPT-Image-1.5 / sora_image | ⭐ | 0 | Alta | Adesivos, imagens de e-commerce |

| GPT-Image-2 + Modelo de recorte genérico | ⭐⭐ | +1 chamada de recorte | Média-Alta | Pessoas realistas, fotos de produtos |

| Método de tela verde (Chroma Key) | ⭐⭐⭐ | Quase zero | Média | Personagens de desenho, formas geométricas |

| Método de subtração de duas imagens | ⭐⭐⭐⭐ | 2x custo de geração | Alta | Vidro, cabelos e bordas complexas |

🎯 Sugestão de Engenharia: No backend da APIYI (apiyi.com), roteamos automaticamente a "demanda por fundo transparente" para o gpt-image-1.5; se o cliente desejar manter o estilo realista do GPT-Image-2, pode-se criar uma chamada serial de duas etapas ("geração + recorte") através da interface unificada, expondo apenas um endpoint para facilitar o encapsulamento do lado do negócio.

Se o projeto for sensível tanto à qualidade das bordas quanto ao custo, a tabela de comparação de ferramentas de recorte abaixo pode servir como ponto de partida para a seleção:

| Ferramenta de Recorte | Precisão de Borda | Tempo Médio | Forma de Implantação | Combinação Recomendada |

|---|---|---|---|---|

| 851-labs/background-remover | Alta | 1.5-2 seg | API na nuvem | Com imagens realistas do GPT-Image-2 |

| RemBG (U2Net) | Média | 0.5 seg | Auto-hospedado | Com fundo de cor sólida, tarefas em lote |

| BiRefNet | Altíssima | 2-3 seg | Auto-hospedado | Cabelos, bordas complexas |

| Limite de cor HSV | Média | <0.1 seg | Algumas linhas Python | Com tela verde (Chroma Key) |

FAQ sobre o fundo transparente no GPT-Image-2

P1: Por que escrever "o fundo deve ser transparente" no comando do GPT-Image-2 sempre falha?

Porque o modelo não foi treinado para "gerar um canal alfa"; ele só consegue desenhar no espaço RGB. Quando você insiste em descrições como "fundo transparente", ele interpreta literalmente e desenha um símbolo visual que "representa a transparência" — ou seja, aquele padrão de tabuleiro de xadrez. Isso é uma falha clássica de alinhamento semântico, não importa o quão detalhado seja o seu comando.

P2: Por que os canais de acesso via proxy, como o gpt-image-2-all / gpt-image-2-vip, também não funcionam?

Esses canais de acesso essencialmente chamam o mesmo modelo de backend da OpenAI; a única diferença é que o frontend gerencia um pool de contas ou um serviço proxy de API. Se o modelo não suporta uma capacidade, não há "embalagem" no frontend que resolva isso. Se você vir plataformas de terceiros alegando que o "GPT-Image-2 suporta fundo transparente", provavelmente elas estão realizando uma remoção de fundo via pós-processamento na camada de gateway da API, e não que o GPT-Image-2 esteja gerando a transparência nativamente.

P3: Se o meu projeto precisa de um fundo transparente, qual API devo escolher?

Com base em nossos testes práticos na APIYI (apiyi.com), recomendamos: para adesivos, figurinhas ou imagens principais de e-commerce, escolha o GPT-Image-1.5; para recortes realistas de nível fotográfico, use o GPT-Image-2 combinado com um modelo de remoção de fundo; para cenários que exigem conformidade local, considere o auto-hospedado da série Stable Diffusion. Você pode alternar entre essas três opções dentro do mesmo gateway, facilitando testes A/B.

P4: Quando o GPT-Image-2 / Nano Banana Pro voltará a suportar fundo transparente?

Nem a OpenAI nem o Google divulgaram um cronograma. Pelo ritmo de iteração anterior, a OpenAI geralmente adiciona parâmetros ausentes em subversões (como GPT-Image-2.1, 2.5); a série Nano Banana do Google tende a resolver isso através de uma "combinação" entre Gemini 3 Flash + execução de código, em vez de alterar o modelo base.

P5: Como a APIYI (apiyi.com) pode me ajudar com isso?

Nós fazemos três coisas: ① Identificamos automaticamente solicitações de transparent na camada de gateway e sugerimos o downgrade; ② Integramos o roteamento de múltiplos modelos, como GPT-Image-1.5, GPT-Image-2 e Nano Banana Pro; ③ Fornecemos faturamento, cotas e logs unificados, facilitando para a equipe comparar o custo real de diferentes soluções sem precisar manter vários SDKs.

3 conclusões sobre o problema de fundo transparente no GPT-Image-2

Primeiro, o fato de o GPT-Image-2 não suportar fundo transparente é uma estratégia de produto definida, não um problema de como escrever o comando ou de como realizar a integração. Qualquer fluxo de trabalho que tente repetidamente usar o termo "transparent" no comando deve ser migrado para a versão 1.5 ou para um pipeline de pós-processamento o mais rápido possível, caso contrário, você ficará preso em um ciclo de gerar padrões de tabuleiro de xadrez.

Segundo, o Nano Banana 2 / Pro também não suporta fundo transparente. Atualmente, a "saída transparente nativa" nesta categoria depende apenas da geração anterior (GPT-Image-1.5, sora_image / gpt-4o-image) ou do Stable Diffusion auto-hospedado. Não é realista depositar esperanças em algum "interruptor oculto".

Terceiro, a postura mais estável para o negócio é abstrair o modelo atrás de um gateway, permitindo que a "demanda por fundo transparente" seja roteada automaticamente para o modelo capaz de entregá-la. Já implementamos essa estratégia de roteamento como comportamento padrão, para que sua equipe economize tempo evitando erros comuns e foque na lógica de negócio real.

Se você está refatorando fluxos de trabalho relacionados à geração de imagens, convidamos você a realizar um teste de regressão diretamente na APIYI (apiyi.com): execute seus comandos atuais simultaneamente no GPT-Image-2 e no GPT-Image-1.5. Em 10 minutos, você terá uma tabela comparativa sobre "qual modelo usar em cada cenário" e poderá decidir se faz o downgrade ou se adiciona um pós-processamento de recorte.

📌 Autor: Equipe técnica da APIYI — Acompanhamos continuamente as mudanças de capacidade dos principais modelos como OpenAI, Google e Anthropic para oferecer uma experiência de gateway de API multimodal unificada para desenvolvedores. Para saber mais, visite apiyi.com.