作者注:深入解析 AI 漫剧批量制作的完整工作流程,详细介绍如何运用 Sora 2 Character Cameo 和 Veo 3.1 4K 输出实现高效漫剧生产。

AI 漫剧正在成为内容创作领域的新风口。如何利用 Sora 2 和 Veo 3.1 构建高效的漫剧批量制作工作流,是每个创作者都在探索的核心问题。

核心价值:读完本文,你将掌握完整的漫剧生产工作流,学会使用 Sora 2 Character Cameo 保持角色一致性,以及利用 Veo 3.1 输出 4K 竖屏视频的实战技巧。

漫剧批量制作的核心价值与市场机遇

AI 漫剧批量制作正在重新定义内容生产的效率边界。传统漫剧制作需要大量人工绘制和动画制作,而 Sora 2 和 Veo 3.1 的出现让单人团队也能实现工业级产出。

| 对比维度 | 传统漫剧制作 | AI 漫剧批量制作 | 效率提升 |

|---|---|---|---|

| 单集制作周期 | 7-14 天 | 2-4 小时 | 50-80 倍 |

| 角色一致性 | 依赖画师技术 | API 自动保持 | 100% 一致 |

| 场景生成 | 逐帧绘制 | 批量生成 | 20-50 倍 |

| 成本投入 | 万元级/集 | 百元级/集 | 降低 90% |

| 产能上限 | 月产 2-4 集 | 月产 50-100 集 | 25 倍 |

漫剧批量制作的三大核心优势

第一,角色一致性的技术突破。Sora 2 的 Character Cameo 功能允许创建可复用的角色 ID,确保同一角色在不同场景中保持完全一致的外观特征。这解决了传统 AI 视频生成中角色"变脸"的核心痛点。

第二,批量生产的流程标准化。通过 API 接口,创作者可以将剧本解析、提示词生成、视频生成、后期剪辑整合成一条自动化流水线。20-50 个场景的生成时间可以从数小时压缩到一小时以内。

第三,多平台适配的灵活性。Veo 3.1 原生支持竖屏视频生成,可以直接输出适合抖音、快手、小红书等短视频平台的 9:16 比例内容,无需二次裁剪。

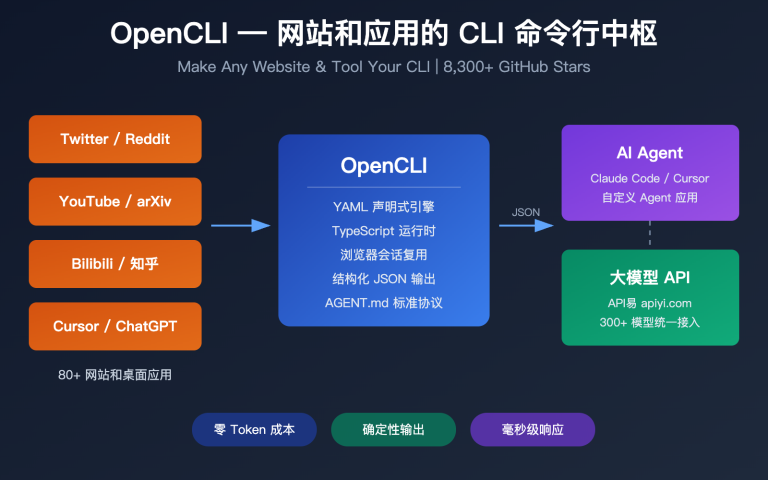

🎯 平台建议:漫剧批量制作需要稳定的 API 调用环境。推荐通过 API易 apiyi.com 获取 Sora 2 和其他主流视频模型的统一接口,支持批量任务提交和成本优化。

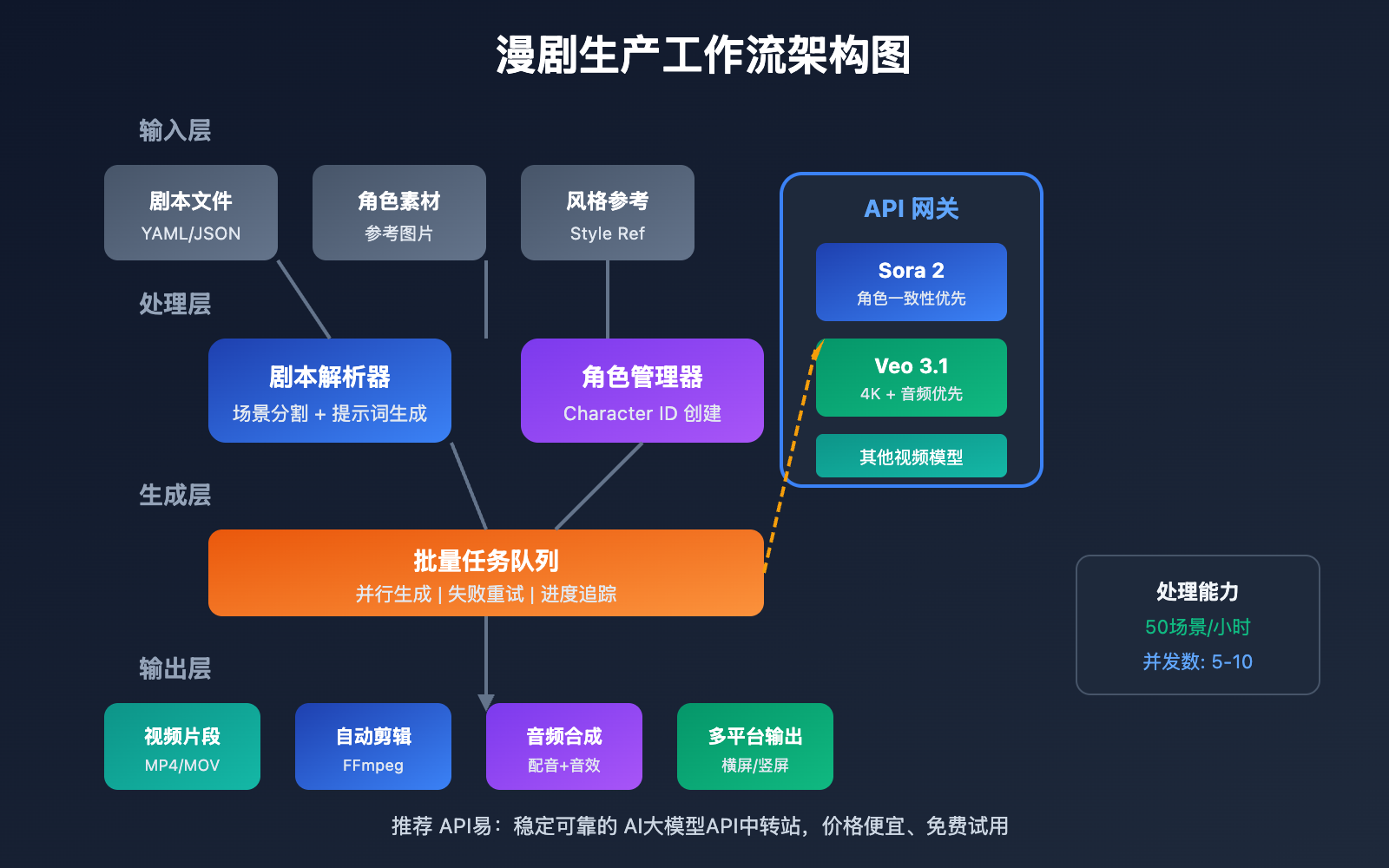

漫剧生产工作流全流程解析

完整的漫剧生产工作流可以分为五个核心阶段,每个阶段都有明确的输入输出和技术要点。

漫剧生产工作流第一阶段:剧本策划与分镜设计

漫剧生产工作流的起点是结构化剧本。与传统剧本不同,AI 漫剧剧本需要为每个镜头提供详细的视觉描述。

| 剧本要素 | 传统写法 | AI 漫剧工作流写法 | 作用说明 |

|---|---|---|---|

| 场景描述 | 咖啡厅内 | 现代简约咖啡厅,落地窗,午后阳光,暖色调 | 提供视觉生成依据 |

| 角色动作 | 小明喝咖啡 | 黑发男性,白衬衫,右手持咖啡杯,微笑看向窗外 | 确保动作可生成 |

| 镜头语言 | 近景 | 中近景,45度侧面,景深虚化背景 | 指导构图生成 |

| 时长标注 | 无 | 8秒 | API 参数设置 |

分镜脚本示例格式:

episode: 1

title: "初次相遇"

total_scenes: 12

characters:

- id: "char_001"

name: "小雨"

description: "20岁女性,黑色长发,白色连衣裙"

- id: "char_002"

name: "阿明"

description: "22岁男性,短发,休闲西装"

scenes:

- scene_id: 1

duration: 6

setting: "城市街道,傍晚,霓虹灯初亮"

characters: ["char_001"]

action: "小雨独自走在街道上,低头看手机"

camera: "跟随镜头,中景"

漫剧生产工作流第二阶段:角色资产创建

角色一致性是漫剧批量制作的核心挑战。Sora 2 和 Veo 3.1 分别提供了不同的解决方案。

Sora 2 角色创建方法:

- 准备角色参考图(正面、侧面、全身照)

- 通过 Character API 上传参考素材

- 获取可复用的 Character ID

- 在后续场景生成中引用该 ID

Veo 3.1 角色保持方法:

- 上传多张角色参考图

- 使用 style reference 功能锁定风格

- 在提示词中详细描述角色特征

- 通过连续生成保持一致性

技术提示:建议为主要角色创建 3-5 张不同角度的参考图,这样可以显著提高 AI 模型对角色特征的理解准确度。

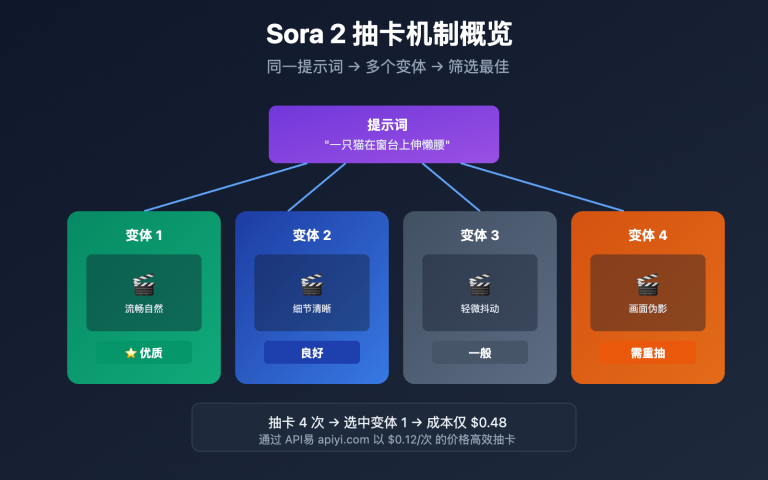

漫剧生产工作流第三阶段:批量视频生成

这是漫剧生产工作流中最核心的技术环节。通过 API 批量提交生成任务,可以大幅提升产能。

批量生成策略:

- 并行生成:同时提交多个场景的生成请求

- 优先级管理:关键场景优先生成,便于及时调整

- 失败重试:自动检测生成失败的任务并重新提交

- 结果校验:自动筛选符合质量标准的输出

漫剧生产工作流第四阶段:后期剪辑与音频

生成的视频片段需要进行剪辑整合和音频添加。

| 后期环节 | 推荐工具 | 耗时占比 | 自动化程度 |

|---|---|---|---|

| 视频拼接 | FFmpeg / Premiere | 15% | 可完全自动化 |

| 转场效果 | After Effects | 10% | 半自动化 |

| 配音配乐 | Eleven Labs / Suno | 25% | 可完全自动化 |

| 字幕添加 | Whisper + Aegisub | 15% | 可完全自动化 |

| 调色输出 | DaVinci Resolve | 20% | 半自动化 |

| 质检修正 | 人工审核 | 15% | 需人工介入 |

漫剧生产工作流第五阶段:多平台分发

根据不同平台的要求输出对应规格的视频文件。

- 抖音/快手:9:16 竖屏,1080×1920,60 秒以内

- B站/YouTube:16:9 横屏,1920×1080,无时长限制

- 小红书:3:4 或 9:16,侧重封面吸引力

- 微信视频号:支持多种比例,建议 9:16

🎯 效率建议:使用 API易 apiyi.com 的统一接口可以同时调用多个视频模型,根据不同场景选择最优模型,实现成本和效果的平衡。

Sora 2 在漫剧制作中的核心运用

Sora 2 是 OpenAI 推出的视频生成模型,其 Character Cameo 功能是漫剧批量制作的关键技术支撑。

Sora 2 Character Cameo 角色一致性技术

Character Cameo 允许创建可复用的角色身份,确保同一角色在不同场景中保持一致的外观。

创建角色 ID 的两种方式:

方式一:从现有视频提取

import requests

# 从视频 URL 提取角色特征

response = requests.post(

"https://vip.apiyi.com/v1/sora/characters/extract",

headers={"Authorization": "Bearer YOUR_API_KEY"},

json={

"video_url": "https://example.com/character_reference.mp4",

"character_name": "protagonist_male"

}

)

character_id = response.json()["character_id"]

方式二:从参考图片创建

# 从多角度参考图创建角色

response = requests.post(

"https://vip.apiyi.com/v1/sora/characters/create",

headers={"Authorization": "Bearer YOUR_API_KEY"},

json={

"images": [

"base64_front_view...",

"base64_side_view...",

"base64_full_body..."

],

"character_name": "protagonist_female",

"description": "20岁亚洲女性,黑色长发,温柔气质"

}

)

Sora 2 图生视频功能在漫剧制作中的应用

Sora 2 的图生视频(Image-to-Video)功能可以将静态漫画帧转化为动态视频,是漫剧生产工作流中的重要环节。

| 图生视频场景 | 输入要求 | 输出效果 | 适用情况 |

|---|---|---|---|

| 单图动态化 | 高清静态图 | 6-15 秒动态视频 | 封面、转场画面 |

| 表情动作 | 人物特写 | 添加眨眼、微笑等微表情 | 对话场景 |

| 场景延展 | 局部画面 | 镜头推拉、环境延展 | 建立镜头 |

| 风格转换 | 任意图片 | 转为动漫/写实风格 | 风格统一 |

Sora 2 漫剧生成的最佳实践

提示词结构化模板:

[主体描述] + [动作行为] + [场景环境] + [镜头语言] + [风格指定]

示例:

"一位黑发女孩(character_id: char_001)坐在咖啡厅窗边,

轻轻搅动咖啡杯,阳光从落地窗洒入,暖色调,

中近景,浅景深,日系动漫风格,柔和色彩"

生成参数建议:

- 时长:单镜头建议 6-10 秒,便于后期剪辑

- 分辨率:优先 1080p,平衡质量和成本

- 风格预设:使用 Comic 预设获得更稳定的漫画风格

🎯 API 调用建议:Sora 2 API 的批量调用推荐通过 API易 apiyi.com 进行,支持任务队列管理和自动重试,提高批量生成的成功率。

Veo 3.1 在漫剧制作中的核心运用

Veo 3.1 是 Google DeepMind 推出的最新视频生成模型,在漫剧批量制作领域具有独特优势。

Veo 3.1 4K 输出与画质优势

Veo 3.1 相比前代在画质和稳定性上有显著提升,特别适合需要高清输出的漫剧项目。

| Veo 版本 | 最高分辨率 | 音频支持 | 角色一致性 | 生成速度 |

|---|---|---|---|---|

| Veo 2 | 1080p | 无 | 一般 | 较快 |

| Veo 3 | 4K | 原生音频 | 良好 | 中等 |

| Veo 3.1 | 4K | 增强音频 | 优秀 | 30-60秒 |

Veo 3.1 的核心优势:

- 原生音频生成:可同时生成音效、环境音甚至角色对白

- 角色一致性增强:多参考图上传功能大幅提升一致性

- 竖屏原生支持:直接生成 9:16 比例视频,适配短视频平台

- 风格控制精准:通过 style reference 图片精确控制输出风格

Veo 3.1 竖屏视频生成在漫剧制作中的应用

短视频平台的漫剧内容需要竖屏格式,Veo 3.1 的原生竖屏支持避免了二次裁剪导致的画面损失。

竖屏生成方法:

# 通过上传竖屏参考图触发竖屏生成

response = requests.post(

"https://vip.apiyi.com/v1/veo/generate",

headers={"Authorization": "Bearer YOUR_API_KEY"},

json={

"prompt": "动漫风格,黑发少女在樱花树下,微风吹动头发,唯美氛围",

"reference_image": "vertical_reference_9_16.jpg",

"duration": 8,

"with_audio": True,

"audio_prompt": "轻柔的钢琴背景音乐,树叶沙沙声"

}

)

Veo 3.1 多参考图角色控制技术

Veo 3.1 支持上传多张参考图来指导角色、物体和场景的生成,这对漫剧批量制作的一致性至关重要。

多参考图使用策略:

- 角色图:3-5 张不同角度的角色定妆照

- 场景图:2-3 张场景风格参考

- 风格图:1-2 张整体画风参考

🎯 模型选择建议:需要高清画质和原生音频时选择 Veo 3.1,需要角色一致性保证时选择 Sora 2。API易 apiyi.com 支持两种模型的统一调用,便于灵活切换。

漫剧批量制作技术方案:API 自动化实战

将漫剧生产工作流自动化是提升产能的关键。以下是完整的技术实现方案。

漫剧批量制作自动化脚本架构

import asyncio

from typing import List, Dict

class MangaDramaProducer:

"""漫剧批量制作自动化框架"""

def __init__(self, api_key: str):

self.api_key = api_key

self.base_url = "https://vip.apiyi.com/v1"

async def batch_generate(

self,

scenes: List[Dict],

model: str = "sora-2"

) -> List[str]:

"""批量生成场景视频"""

tasks = []

for scene in scenes:

task = self.generate_scene(scene, model)

tasks.append(task)

results = await asyncio.gather(*tasks)

return results

async def generate_scene(

self,

scene: Dict,

model: str

) -> str:

"""单场景生成"""

# 构建提示词

prompt = self.build_prompt(scene)

# 调用 API

video_url = await self.call_api(prompt, model)

return video_url

查看完整自动化脚本代码

import asyncio

import aiohttp

from typing import List, Dict, Optional

from dataclasses import dataclass

import json

@dataclass

class Scene:

"""场景数据结构"""

scene_id: int

duration: int

setting: str

characters: List[str]

action: str

camera: str

dialogue: Optional[str] = None

@dataclass

class Character:

"""角色数据结构"""

char_id: str

name: str

description: str

reference_images: List[str]

class MangaDramaProducer:

"""漫剧批量制作完整框架"""

def __init__(self, api_key: str):

self.api_key = api_key

self.base_url = "https://vip.apiyi.com/v1"

self.characters: Dict[str, str] = {} # name -> character_id

async def create_character(

self,

character: Character

) -> str:

"""创建角色 ID"""

async with aiohttp.ClientSession() as session:

async with session.post(

f"{self.base_url}/sora/characters/create",

headers={"Authorization": f"Bearer {self.api_key}"},

json={

"images": character.reference_images,

"character_name": character.char_id,

"description": character.description

}

) as resp:

result = await resp.json()

char_id = result["character_id"]

self.characters[character.name] = char_id

return char_id

def build_prompt(self, scene: Scene) -> str:

"""构建场景提示词"""

char_refs = []

for char_name in scene.characters:

if char_name in self.characters:

char_refs.append(

f"(character_id: {self.characters[char_name]})"

)

prompt_parts = [

scene.action,

f"场景:{scene.setting}",

f"镜头:{scene.camera}",

"动漫风格,高质量,细节丰富"

]

if char_refs:

prompt_parts.insert(0, " ".join(char_refs))

return ",".join(prompt_parts)

async def generate_scene(

self,

scene: Scene,

model: str = "sora-2",

with_audio: bool = False

) -> Dict:

"""生成单个场景"""

prompt = self.build_prompt(scene)

async with aiohttp.ClientSession() as session:

endpoint = "sora" if "sora" in model else "veo"

async with session.post(

f"{self.base_url}/{endpoint}/generate",

headers={"Authorization": f"Bearer {self.api_key}"},

json={

"prompt": prompt,

"duration": scene.duration,

"with_audio": with_audio

}

) as resp:

result = await resp.json()

return {

"scene_id": scene.scene_id,

"video_url": result.get("video_url"),

"status": result.get("status")

}

async def batch_generate(

self,

scenes: List[Scene],

model: str = "sora-2",

max_concurrent: int = 5

) -> List[Dict]:

"""批量生成场景"""

semaphore = asyncio.Semaphore(max_concurrent)

async def limited_generate(scene):

async with semaphore:

return await self.generate_scene(scene, model)

tasks = [limited_generate(s) for s in scenes]

results = await asyncio.gather(*tasks, return_exceptions=True)

# 处理失败的任务

successful = []

failed = []

for i, result in enumerate(results):

if isinstance(result, Exception):

failed.append(scenes[i])

else:

successful.append(result)

# 重试失败的任务

if failed:

retry_results = await self.batch_generate(

failed, model, max_concurrent

)

successful.extend(retry_results)

return successful

# 使用示例

async def main():

producer = MangaDramaProducer("your_api_key")

# 创建角色

protagonist = Character(

char_id="char_001",

name="小雨",

description="20岁女性,黑色长发,温柔气质",

reference_images=["base64_img1", "base64_img2"]

)

await producer.create_character(protagonist)

# 定义场景

scenes = [

Scene(1, 8, "城市街道黄昏", ["小雨"], "独自走路看手机", "跟随中景"),

Scene(2, 6, "咖啡厅内部", ["小雨"], "坐在窗边喝咖啡", "固定中近景"),

Scene(3, 10, "公园长椅", ["小雨"], "望着夕阳发呆", "慢推特写")

]

# 批量生成

results = await producer.batch_generate(scenes, model="sora-2")

print(json.dumps(results, indent=2, ensure_ascii=False))

if __name__ == "__main__":

asyncio.run(main())

漫剧批量制作成本优化策略

| 优化方向 | 具体措施 | 预期节省 | 实施难度 |

|---|---|---|---|

| 模型选择 | 简单场景用低成本模型 | 30-50% | 低 |

| 分辨率控制 | 按需选择 720p/1080p/4K | 20-40% | 低 |

| 批量折扣 | 使用 API 聚合平台 | 10-20% | 低 |

| 缓存复用 | 相似场景复用生成结果 | 15-25% | 中 |

| 时长优化 | 精确控制每镜头时长 | 10-15% | 中 |

🎯 成本控制建议:API易 apiyi.com 提供多种视频模型的统一接口,支持按需选择不同档次的模型,配合批量任务折扣,可有效降低漫剧批量制作的整体成本。

Sora 2 vs Veo 3.1 漫剧制作对比分析

选择合适的视频生成模型是漫剧批量制作成功的关键。以下是两款主流模型的详细对比。

Sora 2 与 Veo 3.1 核心能力对比

| 对比维度 | Sora 2 | Veo 3.1 | 漫剧制作建议 |

|---|---|---|---|

| 最大时长 | 15-25 秒 | 8-15 秒 | Sora 2 适合长镜头 |

| 角色一致性 | Character Cameo 原生支持 | 多参考图方案 | Sora 2 更稳定 |

| 音频生成 | 需单独配音 | 原生音频支持 | Veo 3.1 效率更高 |

| 输出分辨率 | 1080p | 4K | Veo 3.1 画质更优 |

| 竖屏支持 | 需后期裁剪 | 原生支持 | Veo 3.1 更适配短视频 |

| 风格预设 | Comic/Anime 预设 | Style Reference | 各有优势 |

| 生成速度 | 中等 | 30-60秒/条 | Veo 3.1 略快 |

| API 稳定性 | 高 | 高 | 均可商用 |

漫剧制作场景选择指南

选择 Sora 2 的场景:

- 需要严格角色一致性的连续剧情

- 长镜头叙事场景(超过 10 秒)

- 复杂角色互动场景

- 已有成熟的配音工作流

选择 Veo 3.1 的场景:

- 追求 4K 高清画质输出

- 短视频平台内容(抖音、快手等)

- 需要原生音频的快速出片

- 竖屏内容为主的项目

混合使用策略:

对于大型漫剧项目,推荐根据场景特点混合使用两款模型:

- 核心角色场景 → Sora 2(保证一致性)

- 环境空镜头 → Veo 3.1(高画质+音效)

- 对话场景 → Veo 3.1(原生音频)

- 动作场景 → Sora 2(长时长支持)

🎯 模型切换建议:通过 API易 apiyi.com 的统一接口,可以在同一项目中灵活切换 Sora 2 和 Veo 3.1,无需修改代码结构,只需更改模型参数。

常见问题

Q1: Sora 2 和 Veo 3.1 哪个更适合漫剧批量制作?

两者各有优势。Sora 2 的 Character Cameo 功能在角色一致性方面表现更优,适合需要固定角色的连续剧情;Veo 3.1 的原生音频和 4K 输出则更适合追求画质和快速出片的短视频项目。建议根据具体需求混合使用。

Q2: 漫剧批量制作的成本大概是多少?

使用 AI 漫剧批量制作,单集(3-5 分钟)成本可控制在 50-200 元区间,主要取决于场景数量、分辨率选择和模型档次。相比传统制作降低 90% 以上。通过 API易 apiyi.com 等聚合平台还能获得额外的批量折扣。

Q3: 如何快速开始漫剧批量制作?

推荐以下快速启动步骤:

- 访问 API易 apiyi.com 注册账号并获取 API Key

- 准备 2-3 个主要角色的参考图片

- 编写结构化的分镜剧本(5-10 个场景起步)

- 使用本文提供的代码示例进行测试生成

- 根据效果调整提示词和参数

Q4: 漫剧生产工作流中如何保证角色一致性?

核心方法包括:使用 Sora 2 Character Cameo 创建角色 ID;为每个角色准备多角度参考图;在提示词中保持角色描述一致;使用固定的风格预设。建议在正式生产前先生成 3-5 个测试场景验证一致性。

总结

漫剧批量制作的核心要点:

- 工作流标准化:建立从剧本到分发的完整漫剧生产工作流,每个环节明确输入输出

- 模型选择策略:Sora 2 侧重角色一致性,Veo 3.1 侧重画质和音频,根据场景灵活切换

- 批量自动化:通过 API 批量提交任务,将 50 个场景的生成时间压缩到 1 小时内

- 成本优化:按需选择分辨率和模型档次,使用聚合平台获取批量折扣

AI 漫剧批量制作正在快速成熟,掌握 Sora 2 和 Veo 3.1 的核心能力,建立高效的漫剧生产工作流,是抓住这波内容红利的关键。

推荐通过 API易 apiyi.com 获取统一的视频模型 API 接口,平台支持 Sora 2、Veo 3.1 等主流模型,提供免费测试额度和技术支持。

参考资料

⚠️ 链接格式说明: 所有外链使用

资料名: domain.com格式,方便复制但不可点击跳转,避免 SEO 权重流失。

-

OpenAI Sora 官方文档: Sora 2 功能介绍和 API 使用指南

- 链接:

help.openai.com/en/articles/12593142-sora-release-notes - 说明: 官方 Character Cameo 功能详解

- 链接:

-

Google Veo 官方页面: Veo 3.1 模型介绍

- 链接:

deepmind.google/models/veo - 说明: 4K 输出和音频生成能力说明

- 链接:

-

AI Comic Factory: 开源漫画生成项目

- 链接:

github.com/jbilcke-hf/ai-comic-factory - 说明: LLM + SDXL 的漫画生成实现参考

- 链接:

-

Hugging Face AI Comic: 漫画生成技术博客

- 链接:

huggingface.co/blog/ai-comic-factory - 说明: 批量生成和 API 集成的技术细节

- 链接:

作者: 技术团队

技术交流: 欢迎在评论区讨论漫剧批量制作的实战经验,更多 AI 视频生成资料可访问 API易 apiyi.com 技术社区