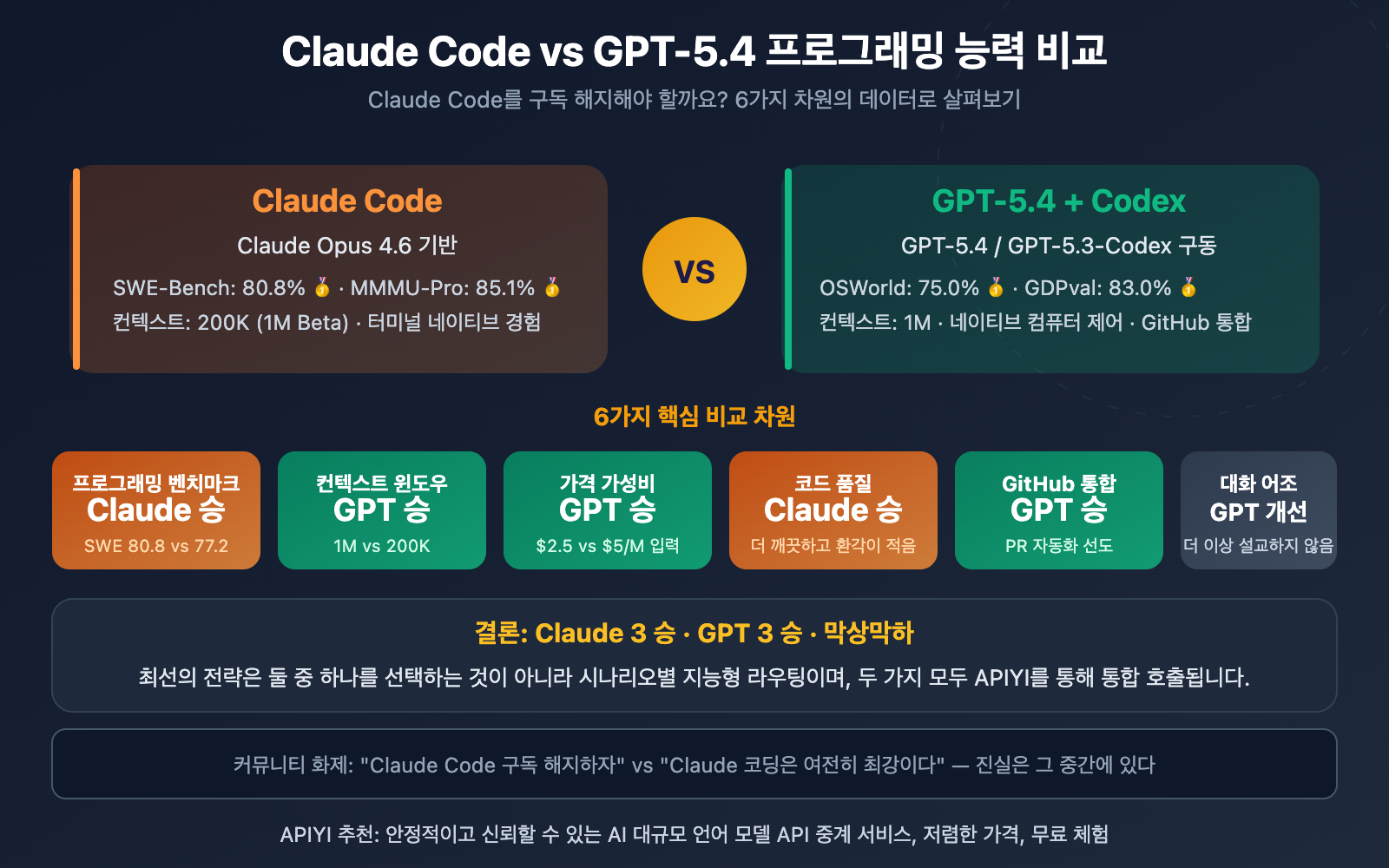

저자 주: Claude Code와 GPT-5.4의 프로그래밍 능력, 코드 품질, 컨텍스트 윈도우, 가격 및 개발자 경험을 중립적으로 비교하여, 도구를 교체해야 할지 판단을 도와드립니다.

GPT-5.4가 출시된 당일, 소셜 미디어에서는 "Claude Code 구독 취소하세요!"라는 목소리가 터져 나왔습니다. 1M 컨텍스트 윈도우, 모든 면에서 앞서는 성능, 그리고 고질적인 "기계적인 말투" 문제까지 해결되었다는 점이 그 이유였죠.

하지만 현실은 그렇게 간단하지 않습니다. 벤치마크 데이터에 따르면, Claude Opus 4.6은 SWE-Bench 프로그래밍 벤치마크에서 80.8%를 기록하며 GPT-5.4의 77.2%를 여전히 앞서고 있습니다. 개발자 커뮤니티의 실제 피드백 또한 의견이 분분합니다.

핵심 가치: 이 글에서는 6가지 차원에서 Claude Code와 GPT-5.4의 프로그래밍 능력을 객관적으로 비교하여, 여러분이 도구를 교체해야 할지, 아니면 두 도구를 병행하는 것이 더 현명한 선택일지 판단할 수 있도록 도와드립니다.

Claude Code vs GPT-5.4 핵심 데이터 비교

| 비교 항목 | Claude Code (Opus 4.6) | GPT-5.4 / Codex | 승자 |

|---|---|---|---|

| SWE-Bench 프로그래밍 | 80.8% | 77.2% | Claude |

| MMMU-Pro 시각적 추론 | 85.1% | 81.2% | Claude |

| GDPval 지식 업무 | 78.0% | 83.0% | GPT |

| OSWorld 컴퓨터 제어 | 72.7% | 75.0% | GPT |

| FrontierMath 수학 | 27.2% | 47.6% | GPT |

| Terminal-Bench 터미널 | 65.4% | 75.1% | GPT |

| 컨텍스트 윈도우 | 200K (1M Beta) | 1,000K | GPT |

| API 입력 가격 | $5.00/M | $2.50/M | GPT |

| API 출력 가격 | $25.00/M | $15.00/M | GPT |

| 코드 깔끔함 | 더 깔끔하고 표준적임 | 표준 수준 | Claude |

| 리팩토링 및 디버깅 | 앞섬 | 표준 수준 | Claude |

| GitHub PR 자동화 | 보통 | 깊은 통합 | GPT |

점수만 보면 Claude 4승, GPT 8승입니다. 하지만 성급하게 결론 내리지는 마세요. 실제 프로그래밍 환경에서는 SWE-Bench 점수, 코드 품질, 리팩토링 능력의 가중치가 지식 업무나 컴퓨터 제어 능력보다 훨씬 높기 때문입니다. 이제 하나씩 자세히 살펴보겠습니다.

Claude Code vs GPT-5.4 프로그래밍 능력 심층 분석

포인트 1: 프로그래밍 벤치마크 — Claude Code의 우세

가장 주목받는 프로그래밍 벤치마크인 SWE-Bench Verified(실제 GitHub 이슈 해결 능력) 결과를 살펴보겠습니다.

| 모델 | SWE-Bench Verified | SWE-Bench Pro |

|---|---|---|

| Claude Opus 4.6 | 80.8% 🥇 | — |

| Gemini 3.1 Pro | 80.6% | — |

| GPT-5.4 | 77.2% | 57.7% |

Claude Opus 4.6은 GPT-5.4를 3.6% 포인트 차이로 앞서고 있습니다. 여러 파일에 걸친 아키텍처 이해나 복잡한 의존성 추적 등 실제 운영 환경의 코드 수정 시나리오에서 Claude가 더 강력한 코드 구조 이해력을 보여주었습니다.

하지만 터미널 조작 집약적 작업을 측정하는 Terminal-Bench 2.0에서는 GPT-5.4가 75.1%를 기록하며 Claude(65.4%)를 크게 앞섰습니다. 만약 여러분의 워크플로우가 터미널 조작에 많이 의존한다면 GPT가 더 유리할 수 있습니다.

포인트 2: 코드 품질 및 개발 경험 — 더 깔끔한 Claude Code

여러 개발자 커뮤니티의 피드백은 공통된 결론을 가리키고 있습니다. 바로 Claude가 생성하는 코드가 더 깔끔하고, 패턴이 우수하며, 환각 현상이 적다는 점입니다.

구체적인 특징은 다음과 같습니다:

- 리팩토링 작업: 복잡한 리팩토링과 디버깅에서 Claude가 더 뛰어난 성능을 보입니다.

- 아키텍처 이해: 대규모 저장소와 계층형 아키텍처를 분석할 때 Claude의 추론 체인이 더 안정적이며 컨텍스트 유실이 적습니다.

- 생성 속도: Claude Code의 초기 생성 속도가 더 빠릅니다. (5분당 약 1,200행 vs Codex 10분당 약 200행)

반면 GPT-5.4는 문서 생성이나 템플릿 코드 작성처럼 프로젝트 아키텍처에 대한 깊은 이해가 필요 없는 작업에서 강점을 보입니다.

포인트 3: 컨텍스트 윈도우 — GPT-5.4의 압도적 승리

이 부분은 GPT-5.4의 가장 강력한 구조적 강점입니다.

| 능력 | Claude Code | GPT-5.4 |

|---|---|---|

| 표준 컨텍스트 | 200K | 1,000K |

| 베타 컨텍스트 | 1M | — |

| 최대 출력 | 32K | 128K |

1M 토큰은 실제 운영 중인 대규모 코드베이스 전체를 한 번에 입력할 수 있는 수준입니다. 다만 주의할 점은 272K 토큰을 초과하는 요청의 경우 입력 비용은 2배, 출력 비용은 1.5배로 할증된다는 것입니다. 실제 사용 시 대부분의 프로그래밍 작업은 200K 컨텍스트 내에서 충분히 해결 가능합니다.

🎯 실질적인 조언: 컨텍스트 윈도우는 GPT-5.4의 핵심 무기이지만, 초거대 코드베이스를 다룰 때만 진가를 발휘합니다. 중소규모 프로젝트에서는 더 나은 아키텍처 이해력을 가진 Claude의 200K 컨텍스트가 더 나은 선택일 수 있습니다. 두 모델 모두 APIYI(apiyi.com)를 통해 통합하여 호출할 수 있습니다.

Claude Code vs GPT-5.4 가격 및 생태계 비교

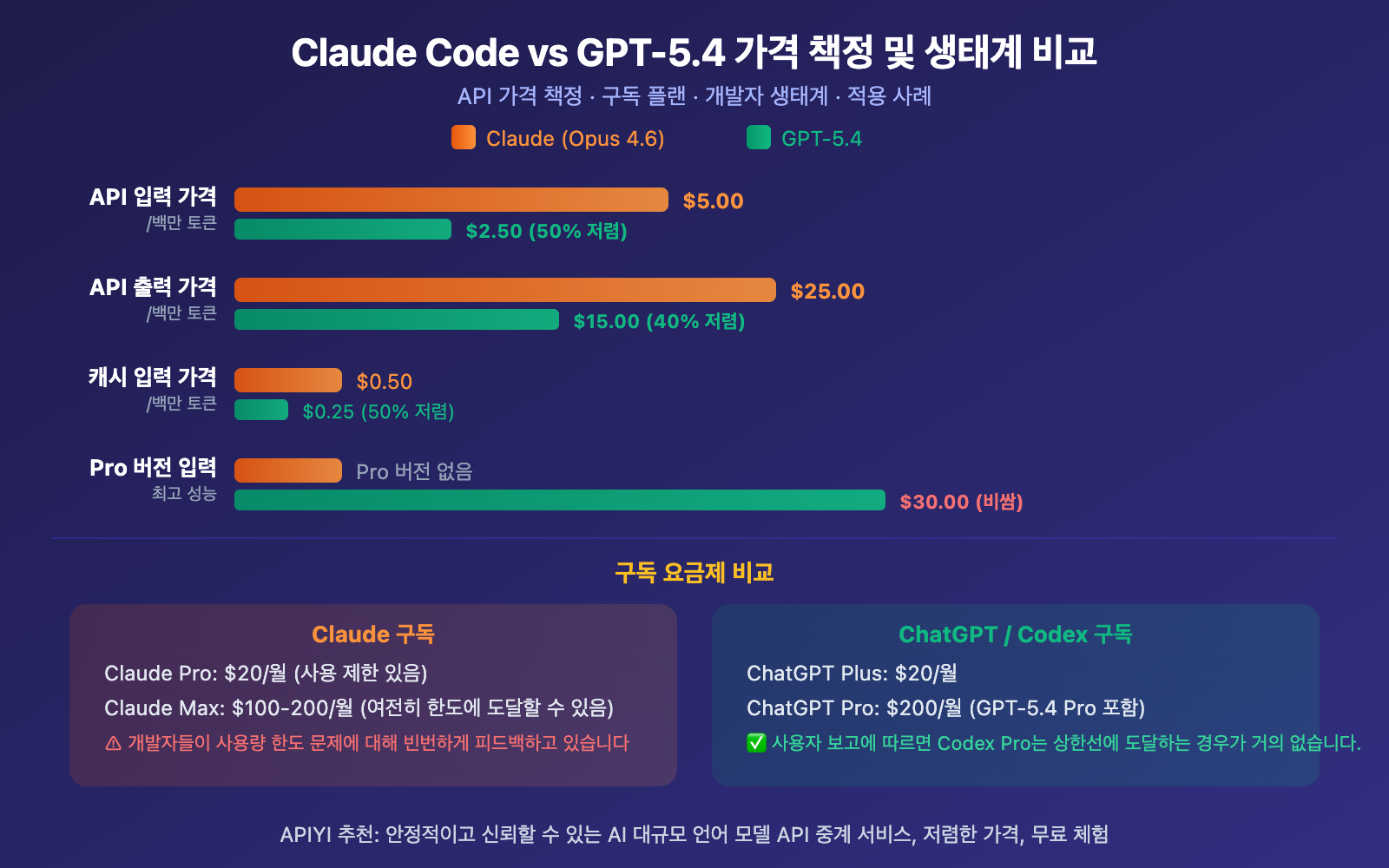

포인트 4: 가격 — GPT-5.4의 더 높은 가성비

GPT-5.4는 API 가격 정책 면에서 Claude Opus 4.6보다 전반적으로 저렴합니다.

- 입력: $2.50 vs $5.00/M (50% 저렴)

- 출력: $15.00 vs $25.00/M (40% 저렴)

- 캐시 입력: $0.25 vs $0.50/M (50% 저렴)

구독 서비스 측면에서도 Claude의 사용 제한이 더 엄격하다는 것이 개발자들의 공통된 의견입니다. 월 $20인 Codex 플랜은 월 $17인 Claude Pro 플랜보다 사용 한도가 훨씬 넉넉합니다. 많은 개발자가 Codex Pro는 상한선에 거의 도달하지 않는 반면, Claude는 더 비싼 플랜에서도 잦은 속도 제한(Rate Limit)을 겪는다고 보고하고 있습니다.

포인트 5: GitHub 통합 — GPT Codex의 명확한 리드

이 부분은 간과하기 쉽지만 개발자 워크플로우에 큰 영향을 미치는 차이점입니다.

개발자들의 피드백에 따르면, Claude Code의 GitHub PR 리뷰는 "장황한 코멘트를 남기지만 명백한 버그를 놓치는 경우"가 있는 반면, Codex는 인라인 주석과 즉시 실행 가능한 수정 워크플로우를 포함해 "찾아내기 어려운 버그를 정확히 탐지"하는 능력을 보여줍니다. 또한 Codex의 GitHub 앱은 CLI와 웹 인터페이스 간의 일관된 동작을 보장합니다.

포인트 6: 대화 톤 — GPT-5.x의 '기계적인 말투' 문제 개선

소셜 미디어에서 자주 언급되는 세 번째 쟁점입니다. GPT-5 시리즈는 '로봇 같은 말투'에서 벗어나 점진적으로 개선되는 과정을 거쳤습니다.

- GPT-5.0: "냉담한 로봇 같다"는 비판을 받음

- GPT-5.1: 대화의 온기와 상호작용성 강화

- GPT-5.3 Instant: "덜 오글거리는(less cringe)" 말투를 주력으로 내세우며 환각 현상 26.8% 감소

- GPT-5.4: 5.3의 개선된 말투를 계승하면서 전문적인 능력 강화

하지만 객관적으로 볼 때, 자연스러운 대화와 코드 설명의 가독성 측면에서는 여전히 Claude가 우위에 있다는 평가가 지배적입니다. GPT-5.4가 많이 개선되었지만 아직은 격차가 존재합니다.

🎯 비용 최적화 팁: 어떤 모델을 선택하든 APIYI(apiyi.com)를 통해 통합하여 사용하면 더 유연한 요금제를 누릴 수 있습니다. GPT-5.4 가격은 공식 홈페이지와 동일하게 적용되며($2.50/$15.00), 100달러 이상 충전 시 10% 추가 증정 혜택도 제공됩니다.

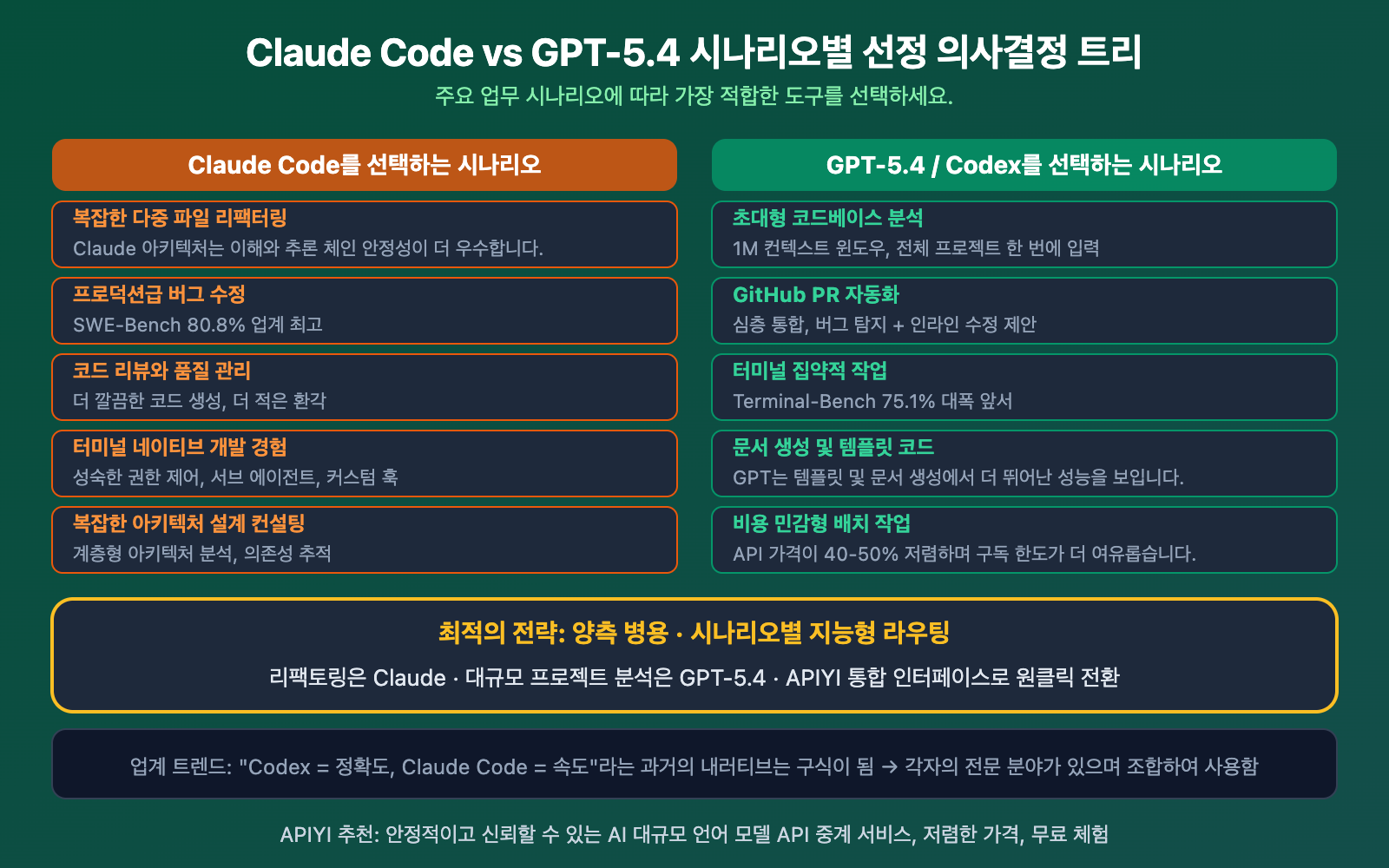

Claude Code vs GPT-5.4 시나리오별 선택 가이드

Claude Code vs GPT-5.4 API 호출 예시

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# 복잡한 리팩토링 → Claude Opus 4.6 사용 (코드 품질 우수)

refactor_result = client.chat.completions.create(

model="claude-opus-4-6",

messages=[{"role": "user", "content": "이 모듈의 의존성 주입 아키텍처를 리팩토링해줘"}]

)

# 초대형 코드베이스 분석 → GPT-5.4 사용 (1M 컨텍스트)

analysis_result = client.chat.completions.create(

model="gpt-5.4",

messages=[{"role": "user", "content": "전체 프로젝트의 보안 취약점을 분석해줘"}]

)

권장 사항: APIYI(apiyi.com)에서 계정을 하나만 생성하면 Claude와 GPT-5.4를 동시에 호출할 수 있습니다. GPT-5.4 가격은 공식 홈페이지와 동일하며, 100달러 이상 충전 시 10% 추가 혜택을 제공합니다. 시나리오에 맞춰 모델을 전환하려면 파라미터 하나만 수정하면 됩니다.

자주 묻는 질문

Q1: Claude Code 구독을 해지해야 할까요?

주요 작업 환경에 따라 다릅니다. 핵심 요구 사항이 복잡한 코드 리팩토링과 프로덕션급 버그 수정이라면 Claude가 여전히 최선의 선택입니다(SWE-Bench 80.8%로 선두). 만약 초장문 컨텍스트, GitHub 통합 및 더 낮은 비용이 필요하다면 GPT-5.4 / Codex가 더 유리합니다. 가장 좋은 전략은 하나를 선택하는 것이 아니라, API를 통해 시나리오별로 두 모델을 모두 활용하는 것입니다.

Q2: GPT-5.4의 코딩 능력이 정말 모든 면에서 앞서나요?

아닙니다. GPT-5.4는 GDPval(지식 작업), OSWorld(컴퓨터 제어), FrontierMath(수학) 등에서는 앞서지만, 가장 핵심적인 코딩 벤치마크인 SWE-Bench에서는 Claude Opus 4.6이 80.8% 대 77.2%로 우위를 점하고 있습니다. 코드 품질, 리팩토링 능력, 아키텍처 이해도 측면에서 개발자 커뮤니티는 여전히 Claude를 선호하는 경향이 있습니다. 두 모델 모두 APIYI(apiyi.com)를 통해 통합 호출하여 비교해 볼 수 있습니다.

Q3: Claude와 GPT-5.4를 동시에 사용하는 방법은 무엇인가요?

APIYI(apiyi.com)에서 계정을 등록하면 됩니다:

- 통합 API 키 발급

base_url을https://vip.apiyi.com/v1로 설정- 리팩토링 작업에는

model="claude-opus-4-6"사용 - 대규모 프로젝트 분석에는

model="gpt-5.4"사용 - 일상적인 작업에는

model="gpt-5.3-chat-latest"사용(가장 경제적)

100달러 이상 충전 시 10% 추가 혜택이 있으며, 계정 하나로 모든 주요 모델을 이용할 수 있습니다.

요약

Claude Code vs GPT-5.4의 핵심 결론입니다:

- 코딩 벤치마크는 여전히 Claude가 우세: SWE-Bench 80.8% vs 77.2%로, 코드 품질이 더 깔끔하고 리팩토링 및 디버깅 능력이 강력합니다. 따라서 "Claude Code 구독 해지"라는 말은 다소 성급한 판단일 수 있습니다.

- GPT-5.4는 컨텍스트와 가성비에서 압도적: 1M 토큰 컨텍스트(Claude의 5배), API 가격 40~50% 저렴, 더 깊은 GitHub 통합을 제공합니다. 대규모 프로젝트와 비용에 민감한 상황에 적합합니다.

- 최적의 전략은 둘 다 병행하는 것: 리팩토링과 버그 수정은 Claude를, 대규모 코드베이스 분석과 터미널 작업은 GPT-5.4를, 일상적인 작업은 GPT-5.3 Instant를 사용하여 비용을 절약하세요.

"Claude Code 구독 해지"와 같은 자극적인 제목에 휘둘리지 마세요. 진짜 현명한 개발자는 특정 브랜드에만 충성하기보다 상황에 따라 가장 적합한 도구를 선택합니다.

APIYI(apiyi.com)를 통해 Claude와 GPT-5.4를 통합하여 사용해 보시는 것을 추천합니다. 하나의 API 키로 모든 모델을 호출할 수 있으며, 100달러 이상 충전 시 10% 추가 증정 혜택도 드립니다.

📚 참고 자료

-

Claude Code vs Codex 심층 비교: Builder.io 팀의 개발자 관점 상세 비교

- 링크:

builder.io/blog/codex-vs-claude-code - 설명: 가격, 코드 품질, GitHub 통합 등 실무적인 비교 내용을 담고 있습니다.

- 링크:

-

Claude를 겨냥한 GPT-5.4의 경쟁 분석: GPT-5.4의 시장 포지셔닝 분석

- 링크:

trendingtopics.eu/gpt-5-4-targets-anthropics-claude-with-premium-pricing-and-coding-muscle/ - 설명: GPT-5.4 Pro의 고가 정책과 코딩 분야의 야심을 심층 분석합니다.

- 링크:

-

GPT-5.4 vs Opus 4.6 vs Gemini 3.1 Pro 전방위 비교: 12개 벤치마크 데이터

- 링크:

digitalapplied.com/blog/gpt-5-4-vs-opus-4-6-vs-gemini-3-1-pro-best-frontier-model - 설명: 가장 포괄적인 3대 모델 비교로, 경쟁력 분석과 모델 선택 가이드를 제공합니다.

- 링크:

-

Claude Sonnet 4.6 vs GPT-5 개발자 벤치마크: SitePoint의 실제 개발 시나리오 테스트

- 링크:

sitepoint.com/claude-sonnet-4-6-vs-gpt-5-the-2026-developer-benchmark/ - 설명: 리팩토링, 디버깅, 문서 생성 등 구체적인 작업에 대한 비교 데이터를 제공합니다.

- 링크:

작성자: APIYI 기술 팀

기술 교류: 댓글을 통해 자유롭게 의견을 남겨주세요. 더 많은 자료는 APIYI docs.apiyi.com 문서 센터에서 확인하실 수 있습니다.