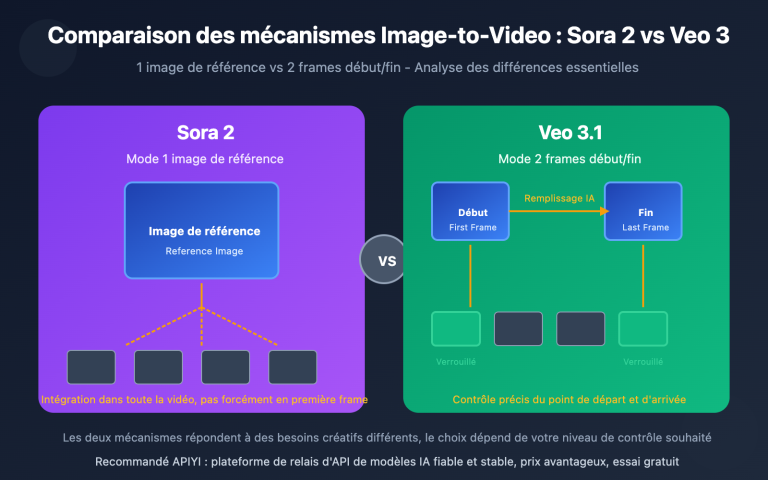

Note de l'auteur : Tutoriel complet : utilisez l'API de compréhension vidéo de Gemini pour faire l'ingénierie inverse des invites de vidéos virales, puis utilisez Sora 2 pour générer de nouvelles vidéos similaires. Un workflow complet pour la duplication de vidéos e-commerce.

Voir une vidéo virale d'un concurrent sans savoir comment la reproduire est un point de douleur courant pour les opérateurs e-commerce. Cet article présente le workflow complet Compréhension vidéo + Génération vidéo par IA, pour vous aider à maîtriser rapidement les techniques pratiques de duplication de vidéos à succès.

Valeur ajoutée : En lisant cet article, vous apprendrez à utiliser la compréhension vidéo de Gemini pour extraire l'invite de n'importe quelle vidéo et utiliser Sora 2 pour générer une nouvelle vidéo de style identique.

Points clés de la duplication par compréhension vidéo

| Point clé | Explication | Valeur |

|---|---|---|

| Ingénierie inverse | Utilise l'IA pour analyser l'image, les mouvements, le style et le rythme | Extrait avec précision les éléments clés d'une vidéo virale |

| Génération d'invites | Génère automatiquement des invites structurées pour la création vidéo | Élimine les suppositions manuelles et les tests fastidieux |

| Duplication en un clic | Envoie l'invite directement à Sora 2 pour générer une variante | Produit rapidement de nouvelles vidéos de style identique |

| API tout-en-un | Appels unifiés Gemini + Sora 2 sur une seule plateforme | Simplifie le workflow et réduit les coûts d'intégration |

Détails sur la duplication par compréhension vidéo

La compréhension vidéo (Video Understanding) est l'une des capacités phares de l'IA multimodale. Les modèles de la série Gemini peuvent traiter simultanément le flux audio et les images d'une vidéo, en extrayant des informations à un taux d'échantillonnage de 1 image par seconde, tout en analysant le contenu de la piste sonore. Cela signifie que l'IA ne se contente pas de "voir" ce qu'il y a dans la vidéo, elle comprend aussi le langage cinématographique, le style d'éclairage et le rythme du montage.

L'ingénierie d'invite inverse (Reverse Prompt Engineering) est la technologie clé pour appliquer cette compréhension à la création de contenu. Grâce à des invites d'analyse soigneusement conçues, l'IA peut extraire d'une vidéo : la composition des plans, les mouvements de caméra, le style d'éclairage, la tonalité des couleurs, les actions du sujet et les caractéristiques de la musique de fond, pour réorganiser le tout en une invite prête pour Sora 2.

Workflow complet : Répliquer des vidéos virales grâce à l'IA

Étape 1 : Télécharger la vidéo virale

Plusieurs méthodes d'importation sont disponibles pour vos vidéos :

| Méthode d'entrée | Cas d'utilisation | Limitations |

|---|---|---|

| Import local | Fichiers vidéo déjà téléchargés | Transfert inline pour fichiers < 100 Mo |

| API File | Fichiers volumineux ou vidéos longues | Supporte > 100 Mo, réutilisable |

| URL YouTube | Analyse directe de vidéos en ligne | Support natif par Gemini |

Étape 2 : Analyse de la vidéo par l'IA

Utilisez le modèle de compréhension vidéo de Gemini pour décortiquer le contenu et extraire les éléments créatifs clés :

import requests

import base64

# Configuration de l'API

api_key = "VOTRE_CLÉ_API"

base_url = "https://vip.apiyi.com/v1"

# Lecture du fichier vidéo

with open("/chemin/absolu/vers/viral_video.mp4", "rb") as f:

video_base64 = base64.b64encode(f.read()).decode()

# Analyse de la vidéo

response = requests.post(

f"{base_url}/chat/completions",

headers={"Authorization": f"Bearer {api_key}"},

json={

"model": "gemini-2.5-pro-preview",

"messages": [{

"role": "user",

"content": [

{"type": "video", "video": video_base64},

{"type": "text", "text": """Analysez cette vidéo et extrayez les éléments de création suivants :

1. Composition du plan et format de l'image

2. Mouvements de caméra (zoom, panoramique, travelling, fixe, etc.)

3. Style d'éclairage et colorimétrie

4. Action du sujet et rythme

5. Description de l'arrière-plan et de l'environnement

6. Mots-clés du style visuel global

Veuillez organiser les résultats dans un format d'invite en anglais prêt à l'emploi pour Sora 2."""}

]

}]

}

)

print(response.json()["choices"][0]["message"]["content"])

Étape 3 : Génération d'une invite structurée

Voici un exemple de résultat d'analyse renvoyé par le modèle :

Camera: Slow push-in, centered composition, shallow depth of field

Lighting: Soft diffused studio lighting, warm color temperature (3200K)

Subject: Premium leather handbag rotating on white marble pedestal

Movement: 360-degree rotation over 8 seconds, smooth and elegant

Style: Luxury commercial aesthetic, minimalist background

Color: Warm tones, high contrast, subtle vignette

Sora 2 Prompt:

"A premium leather handbag slowly rotating 360 degrees on a white marble

pedestal, soft diffused studio lighting with warm color temperature,

shallow depth of field, luxury commercial aesthetic, centered composition,

smooth cinematic movement, minimalist white background, high-end product

showcase style"

Étape 4 : Génération de la vidéo avec Sora 2

Injectez l'invite extraite dans Sora 2 pour générer votre nouvelle vidéo :

# Génération de la nouvelle vidéo à partir de l'invite extraite

sora_response = requests.post(

f"{base_url}/videos/generations",

headers={"Authorization": f"Bearer {api_key}"},

json={

"model": "sora-2",

"prompt": extracted_prompt, # L'invite extraite à l'étape précédente

"aspect_ratio": "9:16",

"duration": 10

}

)

print(sora_response.json())

Conseil : Via APIYI (apiyi.com), vous pouvez appeler simultanément les API de compréhension vidéo de Gemini et de génération vidéo de Sora 2. Centralisez tout votre workflow sans avoir à jongler entre plusieurs plateformes.

Prise en main rapide : Réplication de vidéos virales

Exemple minimaliste

Voici le code complet pour répliquer une vidéo virale en un clic :

import requests

import base64

api_key = "VOTRE_CLÉ_API"

base_url = "https://vip.apiyi.com/v1"

def clone_viral_video(video_path: str) -> dict:

"""Répliquer une vidéo virale en un clic"""

# 1. Lecture de la vidéo

with open(video_path, "rb") as f:

video_b64 = base64.b64encode(f.read()).decode()

# 2. Analyse vidéo avec Gemini

analysis = requests.post(

f"{base_url}/chat/completions",

headers={"Authorization": f"Bearer {api_key}"},

json={

"model": "gemini-2.5-pro-preview",

"messages": [{"role": "user", "content": [

{"type": "video", "video": video_b64},

{"type": "text", "text": "Analyze and generate Sora 2 prompt"}

]}]

}

).json()

prompt = analysis["choices"][0]["message"]["content"]

# 3. Génération de la nouvelle vidéo avec Sora 2

result = requests.post(

f"{base_url}/videos/generations",

headers={"Authorization": f"Bearer {api_key}"},

json={"model": "sora-2", "prompt": prompt}

).json()

return {"prompt": prompt, "video": result}

# Utilisation

result = clone_viral_video("/chemin/absolu/vers/video_concurrent.mp4")

Voir le code d’implémentation complet (incluant le traitement par lot et la gestion des erreurs)

import requests

import base64

import time

from typing import Optional, List

from pathlib import Path

class ViralVideoCloner:

"""Classe utilitaire pour la réplication de vidéos virales"""

def __init__(self, api_key: str):

self.api_key = api_key

self.base_url = "https://vip.apiyi.com/v1"

self.headers = {"Authorization": f"Bearer {api_key}"}

def analyze_video(self, video_path: str) -> str:

"""Utilise Gemini pour analyser la vidéo et extraire l'invite"""

with open(video_path, "rb") as f:

video_b64 = base64.b64encode(f.read()).decode()

analysis_prompt = """Analyze this video and extract creative elements:

1. Camera movement and composition

2. Lighting style and color grading

3. Subject action and pacing

4. Background and environment

5. Overall visual style

Generate a detailed Sora 2 prompt in English that can recreate

a similar video with different products."""

response = requests.post(

f"{self.base_url}/chat/completions",

headers=self.headers,

json={

"model": "gemini-2.5-pro-preview",

"messages": [{

"role": "user",

"content": [

{"type": "video", "video": video_b64},

{"type": "text", "text": analysis_prompt}

]

}]

}

)

return response.json()["choices"][0]["message"]["content"]

def generate_video(

self,

prompt: str,

aspect_ratio: str = "9:16",

duration: int = 10

) -> dict:

"""Génère une nouvelle vidéo via Sora 2"""

response = requests.post(

f"{self.base_url}/videos/generations",

headers=self.headers,

json={

"model": "sora-2",

"prompt": prompt,

"aspect_ratio": aspect_ratio,

"duration": duration

}

)

return response.json()

def clone(

self,

video_path: str,

custom_subject: Optional[str] = None

) -> dict:

"""Processus complet de réplication"""

# Analyse de la vidéo originale

base_prompt = self.analyze_video(video_path)

# Si un sujet personnalisé est spécifié, on remplace la description du sujet dans l'invite

if custom_subject:

base_prompt = self._replace_subject(base_prompt, custom_subject)

# Génération de la nouvelle vidéo

result = self.generate_video(base_prompt)

return {

"original_video": video_path,

"extracted_prompt": base_prompt,

"generated_video": result

}

def batch_clone(self, video_paths: List[str]) -> List[dict]:

"""Réplication par lot de plusieurs vidéos"""

results = []

for path in video_paths:

result = self.clone(path)

results.append(result)

time.sleep(2) # Pause pour éviter de dépasser les limites de taux (rate limiting)

return results

def _replace_subject(self, prompt: str, new_subject: str) -> str:

"""Remplace le sujet dans l'invite"""

# Approche simplifiée, une méthode NLP plus complexe peut être utilisée en production

return f"{new_subject}, {prompt}"

# Exemple d'utilisation

cloner = ViralVideoCloner("VOTRE_CLÉ_API")

result = cloner.clone(

"/chemin/absolu/vers/best_seller_concurrent.mp4",

custom_subject="my product: wireless earbuds in charging case"

)

print(result["extracted_prompt"])

Conseil : Obtenez vos quotas pour Gemini et Sora 2 sur APIYI (apiyi.com). La plateforme unifie la gestion de vos appels multi-modèles pour simplifier votre développement.

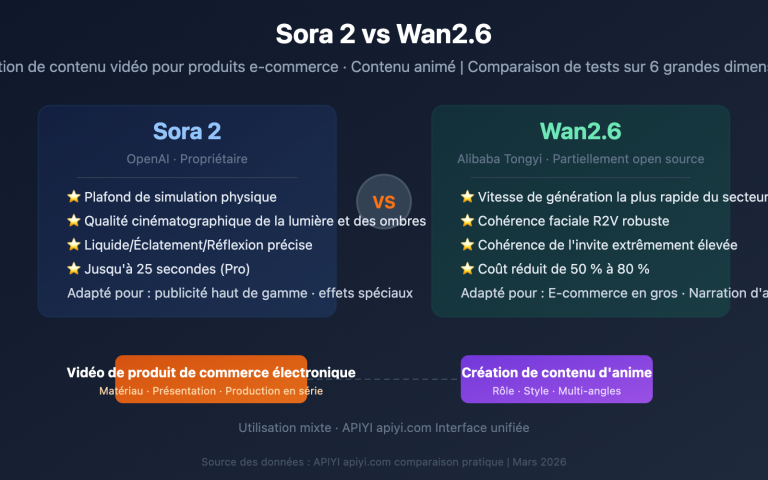

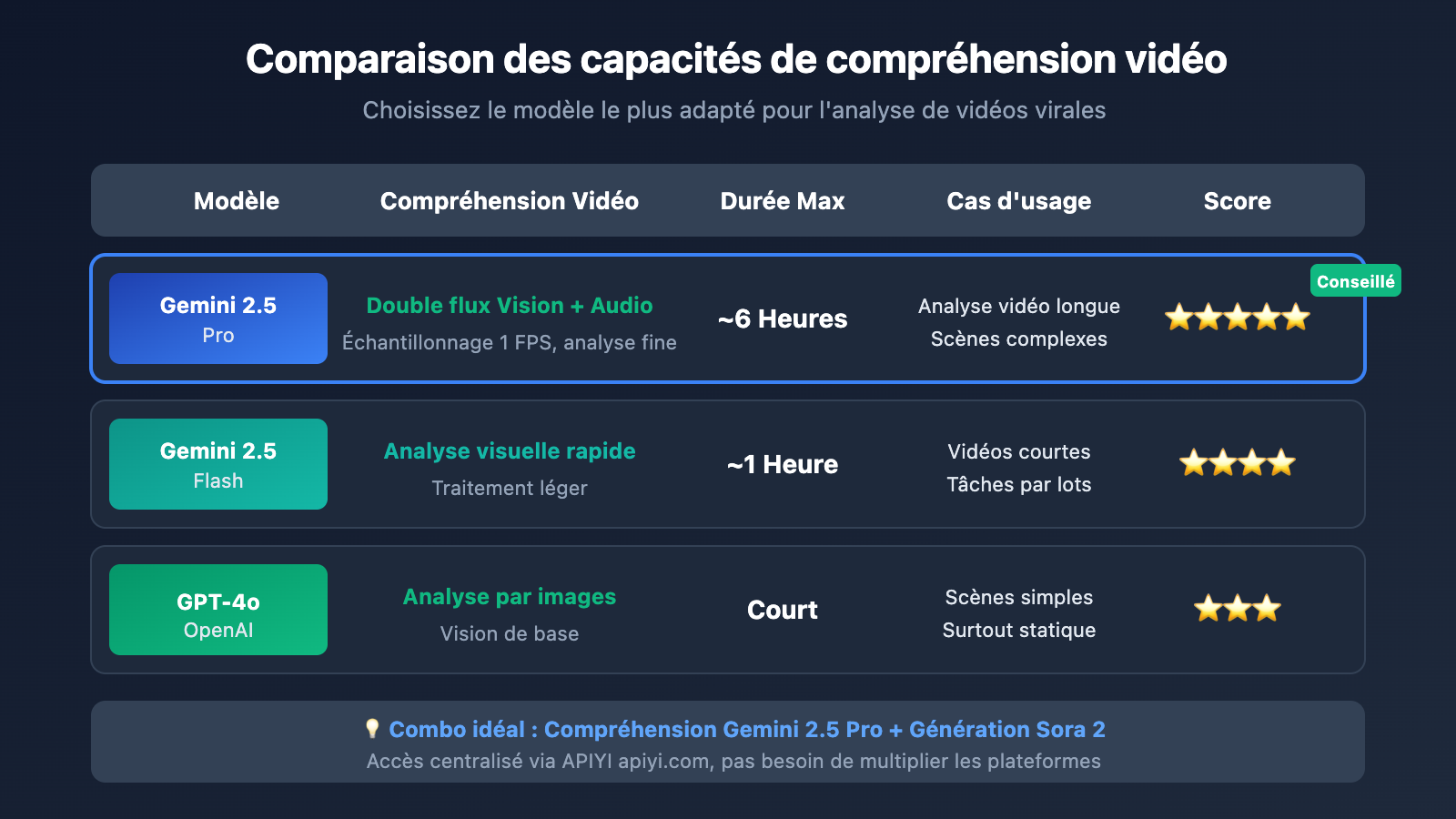

Comparaison des modèles pour la réplication de vidéos virales

| Modèle | Compréhension Vidéo | Durée Maximale | Cas d'usage | Plateformes |

|---|---|---|---|---|

| Gemini 2.5 Pro | Analyse double flux Vision + Audio | ~ 6 heures | Analyse approfondie de vidéos longues | APIYI et autres |

| Gemini 2.5 Flash | Analyse visuelle rapide | ~ 1 heure | Traitement rapide de vidéos courtes | APIYI et autres |

| GPT-4o | Analyse par trames visuelles | Court | Compréhension de scènes simples | APIYI et autres |

Pourquoi recommander Gemini pour la compréhension vidéo ?

La série Gemini 2.5 atteint des performances de pointe dans les tests de référence de compréhension vidéo :

- Traitement à double flux : Analyse simultanément les images et la piste audio pour une compréhension globale.

- Contexte ultra-large : Le contexte de 2 millions de tokens permet de traiter des vidéos allant jusqu'à 6 heures.

- Contrôle granulaire : Permet de personnaliser le taux d'échantillonnage et les paramètres de résolution.

- Horodatage précis : Capable de citer des moments spécifiques de la vidéo au format MM:SS.

Conseil d'expert : Nous vous recommandons d'utiliser Gemini 2.5 Pro pour vos analyses vidéo. Vous pouvez l'appeler très facilement via APIYI (apiyi.com).

Réplication de vidéos virales : Cas d'application

Idéal pour les scénarios e-commerce suivants :

- Analyse de la concurrence : Décortiquez les vidéos virales de vos concurrents pour en extraire les clés du succès.

- Transfert de style : Appliquez le style d'une vidéo tendance à vos propres produits.

- Production de masse : Générez rapidement plusieurs vidéos produits à partir d'un même modèle de style.

- Tests A/B : Créez plusieurs variantes de styles pour optimiser vos campagnes publicitaires.

| Scénario | Entrée | Sortie | Gain d'efficacité |

|---|---|---|---|

| Réplication concurrente | Vidéo virale concurrente | Vidéo de votre produit (même style) | 10x |

| Transfert de style | Vidéo au style populaire | Vidéo stylisée de votre produit | 8x |

| Production par modèle | 1 vidéo modèle | N vidéos produits | 20x |

FAQ

Q1 : Quels formats et quelles durées sont pris en charge pour la compréhension vidéo ?

Gemini prend en charge les formats vidéo courants (MP4, MOV, AVI, etc.). Les fichiers de moins de 100 Mo peuvent être transmis directement en ligne (inline), tandis que les fichiers plus volumineux doivent être téléchargés via l'API File. La fenêtre contextuelle de 2 millions de tokens de Gemini 2.5 Pro permet théoriquement d'analyser environ 6 heures de vidéo.

Q2 : Les invites extraites doivent-elles être ajustées manuellement ?

Les invites générées par l'IA peuvent généralement être utilisées telles quelles, mais il est conseillé de les affiner selon vos besoins réels :

- Remplacez la description du sujet par votre propre produit

- Ajustez les paramètres de durée et de format (aspect ratio)

- Ajoutez des mots-clés de style spécifiques à votre image de marque

Q3 : Comment commencer rapidement à tester la compréhension et la reproduction vidéo ?

Il est recommandé d'utiliser une plateforme d'agrégation d'API multi-modèles pour vos tests :

- Rendez-vous sur APIYI (apiyi.com) pour créer un compte

- Obtenez votre clé API et vos crédits gratuits

- Utilisez les exemples de code de cet article pour une vérification rapide

- Réalisez tout le processus en un seul endroit : compréhension vidéo Gemini + génération Sora 2

Conclusion

Voici les points clés pour reproduire des vidéos virales grâce à la compréhension vidéo :

- La compréhension vidéo est le pilier : Les capacités multimodales de Gemini permettent d'extraire avec précision les éléments créatifs d'une vidéo.

- Automatisation de l'ingénierie des invites : L'IA convertit automatiquement l'analyse visuelle en invites de génération exploitables.

- Flux de travail tout-en-un : L'utilisation d'API unifiées pour Gemini + Sora 2 simplifie grandement le processus de développement.

En maîtrisant ce flux de travail, les professionnels de l'e-commerce peuvent reproduire rapidement les styles de vidéos qui cartonnent dans leur secteur, réduisant ainsi considérablement les coûts liés aux essais et erreurs de création vidéo.

Nous vous recommandons de tester rapidement ces résultats via APIYI (apiyi.com). La plateforme propose à la fois l'API de compréhension vidéo Gemini et l'API de génération vidéo Sora 2, vous permettant de boucler tout le processus de reproduction sur une seule interface.

📚 Ressources et Références

⚠️ Format des liens : Tous les liens externes utilisent le format

Nom de la ressource : domain.com. Ce format facilite le copier-coller tout en évitant les clics directs pour préserver le référencement SEO.

-

Documentation officielle de Gemini sur la compréhension vidéo : Paramètres d'API et méthodes d'utilisation détaillés.

- Lien :

ai.google.dev/gemini-api/docs/video-understanding - Description : Documentation officielle de référence pour découvrir l'ensemble des capacités de compréhension vidéo.

- Lien :

-

Guide des invites Sora 2 : Les meilleures pratiques d'OpenAI pour la rédaction d'invites.

- Lien :

cookbook.openai.com/examples/sora/sora2_prompting_guide - Description : Apprenez à rédiger des invites de haute qualité pour la génération de vidéos.

- Lien :

-

Guide d'ingénierie d'invites inversée : Détails techniques sur la conversion vidéo-vers-invite.

- Lien :

skywork.ai/skypage/en/Video-to-Prompt-A-Hands-On-Guide - Description : Pour approfondir votre compréhension du fonctionnement de Video-to-Prompt.

- Lien :

Auteur : Équipe technique

Échanges techniques : N'hésitez pas à lancer la discussion dans l'espace commentaires. Pour plus de ressources, vous pouvez consulter la communauté technique APIYI sur apiyi.com.