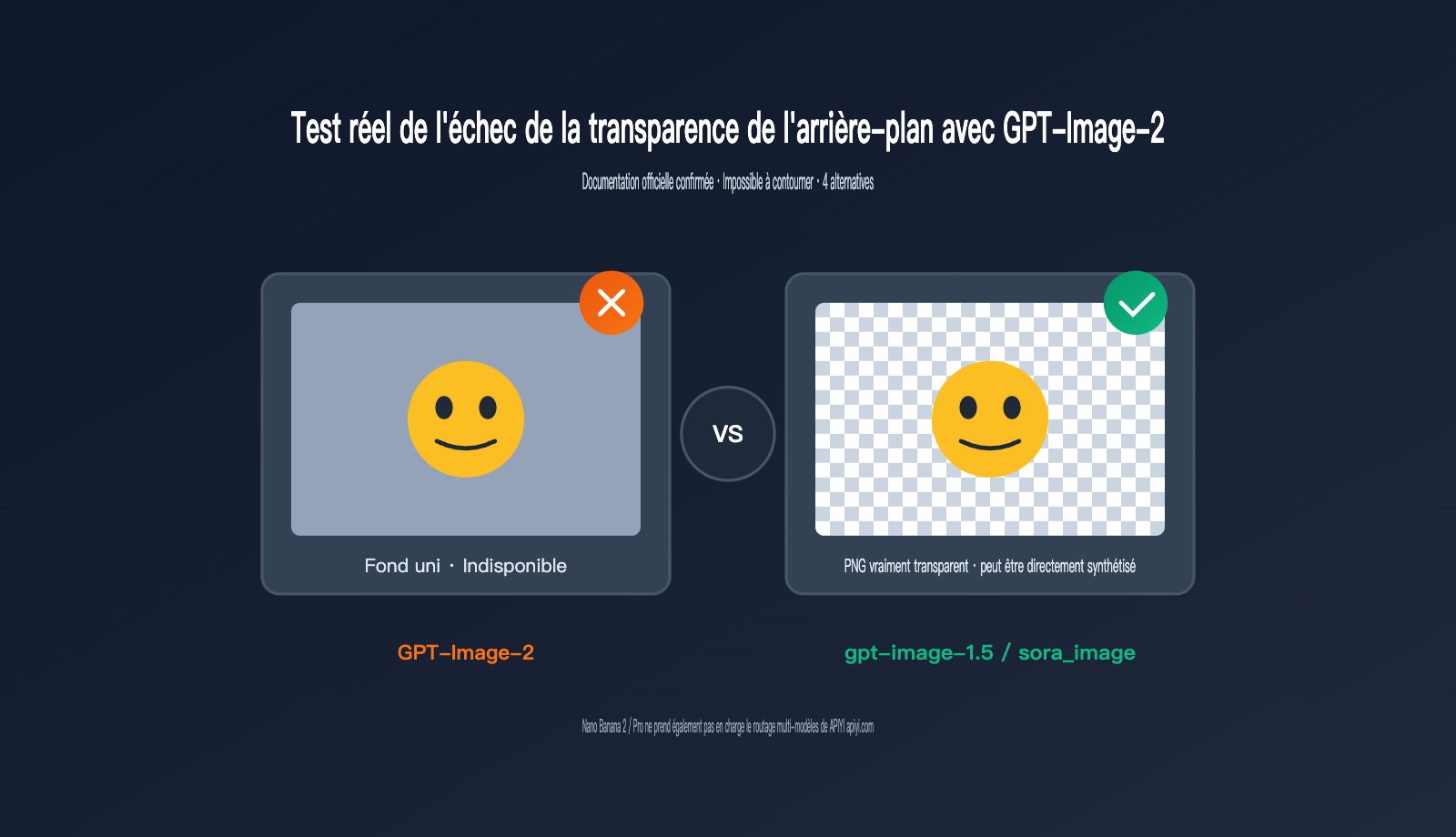

Récemment, en aidant des clients à résoudre des problèmes liés à la génération d'images, nous avons observé un phénomène qui mérite d'être partagé : GPT-Image-2 n'est plus capable de générer de véritables fichiers PNG avec un arrière-plan transparent. Peu importe que vous précisiez dans votre invite « l'arrière-plan doit être transparent » ou que vous passiez le paramètre background: "transparent" via l'API, la dernière génération de GPT-Image-2 renvoie systématiquement une image avec un fond opaque, voire génère une erreur. Ce recul par rapport à la génération précédente (sora_image / gpt-4o-image) a pris au dépourvu de nombreuses équipes travaillant sur le détourage de produits e-commerce, les autocollants pour réseaux sociaux ou les illustrations pour présentations.

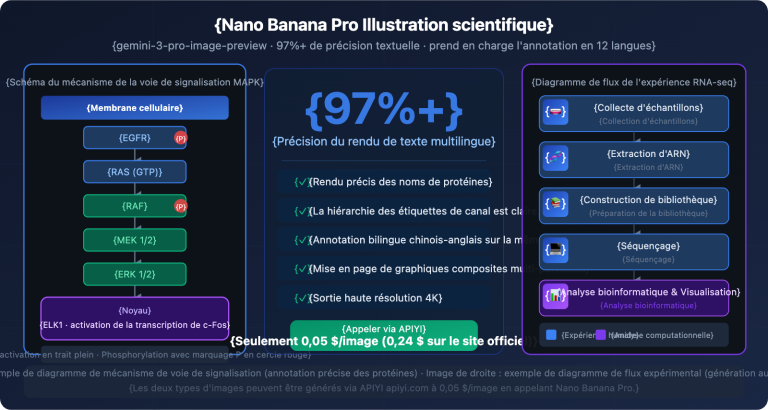

Plus surprenant encore, le modèle phare de Google lancé fin 2025, Nano Banana Pro (basé sur Gemini 3 Pro Image), ne prend pas non plus en charge la génération d'arrière-plans transparents, tout comme son prédécesseur, Nano Banana 2. En d'autres termes, les deux piliers actuels de la génération d'images ont supprimé cette fonctionnalité pourtant essentielle. Chez APIYI (apiyi.com), nous avons effectué une série complète de tests de régression pour analyser le phénomène, identifier les causes profondes et proposer des solutions de contournement, afin d'aider les équipes en phase d'intégration produit à prendre des décisions rapides.

Expérience de reproduction complète de l'échec de transparence sur GPT-Image-2

Pour comprendre cette différence de capacité, le plus simple est de tester directement. Nous avons utilisé la passerelle APIYI pour appeler simultanément les versions gpt-image-2, gpt-image-1.5 et gpt-image-2-all, avec l'invite « a cute orange cat sticker, transparent background » et le paramètre background explicitement défini sur transparent. Le résultat est sans appel : la série gpt-image-2 renvoie soit une erreur 4xx, soit une image avec un fond opaque ou un motif en damier, tandis que gpt-image-1.5 renvoie fidèlement un PNG transparent avec canal alpha.

# Test de la capacité de transparence sur 3 versions via la passerelle APIYI

from openai import OpenAI

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1"

)

# ❌ gpt-image-2 ne prend pas en charge 'transparent', rejeté par la passerelle

client.images.generate(

model="gpt-image-2",

prompt="a cute orange cat sticker",

background="transparent",

output_format="png"

)

# ✅ gpt-image-1.5 prend toujours en charge la sortie avec transparence native

client.images.generate(

model="gpt-image-1.5",

prompt="a cute orange cat sticker",

background="transparent",

output_format="png"

)

🎯 Conseil pour une mise en œuvre rapide : Si vous souhaitez simplement rétablir votre flux de travail, la solution la plus économique consiste à repasser sur le modèle

gpt-image-1.5en pointant votrebase_urlvers APIYI (apiyi.com). Sans changer aucun autre paramètre, vous retrouverez votre capacité de sortie transparente en moins de 5 minutes.

Nous avons également testé l'ajout forcé dans l'invite de termes comme « background must be transparent », « isolated on transparent canvas » ou « PNG with alpha channel ». GPT-Image-2 reste obstiné : il génère soit un fond blanc, soit une image avec un motif de « damier gris et blanc » incrusté, comme s'il dessinait une représentation visuelle de la transparence. Cela correspond parfaitement au mode d'échec de Nano Banana Pro ; il s'agit d'une lacune profonde dans l'alignement sémantique du modèle, et non d'un manque de précision dans l'invite.

| Méthode de déclenchement | Comportement GPT-Image-2 | Comportement gpt-image-1.5 | Recommandation |

|---|---|---|---|

Paramètre background="transparent" |

Rejet API / Fond opaque | PNG vrai transparent | Changer de modèle |

| Invite « transparent background » | Fond blanc ou damier | PNG vrai transparent | Ne pas se fier au texte |

| Invite « isolated subject on white » | Fond gris clair | Sujet sur fond blanc | Combiner avec le paramètre |

Sortie output_format=webp |

Toujours opaque | Webp vrai transparent | Le format n'influe pas |

| Interface Edit + masque alpha | Inefficace | Transparence locale | Uniquement 1.5 |

Les 3 raisons fondamentales de la suppression des arrière-plans transparents dans GPT-Image-2

La première raison réside dans les choix architecturaux. OpenAI indique clairement dans la documentation officielle de GPT-Image-2 que "gpt-image-2 ne prend pas actuellement en charge les arrière-plans transparents". Bien que la raison exacte ne soit pas publique, l'industrie s'accorde à dire que cela est lié à l'optimisation du modèle pour une meilleure "cohérence de scène". Le modèle est entraîné à compléter des scènes réalistes plutôt qu'à effectuer du "détourage", ce qui signifie que le signal de supervision du canal alpha est absent au niveau fondamental. Il s'agit d'un choix de conception produit, et non d'un bug.

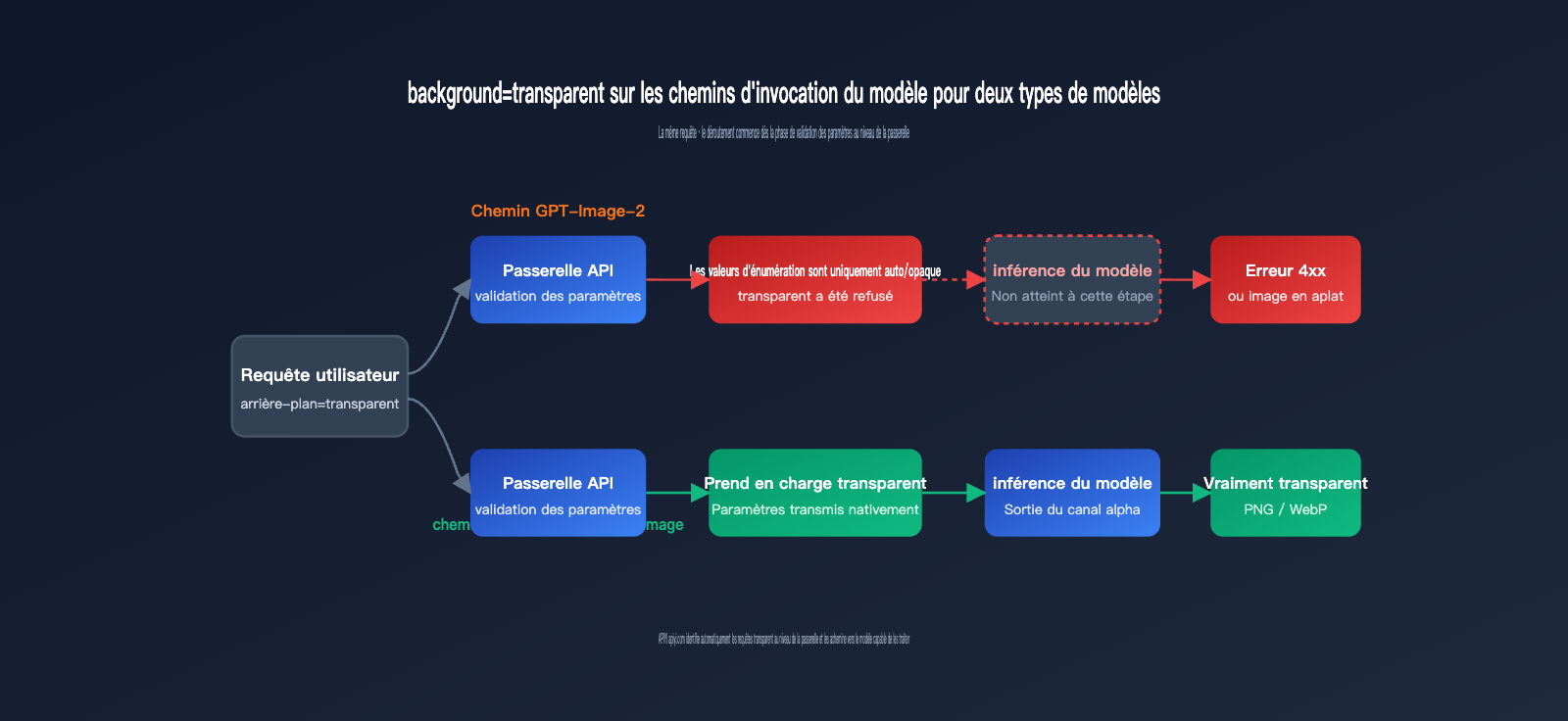

La deuxième raison est la validation stricte de la passerelle API. En analysant les réponses des terminaux officiels d'OpenAI, nous avons constaté que les valeurs énumérées pour le paramètre background de gpt-image-2 sont limitées à auto et opaque. La valeur transparent a été purement et simplement supprimée de l'espace des paramètres. Cela signifie que toute plateforme tierce (y compris la passerelle APIYI) rejettera ce type d'appel dès la phase de requête, avant même qu'il n'atteigne l'étape d'inférence du modèle. L'idée qu'il suffirait de "changer de plateforme tierce pour contourner cette restriction" est donc une illusion ; les canaux "officiels inversés" comme gpt-image-2-all ou gpt-image-2-vip utilisent tous le même modèle en backend.

La troisième raison concerne les stratégies de filtrage de sécurité et de droits d'auteur. Les images à fond transparent sont souvent utilisées pour des compositions secondaires, impliquant fréquemment des portraits ou des logos de marques. Ces deux dernières années, OpenAI a nettement durci les autorisations de sortie pour les "matériaux destinés à la recomposition". GPT-Image-2 intègre désormais un pipeline de modération de contenu plus strict, ce qui va de pair avec la suppression de la capacité de transparence.

🎯 Conseil d'architecture : Sur une passerelle unifiée comme APIYI (apiyi.com), nous vérifions séparément les espaces de paramètres de gpt-image-2 et gpt-image-1.5. Lorsqu'une requête

transparentest détectée, nous proposons automatiquement des suggestions de dégradation pour éviter que les utilisateurs ne se retrouvent face à des "échecs d'appel sans explication".

Comparaison des capacités de fond transparent : GPT-Image-2 vs Nano Banana Pro

Beaucoup de clients nous demandent : "Est-ce qu'il suffit de passer à Google Nano Banana 2 / Nano Banana Pro ?" La réponse est assez brutale : non, cela ne fonctionne pas non plus. Le mode d'échec de Nano Banana Pro est même plus "excentrique" que celui de GPT-Image-2 : il génère une image qui semble avoir un "fond transparent" à première vue, mais en y regardant de plus près, le damier est en fait composé de pixels opaques intégrés à l'image. C'est comme si le modèle avait "dessiné" le motif de transparence de Photoshop directement sur l'image.

L'explication dominante au sein de la communauté est la suivante : les données d'entraînement des modèles contiennent une grande quantité d'images utilisant des damiers pour représenter la transparence (banques d'images, captures d'écran Photoshop, tutoriels de design, etc.), ce qui a conduit le modèle à former une association erronée : "transparence = damier". Google a d'ailleurs confirmé sur le forum de l'API Gemini que la série Nano Banana ne prendrait pas en charge nativement la sortie avec fond transparent pour le moment. Il faut donc recourir à une combinaison de Gemini 3 Flash et d'exécution de code pour "contourner le problème".

| Modèle | Date de sortie | Support fond transparent | Comportement en cas d'échec | Scénarios recommandés |

|---|---|---|---|---|

| GPT-Image-2 | Début 2026 | ❌ Non supporté | Fond opaque / Erreur | Images réalistes, affiches |

| GPT-Image-2-all (officiel) | Début 2026 | ❌ Non supporté | Identique à l'officiel | Équivalent à GPT-Image-2 |

| GPT-Image-1.5 | Mi-2025 | ✅ Support natif | / | Autocollants, détourage e-commerce |

| sora_image / gpt-4o-image | Mars 2025 | ✅ Supporté | / | Compatibilité anciens flux |

| Nano Banana 2 | Fin 2025 | ❌ Non supporté | Motif damier gris/blanc | Création secondaire, stylisation |

| Nano Banana Pro | Fin 2025 | ❌ Non supporté | Motif damier gris/blanc | Édition haute fidélité |

| Stable Diffusion + LoRA | Mise à jour continue | ✅ Support indirect | Nécessite post-traitement | Production auto-hébergée |

🎯 Conseil de sélection : Si votre objectif est simplement de "détourer le sujet", la solution la plus rentable en 2026 est d'utiliser GPT-Image-1.5 / sora_image pour générer l'image directement, ou d'utiliser Nano Banana Pro suivi d'une suppression de fond. Ces deux options utilisent l'authentification et la facturation unifiées sur APIYI (apiyi.com), ce qui vous évite de devoir gérer deux jeux de clés côté métier.

4 alternatives pour gérer la transparence avec GPT-Image-2

Bien que GPT-Image-2 refuse de générer des images transparentes, il existe quatre chemins matures pour permettre à vos applications de fonctionner, chacun avec ses propres coûts et niveaux de qualité.

La première option consiste à redescendre vers sora_image / gpt-image-1.5. C'est la solution la moins intrusive : le code client n'a pratiquement pas besoin d'être modifié, il suffit de changer le champ model de gpt-image-2 vers gpt-image-1.5 ou sora_image pour retrouver immédiatement la sortie avec canal alpha. Le coût est une légère baisse du réalisme et des capacités de rendu de texte long, mais cela suffit amplement pour des autocollants, des logos ou des images e-commerce.

La deuxième option est GPT-Image-2 + post-traitement de détourage. Générez d'abord une image de haute qualité avec GPT-Image-2, puis enchaînez avec un modèle de détourage (ex: 851-labs/background-remover, RemBG, BiRefNet) pour extraire le canal alpha. Cette méthode préserve les avantages de GPT-Image-2, mais ajoute 1 à 3 secondes de latence, et la précision des bords complexes (cheveux, verre, fumée) dépend du modèle de détourage utilisé.

La troisième option est la méthode du fond vert (Chroma Key). Forcez dans l'invite l'utilisation d'un "fond vert pur, hex #00ff00", demandez à GPT-Image-2 de générer une image propre, puis utilisez du code pour remplacer la couleur via un seuil HSV. Cette méthode est plus rapide et moins coûteuse qu'un détourage générique, mais elle risque de "manger" les pixels de même teinte sur le sujet, ce qui n'est pas idéal si le sujet lui-même est vert.

La quatrième option est la soustraction de deux fonds. Demandez à GPT-Image-2 de générer deux images avec la même graine (seed), l'une sur fond blanc et l'autre sur fond noir, puis calculez la différence de couleur pixel par pixel pour déduire la valeur alpha. C'est une solution "hardcore" très discutée dans la communauté OpenAI, offrant une qualité très stable, mais au prix d'un coût de génération doublé.

| Alternative | Complexité | Coût supplémentaire | Qualité des bords | Scénario d'usage |

|---|---|---|---|---|

| Retour à GPT-Image-1.5 / sora_image | ⭐ | 0 | Élevée | Autocollants, e-commerce |

| GPT-Image-2 + détourage générique | ⭐⭐ | +1 appel détourage | Moyenne-Élevée | Portraits réalistes, produits |

| Méthode du fond vert (Chroma Key) | ⭐⭐⭐ | Presque nul | Moyenne | Personnages cartoon, formes |

| Soustraction de deux fonds | ⭐⭐⭐⭐ | 2x coût de génération | Élevée | Verre, cheveux, bords complexes |

🎯 Conseil d'ingénierie : Sur le backend d'APIYI (apiyi.com), nous routons par défaut les "demandes de fond transparent" vers gpt-image-1.5. Si un client souhaite conserver le style réaliste de GPT-Image-2, il est possible de créer une chaîne de traitement "génération + détourage" via une interface unifiée, exposant un seul point de terminaison pour simplifier l'intégration côté métier.

Si votre projet est sensible à la fois à la qualité des bords et aux coûts, le tableau comparatif ci-dessous peut servir de point de départ :

| Outil de détourage | Précision des bords | Latence moyenne | Déploiement | Combinaison recommandée |

|---|---|---|---|---|

| 851-labs/background-remover | Élevée | 1.5-2 s | API Cloud | Avec GPT-Image-2 |

| RemBG (U2Net) | Moyenne | 0.5 s | Auto-hébergé | Avec fond uni, tâches batch |

| BiRefNet | Très élevée | 2-3 s | Auto-hébergé | Cheveux, bords complexes |

| Seuil de couleur HSV | Moyenne | <0.1 s | Python | Avec fond vert (Chroma Key) |

FAQ sur la transparence des arrière-plans avec GPT-Image-2

Q1 : Pourquoi l'ajout de "fond transparent" dans l'invite GPT-Image-2 échoue-t-il systématiquement ?

Parce que le modèle n'a pas été entraîné à "générer un canal alpha" ; il est limité à l'espace colorimétrique RGB. Lorsque vous forcez une description comme "transparent background", le modèle l'interprète littéralement et dessine un symbole visuel représentant la transparence : le fameux damier gris et blanc. C'est un échec classique d'alignement sémantique, indépendamment de la précision de votre invite.

Q2 : Pourquoi les canaux officiels inversés comme gpt-image-2-all ou gpt-image-2-vip ne fonctionnent-ils pas non plus ?

Ces canaux ne sont, par essence, que des interfaces appelant le même modèle OpenAI en arrière-plan, avec simplement une gestion de pool de comptes ou de proxy en façade. Si une capacité n'est pas supportée par le modèle lui-même, aucun habillage frontal ne pourra la compenser. Si certaines plateformes tierces prétendent que "GPT-Image-2 supporte les fonds transparents", il s'agit le plus souvent d'un traitement post-génération automatique via une passerelle API, et non d'une sortie native du modèle.

Q3 : Quel API choisir si mon projet nécessite absolument un fond transparent ?

D'après nos tests sur APIYI (apiyi.com), voici nos recommandations : pour des stickers, des emojis ou des images e-commerce, privilégiez GPT-Image-1.5. Pour des détourages photo réalistes, utilisez GPT-Image-2 couplé à un modèle de segmentation dédié. Pour des besoins de conformité locale, envisagez l'auto-hébergement de modèles de la famille Stable Diffusion. Ces trois options sont commutables au sein d'une même passerelle, ce qui facilite grandement les tests A/B.

Q4 : Quand GPT-Image-2 / Nano Banana Pro supporteront-ils à nouveau les fonds transparents ?

Ni OpenAI ni Google n'ont communiqué de calendrier. Au vu des cycles de mise à jour passés, OpenAI ajoute généralement les paramètres manquants lors de versions mineures (ex: GPT-Image-2.1, 2.5). La série Nano Banana de Google privilégie davantage une approche combinée via Gemini 3 Flash et l'exécution de code, plutôt qu'une modification directe du modèle de base.

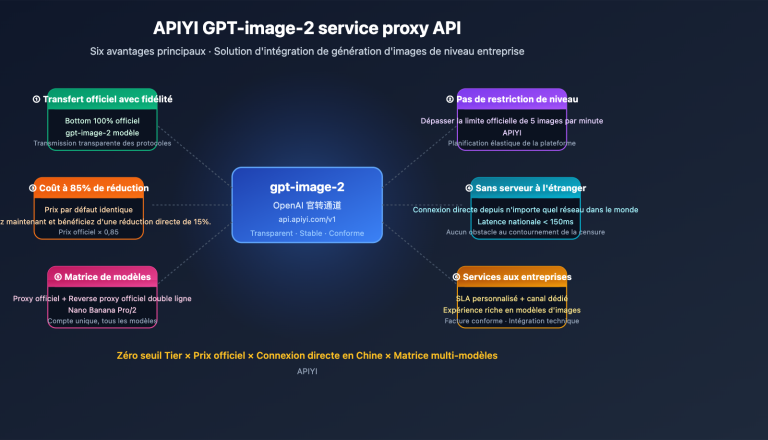

Q5 : Comment APIYI (apiyi.com) peut-il m'aider à ce sujet ?

Nous avons mis en place trois solutions : ① une détection automatique des requêtes contenant transparent au niveau de la passerelle avec une suggestion de repli (fallback) ; ② un routage multi-modèles unifié incluant GPT-Image-1.5, GPT-Image-2, Nano Banana Pro, etc. ; ③ une gestion centralisée de la facturation, des quotas et des logs, permettant à votre équipe de comparer les coûts réels sans avoir à maintenir plusieurs SDK.

3 points clés sur le problème de transparence avec GPT-Image-2

Premièrement, l'absence de support pour les fonds transparents dans GPT-Image-2 est une stratégie produit délibérée, et non un problème de rédaction d'invite ou de méthode d'intégration. Tout flux de travail insistant sur le terme "transparent" dans l'invite doit être migré vers la version 1.5 ou vers une chaîne de traitement post-génération, sous peine de rester bloqué sur des motifs en damier.

Deuxièmement, Nano Banana 2 / Pro ne supporte pas non plus les fonds transparents. Actuellement, la "sortie transparente native" repose exclusivement sur l'ancienne génération (GPT-Image-1.5, sora_image / gpt-4o-image) ou sur l'auto-hébergement de Stable Diffusion. Espérer l'existence d'un "interrupteur caché" est illusoire.

Troisièmement, la stratégie la plus robuste consiste à abstraire vos modèles derrière une passerelle unique, permettant de router automatiquement les demandes de "fond transparent" vers le modèle capable de les traiter. Nous avons intégré cette stratégie de routage par défaut, permettant à votre équipe d'économiser un temps précieux et de se concentrer sur la logique métier réelle.

Si vous refondez actuellement vos flux de travail liés à la génération d'images, n'hésitez pas à effectuer un test de régression directement sur APIYI (apiyi.com) : exécutez vos invites actuelles simultanément sur GPT-Image-2 et GPT-Image-1.5. En 10 minutes, vous obtiendrez un tableau comparatif vous indiquant quel modèle utiliser pour chaque scénario, vous aidant ainsi à décider s'il faut opter pour un repli vers un modèle inférieur ou ajouter une étape de détourage.

📌 Auteur : L'équipe technique d'APIYI — Nous suivons en continu les évolutions des capacités des modèles majeurs (OpenAI, Google, Anthropic) pour offrir aux développeurs une expérience de passerelle API multi-modèles unifiée. Pour en savoir plus, visitez APIYI (apiyi.com).