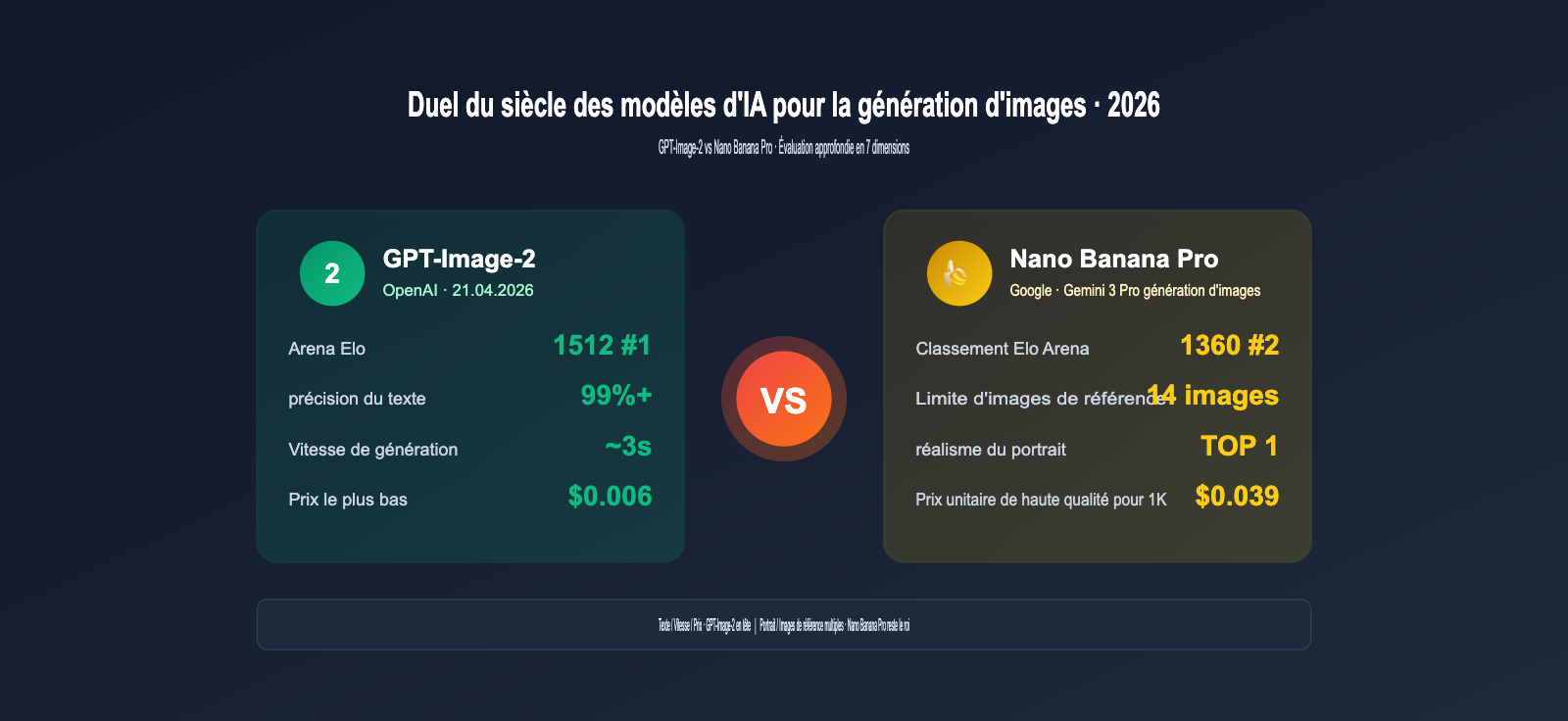

Le 21 avril 2026, OpenAI a officiellement lancé GPT-Image-2. À peine 12 heures après sa mise en ligne, il a atteint la première place du classement LMArena Image avec un score de 1512 Elo, reléguant l'ancien champion de Google, Nano Banana Pro (Gemini 3 Pro Image), avec une avance record de +242 points.

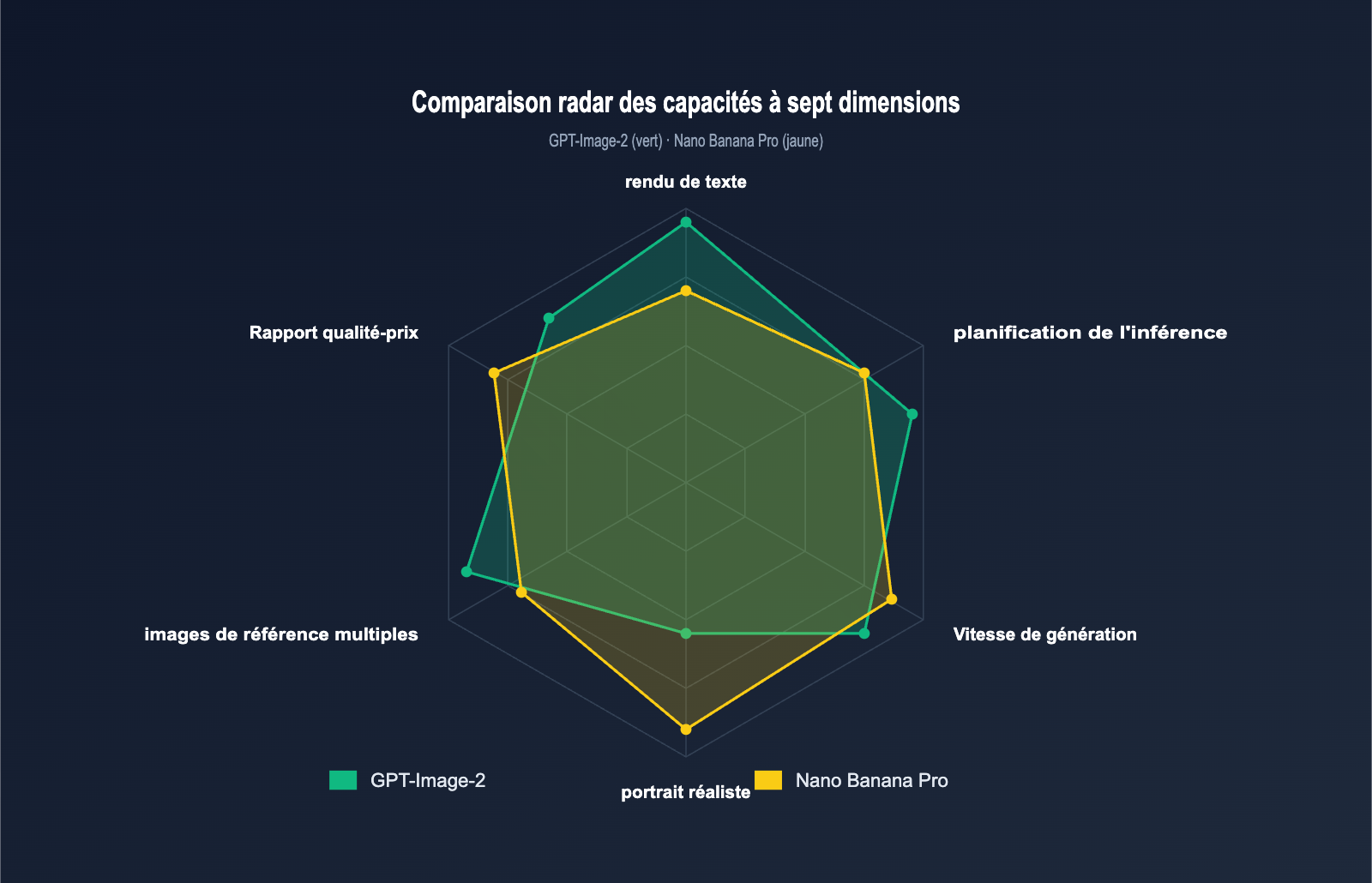

Soudainement, "Que vaut GPT-Image-2 ? Est-il vraiment meilleur que Banana ?" est devenu la question brûlante pour les designers, développeurs, responsables marketing et entreprises. Cet article analyse les deux modèles sous 7 dimensions clés, basées sur la documentation officielle, les données de test du classement Arena et des cas d'usage réels, pour vous aider à prendre une décision en 30 minutes.

Si vous souhaitez une conclusion rapide, passez directement à la "Matrice de décision" en fin d'article ; si vous préférez comprendre les différences techniques derrière chaque dimension, nous vous conseillons de lire l'article dans l'ordre.

Aperçu des différences clés : GPT-Image-2 vs Nano Banana Pro

Avant d'entrer dans le détail, voici un tableau comparatif pour visualiser les différences majeures entre les deux modèles.

| Dimension | GPT-Image-2 (OpenAI) | Nano Banana Pro (Google) |

|---|---|---|

| Date de sortie | 21 avril 2026 | Novembre 2025 (Gemini 3 Pro Image) |

| Elo Arena | 1512 (#1) | 1360 (#2) |

| Modèle sous-jacent | Série GPT-5 + raisonnement O-Series | Gemini 3 Pro |

| Résolution max. | 2K natif / 4K Beta | 2K / 4K |

| Vitesse de génération | ~3 secondes (instantané) | 10-15 secondes |

| Précision du rendu texte | 99%+ (multilingue) | ~95% |

| Cohérence multi-images | Jusqu'à 8 images par requête | Jusqu'à 8 images par requête |

| Limite image de référence | Fusion multi-images (limite non publiée) | 14 images de réf. / 5 personnages |

| Capacité de raisonnement | Double mode Instant + Thinking | Raisonnement basé sur Gemini 3 Pro |

| Fourchette de prix (1K) | 0,006 $ – 0,211 $ | 0,039 $ – 0,134 $ |

| Filigrane officiel | Aucun filigrane visible imposé | Filigrane invisible SynthID |

| Accès API | Compatible OpenAI / service proxy API | Google AI Studio / service proxy API |

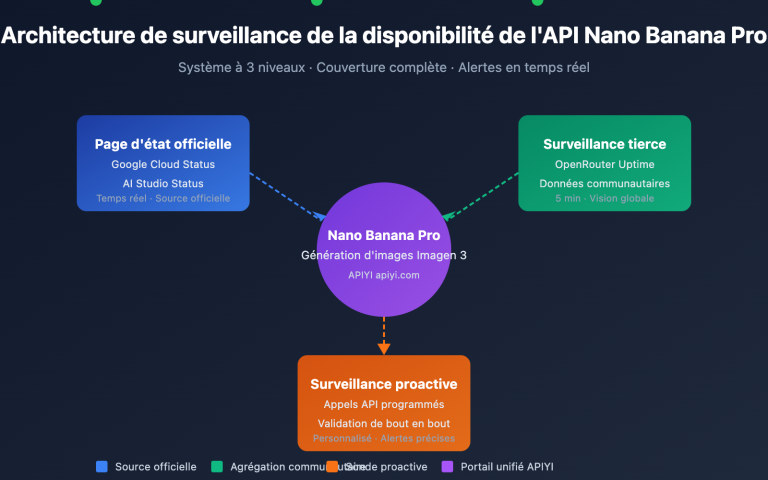

🎯 Conclusion rapide : En termes de classement Arena et de précision du rendu de texte, GPT-Image-2 est actuellement le modèle d'image le plus puissant. Cependant, Nano Banana Pro conserve des avantages irremplaçables pour le réalisme des portraits, la cohérence avec plusieurs images de référence et le contrôle des coûts. Pour les développeurs souhaitant utiliser les deux modèles et basculer entre eux selon les besoins, nous recommandons d'utiliser la plateforme APIYI (apiyi.com) pour accéder aux deux via une interface unique, évitant ainsi de multiplier les SDK.

Dimension 1 : Résultats au classement Arena et modèles de base

Le dépassement historique au classement LMArena

LMArena (anciennement LMSys Chatbot Arena) est actuellement l'arène de test en aveugle la plus faisant autorité dans l'industrie, basée sur les votes anonymes d'utilisateurs du monde entier pour générer un score Elo. Le jour de sa sortie, GPT-Image-2 a battu tous les records historiques.

| Modèle | Arena Elo | Écart avec le 1er | Temps pour atteindre le sommet |

|---|---|---|---|

| GPT-Image-2 | 1512 | 0 (#1) | 12 heures |

| Nano Banana Pro | 1360 | -152 | – |

| Nano Banana 2 (Flash) | ~1270 | -242 | – |

| Midjourney V8 | ~1250 | -262 | – |

| FLUX Pro 1.1 | ~1180 | -332 | – |

Données clés : GPT-Image-2 devance le second, Nano Banana Pro, de 152 points et le troisième groupe de 242 points. Cet écart est à peu près équivalent à celui qui séparait Nano Banana Pro de DALL-E 3, ce qui signifie qu'il s'agit d'un changement qualitatif intergénérationnel.

Les différences de "cerveau" entre les deux modèles

La différence de capacité entre les deux modèles trouve sa source dans les philosophies de conception de leurs modèles de base :

- GPT-Image-2 est basé sur la série GPT-5 et intègre nativement l'architecture de raisonnement O-Series d'OpenAI. Il ne se contente plus de "dessiner dès qu'il voit l'invite", il comprend d'abord, planifie ensuite, et génère enfin. C'est la raison fondamentale pour laquelle ses capacités en matière de texte et de mise en page ont fait un bond en avant.

- Nano Banana Pro est basé sur Gemini 3 Pro et possède les mêmes connaissances du monde que le modèle textuel Gemini, ainsi qu'une capacité d'accès aux informations en temps réel via Google Search. Il s'apparente davantage à un "Gemini du monde de l'image", excellant dans l'intégration d'informations issues du monde réel.

💡 Conseil technique : Si votre activité nécessite une génération d'images basée sur des informations en temps réel (météo, actualités, événements sportifs, géographie), la capacité de connexion à Google Search de Nano Banana Pro est un atout majeur. Si votre besoin principal est la précision du texte et la mise en page complexe, l'architecture de raisonnement de GPT-Image-2 est plus avantageuse.

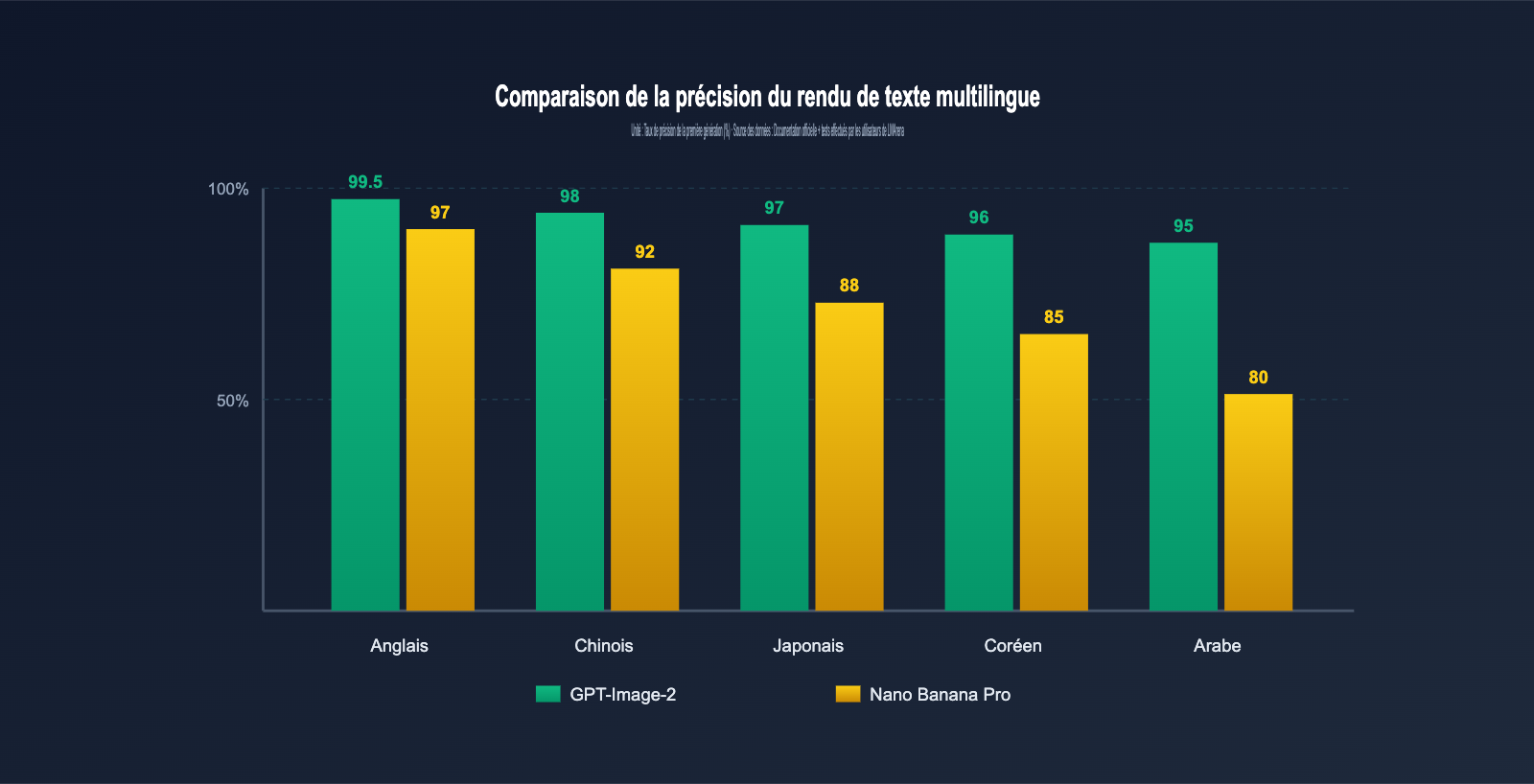

Dimension 2 : Capacité de rendu de texte — GPT-Image-2 atteint un taux de précision proche de 100 %

Le rendu de texte a toujours été le "talon d'Achille" des modèles d'IA génératrice d'images. Pour les générations précédentes, même Midjourney ou DALL-E 3 écrivaient souvent "Wecolme" au lieu de "Welcome", ou déformaient les caractères chinois. GPT-Image-2 a réalisé une percée qualitative sur ce point.

Test de précision du texte multilingue

Selon les données officielles et les retours des testeurs de LMArena, le taux de précision du texte lors de la première génération pour les deux modèles est le suivant :

| Langue | GPT-Image-2 | Nano Banana Pro | Écart |

|---|---|---|---|

| Anglais | 99,5%+ | 97% | +2,5pp |

| Chinois (simplifié/traditionnel) | 98%+ | 92% | +6pp |

| Japonais (incl. Kanji/Kana) | 97%+ | 88% | +9pp |

| Coréen | 96%+ | 85% | +11pp |

| Arabe | 95%+ | 80% | +15pp |

Conclusion : L'écart est faible pour les langues occidentales, mais dans les scénarios CJK (chinois, japonais, coréen) et RTL (arabe), GPT-Image-2 présente un avantage évident, presque une génération d'écart.

Scénarios à forte densité de texte adaptés à GPT-Image-2

- Affiches marketing / publicités multilingues

- Infographies

- Prototypes d'interface utilisateur / boutons / étiquettes

- Couvertures de diapositives / visualisation de données

- Bulles de dialogue pour bandes dessinées

- Menus / panneaux de signalisation / enseignes de magasins

Exemple pratique de capacité textuelle

# Utilisation de GPT-Image-2 pour générer une affiche marketing multilingue

from openai import OpenAI

client = OpenAI(

api_key="VOTRE_CLE_API",

base_url="https://vip.apiyi.com/v1" # Via le service proxy API APIYI, compatible avec le SDK OpenAI

)

response = client.images.generate(

model="gpt-image-2",

prompt="""Une affiche technologique sur fond noir, avec le titre centré en gros caractères "L'IA pilote le futur",

sous-titre en dessous "Powered by AI - Sommet technique 2026", date en petit en bas à droite "2026.06.15",

style global : dégradé bleu-violet néon, minimaliste, style professionnel""",

size="1024x1536",

quality="high",

n=1

)

print(response.data[0].url)

🎯 Conseil de déploiement : Le code ci-dessus pointe vers

https://vip.apiyi.com/v1viabase_url, vous permettant d'utiliser le service proxy API stable d'APIYI. APIYI prend en charge les interfaces d'image d'OpenAI et de Google ; le même code peut basculer entregpt-image-2etgemini-3-pro-imageen un clic pour une comparaison facile.

Dimension 3 : Capacités de raisonnement et de planification — Le mode « Thinking » fait toute la différence

La conception à double mode de GPT-Image-2

GPT-Image-2 introduit pour la première fois dans le domaine de la génération d'images la chaîne de raisonnement de la série O d'OpenAI, offrant deux modes de fonctionnement :

Mode Instant

- Objectif : Génération rapide, résultat en moins de 3 secondes.

- Caractéristiques : Qualité déjà supérieure à la génération précédente GPT Image 1.5.

- Cas d'usage : Avatars, emojis, ébauches conceptuelles rapides, visuels pour réseaux sociaux.

- Disponibilité : Accessible même aux utilisateurs gratuits de ChatGPT.

Mode Thinking

- Objectif : Raisonnement + planification + génération après recherche.

- Caractéristiques : Réfléchit à la composition et aux relations spatiales avant de générer, avec possibilité d'utiliser la recherche Web.

- Cas d'usage : Affiches complexes, séquences multi-images, supports de marque, visualisations de recherche.

- Disponibilité : Réservé aux utilisateurs ChatGPT Plus / Pro / Business et via API.

La conception de raisonnement de Nano Banana Pro

Basé sur Gemini 3 Pro, Nano Banana Pro intègre nativement une solide connaissance du monde et des capacités de raisonnement, mais ne propose pas de bascule explicite entre Instant et Thinking : sa « réflexion » est intrinsèque et l'utilisateur ne peut ni la désactiver ni la renforcer manuellement.

Son avantage unique réside dans le Google Search Grounding : il effectue des recherches Google en temps réel avant la génération, ce qui le rend idéal pour les scénarios nécessitant des informations à jour.

| Critère de comparaison | GPT-Image-2 Thinking | Nano Banana Pro |

|---|---|---|

| Intensité du raisonnement | Réglable explicitement | Intégrée par défaut |

| Source de recherche Web | Bing + index interne OpenAI | Google Search |

| Planification pré-génération | Chaîne de raisonnement explicite | Planification implicite |

| Compréhension des invites longues | Excellente | Excellente |

| Résistance aux contradictions | Excellente (ajustement actif) | Moyenne |

Test d'exécution d'instructions complexes

Un test typique : générer une grille 3×3, où chaque case présente un vêtement avec une étiquette textuelle.

- GPT-Image-2 : Exécute précisément la mise en page en grille, les étiquettes sont claires et correspondent parfaitement aux vêtements.

- Nano Banana Pro : La grille est interprétée comme une « mise en page de référence », mais le résultat peut présenter des mélanges de vêtements ou des étiquettes mal placées.

💡 Conseil de sélection : Si vous avez besoin de respecter strictement des instructions structurées (relations spatiales, quantités, hiérarchie), privilégiez le mode Thinking de GPT-Image-2. Si vous devez intégrer des informations en temps réel (cours de bourse, météo actuelle), le Grounding de Nano Banana Pro est plus adapté. Pour les équipes qui testent fréquemment, l'utilisation d'une passerelle unifiée (comme APIYI apiyi.com) permet d'économiser un temps précieux.

Dimension 4 : Réalisme des portraits et cohérence multi-références — Nano Banana Pro reste le roi

Comparaison du réalisme des portraits

Bien que GPT-Image-2 domine globalement les classements, Nano Banana Pro conserve un avantage net en ce qui concerne les portraits réalistes, la texture de la peau, le grain de peau et les détails des cheveux.

| Dimension du portrait | GPT-Image-2 | Nano Banana Pro |

|---|---|---|

| Texture de la peau | Aspect plastique | Naturel, avec détails des pores |

| Détails des cheveux | Mèches parfois coupées | Mèches nettes, bonne profondeur |

| Réalisme de la lumière | Correct | Qualité cinématographique |

| Finesse des émotions | Moyenne | Élevée |

| Détails de l'iris/pupille | Moyen | Précis |

| Proportions corporelles | Erreurs occasionnelles | Stable |

Différences de limites pour la synthèse multi-références

Nano Banana Pro possède un avantage majeur sur le nombre d'images de référence :

- Nano Banana Pro : Prend en charge jusqu'à 14 images de référence + 5 personnages humains simultanément dans une même image, tout en conservant une cohérence de lumière, de perspective et de style.

- GPT-Image-2 : Prend également en charge plusieurs images de référence, mais au-delà de 5 ou 6, la cohérence des personnages commence à dériver légèrement.

Pour des scénarios tels que l'essayage virtuel e-commerce, le jeu de rôle, les systèmes de design de marque ou la continuité de personnages de bande dessinée, la limite de 14 images de Nano Banana Pro est actuellement la seule solution réellement exploitable sur le marché.

Recommandations par scénario

- 📸 Style photographie professionnelle : Nano Banana Pro ressemble davantage à une « prise de vue réelle », tandis que GPT-Image-2 tend vers « l'illustration retouchée ».

- 👤 Conservation du visage : Pour éditer plusieurs fois le même visage, la cohérence faciale de Nano Banana Pro est plus stable.

- 👫 Photos de groupe : Pour les photos de 3 personnes ou plus, Nano Banana Pro est le premier choix.

- 🎭 Séries de personnages : Si un même personnage fictif doit apparaître dans différents scénarios, Nano Banana Pro l'emporte.

- 🏷️ Design avec texte : GPT-Image-2 gagne.

🎯 Conseil métier : Pour l'e-commerce, la retouche photo et les mini-séries, utilisez principalement Nano Banana Pro. Pour le design de marque, la création d'affiches et l'UI design, privilégiez GPT-Image-2. La plateforme APIYI apiyi.com permet d'accéder aux deux modèles avec un quota partagé, vous permettant de basculer selon vos besoins.

Dimension 5 : Vitesse de génération et débit

La vitesse est souvent le facteur décisif pour l'expérience utilisateur, en particulier pour les produits grand public, les éditeurs en ligne et les scénarios de production en masse.

| Indicateur de vitesse | GPT-Image-2 | Nano Banana Pro |

|---|---|---|

| Latence du premier jeton | ~1 s | ~3 s |

| Durée totale mode Instant | 3 s | N/A |

| Durée totale mode Thinking | 15-40 s | N/A |

| Durée totale standard | 3-8 s | 10-15 s |

| Durée totale 4K | 8-15 s | 20-30 s |

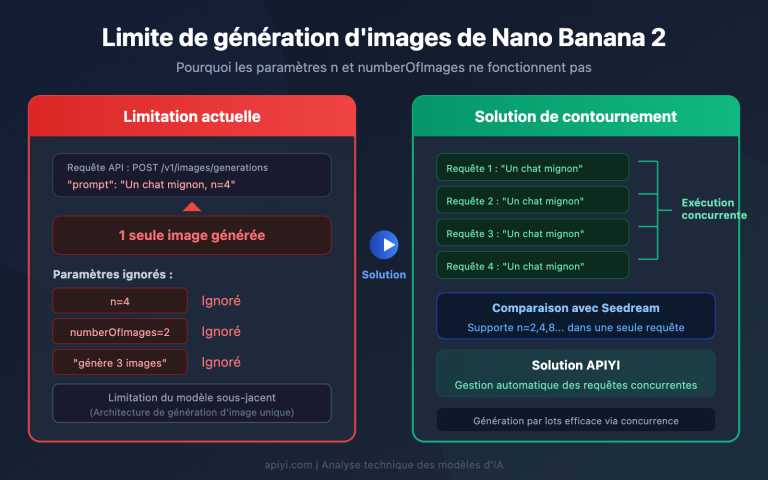

| Nombre max. d'images par requête | 8 | 8 |

| Capacité de traitement par lots | Excellente | Bonne |

La vitesse de génération de 3 secondes du mode Instant de GPT-Image-2 est l'une des plus rapides actuellement parmi les modèles d'image de niveau 2K. Elle offre une expérience quasi "temps réel", idéale pour les produits interactifs.

# Comparaison par lots de la vitesse de génération des deux modèles

import time

from openai import OpenAI

# Utilisation centralisée via le service proxy API APIYI, un seul SDK pour les deux modèles

client = OpenAI(api_key="VOTRE_CLE_API", base_url="https://vip.apiyi.com/v1")

prompt = "rue cyberpunk de nuit, enseignes néon, sol pluvieux, cinématique 8k"

for model in ["gpt-image-2", "gemini-3-pro-image"]:

start = time.time()

resp = client.images.generate(model=model, prompt=prompt, size="1024x1024", n=1)

elapsed = time.time() - start

print(f"{model}: {elapsed:.2f}s -> {resp.data[0].url}")

💡 Conseils de performance : Si vous développez un produit SaaS, un éditeur en temps réel ou des interactions IA en direct, privilégiez GPT-Image-2 Instant. Pour des tâches de traitement par lots hors ligne ou du rendu nocturne, la différence de vitesse entre les deux modèles est négligeable. En environnement de production, il est recommandé d'utiliser une passerelle proxy avec gestion de pool de connexions et sélection de région pour réduire efficacement la latence.

Dimension 6 : Prix de l'API et coûts de commercialisation

Comparaison des tarifs officiels

Les stratégies tarifaires des deux modèles diffèrent radicalement : GPT-Image-2 utilise une "tarification par niveau de qualité", tandis que Nano Banana Pro utilise une "tarification par résolution + facturation au jeton".

| Niveau / Résolution | GPT-Image-2 (Prix/image) | Nano Banana Pro (Prix/image) |

|---|---|---|

| Low / 1024×1024 | 0,006 $ | 0,039 $ |

| Medium / 1024×1024 | 0,065 $ | 0,039 $ |

| High / 1024×1024 | 0,211 $ | 0,039 $ |

| High / 2K | 0,28 $ | 0,134 $ |

| High / 4K | 0,41 $ | 0,24 $ |

| Facturation jetons (entrée) | 5 $ / 1M | 2 $ / 1M |

| Facturation jetons (sortie) | 10 $ / 1M | 12 $ / 1M |

Analyse clé :

- Niveau basse qualité : GPT-Image-2 est le moins cher (0,006 $), idéal pour des brouillons en masse.

- Niveau haute qualité : Nano Banana Pro est plus abordable (0,039 $ vs 0,211 $), adapté aux besoins de haute qualité à l'unité.

- Scénarios 4K : Nano Banana Pro (0,24 $) permet d'économiser 41 % par rapport à GPT-Image-2 (0,41 $).

- Mode Thinking : Les coûts en jetons de GPT-Image-2 peuvent alourdir la facture, surveillez votre budget.

Exemple d'estimation des coûts

Pour 10 000 images 1K de haute qualité par mois :

| Modèle | Prix unitaire | Coût mensuel | Économie |

|---|---|---|---|

| GPT-Image-2 (High 1K) | 0,211 $ | 2 110 $ | – |

| Nano Banana Pro (1K) | 0,039 $ | 390 $ | 82 % |

| Stratégie mixte (50/50) | – | 1 250 $ | 41 % |

🎯 Conseils d'optimisation des coûts : Pour les activités sensibles au budget, Nano Banana Pro est plus rentable. Cependant, si votre contenu nécessite beaucoup de texte, les capacités textuelles de GPT-Image-2 permettent des économies sur la retouche manuelle qui dépassent souvent la différence de prix de l'API. Nous recommandons d'utiliser la plateforme APIYI (apiyi.com) pour une facturation unifiée, bénéficiant de remises sur volume et évitant de gérer séparément les recharges chez OpenAI et Google.

Dimension 7 : Conformité, filigrane et contrôle

Différences dans la stratégie de filigrane

Les deux solutions adoptent des approches radicalement différentes pour la "traçabilité" des images générées :

- GPT-Image-2 : Les images en sortie ne comportent aucun filigrane visible obligatoire, mais les métadonnées du fichier contiennent des informations C2PA (Coalition for Content Provenance and Authenticity), lisibles par des outils spécialisés.

- Nano Banana Pro : Toutes les images générées incluent automatiquement un filigrane invisible SynthID. Il est imperceptible à l'œil nu, mais peut être détecté via les outils de vérification de Google.

| Dimension de conformité | GPT-Image-2 | Nano Banana Pro |

|---|---|---|

| Filigrane visible | Aucun | Aucun |

| Filigrane invisible | Métadonnées C2PA | SynthID |

| Usage commercial | Autorisé (sous réserve de la politique de contenu) | Autorisé |

| Politique / Personnalités publiques | Restrictions strictes | Restrictions strictes |

| Contenu lié aux mineurs | Restrictions strictes | Restrictions strictes |

| NSFW | Interdit | Interdit |

Intensité des filtres de sécurité

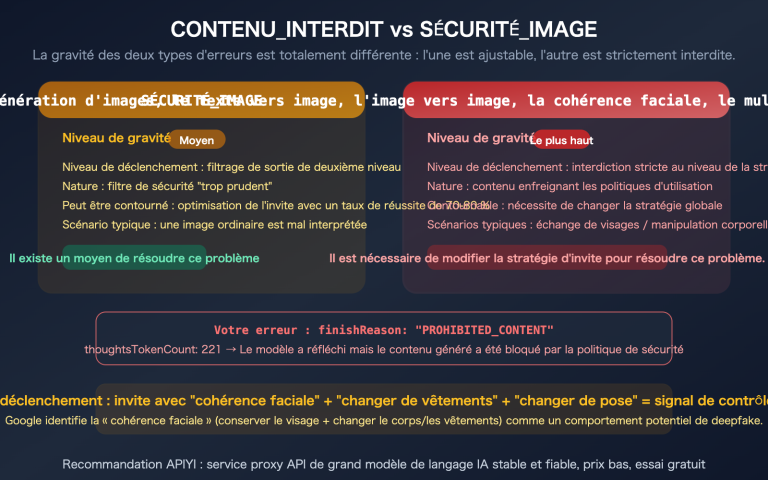

- GPT-Image-2 : La modération est assez stricte. Les requêtes impliquant des célébrités, des marques déposées ou des termes sensibles renvoient directement une erreur

content_policy_violation400 (si vous rencontrez ce type d'erreur, consultez notre documentation de dépannage). - Nano Banana Pro : La politique de sécurité est similaire, mais elle se montre relativement plus souple vis-à-vis des personnages historiques et des courants artistiques.

💡 Conseil de conformité : Pour les usages commerciaux en entreprise, il est vivement recommandé de conserver les filigranes officiels ou les informations C2PA afin d'éviter tout litige lié aux droits d'auteur en aval. Les organisations nécessitant des processus d'audit rigoureux peuvent envisager d'utiliser une passerelle API intégrant la journalisation des requêtes, l'audit des invites (prompts) et la traçabilité des sorties, facilitant ainsi les contrôles de gestion des risques internes.

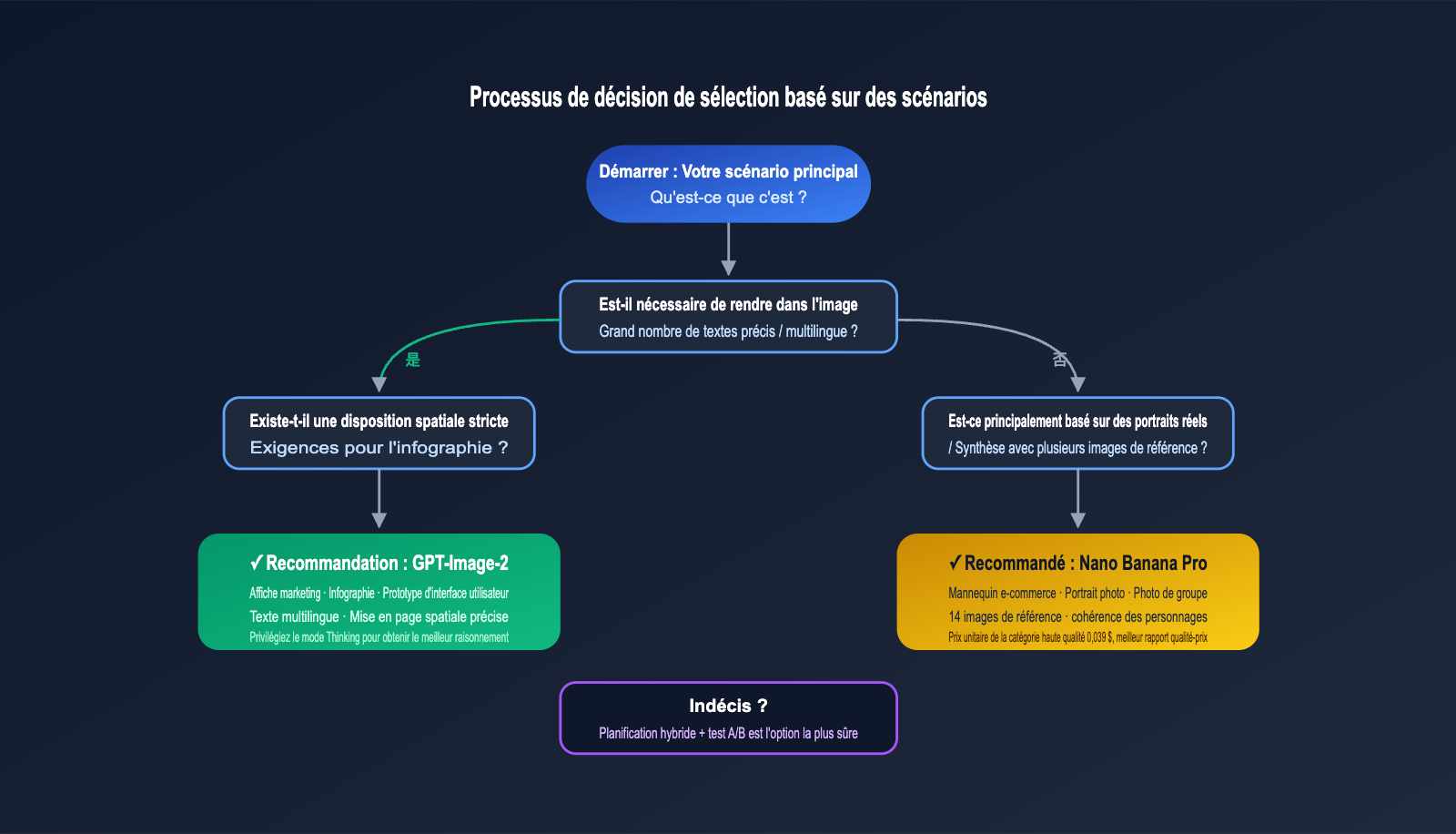

Matrice de sélection par scénario

Sur la base des 7 dimensions précédentes, nous avons synthétisé les recommandations par scénario d'usage.

| Scénario d'usage | Modèle privilégié | Modèle alternatif | Raison clé |

|---|---|---|---|

| Affiches marketing / Publicités multilingues | GPT-Image-2 | Nano Banana Pro | Rendu du texte > 99% |

| Infographies / Visualisation de données | GPT-Image-2 | Nano Banana Pro | Meilleur raisonnement de mise en page |

| Essayage virtuel / Mannequins e-commerce | Nano Banana Pro | GPT-Image-2 | 14 images de référence |

| Portraits réalistes | Nano Banana Pro | – | Supériorité du réalisme humain |

| Photos de groupe / Équipe | Nano Banana Pro | – | Jusqu'à 5 personnages |

| Prototypage UI / Maquettes | GPT-Image-2 | Nano Banana Pro | Texte + composants précis |

| Brouillons en masse (faible coût) | Nano Banana Pro | GPT-Image-2 Low | Coût unitaire inférieur |

| Éditeur temps réel / Produit SaaS | GPT-Image-2 Instant | – | Génération en 3 secondes |

| Informations en temps réel (météo/actu) | Nano Banana Pro | GPT-Image-2 Thinking | Connexion recherche Google |

| Affiche + chiffres/dates précis | GPT-Image-2 Thinking | – | Raisonnement + texte excellents |

| Cohérence des personnages (BD/scénario) | Nano Banana Pro | – | Meilleure cohérence multi-images |

| Stylisation artistique | Variable | – | Test A/B recommandé |

Bonnes pratiques pour une planification hybride

Dans un environnement de production réel, s'appuyer sur une seule solution n'est pas la stratégie optimale. Voici les modèles de répartition que nous avons observés :

Modèle A : Priorité au texte (pour le marketing de marque, les médias sociaux, l'e-commerce)

- 70% du trafic → GPT-Image-2 (affiches, infographies, UI)

- 30% du trafic → Nano Banana Pro (portraits, mannequins, photos réelles)

Modèle B : Priorité au portrait (pour la photographie, le mariage, les modèles e-commerce)

- 70% du trafic → Nano Banana Pro (portraits, groupes, édition)

- 30% du trafic → GPT-Image-2 (logos, annotations, typographie de couverture)

Modèle C : Priorité au coût (pour la production de masse, usine à contenu)

- 80% des ébauches → GPT-Image-2 Low (0,006 $) / Nano Banana Pro (0,039 $)

- 20% des finitions → Sélection selon les besoins de qualité

🎯 Conseil technique : Si vous avez besoin d'un routage entre modèles, vous pouvez diriger directement votre

base_urlvershttps://vip.apiyi.com/v1et alterner entregpt-image-2etgemini-3-pro-imagevia le champmodel. Cela évite d'avoir à gérer séparément les clés OpenAI et Google AI Studio, simplifiant ainsi considérablement votre infrastructure.

Démarrage rapide : Intégration de deux modèles en 3 minutes

Préparation de l'environnement

# Installer la dernière version du SDK OpenAI (compatible avec les deux modèles)

pip install --upgrade openai

# Ou utiliser le SDK Node.js

npm install openai@latest

Exemple d'invocation unifiée (Python)

from openai import OpenAI

import base64

client = OpenAI(

api_key="VOTRE_CLE_APIYI",

base_url="https://vip.apiyi.com/v1"

)

def generate_image(model_name: str, prompt: str, size="1024x1024"):

"""Encapsulation unifiée, supporte gpt-image-2 et gemini-3-pro-image"""

resp = client.images.generate(

model=model_name,

prompt=prompt,

size=size,

n=1,

quality="high"

)

return resp.data[0].url

# Test comparatif avec la même invite

prompt = "Une couverture de brochure de voiture électrique futuriste avec le texte 'EV 2026'"

url_openai = generate_image("gpt-image-2", prompt)

url_google = generate_image("gemini-3-pro-image", prompt)

print(f"GPT-Image-2: {url_openai}")

print(f"Nano Banana Pro: {url_google}")

Exemple d'invocation Node.js

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.APIYI_KEY,

baseURL: "https://vip.apiyi.com/v1",

});

async function generate(model, prompt) {

const res = await client.images.generate({

model,

prompt,

size: "1024x1024",

n: 1,

});

return res.data[0].url;

}

const prompt = "affiche cyberpunk avec le texte chinois '人工智能'";

console.log(await generate("gpt-image-2", prompt));

console.log(await generate("gemini-3-pro-image", prompt));

💡 Conseil d'intégration : Utiliser une seule

base_urlet une seule clé API pour les deux modèles est la norme que nous recommandons. En passant par APIYI (apiyi.com), changer de modèle ne nécessite que la modification d'un paramètre de chaîne de caractères, sans toucher à la structure de la requête.

FAQ – Questions fréquentes

1. GPT-Image-2 surpasse-t-il vraiment Nano Banana Pro sur tous les points ?

Pas du tout. GPT-Image-2 a des avantages évidents en rendu de texte, raisonnement spatial et vitesse de génération, mais Nano Banana Pro reste inégalé pour le réalisme des portraits, la cohérence faciale et la fusion de plusieurs images de référence. Nous recommandons de choisir selon votre cas d'usage plutôt que de chercher une solution unique.

2. Les API de ces deux modèles sont-elles stables en Chine continentale ?

Les API officielles imposent des restrictions d'accès aux utilisateurs en Chine continentale. Nous recommandons d'utiliser les lignes optimisées d'APIYI (apiyi.com), qui supportent le protocole natif OpenAI et couvrent à la fois gpt-image-2 et gemini-3-pro-image pour une stabilité et une réactivité optimales.

3. Lequel choisir pour des affiches marketing contenant du texte ?

Privilégiez GPT-Image-2, surtout pour les affiches nécessitant du chinois, japonais, coréen ou arabe. Son taux de précision textuelle est supérieur de 6 à 15 % à celui de Nano Banana Pro. Si l'affiche implique des modèles humains, envisagez un flux combiné : "GPT-Image-2 pour la mise en page et le texte + Nano Banana Pro pour les visuels de personnages".

4. Comment basculer entre les modes Thinking et Instant dans l'API ?

Utilisez le paramètre reasoning_effort ou le nom du modèle dédié (ex: gpt-image-2-thinking). Consultez la documentation officielle d'OpenAI pour les paramètres détaillés. Attention, le mode Thinking consomme davantage de jetons de raisonnement ; le coût peut être 2 à 3 fois supérieur au mode Instant.

5. Le filigrane SynthID de Nano Banana Pro affecte-t-il l'usage commercial ?

SynthID est un filigrane invisible à l'œil nu qui n'altère pas la qualité visuelle et n'entrave pas l'usage commercial. Cependant, si vos images sont destinées à des circuits de "suppression de filigrane / blanchiment de droits d'auteur", sachez que Google peut détecter la source via SynthID, ce qui pourrait poser des risques juridiques.

6. Comment réaliser des tests A/B entre les deux modèles ?

La méthode la plus efficace consiste à utiliser la même clé et la même base_url, puis à répartir le trafic selon une pondération au niveau de votre application. Utilisez l'interface unifiée d'APIYI (apiyi.com) pendant 1 à 2 semaines pour analyser les préférences des utilisateurs, le taux de téléchargement et les taux d'édition, avant de décider du modèle principal.

7. Que faire si GPT-Image-2 renvoie une erreur 400 moderation_blocked ?

Cela signifie généralement que votre invite a déclenché la politique de contenu d'OpenAI (personnalités, violence, contenu explicite, politique, etc.). Essayez : ① de réécrire l'invite pour éviter les termes sensibles ; ② de tester la même invite avec Nano Banana Pro (les politiques peuvent différer) ; ③ de consulter notre documentation dédiée aux erreurs de modération.

8. Existe-t-il d'autres concurrents à surveiller ?

En 2026, le second rang est principalement composé de : Midjourney V8 (toujours le meilleur pour le contrôle artistique), FLUX Pro 1.1 (le favori de la communauté open-source) et Imagen 4 (le candidat de nouvelle génération de Google). Cependant, selon les scores globaux de LMArena, l'écart entre GPT-Image-2/Nano Banana Pro et les autres s'est considérablement creusé.

Résumé : Le « duel des titans » des modèles d'image IA en 2026

Après une analyse comparative systématique selon 7 dimensions, nous pouvons dégager trois conclusions majeures :

- GPT-Image-2 est actuellement le modèle d'image le plus complet. Il établit une avance générationnelle en matière de rendu de texte, de mise en page, de raisonnement et de vitesse, ce qui le rend idéal pour les besoins en branding, marketing, UI et infographie.

- Nano Banana Pro reste le roi incontesté du portrait et de l'utilisation d'images de référence multiples. Il demeure irremplaçable pour le réalisme photographique, la cohérence faciale et les photos de groupe, se prêtant parfaitement aux domaines de la photographie, du e-commerce, des séries courtes et de la bande dessinée.

- Le routage hybride est la solution optimale en 2026. L'ère du choix unique est révolue ; router les requêtes vers l'un ou l'autre modèle selon le scénario permet d'obtenir le meilleur rapport qualité-prix.

Pour les développeurs et les entreprises souhaitant déployer rapidement leurs solutions sans avoir à maintenir plusieurs SDK, nous recommandons de passer par la plateforme APIYI apiyi.com pour accéder de manière unifiée à GPT-Image-2 et Nano Banana Pro. Avec une seule clé API, une seule base_url et le SDK standard OpenAI, vous pouvez basculer en toute transparence entre ces deux modèles leaders, tout en profitant de connexions stables, d'une facturation centralisée et de tarifs préférentiels.

🎯 Conseil final : Si vous n'avez encore testé aucun de ces modèles, créez un compte sur APIYI apiyi.com, testez les deux modèles sur une vingtaine d'images, puis choisissez votre orientation principale. Le prix d'un café suffit pour éviter les coûts de migration futurs liés à un mauvais choix de modèle.

Auteur : Équipe technique APIYI | apiyi.com

Date de publication : 24 avril 2026

Échanges techniques : Visitez APIYI apiyi.com pour accéder aux derniers services d'API de grands modèles de langage, avec une prise en charge unifiée des principaux fournisseurs tels qu'OpenAI, Google et Anthropic.