OpenAI a officiellement annoncé le 24 mars 2026 via une notification aux développeurs : la date de fin de vie de l'API Sora-2 est fixée au 24 septembre 2026. Cela signifie que toutes les activités de génération vidéo dépendant de sora-2, sora-2-pro et de l'API Videos doivent impérativement migrer en moins de six mois.

Il est d'autant plus crucial de rester vigilant : les soi-disant "API Sora inversées" qui circulaient ces six derniers mois sont devenues largement inutilisables suite au renforcement des contrôles de sécurité d'OpenAI. Continuer à miser sur cette voie ne fera qu'accumuler les problèmes pour votre activité. Cet article analyse en détail le calendrier de fin de vie de l'API Sora-2, son impact, et recommande deux alternatives prêtes pour la production basées sur des tests réels : SeeDance 2.0 de ByteDance et Wan 2.7 d'Alibaba Tongyi.

Si vous utilisez actuellement l'API Sora-2 pour la production de contenu vidéo, nous vous conseillons de comparer directement SeeDance 2.0 et Wan 2.7 via la plateforme APIYI (apiyi.com). Cette plateforme a déjà intégré plusieurs modèles de génération vidéo majeurs, ce qui permet de réduire considérablement vos coûts de migration.

Calendrier de fin de vie de l'API Sora-2 et périmètre d'impact

Jalons officiels de la fin de vie de l'API Sora-2

OpenAI a adopté une stratégie de fermeture en deux étapes pour ses produits Sora : les applications grand public ferment en premier, suivies par l'API professionnelle, avec une période de transition d'environ 5 mois pour les développeurs. Il s'agit de l'un des "atterrissages en douceur" les plus complets de l'histoire d'OpenAI, bien que la fenêtre de tir pour les développeurs reste très serrée.

| Date | Événement | Impact | Période de transition |

|---|---|---|---|

| 24/03/2026 | Notification officielle | Tous les utilisateurs de l'API Sora-2 | T+0 |

| 26/04/2026 | Fermeture du site et de l'App Sora | Utilisateurs finaux, créateurs | T+33 jours |

| 24/09/2026 | Fin de vie de l'API Sora-2 | Toutes les intégrations API | T+184 jours |

| Après 25/09/2026 | Erreur 410 Gone | Interruption totale des services | — |

Dans son centre d'aide, OpenAI recommande explicitement aux utilisateurs souhaitant conserver leurs vidéos générées sur Sora de les exporter avant la fermeture de l'application le 26 avril. Cependant, pour les développeurs utilisant l'API, la date couperet est bien le 24 septembre.

Il est important de noter qu'OpenAI n'a promis aucune possibilité de "prolongation". Au vu des précédentes fins de vie de modèles depuis 2025, la fermeture à la date prévue est devenue la norme ; il ne faut donc pas compter sur un report.

Liste complète des modèles impactés par la fin de vie de l'API Sora-2

De nombreuses équipes pensent que seul l'alias sora-2 sera supprimé, mais il s'agit en réalité d'un retrait global de toute la gamme de modèles de l'API Videos :

| ID du modèle | Type | État | Alternative suggérée |

|---|---|---|---|

sora-2 |

Alias standard | Supprimé | SeeDance 2.0 / Wan 2.7 |

sora-2-pro |

Alias HD | Supprimé | SeeDance 2.0 (1080p) |

sora-2-2025-10-06 |

Snapshot standard | Supprimé | SeeDance 2.0 |

sora-2-2025-12-08 |

Snapshot standard | Supprimé | SeeDance 2.0 |

sora-2-pro-2025-10-06 |

Snapshot Pro | Supprimé | Wan 2.7 (incl. Thinking Mode) |

| API Videos (ensemble) | Point de terminaison | Arrêt total | Plateforme d'agrégation |

En d'autres termes, OpenAI ne conservera aucun point d'entrée pour l'API de génération vidéo. À partir du 25 septembre, toutes les requêtes commençant par videos renverront une erreur 410 Gone ou une erreur de dépréciation. Contrairement aux modèles GPT où seuls les snapshots étaient supprimés au profit d'alias, il s'agit ici d'un retrait complet de la ligne de produits.

🎯 Information clé : Cela signifie que vous ne pouvez pas simplement "changer le nom du modèle" pour migrer ; vous devez basculer vers une API de génération vidéo totalement différente. Nous vous recommandons de terminer vos tests d'intégration avant fin juin. Vous pouvez comparer les deux candidats, SeeDance 2.0 et Wan 2.7, via une plateforme d'agrégation pour éviter le stress des deux derniers mois.

Les raisons réelles de la fin de vie de l'API Sora-2

Bien qu'OpenAI n'ait pas fourni d'explication détaillée, les analyses de médias anglophones (The Decoder, Futurum Group, Wikipedia, etc.) convergent vers trois facteurs principaux :

- Coûts de calcul non durables : Le coût en GPU pour une seule génération vidéo est des dizaines de fois supérieur à celui d'un modèle textuel, et les revenus commerciaux ne couvrent pas ces dépenses. Après le lancement de Sora-2, OpenAI a dû limiter strictement les quotas par utilisateur, ce qui a freiné l'intérêt des développeurs.

- Risques élevés liés à la sécurité du contenu : Malgré l'ajout de filigranes et la modération, Sora a été impliqué dans plusieurs controverses liées aux deepfakes et aux droits d'auteur, rendant les coûts juridiques et de conformité prohibitifs.

- Recentrage stratégique : OpenAI privilégie désormais ses ressources de calcul pour ses activités principales : GPT, Operator et les agents. La vidéo n'est plus une priorité stratégique.

Comprendre ces raisons est essentiel pour choisir une alternative. Les entreprises qui continuent d'investir dans la génération vidéo sont celles pour qui ce domaine est un axe stratégique majeur. ByteDance et Alibaba considèrent tous deux la génération vidéo comme un pilier stratégique, ce qui explique pourquoi leur rythme d'itération est bien plus rapide que celui d'OpenAI et pourquoi elles sont en mesure de reprendre la base d'utilisateurs de Sora-2 en 2026.

title: "Pourquoi l'API Sora « inversée » n'est plus une option viable"

description: "Découvrez pourquoi les API Sora inversées sont obsolètes en 2026 et comment migrer vers des solutions performantes comme SeeDance 2.0."

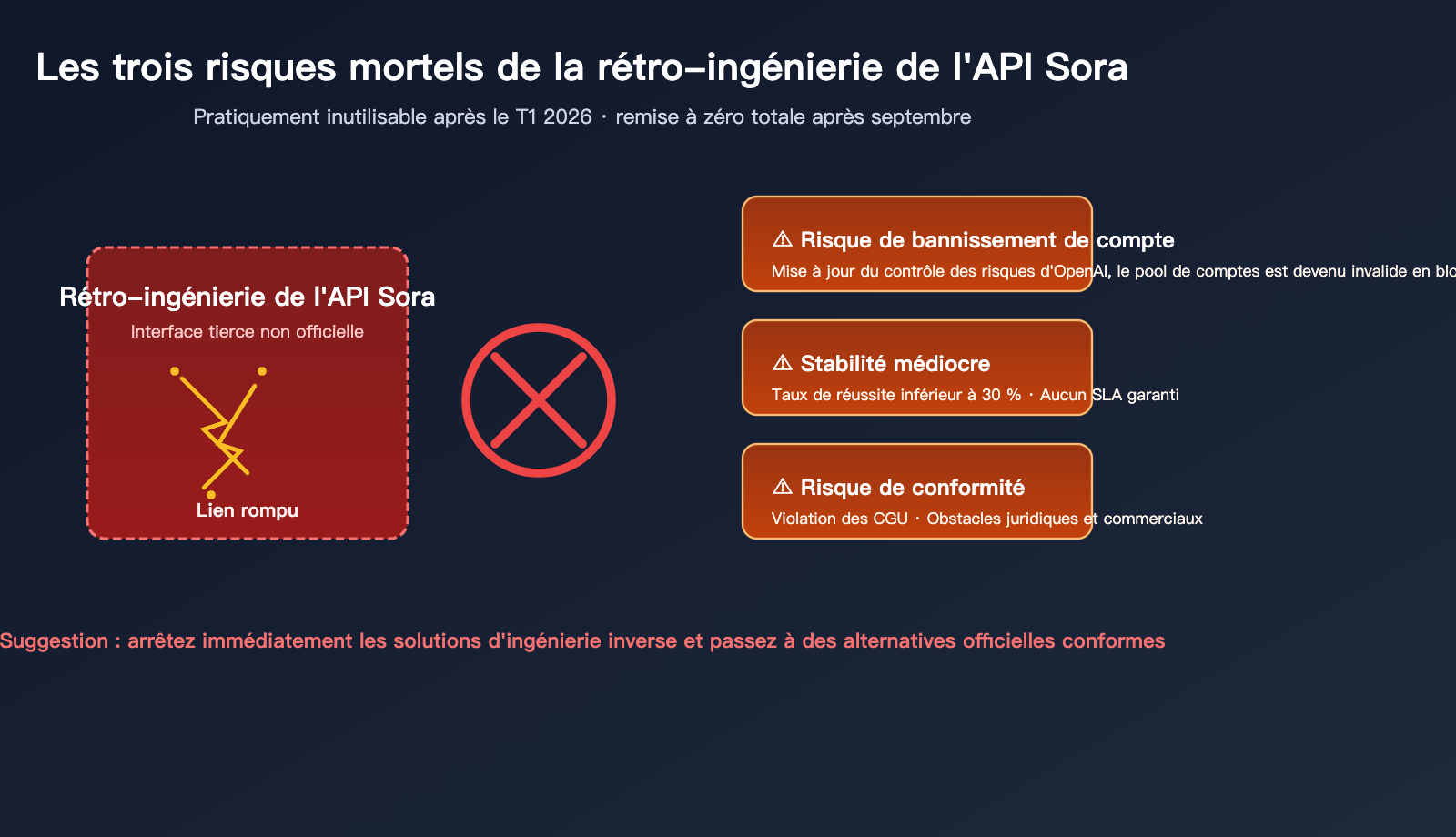

Pourquoi l'API Sora « inversée » n'est plus une option viable

État des lieux de l'API Sora inversée en 2026

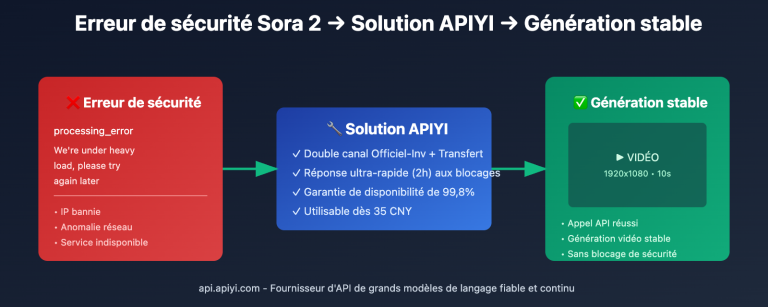

Au cours du dernier semestre, de nombreuses interfaces « inversées » prétendant permettre l'invocation du modèle Sora-2 sans compte OpenAI ont circulé, avec des tarifs bien inférieurs à ceux officiels. Cependant, selon les retours d'expérience de nombreuses communautés de développeurs, ces interfaces sont devenues pratiquement inutilisables depuis le premier trimestre 2026 :

- En janvier 2026, OpenAI a mis à jour ses règles de contrôle Cloudflare, entraînant des erreurs 403 systématiques pour la plupart des interfaces inversées.

- Certains fournisseurs de services utilisaient des pools de comptes, mais le renforcement des mesures d'OpenAI contre les comptes suspects a rendu ces pools inopérants.

- Même lorsqu'elles fonctionnent, la vitesse de génération est extrêmement lente et le taux de réussite est inférieur à 30 %, ce qui les rend inexploitables en production.

- De plus en plus de fournisseurs « disparaissent » ou se reconvertissent, faisant courir un risque de perte totale sur les soldes prépayés.

Plus important encore, puisque OpenAI a décidé de mettre fin à son API officielle le 24 septembre, la source même de ces interfaces inversées disparaîtra. Cette voie sera totalement fermée après septembre.

3 raisons d'arrêter d'investir dans les solutions inversées

| Dimension de risque | Manifestation concrète | Conséquence métier |

|---|---|---|

| Stabilité | Interfaces bloquées sans préavis, aucun SLA | Interruptions de production |

| Conformité | Violation des CGU d'OpenAI, risques liés à l'achat de comptes | Blocage des partenariats juridiques et commerciaux |

| Coûts irrécupérables | Arrêt officiel en septembre, obsolescence immédiate | Gaspillage de ressources pour une re-migration |

| Données | Accès possible aux invites et contenus par des tiers | Fuite de secrets commerciaux |

⚠️ Recommandation forte : Si votre équipe utilise encore une forme quelconque d'API Sora inversée, arrêtez immédiatement tout nouveau développement et donnez la priorité à l'évaluation d'alternatives officielles et conformes. Nous recommandons d'accéder directement à SeeDance 2.0 ou Wan 2.7 via des plateformes d'agrégation conformes, garantissant ainsi la stabilité du service et évitant les problèmes de conformité.

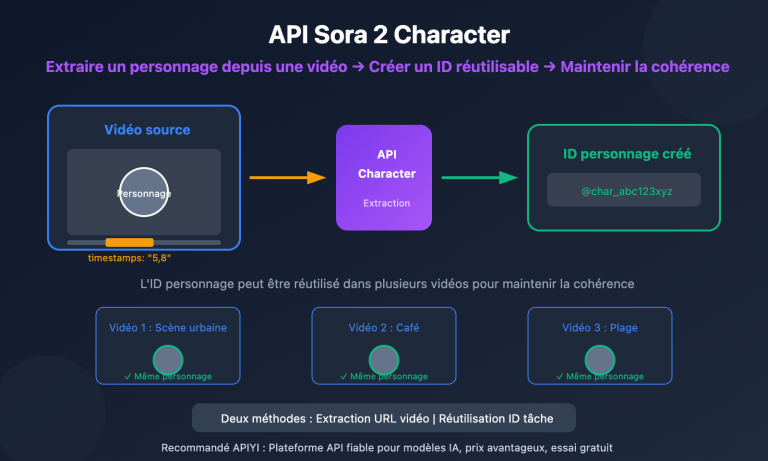

Alternative à l'API Sora-2 : SeeDance 2.0

Positionnement de SeeDance 2.0

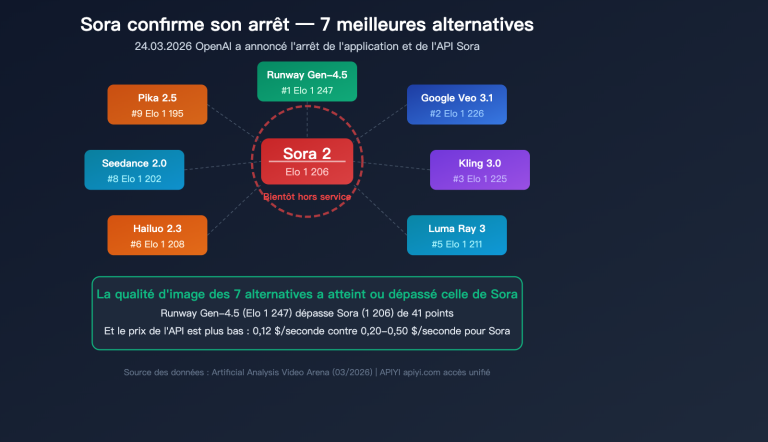

SeeDance 2.0 est le modèle phare de génération vidéo lancé officiellement par l'équipe de grands modèles de langage de ByteDance (Doubao) le 9 février 2026. Il a été ouvert en bêta publique sur la plateforme BytePlus ModelArk le 14 avril et est disponible via fal depuis le 9 avril. Dans le classement des modèles vidéo d'Artificial Analysis, SeeDance 2.0 a obtenu un score Elo de 1269, dépassant Google Veo 3, OpenAI Sora 2 et Runway Gen-4.5, se hissant à la première place des classements publics.

Sa principale différence réside dans son architecture unifiée de génération multimodale audio-vidéo : il n'est pas nécessaire de générer la vidéo puis d'ajouter l'audio. Le modèle produit en une seule inférence jusqu'à 15 secondes de contenu audiovisuel de qualité cinématographique. Cette capacité de « synchronisation native » est inégalée par Sora-2, qui nécessite une étape de TTS séparée.

Capacités clés de SeeDance 2.0

| Capacité | Performance de SeeDance 2.0 | Comparaison avec Sora-2 |

|---|---|---|

| Durée max par génération | 15 secondes | Égalité |

| Audio synchronisé | Génération native unifiée | Sora-2 nécessite un TTS externe |

| Modalités d'entrée | Texte / Image / Audio / Vidéo | Sora-2 (Texte + Image seulement) |

| Contrôle de caméra | Instructions de réalisation avancées | Sora-2 (plus limité) |

| Réalisme physique | Leader du secteur | Égalité |

| Artificial Analysis Elo | 1269 (n°1) | ~1180 |

| Canaux d'accès publics | BytePlus ModelArk / fal / Plateformes d'agrégation | OpenAI (bientôt arrêté) |

| Compréhension des invites | Excellente | Moyenne |

SeeDance 2.0 est actuellement disponible en test interne via la plateforme APIYI (apiyi.com). Si vous cherchez une alternative à Sora-2, vous pouvez contacter le service client de la plateforme pour obtenir un quota d'essai et utiliser le protocole compatible OpenAI pour vos invocations.

Exemple d'invocation de SeeDance 2.0

Voici un exemple minimaliste pour invoquer SeeDance 2.0 via l'interface compatible OpenAI :

from openai import OpenAI

# Initialisation du client avec l'URL de base APIYI

client = OpenAI(

api_key="votre-clé-api",

base_url="https://api.apiyi.com/v1"

)

# Invocation du modèle

response = client.videos.generate(

model="seedance-2.0",

prompt="Un chat roux saute du rebord de la fenêtre sur le canapé, le soleil du crépuscule filtre à travers les stores, la caméra suit le chat avec un mouvement lent",

duration=10,

audio=True,

aspect_ratio="16:9"

)

print(response.video_url)

📌 Exemple complet (avec gestion des erreurs et polling)

import time

from openai import OpenAI

client = OpenAI(

api_key="votre-clé-api",

base_url="https://api.apiyi.com/v1"

)

def generate_seedance_video(prompt: str, duration: int = 10):

try:

# Lancement de la tâche

task = client.videos.generate(

model="seedance-2.0",

prompt=prompt,

duration=duration,

audio=True,

aspect_ratio="16:9",

resolution="1080p"

)

# Boucle de vérification du statut

while True:

status = client.videos.retrieve(task.id)

if status.state == "completed":

return status.video_url

elif status.state == "failed":

raise RuntimeError(f"Échec de la tâche : {status.error}")

time.sleep(5)

except Exception as e:

print(f"Erreur lors de l'invocation : {e}")

return None

url = generate_seedance_video(

prompt="Un bus à impériale rouge rétro traverse les rues de Londres après la pluie, les reflets des réverbères se reflètent sur les vitres",

duration=12

)

print(url)

Scénarios d'utilisation de SeeDance 2.0

- Courts-métrages de marque : Audio natif synchronisé et mouvements de caméra cinématographiques, idéal pour les publicités.

- Création multimodale : Supporte l'audio et la vidéo comme références d'entrée, parfait pour le contenu dérivé d'IP.

- Cohérence faciale : Excellentes capacités de référence multimodale, adapté à la production de séries.

- Réseaux sociaux internationaux : Sorties natives en 16:9, 9:16 et 1:1, adaptées directement à TikTok, YouTube et Instagram.

- Clips musicaux : La génération conjointe audio-vidéo permet un alignement naturel entre le rythme de la musique et les images.

Alternative à l'API Sora-2 : Wan 2.7

Positionnement stratégique de Wan 2.7

Wan 2.7 est un modèle de génération vidéo de nouvelle génération lancé par le laboratoire Tongyi d'Alibaba en mars 2026. Basé sur une architecture MoE (Mixture-of-Experts) de 27 milliards de paramètres, il utilise les technologies Diffusion Transformer et Flow Matching. Déjà disponible via les plateformes Alibaba Cloud DashScope et WaveSpeedAI, il s'agit du premier modèle vidéo MoE chinois à proposer une API publique.

Contrairement à SeeDance 2.0 qui mise sur la fusion multimodale, les deux arguments de vente uniques de Wan 2.7 sont : le Thinking Mode (mode réflexion) et le contrôle précis des images de début et de fin. Il peut "réfléchir" à la structure du plan avant de générer la vidéo et permet de spécifier simultanément les images clés de début et de fin, deux capacités absentes de l'API Sora-2 actuelle.

Aperçu des capacités clés de Wan 2.7

| Dimension | Performance Wan 2.7 | Comparaison Sora-2 |

|---|---|---|

| Architecture | 27B MoE | Non divulgué |

| Durée max par requête | 15 secondes | Équivalent |

| Résolution max | 1080p | Équivalent |

| Thinking Mode | ✅ Supporté (planification) | ❌ Non supporté |

| Contrôle début/fin | ✅ Début + Fin spécifiables | ❌ Début uniquement |

| Référence 9 grilles | ✅ Jusqu'à 9 images | ❌ Non supporté |

| Référence sujet + voix | ✅ Supporté | ❌ Non supporté |

| Limite de caractères (invite) | 5000 caractères | ~1000 caractères |

| Canaux d'appel | DashScope / WaveSpeedAI / Agrégateurs | OpenAI (bientôt hors service) |

| Tarif de référence | À partir de 0,10 $/s | À partir de 0,50 $/s |

🎯 Conseils d'utilisation : Si vos projets de génération vidéo exigent un contrôle strict des images de début et de fin (comme pour des intros/outros de marque ou des comptes à rebours publicitaires), la capacité de contrôle de Wan 2.7 est irremplaçable par Sora-2. Il est recommandé d'utiliser une plateforme agrégatrice pour appeler Wan 2.7, ce qui vous évite de gérer manuellement le SDK et les mécanismes de signature d'Alibaba Cloud.

Exemple d'appel pour Wan 2.7

from openai import OpenAI

# Utilisation via un service proxy API comme APIYI

client = OpenAI(

api_key="votre-cle-api",

base_url="https://api.apiyi.com/v1"

)

response = client.videos.generate(

model="wan-2.7",

prompt="Rues néon style cyberpunk, la caméra s'élève lentement du sol pour surplomber toute la ville",

first_frame_url="https://example.com/start.png",

last_frame_url="https://example.com/end.png",

thinking_mode=True,

duration=10

)

print(response.video_url)

📌 Exemple complet avec références multiples (grille de 9 + Thinking Mode)

from openai import OpenAI

client = OpenAI(

api_key="votre-cle-api",

base_url="https://api.apiyi.com/v1"

)

# Liste de 9 images de référence

reference_images = [

f"https://example.com/ref{i}.png" for i in range(1, 10)

]

response = client.videos.generate(

model="wan-2.7",

prompt=(

"Le protagoniste traverse 9 scènes différentes,"

"chaque scène correspond à une image de référence,"

"l'apparence et les vêtements du personnage restent cohérents."

),

reference_images=reference_images,

thinking_mode=True,

duration=15,

resolution="1080p",

audio=True

)

print(response.video_url)

Cas d'usage pour Wan 2.7

- Intros et outros de marque : Contrôle précis des images de début et de fin sans post-production.

- Cohérence des personnages : Utilisation de la grille de 9 images de référence pour éviter la dérive du personnage entre les plans.

- Plans complexes : Le Thinking Mode planifie automatiquement la structure, idéal pour les courts-métrages et la publicité.

- Édition par instructions : Supporte l'édition de vidéos existantes via des instructions en langage naturel.

- Narration séquentielle : Génération de vidéos cohérentes à partir de plusieurs images clés.

Voici une analyse comparative et un guide de migration pour vos besoins en génération vidéo.

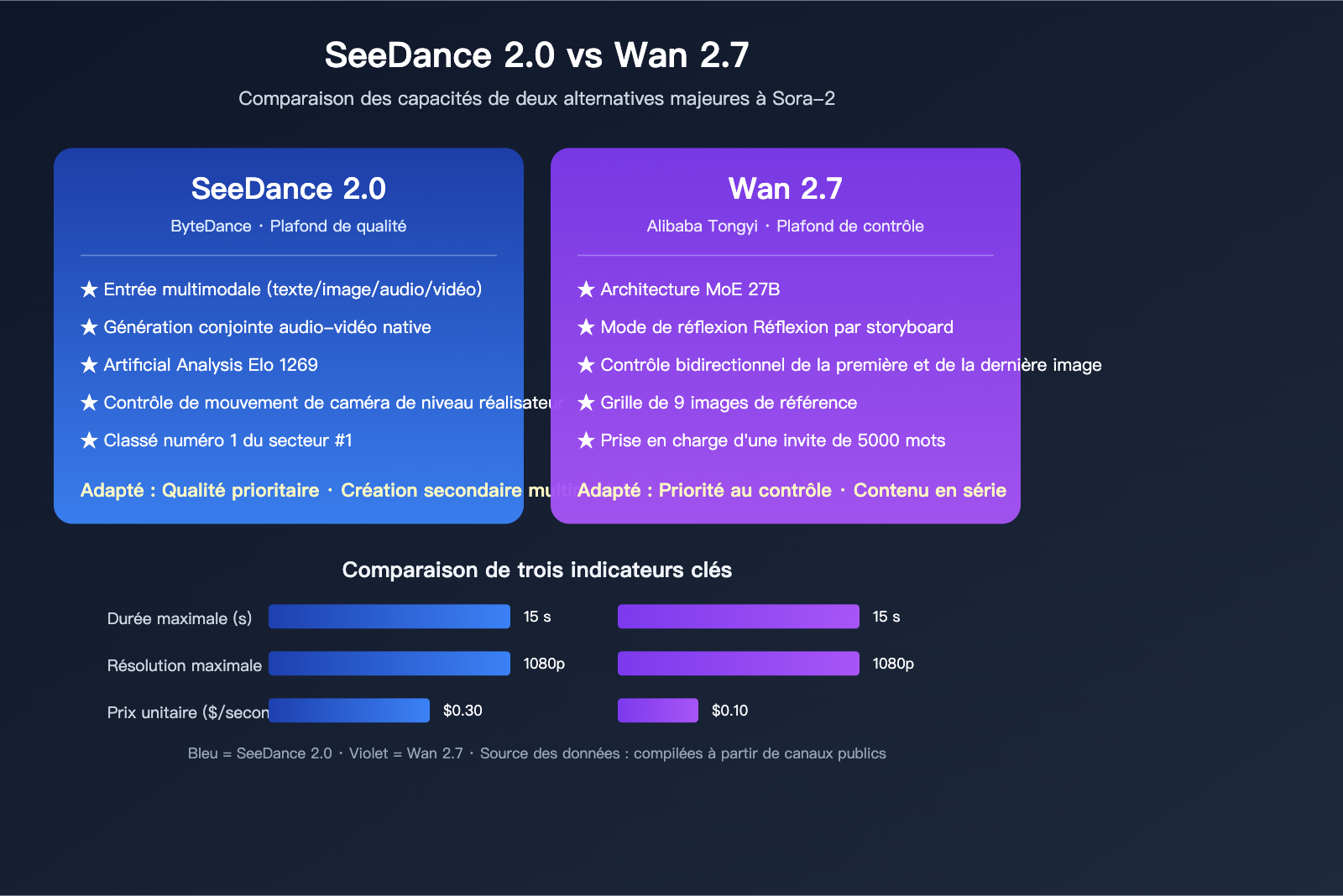

Comparaison : SeeDance 2.0 vs Wan 2.7 vs Sora-2

Comparaison des indicateurs clés des trois modèles

| Dimension de comparaison | Sora-2 (bientôt obsolète) | SeeDance 2.0 | Wan 2.7 |

|---|---|---|---|

| Fournisseur | OpenAI | ByteDance | Alibaba Tongyi |

| Date de sortie | Octobre 2025 | 09/02/2026 | Mars 2026 |

| État du service | Obsolète le 24/09/2026 | Bêta publique | Bêta publique |

| Durée maximale | 15s | 15s | 15s |

| Résolution max. | 1080p | 1080p | 1080p |

| Audio natif | ✅ | ✅ (génération conjointe) | ✅ |

| Entrée multimodale | Texte+Image | Texte+Image+Audio+Vidéo | Texte+Multi-images réf. |

| Contrôle début/fin | ❌ | ❌ | ✅ Bidirectionnel |

| Mode réflexion | ❌ | ❌ | ✅ |

| Elo Artificial Analysis | ~1180 | 1269 (#1) | Non classé |

| Support du chinois | Moyen | Excellent | Excellent |

| Conformité locale | ❌ | ✅ | ✅ |

| Prix indicatif | 0,50 $/s | 0,30 $/s | À partir de 0,10 $/s |

Recommandations de sélection par scénario

| Scénario métier | Solution privilégiée | Raison |

|---|---|---|

| Publicité vidéo courte | SeeDance 2.0 | Audio synchrone + mouvements de caméra cinématographiques |

| Séries / Contenu sérialisé | Wan 2.7 | Grille de 9 références pour la cohérence faciale |

| Personnalisation intro/outro | Wan 2.7 | Contrôle précis des images de début et de fin |

| Création multimodale | SeeDance 2.0 | Supporte les entrées audio et vidéo de référence |

| Génération via texte chinois | Les deux | Compréhension du chinois supérieure à Sora-2 |

| Qualité maximale | SeeDance 2.0 | N°1 sur Artificial Analysis |

| Optimisation des coûts | Wan 2.7 | À partir de 0,10 $/s, avantage prix net |

| Réseaux sociaux internationaux | SeeDance 2.0 | Sorties natives multi-formats |

| Vidéo e-commerce | Wan 2.7 | Référence du sujet pour une image produit constante |

💡 Conseil de sélection : Si vous ne devez en choisir qu'un à court terme, SeeDance 2.0 est idéal pour la "qualité prioritaire", tandis que Wan 2.7 excelle dans le "contrôle prioritaire" et la "gestion des coûts". Il est recommandé d'activer les deux modèles sur une plateforme d'agrégation pour router dynamiquement vos requêtes selon le besoin métier.

Estimation des coûts (10 secondes de vidéo 1080p)

| Modèle | Coût estimé par unité | Coût mensuel (10k unités) | Remarques |

|---|---|---|---|

| Sora-2 | ~5,00 $ | ~50 000 $ | Inutilisable après septembre |

| SeeDance 2.0 | ~3,00 $ | ~30 000 $ | Audio natif inclus |

| Wan 2.7 | ~1,00 $ | ~10 000 $ | Prix d'entrée |

Note : Données basées sur des sources publiques. Les tarifs réels dépendent des mises à jour des fournisseurs. L'utilisation via une plateforme d'agrégation offre souvent des remises supplémentaires.

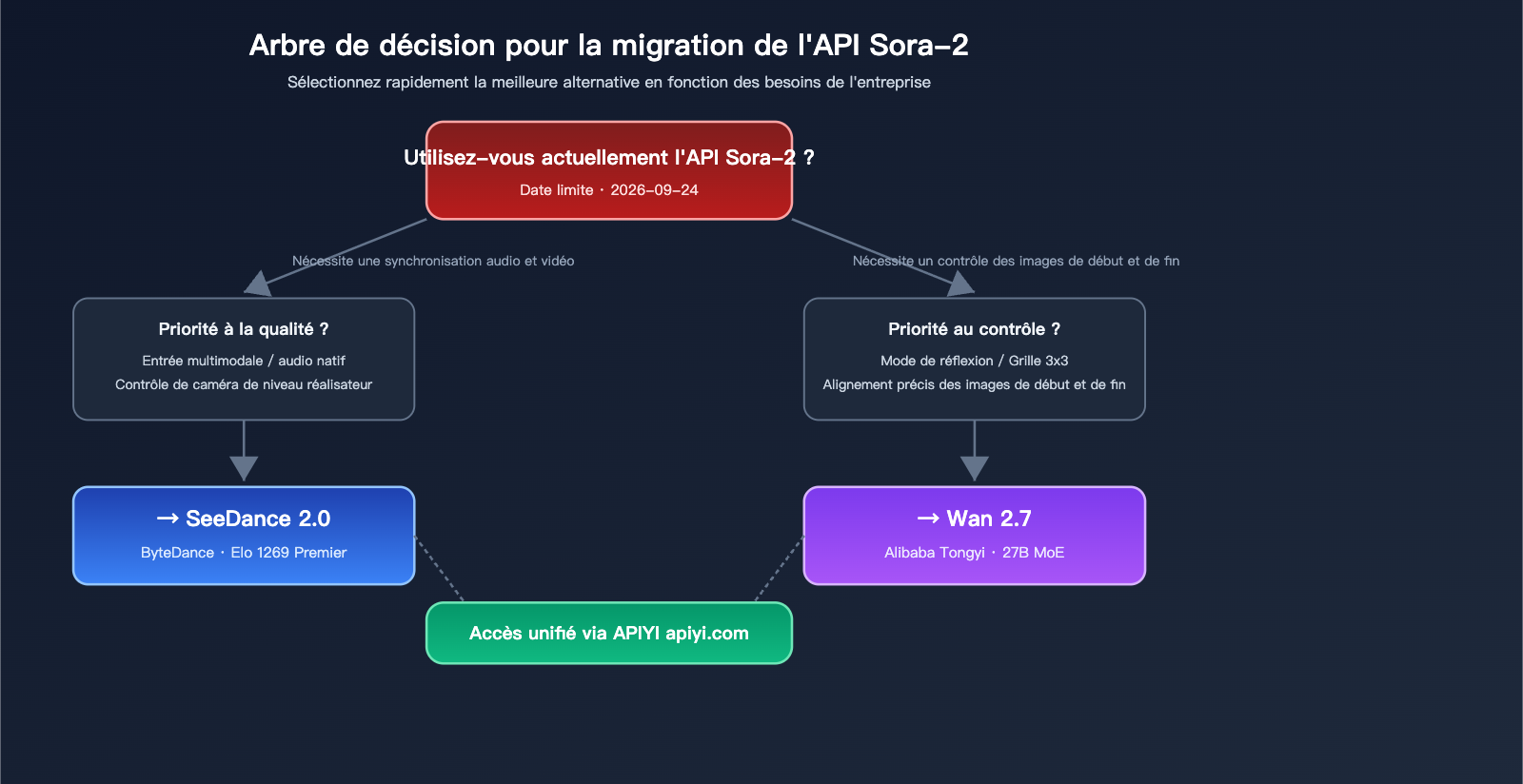

Démarrage rapide : Migration de l'API Sora-2 vers des alternatives

Arbre de décision pour la migration

La migration de l'API Sora-2 se décompose en 4 étapes :

- Inventaire des appels Sora-2 : Identifiez tous les chemins de code utilisant

sora-2ou l'API Vidéos, listez les modèles d'invites, les paramètres d'entrée et la logique de traitement de sortie. - Sélection du modèle cible : Déterminez le modèle principal selon les recommandations ci-dessus.

- Remplacement de

base_urlet du nom du modèle : Remplacez l'URL de base d'OpenAI par celle de la plateforme d'agrégation (ex:https://api.apiyi.com/v1) et mettez à jour le nom du modèle parseedance-2.0ouwan-2.7. - Tests de régression : Exécutez une série d'invites représentatives pour valider la chaîne complète et comparer la qualité et la latence.

Intégration via une plateforme d'agrégation

from openai import OpenAI

# Utilisation de la plateforme d'agrégation APIYI

client = OpenAI(

api_key="votre-clé-api",

base_url="https://api.apiyi.com/v1"

)

def generate_video(prompt: str, prefer: str = "seedance"):

# Sélection dynamique du modèle

model = "seedance-2.0" if prefer == "seedance" else "wan-2.7"

return client.videos.generate(

model=model,

prompt=prompt,

duration=10,

audio=True

)

video_a = generate_video("Publicité produit : enceinte intelligente jouant de la musique", prefer="seedance")

video_b = generate_video("Intro de marque : logo apparaissant dans des reflets lumineux", prefer="wan")

L'avantage est d'utiliser un seul SDK, une seule clé API et une seule base_url. Une fois Sora-2 retiré le 24 septembre, il vous suffira de changer le nom du modèle dans votre code.

Liste de contrôle pour la migration

| Phase | Tâche | Durée estimée |

|---|---|---|

| Inventaire | Lister tous les points d'entrée Sora-2 | 0,5 jour |

| Inventaire | Préparer 50-100 invites représentatives | 1 jour |

| Intégration | Demander un compte et des quotas sur la plateforme | 0,5 jour |

| Intégration | Modifier base_url et le champ model |

1 jour |

| Test | Exécuter les tests de régression | 2-3 jours |

| Test | Évaluation qualité par l'équipe produit/design | 1 semaine |

| Déploiement | Basculer 10-30% du trafic | 1 semaine |

| Déploiement | Basculer à 100% | — |

| Finalisation | Supprimer le code lié à Sora-2 | 0,5 jour |

🎯 Conseil : Ne tardez pas. Activez dès maintenant votre compte sur la plateforme d'agrégation pour effectuer des tests en parallèle et comparer les résultats avec vos données réelles.

Contrôle des coûts durant la migration

- Stratégie de dégradation : Testez en 720p / 5s avant de passer au 1080p / 15s.

- Mise en cache : Utilisez le hachage de contenu pour les invites identiques afin d'éviter les générations redondantes.

- Facturation groupée : Évitez les seuils de consommation minimale en centralisant vos appels.

- Génération par lots : Utilisez le mode "batch" pour les traitements nocturnes (réductions de 30-50%).

- Optimisation des invites : Des invites plus précises réduisent le besoin de régénération (économie de 20-40%).

Pièges courants et solutions

| Problème | Cause | Solution |

|---|---|---|

| Ratio de sortie incohérent | aspect_ratio par défaut différent |

Spécifier explicitement le paramètre |

| Différence de durée | Facturation à la seconde | Spécifier duration selon le besoin |

| Audio manquant | Interfaces audio différentes | Activer explicitement audio=True |

| Dérive de style | Préférences de modèle différentes | Optimiser les invites pour chaque modèle |

| Mécanisme de rappel | Support limité au polling | Utiliser les webhooks de la plateforme |

FAQ : Questions fréquentes sur l'arrêt de l'API Sora-2

Q1 : Après l'arrêt de l'API Sora-2, les vidéos déjà générées seront-elles toujours accessibles ?

Oui. Les fichiers vidéo eux-mêmes, une fois téléchargés en local ou sur un stockage objet (OSS), ne sont pas affectés par l'arrêt de l'API. Cependant, si vous faisiez référence directement aux video_url renvoyés par OpenAI, ces liens cesseront de fonctionner après l'arrêt de l'API. Il est impératif de transférer toutes vos vidéos vers votre propre stockage objet avant le 24 septembre. Si le volume est important, vous pouvez utiliser les capacités de proxy vidéo de la plateforme APIYI (apiyi.com) pour effectuer des téléchargements par lots ; la plateforme gère automatiquement la limitation de débit et les tentatives de reconnexion en cas d'échec.

Q2 : OpenAI lancera-t-il une API Sora-3 à l'avenir ?

OpenAI n'a fourni aucun calendrier pour Sora-3. D'un point de vue stratégique, OpenAI donne actuellement la priorité à ses ressources de calcul pour sa gamme GPT et ses activités d'agents. La probabilité d'une réouverture d'une API de génération vidéo à court terme est faible. Les analyses de Wikipedia et du Futurum Group soulignent également que le manque de résultats commerciaux de Sora est la raison principale de cet arrêt. Il est conseillé de ne pas baser votre planification métier sur l'idée que "Sora-3 reviendra peut-être" et de finaliser votre migration vers SeeDance 2.0 ou Wan 2.7.

Q3 : SeeDance 2.0 et Wan 2.7 peuvent-ils être appelés de manière stable depuis la Chine continentale ?

Oui. Ces deux modèles sont respectivement exploités par ByteDance et Alibaba, avec des nœuds de service situés en Chine. La stabilité réseau est bien supérieure aux appels transfrontaliers vers OpenAI. Si vous deviez utiliser des proxys ou des serveurs étrangers pour Sora-2, votre architecture réseau pourra être simplifiée après la migration vers ces modèles. L'utilisation d'une plateforme d'agrégation nationale conforme permet de résoudre simultanément les problèmes de stabilité et de conformité fiscale (facturation).

Q4 : L'ingénierie inverse de l'API Sora a-t-elle encore une valeur de transition ?

Non, ce n'est pas recommandé. La stabilité des API inversées a chuté drastiquement après le premier trimestre 2026, et après septembre, la source officielle disparaissant, les interfaces inversées deviendront inévitablement totalement inopérantes. Continuer à investir dans des solutions d'ingénierie inverse revient à superposer du nouveau code sur une pile technologique vouée à disparaître, ce qui ne fera qu'augmenter les coûts de migration. L'approche la plus économique est une migration directe vers SeeDance 2.0 ou Wan 2.7.

Q5 : Comment évaluer l'efficacité réelle des alternatives lors de la migration ?

Nous recommandons une évaluation tridimensionnelle : qualité visuelle (score subjectif), respect de l'invite (comparaison objective) et coût unitaire (analyse financière). Concrètement, extrayez 50 invites représentatives de vos appels historiques Sora-2, testez-les sur SeeDance 2.0 et Wan 2.7, et faites réaliser une évaluation en aveugle par votre équipe produit. Il est conseillé d'utiliser une plateforme d'agrégation pour ces tests afin de bénéficier d'une facturation et de journaux unifiés, facilitant ainsi le choix le plus adapté à votre activité.

Q6 : Les spécifications de l'interface API changeront-elles après la migration vers une plateforme d'agrégation ?

Les plateformes d'agrégation adoptent généralement un protocole compatible avec OpenAI, ce qui signifie que votre structure de code actuelle pour Sora-2 peut être conservée en grande partie. Il suffit de modifier les champs base_url et model. Les paramètres de requête liés à la génération vidéo (invite, durée, audio, résolution, etc.) varient légèrement d'un modèle à l'autre ; la plateforme d'agrégation se chargera de l'alignement des paramètres. Consultez la documentation de la plateforme pour les détails spécifiques.

Q7 : Dois-je migrer immédiatement ou attendre septembre ?

Nous recommandons vivement de commencer les tests immédiatement et de terminer la migration avant fin juin. Pour trois raisons :

- Plus on se rapproche du 24 septembre, plus les utilisateurs de Sora-2 se bousculeront, saturant les ressources des plateformes d'agrégation et des modèles alternatifs.

- Une migration anticipée permet de comparer sereinement les deux alternatives, évitant les changements précipités.

- Les développeurs qui migrent tôt bénéficient généralement de meilleurs quotas d'essai et de tarifs préférentiels.

Q8 : SeeDance 2.0 ou Wan 2.7, lequel est le plus adapté aux invites en chinois ?

Les deux sont nettement supérieurs à Sora-2 en termes de compréhension du chinois. SeeDance 2.0 est plus nuancé dans l'expression des émotions et la description des actions en chinois. Wan 2.7, grâce à son support des invites longues (5000 caractères) et son "Thinking Mode", est plus stable dans les scénarios narratifs complexes. Si vos invites font généralement moins de 200 caractères, choisissez SeeDance 2.0 ; si vous devez décrire des plans complexes, optez pour Wan 2.7.

Q9 : Comment garantir l'absence d'interruption de service pendant la migration ?

La méthode la plus sûre est le double écriture/double lecture : pendant la transition, appelez simultanément Sora-2 et le modèle cible, enregistrez les deux sorties et gérez le basculement côté front-end (A/B testing). Ainsi, en cas de problème avec le modèle cible, vous pouvez immédiatement revenir à Sora-2 (avant le 24 septembre), minimisant ainsi les risques. Les plateformes d'agrégation supportent généralement le routage dynamique basé sur le champ model, rendant le coût du double flux très faible.

Conclusion : Le meilleur chemin après l'arrêt de l'API Sora-2

OpenAI a fixé la date d'arrêt de l'API Sora-2 au 24 septembre 2026, laissant moins de six mois à toutes les activités basées sur la génération vidéo. L'ingénierie inverse, autrefois "solution de transition bon marché", a perdu toute valeur face au renforcement du contrôle des risques et à l'arrêt officiel. Continuer à y investir ne fera qu'accumuler les coûts de migration.

Heureusement, le secteur de la génération vidéo en 2026 présente un paysage multipolaire sain : SeeDance 2.0 s'impose comme la référence en termes de qualité avec un score Elo de 1269 sur Artificial Analysis, excellent pour les entrées multimodales et la génération native audio-vidéo ; Wan 2.7 se distingue par son "Thinking Mode" et son contrôle des images de début et de fin, idéal pour les scénarios nécessitant une précision visuelle rigoureuse. Les deux solutions sont nettement supérieures à Sora-2 pour le support du chinois, la conformité locale et la stabilité.

Notre conseil : Ne mettez pas tous vos œufs dans le même panier. Utilisez la plateforme APIYI (apiyi.com) pour accéder simultanément à SeeDance 2.0 et Wan 2.7, et routez dynamiquement vos requêtes selon vos besoins : le contenu privilégiant la qualité vers SeeDance 2.0, et les visuels nécessitant un contrôle précis vers Wan 2.7. Cette architecture bi-modèle garantit la stabilité durant la migration et permet une transition fluide après septembre.

Le point crucial : Commencez maintenant. Attendre août ou septembre rendra l'adaptation des modèles, l'optimisation des invites et les demandes de quotas beaucoup plus difficiles. Lancez vos tests PoC cette semaine, clonez votre code actuel et utilisez vos données métier réelles pour piloter vos décisions, afin de garantir que votre solution alternative fonctionne de manière stable depuis au moins deux mois lors de l'arrêt définitif du 24 septembre.

Auteur : Équipe APIYI — Spécialistes du proxy API pour grands modèles de langage et services d'agrégation de modèles de génération vidéo.