Le modèle de génération d'images de nouvelle génération d'OpenAI, GPT Image 2, est entré en phase de test bêta. Trois modèles portant des noms de code (maskingtape/gaffertape/packingtape) ont été repérés lors d'évaluations anonymes sur le Chatbot Arena. Bien qu'il n'ait pas encore été officiellement lancé, les informations qui ont fuité suggèrent que GPT Image 2 repose sur une toute nouvelle architecture indépendante, promettant des avancées majeures en matière de rendu de texte, de résolution, de support multilingue et de cohérence faciale.

Valeur ajoutée : Découvrez en 3 minutes les dernières infos sur GPT Image 2, les améliorations attendues et l'évolution complète de la gamme de génération d'images d'OpenAI, de DALL-E à GPT Image.

Aperçu rapide de GPT Image 2

GPT Image 2 est actuellement en phase de test bêta et l'API n'a pas encore été officiellement publiée. Les informations ci-dessous proviennent d'évaluations sur l'Arena et d'analyses diverses ; elles n'ont pas été confirmées officiellement par OpenAI.

| Élément | Détails |

|---|---|

| État actuel | En test bêta, non publié officiellement |

| Nom de code Arena | maskingtape-alpha / gaffertape-alpha / packingtape-alpha |

| Architecture | Nouvelle architecture indépendante, non dérivée de GPT-4o |

| Résolution attendue | 4K natif (2048×2048 ou 4096×4096) |

| Rendu de texte | Précision attendue > 99 %, support des langues non latines (CJK, arabe, etc.) |

| Vitesse de génération | Estimée à moins de 3 secondes |

| Lancement prévu | Mi-2026 à fin 2026 |

Analyse des 3 noms de code

Lors des évaluations anonymes sur le Chatbot Arena, trois noms de code de modèles d'image inédits sont apparus :

| Nom de code | Analyse |

|---|---|

| maskingtape-alpha | "Ruban de masquage" — suggère potentiellement une amélioration des capacités d'édition locale ou de masquage |

| gaffertape-alpha | "Ruban adhésif professionnel" — pourrait correspondre à une variante de niveau professionnel/haut de gamme |

| packingtape-alpha | "Ruban d'emballage" — pourrait correspondre à une variante pour la génération par lots |

Les trois noms de code utilisent le thème du "ruban" (tape), et le suffixe "alpha" indique qu'ils sont à un stade précoce de test. Certains utilisateurs de ChatGPT ont déjà pu tester ces nouveaux modèles de manière aléatoire.

🎯 Conseil technique : Dès la sortie officielle de GPT Image 2, les développeurs pourront y accéder immédiatement via la plateforme APIYI (apiyi.com). La plateforme prend déjà en charge toute la gamme des modèles GPT Image 1.5 et sera rapidement adaptée pour les nouveaux modèles.

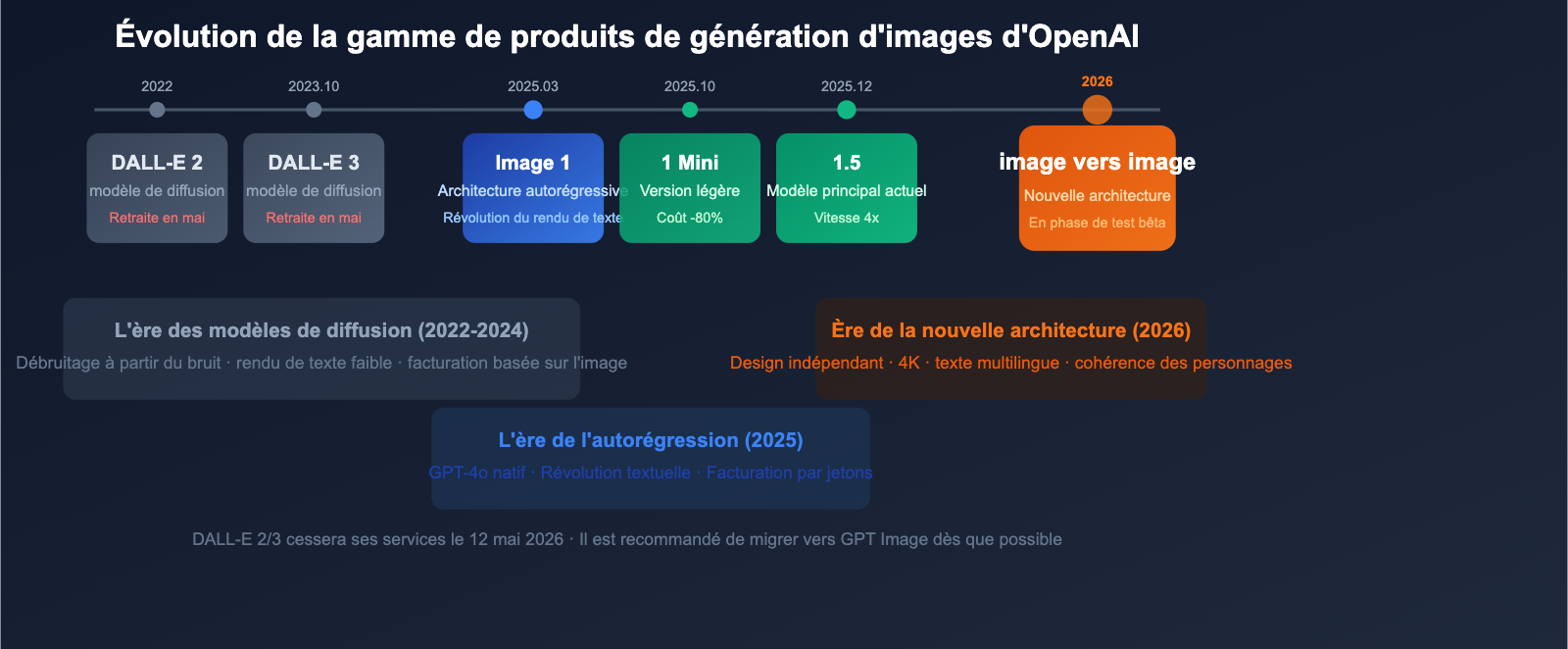

Évolution complète de la gamme de produits GPT Image

Pour bien comprendre le positionnement de GPT Image 2, il est essentiel de saisir l'évolution complète de la gamme de produits de génération d'images d'OpenAI.

Chronologie de la gamme de produits

| Modèle | Date de sortie | Architecture | Caractéristiques clés |

|---|---|---|---|

| DALL-E 2 | 2022 | Modèle de diffusion | Génération d'images par IA pionnière |

| DALL-E 3 | Octobre 2023 | Modèle de diffusion | Amélioration majeure de la compréhension des invites |

| GPT Image 1 | Mars/Avril 2025 | Autorégressif (natif GPT-4o) | Rendu de texte révolutionnaire, édition d'images |

| GPT Image 1 Mini | Octobre 2025 | Autorégressif (léger) | Réduction des coûts de 80 % |

| GPT Image 1.5 | Décembre 2025 | Autorégressif (optimisé) | Vitesse multipliée par 4, correction des dérives colorimétriques |

| GPT Image 2 | 2026 (prévu) | Nouvelle architecture indépendante | 4K / Texte multilingue / Cohérence faciale |

Transition architecturale : Du modèle de diffusion de DALL-E au modèle autorégressif de GPT Image 1, jusqu'à la toute nouvelle architecture indépendante de GPT Image 2, OpenAI a opéré des changements structurels majeurs à chaque génération de produits.

Compte à rebours pour la fin de la série DALL-E

OpenAI a annoncé que DALL-E 2 et DALL-E 3 cesseront de fonctionner le 12 mai 2026. Cela signifie que toutes les applications dépendant de l'API DALL-E doivent migrer vers la série GPT Image avant cette date.

5 améliorations majeures attendues pour GPT Image 2

Basé sur les fuites des tests Arena et diverses analyses, GPT Image 2 devrait apporter des avancées significatives dans les 5 domaines suivants.

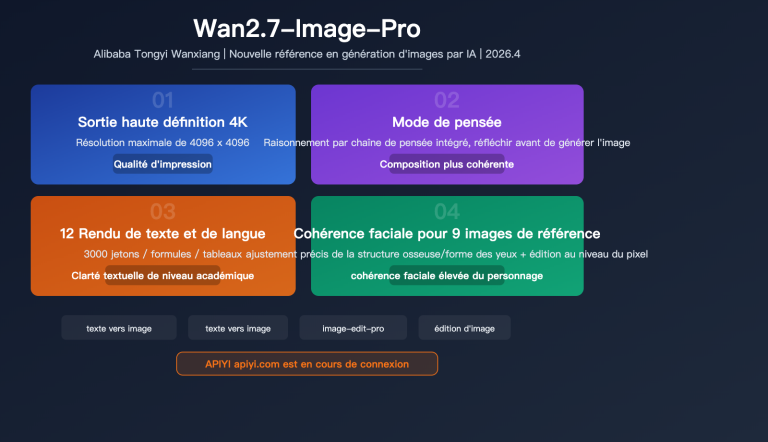

Amélioration 1 : Résolution native 4K

La résolution maximale de GPT Image 1.5 est de 1536×1024. GPT Image 2 devrait prendre en charge une sortie native 4K (2048×2048 ou 4096×4096), ainsi que le format large 16:9, répondant ainsi aux besoins de la création de contenu professionnel et de l'impression commerciale.

| Dimension | GPT Image 1.5 | GPT Image 2 (attendu) |

|---|---|---|

| Résolution max. | 1536×1024 | 4K native |

| Format d'image | 1:1, 3:2, 2:3 | Ajout du 16:9 |

| Qualité de sortie | Élevée | Réalisme quasi photographique |

Amélioration 2 : Précision de rendu de texte > 99 %

Le rendu de texte est la signature de la série GPT Image. GPT Image 1.5 a déjà atteint environ 95 % de précision pour l'anglais, mais reste perfectible pour les écritures non latines comme le CJK (chinois, japonais, coréen) ou l'arabe. GPT Image 2 devrait porter cette précision au-delà de 99 % et offrir une prise en charge complète du multilingue.

Cette mise à jour est particulièrement importante pour les utilisateurs chinois : cela signifie que la génération d'images contenant du texte chinois précis deviendra fiable pour la première fois.

Amélioration 3 : Cohérence faciale

Actuellement, GPT Image 1.5 peine à maintenir la cohérence faciale d'un personnage sur plusieurs générations. GPT Image 2 devrait prendre en charge la cohérence des personnages entre différentes images, rendant enfin pratiques les illustrations séquentielles, les séries de bandes dessinées ou la création de mascottes de marque.

Amélioration 4 : Contrôle par zone

La composition de GPT Image 1.5 dépend entièrement des invites textuelles. GPT Image 2 pourrait introduire des invites basées sur des zones (Region-based Prompting), permettant aux utilisateurs de spécifier le contenu de différentes parties de l'image pour un contrôle de composition beaucoup plus précis.

Amélioration 5 : Vitesse de génération en moins de 3 secondes

GPT Image 1.5 était déjà 4 fois plus rapide que la première génération. Grâce à une toute nouvelle architecture, GPT Image 2 devrait être capable de générer des images de haute qualité en moins de 3 secondes, réduisant ainsi considérablement le cycle de création.

Tableau récapitulatif des 5 améliorations

| Capacité | GPT Image 1.5 (actuel) | GPT Image 2 (attendu) | Gain |

|---|---|---|---|

| Résolution max. | 1536×1024 | 4K native (2048+) | 2-4x |

| Précision texte (EN) | ~95 % | 99 %+ | +4 pts |

| Précision texte (CJK) | Faible | Attendu excellent | Saut qualitatif |

| Cohérence faciale | Non supporté | Cohérence inter-images | Nouvelle fonction |

| Contrôle composition | Invites texte uniquement | Invites par zone | Nouvelle fonction |

| Vitesse | ~5-10 s | < 3 s | 2-3x |

| Format d'image | 3 types | Ajout du 16:9 | Plus riche |

💡 Conseil : Si vous utilisez actuellement DALL-E 3 ou GPT Image 1, nous vous recommandons de migrer vers GPT Image 1.5 dès que possible. La série DALL-E sera retirée le 12 mai, et GPT Image 1.5 offre des gains significatifs en qualité et en vitesse. La plateforme APIYI (apiyi.com) permet de basculer facilement entre les différentes versions.

Tarification actuelle de l'API GPT Image 1.5 (pour référence)

En attendant la sortie officielle de GPT Image 2, comprendre la tarification actuelle de GPT Image 1.5 aide à anticiper les tendances futures.

Facturation par image

| Qualité | 1024×1024 | 1024×1536 / 1536×1024 |

|---|---|---|

| Basse | 0,009 $ | 0,013 $ |

| Moyenne | 0,034 $ | 0,050 $ |

| Élevée | 0,133 $ | 0,200 $ |

Facturation par jeton (Token)

| Type de jeton | Prix |

|---|---|

| Entrée image | 8,00 $/M jetons |

| Entrée image (cache) | 2,00 $/M jetons |

| Sortie image | 32,00 $/M jetons |

| Entrée texte | 5,00 $/M jetons |

| Sortie texte | 10,00 $/M jetons |

Analyse des tendances tarifaires

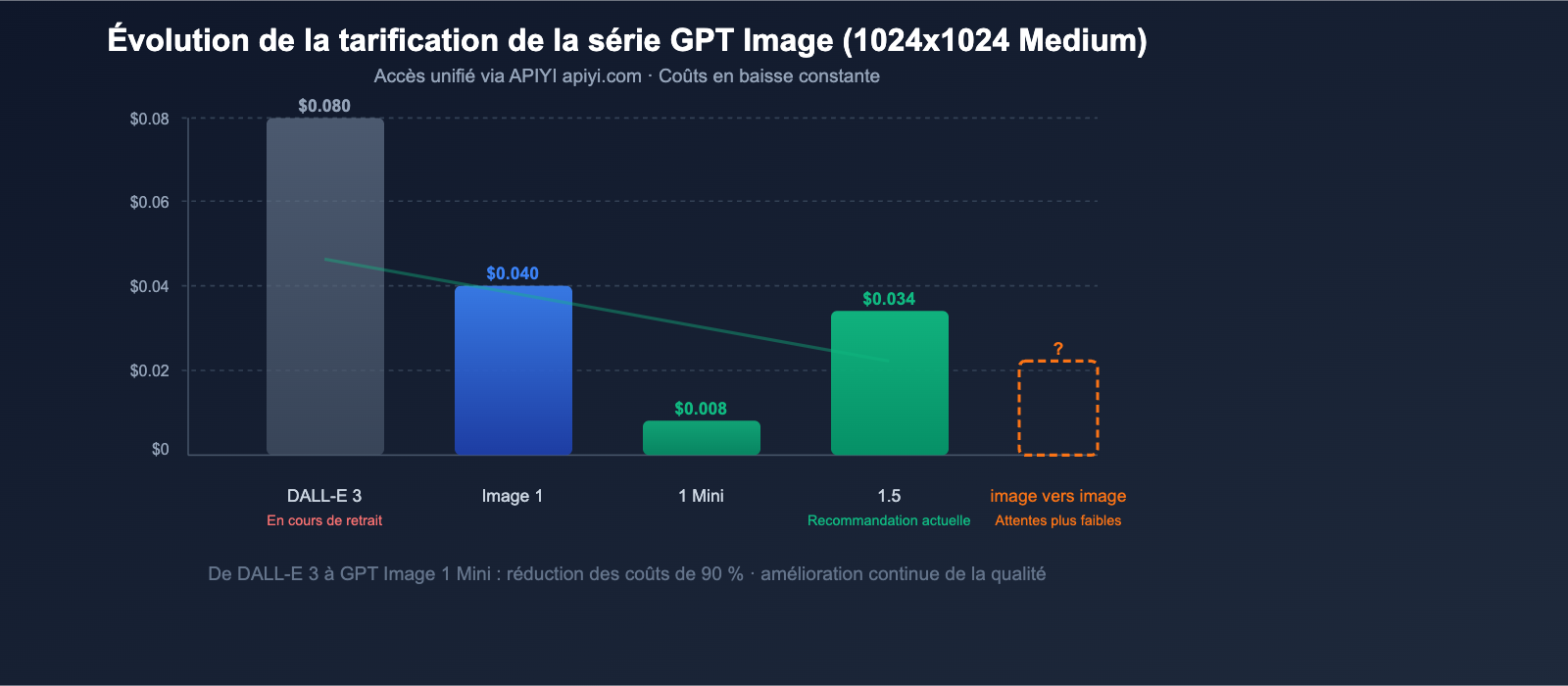

De DALL-E 3 à GPT Image 1.5, le coût de la génération d'images par OpenAI suit une tendance à la baisse constante :

| Modèle | 1024×1024 (standard) | Coût relatif |

|---|---|---|

| DALL-E 3 | 0,040 $ – 0,080 $ | Référence |

| GPT Image 1 | ~0,040 $ (Moyen) | Identique, qualité accrue |

| GPT Image 1 Mini | ~0,008 $ | -80 % |

| GPT Image 1.5 | 0,034 $ (Moyen) | Prix réduit + vitesse 4x |

GPT Image 2 devrait poursuivre cette tendance et pourrait introduire un nouveau niveau de tarification "turbo".

💰 Optimisation des coûts : La qualité "Basse" de GPT Image 1.5 ne coûte que 0,009 $ par image, ce qui rend la génération en masse très économique. La plateforme APIYI (apiyi.com) permet de gérer de manière flexible vos stratégies d'appel selon les différents niveaux de qualité.

title: Guide de démarrage rapide de l'API GPT Image

Guide de démarrage rapide de l'API GPT Image

En attendant GPT Image 2, les développeurs peuvent dès maintenant utiliser GPT Image 1.5 pour concevoir leurs applications. L'interface API est entièrement compatible ; pour migrer vers GPT Image 2 à l'avenir, il suffira de modifier le nom du modèle.

Exemple d'invocation pour le texte vers image

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # Interface unifiée via APIYI

)

# Génération d'image

result = client.images.generate(

model="gpt-image-1.5",

prompt="Un Shiba Inu portant une combinaison spatiale debout sur la surface de la lune, avec la Terre bleue en arrière-plan, style réaliste",

size="1536x1024",

quality="high",

n=1,

)

# Récupération des données de l'image

image_base64 = result.data[0].b64_json

Exemple d'édition d'image (Inpainting)

# Édition locale de l'image

result = client.images.edit(

model="gpt-image-1.5",

image=open("original.png", "rb"),

mask=open("mask.png", "rb"),

prompt="Remplacer l'arrière-plan par une plage au coucher du soleil",

size="1024x1024",

)

Explication des paramètres clés

| Paramètre | Type | Description | Valeurs possibles |

|---|---|---|---|

model |

string | ID du modèle | gpt-image-1.5 / gpt-image-1 |

prompt |

string | Description textuelle | Description en langage naturel |

size |

string | Dimensions de sortie | 1024x1024 / 1536x1024 / 1024x1536 / auto |

quality |

string | Niveau de qualité | low / medium / high |

n |

int | Nombre de générations | 1 (actuellement limité à une seule image) |

output_format |

string | Format de sortie | png / jpeg / webp |

Tous les modèles GPT Image intègrent des métadonnées C2PA pour identifier les contenus générés par IA et prennent en charge les arrière-plans transparents (alpha PNG).

Astuces pour le rendu de texte avec GPT Image

Le rendu de texte est l'atout majeur de la série GPT Image. Voici quelques conseils pratiques pour améliorer la précision :

| Astuce | Description | Exemple |

|---|---|---|

| Citer le texte | Utiliser des guillemets pour le texte à afficher | "L'image affiche 'Welcome Home'" |

| Spécifier la police | Décrire les caractéristiques visuelles | "Police sans empattement en gras" |

| Indiquer la position | Préciser l'emplacement du texte | "Titre centré en haut" |

| Limiter la quantité | Moins de 20 caractères par génération | Générer les longs textes en plusieurs fois |

| Utiliser l'anglais | Le rendu anglais est le plus fiable | GPT Image 2 améliorera le multilingue |

🚀 Démarrage rapide : Nous recommandons d'utiliser la plateforme APIYI (apiyi.com) pour accéder à l'API GPT Image. Elle prend en charge les interfaces compatibles OpenAI et sera adaptée dès la sortie de GPT Image 2.

Perspectives et comparaison de GPT Image 2 avec la concurrence

Le secteur de la génération d'images par IA est en pleine effervescence en 2026. GPT Image 2 devra relever de nombreux défis.

Comparaison des principaux modèles de génération d'images

| Modèle | Fabricant | Architecture | Rendu de texte | Résolution max | Modèle tarifaire |

|---|---|---|---|---|---|

| GPT Image 2 (prévu) | OpenAI | Nouvelle architecture indépendante | 99%+ | 4K natif | Token/Image |

| GPT Image 1.5 | OpenAI | Autorégressif | ~95% | 1536×1024 | Token/Image |

| Imagen 3 | Modèle de diffusion | Bon | 1024×1024 | Token | |

| FLUX 1.1 Pro | Black Forest | Modèle de diffusion | Excellent | 2048×2048 | Par image |

| Ideogram 3.0 | Ideogram | Modèle de diffusion | Excellent | 2048×2048 | Par image |

| Midjourney V7 | Midjourney | Modèle de diffusion | En amélioration | 2048×2048 | Abonnement |

Les forces fondamentales de la série GPT Image résident dans : la précision du rendu de texte, les connaissances du monde réel (reconnaissance précise des objets/marques), l'édition d'image native et l'intégration profonde avec l'écosystème ChatGPT.

Scénarios d'application attendus pour GPT Image 2

Les capacités accrues de GPT Image 2 ouvriront la voie à des cas d'usage jusqu'ici difficiles à réaliser :

| Scénario | Dépendance clé | Faisabilité actuelle | Attentes GPT Image 2 |

|---|---|---|---|

| Affiches/Bannières en chinois | Rendu de texte CJK | ❌ Taux d'erreur élevé | ✅ Précision 99%+ |

| BD/Illustrations continues | Cohérence faciale | ❌ Différent à chaque fois | ✅ Cohérence entre images |

| Impression commerciale 4K | Haute résolution | ❌ Max 1536px | ✅ 4K natif |

| Génération de visuels e-commerce | Vitesse + Qualité | ⚠️ Utilisable | ✅ <3s + Qualité supérieure |

| Maquettes UI/UX | Mise en page précise | ⚠️ Limitée | ✅ Contrôle par zone |

| Matériel marketing multilingue | Texte multilingue | ❌ Faible hors latin | ✅ Support complet |

| Produits dérivés de marque | Cohérence + HD | ❌ Difficile à réaliser | ✅ Support complet |

Pour les développeurs et créateurs de contenu francophones et internationaux, la percée dans le rendu de texte sera l'amélioration la plus concrète de GPT Image 2.

Autorégressif vs Diffusion : Différences fondamentales d'architecture

L'architecture autorégressive utilisée par la série GPT Image diffère radicalement des modèles de diffusion utilisés par DALL-E, Midjourney ou FLUX :

| Dimension | Modèles de diffusion (DALL-E/MJ/FLUX) | Modèles autorégressifs (GPT Image) |

|---|---|---|

| Méthode de génération | Débruitage progressif | Génération pixel par pixel (comme du texte) |

| Rendu de texte | Faible (ne comprend pas la sémantique) | Très fort (hérité du modèle de langage) |

| Connaissances du monde | Limitées (données d'entraînement) | Riches (héritées du LLM) |

| Édition d'image | Nécessite des modèles tiers | Support natif |

| Compréhension des invites | Bonne | Excellente (niveau LLM) |

| Vitesse de génération | Rapide (débruitage parallèle) | Plus lente (génération séquentielle) |

💡 Aperçu technique : La "nouvelle architecture indépendante" de GPT Image 2 pourrait être une solution hybride combinant autorégression et diffusion pour tirer le meilleur des deux mondes. Via la plateforme APIYI (apiyi.com), vous pouvez invoquer à la fois GPT Image et des modèles de diffusion comme FLUX pour comparer directement les résultats réels des deux architectures.

Guide de migration DALL-E : à compléter avant le 12 mai

DALL-E 2 et DALL-E 3 seront officiellement retirés le 12 mai 2026. Tous les développeurs doivent avoir terminé leur migration avant cette date.

Parcours de migration

| Modèle actuel | Migration recommandée | Difficulté de migration |

|---|---|---|

| DALL-E 2 | GPT Image 1.5 | Faible (API compatible) |

| DALL-E 3 | GPT Image 1.5 | Faible (remplacement du nom du modèle) |

| GPT Image 1 | GPT Image 1.5 | Très faible (remplacement direct) |

Points d'attention pour la migration

- Compatibilité des interfaces : La série GPT Image utilise le même point de terminaison

/v1/images/generations, il suffit de modifier le paramètremodel. - Différences de paramètres : GPT Image 1.5 ajoute le paramètre

quality(low/medium/high), tandis que DALL-E 3 utilisaitquality(standard/hd). - Changements de facturation : Passage d'une facturation à l'image pour DALL-E à une double facturation (par jeton + par image) pour GPT Image.

- Formats de sortie : GPT Image prend désormais en charge le format WebP et les arrière-plans transparents.

🎯 Conseil de migration : Effectuez vos tests de migration via la plateforme APIYI apiyi.com. Cela vous permet de comparer les différences de rendu entre DALL-E et GPT Image sans impacter votre environnement de production. La plateforme prend en charge une interface unifiée pour plusieurs modèles, rendant le coût de basculement extrêmement faible.

Foire aux questions

Q1 : Quand GPT Image 2 sera-t-il officiellement publié ?

Il n'y a actuellement aucune date de sortie officielle confirmée. Selon l'avancement des tests bêta sur l'Arena et les cycles de publication historiques, on peut s'attendre à une sortie entre le milieu et la fin de l'année 2026. L'intervalle entre GPT Image 1 et 1.5 ayant été d'environ 9 mois, la deuxième génération pourrait arriver vers l'été. Dès sa sortie, la plateforme APIYI apiyi.com assurera une intégration immédiate.

Q2 : Faut-il attendre GPT Image 2 ou utiliser GPT Image 1.5 dès maintenant ?

Nous recommandons d'utiliser GPT Image 1.5 immédiatement. C'est le modèle de génération d'images d'OpenAI le plus performant à ce jour, avec un coût de 0,009 $ par image en qualité "Low". L'interface API est compatible, et une future migration vers GPT Image 2 ne nécessitera que le remplacement du nom du modèle. Attendre ne ferait que vous faire manquer la fenêtre de migration avant le retrait de DALL-E.

Q3 : Que signifie la nouvelle architecture de GPT Image 2 ?

GPT Image 1/1.5 repose sur les capacités de génération d'images du modèle multimodal GPT-4o. GPT Image 2 serait basé sur une toute nouvelle architecture indépendante, sans dépendance vis-à-vis de GPT-4o. Cela pourrait signifier des optimisations dédiées à la génération d'images, des résolutions maximales plus élevées et des coûts d'inférence réduits. Via la plateforme APIYI apiyi.com, vous pourrez rapidement comparer les différences réelles entre les anciennes et les nouvelles architectures dès la sortie de la version 2.

Q4 : La série GPT Image prend-elle en charge le rendu de texte en chinois ?

GPT Image 1.5 offre un support limité pour le rendu de texte en chinois, avec des risques d'erreurs ou de caractères corrompus. GPT Image 2 devrait considérablement améliorer la précision du rendu des écritures non latines (y compris le chinois, le japonais, le coréen et l'arabe), ce qui constitue une avancée majeure pour les créateurs de contenu sinophones.

Résumé

Le test en version bêta de GPT Image 2 marque le début d'une nouvelle ère pour la génération d'images chez OpenAI. Avec une toute nouvelle architecture indépendante, une résolution native 4K, un rendu de texte multilingue à plus de 99 %, une cohérence faciale et un contrôle par zone, ces mises à jour attendues redéfiniront les limites de la génération d'images par IA une fois déployées.

Points clés à retenir :

- État : En phase de test bêta, 3 noms de code Arena ont été révélés.

- Architecture : Nouvelle architecture indépendante, non dérivée de GPT-4o.

- Améliorations attendues : Résolution 4K / précision du texte > 99 % / cohérence faciale / contrôle par zone / génération en 3 secondes.

- Solution actuelle : GPT Image 1.5 (à partir de 0,009 $ par image) reste le meilleur choix actuel.

- Urgence : DALL-E 2/3 seront retirés le 12 mai, une migration est nécessaire dès que possible.

- Date de sortie prévue : Entre le milieu et la fin de l'année 2026.

Nous vous recommandons d'utiliser APIYI (apiyi.com) pour accéder rapidement à toute la gamme de modèles GPT Image et bénéficier d'un accès API dès la sortie officielle de GPT Image 2.

Références

- Documentation de l'API de génération d'images d'OpenAI :

developers.openai.com/api/docs/guides/image-generation - Liste des modèles OpenAI :

developers.openai.com/api/docs/models - Tarification de l'API OpenAI :

developers.openai.com/api/docs/pricing

Cet article a été rédigé par l'équipe technique d'APIYI. Pour plus de tutoriels sur l'utilisation des modèles d'IA, veuillez consulter APIYI (apiyi.com).