Note de l'auteur : Analyse des raisons pour lesquelles Claude Code ne prend en charge que les modèles Anthropic, comparaison de la prise en charge des modèles pour 6 outils CLI (OpenCode, Cline, Aider, Gemini CLI, etc.), et solution pour exécuter d'autres modèles sur Claude Code via un service proxy API LiteLLM.

Claude Code est actuellement l'outil de codage IA en terminal le plus puissant, mais il présente une limitation évidente : il ne peut utiliser que les modèles Claude d'Anthropic et ne prend pas en charge GPT ou Gemini. Si vous avez besoin de basculer facilement entre les modèles de différents fournisseurs dans la ligne de commande — Claude pour le raisonnement complexe, GPT pour des tâches spécifiques, et Gemini pour les travaux à faible priorité via des quotas gratuits — quel outil choisir ? Cet article passe en revue la prise en charge des modèles par 6 outils de codage CLI populaires et vous propose un tableau de sélection clair.

Valeur ajoutée : Après avoir lu cet article, vous saurez quel outil CLI est le mieux adapté à vos besoins multi-modèles et comment faire en sorte que Claude Code puisse également exécuter d'autres modèles.

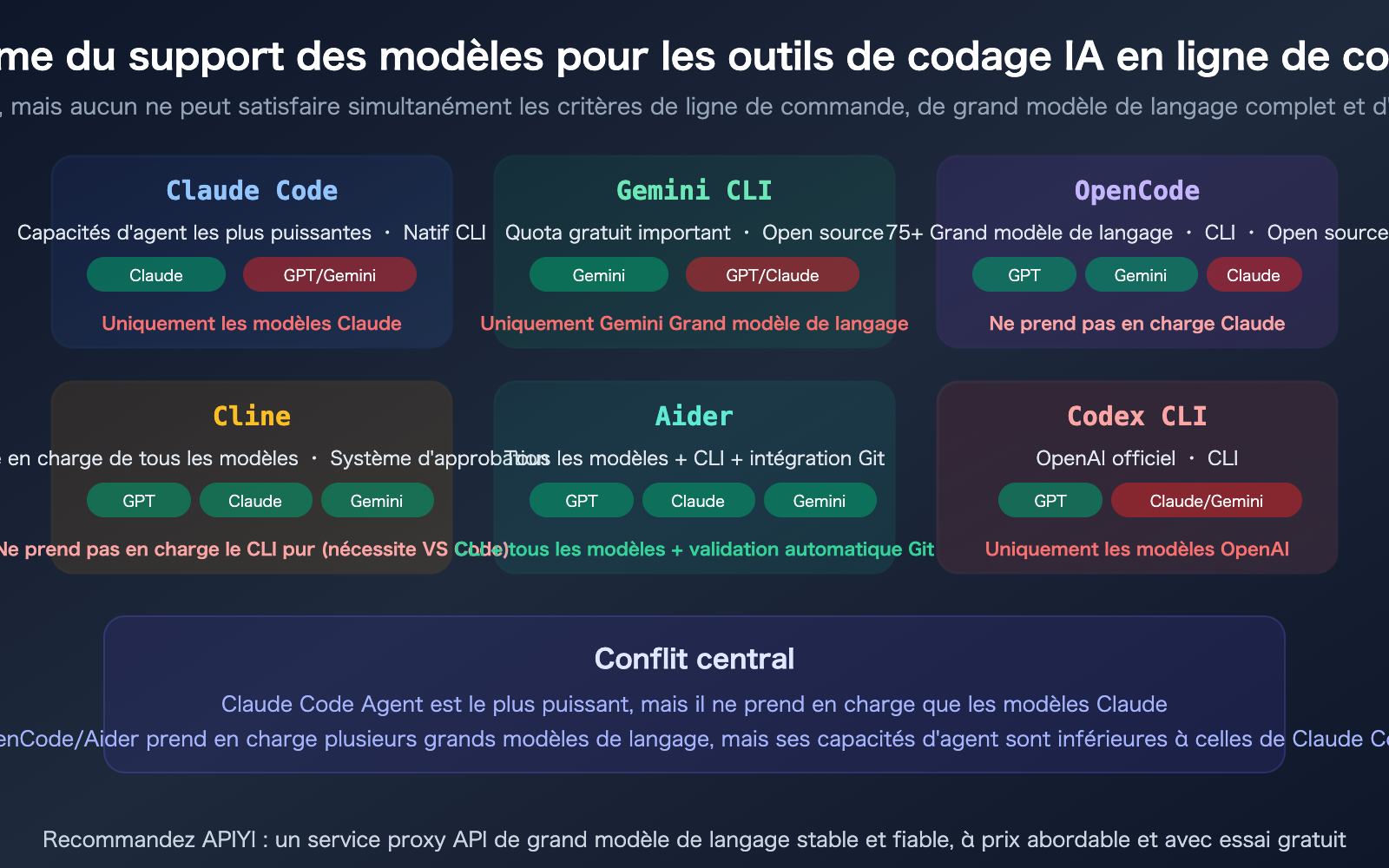

Tableau comparatif des outils de codage CLI

C'est le tableau le plus important de cet article : il répond directement à la question "quel outil prend en charge quoi".

Comparatif de 6 outils de codage AI en CLI

| Outil | Support CLI | Claude | GPT | Gemini | Modèle local | Changement de modèle | Capacité Agent | Prix |

|---|---|---|---|---|---|---|---|---|

| Claude Code | CLI native | Toute la gamme | Via proxy | Via proxy | Non | Non | Très élevée | Abonnement |

| Gemini CLI | CLI native | Non | Non | Toute la gamme | Non | Non | Moyenne | Gratuité généreuse |

| OpenCode | CLI native | Non | Toute la gamme | Toute la gamme | Ollama | En session | Moyenne | Open source |

| Cline | Non | Toute la gamme | Toute la gamme | Toute la gamme | Ollama | Oui | Moyenne | Open source |

| Aider | CLI native | Toute la gamme | Toute la gamme | Toute la gamme | Ollama | Oui | Moyenne | Open source |

| Codex CLI | CLI native | Non | Toute la gamme | Non | Non | Non | Moyenne | Abonnement OpenAI |

Le tableau met clairement en évidence les "lacunes" de chaque outil :

- Claude Code : Agent le plus performant, mais limité à Claude.

- Gemini CLI : Gratuité généreuse, mais limité à Gemini.

- OpenCode : Plus de 75 modèles, mais ne prend pas en charge Claude.

- Cline : Tous les modèles, mais n'est pas un outil CLI (nécessite VS Code).

- Aider : CLI + tous les modèles, mais capacité Agent inférieure à Claude Code.

- Codex CLI : Limité aux modèles OpenAI.

Pourquoi Claude Code ne prend-il pas en charge GPT et Gemini ?

Raisons techniques : intégration profonde vs compatibilité générique

Claude Code n'est pas un simple "wrapper LLM" ; c'est un framework d'Agent conçu sur mesure par Anthropic pour les modèles Claude. De nombreuses capacités fondamentales de Claude Code reposent sur les spécificités des modèles Claude :

| Capacité spécifique de Claude Code | Fonctionnalité Claude dépendante |

|---|---|

| Context Compaction | Mécanisme de résumé interne de Claude |

| Adaptive Thinking | Paramètre "thinking" de Claude Opus 4.6 |

| thoughtSignature | Signature de raisonnement propriétaire de Claude |

| Skills / Subagents | Optimisation basée sur le format de prompt de Claude |

| Fenêtre de contexte de 1M | Spécifique à Claude Opus 4.6 |

| Ultrathink | Mode de raisonnement profond exclusif à Claude |

Si l'on passait à GPT ou Gemini, ces fonctionnalités optimisées seraient inopérantes ou dégradées. C'est pourquoi la capacité d'Agent de Claude Code est bien supérieure aux outils généralistes comme OpenCode ou Aider : l'avantage de la spécialisation ne peut être reproduit par une compatibilité générique.

Raisons commerciales : stratégie de verrouillage

Claude Code est l'un des produits phares d'Anthropic, conçu pour stimuler la consommation de jetons (tokens) de l'API Claude. Si Anthropic permettait aux utilisateurs de basculer vers GPT, ils perdraient cette source de revenus. C'est la même logique que pour Gemini CLI (limité à Gemini) ou Codex CLI (limité à GPT) : chaque entreprise cherche à verrouiller les utilisateurs au sein de son propre écosystème.

Analyse détaillée des caractéristiques des outils

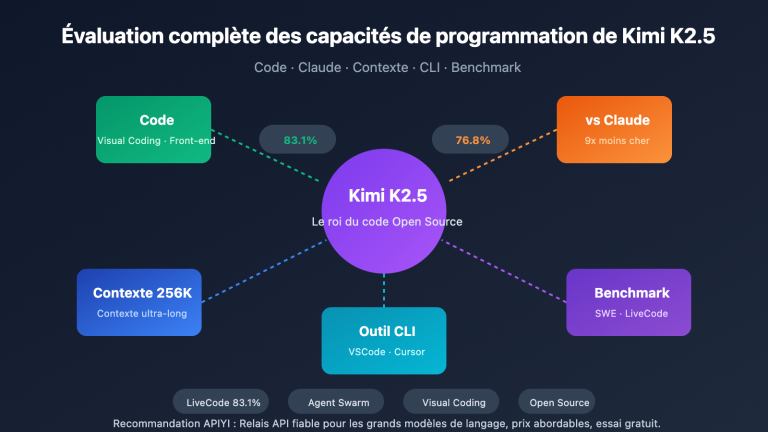

OpenCode : 75+ modèles, mais pas de support pour Claude

OpenCode est un outil de codage CLI open source développé en Go, avec plus de 45 000 étoiles sur GitHub. Son principal argument de vente est la flexibilité des modèles : il prend en charge plus de 75 fournisseurs de grands modèles de langage, dont OpenAI, Google Gemini, AWS Bedrock, Groq, Azure, etc.

Caractéristiques principales :

- Changement de modèle à chaud pendant la session (utilisez des modèles économiques pour l'itération rapide et des modèles puissants pour la validation finale)

- Intégration LSP (configuration automatique du serveur de langage)

- Sessions multiples en parallèle (exécution de plusieurs agents sur un même projet)

- Priorité à la confidentialité (aucune donnée de code ou de contexte n'est stockée)

Limitation majeure : OpenCode ne prend pas en charge les modèles Claude d'Anthropic. Si votre flux de travail principal dépend des capacités de raisonnement de Claude, OpenCode n'est pas le choix idéal.

Aider : CLI + tous modèles + auto-commit Git

Aider est actuellement le seul outil qui combine "natif CLI + support complet des modèles + intégration Git robuste". Il prend en charge presque tous les modèles grand public, notamment Claude, GPT, Gemini, DeepSeek et les modèles locaux via Ollama.

Avantages clés :

- Auto-commit Git (crée automatiquement un message de commit explicite à chaque modification)

- Édition collaborative multi-fichiers

- Support de presque tous les LLM

- Open source et gratuit, BYOK (apportez votre propre clé API)

Limitation majeure : Les capacités d'agent sont plus faibles que celles de Claude Code — il n'y a pas de système de compétences, de sous-agents, de hooks ou d'agents en arrière-plan. C'est davantage un éditeur de code intelligent qu'une plateforme d'agent complète.

Cline : tous modèles, mais pas de CLI

La philosophie de Cline est "tout approuver" : chaque modification de fichier et chaque commande terminal nécessite votre approbation explicite. Il prend en charge tous les modèles courants, y compris Claude, GPT, Gemini et les modèles locaux Ollama.

Limitation majeure : Cline n'est pas un outil CLI, c'est une extension VS Code. Si vous avez besoin de travailler dans un environnement purement terminal (SSH, serveurs, CI/CD), Cline ne conviendra pas.

🎯 Conseil de sélection : Si vous effectuez principalement des raisonnements complexes sur de grands projets, Claude Code associé à une clé API Claude à prix réduit via APIYI (apiyi.com) est la solution optimale. Si vous avez besoin de basculer entre plusieurs modèles en CLI, Aider est actuellement l'option la plus complète.

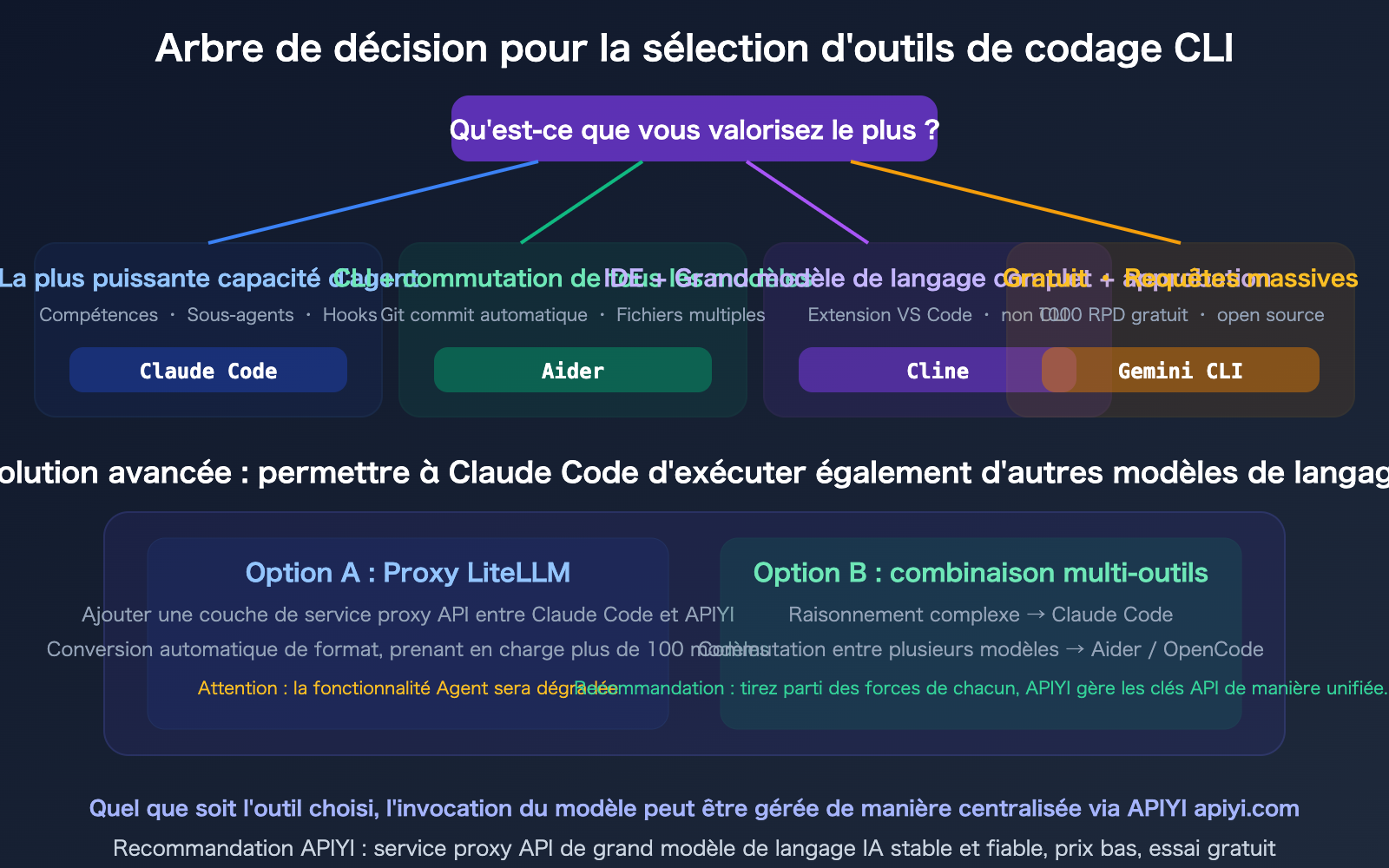

Solution LiteLLM pour faire tourner d'autres modèles avec Claude Code

Si vous avez réellement besoin d'utiliser GPT ou Gemini dans l'interface de Claude Code, le proxy LiteLLM est actuellement la seule solution viable.

Comment fonctionne le proxy LiteLLM

LiteLLM est un service proxy LLM open source qui agit comme une couche de traduction entre Claude Code et l'API cible. Il convertit automatiquement les requêtes au format Anthropic Messages API émises par Claude Code vers le format OpenAI ou Gemini.

Claude Code → Requête au format Anthropic → Proxy LiteLLM → Conversion au format GPT/Gemini → API cible

Limitations clés du proxy LiteLLM

| Limitation | Impact |

|---|---|

| Dégradation des fonctions d'Agent | Les fonctionnalités exclusives à Claude comme Thinking, thoughtSignature et Context Compaction deviennent inopérantes |

| Risques de sécurité | LiteLLM est un proxy tiers, Anthropic n'audite pas sa sécurité |

| Latence accrue | Une couche de proxy supplémentaire = une couche de latence réseau supplémentaire |

| Compatibilité de format | La conversion de certaines requêtes complexes (appels d'outils, réflexion multi-tours) peut échouer |

Conclusion : La solution LiteLLM permet de "faire tourner d'autres modèles avec Claude Code", mais l'expérience est bien inférieure à celle des modèles Claude natifs. Si vous avez besoin d'une capacité de basculement entre plusieurs modèles, il est plus pragmatique de choisir Aider ou OpenCode.

🎯 Conseil pratique : N'essayez pas de faire tout faire avec un seul outil. Voici la combinaison recommandée :

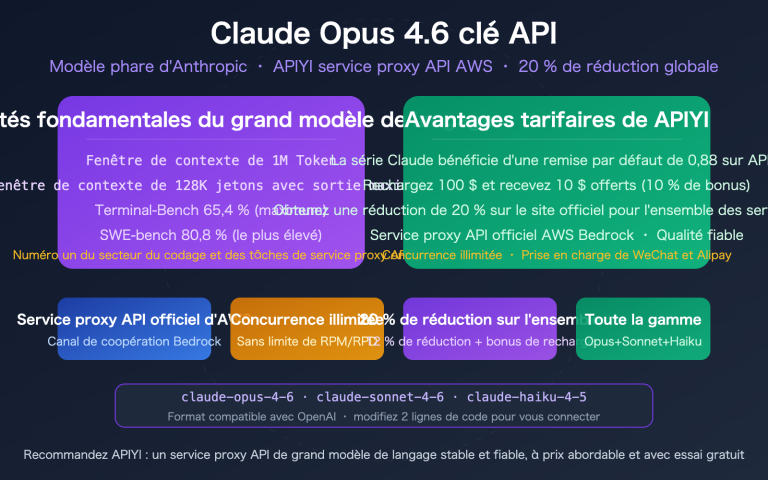

- Raisonnement complexe et grands projets → Claude Code (via APIYI apiyi.com pour accéder à Claude Opus 4.6 avec 20 % de réduction)

- Codage quotidien nécessitant un changement de modèle → Aider (support complet des modèles en CLI)

- Besoin d'un grand volume de requêtes gratuites → Gemini CLI (1000 RPD gratuits)

Foire aux questions

Q1 : Pourquoi OpenCode supporte-t-il plus de 75 modèles mais pas Claude ?

OpenCode prend en charge les points de terminaison d'API compatibles avec OpenAI. Le format d'API natif de Claude (/v1/messages) est différent du format OpenAI (/v1/chat/completions), et OpenCode n'a pas encore adapté le format Anthropic. Si vous appelez Claude via les points de terminaison compatibles OpenAI de plateformes de service proxy API comme APIYI apiyi.com, vous pouvez théoriquement l'utiliser dans OpenCode, mais les fonctionnalités avancées comme le "thinking" seront limitées.

Q2 : Quelle est la différence entre les capacités d’Agent d’Aider et celles de Claude Code ?

La différence est majeure. Claude Code dispose d'une plateforme d'Agent complète : système de compétences (Skills), sous-agents (Subagents), hooks de cycle de vie, agents en arrière-plan, boucles de temporisation (/loop), contrôle à distance, mode vocal et contrôle du bureau (Computer Use). Aider se concentre principalement sur l'édition de code intelligente et l'intégration Git, sans aucune des fonctionnalités d'Agent mentionnées ci-dessus. Choisir Aider, c'est choisir la "flexibilité multi-modèle", choisir Claude Code, c'est choisir la "puissance d'Agent ultime".

Q3 : Si je ne dois choisir qu’un seul outil, lequel prendre ?

Cela dépend de vos besoins principaux : si 80 % de votre travail consiste en un raisonnement de code complexe et de grands projets, choisissez Claude Code ; ses capacités d'Agent et la profondeur de raisonnement d'Opus 4.6 sont irremplaçables. Si vous avez souvent besoin de tester différents modèles, choisissez Aider ; c'est le seul véritable choix en CLI avec un support multi-modèle complet. Si votre budget est limité, choisissez Gemini CLI ; le quota gratuit de 1000 RPD suffit largement à un développeur individuel. Toutes les invocations de modèle via API peuvent être gérées de manière centralisée via APIYI apiyi.com.

Q4 : Gemini CLI peut-il supporter d’autres modèles via un proxy ?

Oui. Depuis 2026, des outils comme Bifrost permettent d'effectuer des conversions de format entre Gemini CLI et d'autres modèles, supportant plus de 20 fournisseurs comme Claude, GPT, Groq, etc. Mais comme pour la solution LiteLLM, cette méthode de proxy entraîne la perte des fonctionnalités exclusives au modèle, et l'expérience est moins fluide qu'avec un support natif.

Résumé

Les points clés pour choisir le bon modèle pour vos outils de codage IA en CLI :

- Il n'existe pas d'outil universel parfait : Claude Code Agent est le plus performant mais se limite à Claude ; OpenCode prend en charge plus de 75 modèles mais ne supporte pas Claude ; Cline est compatible avec tous les modèles mais n'est pas une interface CLI ; Aider reste le choix le plus équilibré, combinant CLI et compatibilité multi-modèles.

- Les limitations de Claude Code ont des raisons techniques : L'intégration profonde des fonctionnalités telles que le "Thinking", le "Compaction" et les "Skills" de Claude est ce qui rend ses capacités d'Agent supérieures — une compatibilité universelle sacrifierait ces avantages.

- Approche recommandée : Utilisez Claude Code combiné à une clé API Claude à prix réduit via APIYI pour les raisonnements complexes, Aider pour le codage quotidien multi-modèles, et Gemini CLI pour les tâches à haut volume gratuites.

Nous vous recommandons d'utiliser APIYI (apiyi.com) pour gérer de manière centralisée vos invocations de modèles pour tous vos outils : profitez de 20 % de réduction sur Claude et 28 % sur Gemini, le tout sur une plateforme unique couvrant tous les modèles.

📚 Références

-

Documentation officielle de Claude Code : Explications sur les capacités d'Agent et la prise en charge des modèles

- Lien :

code.claude.com/docs/en/overview - Description : Découvrez les fonctionnalités complètes et les limitations de modèles de Claude Code.

- Lien :

-

Site officiel d'OpenCode : Outil CLI open source prenant en charge plus de 75 modèles

- Lien :

opencode.ai - Description : Inclut la configuration des modèles, les sessions multiples et l'intégration LSP.

- Lien :

-

GitHub d'Aider : Assistant de codage CLI + tous modèles + intégration Git

- Lien :

github.com/paul-gauthier/aider - Description : Contient la liste des modèles pris en charge et la documentation sur l'intégration Git.

- Lien :

-

Utiliser LiteLLM pour faire tourner des modèles non-Anthropic avec Claude Code : Documentation sur la solution proxy

- Lien :

docs.litellm.ai/docs/tutorials/claude_non_anthropic_models - Description : Inclut les étapes de configuration et les limitations.

- Lien :

-

Centre de documentation APIYI : Gestion unifiée des API multi-modèles

- Lien :

docs.apiyi.com - Description : Supporte tous les modèles principaux tels que Claude, GPT, Gemini, etc.

- Lien :

Auteur : Équipe technique APIYI

Échanges techniques : N'hésitez pas à discuter dans la section commentaires. Pour plus d'informations, visitez le centre de documentation APIYI sur docs.apiyi.com.