Recientemente, mientras ayudaba a clientes a solucionar problemas con sus necesidades de generación de imágenes, descubrimos un fenómeno que vale la pena compartir: GPT-Image-2 ya no puede generar archivos PNG con fondo verdaderamente transparente. No importa si escribes "el fondo debe ser transparente" en la indicación, o si pasas el parámetro background: "transparent" directamente a través de la API, la última generación de GPT-Image-2 devolverá una imagen con un fondo de color sólido o simplemente arrojará un error. Esto representa un contraste de capacidades muy evidente frente a su predecesor, sora_image / gpt-4o-image, y ha dejado descolocados a varios equipos que trabajan con recorte de SKU para comercio electrónico, pegatinas para redes sociales e ilustraciones para presentaciones.

Lo curioso es que el modelo de imagen insignia de Google lanzado a finales de 2025, Nano Banana Pro (basado en Gemini 3 Pro Image), tampoco admite la generación de fondos transparentes, y su predecesor, Nano Banana 2, presenta la misma limitación. En otras palabras, los dos pilares más importantes de la industria en generación de imágenes han eliminado esta función, que parecía básica. En APIYI (apiyi.com) realizamos una ronda completa de pruebas de regresión y hemos organizado los fenómenos, las causas raíz y las soluciones alternativas en este artículo para que los equipos que integran productos puedan tomar decisiones rápidamente.

Experimento completo de fallo de fondo transparente en GPT-Image-2

Para entender esta diferencia de capacidad, la forma más directa es ejecutar una prueba. Usamos la puerta de enlace de APIYI para invocar simultáneamente las versiones gpt-image-2, gpt-image-1.5 y gpt-image-2-all, con la indicación unificada "a cute orange cat sticker, transparent background", y configuramos explícitamente el parámetro background como transparent. Los resultados fueron muy consistentes: la serie gpt-image-2 devolvió un error 4xx o generó una imagen con fondo sólido o con el patrón de tablero de ajedrez, mientras que gpt-image-1.5 devolvió honestamente un PNG transparente con canal alfa.

# Prueba única de capacidad de fondo transparente a través de la puerta de enlace de APIYI

from openai import OpenAI

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1"

)

# ❌ gpt-image-2 no admite transparent, será rechazado por la capa de la puerta de enlace

client.images.generate(

model="gpt-image-2",

prompt="a cute orange cat sticker",

background="transparent",

output_format="png"

)

# ✅ gpt-image-1.5 sigue admitiendo de forma nativa la salida con fondo transparente

client.images.generate(

model="gpt-image-1.5",

prompt="a cute orange cat sticker",

background="transparent",

output_format="png"

)

🎯 Consejo de inicio rápido: Si solo quieres que tu flujo de trabajo actual funcione, la forma más económica es cambiar el campo model de vuelta a

gpt-image-1.5, apuntar la base_url a APIYI apiyi.com, y dejar los demás parámetros intactos; podrás recuperar la capacidad de salida transparente en menos de 5 minutos.

También replicamos situaciones incluyendo en la indicación frases como "background must be transparent", "isolated on transparent canvas" o "PNG with alpha channel". GPT-Image-2 se comporta de forma muy obstinada: o da un fondo blanco, o genera una imagen sólida con un "patrón" de tablero de ajedrez gris y blanco, lo que equivale a dibujar una "marca visual de transparencia". Esto es altamente consistente con el modo de fallo de Nano Banana Pro; es un problema grave en el nivel de alineación semántica del modelo, no porque la indicación no sea lo suficientemente precisa.

| Método de activación | Comportamiento de GPT-Image-2 | Comportamiento de gpt-image-1.5 | Recomendación |

|---|---|---|---|

Parámetro background="transparent" |

Rechazo API / Color sólido | PNG transparente real | Cambiar de modelo |

| Indicación "transparent background" | Fondo blanco o patrón ajedrez | PNG transparente real | No depender del texto |

| Indicación "isolated subject on white" | Fondo gris claro | Sujeto sobre fondo blanco | Usar junto con parámetros |

Salida output_format=webp |

Sigue siendo color sólido | Webp transparente real | Webp no afecta la capacidad |

| Interfaz Edit + máscara alfa | Inválido | Transparencia parcial | Solo disponible en 1.5 |

3 razones fundamentales por las que se eliminó el fondo transparente en GPT-Image-2

La primera es una decisión a nivel de arquitectura. OpenAI especifica claramente en la documentación oficial de GPT-Image-2 que "gpt-image-2 no admite actualmente fondos transparentes". Aunque no se han hecho públicas las razones, en la industria se especula que esto está relacionado con su actualización hacia un objetivo de entrenamiento de "consistencia de escena" más robusto: el modelo ha sido entrenado para completar una escena del mundo real, no para "recortar objetos", por lo que carece de señales de supervisión para el canal alfa desde la base. Se trata de una decisión de diseño a nivel de producto, no de un error (bug).

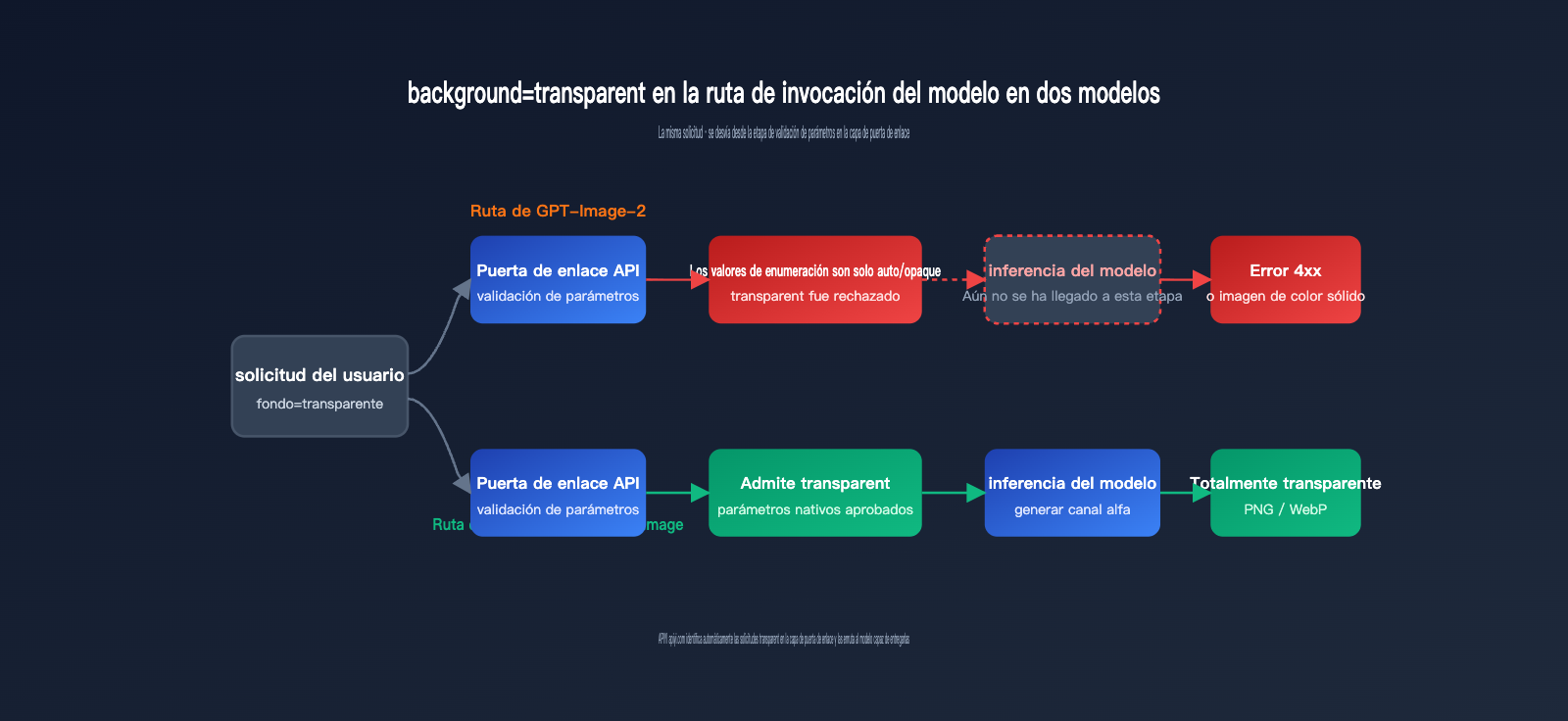

La segunda es la validación forzosa de la puerta de enlace (API Gateway). Hemos analizado las respuestas del endpoint oficial de OpenAI y los valores enumerados del parámetro background en gpt-image-2 solo permiten auto y opaque, eliminando transparent del espacio de parámetros. Esto significa que cualquier plataforma externa (incluyendo la puerta de enlace de APIYI) rechazará este tipo de invocación en la fase de solicitud, sin llegar siquiera a la etapa de inferencia del modelo. Por lo tanto, pensar que "cambiar a otra plataforma de terceros lo solucionará" es una ilusión; los canales "inversos" como gpt-image-2-all o gpt-image-2-vip utilizan el mismo modelo backend.

La tercera es la estrategia de filtrado de seguridad y derechos de autor. Las imágenes con fondo transparente se utilizan a menudo para composiciones secundarias, especialmente en escenarios que involucran retratos o logotipos de marcas. OpenAI ha estado restringiendo notablemente los permisos de salida para "materiales aptos para composición secundaria" en los últimos dos años, y gpt-image-2 también incorpora una línea de revisión de contenido más estricta, lo cual está alineado con la eliminación de la capacidad de fondo transparente.

🎯 Consejo de arquitectura: En una puerta de enlace unificada como APIYI (apiyi.com), validamos los espacios de parámetros de gpt-image-2 y gpt-image-1.5 por separado. Cuando detectamos una solicitud con

transparent, sugerimos automáticamente una degradación para evitar que el usuario final se encuentre con "fallos de invocación sin explicación".

Comparativa de capacidades de fondo transparente: GPT-Image-2 frente a Nano Banana Pro

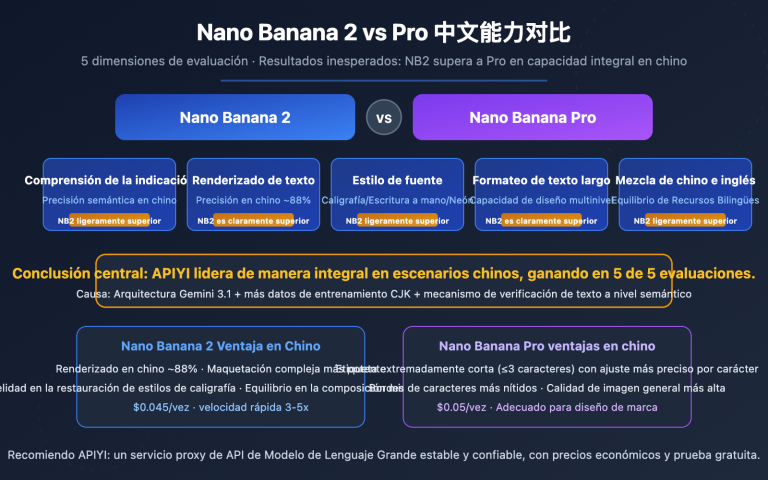

Muchos clientes nos preguntan: "¿No basta con cambiar a Google Nano Banana 2 / Nano Banana Pro?". La respuesta es bastante cruda: tampoco funciona. El modo de fallo de Nano Banana Pro es incluso más "peculiar" que el de GPT-Image-2: genera una imagen que aparentemente "tiene fondo transparente", pero si miras de cerca, el patrón de tablero de ajedrez está dibujado como píxeles de color sólido, como si hubiera "calcado" el indicador de transparencia de Photoshop.

La explicación predominante en la comunidad es que los datos de entrenamiento del modelo contienen una gran cantidad de imágenes de archivo (bancos de imágenes, capturas de pantalla de Photoshop, tutoriales de diseño, etc.) donde el tablero de ajedrez representa la transparencia, lo que ha llevado al modelo a formar una asociación errónea de "transparencia = tablero de ajedrez". Google ha confirmado en los foros de la API de Gemini que la serie Nano Banana no admitirá de forma nativa la salida con fondo transparente por el momento, por lo que se requiere la combinación de Gemini 3 Flash + ejecución de código como una solución alternativa.

| Modelo | Fecha de lanzamiento | Soporte de fondo transparente | Comportamiento ante fallos | Escenario recomendado |

|---|---|---|---|---|

| GPT-Image-2 | Principios de 2026 | ❌ No compatible | Fondo de color sólido / Error | Imágenes realistas, pósteres |

| GPT-Image-2-all (inverso oficial) | Principios de 2026 | ❌ No compatible | Igual que el oficial | Equivalente a GPT-Image-2 |

| GPT-Image-1.5 | Mediados de 2025 | ✅ Soporte nativo | / | Pegatinas, recorte para e-commerce |

| sora_image / gpt-4o-image | Marzo de 2025 | ✅ Compatible | / | Compatibilidad con flujos antiguos |

| Nano Banana 2 | Finales de 2025 | ❌ No compatible | Patrón de ajedrez gris/blanco | Creación secundaria, estilizado |

| Nano Banana Pro | Finales de 2025 | ❌ No compatible | Patrón de ajedrez gris/blanco | Edición de alta fidelidad |

| Stable Diffusion + LoRA | Actualización continua | ✅ Soporte indirecto | Requiere post-procesamiento | Producción masiva autohospedada |

🎯 Consejo de selección: Si solo necesitas "extraer el sujeto", la combinación más rentable en 2026 es usar GPT-Image-1.5 / sora_image para obtener la imagen directamente, o bien usar Nano Banana Pro y ejecutar una eliminación de fondo posterior. Ambas rutas pueden utilizar la autenticación y facturación unificadas en APIYI (apiyi.com), evitando que el lado del negocio tenga que mantener dos claves API distintas.

4 alternativas para obtener fondos transparentes con GPT-Image-2

Aunque GPT-Image-2 se niega a generar imágenes transparentes, existen cuatro rutas maduras para lograrlo, cada una con sus propios costes y curvas de calidad, que pueden combinarse según el escenario.

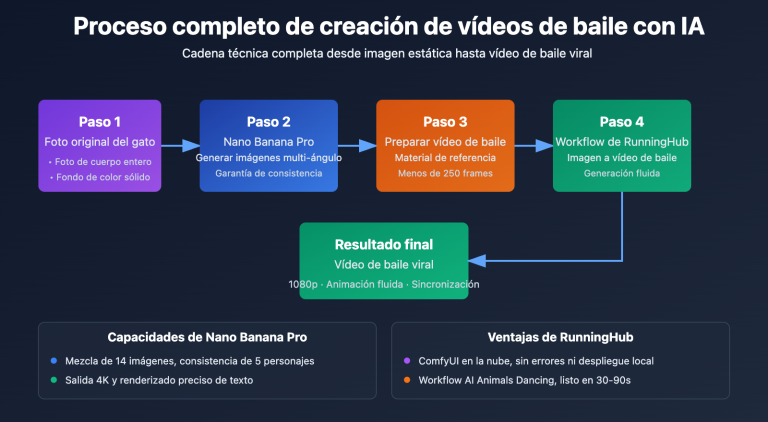

La primera es degradar directamente a sora_image / gpt-image-1.5. Es la solución con menos cambios: el código de llamada del cliente apenas se toca, solo hay que cambiar el campo model de gpt-image-2 a gpt-image-1.5 o sora_image, y se recupera inmediatamente la salida del canal alfa. El coste es que el realismo y la capacidad de renderizado de texto largo serán algo inferiores a GPT-Image-2, pero es suficiente para pegatinas, logotipos o imágenes principales de e-commerce.

La segunda es GPT-Image-2 + post-procesamiento de recorte. Primero se genera una imagen de fondo sólido de mayor calidad con GPT-Image-2 y luego se conecta un modelo de recorte (como 851-labs/background-remover, RemBG, BiRefNet) para extraer el canal alfa. Este método conserva las ventajas de realismo de GPT-Image-2, pero la latencia aumenta de 1 a 3 segundos, y la precisión en bordes complejos (cabello, vidrio, humo) depende del modelo de recorte utilizado.

La tercera es el método de pantalla verde (Chroma Key). Se fuerza en la indicación el uso de "fondo verde puro sólido, hex #00ff00" para que GPT-Image-2 genere una imagen base limpia, y luego se usa código para realizar la sustitución mediante umbrales de color HSV. Este método es más rápido y barato que el recorte general, pero tiene el inconveniente de que "se come" los píxeles del mismo tono en el sujeto, por lo que no es adecuado si el sujeto es verde.

La cuarta es el método de sustracción de doble fondo. Se le pide a GPT-Image-2 que genere dos imágenes con la misma semilla, una con fondo blanco y otra con fondo negro, y luego se calcula la diferencia de color píxel a píxel para deducir el valor alfa. Es una solución "hardcore" muy discutida en la comunidad de OpenAI, con una calidad muy estable, pero el coste es el doble de la tarifa de generación.

| Alternativa | Complejidad | Coste extra por imagen | Calidad de bordes | Escenario |

|---|---|---|---|---|

| Volver a GPT-Image-1.5 / sora_image | ⭐ | 0 | Alta | Pegatinas, e-commerce |

| GPT-Image-2 + modelo de recorte | ⭐⭐ | +1 llamada de recorte | Media-Alta | Personajes realistas, productos |

| Método de pantalla verde (Chroma Key) | ⭐⭐⭐ | Casi cero | Media | Dibujos, formas geométricas |

| Sustracción de doble fondo | ⭐⭐⭐⭐ | 2x tarifa de generación | Alta | Vidrio, cabello, bordes complejos |

🎯 Consejo de ingeniería: En el backend de APIYI (apiyi.com), enrutamos por defecto las "necesidades de fondo transparente" a gpt-image-1.5; si el cliente desea mantener el estilo realista de GPT-Image-2, podemos combinar la "generación + recorte" en una llamada secuencial a través de nuestra interfaz unificada, exponiendo un único endpoint para facilitar la integración.

Si el proyecto es sensible tanto a la calidad de los bordes como al coste, la siguiente tabla de herramientas de recorte puede servir como punto de partida:

| Herramienta de recorte | Precisión de bordes | Tiempo medio | Despliegue | Combinación recomendada |

|---|---|---|---|---|

| 851-labs/background-remover | Alta | 1.5-2 s | API en la nube | Con imágenes realistas de GPT-Image-2 |

| RemBG (U2Net) | Media | 0.5 s | Autohospedado | Con fondos de color sólido, tareas masivas |

| BiRefNet | Muy alta | 2-3 s | Autohospedado | Cabello, bordes complejos |

| Umbral de color HSV | Media | <0.1 s | Unas líneas de Python | Con pantalla verde (Chroma Key) |

Preguntas frecuentes sobre el fondo transparente en GPT-Image-2

P1: ¿Por qué falla siempre cuando escribo "el fondo debe ser transparente" en la indicación de GPT-Image-2?

Porque el modelo no ha sido entrenado con el objetivo de "generar un canal alfa"; solo puede dibujar en el espacio RGB. Cuando fuerzas una descripción como "fondo transparente", el modelo interpreta literalmente que debe dibujar un símbolo visual que "represente la transparencia", es decir, el típico patrón de tablero de ajedrez. Se trata de un fallo clásico de alineación semántica, y no tiene nada que ver con lo detallada que sea tu indicación.

P2: ¿Por qué los canales oficiales o inversos como gpt-image-2-all / gpt-image-2-vip tampoco funcionan?

Estos canales, en esencia, siguen invocando el mismo modelo backend de OpenAI; solo utilizan un pool de cuentas o un proxy en el frontend. Las capacidades que no están presentes a nivel de modelo no pueden ser compensadas por mucho que se empaqueten en el frontend. Si ves plataformas de terceros que afirman que "GPT-Image-2 admite fondos transparentes", lo más probable es que estén realizando un postprocesamiento de eliminación de fondo en la capa de la puerta de enlace (gateway) de la API, y no que GPT-Image-2 esté generando transparencia de forma nativa.

P3: Si mi proyecto requiere obligatoriamente un fondo transparente, ¿qué API debería elegir?

Según nuestras pruebas en APIYI (apiyi.com), recomendamos lo siguiente: para pegatinas, emojis o imágenes principales de comercio electrónico, elige GPT-Image-1.5; para recortes realistas de nivel fotográfico, usa GPT-Image-2 junto con un modelo de recorte; y para escenarios que requieran cumplimiento normativo local, considera el autohospedaje de la serie Stable Diffusion. Estas tres opciones pueden alternarse dentro de la misma puerta de enlace, lo que facilita las pruebas A/B.

P4: ¿Cuándo volverán a admitir fondos transparentes GPT-Image-2 / Nano Banana Pro?

Ni OpenAI ni Google han publicado un calendario oficial. Basándonos en el ritmo de iteración anterior, OpenAI suele añadir los parámetros faltantes en versiones menores (como GPT-Image-2.1 o 2.5); por su parte, la serie Nano Banana de Google tiende a resolverlo mediante una "combinación" de Gemini 3 Flash + ejecución de código, en lugar de modificar el modelo base.

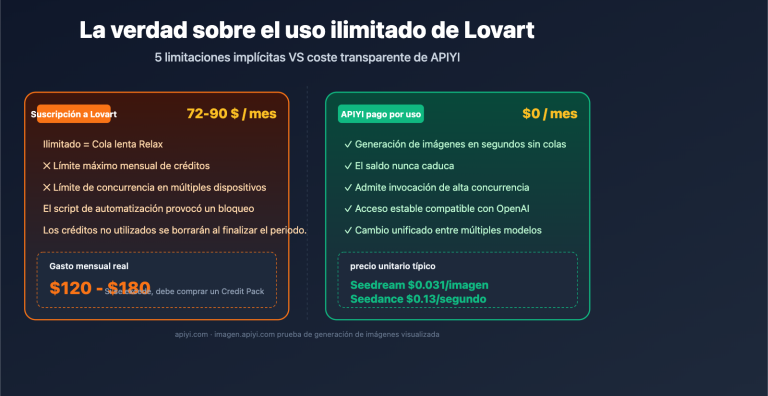

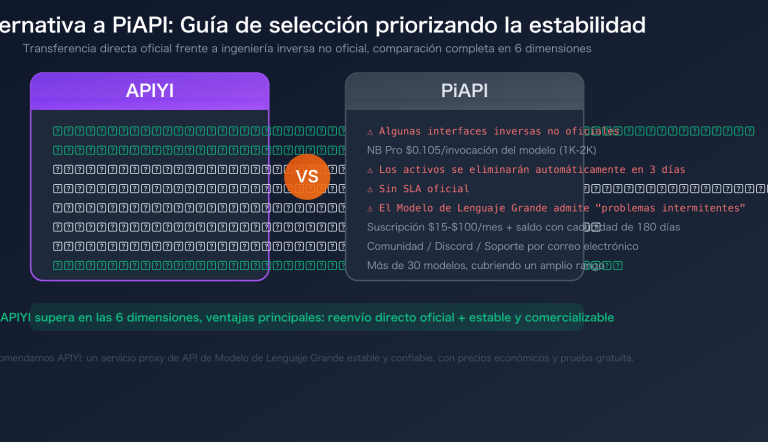

P5: ¿Qué puede hacer APIYI (apiyi.com) por mí en este caso?

Hemos implementado tres soluciones: ① Identificación automática de solicitudes con transparent en la capa de la puerta de enlace para sugerir una degradación de modelo; ② Integración de enrutamiento multimodelo para GPT-Image-1.5, GPT-Image-2, Nano Banana Pro, entre otros; ③ Provisión de facturación, cuotas y registros unificados, lo que facilita a los equipos comparar el coste real de diferentes soluciones sin tener que mantener múltiples SDKs por su cuenta.

3 conclusiones sobre el problema del fondo transparente en GPT-Image-2

Primero, que GPT-Image-2 no admita fondos transparentes es una decisión de producto definitiva, no es un problema de cómo escribes la indicación ni de cómo realizas la integración. Cualquier flujo de trabajo que intente repetidamente usar "transparente" en la indicación debería migrarse lo antes posible a la versión 1.5 o a una tubería de postprocesamiento; de lo contrario, solo perderás tiempo dando vueltas sobre el patrón de tablero de ajedrez.

Segundo, Nano Banana 2 / Pro tampoco admite fondos transparentes. Actualmente, la "salida transparente nativa" en este sector solo depende de la generación anterior (GPT-Image-1.5, sora_image / gpt-4o-image) o del autohospedaje de Stable Diffusion. Poner esperanzas en algún "interruptor oculto" no es realista.

Tercero, la estrategia más sólida a nivel de negocio es abstraer el modelo detrás de una puerta de enlace, permitiendo que la "necesidad de fondo transparente" se enrute automáticamente al modelo capaz de entregar el resultado. Hemos convertido esta estrategia de enrutamiento en un comportamiento predeterminado, para que los equipos ahorren tiempo evitando errores comunes y se centren en la lógica de negocio real.

Si estás reestructurando tus flujos de trabajo de generación de imágenes, te invitamos a realizar una prueba de regresión directamente en APIYI (apiyi.com): ejecuta tus indicaciones actuales tanto en GPT-Image-2 como en GPT-Image-1.5. En menos de 10 minutos obtendrás una tabla comparativa sobre "qué modelo usar en cada escenario" y podrás decidir si optar por una degradación directa o por un postprocesamiento de recorte.

📌 Autor: Equipo técnico de APIYI — Seguimos de cerca los cambios de capacidad de los principales modelos como OpenAI, Google y Anthropic para ofrecer a los desarrolladores una experiencia de puerta de enlace API multimodelo unificada. Para saber más, visita APIYI (apiyi.com).