OpenAI hat am 24. März 2026 per Entwicklerbenachrichtigung offiziell verkündet: Das Abschaltdatum für die Sora-2 API ist der 24. September 2026. Das bedeutet, dass alle Videogenerierungsdienste, die auf sora-2, sora-2-pro oder die Videos-API angewiesen sind, innerhalb von weniger als sechs Monaten migriert werden müssen.

Besonders kritisch ist, dass die sogenannten „Reverse-Sora-APIs“, die in den letzten sechs Monaten auf dem Markt kursierten, nach der Verschärfung der Sicherheitskontrollen durch OpenAI weitgehend unbrauchbar geworden sind. Sich weiterhin darauf zu verlassen, führt nur zu weiteren Problemen. Dieser Artikel analysiert den Zeitplan für die Abschaltung der Sora-2 API, die Auswirkungen und empfiehlt zwei produktionsreife Alternativen basierend auf Praxistests: SeeDance 2.0 von ByteDance und Wan 2.7 von Alibaba Tongyi.

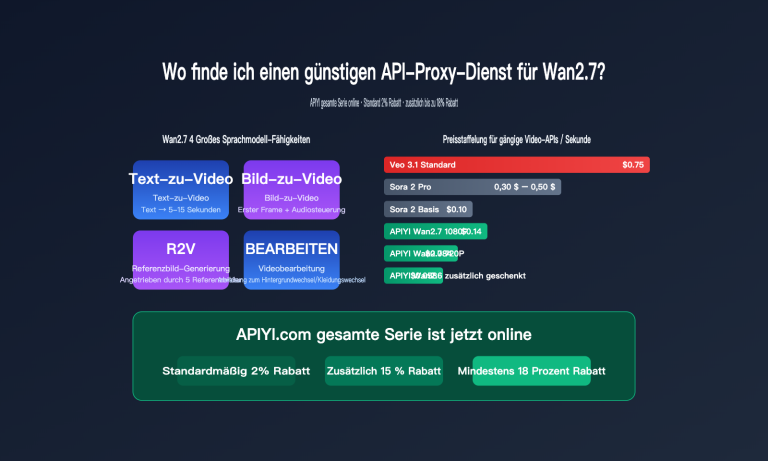

Wenn Sie die Sora-2 API derzeit für die Videoproduktion nutzen, empfehlen wir Ihnen, die Plattform APIYI (apiyi.com) für einen direkten Vergleichstest zwischen SeeDance 2.0 und Wan 2.7 zu verwenden. Die Plattform hat bereits mehrere führende Videogenerierungsmodelle integriert, was die Migrationskosten erheblich senkt.

Zeitplan und Auswirkungen der Sora-2 API-Abschaltung

Offizielle Meilensteine der Sora-2 API-Abschaltung

OpenAI verfolgt eine Zwei-Phasen-Abschaltstrategie: Zuerst werden die Endkundenanwendungen eingestellt, danach die B2B-API, wobei ein Puffer von etwa fünf Monaten für Entwickler bleibt. Dies ist eine der strukturiertesten „sanften Landungen“ in der Geschichte von OpenAI, doch das Zeitfenster für Entwickler bleibt äußerst knapp.

| Zeitstempel | Ereignis | Betroffene Zielgruppe | Puffer |

|---|---|---|---|

| 24.03.2026 | Offizielle Ankündigung | Alle Sora-2 API-Nutzer | T+0 |

| 26.04.2026 | Abschaltung von Sora Web & App | Endnutzer, Content Creator | T+33 Tage |

| 24.09.2026 | Sora-2 API offizielle Abschaltung | Alle API-integrierten Dienste | T+184 Tage |

| Nach 25.09.2026 | API-Endpunkte liefern 410 Gone | Nicht migrierte Dienste unterbrochen | — |

OpenAI empfiehlt im Hilfecenter ausdrücklich: Wer zuvor mit Sora erstellte Videoinhalte behalten möchte, muss den Datenexport vor der Abschaltung der App am 26. April abschließen. Für Entwickler, die die API nutzen, ist jedoch der 24. September die entscheidende Frist.

Es ist wichtig zu beachten, dass OpenAI keine Möglichkeit einer „Verlängerung“ in Aussicht gestellt hat. Betrachtet man die Abschaltungen von OpenAI seit 2025, ist eine Abschaltung zum Stichtag Standard. Man sollte sich also nicht auf Ausnahmen verlassen.

Liste der von der Abschaltung betroffenen Modelle

Viele Teams gehen davon aus, dass nur der Alias sora-2 abgeschaltet wird. Tatsächlich handelt es sich jedoch um die Einstellung der gesamten Videos-API-Modellreihe:

| Modell-ID | Typ | Status | Empfohlene Alternative |

|---|---|---|---|

sora-2 |

Standard-Alias | Abgeschaltet | SeeDance 2.0 / Wan 2.7 |

sora-2-pro |

HD-Alias | Abgeschaltet | SeeDance 2.0 (1080p) |

sora-2-2025-10-06 |

Standard-Snapshot | Abgeschaltet | SeeDance 2.0 |

sora-2-2025-12-08 |

Standard-Snapshot | Abgeschaltet | SeeDance 2.0 |

sora-2-pro-2025-10-06 |

Pro-Snapshot | Abgeschaltet | Wan 2.7 (inkl. Thinking Mode) |

| Videos API (gesamte Schnittstelle) | API-Endpunkt | Komplett eingestellt | Aggregator-Plattformen |

Das bedeutet: OpenAI behält keine Einstiegspunkte für die Videogenerierung bei. Ab dem 25. September werden alle Anfragen mit dem Präfix videos den Fehler 410 Gone oder eine Fehlermeldung zurückgeben. Dies unterscheidet sich grundlegend von früheren GPT-Modellen, bei denen Snapshots zwar abgeschaltet, Aliase aber beibehalten wurden.

🎯 Wichtige Information: Sie können die Migration nicht einfach durch eine „Umbenennung des Modells“ abschließen; Sie müssen auf eine völlig neue Videogenerierungs-API umsteigen. Wir empfehlen, die Integrationstests bis Ende Juni abzuschließen. Nutzen Sie Aggregator-Plattformen, um SeeDance 2.0 und Wan 2.7 direkt zu vergleichen und den Migrationsdruck in den letzten zwei Monaten zu vermeiden.

Die wahren Gründe für die Abschaltung der Sora-2 API

OpenAI hat keine detaillierten Gründe genannt, aber Analysen von Medien wie The Decoder, Futurum Group und Wikipedia deuten auf drei Hauptfaktoren hin:

- Nicht nachhaltige Rechenkosten: Die Videogenerierung erfordert pro Aufruf ein Vielfaches der GPU-Zeit im Vergleich zu Textmodellen, während die kommerziellen Einnahmen die Kosten nicht decken konnten. Nach dem Start von Sora-2 musste OpenAI die Kontingente pro Nutzer streng begrenzen, was wiederum das Interesse der Entwickler an einer Integration dämpfte.

- Hohe Risiken bei der Inhaltssicherheit: Trotz Wasserzeichen und Inhaltsprüfung kam es bei Sora immer wieder zu Deepfakes und Urheberrechtsstreitigkeiten. Die Kosten für Rechtssicherheit und Compliance überstiegen den Nutzen des Modells bei weitem.

- Strategische Fokussierung: OpenAI konzentriert seine Rechenkapazitäten vorrangig auf die GPT-Hauptlinie, Operator- und Agenten-Dienste. Video ist derzeit kein Kernbereich mehr.

Das Verständnis dieser Gründe ist wichtig für die Wahl einer Alternative. Anbieter, die kontinuierlich in die Videogenerierung investieren, betrachten Video als strategischen Hauptpfeiler. ByteDance und Alibaba sehen die Videogenerierung als strategische Priorität, weshalb ihr Innovationszyklus weit schneller ist als der von OpenAI – und genau deshalb sind sie in der Lage, die Sora-2-Nutzerbasis im Jahr 2026 zu übernehmen.

title: "Warum die 'Reverse-Sora-API' keine Option mehr ist"

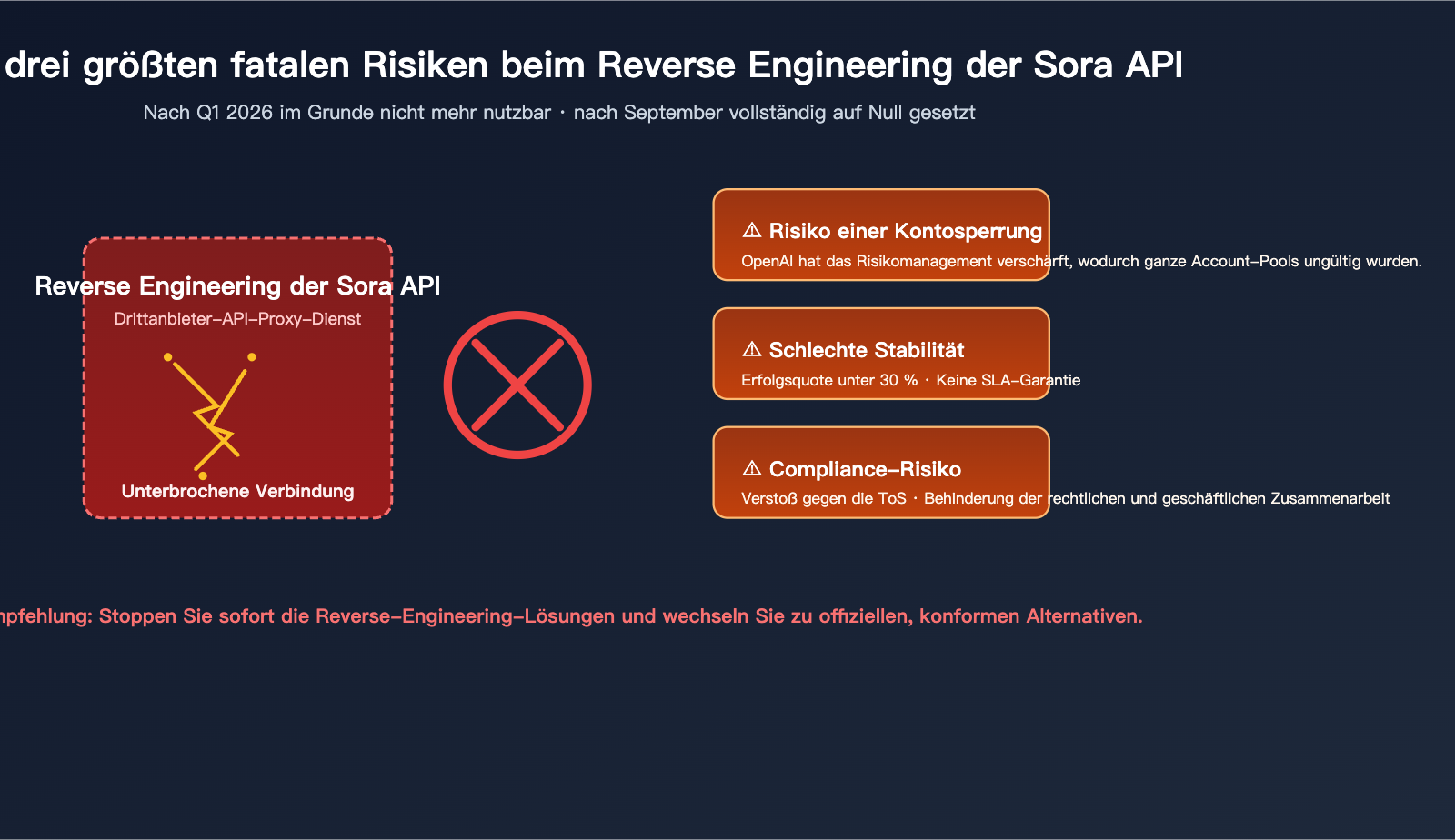

Warum die "Reverse-Sora-API" keine Option mehr ist

Status quo der Reverse-Sora-API im Jahr 2026

Im letzten halben Jahr kursierten in chinesischsprachigen Kreisen zahlreiche Reverse-Schnittstellen, die versprachen, "Sora-2 ohne OpenAI-Konto nutzen zu können", zu Preisen, die nur einen Bruchteil der offiziellen Kosten betrugen. Doch laut Rückmeldungen aus verschiedenen Entwickler-Communities sind diese Schnittstellen seit dem ersten Quartal 2026 praktisch unbrauchbar:

- OpenAI hat im Januar 2026 die Cloudflare-Risikokontrollregeln aktualisiert, wodurch viele Reverse-Schnittstellen direkt mit einem 403-Fehler antworten.

- Einige Anbieter nutzen Konten-Pools, doch OpenAI hat das Vorgehen gegen massenhafte, verdächtige Konten verschärft, was zum Ausfall ganzer Pools führt.

- Selbst wenn ein Aufruf gelegentlich funktioniert, ist die Generierungsgeschwindigkeit extrem langsam und die Erfolgsquote liegt unter 30 % – für den produktiven Einsatz völlig ungeeignet.

- Immer mehr Anbieter von Reverse-Diensten "verschwinden" oder stellen ihr Geschäftsmodell um, wodurch eingezahlte Guthaben verloren gehen.

Noch entscheidender: Da OpenAI beschlossen hat, die offizielle API am 24. September einzustellen, wird auch die "Quelle" der Reverse-Schnittstellen vollständig versiegen. Dieser Weg führt nach September ins Nichts.

3 Gründe, warum Sie nicht weiter in Reverse-Lösungen investieren sollten

| Risikodimension | Konkrete Auswirkungen | Geschäftliche Folgen |

|---|---|---|

| Stabilitätsrisiko | Schnittstellen werden jederzeit gesperrt, keine SLA-Garantie | Produktionsumgebungen fallen aus |

| Compliance-Risiko | Verstoß gegen OpenAI ToS, potenziell illegaler Kontenhandel | Rechtliche Probleme und blockierte Partnerschaften |

| Versunkene Kosten | Offizielle Einstellung nach September macht Reverse-Lösungen wertlos | Ressourcenverschwendung durch doppelte Migration |

| Datenrisiko | Drittanbieter-Proxys können auf Ihre Eingabeaufforderungen und Inhalte zugreifen | Abfluss von Geschäftsgeheimnissen |

⚠️ Dringende Empfehlung: Falls Ihr Team derzeit noch irgendeine Form der Reverse-Sora-API verwendet, stoppen Sie bitte sofort die Entwicklung neuer Funktionen und evaluieren Sie vorrangig offizielle, konforme Alternativen. Wir empfehlen die Anbindung über eine konforme Aggregator-Plattform direkt an SeeDance 2.0 oder Wan 2.7, um die Service-Stabilität zu gewährleisten und spätere Compliance-Probleme zu vermeiden.

Sora-2 API-Alternative 1: SeeDance 2.0

Die Kernpositionierung von SeeDance 2.0

SeeDance 2.0 ist das Flaggschiff-Modell für Videogenerierung, das vom Doubao-Team von ByteDance am 9. Februar 2026 offiziell veröffentlicht wurde. Seit dem 14. April befindet es sich auf der BytePlus ModelArk-Plattform von Volcano Engine im öffentlichen Betatest und ist seit dem 9. April über die fal-Plattform verfügbar. Auf der Bestenliste für Videomodelle von Artificial Analysis erreichte SeeDance 2.0 einen Elo-Wert von 1269 und übertraf damit Google Veo 3, OpenAI Sora 2 und Runway Gen-4.5 – es ist derzeit die Nummer 1 auf der öffentlichen Bestenliste.

Der größte Unterschied liegt in der einheitlichen, multimodalen Architektur für die gemeinsame Audio- und Videogenerierung. Anstatt erst ein Video zu erstellen und dann Audio hinzuzufügen, wird in einem einzigen Inferenzschritt ein bis zu 15 Sekunden langer, filmreifer Audio-Video-Inhalt ausgegeben. Diese Fähigkeit der "Audio-Bild-Einheit" ist mit dem Ansatz von Sora-2, bei dem erst das Video generiert und dann ein TTS-System extern angehängt wird, nicht vergleichbar.

Überblick über die Fähigkeiten von SeeDance 2.0

| Fähigkeitsdimension | SeeDance 2.0 Leistung | Vergleich zu Sora-2 |

|---|---|---|

| Maximale Dauer pro Aufruf | 15 Sekunden | Gleichstand |

| Synchrones Audio | Native Audio-Video-Generierung | Sora-2 benötigt externes TTS |

| Eingabemodalitäten | Text / Bild / Audio / Video | Sora-2 nur Text + Bild |

| Kamerasteuerung | Regie-Befehle für Kamerafahrten | Sora-2 schwächer |

| Physikalische Realität | Branchenführend | Gleichstand |

| Artificial Analysis Elo | 1269 (#1) | ~1180 |

| Öffentliche Kanäle | BytePlus ModelArk / fal / Aggregator | OpenAI offiziell (wird eingestellt) |

| Verständnis chinesischer Eingabeaufforderungen | Exzellent | Durchschnittlich |

SeeDance 2.0 ist derzeit über die APIYI-Plattform (apiyi.com) für interne Tests verfügbar. Wenn Sie nach einer Ersatzlösung für Sora-2 suchen, können Sie den Kundenservice der Plattform kontaktieren, um Testkontingente für SeeDance 2.0 freischalten zu lassen und diese einheitlich über das OpenAI-kompatible Protokoll aufzurufen.

Beispiel für einen SeeDance 2.0-Aufruf

Hier ist ein minimalistisches Beispiel für den Aufruf von SeeDance 2.0 über die OpenAI-kompatible Schnittstelle:

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

response = client.videos.generate(

model="seedance-2.0",

prompt="Eine orangefarbene Katze springt von der Fensterbank auf das Sofa, die Abendsonne fällt durch die Jalousien, die Kamera folgt der Katze mit einer langsamen Kamerafahrt",

duration=10,

audio=True,

aspect_ratio="16:9"

)

print(response.video_url)

📌 Vollständiges Aufrufbeispiel (inkl. Fehlerbehandlung und Polling)

import time

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

def generate_seedance_video(prompt: str, duration: int = 10):

try:

task = client.videos.generate(

model="seedance-2.0",

prompt=prompt,

duration=duration,

audio=True,

aspect_ratio="16:9",

resolution="1080p"

)

while True:

status = client.videos.retrieve(task.id)

if status.state == "completed":

return status.video_url

elif status.state == "failed":

raise RuntimeError(f"Aufgabe fehlgeschlagen: {status.error}")

time.sleep(5)

except Exception as e:

print(f"Aufruffehler: {e}")

return None

url = generate_seedance_video(

prompt="Ein nostalgischer roter Doppeldeckerbus fährt durch die Londoner Straßen nach dem Regen, die Spiegelung der Straßenlaternen ist im Fenster zu sehen",

duration=12

)

print(url)

Einsatzszenarien für SeeDance 2.0

- Marken-Kurzvideos: Synchrones natives Audio + filmreife Kameraführung, ideal für Werbespots und Markenmaterial.

- Multimodale Kreationen: Unterstützt Audio und Video als Referenz, ideal für IP-Inhaltsableitungen.

- Charakterkonsistenz: Hervorragende multimodale Referenzfähigkeiten, ideal für die Produktion von Serieninhalten.

- Social-Media-Marketing im Ausland: Native Ausgabe in verschiedenen Formaten (16:9 / 9:16 / 1:1), direkt angepasst für TikTok, YouTube und Instagram.

- Musik-Videos: Die gemeinsame Generierung von Audio und Video ermöglicht eine natürliche Synchronisation von Bild und Musikrhythmus.

title: "Sora-2 API-Alternative 2: Wan 2.7"

Kernpositionierung von Wan 2.7

Wan 2.7 ist ein Videogenerierungsmodell der neuen Generation, das im März 2026 vom Alibaba Tongyi Lab veröffentlicht wurde. Es basiert auf einer 27B-Parameter-MoE-Architektur (Mixture-of-Experts) und nutzt die Technologie-Route Diffusion Transformer + Flow Matching. Es ist über die Plattformen Alibaba Cloud DashScope und WaveSpeedAI verfügbar und ist das erste MoE-Videomodell eines chinesischen Anbieters mit öffentlicher API.

Im Gegensatz zu SeeDance 2.0, das auf multimodale Fusion setzt, bietet Wan 2.7 zwei einzigartige Verkaufsargumente: den Thinking Mode (Denkmodus) und die präzise Steuerung von Start- und Endbildern. Es kann die Szenenstruktur "durchdenken", bevor es das Video generiert, und ermöglicht die gleichzeitige Vorgabe von Schlüsselbildern für den Anfang und das Ende – beides Funktionen, die der aktuelle Sora-2 API fehlen.

Die wichtigsten Fähigkeiten von Wan 2.7 im Überblick

| Fähigkeitsdimension | Wan 2.7 Leistung | Vergleich zu Sora-2 |

|---|---|---|

| Modellarchitektur | 27B MoE | Nicht öffentlich |

| Maximale Dauer | 15 Sekunden | Gleichstand |

| Maximale Auflösung | 1080p | Gleichstand |

| Thinking Mode | ✅ Unterstützt Szenen-Denken | ❌ Nicht unterstützt |

| Start-/Endbild-Steuerung | ✅ Start- & Endbild gleichzeitig | ❌ Nur Startbild |

| 9-Raster-Referenzbild | ✅ Bis zu 9 Referenzbilder | ❌ Nicht unterstützt |

| Subjekt- + Sprachreferenz | ✅ Kombinierte Referenz | ❌ Nicht unterstützt |

| Prompt-Längenlimit | 5000 Zeichen | ~1000 Zeichen |

| Öffentliche API-Kanäle | Alibaba DashScope / WaveSpeedAI / Aggregator | OpenAI offiziell (wird eingestellt) |

| Preisbeispiel | ab $0,10/Sek. | ab $0,50/Sek. |

🎯 Szenario-Empfehlung: Wenn Ihre Videogenerierung klare Anforderungen an den Start- und Endbildinhalt hat (z. B. Marken-Intros/Outros, Werbe-Countdowns), ist die Steuerung von Wan 2.7 durch nichts zu ersetzen. Wir empfehlen die Nutzung über einen API-Proxy-Dienst, um die Komplexität des Alibaba-SDKs zu umgehen.

Beispiel für den Wan 2.7-Aufruf

from openai import OpenAI

# Initialisierung über APIYI-Proxy

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

response = client.videos.generate(

model="wan-2.7",

prompt="Neon-Straßen im Cyberpunk-Stil, die Kamera fährt langsam vom Boden hoch zur Vogelperspektive der Stadt",

first_frame_url="https://example.com/start.png",

last_frame_url="https://example.com/end.png",

thinking_mode=True,

duration=10

)

print(response.video_url)

📌 Vollständiges Beispiel für Wan 2.7 mit mehreren Referenzbildern (9-Raster-Eingabe + Thinking Mode)

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

# Liste mit 9 Referenzbildern

reference_images = [

f"https://example.com/ref{i}.png" for i in range(1, 10)

]

response = client.videos.generate(

model="wan-2.7",

prompt=(

"Der Protagonist durchquert 9 verschiedene Szenen,"

"jede Szene entspricht einem der Referenzbilder,"

"das Video behält das Aussehen und die Kleidung konsistent bei"

),

reference_images=reference_images,

thinking_mode=True,

duration=15,

resolution="1080p",

audio=True

)

print(response.video_url)

Anwendungsbereiche für Wan 2.7

- Marken-Intros/Outros: Präzise Steuerung von Start- und Endbildern, kein nachträgliches Schneiden nötig.

- Konsistente Charakterserien: 9-Raster-Referenzbilder sorgen dafür, dass Charaktere über mehrere Einstellungen hinweg nicht "driften".

- Komplexe Szenenabfolgen: Der Thinking Mode plant automatisch die Kameraführung, ideal für Kurzfilme und Werbung.

- Instruktionsbasierte Bearbeitung: Unterstützt die Bearbeitung bestehender Videos mittels natürlicher Sprache.

- 9-Raster-Storytelling: Mehrere Schlüsselbilder für eine zusammenhängende Erzählung in einem Video.

SeeDance 2.0 vs. Wan 2.7 vs. Sora-2: Ein umfassender Vergleich

Vergleich der Kernkennzahlen der drei Modelle

| Vergleichsdimension | Sora-2 (wird eingestellt) | SeeDance 2.0 | Wan 2.7 |

|---|---|---|---|

| Anbieter | OpenAI | ByteDance | Alibaba Tongyi |

| Veröffentlichungsdatum | 10/2025 | 09.02.2026 | 03/2026 |

| Servicestatus | Einstellung am 24.09.2026 | Öffentliche Beta | Öffentliche Beta |

| Maximale Dauer | 15s | 15s | 15s |

| Maximale Auflösung | 1080p | 1080p | 1080p |

| Natives Audio | ✅ | ✅ (kombinierte Erzeugung) | ✅ |

| Multimodale Eingabe | Text+Bild | Text+Bild+Audio+Video | Text+mehrere Referenzbilder |

| Start-/Endbild-Kontrolle | ❌ | ❌ | ✅ bidirektional |

| Thinking Mode | ❌ | ❌ | ✅ |

| Artificial Analysis Elo | ~1180 | 1269 (#1) | noch nicht gelistet |

| Chinesische Unterstützung | Durchschnittlich | Exzellent | Exzellent |

| In China konform nutzbar | ❌ | ✅ | ✅ |

| Referenzpreis | $0,50/Sek. | $0,30/Sek. | ab $0,10/Sek. |

Empfehlungen zur Szenario-Auswahl

| Geschäftsszenario | Bevorzugte Lösung | Begründung |

|---|---|---|

| Marken-Werbevideos | SeeDance 2.0 | Synchrones Audio + filmische Kameraführung |

| Kurzserien/Serieninhalte | Wan 2.7 | 9-Raster-Referenz garantiert Gesichtskonsistenz |

| Intro/Outro-Anpassung | Wan 2.7 | Präzise Kontrolle von Start- und Endbild |

| Multimodale Zweitverwertung | SeeDance 2.0 | Unterstützt Audio- und Video-Referenzeingabe |

| Chinesischsprachige Texte | Beide möglich | Beide verstehen Chinesisch besser als Sora-2 |

| Fokus auf höchste Qualität | SeeDance 2.0 | Platz 1 bei Artificial Analysis |

| Kostensensible Massenproduktion | Wan 2.7 | Ab $0,10/Sek., deutlicher Preisvorteil |

| Internationale Social Media | SeeDance 2.0 | Native Ausgabe in mehreren Seitenverhältnissen |

| E-Commerce-Produktvideos | Wan 2.7 | Subjekt-Referenz sichert konsistentes Produktaussehen |

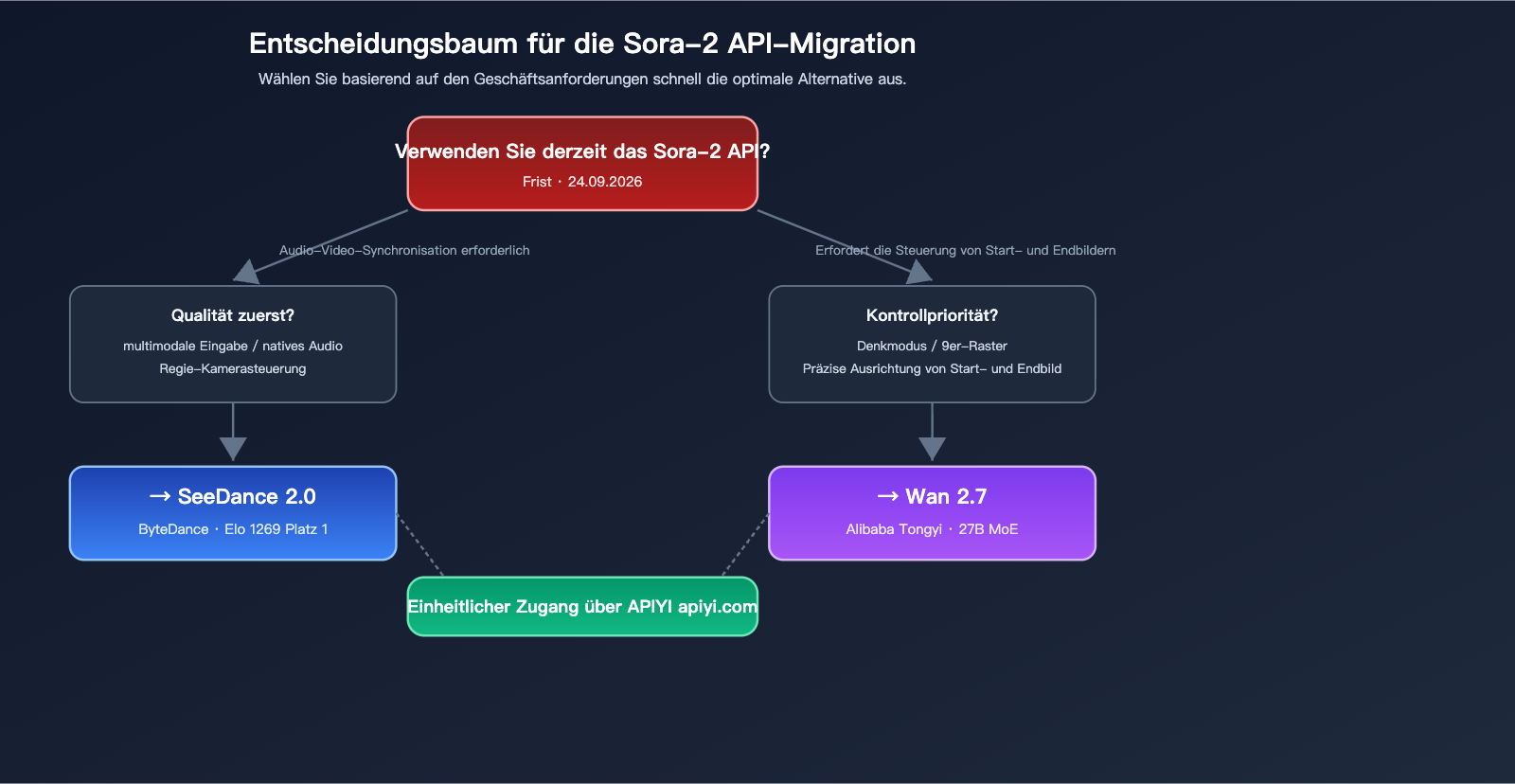

💡 Auswahlempfehlung: Wenn Sie sich kurzfristig für eines entscheiden müssen, ist SeeDance 2.0 für "Qualitäts-fokussierte" Szenarien und Wan 2.7 für "Kontroll-fokussierte" und "Kosten-fokussierte" Szenarien geeignet. Es empfiehlt sich, auf einer aggregierten Plattform Zugriff auf beide Modelle zu erhalten und je nach Geschäftsanforderung dynamisch zu routen, um während der Migrationsphase maximale Flexibilität zu bewahren.

Kostenkalkulation der drei Modelle (10 Sek. 1080p-Video)

| Modell | Geschätzte Kosten pro Durchlauf | Geschätzte monatliche Kosten (10k) | Anmerkung |

|---|---|---|---|

| Sora-2 | ~$5,00 | ~$50.000 | Nach September nicht mehr verfügbar |

| SeeDance 2.0 | ~$3,00 | ~$30.000 | Inkl. nativem Audio |

| Wan 2.7 | ~$1,00 | ~$10.000 | Einstiegspreis |

Hinweis: Die obigen Daten basieren auf öffentlich zugänglichen Informationen. Aktuelle Preise entnehmen Sie bitte den neuesten Angeboten der Hersteller. Die Nutzung über eine Aggregator-Plattform bietet oft zusätzliche Preisvorteile gegenüber Einzelkonten.

Schnelleinstieg: Migration der Sora-2 API zu Alternativen

Entscheidungsbaum für den Migrationspfad

Die Migration der Sora-2 API zu einer Alternative lässt sich grob in 4 Schritte unterteilen:

- Bestandsaufnahme der Sora-2 Aufrufe: Identifizieren Sie alle Codepfade, die

sora-2oder die Videos-API aufrufen, und listen Sie Prompt-Vorlagen, Eingabeparameter und die Logik zur Ausgabeverarbeitung auf. - Auswahl des Zielmodells: Bestimmen Sie das primäre Modell basierend auf den oben genannten Szenario-Empfehlungen.

- Ersetzen von base_url und Modellname: Ersetzen Sie die OpenAI

base_urldurch die der Aggregator-Plattform (z. B.https://api.apiyi.com/v1) und ändern Sie den Modellnamen inseedance-2.0oderwan-2.7. - Regressionstests: Führen Sie eine Reihe repräsentativer Prompts durch die gesamte Kette aus und vergleichen Sie die Qualität und Latenz der neuen mit der alten Ausgabe.

Einmalige Anbindung beider Alternativen über eine Aggregator-Plattform

from openai import OpenAI

# APIYI bietet eine einheitliche Schnittstelle

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

def generate_video(prompt: str, prefer: str = "seedance"):

model = "seedance-2.0" if prefer == "seedance" else "wan-2.7"

return client.videos.generate(

model=model,

prompt=prompt,

duration=10,

audio=True

)

video_a = generate_video("Produktwerbung: Intelligenter Lautsprecher spielt Musik", prefer="seedance")

video_b = generate_video("Marken-Intro: Logo erscheint aus Lichtflecken", prefer="wan")

Der Vorteil dieser Methode ist, dass Sie mit einem SDK, einem API-Schlüssel und einer base_url beide Alternativen gleichzeitig aufrufen können. Sobald Sora-2 am 24. September endgültig abgeschaltet wird, müssen Sie lediglich model="sora-2" in model="seedance-2.0" oder model="wan-2.7" ändern – der restliche Code bleibt unangetastet.

Migrations-Checkliste (zum Ausdrucken)

| Phase | Aufgabe | Geschätzter Zeitaufwand |

|---|---|---|

| Analyse | Alle Sora-2 Aufrufstellen auflisten | 0,5 Tage |

| Analyse | 50-100 repräsentative Prompts zusammenstellen | 1 Tag |

| Anbindung | Konto und Kontingent bei Aggregator beantragen | 0,5 Tage |

| Anbindung | base_url und Modellfelder anpassen |

1 Tag |

| Test | Regressionstests ausführen | 2-3 Tage |

| Test | Blindtest der Qualität durch Produkt/Design | 1 Woche |

| Rollout | 10%-30% des Traffics umstellen | 1 Woche |

| Rollout | 100% Traffic-Umstellung | — |

| Abschluss | Sora-2 Aufrufcode entfernen | 0,5 Tage |

Bei diesem Zeitplan können Sie die Migration in 4-6 Wochen vollständig abschließen. Dies lässt ein Zeitfenster von mindestens 2 Monaten für den stabilen Betrieb und ausreichend Puffer vor der Deadline am 24. September.

🎯 Migrationstipp: Warten Sie nicht bis September mit dem Testen. Eröffnen Sie sofort ein Konto auf der Aggregator-Plattform, klonen Sie den bestehenden Sora-2-Code und ändern Sie die

base_urlaufhttps://api.apiyi.com/v1. So können Sie Vergleichsexperimente zwischen Sora-2 und den Alternativen parallel durchführen und auf Basis echter Geschäftsdaten entscheiden.

Kostenkontrolle während der Migration

Die Stückpreise für die Videoerzeugung liegen deutlich über denen von Textmodellen. Ohne Optimierung kann sich Ihre API-Rechnung während der Migration leicht verdoppeln. Beachten Sie folgende Strategien:

- Downgrade-Strategie: Nutzen Sie in der Testphase bevorzugt 720p / 5-Sekunden-Videos, bevor Sie auf 1080p / 15 Sekunden umsteigen.

- Caching: Nutzen Sie Content-Hash-Caching für Anfragen mit identischem Prompt und gleichen Parametern, um redundante Erzeugungen zu vermeiden.

- Aggregierte Abrechnung: Die zentrale Abrechnung über eine Plattform verhindert Mindestumsatzschwellen bei mehreren Einzelanbietern.

- Batch-Verarbeitung: Nutzen Sie den Batch-Modus der Hersteller für nächtliche Generierungen, um 30-50% Rabatt zu erhalten.

- Prompt-Optimierung: Durch präzisere Prompts reduzieren Sie die Anzahl der Neugenerierungen, was meist 20-40% der Kosten einspart.

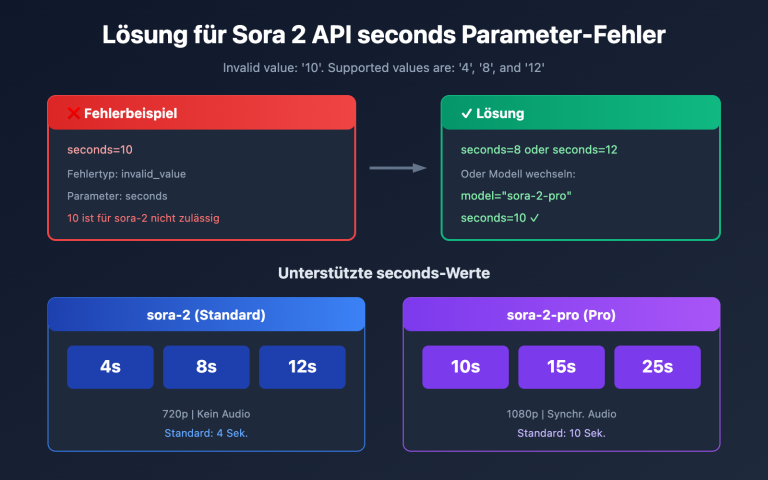

Häufige Migrationsfallen und Lösungen

| Problem | Ursache | Lösung |

|---|---|---|

| Inkonsistente Seitenverhältnisse | Unterschiedliche Standard-aspect_ratio |

Parameter aspect_ratio explizit angeben |

| Unterschiede bei der Dauer | Manche Modelle rechnen pro Sekunde | duration explizit nach Bedarf angeben |

| Fehlendes Audio | Unterschiedliche Audio-Schnittstellen | audio=True explizit aktivieren |

| Prompt-Stil-Drift | Unterschiedliche Prompt-Präferenzen | Prompts für jedes Modell individuell optimieren |

| Callback-Unterschiede | Manche Plattformen unterstützen nur Polling | Webhook der Aggregator-Plattform nutzen |

FAQ zur Einstellung der Sora-2 API

Q1: Sind bereits generierte Videos nach der Einstellung der Sora-2 API noch nutzbar?

Ja. Videodateien, die bereits lokal oder in einem OSS gespeichert wurden, sind von der API-Einstellung nicht betroffen. Wenn Sie jedoch direkt auf die von OpenAI bereitgestellte video_url verlinkt haben, werden diese Links nach der Einstellung der API ungültig. Stellen Sie sicher, dass Sie alle Videos bis zum 24. September in Ihren eigenen Objektspeicher übertragen. Bei großen Datenmengen können Sie die Video-Proxy-Funktionen der Plattform APIYI (apiyi.com) nutzen, um die Dateien stapelweise herunterzuladen; die Plattform übernimmt dabei automatisch das Raten-Limit und Wiederholungsversuche bei Fehlern.

Q2: Wird OpenAI in Zukunft eine Sora-3 API veröffentlichen?

OpenAI hat keinen Zeitplan für Sora-3 bekannt gegeben. Strategisch gesehen priorisiert OpenAI derzeit die Rechenleistung für die GPT-Hauptlinie und Agenten-Dienste; die Wahrscheinlichkeit einer kurzfristigen Wiederaufnahme der Video-Generierungs-API ist gering. Analysen von Wikipedia und der Futurum Group deuten darauf hin, dass die hinter den Erwartungen zurückgebliebene Kommerzialisierung von Sora der Hauptgrund für die Einstellung ist. Es wird empfohlen, Ihre Geschäftsplanung nicht auf die Hoffnung zu stützen, dass "Sora-3 vielleicht zurückkehrt", sondern die Migration zu SeeDance 2.0 oder Wan 2.7 abzuschließen.

Q3: Können SeeDance 2.0 und Wan 2.7 in Festlandchina stabil aufgerufen werden?

Ja. Beide Modelle werden von ByteDance bzw. Alibaba betrieben. Die Service-Knoten befinden sich im Inland, wodurch die Netzwerkstabilität weitaus besser ist als bei grenzüberschreitenden Aufrufen von OpenAI. Wenn Sie für Sora-2 zuvor Proxys oder ausländische Server nutzen mussten, kann die Netzwerkarchitektur nach der Migration auf diese beiden Modelle vereinfacht werden. Durch die Nutzung einer inländischen, konformen Aggregationsplattform lassen sich Stabilität und steuerliche Compliance gleichzeitig lösen.

Q4: Lohnt es sich noch, die Sora-API zu reverse-engineeren?

Davon ist abzuraten. Die Stabilität von Reverse-Engineering-APIs hat nach Q1 2026 drastisch abgenommen, und nach dem 24. September, wenn die offizielle Quelle verschwindet, werden diese Schnittstellen zwangsläufig komplett ausfallen. Weiter in Reverse-Engineering-Lösungen zu investieren, bedeutet, neuen Code auf einem veralteten Technologie-Stack aufzubauen, was die Migrationskosten nur weiter in die Höhe treibt. Der wirtschaftlichste Weg ist die direkte Migration zu SeeDance 2.0 oder Wan 2.7.

Q5: Wie evaluiert man die tatsächliche Leistung von Alternativen während der Migration?

Wir empfehlen eine dreidimensionale Bewertung: Visuelle Qualität (subjektive Bewertung), Einhaltung der Eingabeaufforderung (objektiver Vergleich) und Kosten pro Einheit (finanzielle Kalkulation). Gehen Sie so vor, dass Sie 50 repräsentative Eingabeaufforderungen aus Ihren historischen Sora-2-Aufrufen extrahieren, diese mit SeeDance 2.0 und Wan 2.7 erneut ausführen und von Ihrem Produktteam blind bewerten lassen. Nutzen Sie eine Aggregationsplattform für den Test, um einheitliche Abrechnungen und Protokolle zu erhalten, damit Sie schnell die beste Wahl für Ihr Unternehmen treffen können.

Q6: Ändern sich die API-Schnittstellenspezifikationen nach dem Wechsel zu einer Aggregationsplattform?

Aggregationsplattformen unterstützen in der Regel das OpenAI-kompatible Protokoll. Das bedeutet, dass Ihr bestehendes Code-Framework für Sora-2 weitgehend beibehalten werden kann; Sie müssen lediglich die Felder base_url und model anpassen. Die Parameter für die Videoerzeugung (Eingabeaufforderung, Dauer, Audio, Auflösung usw.) können sich zwischen den Modellen leicht unterscheiden. Die Aggregationsplattform übernimmt die Parametereinheitlichkeit; Details dazu finden Sie in der Dokumentation der Plattform.

Q7: Sollte ich sofort migrieren oder bis September warten?

Wir empfehlen dringend, sofort mit dem Testen zu beginnen und die Migration bis Ende Juni abzuschließen. Dafür gibt es drei Gründe:

- Je näher der 24. September rückt, desto stärker werden die Migrationsfenster von allen Sora-2-Nutzern beansprucht, was die Ressourcen der Aggregationsplattformen und Alternativmodelle verknappt.

- Eine frühzeitige Migration ermöglicht einen gründlichen Vergleich beider Alternativen, um kurzfristige Fehlentscheidungen zu vermeiden.

- Entwickler, die frühzeitig migrieren, erhalten oft bessere Testkontingente und Preisvorteile.

Q8: Welches Modell, SeeDance 2.0 oder Wan 2.7, ist besser für chinesische Eingabeaufforderungen geeignet?

Beide sind dem Sora-2 in Bezug auf das Verständnis chinesischer Sprache deutlich überlegen. SeeDance 2.0 ist nuancierter bei der Darstellung chinesischer Emotionen und Bewegungsabläufe, während Wan 2.7 dank der Unterstützung von 5000 Zeichen langen Eingabeaufforderungen und einem "Thinking Mode" in komplexen chinesischen Erzählszenarien stabiler agiert. Wenn Ihre Eingabeaufforderungen meist unter 200 Zeichen liegen, wählen Sie SeeDance 2.0; wenn Sie häufig komplexe Bildsequenzen beschreiben müssen, wählen Sie Wan 2.7.

Q9: Wie lässt sich während der Migration ein Serviceausfall vermeiden?

Der sicherste Weg ist das "Double-Writing & Double-Reading": Während der Umstellungsphase rufen Sie sowohl Sora-2 als auch das Zielmodell auf, speichern beide Ausgaben und steuern das Frontend per A/B-Switching. Sollte das Zielmodell Probleme bereiten, können Sie sofort auf Sora-2 zurückgreifen (vor dem 24. September), um das Risiko zu minimieren. Aggregationsplattformen unterstützen in der Regel dynamisches Routing basierend auf dem Modellfeld, was die Kosten für dieses Verfahren sehr gering hält.

Fazit: Der beste Weg nach der Einstellung der Sora-2 API

OpenAI hat den 24. September 2026 als Datum für die Einstellung der Sora-2 API festgelegt. Damit bleibt weniger als ein halbes Jahr Zeit für alle Videogenerierungs-Dienste. Die "günstige Übergangslösung" durch Reverse-Engineering hat aufgrund verschärfter Risikokontrollen und der offiziellen Einstellung ihren Wert verloren.

Glücklicherweise hat sich der Markt für Videogenerierung 2026 zu einer gesunden, multipolaren Landschaft entwickelt: SeeDance 2.0 ist mit einem Artificial Analysis Elo-Wert von 1269 der Qualitätsführer und glänzt bei multimodalen Eingaben sowie der nativen Audio-Video-Generierung. Wan 2.7 bietet durch den "Thinking Mode" und die Kontrolle von Start- und Endbildern einzigartige Vorteile für Szenarien, die eine präzise Bildsteuerung erfordern. Beide Lösungen sind Sora-2 in Bezug auf chinesische Sprachunterstützung, inländische Compliance und Stabilität überlegen.

Unser Rat: Setzen Sie nicht alles auf eine Karte. Nutzen Sie die Plattform APIYI (apiyi.com), um sowohl SeeDance 2.0 als auch Wan 2.7 anzubinden und je nach Anforderung dynamisch zu routen – qualitätsorientierte Inhalte über SeeDance 2.0, präzise gesteuerte Bilder über Wan 2.7. Diese Zwei-Modell-Architektur garantiert Stabilität während der Migration und führt Ihre Sora-2-Dienste nahtlos in die Zukunft.

Das Wichtigste: Fangen Sie jetzt an. Wenn Sie bis August oder September warten, werden Modellanpassungen, Optimierungen der Eingabeaufforderungen und die Beantragung von Kontingenten deutlich schwieriger. Starten Sie diese Woche mit einem PoC-Test, klonen Sie Ihren bestehenden Sora-2-Code für parallele Tests und nutzen Sie reale Geschäftsdaten für Ihre Entscheidung, um sicherzustellen, dass Ihre alternative Lösung am 24. September bereits seit mindestens zwei Monaten stabil läuft.

Autor: APIYI Team — Spezialisiert auf API-Proxy-Dienste für große Sprachmodelle und Aggregationsdienste für Videogenerierungsmodelle