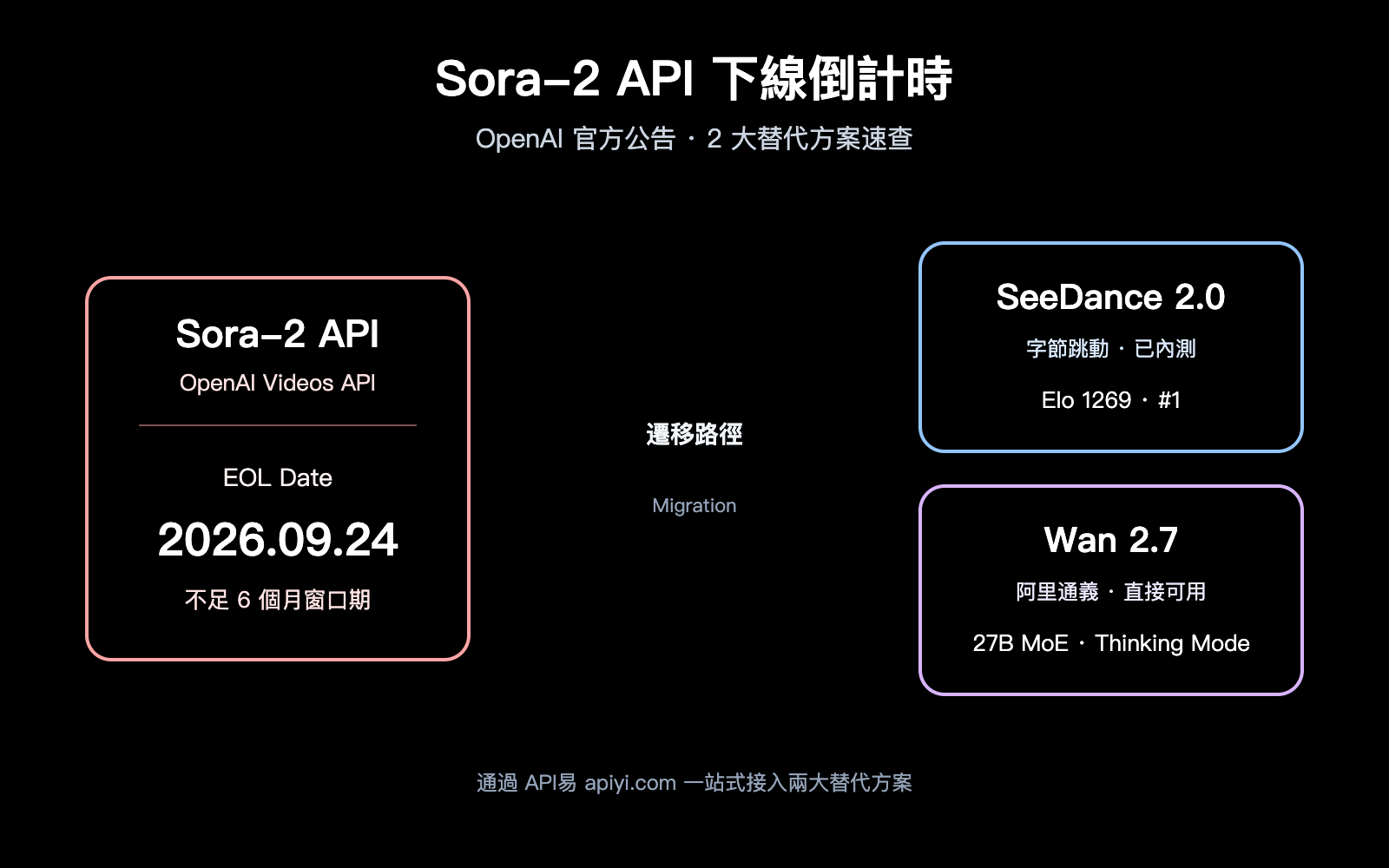

OpenAI 已經在 2026 年 3 月 24 日通過開發者通知正式宣佈: Sora-2 API 下線時間確定爲 2026 年 9 月 24 日。這意味着所有依賴 sora-2、sora-2-pro 以及 Videos API 的視頻生成業務,必須在不到半年的時間內完成遷移。

更值得警惕的是,過去半年市面上流通的所謂"逆向 Sora API"在 OpenAI 收緊風控之後基本已不可用,繼續依賴這條路只會讓業務持續踩坑。本文將完整解析 Sora-2 API 下線時間表、官方影響範圍,並基於實測數據推薦兩個真正可投入生產的替代方案: 字節跳動 SeeDance 2.0 與阿里通義 Wan 2.7。

如果您正在使用 Sora-2 API 做視頻內容生產,建議直接通過 API易 apiyi.com 平臺對比測試 SeeDance 2.0 與 Wan 2.7,該平臺已經統一接入了多家主流視頻生成模型,可以最大程度降低遷移成本。

Sora-2 API 下線時間表與影響範圍

Sora-2 API 下線的官方時間節點

OpenAI 對 Sora 產品採取了兩階段關閉策略: C 端應用先下線,B 端 API 後下線,中間留出大約 5 個月的緩衝期供開發者遷移。這是 OpenAI 歷史上對一個產品線進行的最完整一次"軟着陸",但留給開發者的窗口期依然非常緊張。

| 時間節點 | 事件 | 受影響對象 | 緩衝期 |

|---|---|---|---|

| 2026-03-24 | 官方通知發出 | 所有 Sora-2 API 調用方 | T+0 |

| 2026-04-26 | Sora 網頁與 App 關閉 | C 端用戶、內容創作者 | T+33 天 |

| 2026-09-24 | Sora-2 API 正式下線 | 所有 API 集成業務 | T+184 天 |

| 2026-09-25 之後 | API 端點返回 410 Gone | 未遷移業務將完全中斷 | — |

OpenAI 在幫助中心明確建議: 如果您希望保留之前在 Sora 上生成的視頻內容,務必在 4 月 26 日 App 關閉之前完成數據導出。但對於以 API 形式接入的開發者而言,真正的截止線是 9 月 24 日。

值得注意的是, OpenAI 在通知中並未承諾"延期"的可能性。從 2025 年至今 OpenAI 幾次模型下線的執行情況來看,到期即關停已經成爲標準操作,因此不應抱有僥倖心理。

Sora-2 API 下線影響的全部模型清單

很多團隊以爲只有 sora-2 這個 alias 會下線,實際上這次清退是整批 Videos API 模型一併退役:

| 模型 ID | 類型 | 狀態 | 替代建議 |

|---|---|---|---|

sora-2 |

標準版 alias | 下線 | SeeDance 2.0 / Wan 2.7 |

sora-2-pro |

高清版 alias | 下線 | SeeDance 2.0 (1080p) |

sora-2-2025-10-06 |

標準版 snapshot | 下線 | SeeDance 2.0 |

sora-2-2025-12-08 |

標準版 snapshot | 下線 | SeeDance 2.0 |

sora-2-pro-2025-10-06 |

Pro 版 snapshot | 下線 | Wan 2.7 (含 Thinking Mode) |

| Videos API (整套接口) | API 端點 | 整體停用 | 聚合平臺兼容協議 |

也就是說,OpenAI 不再保留任何視頻生成 API 入口,從 9 月 25 日起,所有以 videos 爲前綴的請求都會返回 410 Gone 或廢棄錯誤。這與以往 GPT 系列模型僅"下線 snapshot 但保留 alias"的做法完全不同,屬於業務線級別的退出。

🎯 關鍵信息: 這意味着您不能簡單地"換一個 model 名"就完成遷移,必須切換到完全不同的視頻生成 API。建議在 6 月底之前完成新方案的接入測試,可以通過聚合平臺一次性對比 SeeDance 2.0 和 Wan 2.7 兩個候選方案,避免最後兩個月的緊張遷移。

Sora-2 API 下線的真實原因

OpenAI 官方未給出詳細解釋,但綜合 The Decoder、Futurum Group、Wikipedia 等英文媒體的分析,主要原因可以歸納爲三個層面:

- 算力成本不可持續: 視頻生成單次調用所需的 GPU 時間是文本模型的幾十倍,而商業化收入未能覆蓋成本。Sora-2 上線後, OpenAI 不得不長期對每用戶配額做嚴格限制,這反過來抑制了開發者的集成意願

- 內容安全風險高企: 即便上線了水印與內容審覈, Sora 仍然多次出現深度僞造與版權爭議,法務與合規成本遠超模型本身

- 戰略聚焦: OpenAI 將算力優先投入到 GPT 主線、Operator 與 Agent 業務,視頻暫時不再是核心方向

理解這些原因對選擇替代方案非常重要——能持續投入視頻生成的廠商,必然是把視頻作爲戰略主航道來做的玩家。字節跳動與阿里巴巴恰好都把視頻生成視爲重要戰略方向,這使得它們的產品迭代節奏遠快於 OpenAI,也是它們能在 2026 年迅速接管 Sora-2 用戶羣的根本原因。

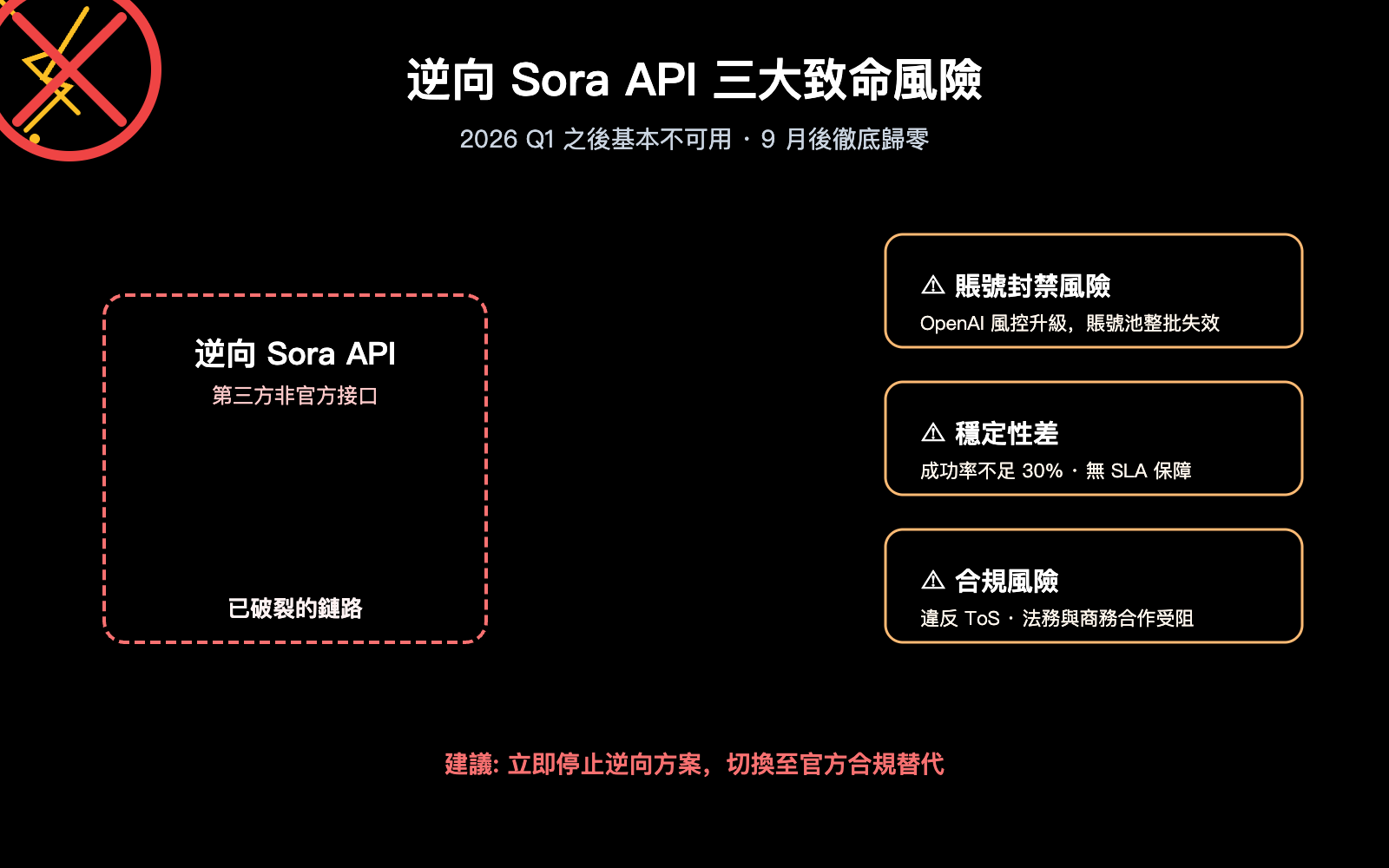

爲什麼"逆向 Sora API"不再是可選方案

逆向 Sora API 在 2026 年的現狀

過去半年,中文圈一直流通着多個號稱"無需 OpenAI 賬號即可調用 Sora-2"的逆向接口,價格從官方的幾分之一到十幾分之一不等。但根據多個開發者社區的實測反饋,這些接口在 2026 年 Q1 之後已經基本不可用:

- OpenAI 在 2026 年 1 月升級了 Cloudflare 風控規則,大量逆向接口直接返回 403

- 部分逆向服務提供商使用賬號池,而 OpenAI 加強了對批量異常賬號的封禁,導致整池失效

- 即便偶爾能調通,生成速度極慢且成功率不到 30%,完全無法用於生產

- 越來越多的逆向服務商開始"跑路"或轉型,押付的預付費餘額面臨蒸發風險

更關鍵的是, OpenAI 既然已經決定 9 月 24 日下線官方 API,那麼逆向接口的"上游"也將徹底消失,這條路在 9 月之後會歸零。

不應繼續投入逆向方案的 3 個理由

| 風險維度 | 具體表現 | 業務後果 |

|---|---|---|

| 穩定性風險 | 接口隨時被封,無 SLA 保障 | 生產環境隨時中斷 |

| 合規風險 | 違反 OpenAI ToS,可能涉及賬號買賣 | 法務與商務合作受阻 |

| 沉沒成本 | 9 月之後官方下線,逆向也將失效 | 二次遷移浪費資源 |

| 數據風險 | 第三方代理可訪問您的 prompt 與生成內容 | 商業祕密外泄 |

⚠️ 強烈建議: 如果您的團隊目前還在使用任何形式的逆向 Sora API, 請立即停止新功能開發,優先評估官方合規的替代方案。推薦通過合規聚合平臺直接接入 SeeDance 2.0 或 Wan 2.7, 既保證服務穩定性,也避免後續合規審查的麻煩。

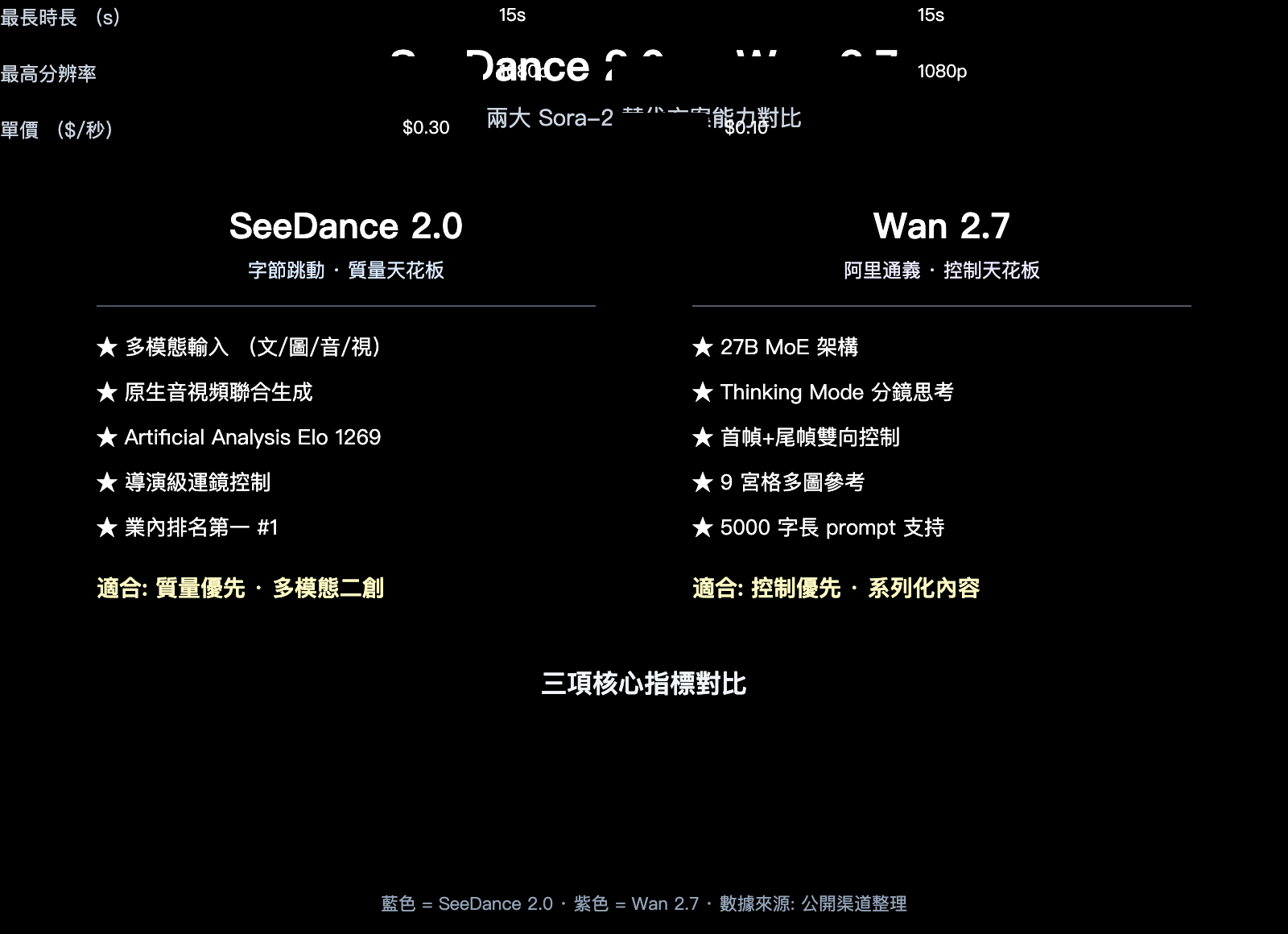

Sora-2 API 替代方案 1: SeeDance 2.0

SeeDance 2.0 的核心定位

SeeDance 2.0 是字節跳動豆包大模型團隊在 2026 年 2 月 9 日正式發佈的旗艦視頻生成模型,4 月 14 日在火山引擎 BytePlus ModelArk 平臺開放公測,4 月 9 日已在 fal 平臺開放調用。在 Artificial Analysis 視頻模型榜單上, SeeDance 2.0 取得了 Elo 1269 的成績,排名超越 Google Veo 3、OpenAI Sora 2 與 Runway Gen-4.5,是目前公開榜單上的第一名。

它最大的差異點在於採用了統一的多模態音視頻聯合生成架構——不需要先生成視頻再補音頻,而是在一次推理中同步輸出最長 15 秒的電影級音視頻內容。這種"音畫同源"的能力,是 Sora-2 通過先生成視頻再外掛 TTS 的方式無法媲美的。

SeeDance 2.0 關鍵能力一覽

| 能力維度 | SeeDance 2.0 表現 | 對標 Sora-2 |

|---|---|---|

| 單次最長時長 | 15 秒 | 持平 |

| 同步音頻 | 原生音視頻聯合生成 | Sora-2 需另接 TTS |

| 輸入模態 | 文本 / 圖像 / 音頻 / 視頻 | Sora-2 僅文本+圖像 |

| 鏡頭控制 | 導演級運鏡指令 | Sora-2 較弱 |

| 物理真實性 | 業內領先 | 持平 |

| Artificial Analysis Elo | 1269 (#1) | ~1180 |

| 公開可調用渠道 | BytePlus ModelArk / fal / 聚合平臺 | OpenAI 官方(將下線) |

| 中文 prompt 理解 | 優秀 | 一般 |

SeeDance 2.0 當前已通過 API易 apiyi.com 平臺開放內測,如果您正在爲 Sora-2 尋找平替方案,可以聯繫平臺客服開通 SeeDance 2.0 的試用配額,統一通過 OpenAI 兼容協議調用。

SeeDance 2.0 調用示例

下面是通過 OpenAI 兼容接口調用 SeeDance 2.0 的極簡示例:

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

response = client.videos.generate(

model="seedance-2.0",

prompt="一隻橘貓從窗臺跳到沙發上,夕陽從百葉窗灑入,鏡頭跟隨小貓緩慢推進",

duration=10,

audio=True,

aspect_ratio="16:9"

)

print(response.video_url)

📌 完整調用示例 (含異常處理與輪詢)

import time

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

def generate_seedance_video(prompt: str, duration: int = 10):

try:

task = client.videos.generate(

model="seedance-2.0",

prompt=prompt,

duration=duration,

audio=True,

aspect_ratio="16:9",

resolution="1080p"

)

while True:

status = client.videos.retrieve(task.id)

if status.state == "completed":

return status.video_url

elif status.state == "failed":

raise RuntimeError(f"任務失敗: {status.error}")

time.sleep(5)

except Exception as e:

print(f"調用異常: {e}")

return None

url = generate_seedance_video(

prompt="一輛復古紅色雙層巴士駛過雨後倫敦街頭,車窗映出街燈倒影",

duration=12

)

print(url)

SeeDance 2.0 適用場景

- 品牌短視頻: 同步原生音頻 + 電影級運鏡,適合廣告片與品牌物料

- 多模態二創: 支持音頻、視頻作爲輸入參考,適合 IP 內容衍生

- 角色一致性: 多模態參考能力優秀,適合系列化內容生產

- 海外社媒投放: 原生 16:9 / 9:16 / 1:1 多比例輸出,直接適配 TikTok/YouTube/Instagram

- 音樂 MV: 音視頻聯合生成可以做到畫面與音樂節奏天然對齊

Sora-2 API 替代方案 2: Wan 2.7

Wan 2.7 的核心定位

Wan 2.7 是阿里巴巴通義實驗室在 2026 年 3 月發佈的新一代視頻生成模型,基於 27B 參數的 MoE (Mixture-of-Experts) 架構,採用 Diffusion Transformer + Flow Matching 技術路線。已經通過阿里雲 DashScope 平臺與 WaveSpeedAI 平臺對外開放,是目前國內廠商首個公開 API 的 MoE 視頻模型。

與 SeeDance 2.0 主打多模態融合不同, Wan 2.7 的兩大獨特賣點是: Thinking Mode (思考模式) 與 首尾幀精準控制——它可以先"思考"分鏡結構再生成視頻,也可以同時指定開頭與結尾的關鍵幀,這兩點都是當前 Sora-2 API 所不具備的能力。

Wan 2.7 關鍵能力一覽

| 能力維度 | Wan 2.7 表現 | 對標 Sora-2 |

|---|---|---|

| 模型架構 | 27B MoE | 未公開 |

| 單次最長時長 | 15 秒 | 持平 |

| 最高分辨率 | 1080p | 持平 |

| Thinking Mode | ✅ 支持分鏡思考 | ❌ 不支持 |

| 首尾幀控制 | ✅ 同時指定首幀+尾幀 | ❌ 僅支持首幀 |

| 9 宮格參考圖 | ✅ 最多 9 張參考圖 | ❌ 不支持 |

| 主體+語音參考 | ✅ 支持組合參考 | ❌ 不支持 |

| Prompt 長度上限 | 5000 字符 | ~1000 字符 |

| 公開可調用渠道 | 阿里雲 DashScope / WaveSpeedAI / 聚合平臺 | OpenAI 官方(將下線) |

| 單價參考 | $0.10/秒起 | $0.50/秒起 |

🎯 場景建議: 如果您的視頻生成場景對起止畫面有明確要求 (例如品牌片頭片尾、廣告倒計時),那麼 Wan 2.7 的首尾幀控制能力是 Sora-2 完全無法替代的。建議直接通過聚合平臺調用 Wan 2.7,無需自行處理阿里雲的 SDK 與簽名機制。

Wan 2.7 調用示例

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

response = client.videos.generate(

model="wan-2.7",

prompt="賽博朋克風格的霓虹街道,鏡頭從地面緩慢上升至俯瞰整座城市",

first_frame_url="https://example.com/start.png",

last_frame_url="https://example.com/end.png",

thinking_mode=True,

duration=10

)

print(response.video_url)

📌 Wan 2.7 多圖參考完整示例 (9 宮格輸入 + Thinking Mode)

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

reference_images = [

f"https://example.com/ref{i}.png" for i in range(1, 10)

]

response = client.videos.generate(

model="wan-2.7",

prompt=(

"主角穿過 9 個不同的場景,"

"每個場景對應參考圖中的一張,"

"整段視頻保持人物外觀與服裝一致"

),

reference_images=reference_images,

thinking_mode=True,

duration=15,

resolution="1080p",

audio=True

)

print(response.video_url)

Wan 2.7 適用場景

- 品牌片頭片尾: 首尾幀精準控制,無需後期對齊

- 角色一致系列: 9 宮格參考圖保證多鏡頭中角色不漂移

- 複雜分鏡: Thinking Mode 自動規劃鏡頭結構,適合短劇與廣告

- 指令式編輯: 支持基於自然語言指令對已有視頻進行編輯

- 9 宮格劇情: 一次輸入多張關鍵畫面,生成連貫敘事視頻

SeeDance 2.0 vs Wan 2.7 vs Sora-2 全面對比

三大模型核心指標對比

| 對比維度 | Sora-2 (即將下線) | SeeDance 2.0 | Wan 2.7 |

|---|---|---|---|

| 廠商 | OpenAI | 字節跳動 | 阿里通義 |

| 發佈時間 | 2025-10 | 2026-02-09 | 2026-03 |

| 服務狀態 | 2026-09-24 下線 | 公測開放 | 公測開放 |

| 最長時長 | 15s | 15s | 15s |

| 最高分辨率 | 1080p | 1080p | 1080p |

| 原生音頻 | ✅ | ✅ (聯合生成) | ✅ |

| 多模態輸入 | 文本+圖像 | 文本+圖像+音頻+視頻 | 文本+多參考圖 |

| 首尾幀控制 | ❌ | ❌ | ✅ 雙向 |

| Thinking Mode | ❌ | ❌ | ✅ |

| Artificial Analysis Elo | ~1180 | 1269 (#1) | 暫未上榜 |

| 中文支持 | 一般 | 優秀 | 優秀 |

| 國內合規可用 | ❌ | ✅ | ✅ |

| 單價參考 | $0.50/秒 | $0.30/秒 | $0.10/秒起 |

場景化選型建議

| 業務場景 | 首選方案 | 理由 |

|---|---|---|

| 品牌廣告短視頻 | SeeDance 2.0 | 同步音頻 + 電影級運鏡 |

| 短劇/系列化內容 | Wan 2.7 | 9 宮格參考保證角色一致 |

| 片頭片尾定製 | Wan 2.7 | 首尾幀精準控制 |

| 多模態二創 | SeeDance 2.0 | 支持音視頻參考輸入 |

| 中文文案驅動生成 | 兩者皆可 | 中文理解都優於 Sora-2 |

| 極致質量優先 | SeeDance 2.0 | Artificial Analysis 第一 |

| 成本敏感批量生成 | Wan 2.7 | $0.10/秒起,價格優勢明顯 |

| 海外社媒內容 | SeeDance 2.0 | 多比例原生輸出 |

| 電商商品視頻 | Wan 2.7 | 主體參考保證商品形象一致 |

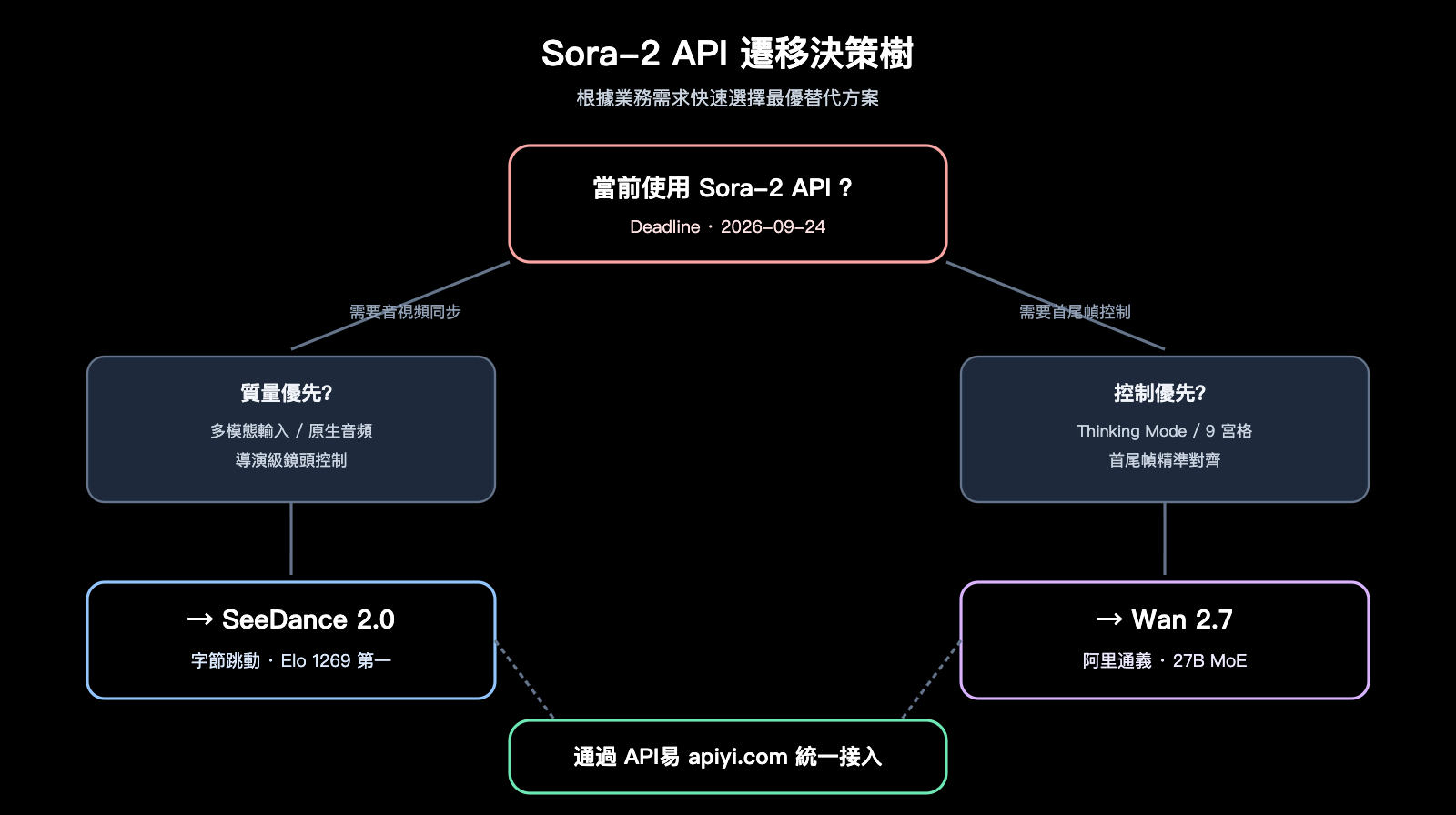

💡 選擇建議: 如果您短期內只能選一個,SeeDance 2.0 適合"質量優先"場景, Wan 2.7 適合"控制優先"和"成本優先"場景。建議在同一個聚合平臺同時開通兩個模型的調用權限,根據具體業務請求動態路由,這樣可以在遷移期保留最大靈活性。

三大模型成本測算 (10 秒 1080p 視頻)

| 模型 | 單次成本估算 | 月度萬次成本估算 | 備註 |

|---|---|---|---|

| Sora-2 | ~$5.00 | ~$50,000 | 9月後不可用 |

| SeeDance 2.0 | ~$3.00 | ~$30,000 | 含原生音頻 |

| Wan 2.7 | ~$1.00 | ~$10,000 | 入門價 |

注: 以上數據基於公開渠道整理,實際價格以廠商最新報價爲準。在聚合平臺上調用通常會比單獨開通廠商賬號有額外的優惠空間。

Sora-2 API 遷移到替代方案的快速上手

遷移路徑決策樹

將 Sora-2 API 遷移到替代方案,大致可以拆解爲 4 個步驟:

- 盤點現有 Sora-2 調用: 找出所有調用

sora-2或 Videos API 的代碼路徑,列出 prompt 模板、輸入參數、輸出處理邏輯 - 選擇目標模型: 根據上文的場景化選型建議,確定主用模型

- 替換 base_url 與 model 名: 把 OpenAI 的 base_url 替換爲聚合平臺的 base_url,例如替換爲

https://api.apiyi.com/v1,並將 model 名替換爲seedance-2.0或wan-2.7 - 迴歸測試: 用一組代表性 prompt 跑通完整鏈路,對比新舊輸出質量與時延

通過聚合平臺一次性接入兩個替代方案

from openai import OpenAI

client = OpenAI(

api_key="your-api-key",

base_url="https://api.apiyi.com/v1"

)

def generate_video(prompt: str, prefer: str = "seedance"):

model = "seedance-2.0" if prefer == "seedance" else "wan-2.7"

return client.videos.generate(

model=model,

prompt=prompt,

duration=10,

audio=True

)

video_a = generate_video("產品廣告:智能音箱播放音樂", prefer="seedance")

video_b = generate_video("品牌片頭:logo 從光斑中漸顯", prefer="wan")

這種寫法的好處是一套 SDK、一個 API Key、一個 base_url 就能同時調用兩個替代方案。等到 9 月 24 日 Sora-2 真正下線之後,您只需要把原來的 model="sora-2" 改成 model="seedance-2.0" 或 model="wan-2.7",其他代碼完全不用動。

遷移檢查清單 (建議打印貼在工位上)

| 階段 | 檢查項 | 預計耗時 |

|---|---|---|

| 盤點 | 列出所有 Sora-2 調用入口 | 0.5 天 |

| 盤點 | 整理代表性 prompt 50-100 條 | 1 天 |

| 接入 | 申請聚合平臺賬號與配額 | 0.5 天 |

| 接入 | 改造 base_url 與 model 字段 | 1 天 |

| 測試 | 運行迴歸測試集 | 2-3 天 |

| 測試 | 產品/設計盲評質量 | 1 周 |

| 灰度 | 切換 10%-30% 流量 | 1 周 |

| 灰度 | 切換至 100% 流量 | — |

| 收尾 | 下線 Sora-2 調用代碼 | 0.5 天 |

按照上述節奏,4-6 周可以完整跑完一次遷移,留出至少 2 個月的穩定運行窗口期,在 9 月 24 日的最終截止線之前留有充足的調整空間。

🎯 遷移建議: 不要等到 9 月份再開始測試。建議立刻在聚合平臺開通賬號,把現有的 Sora-2 調用代碼克隆一份,把 base_url 改成

https://api.apiyi.com/v1,這樣就可以並行跑 Sora-2 和替代方案的對比實驗,用真實業務數據決策最終方案。

遷移期間的成本控制建議

視頻生成的單價顯著高於文本模型,遷移期間如果不做任何優化, API 賬單很容易翻倍。建議參考以下三條策略:

- 降級策略: 測試階段優先使用 720p / 5 秒短視頻,確認 prompt 效果後再上 1080p / 15 秒

- 緩存複用: 相同 prompt + 相同參數的請求做內容哈希緩存,避免重複生成

- 聚合計費: 通過聚合平臺統一計費,可以避免在多家廠商分別開通賬號導致的最低消費門檻

- 批量生成: 利用廠商的 batch 模式做夜間批量生成,可享受 30%-50% 的價格優惠

- prompt 優化: 通過更精準的 prompt 減少重生成次數,通常可以節省 20%-40% 調用成本

常見遷移坑點與解決方案

| 坑點 | 原因 | 解決方案 |

|---|---|---|

| 輸出比例不一致 | 各模型默認 aspect_ratio 不同 | 顯式指定 aspect_ratio 參數 |

| 時長上限差異 | 部分模型按秒數計費 | 改爲按需指定 duration |

| 音頻缺失 | Sora-2 與新模型音頻接口不同 | 顯式開啓 audio=True |

| Prompt 風格漂移 | 各模型 prompt 偏好不同 | 針對每個模型單獨優化 prompt |

| 回調機制差異 | 部分平臺只支持輪詢 | 統一使用聚合平臺的 webhook |

關於 Sora-2 API 下線的常見問題 FAQ

Q1: Sora-2 API 下線後,已經生成的視頻還能用嗎?

可以。視頻文件本身一旦下載到本地或 OSS,就不受 API 下線影響。但如果您之前是直接引用 OpenAI 返回的 video_url,這些鏈接會在 API 下線後失效,務必在 9 月 24 日之前把所有視頻轉存到自己的對象存儲中。如果轉存量較大,可以通過 API易 apiyi.com 平臺的視頻代理能力批量下載,平臺會自動做併發限速與失敗重試。

Q2: OpenAI 之後會不會推出 Sora-3 API?

OpenAI 官方未給出 Sora-3 的時間表。從戰略層面看, OpenAI 當前優先投入算力到 GPT 主線與 Agent 業務,短期內重啓視頻生成 API 的可能性較低。Wikipedia 與 Futurum Group 的分析也指出, Sora 商業化未達預期是此次下線的核心原因。建議不要把業務規劃寄託在"也許 Sora-3 會回來"上,務必完成向 SeeDance 2.0 或 Wan 2.7 的遷移。

Q3: SeeDance 2.0 和 Wan 2.7 在中國大陸可以穩定調用嗎?

可以。兩個模型分別由字節跳動與阿里巴巴運營,服務節點在國內,網絡穩定性遠優於跨境調用 OpenAI。如果您之前用 Sora-2 還需要走代理或海外服務器,遷移到這兩個模型後網絡架構可以同步簡化。直接通過國內合規聚合平臺調用,可以一次性解決穩定性與發票合規兩個問題。

Q4: 逆向 Sora API 是否還有最後的過渡價值?

不建議。逆向 API 在 2026 年 Q1 之後穩定性已經急劇下降,且 9 月之後官方源頭消失,逆向接口必然徹底歸零。繼續投入逆向方案等於在已知會廢棄的技術棧上疊加新代碼,遷移成本只會更高。最經濟的做法是直接遷移到 SeeDance 2.0 或 Wan 2.7。

Q5: 遷移過程中如何評估替代方案的真實效果?

建議建立三維評估: 視覺質量(主觀打分)、prompt 遵循度(客觀對比)、單次成本(財務測算)。具體做法是從歷史 Sora-2 調用中抽取 50 條代表性 prompt,在 SeeDance 2.0 與 Wan 2.7 上重跑一遍,由產品團隊盲評。建議通過聚合平臺進行實測對比,統一計費、統一日誌,可以快速做出最適合您業務的選擇。

Q6: 遷移到聚合平臺後, API 接口規範會變嗎?

聚合平臺通常會適配 OpenAI 兼容協議,這意味着您原本調用 Sora-2 的代碼框架基本可以保留, 只需要修改 base_url 與 model 兩個字段。視頻生成相關的請求參數(prompt、duration、audio、resolution 等)在不同模型之間略有差異,聚合平臺會做參數對齊,具體差異可以查閱平臺文檔。

Q7: 我應該立刻遷移,還是等到 9 月份?

強烈建議立刻開始測試,6 月底前完成遷移。原因有三:

- 越接近 9 月 24 日,所有 Sora-2 用戶都在擠遷移窗口,聚合平臺與替代模型的資源會更緊張

- 提早遷移可以充分對比兩個替代方案,避免臨陣換車

- 早期遷移的開發者通常能拿到更好的試用配額與定價空間

Q8: SeeDance 2.0 與 Wan 2.7 哪個對中文 prompt 更友好?

兩者都顯著優於 Sora-2 的中文理解能力。SeeDance 2.0 在中文情緒表達、動作描述上更細膩,Wan 2.7 由於支持 5000 字符長 prompt 與 Thinking Mode,在複雜中文敘事場景下表現更穩定。如果您的 prompt 通常在 200 字以內,選 SeeDance 2.0;如果經常需要描述複雜分鏡,選 Wan 2.7。

Q9: 遷移期間如何保證不出現服務斷檔?

最安全的做法是雙寫雙讀: 在切換期間同時調用 Sora-2 與目標模型,把兩份輸出都保存下來,前端按 A/B 切流。這樣一旦目標模型有問題可以立即回滾到 Sora-2 (在 9 月 24 日之前),把風險降到最低。聚合平臺一般支持基於 model 字段的動態路由,實現雙寫雙讀的成本很低。

總結: Sora-2 API 下線之後的最佳路徑

OpenAI 已經把 Sora-2 API 下線時間鎖定在 2026 年 9 月 24 日,留給所有視頻生成業務的窗口期不足半年。逆向 API 這條曾經的"廉價過渡方案"在風控收緊與官方下線的雙重壓力下已經失去價值,繼續投入只會讓遷移成本進一步累積。

幸運的是,2026 年的視頻生成賽道已經形成了非常健康的多極格局: SeeDance 2.0 憑藉 Artificial Analysis Elo 1269 的成績成爲質量天花板,擅長多模態輸入與原生音視頻聯合生成; Wan 2.7 則以 Thinking Mode 與首尾幀控制建立了獨特的差異化優勢,適合需要精準畫面控制的場景。兩個方案在中文支持、國內合規、調用穩定性上都顯著優於即將下線的 Sora-2。

我們的建議是: 不要把雞蛋放在一個籃子裏。通過 API易 apiyi.com 平臺同時接入 SeeDance 2.0 與 Wan 2.7,根據具體業務請求動態路由——質量優先的內容走 SeeDance 2.0,需要精確控制的畫面走 Wan 2.7。這種雙模型架構既能保證遷移期的穩定性,也能在 9 月之後無縫承接原有 Sora-2 業務。

最關鍵的一點: 現在就開始。等到 8、9 月再啓動遷移,無論是模型適配、prompt 調優還是配額申請都會比現在困難得多。建議本週就啓動 PoC 測試,把現有 Sora-2 調用代碼克隆一份並行測試,用真實業務數據驅動最終決策,確保在 9 月 24 日下線時已經平穩運行了至少 2 個月的替代方案。

作者: APIYI Team — 專注於 AI 大模型 API 中轉與視頻生成模型聚合服務