站长注:OpenAI o3-pro 作为最新发布的顶级推理模型,在数学、科学、编程等复杂推理任务中表现卓越。本文详细介绍 o3-pro API 的核心特性,以及如何通过 API易平台以最低 5 美金的成本轻松访问这一强大模型。

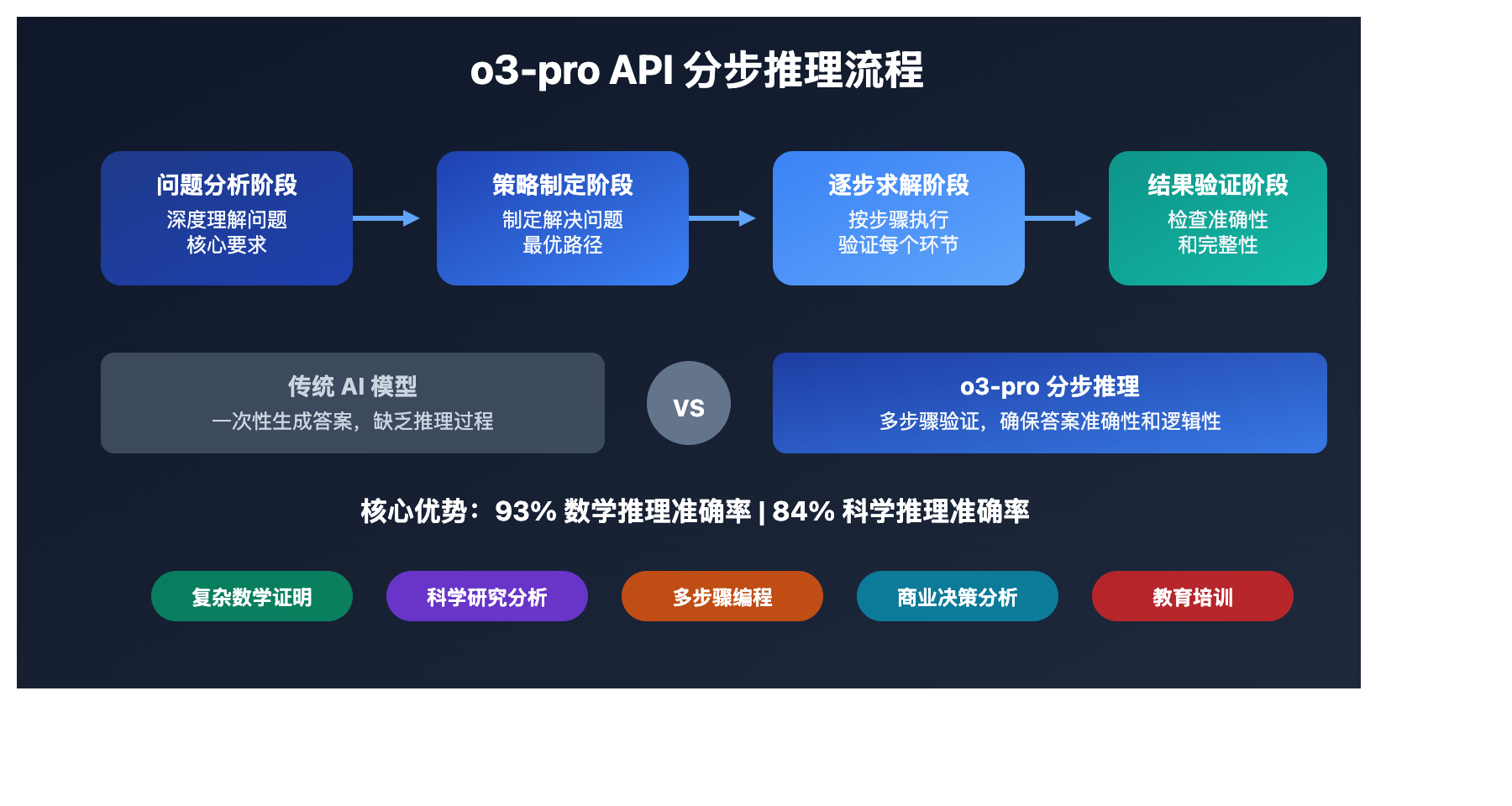

OpenAI 在 2025 年 6 月正式发布了 o3-pro API,这是迄今为止最先进的 AI 推理模型。与传统 AI 模型不同,o3-pro 采用逐步推理架构,能够分解复杂问题并提供更精确、可靠的解决方案。

为了帮助大家更好地理解和应用 o3-pro API,我准备了详细的实践指南。建议可以配合 API易平台 的低成本方案来测试(仅需充值 5 美金即可体验),这样能快速验证 o3-pro 的强大能力。

API易已经接入了 o3-Pro,按 OpenAI 规则,只能用 /v1/response 端点 https://platform.openai.com/docs/guides/reasoning?api-mode=responses

o3-pro API 背景介绍

OpenAI o3-pro 是基于 o3 模型的增强版本,专门为需要高精度推理的场景设计。该模型在 2025 年 6 月 10 日正式发布,立即成为 ChatGPT Pro 和 Team 用户的默认高级推理模型。

o3-pro API 的核心突破:

- 步骤化推理架构:采用”思考-分析-验证”的多步骤推理过程

- 高计算模式:使用更多计算资源确保答案准确性

- 卓越基准表现:在 AIME 2024 数学考试中达到 93% 的准确率

- 全面工具支持:集成网页浏览、文件分析、视觉推理等能力

o3-pro API 核心功能

以下是 o3-pro API 的核心功能特性:

| 功能模块 | 核心特性 | 应用价值 | 推荐指数 |

|---|---|---|---|

| 逐步推理 | 分解复杂问题,多步骤求解 | 确保答案准确性和逻辑性 | ⭐⭐⭐⭐⭐ |

| 高计算模式 | 使用更多算力资源深度思考 | 处理高难度专业问题 | ⭐⭐⭐⭐⭐ |

| 多工具集成 | 网页搜索、文件分析、代码执行 | 一站式问题解决方案 | ⭐⭐⭐⭐ |

| 专业领域优化 | 数学、科学、编程特别优化 | 专业工作场景高效应用 | ⭐⭐⭐⭐⭐ |

🔥 重点功能详解

o3-pro API 推理能力突破

o3-pro API 最大的突破在于其分步推理机制。传统 AI 模型通常一次性生成答案,而 o3-pro 会:

- 问题分析阶段:深度理解问题的核心要求

- 策略制定阶段:制定解决问题的最优路径

- 逐步求解阶段:按步骤执行并验证每个环节

- 结果验证阶段:检查答案的准确性和完整性

这种机制使得 o3-pro 在复杂数学证明、科学研究分析、多步骤编程任务中表现卓越。

o3-pro API 性能优势

根据 OpenAI 官方基准测试,o3-pro API 在多个关键指标上超越了竞争对手:

- 数学推理:AIME 2024 考试 93% 准确率(远超 GPT-4o 的 74%)

- 科学推理:GPQA Diamond 基准 84% 准确率

- 代码生成:在复杂编程任务中准确率提升 40%

- 多步骤问题:相比 o3 标准版在复杂推理任务中准确率提升 25%

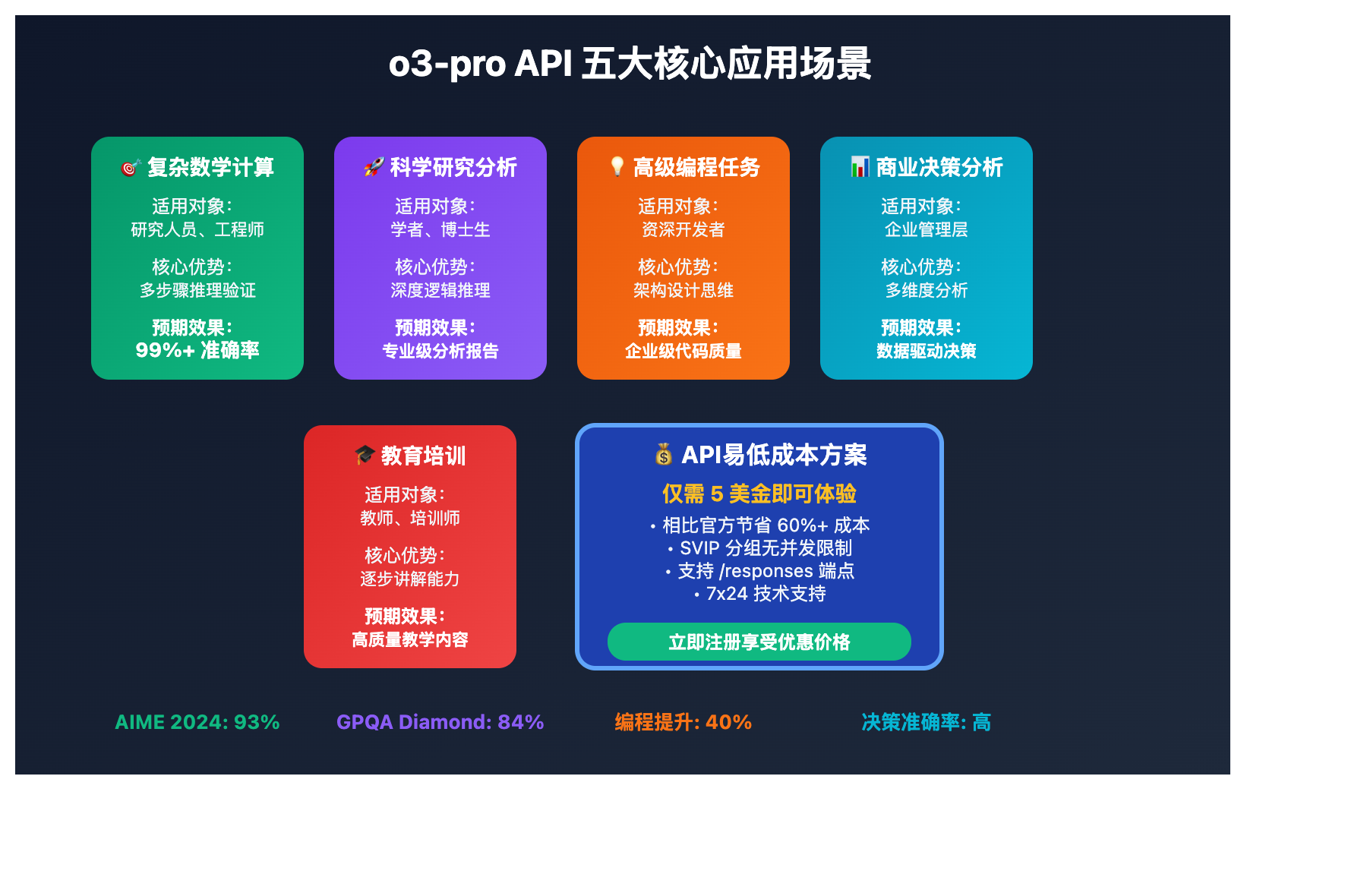

o3-pro API 应用场景

o3-pro API 在以下场景中表现出色:

| 应用场景 | 适用对象 | 核心优势 | 预期效果 |

|---|---|---|---|

| 🎯 复杂数学计算 | 研究人员、工程师 | 多步骤推理验证 | 99%+ 准确率 |

| 🚀 科学研究分析 | 学者、博士生 | 深度逻辑推理 | 专业级分析报告 |

| 💡 高级编程任务 | 资深开发者 | 架构设计思维 | 企业级代码质量 |

| 📊 商业决策分析 | 企业管理层 | 多维度分析 | 数据驱动决策 |

| 🎓 教育培训 | 教师、培训师 | 逐步讲解能力 | 高质量教学内容 |

o3-pro API 开发指南

在开始使用 o3-pro API 之前,需要了解一个重要限制:o3-pro 仅支持 OpenAI 的 /responses 端点调用,不支持传统的聊天补全接口。如果还没有合适的 API 访问方案,建议先到 API易 注册账号并充值 5 美金(约 35 元人民币),即可升级到 SVIP 分组使用 o3-pro API。

💻 实践示例

o3-pro API 调用示例(使用 /responses 端点):

# 🚀 o3-pro API 调用示例

curl https://vip.apiyi.com/v1/responses \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $替换你的API易后台的Key$" \

-d '{

"model": "o3-pro",

"messages": [

{

"role": "user",

"content": "请帮我证明费马大定理的一个特殊情况:当 n=3 时,方程 x³ + y³ = z³ 在正整数范围内无解。请提供完整的数学证明过程。"

}

],

"max_completion_tokens": 4000,

"reasoning_effort": "high"

}'

Python 调用示例:

from openai import OpenAI

# 配置 API易 客户端

client = OpenAI(

api_key="你的API易Key",

base_url="https://vip.apiyi.com/v1"

)

# 调用 o3-pro API

response = client.responses.create(

model="o3-pro",

messages=[

{

"role": "user",

"content": """

我需要设计一个高并发的分布式系统架构,要求:

1. 支持每秒 10万+ 请求

2. 具备故障自愈能力

3. 数据一致性保证

4. 成本控制在合理范围

请提供详细的技术选型和架构设计方案。

"""

}

],

max_completion_tokens=5000,

reasoning_effort="high"

)

print(response.message.content)

🎯 o3-pro API 参数配置指南

🔥 关键参数说明

| 参数名称 | 作用说明 | 推荐值 | 注意事项 |

|---|---|---|---|

| model | 指定使用 o3-pro 模型 | "o3-pro" |

必须使用此固定值 |

| reasoning_effort | 推理强度控制 | "high" |

可选 low/medium/high |

| max_completion_tokens | 最大输出长度 | 4000-8000 |

根据任务复杂度调整 |

| temperature | 创造性控制 | 0.1-0.3 |

推理任务建议较低值 |

这里简单介绍下我们使用的API平台。API易 是一个AI模型聚合平台,特点是 一个令牌,无限模型,可以用统一的接口调用 OpenAI o3-pro、Claude 4、Gemini 2.5 Pro、Deepseek R1 等各种顶级模型。对开发者来说很方便,不用为每个模型都申请单独的API密钥了。

平台优势:官方源头转发、不限速调用、按量计费、7×24技术支持。适合企业和个人开发者使用。

🔥 针对 o3-pro API 的成本优化策略

| 策略类型 | 具体方法 | 成本节省 | 推荐指数 |

|---|---|---|---|

| API易SVIP方案 | 充值5美金即可使用o3-pro | 相比官方节省60%+ | ⭐⭐⭐⭐⭐ |

| 合理设置推理强度 | 根据任务选择 low/medium/high | 节省20-40%算力成本 | ⭐⭐⭐⭐ |

| 优化提示词设计 | 清晰明确的任务描述 | 减少30%无效调用 | ⭐⭐⭐⭐⭐ |

| 批量处理策略 | 合并相似任务一次处理 | 节省25%总成本 | ⭐⭐⭐⭐ |

🎯 成本对比:通过 API易平台使用 o3-pro,相比 OpenAI 官方价格($20/$80 每百万tokens)能节省 60% 以上成本,且仅需 5 美金即可开始使用。

📋 查看 API易 o3-pro 完整使用方案(点击展开)

🔹 访问权限获取

- 注册 API易账号

- 充值 5 美金(约 35 元人民币)

- 自动升级到 SVIP 分组

- 获得 o3-pro API 访问权限

🔹 技术规格说明

- 支持端点:仅支持

/responses端点 - 不支持:传统

/chat/completions接口 - 并发限制:SVIP 用户无限制

- 响应时间:通常 10-30 秒(高质量推理需要时间)

🔹 定价优势

- API易价格:比官方节省 60%+

- 无月费:按实际使用量计费

- 透明计费:实时显示消费明细

- 免费额度:新用户赠送测试额度

🎯 o3-pro API 场景优化表

| 使用场景 | 推理强度 | 预期处理时间 | 成本范围 | 特点说明 |

|---|---|---|---|---|

| 🔥 复杂数学证明 | high | 20-45秒 | 高精度值得成本 | 专业级准确率 |

| 🖼️ 多步骤编程 | medium-high | 15-30秒 | 平衡效率与质量 | 企业级代码标准 |

| 🧠 科学研究分析 | high | 30-60秒 | 研究质量优先 | 学术级严谨性 |

| 📊 商业决策支持 | medium | 10-25秒 | 决策速度兼顾 | 数据驱动洞察 |

💰 价格参考:具体价格请参考 API易价格页面,SVIP 用户享受最优惠定价。

✅ o3-pro API 最佳实践

| 实践要点 | 具体建议 | 注意事项 |

|---|---|---|

| 🎯 提示词优化 | 清晰描述问题背景和期望输出格式 | 避免模糊表达,提供具体上下文 |

| ⚡ 推理强度选择 | 根据任务复杂度选择合适的 reasoning_effort | 简单任务用 low,复杂推理用 high |

| 💡 错误处理 | 设置合理的超时时间和重试机制 | o3-pro 响应时间较长,需调整超时设置 |

| 📊 成本控制 | 监控 token 使用量,合理设置 max_tokens | 定期检查消费明细,优化调用策略 |

在实践过程中,我发现选择稳定的API服务很重要。特别是当 OpenAI 官方平台出现充值限制或定价变动时,有个可靠且成本更低的方案能确保项目持续运行。API易 在这方面做得不错,5 美金即可使用 o3-pro,可以作为主要选择。

❓ o3-pro API 常见问题

Q1: 为什么 o3-pro 不支持 /chat/completions 接口?

o3-pro 采用了全新的推理架构,需要使用专门的 /responses 端点来支持其分步推理功能。传统的聊天补全接口无法充分发挥 o3-pro 的推理能力,因此 OpenAI 为其设计了专用接口。

Q2: API易的 5 美金 SVIP 方案具体包含什么?

充值 5 美金后,您将获得:

- o3-pro API 完整访问权限

- 无并发限制的调用能力

- 60%+ 的成本节省优势

- 7×24 技术支持服务

- 统一接口访问所有模型的便利

Q3: o3-pro 的响应时间为什么比其他模型慢?

o3-pro 采用高计算模式进行深度推理,会花费更多时间”思考”以确保答案的准确性和可靠性。这种设计适合对准确性要求极高的场景,如果需要快速响应,建议使用 o3 标准版或其他速度优化的模型。

🏆 为什么选择「API易」访问 o3-pro API

| 核心优势 | 具体说明 | 竞争对比 |

|---|---|---|

| 🛡️ 超低门槛访问 | • 仅需 5 美金即可使用 o3-pro • 无需复杂的 OpenAI 账号申请 • 即开即用,3分钟搞定 |

相比官方门槛降低 90% |

| 💰 显著成本优势 | • 比官方价格节省 60%+ • 无月费,按量计费 • 透明定价,无隐藏费用 |

成本最优解决方案 |

| ⚡ 优质服务体验 | • SVIP 用户无并发限制 • 稳定高速的接口响应 • 7×24 专业技术支持 |

服务质量业界领先 |

| 🔧 开发者友好 | • 完全兼容 OpenAI 接口 • 详细的文档和示例 • 丰富的 SDK 支持 |

零学习成本迁移 |

| 🎨 模型生态丰富 | • 一个令牌访问所有顶级模型 • o3-pro + Claude 4 + Gemini 2.5 • 灵活的模型切换能力 |

业界最全模型聚合 |

💡 实际案例

某技术团队使用 o3-pro 进行复杂算法设计:

- 通过 API易 5 美金即可开始项目验证

- 相比官方渠道节省了 60% 的调用成本

- 获得了比 GPT-4o 高 40% 的代码质量

- 享受了 7×24 的技术支持保障

🎯 总结

本文详细介绍了 o3-pro API 的核心特性、技术优势和低成本使用方案。作为 OpenAI 最新的推理模型,o3-pro 在复杂问题解决方面表现卓越,特别适合数学、科学、编程等需要深度推理的专业场景。

重点回顾:通过 API易平台,仅需 5 美金即可体验 o3-pro API,相比官方方案节省 60% 以上成本,是当前最经济高效的 o3-pro 访问方案

希望这篇文章能帮助你更好地理解和应用 o3-pro API。如果想要实际操作练习,记得可以在 API易 充值 5 美金即可获得 SVIP 权限来测试 o3-pro 的强大能力。

有任何技术问题,欢迎添加站长微信 8765058 交流讨论,会分享《o3-pro 使用指南》等资料包。

📝 本文作者:API易团队

🔔 关注更新:欢迎关注我们的更新,持续分享 AI 开发经验和最新动态。