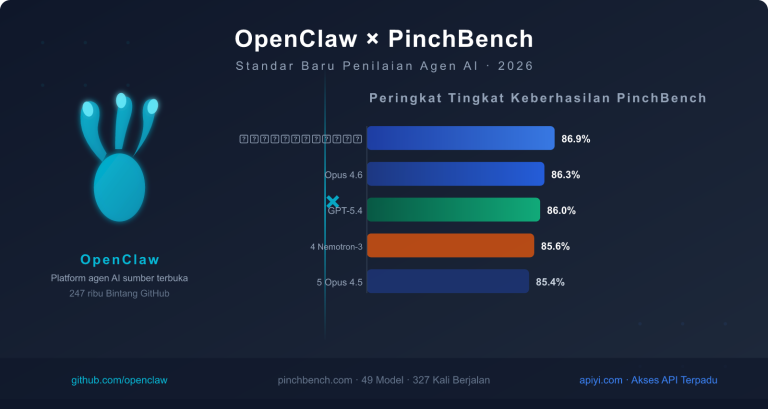

OpenClaw + PinchBench: Memahami 5 Dimensi Kunci dalam Tolok Ukur Evaluasi Agen AI

Pada tahun 2026, sebuah proyek open-source yang dibuat oleh seorang pengembang independen dari Austria di akhir pekan, berhasil mengumpulkan 247 ribu GitHub Stars dalam dua bulan, menjadikannya platform agen AI yang diperebutkan oleh perusahaan di Silicon Valley dan Tiongkok. Proyek ini bernama OpenClaw. Namun, seiring dengan itu, muncul pertanyaan: Dalam skenario agen nyata seperti OpenClaw,…