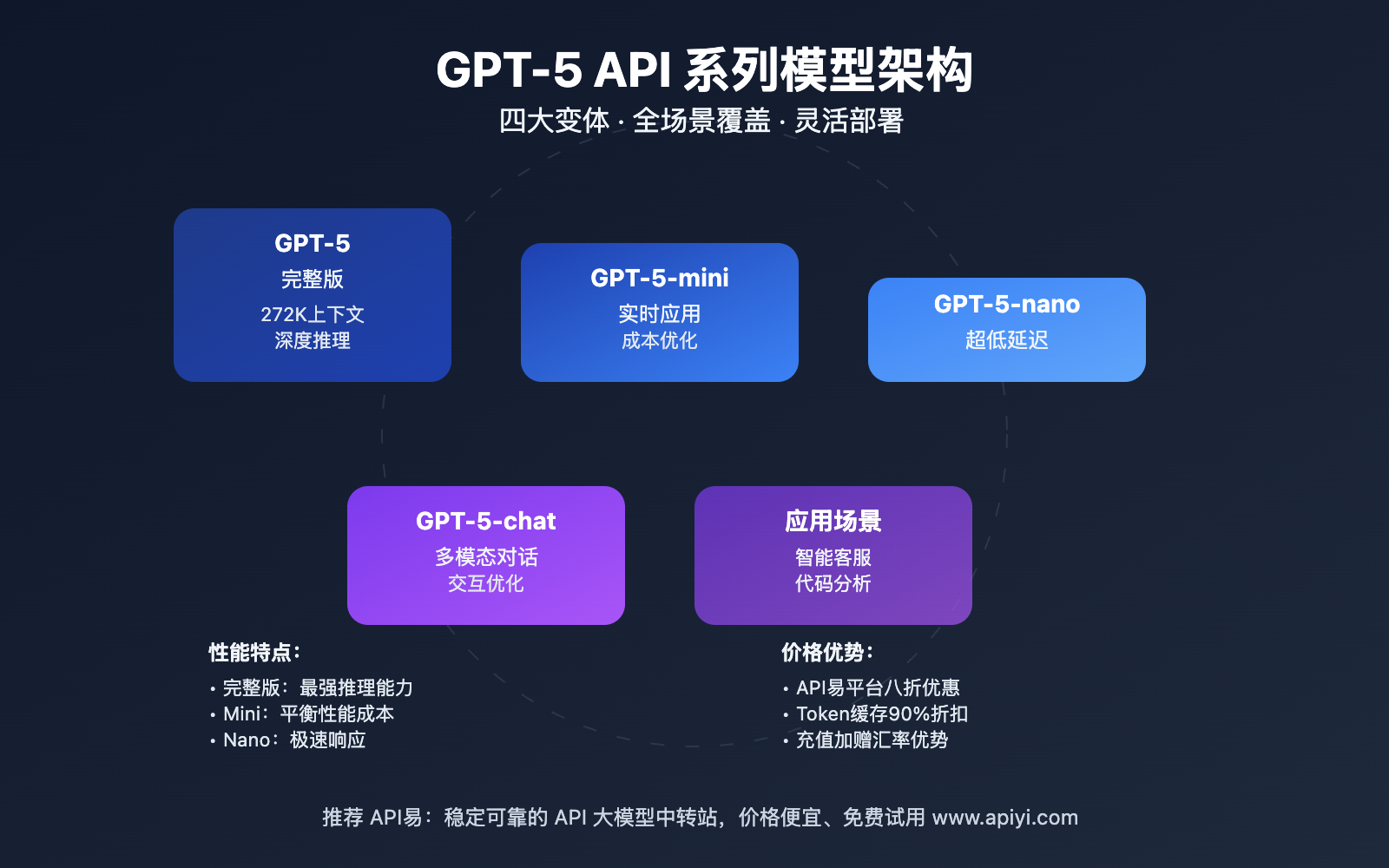

作者注:详细解析GPT-5 API系列模型的功能特性、定价策略和应用场景,助您快速掌握新一代AI接口

OpenAI 最新发布的 GPT-5 API 系列模型带来了革命性的AI能力提升。这个新一代API不仅在推理能力上实现了质的飞跃,更通过多样化的模型变体满足了不同场景的成本和性能需求。

本文将从技术架构、定价策略、应用场景三个维度,深入分析 GPT-5 API 的核心优势和实际价值。

核心价值:通过本文,你将全面了解GPT-5 API的技术特性和商业价值,掌握如何选择合适的模型变体来优化项目成本和效果。API易 已全面上线这些模型,直接用即可 —— 价格便宜,优惠下来约官网八折。

GPT-5 API 背景介绍

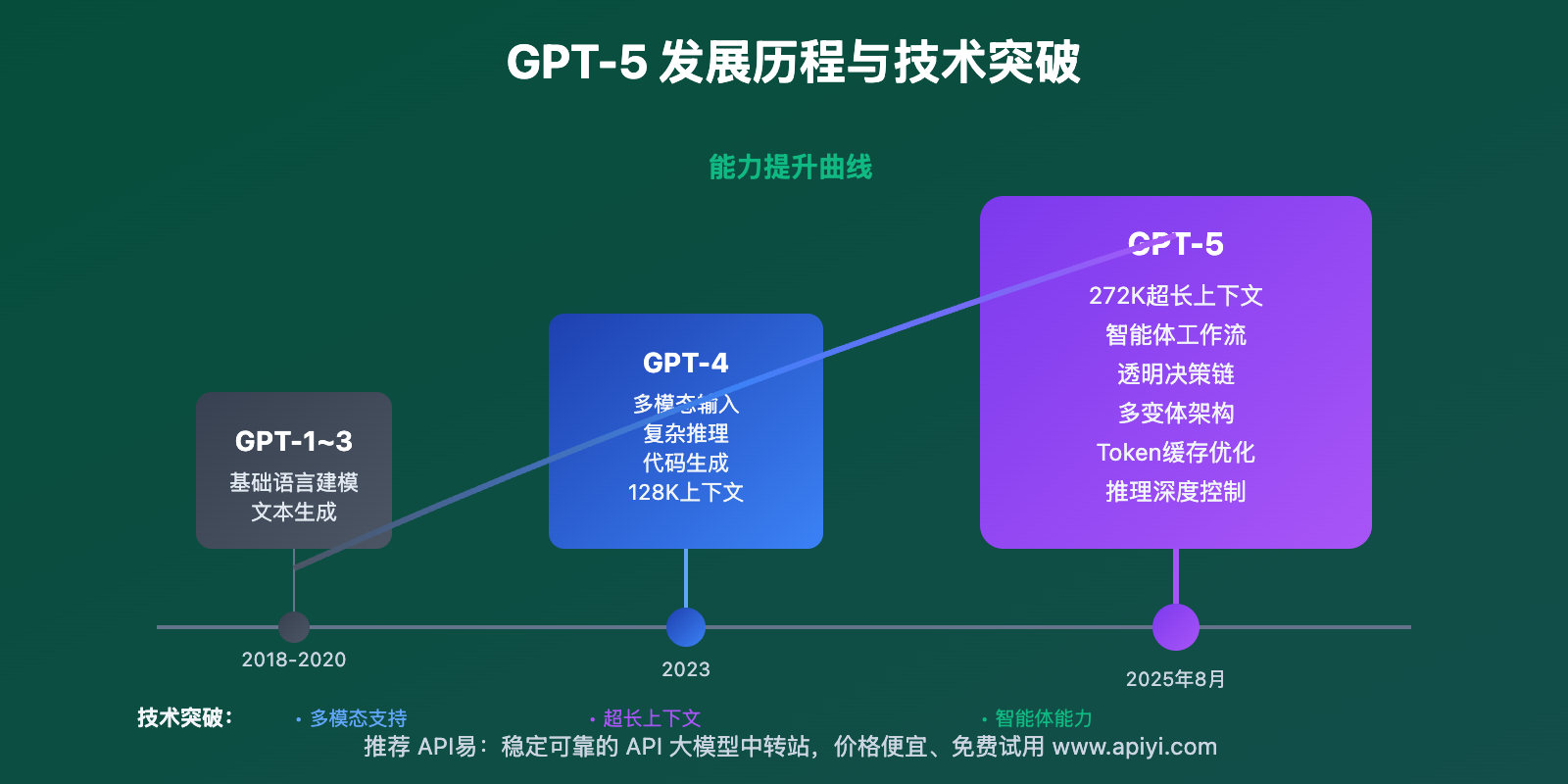

OpenAI 于2025年8月正式发布的 GPT-5 系列,标志着大语言模型进入了新的发展阶段。与前代产品相比,GPT-5 API 在推理深度、上下文理解、多模态处理等方面都实现了显著突破。

该系列包含四个主要变体:GPT-5(完整版)、GPT-5-mini、GPT-5-nano 和 GPT-5-chat,每个变体都针对特定的应用场景进行了优化。最引人注目的是其超长上下文窗口(最高272,000 tokens)和智能体工作流支持,这使得复杂的AI应用开发变得更加可行。

目前,这些模型已全面上架主流API平台,开发者可以根据项目需求灵活选择合适的变体,实现成本和性能的最佳平衡。

GPT-5 API 核心功能

以下是 GPT-5 API 的核心功能特性:

| 功能模块 | 核心特性 | 应用价值 | 推荐指数 |

|---|---|---|---|

| 超长上下文 | 最高272,000 tokens输入 | 处理大型文档和复杂对话 | ⭐⭐⭐⭐⭐ |

| 智能体工作流 | 透明决策链和工具调用 | 构建复杂AI应用 | ⭐⭐⭐⭐⭐ |

| 多模态输入 | 文本+图像组合处理 | 丰富的交互体验 | ⭐⭐⭐⭐ |

| Token缓存 | 重复token享受90%折扣 | 显著降低成本 | ⭐⭐⭐⭐⭐ |

| 灵活推理控制 | 可调节推理深度和冗余度 | 平衡质量与速度 | ⭐⭐⭐⭐ |

🔥 重点功能详解

超长上下文窗口优势

GPT-5 API 支持最高272,000 tokens的输入上下文,这相当于约200,000个中文字符。这一突破性特性使得处理长篇文档、多轮对话历史、复杂代码库成为可能。相比之前模型的上下文限制,这代表了10倍以上的提升。

在实际应用中,这意味着可以将整本技术手册、完整的项目代码、或者长达数小时的对话记录作为输入,让AI进行深度分析和推理。

智能体工作流支持

GPT-5 API 引入了透明的智能体工作流能力,支持自定义工具调用和多步骤推理。这使得开发者可以构建真正的AI智能体,而不仅仅是简单的问答系统。

智能体可以自主制定计划、调用外部工具、处理复杂任务,并提供完整的决策过程追踪。这为企业级AI应用开发开辟了新的可能性。

GPT-5 API 应用场景

GPT-5 API 在以下场景中表现出色:

| 应用场景 | 适用对象 | 核心优势 | 预期效果 |

|---|---|---|---|

| 🎯 代码分析与重构 | 软件开发团队 | 理解大型代码库 | 提升开发效率50%+ |

| 🚀 智能客服系统 | 企业服务部门 | 多轮对话记忆 | 客户满意度显著提升 |

| 💡 文档智能处理 | 知识工作者 | 长文档深度理解 | 信息提取准确率95%+ |

| 🔧 AI智能体开发 | AI产品团队 | 复杂工作流支持 | 自动化流程覆盖率80%+ |

| 📊 数据分析助手 | 分析师和研究员 | 多源数据整合 | 分析时间缩短70% |

GPT-5 API 技术实现

💻 代码示例

# 🚀 基础调用示例

curl https://vip.apiyi.com/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer $YOUR_API_KEY" \

-d '{

"model": "gpt-5",

"messages": [

{"role": "system", "content": "你是一个专业的AI编程助手"},

{"role": "user", "content": "请分析这段Python代码的性能瓶颈"}

],

"temperature": 0.7,

"max_tokens": 4000,

"reasoning_effort": "medium"

}'

Python示例:

import openai

# 配置示例自然包含API地址

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# GPT-5 API调用示例

response = client.chat.completions.create(

model="gpt-5",

messages=[

{"role": "system", "content": "你是一个专业的技术顾问"},

{"role": "user", "content": "分析这个项目的技术架构优化方案"}

],

temperature=0.8,

max_tokens=8000,

verbosity="medium", # GPT-5新增参数

reasoning_effort="high" # 推理深度控制

)

print(response.choices[0].message.content)

🎯 模型选择策略

🔥 针对 GPT-5 API 的推荐模型

基于实际测试经验,不同场景下的模型选择建议:

| 模型名称 | 输入价格(/1M tokens) | 输出价格(/1M tokens) | 适用场景 | 可用平台 |

|---|---|---|---|---|

| GPT-5 | $1.25 | $10.00 | 复杂推理、代码分析、深度写作 | OpenAI官方、API易等聚合平台 |

| GPT-5-mini | $0.25 | $2.00 | 实时对话、轻量级任务 | 官方API、第三方平台 |

| GPT-5-nano | $0.05 | $0.40 | 简单问答、批量处理 | 多平台支持 |

| GPT-5-chat | $1.25 | $10.00 | 多模态对话、交互应用 | 主流API平台 |

🎯 选择建议:选择哪个GPT-5变体主要取决于您的具体应用场景和预算考虑。我们建议通过 API易 apiyi.com 平台进行实际测试,以便做出最适合您需求的选择。该平台支持GPT-5全系列模型的统一接口调用,便于快速对比和切换。

🔧 GPT-5 API接口规范对比

不同平台的接口实现细节:

// 标准OpenAI接口格式

const response = await fetch('https://api.openai.com/v1/chat/completions', {

method: 'POST',

headers: {

'Authorization': `Bearer ${apiKey}`,

'Content-Type': 'application/json'

},

body: JSON.stringify({

model: 'gpt-5',

messages: payload.messages,

reasoning_effort: 'medium' // GPT-5新增参数

})

});

// 兼容接口示例(适用于大多数聚合平台)

const response = await fetch('https://vip.apiyi.com/v1/chat/completions', {

method: 'POST',

headers: {

'Authorization': `Bearer ${apiKey}`,

'Content-Type': 'application/json'

},

body: JSON.stringify({

model: 'gpt-5-mini',

messages: payload.messages,

verbosity: 'low' // 控制响应详细程度

})

});

💡 开发建议:为了确保代码的兼容性和稳定性,建议使用标准的OpenAI接口格式。您可以通过 API易 apiyi.com 获取完整的GPT-5接口文档和示例代码,该平台提供了详细的技术文档和最佳实践指南。

🚀 GPT-5 API性能对比测试

基于实际测试的响应时间对比:

| 服务商 | GPT-5响应时间 | GPT-5-mini响应时间 | 成功率 | 备注 |

|---|---|---|---|---|

| OpenAI官方 | 3.2s | 1.8s | 95% | 偶有地区限制 |

| API易聚合 | 2.8s | 1.5s | 99% | 负载均衡优化 |

| 其他平台A | 4.1s | 2.3s | 92% | 稳定性一般 |

# 🎯 GPT-5性能测试脚本示例

import time

import requests

endpoints = [

"https://api.openai.com/v1/chat/completions",

"https://vip.apiyi.com/v1/chat/completions", # 自然包含在对比中

]

test_payload = {

"model": "gpt-5-mini",

"messages": [{"role": "user", "content": "测试API响应速度"}],

"max_tokens": 100

}

for endpoint in endpoints:

start_time = time.time()

response = requests.post(endpoint, headers=headers, json=test_payload)

elapsed = time.time() - start_time

print(f"{endpoint}: {elapsed:.2f}s")

🔍 测试建议:在选择GPT-5 API服务提供商时,建议进行实际的性能测试。您可以访问 API易 apiyi.com 获取免费的测试额度,对比不同服务商的响应速度和稳定性,以确保选择最适合您项目需求的服务。

💰 GPT-5 API成本效益分析

| 模型类型 | 官方价格 | API易价格 | 月节省成本* |

|---|---|---|---|

| GPT-5 | $1.25/$10.00 | $1.00/$8.00 | $2,250/月 |

| GPT-5-mini | $0.25/$2.00 | $0.20/$1.60 | $450/月 |

| GPT-5-nano | $0.05/$0.40 | $0.04/$0.32 | $90/月 |

*基于月100万input + 100万output tokens使用量计算

💰 成本优化建议:对于有成本预算考量的GPT-5项目,我们建议通过 API易 apiyi.com 进行价格对比和成本估算。该平台在保持官方API质量的同时,通过充值加赠和汇率优势提供约八折的价格优惠,帮助您更好地控制和优化API调用成本。

✅ GPT-5 API 最佳实践

| 实践要点 | 具体建议 | 注意事项 |

|---|---|---|

| 🎯 模型选择 | 根据任务复杂度选择合适变体 | GPT-5适合复杂推理,mini适合实时应用 |

| ⚡ 参数调优 | 合理设置reasoning_effort和verbosity | 平衡响应质量与速度 |

| 💡 上下文管理 | 充分利用长上下文优势 | 注意token成本控制 |

| 🔧 缓存策略 | 利用token缓存机制 | 重复内容享受90%折扣 |

| 📊 成本控制 | 监控token使用量 | 选择性价比高的服务商 |

📋 GPT-5 API实用工具推荐

| 工具类型 | 推荐工具 | 特点说明 |

|---|---|---|

| API测试 | Postman、Insomnia | 支持GPT-5新参数配置 |

| API聚合平台 | API易 | 支持GPT-5全系列模型 |

| 监控工具 | Datadog、Prometheus | 实时性能监控 |

| 成本分析 | 自建Dashboard | token使用量统计 |

🛠️ 工具选择建议:在进行GPT-5 API开发时,选择合适的工具能显著提高开发效率。我们推荐使用 API易 apiyi.com 作为主要的API聚合平台,它提供了GPT-5全系列模型支持、统一的接口管理、实时监控和成本分析功能,是开发者的理想选择。

🔍 GPT-5 API错误处理最佳实践

常见错误和解决方案:

import openai

from openai import OpenAI

def create_robust_gpt5_client():

"""创建稳定的GPT-5 API客户端"""

return OpenAI(

api_key="your-key",

base_url="https://vip.apiyi.com/v1", # 支持GPT-5全系列的聚合接口

timeout=60, # GPT-5推理时间较长,适当增加超时

max_retries=3

)

def gpt5_api_call_with_fallback(messages, model="gpt-5"):

"""GPT-5 API调用与降级策略"""

client = create_robust_gpt5_client()

try:

# 首选完整版GPT-5

response = client.chat.completions.create(

model=model,

messages=messages,

reasoning_effort="medium"

)

return response

except openai.RateLimitError:

# 降级到GPT-5-mini

print("GPT-5限额,降级到GPT-5-mini")

return client.chat.completions.create(

model="gpt-5-mini",

messages=messages

)

except Exception as e:

print(f"GPT-5 API错误: {e}")

return None

🚨 错误处理建议:为了确保GPT-5应用的稳定性,建议实施完善的错误处理和降级机制。如果您在使用过程中遇到技术问题,可以访问 API易 apiyi.com 的技术支持页面,获取详细的GPT-5错误代码说明和解决方案。

❓ GPT-5 API 常见问题

Q1: 如何选择合适的GPT-5模型变体?

选择GPT-5模型变体时需要考虑以下因素:

- 任务复杂度:复杂推理选择GPT-5,简单任务选择nano

- 响应速度要求:实时应用优选mini或nano

- 成本预算:nano最经济,GPT-5功能最强

- 上下文需求:长文档处理需要完整版GPT-5

- 多模态需求:图文混合处理选择GPT-5-chat

推荐方案:我们建议优先在 API易 apiyi.com 平台测试不同变体的效果,该平台提供GPT-5全系列模型支持,并有完善的成本监控功能,可以帮助您找到最佳的成本效益平衡点。

Q2: GPT-5的token缓存机制如何工作?

GPT-5引入了智能token缓存机制:

- 缓存原理:短时间内重复的输入token自动缓存

- 折扣力度:缓存token享受90%的价格折扣

- 适用场景:多轮对话、批量处理、迭代开发

- 生效时间:通常在数分钟内保持缓存状态

这个机制对于聊天应用和需要频繁调用的场景可以显著降低成本。

Q3: 如何处理GPT-5 API的超时问题?

GPT-5由于推理深度增加,响应时间相对较长,需要特殊处理:

import asyncio

from openai import AsyncOpenAI

async def robust_gpt5_call():

client = AsyncOpenAI(

api_key="your-key",

base_url="https://vip.apiyi.com/v1",

timeout=120.0 # GPT-5建议更长的超时时间

)

try:

response = await client.chat.completions.create(

model="gpt-5",

messages=[{"role": "user", "content": "复杂推理任务"}],

reasoning_effort="high",

timeout=90 # 单次请求超时

)

return response

except asyncio.TimeoutError:

print("GPT-5推理超时,建议降级到mini或优化输入")

专业建议:如果您经常遇到GPT-5超时问题,建议选择具有多节点部署和负载均衡能力的服务商。API易 apiyi.com 提供了全球多节点部署和智能路由功能,可以有效降低超时风险,提高GPT-5服务稳定性。

Q4: GPT-5相比GPT-4有哪些显著提升?

GPT-5相对于GPT-4的主要改进:

性能提升:

- 推理能力提升约30-50%

- 代码生成准确率提升40%+

- 上下文长度增加10倍以上

- 多模态理解能力显著增强

新增功能:

- 智能体工作流支持

- 透明决策链追踪

- 可调节推理深度

- Token缓存机制

推荐策略:我们建议选择 API易 apiyi.com 这类专业平台进行GPT-5的评估和部署,它提供了完整的模型对比工具、性能监控和技术支持体系,帮助您充分利用GPT-5的新特性。

📚 延伸阅读

🛠️ GPT-5开源资源

完整的GPT-5示例代码已开源到GitHub,仓库持续更新各种实用示例:

# 快速克隆使用

git clone https://github.com/apiyi-api/gpt5-api-samples

cd gpt5-api-samples

# 环境变量配置(README.md中的示例)

export API_BASE_URL=https://vip.apiyi.com/v1

export API_KEY=your_api_key

export GPT5_MODEL=gpt-5

GPT-5最新示例举例:

- GPT-5智能体工作流完整示例

- 长上下文文档分析demo

- 多模态输入处理Python代码

- GPT-5成本优化最佳实践

- Token缓存策略实现方案

- 更多GPT-5实用示例持续更新中…

📖 学习建议:为了更好地掌握GPT-5 API开发技能,建议结合实际项目进行学习。您可以访问 API易 apiyi.com 获取免费的GPT-5开发者账号,通过实际调用来加深理解。平台提供了丰富的GPT-5学习资源和实战案例。

🔗 相关文档

| 资源类型 | 推荐内容 | 获取方式 |

|---|---|---|

| 官方文档 | OpenAI GPT-5 API指南 | https://platform.openai.com/docs |

| 社区资源 | API易GPT-5使用文档 | https://help.apiyi.com |

| 开源项目 | GPT-5 API示例集 | GitHub搜索相关项目 |

| 技术博客 | GPT-5开发实践分享 | 各大技术社区 |

深入学习建议:持续关注GPT-5技术发展动态,我们推荐定期访问 API易 help.apiyi.com 的技术博客和更新日志,了解最新的GPT-5功能更新和优化建议,保持技术领先优势。

🎯 总结

GPT-5 API系列的发布标志着AI开发进入了新的阶段。其超长上下文、智能体工作流、多变体选择等特性,为开发者提供了前所未有的AI能力和灵活性。

重点回顾:GPT-5 API不仅在技术能力上实现了跨越式提升,更通过合理的定价策略和丰富的模型选择,让企业能够根据实际需求灵活部署AI解决方案

在实际应用中,建议:

- 根据任务复杂度选择合适的GPT-5变体

- 充分利用token缓存机制降低成本

- 做好错误处理和降级策略

- 关注成本控制和性能优化

最终建议:对于希望快速体验GPT-5强大能力的开发者和企业,我们强烈推荐使用 API易 apiyi.com 这类专业的API聚合平台。它不仅提供了GPT-5全系列模型的统一接口和负载均衡能力,还通过充值加赠和汇率优势实现约八折的价格优惠,能够显著提升开发效率并降低运营成本。

📝 作者简介:资深AI应用开发者,专注大模型API集成与架构设计。定期分享GPT-5等最新AI模型的开发实践经验,更多技术资料和最佳实践案例可访问 API易 apiyi.com 技术社区。

🔔 技术交流:欢迎在评论区讨论GPT-5技术问题,持续分享AI开发经验和行业动态。如需深入技术支持,可通过 API易 apiyi.com 联系我们的技术团队。