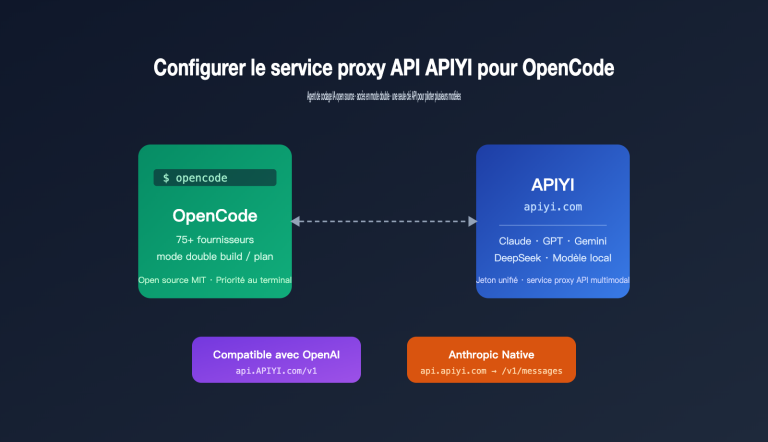

Guide complet de configuration du service proxy API pour OpenCode : 3 étapes pour activer les modes natif Claude et compatible OpenAI

OpenCode est l'un des agents de codage IA open source les plus en vue en 2026. Son créneau ? Une philosophie de conception « agnostique vis-à-vis du modèle et axée sur le terminal », permettant aux développeurs d'exécuter Claude, GPT, Gemini, des modèles locaux, ou même de mixer le tout. À l'instar de Claude Code,…