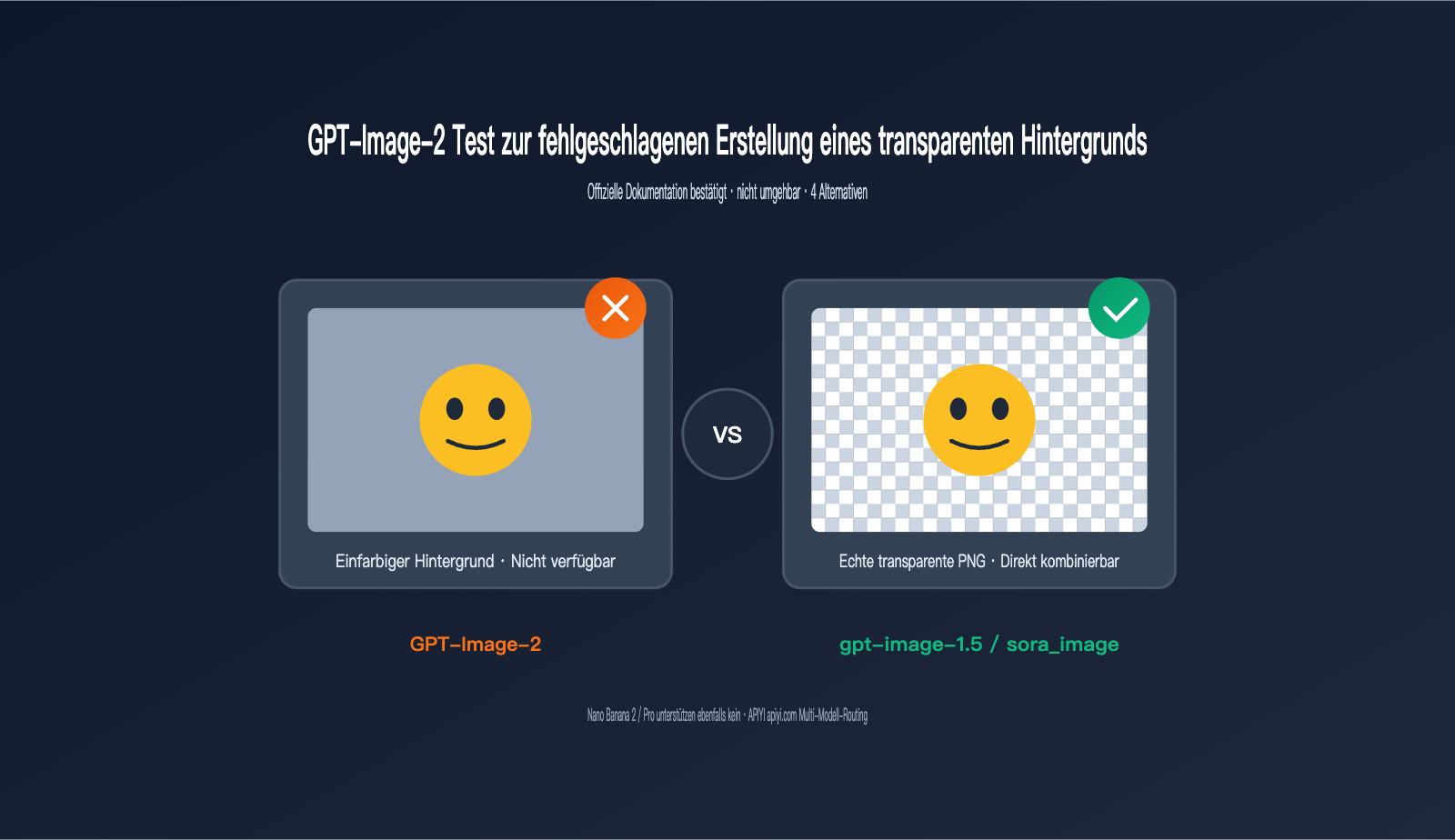

Bei der Unterstützung von Kunden bei der Fehlerbehebung ihrer Anforderungen an die Bilderzeugung sind wir auf ein Phänomen gestoßen, das wir gerne teilen möchten: GPT-Image-2 kann keine echten PNGs mit transparentem Hintergrund mehr erzeugen. Egal, ob Sie in der Eingabeaufforderung „Hintergrund muss transparent sein“ angeben oder den Parameter background: "transparent" direkt über die API übergeben, die neueste Generation von GPT-Image-2 liefert entweder ein Bild mit einfarbigem Hintergrund oder gibt direkt eine Fehlermeldung aus. Dies steht in krassem Gegensatz zu den Fähigkeiten der Vorgängergenerationen sora_image / gpt-4o-image und hat viele Teams, die sich mit E-Commerce-SKU-Freistellungen, Social-Media-Stickern oder PPT-Illustrationen beschäftigen, unvorbereitet getroffen.

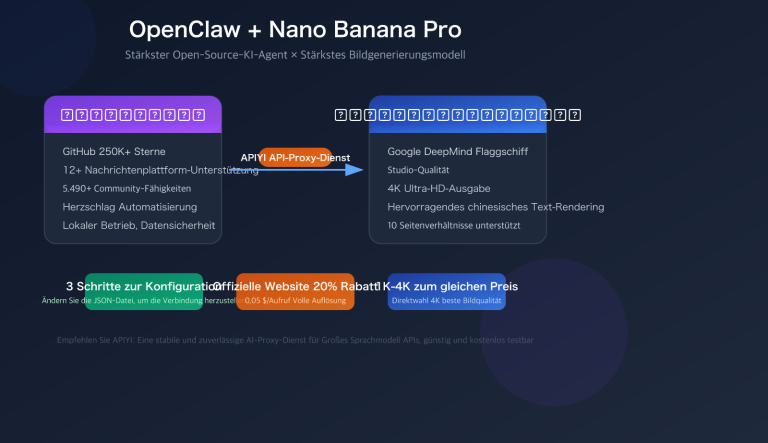

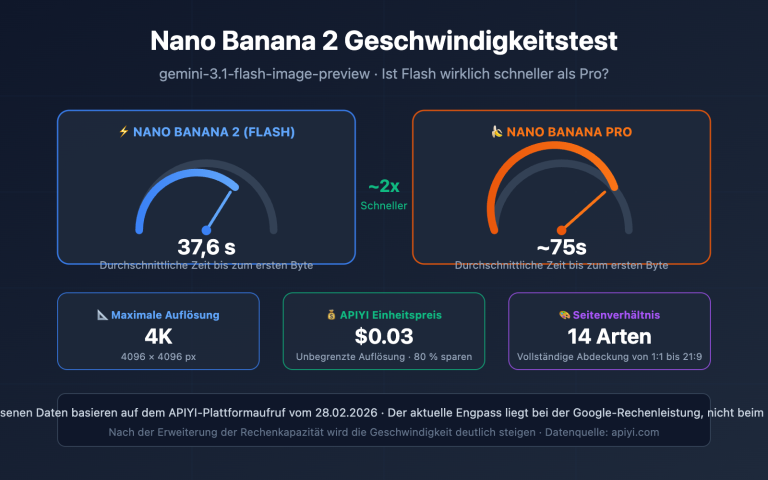

Zufälligerweise unterstützt auch das Ende 2025 von Google eingeführte Flaggschiff-Modell Nano Banana Pro (basierend auf Gemini 3 Pro Image) keine transparente Hintergrundgenerierung, und selbst die Vorgängerversion Nano Banana 2 weist dieselbe Einschränkung auf. Mit anderen Worten: Die beiden derzeit wichtigsten Basismodelle für die Bilderzeugung haben diese scheinbar grundlegende Funktion gestrichen. Wir haben bei APIYI (apiyi.com) eine vollständige Regressionsprüfung durchgeführt und die Phänomene, Grundursachen und Alternativlösungen in diesem Artikel zusammengefasst, um Teams bei der Produktintegration eine schnelle Entscheidungsfindung zu ermöglichen.

Vollständiges Reproduktionsexperiment zum Scheitern von GPT-Image-2 bei transparentem Hintergrund

Um diesen Fähigkeitsunterschied zu verstehen, ist der direkteste Weg, ihn einmal durchzuspielen. Wir haben über das APIYI-Gateway gleichzeitig die Versionen gpt-image-2, gpt-image-1.5 und gpt-image-2-all aufgerufen, mit der einheitlichen Eingabeaufforderung "a cute orange cat sticker, transparent background" und den background-Parameter explizit auf transparent gesetzt. Das Ergebnis war sehr konsistent: Die gpt-image-2-Serie gab entweder einen 4xx-Fehler zurück oder erzeugte ein Bild mit einfarbigem oder kariertem Hintergrund, während nur gpt-image-1.5 brav ein echtes transparentes PNG mit Alpha-Kanal lieferte.

# Test der Transparenz-Fähigkeit für 3 Versionen über das APIYI-Gateway

from openai import OpenAI

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1"

)

# ❌ gpt-image-2 unterstützt kein transparent, wird von der Gateway-Ebene abgelehnt

client.images.generate(

model="gpt-image-2",

prompt="a cute orange cat sticker",

background="transparent",

output_format="png"

)

# ✅ gpt-image-1.5 unterstützt weiterhin nativ die Ausgabe mit transparentem Hintergrund

client.images.generate(

model="gpt-image-1.5",

prompt="a cute orange cat sticker",

background="transparent",

output_format="png"

)

🎯 Tipp für den schnellen Einstieg: Wenn Sie lediglich einen bestehenden Workflow zum Laufen bringen möchten, ist der kostengünstigste Weg, das

model-Feld wieder aufgpt-image-1.5umzustellen, diebase_urlauf APIYI apiyi.com zu richten und die anderen Parameter unverändert zu lassen. Sie können die Transparenz-Ausgabefähigkeit innerhalb von 5 Minuten wiederherstellen.

Wir haben auch Fälle reproduziert, in denen Formulierungen wie "background must be transparent", "isolated on transparent canvas" oder "PNG with alpha channel" in die Eingabeaufforderung eingefügt wurden. GPT-Image-2 verhält sich sehr hartnäckig: Es liefert entweder einen weißen Hintergrund oder erzeugt ein Bild mit einem "Aufkleber"-Muster aus grauen und weißen Karos, was im Grunde bedeutet, dass es die "Visualisierung der Transparenz" einfach mitgezeichnet hat. Dies stimmt stark mit dem Fehlermodus von Nano Banana Pro überein und ist ein grundlegendes Problem bei der semantischen Ausrichtung des Modells, nicht etwa eine unpräzise Eingabeaufforderung.

| Auslöser | Verhalten von GPT-Image-2 | Verhalten von gpt-image-1.5 | Empfehlung |

|---|---|---|---|

Parameter background="transparent" |

API-Ablehnung / einfarbig | Echtes transparentes PNG | Modell wechseln |

| Eingabeaufforderung "transparent background" | Weißer Hintergrund oder Karomuster | Echtes transparentes PNG | Nicht auf Text verlassen |

| Eingabeaufforderung "isolated subject on white" | Hellgrauer Hintergrund | Subjekt auf weißem Grund | Mit Parametern kombinieren |

Ausgabe output_format=webp |

Immer noch einfarbig | Echtes transparentes webp | webp beeinflusst Fähigkeit nicht |

| Edit-Schnittstelle + Alpha-Maske | Ungültig | Teilweise transparent | Nur 1.5 verwendbar |

Die 3 Hauptgründe für das Fehlen transparenter Hintergründe bei GPT-Image-2

Der erste Grund liegt in architektonischen Abwägungen. In der offiziellen Dokumentation von OpenAI zu GPT-Image-2 heißt es explizit: „gpt-image-2 doesn't currently support transparent backgrounds“. Die Gründe hierfür wurden nicht öffentlich gemacht, aber in der Branche wird allgemein vermutet, dass dies mit dem Upgrade auf ein stärkeres Trainingsziel für „Szenenkonsistenz“ zusammenhängt. Das Modell wurde darauf trainiert, eine realistische Szene zu vervollständigen, anstatt „Freistellungen“ vorzunehmen – daher fehlen auf unterster Ebene die Signale für den Alpha-Kanal. Dies ist eine bewusste Designentscheidung auf Produktebene und kein Bug.

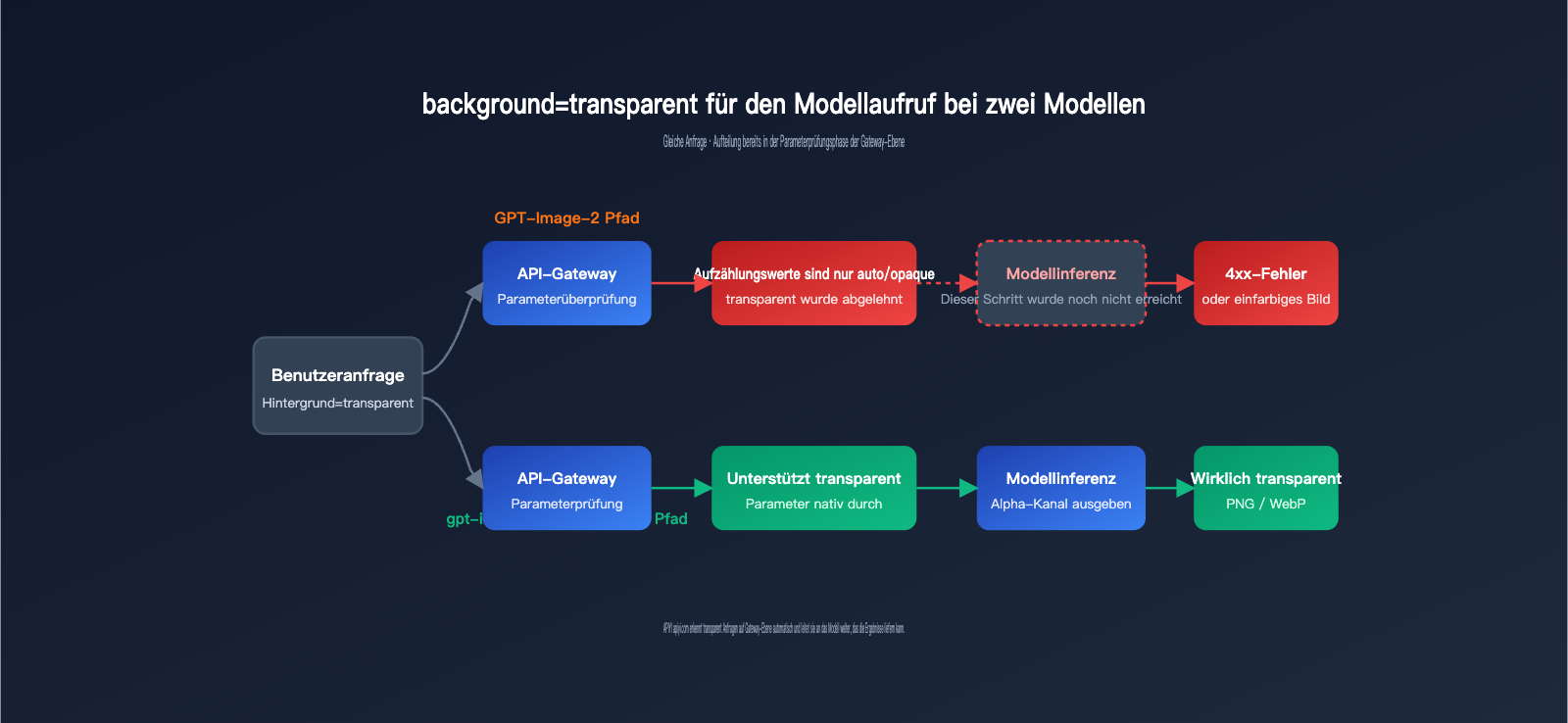

Zweitens gibt es eine erzwungene Validierung durch das API-Gateway. Wir haben die Antworten der offiziellen OpenAI-Endpunkte analysiert: Die Aufzählungswerte für den background-Parameter bei GPT-Image-2 erlauben nur auto und opaque. Der Wert transparent wurde schlichtweg aus dem Parameterraum entfernt. Das bedeutet, dass jede vorgelagerte Plattform (einschließlich des APIYI-Gateways) einen solchen Aufruf bereits in der Anfragephase ablehnt; er erreicht also gar nicht erst die Modellinferenz. Die Annahme, man könne dies durch den Wechsel zu einer Drittanbieter-Plattform umgehen, ist daher eine Illusion. Kanäle wie gpt-image-2-all oder gpt-image-2-vip nutzen ebenfalls dasselbe Backend-Modell.

Drittens spielen Sicherheits- und Urheberrechtsfilter eine Rolle. Bilder mit transparentem Hintergrund werden häufig für nachträgliche Kompositionen verwendet, insbesondere bei Szenen mit Porträts oder Markenlogos. OpenAI hat in den letzten zwei Jahren die Ausgabeberechtigungen für „Material zur nachträglichen Bearbeitung“ deutlich verschärft. Die Deaktivierung der Transparenzfunktion bei GPT-Image-2 steht in direktem Zusammenhang mit dieser strengeren Inhaltsprüfung.

🎯 Empfehlung zur Architektur: In einem einheitlichen Gateway wie APIYI (apiyi.com) validieren wir die Parameterbereiche von GPT-Image-2 und GPT-Image-1.5 getrennt. Bei Anfragen mit

transparentgeben wir automatisch Empfehlungen für ein Downgrade aus, um zu verhindern, dass es auf geschäftlicher Seite zu „unerklärlichen Aufruffehlern“ kommt.

GPT-Image-2 und Nano Banana Pro: Vergleich der Transparenz-Fähigkeiten

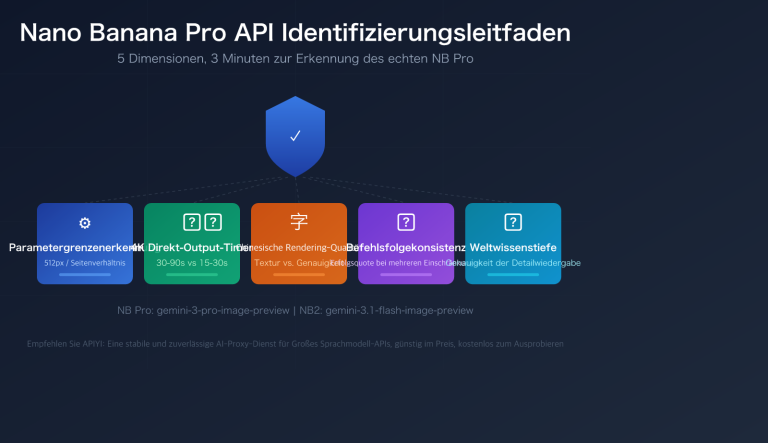

Viele Kunden fragen uns: „Reicht es aus, auf Google Nano Banana 2 / Nano Banana Pro umzusteigen?“ Die Antwort ist ernüchternd: Nein, das funktioniert ebenfalls nicht. Das Fehlerbild von Nano Banana Pro ist sogar noch „dreister“ als bei GPT-Image-2: Es generiert ein Bild, das auf den ersten Blick so aussieht, als hätte es einen transparenten Hintergrund. Bei genauerem Hinsehen stellt man jedoch fest, dass das Schachbrettmuster als echte Pixel in das Bild gezeichnet wurde – das Modell hat also die Transparenz-Indikatoren aus Photoshop einfach „nachgezeichnet“.

Die gängige Erklärung in der Community lautet: Die Trainingsdaten der Modelle enthalten eine enorme Menge an Bildmaterial, in dem Transparenz durch Schachbrettmuster dargestellt wird (Stock-Fotos, Photoshop-Screenshots, Design-Tutorials usw.). Dadurch hat das Modell die fehlerhafte Verknüpfung „Transparenz = Schachbrettmuster“ gelernt. Google hat im Gemini-API-Forum bereits bestätigt, dass die Nano-Banana-Serie derzeit keine native Ausgabe mit transparentem Hintergrund unterstützt. Stattdessen ist eine Kombination aus Gemini 3 Flash und Code-Ausführung erforderlich, um das Problem „durch die Hintertür“ zu lösen.

| Modell | Veröffentlichungsdatum | Transparenz-Unterstützung | Fehlerverhalten | Empfohlener Einsatzbereich |

|---|---|---|---|---|

| GPT-Image-2 | Anfang 2026 | ❌ Nicht unterstützt | Vollfarbiger Hintergrund / Fehler | Realistische Szenen, Poster |

| GPT-Image-2-all (Reverse) | Anfang 2026 | ❌ Nicht unterstützt | Wie beim Original | Äquivalent zu GPT-Image-2 |

| GPT-Image-1.5 | Mitte 2025 | ✅ Nativ unterstützt | / | Sticker, E-Commerce-Freisteller |

| sora_image / gpt-4o-image | März 2025 | ✅ Unterstützt | / | Kompatibilität mit alten Workflows |

| Nano Banana 2 | 2. Halbjahr 2025 | ❌ Nicht unterstützt | Grau-weißes Schachbrettmuster | Sekundärkreationen, Stilisierung |

| Nano Banana Pro | Ende 2025 | ❌ Nicht unterstützt | Grau-weißes Schachbrettmuster | High-Fidelity-Bearbeitung |

| Stable Diffusion + LoRA | Laufend | ✅ Indirekt unterstützt | Erfordert Nachbearbeitung | Selbstgehostete Massenproduktion |

🎯 Auswahlhilfe: Wenn Sie lediglich „das Hauptobjekt freistellen“ möchten, ist die wirtschaftlichste Kombination für 2026 die direkte Bilderzeugung mit GPT-Image-1.5 / sora_image oder die Verwendung von Nano Banana Pro mit einer anschließenden automatischen Hintergrundentfernung. Beide Wege lassen sich über APIYI (apiyi.com) mit einheitlicher Authentifizierung und Abrechnung nutzen, sodass Sie nicht zwei verschiedene API-Schlüssel verwalten müssen.

4 alternative Lösungswege für transparente Hintergründe bei GPT-Image-2

Obwohl GPT-Image-2 von sich aus keine transparenten Bilder ausgibt, gibt es vier bewährte Wege, um das Ziel dennoch zu erreichen. Jeder Weg hat seine eigene Kosten- und Qualitätskurve, sodass Sie je nach Anwendungsfall flexibel wählen können.

Der erste Weg ist der direkte Downgrade auf sora_image / gpt-image-1.5. Dies ist die Lösung mit dem geringsten Aufwand: Der Client-Code muss kaum angepasst werden; man ändert lediglich das Feld model von gpt-image-2 auf gpt-image-1.5 oder sora_image, und schon ist die Alpha-Kanal-Ausgabe wieder verfügbar. Der Preis dafür ist eine etwas geringere Detailtreue und schwächere Textdarstellung im Vergleich zu GPT-Image-2, was jedoch für Sticker, Logos oder E-Commerce-Produktbilder völlig ausreicht.

Der zweite Weg ist GPT-Image-2-Bilderzeugung + nachträgliche Freistellung. Zuerst generieren Sie mit GPT-Image-2 ein Bild mit einfarbigem Hintergrund in hoher Qualität und schalten anschließend ein Freistellungsmodell (z. B. 851-labs/background-remover, RemBG oder BiRefNet) dahinter, um den Alpha-Kanal zu extrahieren. Diese Methode bewahrt die Stärken von GPT-Image-2 bei der Bildrealistik, erhöht jedoch die Latenz um 1–3 Sekunden. Die Präzision bei komplexen Kanten (Haare, Glas, Rauch) hängt dabei vom gewählten Freistellungsmodell ab.

Der dritte Weg ist die Chroma-Key-Methode (Greenscreen). Sie erzwingen in der Eingabeaufforderung einen „solid pure green background, hex #00ff00“, damit GPT-Image-2 ein sauberes, einfarbiges Hintergrundbild erstellt, das anschließend per Code über einen HSV-Farbschwellenwert ersetzt wird. Diese Methode ist schneller und günstiger als eine allgemeine Freistellung, hat aber den Nachteil, dass sie Pixel im gleichen Farbton innerhalb des Hauptobjekts „mitfrisst“ – sie ist also ungeeignet, wenn das Hauptobjekt selbst grüne Anteile enthält.

Der vierte Weg ist die Subtraktionsmethode mit zwei Hintergrundbildern. Sie lassen GPT-Image-2 mit demselben Seed zwei Bilder generieren: eines mit weißem und eines mit schwarzem Hintergrund. Anschließend berechnen Sie die Farbdifferenz Pixel für Pixel, um den Alpha-Wert zurückzurechnen. Dies ist eine in der OpenAI-Community viel diskutierte „Hardcore“-Lösung mit der stabilsten Qualität, kostet jedoch die doppelte Gebühr für die Bilderzeugung.

| Alternative Lösung | Implementierungsaufwand | Zusätzliche Kosten pro Bild | Kantenqualität | Anwendungsfall |

|---|---|---|---|---|

| Zurück zu GPT-Image-1.5 / sora_image | ⭐ | 0 | Hoch | Sticker, E-Commerce-Bilder |

| GPT-Image-2 + allgemeines Freistellungsmodell | ⭐⭐ | +1 Freistellungsaufruf | Mittel-Hoch | Realistische Personen, Produkte |

| Chroma-Key-Methode (Greenscreen) | ⭐⭐⭐ | Nahezu null | Mittel | Cartoons, geometrische Formen |

| Subtraktionsmethode mit zwei Bildern | ⭐⭐⭐⭐ | 2x Erzeugungskosten | Hoch | Glas, Haare, komplexe Kanten |

🎯 Engineering-Empfehlung: Im Backend von APIYI (apiyi.com) leiten wir Anforderungen für „transparente Hintergründe“ standardmäßig an gpt-image-1.5 weiter. Wenn Kunden den realistischen Stil von GPT-Image-2 beibehalten möchten, können sie über eine einheitliche Schnittstelle die Kombination aus „Bilderzeugung + Freistellung“ als zweistufigen Prozess aufrufen. Die gesamte Kette wird dabei über einen einzigen Endpunkt bereitgestellt, was die Kapselung auf Geschäftsseite vereinfacht.

Wenn Ihr Projekt sowohl bei der Kantenqualität als auch bei den Kosten sensibel ist, kann die folgende Vergleichstabelle für Freistellungstools als Ausgangspunkt für Ihre Auswahl dienen:

| Freistellungstool | Kantenpräzision | Durchschnittliche Dauer | Bereitstellungsform | Empfohlene Kombination |

|---|---|---|---|---|

| 851-labs/background-remover | Hoch | 1,5–2 Sek. | Cloud-API | Mit GPT-Image-2 Realistik-Bildern |

| RemBG (U2Net) | Mittel | 0,5 Sek. | Selbstgehostet | Mit einfarbigem Hintergrund, Batch-Jobs |

| BiRefNet | Extrem hoch | 2–3 Sek. | Selbstgehostet | Haare, komplexe Kanten |

| HSV-Farbschwellenwert | Mittel | <0,1 Sek. | Ein paar Zeilen Python | Mit Chroma-Key-Greenscreen |

Häufig gestellte Fragen (FAQ) zu transparenten Hintergründen bei GPT-Image-2

F1: Warum schlägt es immer fehl, wenn ich in der Eingabeaufforderung für GPT-Image-2 „Hintergrund muss transparent sein“ schreibe?

Weil das Modell nicht darauf trainiert wurde, einen Alpha-Kanal auszugeben; es kann Bilder nur im RGB-Farbraum erstellen. Wenn Sie eine Anweisung wie „transparent background“ erzwingen, zeichnet das Modell buchstäblich ein visuelles Symbol, das „Transparenz“ darstellt – also den typischen Schachbrett-Hintergrund. Dies ist ein klassisches Beispiel für ein Scheitern der semantischen Ausrichtung, unabhängig davon, wie detailliert Ihre Eingabeaufforderung ist.

F2: Warum funktionieren offizielle Reverse-Proxy-Kanäle wie gpt-image-2-all / gpt-image-2-vip ebenfalls nicht?

Diese Kanäle rufen im Kern dasselbe OpenAI-Backend-Modell auf; sie bieten lediglich einen Account-Pool oder Proxy auf der Frontend-Ebene. Fähigkeiten, die das Modell selbst nicht unterstützt, können auch durch eine noch so gute Verpackung im Frontend nicht nachgerüstet werden. Wenn Drittanbieter behaupten, dass „GPT-Image-2 transparente Hintergründe unterstützt“, führen sie meist im Hintergrund eine automatische Hintergrundentfernung über das API-Gateway durch, anstatt dass GPT-Image-2 nativ Transparenz ausgibt.

F3: Welches API sollte ich wählen, wenn mein Projekt zwingend einen transparenten Hintergrund benötigt?

Unsere Praxistests bei APIYI (apiyi.com) zeigen: Für Sticker, Emojis oder E-Commerce-Produktbilder ist GPT-Image-1.5 die beste Wahl. Für fotorealistische Freistellungen empfehlen wir GPT-Image-2 in Kombination mit einem speziellen Modell zur Hintergrundentfernung. Für Szenarien, die lokale Compliance-Anforderungen erfüllen müssen, ist eine selbst gehostete Stable-Diffusion-Instanz eine Überlegung wert. Alle drei Wege lassen sich über dasselbe Gateway umschalten, was A/B-Tests erheblich vereinfacht.

F4: Wann werden GPT-Image-2 / Nano Banana Pro wieder transparente Hintergründe unterstützen?

Weder OpenAI noch Google haben hierzu einen Zeitplan veröffentlicht. Basierend auf bisherigen Iterationszyklen ergänzt OpenAI fehlende Parameter meist in kleineren Versionssprüngen (wie GPT-Image-2.1 oder 2.5). Googles Nano-Banana-Serie setzt eher auf eine Kombination aus Gemini 3 Flash und Code-Ausführung, anstatt das Basismodell selbst zu verändern.

F5: Wie kann mir APIYI (apiyi.com) dabei helfen?

Wir bieten drei Lösungen: ① Automatische Erkennung von transparent-Anfragen auf Gateway-Ebene mit entsprechendem Hinweis auf ein Downgrade; ② Ein einheitliches Routing für verschiedene Modelle wie GPT-Image-1.5, GPT-Image-2 und Nano Banana Pro; ③ Zentrale Abrechnung, Kontingentverwaltung und Protokollierung, damit Teams die tatsächlichen Kosten verschiedener Lösungen vergleichen können, ohne mehrere SDKs selbst warten zu müssen.

3 Fazite zum Problem mit transparenten Hintergründen bei GPT-Image-2

Erstens: Dass GPT-Image-2 keine transparenten Hintergründe unterstützt, ist eine bewusste Produktentscheidung und kein Problem der Eingabeaufforderung oder der Implementierung. Workflows, die in der Eingabeaufforderung hartnäckig „transparent“ fordern, sollten so schnell wie möglich auf Version 1.5 oder eine Nachbearbeitungs-Pipeline umgestellt werden, da man sonst nur im Kreis läuft und immer wieder das Schachbrettmuster erhält.

Zweitens: Auch Nano Banana 2 / Pro unterstützen keine transparenten Hintergründe. „Native Transparenz“ ist derzeit nur mit der Vorgängergeneration GPT-Image-1.5, sora_image / gpt-4o-image oder einer selbst gehosteten Stable-Diffusion-Instanz möglich. Es ist unrealistisch, auf einen „versteckten Schalter“ zu hoffen.

Drittens: Der stabilste Ansatz für Unternehmen ist die Abstraktion der Modelle hinter einem Gateway. So können Anforderungen wie „transparenter Hintergrund“ automatisch an das Modell weitergeleitet werden, das diese auch liefern kann. Wir haben diese Routing-Strategie bereits als Standardverhalten implementiert, damit Ihr Team Zeit spart und sich auf die eigentliche Geschäftslogik konzentrieren kann.

Wenn Sie Ihre Workflows zur Bilderzeugung gerade umstrukturieren, laden wir Sie ein, bei APIYI (apiyi.com) einen Regressionstest durchzuführen: Lassen Sie Ihre bestehende Eingabeaufforderung gleichzeitig durch GPT-Image-2 und GPT-Image-1.5 laufen. Innerhalb von 10 Minuten erhalten Sie eine Vergleichstabelle, die Ihnen zeigt, welches Modell für welches Szenario geeignet ist – so können Sie fundiert entscheiden, ob ein Downgrade oder eine nachgelagerte Hintergrundentfernung die richtige Wahl ist.

📌 Autor: Das technische Team von APIYI — Wir verfolgen kontinuierlich die Kapazitätsänderungen führender Modelle von OpenAI, Google und Anthropic, um Entwicklern eine einheitliche API-Gateway-Erfahrung für mehrere Modelle zu bieten. Mehr erfahren Sie unter APIYI.com.