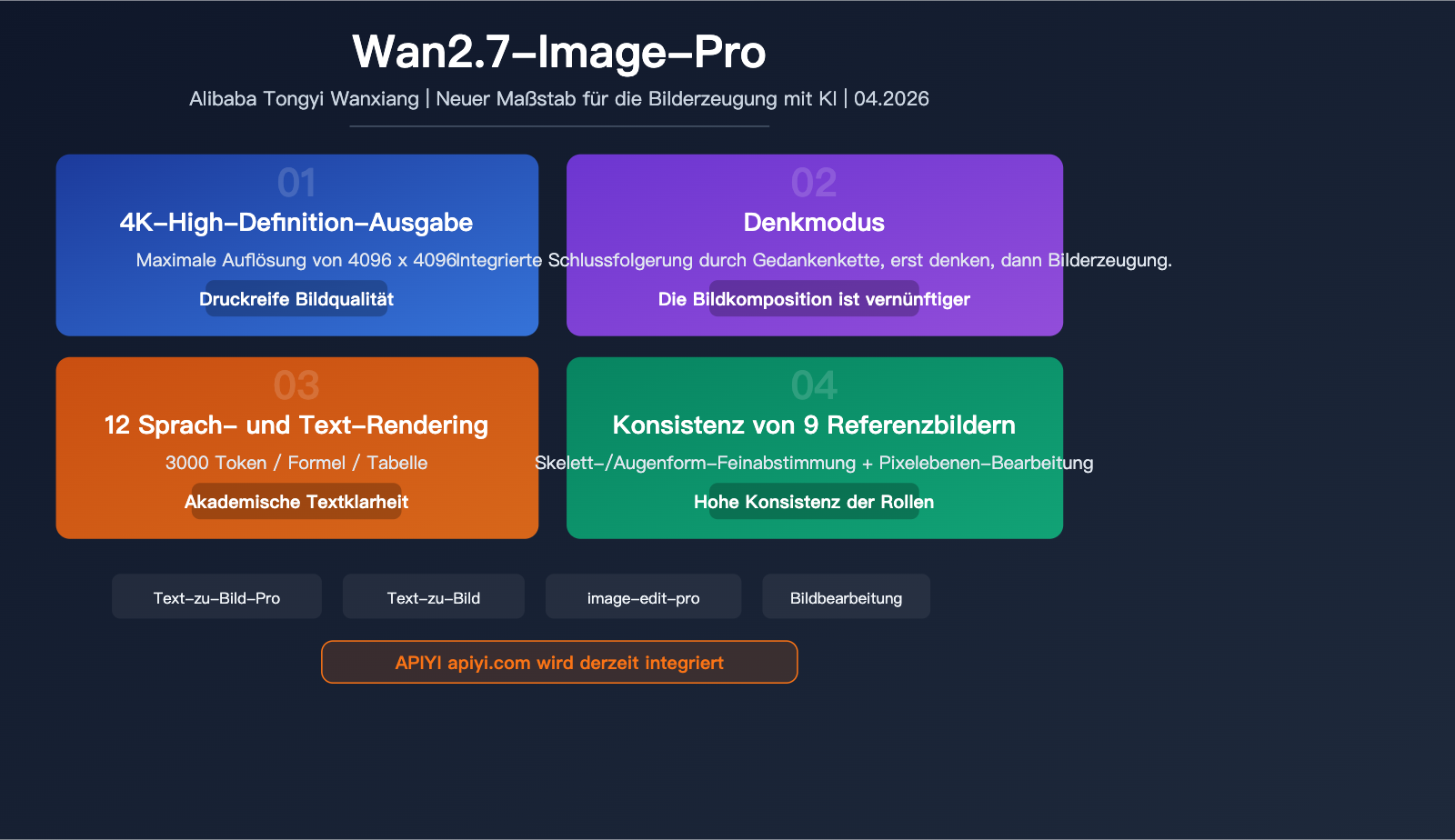

Anmerkung des Autors: Alibaba hat das Bilderzeugungsmodell Wan2.7-Image-Pro veröffentlicht, das 4K-Ausgabe, einen integrierten Denk- und Schlussfolgerungsmodus, Text-Rendering in 12 Sprachen sowie Konsistenzkontrolle durch 9 Referenzbilder unterstützt. Dieser Artikel erläutert die technischen Merkmale, die API-Anbindung und die praktische Anwendung.

Im Bereich der KI-Bilderzeugung ist das Innovationstempo extrem hoch. Am 1. April 2026 veröffentlichte Alibaba offiziell Wan2.7-Image-Pro – das erste 4K-Bilderzeugungsmodell mit integriertem Denk- und Schlussfolgerungsmodus. Es erzielt signifikante Durchbrüche bei der Textdarstellung, der präzisen Farbsteuerung und der Konsistenz bei mehreren Referenzbildern. APIYI bindet dieses Modell derzeit ein, sodass Entwickler es bald über eine einheitliche API aufrufen können.

Kernnutzen: Nach dem Lesen dieses Artikels kennen Sie die technischen Vorteile von Wan2.7-Image-Pro, die Unterschiede zu Vorgängermodellen und Wettbewerbern sowie die Möglichkeiten zur schnellen API-Anbindung.

Wan2.7-Image-Pro Kernpunkte

| Punkt | Beschreibung | Wert |

|---|---|---|

| 4K-Ausgabe | Pro-Version unterstützt bis zu 4096×4096 Pixel | Druckreife Qualität |

| Thinking-Modus | Integrierte Chain-of-Thought-Optimierung | Bessere Komposition, weniger Fehler |

| 12-Sprachen-Rendering | Unterstützung für 3000 Token mehrsprachigen Text | Wissenschaftliche Diagramme, Formeln, Tabellen |

| 9 Referenzbilder | Konsistenzkontrolle für mehrere Referenzbilder | Einheitliche Charaktere/Stile |

| Präzise Farbsteuerung | Unterstützung für exakte Farbcodes und Verhältnisse | Markenfarben-Fixierung |

| 12 Bilder pro Durchgang | Batch-Bilderzeugung | Höhere Effizienz |

Was ist Wan2.7-Image-Pro?

Wan2.7-Image-Pro ist das neueste Bilderzeugungsmodell aus der Tongyi Wanxiang (Wan) Serie von Alibaba und gehört zum Bereich der visuellen Kreation innerhalb des Qwen-Ökosystems. Es ist nicht nur ein einfaches "Text-zu-Bild"-Tool, sondern ein umfassendes System zur Bildgestaltung, das semantisches Verständnis, visuelle Schlussfolgerungen und präzise Steuerung vereint.

Im Vergleich zu früheren Versionen besteht das wichtigste Architektur-Upgrade von Wan2.7 darin, dass Textsemantik und visuelle Semantik in einen gemeinsamen latenten Raum abgebildet werden – das Modell muss die Bedeutung des Textes nicht mehr "erraten", sondern Text und Bild werden von Anfang an eng miteinander verknüpft. Dies führt zu einem Qualitätssprung beim Verständnis der Eingabeaufforderung, der logischen Komposition und der Genauigkeit der Details.

Detaillierte technische Merkmale von Wan2.7-Image-Pro

Die Wan2.7-Modellfamilie

Die Wan2.7-Bilderzeugung umfasst 4 API-Endpunkte, die unterschiedliche Anforderungen von Standard- bis hin zu Profi-Anwendungen abdecken:

| Modell-Endpunkt | Funktion | Maximale Auflösung | Positionierung |

|---|---|---|---|

| wan-2.7/text-to-image-pro | Text-zu-Bild Pro | 4K (4096×4096) | High-End-Kreation |

| wan-2.7/text-to-image | Text-zu-Bild Standard | 2K (2048×2048) | Tägliche Nutzung |

| wan-2.7/image-edit-pro | Bildbearbeitung Pro | 2K | Feinbearbeitung |

| wan-2.7/image-edit | Bildbearbeitung Standard | Standard | Schnelle Bearbeitung |

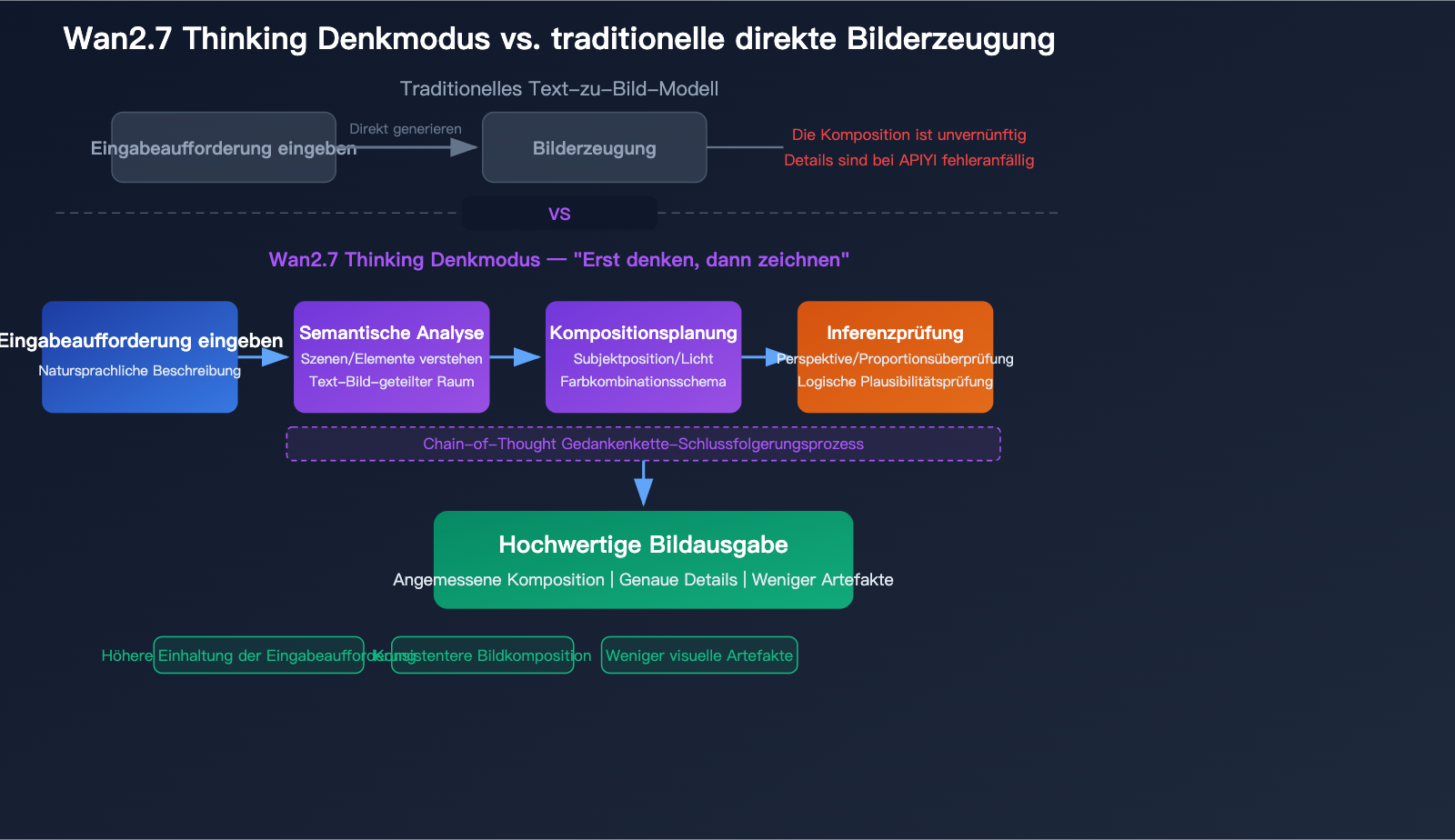

Wan2.7 Thinking-Modus

Die einzigartigste Innovation von Wan2.7 ist der integrierte Chain-of-Thought-Modus (Denkprozess). Bei herkömmlichen Text-zu-Bild-Modellen generiert das Modell das Bild direkt aus der Eingabeaufforderung, was oft zu unlogischen Kompositionen, fehlenden Elementen oder Detailfehlern führt. Der Thinking-Modus von Wan2.7 lässt das Modell vor der Bilderzeugung "nachdenken":

- Analyse der Eingabeaufforderung: Verständnis der gewünschten Szene, Elemente und des Stils.

- Planung der Komposition: Festlegung der Position des Hauptmotivs, der Lichtrichtung und der Farbgestaltung.

- Logische Prüfung: Überprüfung der Kompositionslogik (z. B. Perspektive, Objektproportionen).

- Bilderzeugung: Erstellung des finalen Bildes basierend auf den Schlussfolgerungen.

Dieser "Erst denken, dann zeichnen"-Mechanismus sorgt für eine bessere Einhaltung der Eingabeaufforderung, eine kohärentere Komposition und weniger visuelle Artefakte.

Wan2.7-Image-Pro: Text-Rendering in 12 Sprachen

Die Fähigkeit von Wan2.7, Text in KI-generierten Bildern präzise darzustellen, ist ein entscheidendes Alleinstellungsmerkmal:

| Text-Fähigkeit | Beschreibung |

|---|---|

| Sprachunterstützung | 12 Sprachen, darunter Chinesisch, Englisch usw. |

| Token-Limit | Texteingabe von bis zu 3.000 Token |

| Akademisches Rendering | Akademische Texte in Druckqualität, komplexe Formeln |

| Tabellengenerierung | Direkte Darstellung strukturierter Tabellen im Bild |

| Schriftartenkontrolle | Auswahl verschiedener Schriftstile |

Dies bedeutet, dass Wan2.7 Bilder mit präzisen Texten erstellen kann – akademische Poster, Produktetiketten, technische Architekturdiagramme, Datentabellen und sogar mathematische Formeln können klar und präzise dargestellt werden.

🎯 Anwendungsempfehlung: Wenn Sie Bilder mit chinesischem oder mehrsprachigem Text benötigen (z. B. Produktposter, technische Diagramme), ist Wan2.7-Image-Pro eine der derzeit besten Optionen für klares Text-Rendering. APIYI apiyi.com bindet Wan2.7-Image-Pro derzeit ein; nach Abschluss der Integration kann es direkt über eine einheitliche API aufgerufen werden.

Präzise Steuerungsmöglichkeiten von Wan2.7-Image-Pro

Präzise Farbabstimmung in Wan2.7

Wan2.7 führt die Funktion Farbpalette (Color Palette) ein, mit der Kreative präzise Farbcodes und Verhältnisse direkt in die Eingabeaufforderung eingeben können:

- Eingabe präziser HEX-Farbcodes (z. B.

#FF6B35) - Festlegung des Farbanteils im Bild

- Fixierung von Markenfarben zur Gewährleistung visueller Konsistenz

- Kopieren komplexer Farbschemata für künstlerische Stile

Dies ist eine äußerst praktische Funktion für Brand-Designer, Werbekreative und UI-Designer – das mühsame Anpassen der Eingabeaufforderung, um "auf gut Glück" die richtige Farbe zu treffen, gehört damit der Vergangenheit an.

Konsistenz durch mehrere Referenzbilder in Wan2.7

| Referenzbild-Funktion | Beschreibung | Anwendungsbereich |

|---|---|---|

| Bis zu 9 Referenzbilder | Upload von Stil/Subjekt/Hintergrund | Serien mit Charakterkonsistenz |

| Feinsteuerung von Personen | Skelettstruktur, Anpassung der Augenform | Anpassung virtueller Charaktere |

| Pixelgenaue Bearbeitung | Präzise Änderung durch Auswahlbereiche | Nahtloses Hinzufügen/Verschieben von Elementen |

| Konsistente Stapelgenerierung | 12 konsistente Bilder in einem Durchgang | Produktserien, Comic-Storyboards |

Die Unterstützung von 9 Referenzbildern ist branchenführend. Durch die Bereitstellung mehrerer Referenzbilder können Sie das Aussehen von Charakteren, den Szenenstil und die Hintergrundatmosphäre gleichzeitig steuern, sodass die KI-generierten Bilder visuell hochgradig einheitlich sind.

Vergleich: Wan2.7-Image-Pro vs. Vorgängerversionen

| Vergleichsdimension | Wan 2.6 | Wan 2.7 | Wan 2.7 Pro |

|---|---|---|---|

| Max. Auflösung | 2K | 2K | 4K (4096×4096) |

| Denkmodus | Nein | Ja | Ja |

| Text-Rendering | Basis | 12 Sprachen / 3000 Token | 12 Sprachen / 3000 Token |

| Anzahl Referenzbilder | Begrenzt | Bis zu 9 | Bis zu 9 |

| Farbsteuerung | Eingabeaufforderung | Präzise Farbcodes | Präzise Farbcodes |

| Stapelgenerierung | Begrenzt | Bis zu 12 | Bis zu 12 |

💡 Empfehlung: Wenn Sie 4K-Qualität für den Druck benötigen, wählen Sie Wan2.7-Image-Pro. Für tägliche Designaufgaben und schnelle Prototypen reicht die Standardversion Wan2.7-Image aus. APIYI apiyi.com bindet die gesamte Wan2.7-Modellreihe an, sodass Sie flexibel über denselben API-Schlüssel zwischen den Modellen wechseln können.

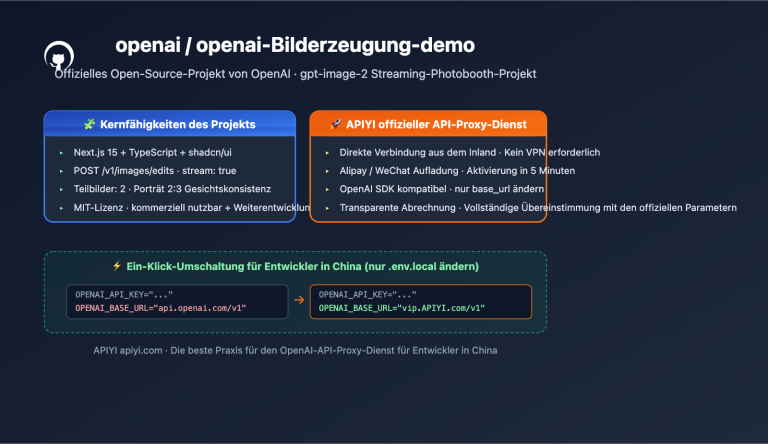

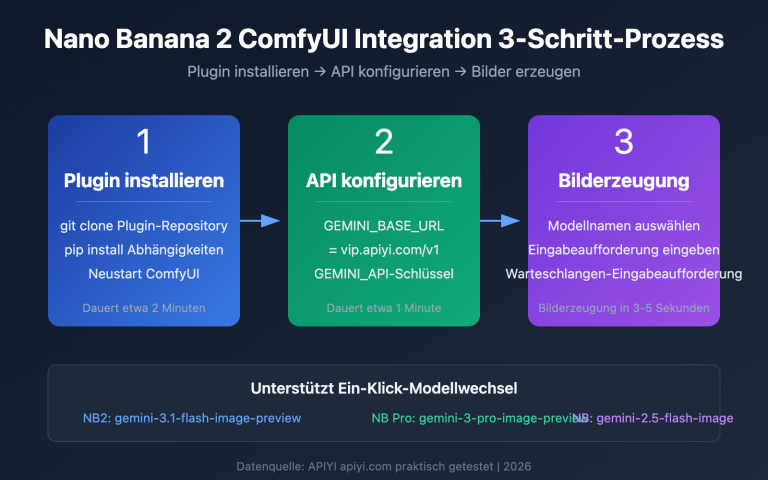

Wan2.7-Image-Pro API-Integrationsleitfaden

Beispiel für den Wan2.7 API-Aufruf

Sie können Wan2.7-Image-Pro ganz einfach über die OpenAI-kompatible Schnittstelle aufrufen:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Aufruf für Text-zu-Bild

response = client.images.generate(

model="wan2.7-image-pro",

prompt="Eine orangefarbene Katze sitzt auf einer sonnendurchfluteten Fensterbank, daneben eine Tasse Kaffee, 4K-Ultra-HD-Qualität",

size="2048x2048",

n=1

)

print(response.data[0].url)

Beispiel für die Bearbeitung mit mehreren Referenzbildern anzeigen

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Bildbearbeitung - Konsistenz bei mehreren Referenzbildern

response = client.images.edit(

model="wan2.7-image-edit-pro",

image=open("original.png", "rb"),

prompt="Behalte die Charakterkonsistenz bei, ändere den Hintergrund in eine Cyberpunk-Stadt bei Nacht",

n=1,

size="2048x2048"

)

print(response.data[0].url)

🚀 Integrationshinweis: APIYI (apiyi.com) integriert derzeit das Modell Wan2.7-Image-Pro. Nach Abschluss der Integration können Sie die gesamte Wan2.7-Modellreihe über die einheitliche Schnittstelle von APIYI aufrufen und gleichzeitig zu anderen Modellen für die Bilderzeugung wie DALL-E, Midjourney oder Jimeng wechseln, um die Ergebnisse zu vergleichen. Besuchen Sie die offizielle Website von APIYI, um den aktuellen Fortschritt zu verfolgen.

Anwendungsbereiche für Wan2.7-Image-Pro

Typische Einsatzszenarien für Wan2.7-Image-Pro

| Szenario | Empfohlenes Modell | Kernkompetenz |

|---|---|---|

| Markendesign | Image-Pro | 4K-Qualität + präzise Farbsteuerung |

| Wissenschaftliche Poster | Image-Pro | Text-Rendering in 12 Sprachen + Formeln |

| Charakterdesign | Image-Pro + Edit | 9 Referenzbilder + Skelett-Feinabstimmung |

| E-Commerce-Produktbilder | Image Standard | Batch-Generierung von 12 konsistenten Bildern |

| UI-Prototyping | Image Standard | Schnelle Iteration + Farbkontrolle |

| Comic-Storyboards | Image + Edit | Charakterkonsistenz + Szenenwechsel |

Die Rolle von Wan2.7-Image-Pro im KI-Workflow

Ein vollständiger Workflow für die KI-Inhaltserstellung könnte wie folgt aussehen:

- Erstellung von Texten und Konzepten mit Claude / GPT-5.4 (via APIYI apiyi.com)

- Generierung der passenden 4K-HD-Bilder mit Wan2.7-Image-Pro

- Erstellung der zugehörigen Videos mit Jimeng CLI oder Seedance 2.0

- Zentrale Veröffentlichung auf Content-Plattformen

Dieses kollaborative Modell aus "Text-KI + Bild-KI + Video-KI" entwickelt sich zum Standardparadigma für die Erstellung von Inhalten.

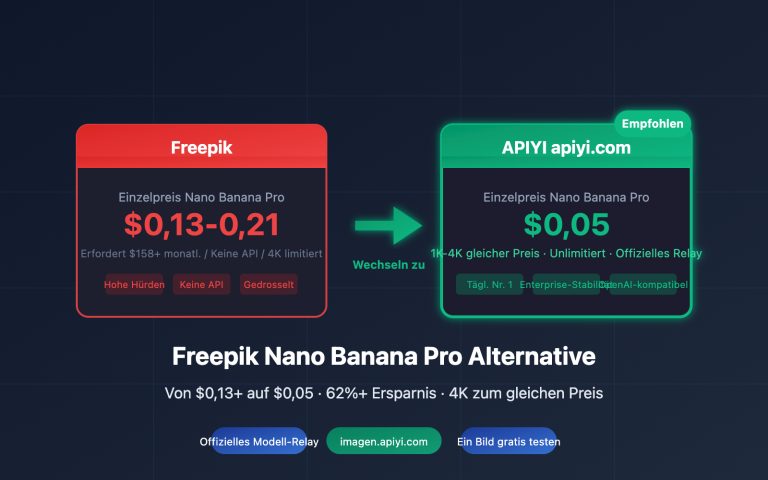

Wan2.7-Image-Pro im Vergleich mit Wettbewerbern

Wan2.7-Image-Pro Vergleichstabelle

| Vergleichsdimension | Wan2.7-Pro | Midjourney v7 | DALL-E 3 | Seedream 5.0 |

|---|---|---|---|---|

| Maximale Auflösung | 4K | 2K | 1024×1024 | 4K |

| Denkmodus | Integriert | Nein | Nein | Nein |

| Text-Rendering | 12 Sprachen / 3000 Token | Begrenzt | Mittel | Gut |

| Anzahl Referenzbilder | Bis zu 9 | Bis zu 4 | Nicht unterstützt | Bis zu 12 |

| Präzise Farbkontrolle | Genaue Farbcodes | Stilbeschreibung | Stilbeschreibung | Gut |

| Stapelgenerierung | Bis zu 12 | 4 | 1 | Mehrere |

| Chinesisches Verständnis | Nativ optimiert | Begrenzt | Begrenzt | Nativ optimiert |

| API verfügbar | Ja | Inoffiziell | Ja | Ja |

Die zentralen Alleinstellungsmerkmale von Wan2.7-Image-Pro sind:

Einzigartiger Denkmodus: Unter den gängigen Modellen zur Bilderzeugung ist Wan2.7 das erste mit integrierter Chain-of-Thought-Logik. Der "Erst denken, dann zeichnen"-Mechanismus verbessert die Kompositionslogik und Detailgenauigkeit erheblich.

Führendes Text-Rendering: Mit der Fähigkeit, Texte in 12 Sprachen und bis zu 3000 Token zu verarbeiten – inklusive wissenschaftlicher Formeln und strukturierter Tabellen – übertrifft es Wettbewerber bei weitem.

Optimierung für chinesische Semantik: Als von Alibaba entwickeltes Modell bietet Wan2.7 ein natürlich besseres Verständnis für chinesische Eingabeaufforderungen als ausländische Konkurrenzprodukte.

🎯 Auswahlhilfe: Jedes Modell zur Bilderzeugung hat seine Stärken. Unsere Empfehlung: Wählen Sie Wan2.7-Pro für 4K-Bilder mit chinesischem Kontext, Midjourney für kreative Kunststile und DALL-E 3 für allgemeine Szenarien. Über die Plattform APIYI (apiyi.com) können Sie mit einem einzigen Schlüssel verschiedene Bildmodelle direkt vergleichen.

Häufig gestellte Fragen (FAQ)

Q1: Was ist der Unterschied zwischen Wan2.7-Image-Pro und der Standardversion?

Der Hauptunterschied liegt in der maximalen Auflösung. Die Pro-Version unterstützt 4K-Ausgabe (4096×4096), während die Standardversion 2K (2048×2048) bietet. Beide unterstützen den Thinking-Modus, das Text-Rendering in 12 Sprachen und die Nutzung von 9 Referenzbildern. Die Pro-Version eignet sich besser für Szenarien, die Druckqualität erfordern. APIYI (apiyi.com) wird beide Versionen integrieren, sodass Sie je nach Bedarf wählen können.

Q2: Wann kann ich Wan2.7-Image-Pro auf APIYI nutzen?

APIYI (apiyi.com) arbeitet aktiv an der Integration von Wan2.7-Image-Pro. Sobald die Anbindung abgeschlossen ist, können Sie das Modell über die einheitliche OpenAI-kompatible Schnittstelle ohne zusätzliche Konfiguration aufrufen. Wir empfehlen Ihnen, die APIYI-Website oder das Dokumentationszentrum unter docs.apiyi.com im Auge zu behalten, um über den aktuellen Fortschritt informiert zu bleiben.

Q3: Beeinflusst der Thinking-Modus von Wan2.7 die Generierungsgeschwindigkeit?

Der Thinking-Modus erhöht die Inferenzzeit geringfügig, da das Modell erst "nachdenkt", bevor es mit der Generierung beginnt. Da der Prozess jedoch wiederholte Korrekturschleifen vermeidet, ist die effektive Produktivität oft höher: Sie erhalten meist schon beim ersten Versuch ein zufriedenstellendes Ergebnis und sparen Zeit bei der Anpassung der Eingabeaufforderung.

Zusammenfassung

Die Kernpunkte von Wan2.7-Image-Pro:

- Neuer Maßstab für 4K-Bildqualität: Die Pro-Version unterstützt eine Auflösung von 4096×4096, was eine Qualität auf Druckniveau ermöglicht.

- Pionierarbeit bei Denkmodellen: Integriertes Chain-of-Thought-Reasoning („erst denken, dann zeichnen“) verbessert die Kompositionslogik und die Genauigkeit von Details.

- Führend bei der Textdarstellung: Unterstützung für 12 Sprachen / 3000 Token sowie eine präzise Wiedergabe von wissenschaftlichen Formeln und Tabellen.

Die Veröffentlichung von Wan2.7-Image-Pro setzt neue Standards im Bereich der KI-Bilderzeugung. APIYI (apiyi.com) integriert dieses Modell derzeit. Nach Abschluss der Anbindung können Entwickler die gesamte Wan2.7-Serie über eine einheitliche Schnittstelle aufrufen. Gleichzeitig ist es möglich, für direkte Ergebnisvergleiche zu anderen Bildmodellen wie DALL-E, Midjourney oder Jimeng zu wechseln, was die Modellauswahl und Integration erheblich beschleunigt.

📚 Referenzen

-

Offizielle Veröffentlichung von Alibaba – Einführung in Wan2.7: Details zu Modellfähigkeiten und technischer Architektur.

- Link:

alibabacloud.com/blog/alibaba-unveils-wan2-7-redefining-personalized-and-precision-image-creation_602995 - Hinweis: Enthält eine vollständige Funktionsübersicht, Personalisierungsoptionen und das Farbsteuerungssystem.

- Link:

-

Offizielle Wan AI-Kreativplattform: Online-Erlebnis aller Wan2.7-Funktionen.

- Link:

create.wan.video/explore/image/generate - Hinweis: Bietet volle Online-Funktionalität für Text-zu-Bild, Bildbearbeitung und mehr.

- Link:

-

Alibaba Cloud Model Studio – Wan2.7 API-Dokumentation: Referenz für die API-Anbindung für Entwickler.

- Link:

alibabacloud.com/help/en/model-studio/wan-image-generation-api-reference - Hinweis: Enthält API-Endpunkte, Parameterbeschreibungen und Aufrufbeispiele.

- Link:

-

WaveSpeed AI – Wan 2.7 Modellkollektion: Anbindung und Nutzung über Drittanbieterplattformen.

- Link:

wavespeed.ai/collections/wan-2.7 - Hinweis: Bietet API-Zugriff und Preisinformationen für die gesamte Wan2.7-Modellreihe.

- Link:

Autor: APIYI Technik-Team

Technischer Austausch: Diskutieren Sie gerne in den Kommentaren über Ihre Erfahrungen mit Wan2.7-Image-Pro. Weitere Informationen zur Anbindung von KI-Modellen finden Sie im APIYI-Dokumentationszentrum unter docs.apiyi.com.