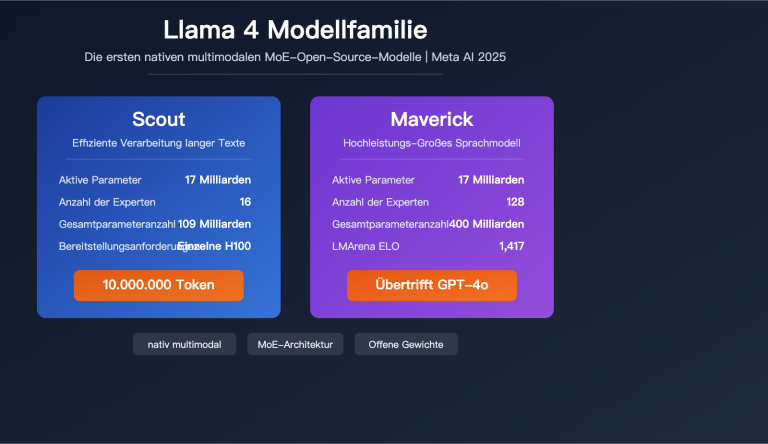

Interpretation von Llama 4 Scout und Maverick: Die ersten nativen multimodalen MoE-Open-Source-Modelle bringen 3 große Durchbrüche

Anmerkung des Autors: Meta veröffentlicht Llama 4 Scout und Maverick, basierend auf einer nativen, multimodalen MoE-Architektur. Scout bietet ein Kontextfenster von 10 Millionen Token, während Maverick in umfassenden Benchmarks GPT-4o übertrifft. Dieser Artikel bietet eine tiefgehende Analyse der technischen Details und der Auswirkungen auf Entwickler. Meta hat offiziell die Llama 4 Modellfamilie veröffentlicht. Die ersten…