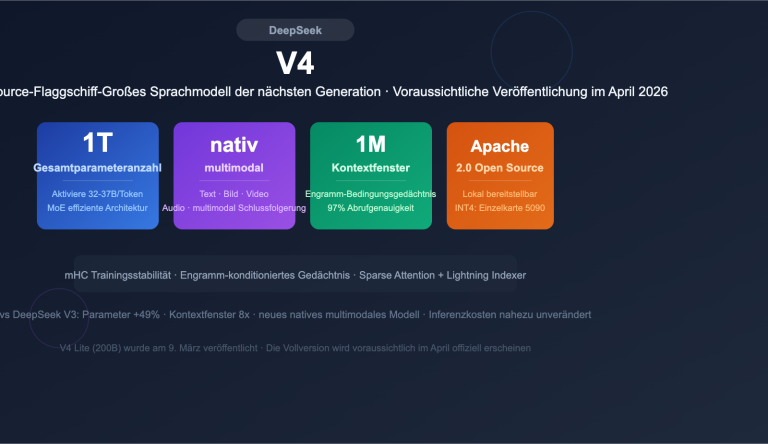

Vorschau auf die Veröffentlichung von DeepSeek V4: Umfassende Analyse der 1T-Parameter-MoE-Architektur und der 4 Kern-Upgrades

DeepSeek V4 steht kurz vor der Veröffentlichung und setzt auf eine MoE-Architektur mit etwa 1 Billion (1T) Parametern, unterstützt native multimodale Eingaben und ein extrem langes Kontextfenster von 1 Million Tokens. Nach mehreren Verzögerungen wird das mit Spannung erwartete Open-Source-Großes Sprachmodell voraussichtlich im April 2026 erscheinen und sich mit der GPT-5.x-, Claude 4- und Gemini…