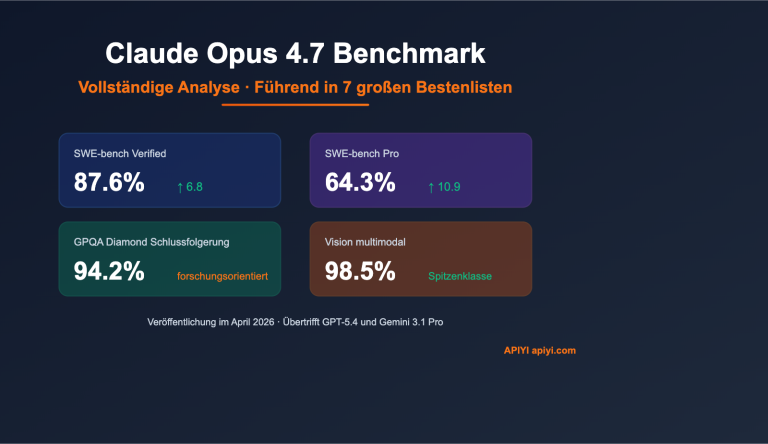

Claude Opus 4.7 Benchmark-Analyse: Empirische Daten zur Führung gegenüber GPT-5.4 in 7 großen Bestenlisten

title: "Claude Opus 4.7 Benchmark-Analyse: Ein neuer Maßstab für KI-Modelle" Anmerkung des Autors: Tiefenanalyse der Claude Opus 4.7 Benchmarks: SWE-bench Verified 87,6 %, SWE-bench Pro 64,3 %, GPQA Diamond 94,2 %. Das Modell übertrifft GPT-5.4 und Gemini 3.1 Pro deutlich. Inklusive Praxisanleitung für API-Aufrufe. Anthropic hat am 16. April 2026 offiziell Claude Opus 4.7 veröffentlicht,…