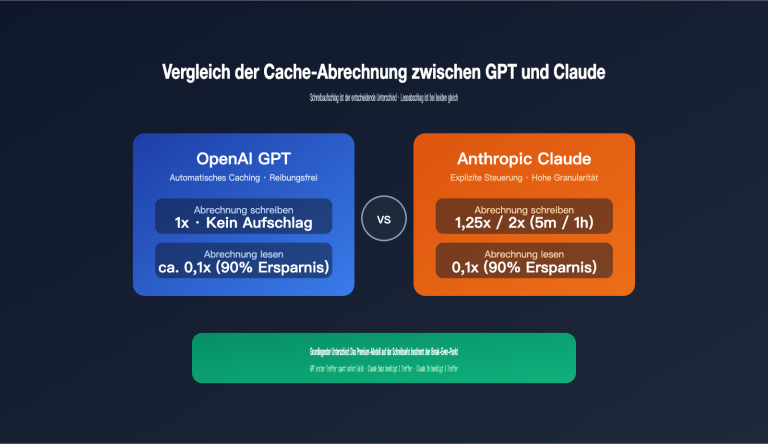

Vollständiger Vergleich der Abrechnung von Eingabeaufforderungs-Caching bei GPT und Claude: 5 Kernunterschiede und die tatsächlichen Kostenauswirkungen des 1,25-fachen Schreibaufschlags

Die Eingabeaufforderung-Zwischenspeicherung (Prompt Caching) ist im Jahr 2026 zu einem entscheidenden Kostenfaktor für alle Nutzer von Großes Sprachmodell-APIs geworden. Bei einer RAG-Anwendung, die beispielsweise eine 8K-System-Eingabeaufforderung verwendet, kann der Unterschied zwischen aktivierter und deaktivierter Zwischenspeicherung die monatliche Rechnung um mehr als das Zehnfache variieren. Viele Entwickler, die zwischen OpenAI und Anthropic wechseln, stolpern jedoch über…