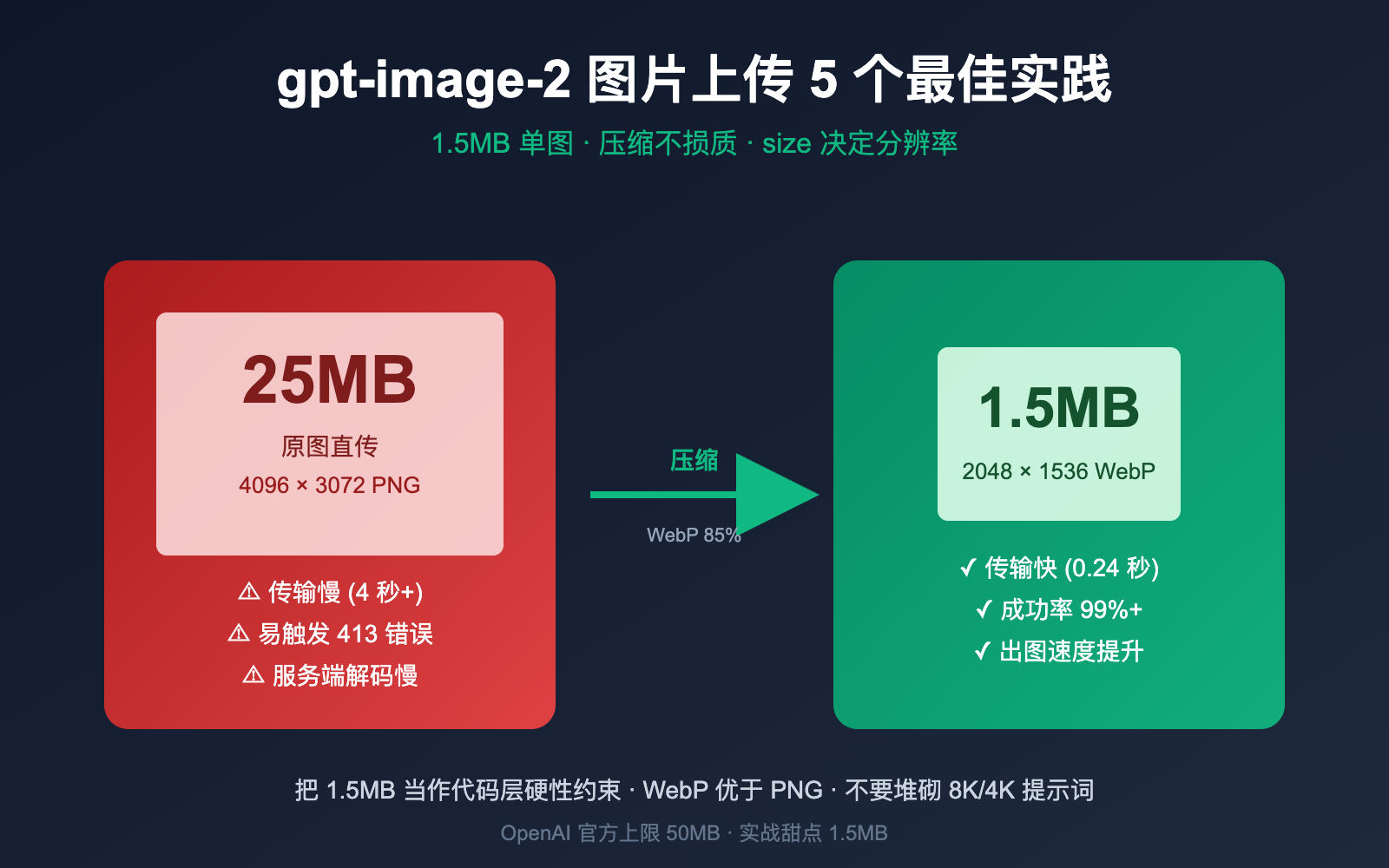

很多开发者第一次接入 gpt-image-2 图片编辑接口时, 都会下意识把原图直接 POST 上去——毕竟官方文档明确写着单图上限是 50MB, 不到上限不是没用上吗? 但只要你跑过几十次实测就会发现, 上传 20MB 的原图和 1.5MB 的压缩图相比, 出图速度可能差 3 倍以上, 失败率 (尤其是 413 Request Entity Too Large) 也成倍上涨。

本文基于大量实战经验, 给出 5 个 gpt-image-2 图片上传 最佳实践, 重点回答两个一线开发者最容易踩坑的问题: 图片到底压缩到多大合适, 以及 输出分辨率究竟由什么决定。

🎯 核心结论先行: gpt-image-2 单图上传建议控制在 1.5MB 以内; 输出分辨率由

size参数决定, 提示词里写"8K""4K"完全没用。本文所有代码都可以通过 API易 apiyi.com 中转直接运行, 不需要海外网络环境。

gpt-image-2 图片上传规格: 官方上限 vs 实战上限

OpenAI 官方文档对 gpt-image-2 的图片输入规格非常宽松, 从字面看似乎没有什么需要担心的限制。但"能用"和"用得好"完全是两回事, 实战中必须给自己定一条更严格的红线。

下面这张表对比了官方上限与本文推荐的实战值, 后者来自国内开发者大量调用统计的经验总结:

| 维度 | 官方上限 | 实战推荐 | 差异原因 |

|---|---|---|---|

| 单图大小 | 50MB | ≤ 1.5MB | 大图传输+服务端解码总耗时显著增加 |

| 单次图片数 | 16 张 | 1-4 张 | 多图叠加会拉低单次成功率 |

| 支持格式 | PNG / WEBP / JPG | WEBP / JPG (压缩态) | PNG 通常体积过大, WEBP 性价比最高 |

| 单边像素 | 最大 3840 | 不超过 2048 | 内部仍会做特征提取下采样 |

| 长宽比 | 1:3 ~ 3:1 | 接近输出比例 | 比例失配会触发额外的填充/裁剪 |

为什么把上限定在 1.5MB? 这是一个在传输耗时、解码耗时、网络稳定性之间取得平衡的甜点值。低于 1.5MB 时, 大多数家用宽带 1-2 秒内就能传完; 超过 5MB 后传输和服务端解码总耗时会非线性增长, 你能明显感觉到接口在"挂着"。

💡 实测经验: 我们建议把 1.5MB 作为代码层的硬性约束, 在调用前用 PIL 等库做一次自动压缩。通过 API易 apiyi.com 调用 gpt-image-2 时, 国内 IDC 节点对小文件的传输优化效果尤为明显。

为什么单图建议压缩到 1.5MB 以内

很多开发者会问: 既然官方支持到 50MB, 为什么要苛求 1.5MB? 这背后其实有四个工程层面的原因, 任何一个都足以让你认真对待图片体积这件事。

第一个原因是 传输延迟, 这也是最容易被低估的环节。25MB 的图在 50Mbps 上行带宽下需要约 4 秒纯传输时间, 而压缩到 1.5MB 后只需要 0.24 秒, 这部分时间是直接累加到 API 总响应时间里的。

第二个原因是 413 错误风险。社区里关于 gpt-image-1 / gpt-image-2 的 413 Request Entity Too Large 报错并不少见, 即便没到 50MB 上限, 也可能在某一层网关 (CDN、反向代理、负载均衡) 被截断。把图压到 1.5MB 以下基本可以彻底避开这类错误, 提升调用稳定性。

第三个原因是 服务端解码耗时。OpenAI 服务端拿到图片后需要解码、特征提取、嵌入向量化, 这些步骤的耗时和图片像素总量正相关。哪怕带宽不是瓶颈, 大图也会拖慢出图速度。

第四个原因是 重试成本。一旦大图调用失败, 整个 25MB 都要重传一次; 而 1.5MB 的图重试一次几乎无感, 整体的端到端可靠性大不一样。

把这四个原因量化到一组真实测试数据上, 对比会更直观: 同一张原图分别以 25MB / 5MB / 1.5MB / 500KB 四个体积上传 gpt-image-2 编辑接口, 在相同提示词和 size 参数下重复 50 次, 端到端总耗时和成功率呈现非常明显的拐点。1.5MB 大概是这条曲线的最优点, 再往下压缩对总体验的提升已经趋近边际, 没必要为追求极致小体积而牺牲过多画质。

🔧 优化建议: 在生产环境调用 gpt-image-2 时, 强烈建议把"上传前压缩"作为代码的标准步骤而非可选项。通过 apiyi.com 中转节点跑批量任务, 配合 1.5MB 压缩策略, 单批次失败率可以从 5-8% 降到 1% 以内, 这个差距在月调用量上万次时会非常显著。

压缩不等于损失画质: 一个被严重高估的误区

这是国内开发者群体里流传最广的一个误区: "压缩 = 损失画质 = 影响 AI 出图效果"。这个判断在 2010 年的 JPEG 时代或许成立, 但放到 2026 年的 WebP 和高质量 JPEG 时代, 它已经严重过时了。

下面这张表把常见的压缩误区与事实并列对比, 帮助你建立正确的图片处理直觉:

| 常见误区 | 事实 |

|---|---|

| 压缩一定损失画质 | WebP 质量 85+ 在视觉上几乎不可分辨, JPEG 90+ 同理 |

| 越大的图 AI 看得越清 | gpt-image-2 内部对超大图会下采样, 大于模型工作分辨率的部分纯属浪费 |

| PNG 无损所以最适合 | PNG 体积通常是 WebP 的 3-5 倍, 但模型解码后效果几乎一致 |

| 压缩工具会偷偷改色 | 主流工具 (Squoosh / TinyPNG / Sharp) 都保留色彩 ICC 配置 |

| 提示词够强就不用压缩 | 提示词和图片体积是两个独立维度, 压缩只影响传输不影响理解 |

具体到工具选型, 你可以根据使用场景挑一个适合的方案:

| 工具 | 适用场景 | 优势 |

|---|---|---|

| PIL / Pillow | Python 后端批量处理 | 代码集成简单, 可循环调整质量直到达标 |

| Sharp (Node.js) | Node 服务端 | 性能最好, 单核每秒处理几十张 |

| Squoosh | 前端单图压缩 | 浏览器 WASM, 不上传服务器即可压缩 |

| TinyPNG | 设计师手动批量 | 智能减少调色板, 视觉无损 |

| 系统截图工具 | macOS / Windows | 直接选 JPEG 80% 即可满足 |

把"压缩"理解成"必要的预处理步骤", 而不是"会损害效果的妥协", 是用好图像 API 的心理基础。

特别要澄清一点: gpt-image-2 内部对超大图会做下采样处理, 它实际工作的"内部分辨率"远小于你能上传的最大值。这意味着把一张 4000×3000 像素的原图喂给它, 它实际看到的可能只是 1024×1024 的下采样版本, 你多上传的那些像素从一开始就被模型扔掉了, 完全是徒劳的带宽开销。

理解这一点之后, "压缩前后效果几乎一致"就不再是直觉判断, 而是有明确技术依据的结论。把图压缩到 1024-2048 这个区间正好命中模型的工作分辨率, 既不浪费也不亏待。

gpt-image-2 输出分辨率: size 参数才是唯一开关

如果说"压缩不损质"是上传端的误区, 那"提示词写 8K 能出 8K"就是输出端最大的误区。这一节我们彻底讲清楚 gpt-image-2 的输出分辨率到底是怎么决定的。

唯一影响输出分辨率的参数是 size, 其他什么都不行。这是一个非常关键但被普遍误解的规则, 我用一组对照实验帮你建立直觉:

| API 调用配置 | 实际输出分辨率 |

|---|---|

size="1024x1024" + 提示词无 4K/8K 字眼 |

1024×1024 |

size="1024x1024" + 提示词写"8K resolution" |

依然 1024×1024 |

size="1024x1024" + 提示词写"ultra HD 4K" |

依然 1024×1024 |

size="1536x1024" + 提示词写"low resolution" |

1536×1024 (size 优先) |

size="3840x2160" + 任意提示词 |

3840×2160 (实验性) |

结论非常明确: 提示词里堆砌"8K""4K""ultra HD""HQ"这类分辨率关键词, 不会让你的输出图变得更大或更清晰, 反而浪费 token 占用提示词预算。

那么 size 参数到底支持哪些值? gpt-image-2 比上一代灵活很多, 既支持预设也支持自定义:

| 配置方式 | 取值范围 | 说明 |

|---|---|---|

| 标准预设 | 1024×1024 / 1536×1024 / 1024×1536 | 最稳定, 推荐日常使用 |

| 自定义 (常规) | 宽高均 16 整数倍 | 例如 1280×720, 1600×900 |

| 自定义 (大图) | 单边最大 3840px | 超过 2560×1440 属实验性 |

| 长宽比约束 | 1:3 ~ 3:1 之间 | 太极端的比例不支持 |

| 总像素约束 | 655,360 ~ 8,294,400 | 上下都有边界 |

把"分辨率描述词"留给提示词里更有价值的内容, 比如风格 ("oil painting style")、构图 ("low angle shot")、光影 ("golden hour lighting")、材质 ("matte ceramic surface"), 这些才是真正能影响出图效果的提示词。

这里还有一个反直觉但非常重要的细节: size 参数选大不一定出图更精细。当你选 3840×2160 这种实验性高分辨率时, 模型其实是在内部低分辨率生成后做超分采样, 细节密度并不会真的随像素数量线性提升, 反而可能因为生成时间拉长而出现一致性下降。日常工作流推荐的甜点档位是 1024×1024 或 1536×1024, 速度快、细节足、API 价格也最友好。

📌 提示词清洗建议: 在调用 gpt-image-2 前, 把提示词里所有"8K"、"4K"、"ultra HD"、"high resolution"等无效关键词都删掉, 给真正有用的描述腾出空间。我们建议在 apiyi.com 平台上对比同一组提示词在不同 size 参数下的效果, 帮助你建立分辨率与画面密度之间的直觉。

gpt-image-2 实战调用: Python 压缩与上传完整代码

理论讲完, 直接上能跑的代码。下面这段 Python 实现了"自动压缩到 1.5MB 以内 → 调用 gpt-image-2 编辑接口 → 保存输出"的完整流程, 你可以复制粘贴到自己项目里使用。

import io

import base64

from PIL import Image

from openai import OpenAI

# 通过 API易 中转调用, 无需海外网络

client = OpenAI(

base_url="https://vip.apiyi.com/v1",

api_key="你的 API易 Key"

)

def compress_image(input_path: str, target_kb: int = 1500) -> bytes:

"""自动压缩图片到指定 KB 以内, 优先使用 WebP 格式"""

img = Image.open(input_path).convert("RGB")

# 限制最大边到 2048, 超过部分等比缩放

if max(img.size) > 2048:

img.thumbnail((2048, 2048), Image.LANCZOS)

# 从质量 90 开始, 每次降 5 直到达标

quality = 90

while quality >= 50:

buf = io.BytesIO()

img.save(buf, format="WEBP", quality=quality)

if len(buf.getvalue()) <= target_kb * 1024:

return buf.getvalue()

quality -= 5

# 兜底: 最低质量

buf = io.BytesIO()

img.save(buf, format="WEBP", quality=50)

return buf.getvalue()

# 调用 gpt-image-2 编辑接口

image_bytes = compress_image("./input.png", target_kb=1500)

result = client.images.edit(

model="gpt-image-2",

image=("input.webp", image_bytes, "image/webp"),

prompt="把这张照片改成赛博朋克风格, 霓虹灯光, 雨夜街景",

size="1536x1024", # 输出分辨率由这里决定

output_format="webp", # 输出格式

output_compression=85 # 输出压缩等级 0-100

)

# 保存输出

output_b64 = result.data[0].b64_json

with open("./output.webp", "wb") as f:

f.write(base64.b64decode(output_b64))

这段代码有几个关键点值得展开说明。第一是 compress_image 函数采用了"循环降质量"的策略, 从 90 开始每次降 5, 直到文件大小达标, 这样能在保证画质的前提下最大化利用压缩空间。

第二是输出端的 output_compression=85, 这个参数仅对 WebP / JPEG 输出格式生效, 用于控制返回图片本身的压缩等级, 默认 100 (无压缩)。如果你需要把生成图直接展示在网页上, 设置为 80-90 可以在画质和加载速度之间取得很好的平衡。

第三是 size="1536x1024" 这一行真正决定了输出分辨率, 不论提示词怎么写, 输出图都会是 1536×1024。

🚀 接入提示: gpt-image-2 兼容 OpenAI 原生 SDK, 上面代码只需改

base_url和api_key就能跑在 API易 apiyi.com 平台上。该平台对图像类接口做了专门的网络优化, 大幅减少超时和 413 错误的发生概率。

gpt-image-2 图片上传 FAQ

Q1: 上传 PNG 和 WebP 哪个更好?

WebP 在同等画质下体积是 PNG 的 1/3 到 1/5, 而 gpt-image-2 内部解码后效果几乎一致, 所以优先用 WebP。除非你的图有透明通道且 alpha 非常重要 (例如 logo 抠图), 否则没有理由用 PNG。

Q2: 多张参考图能一次传几张?

官方上限 16 张, 但实战中超过 4 张后单次成功率就会明显下降, 模型对参考图的关注度也会被稀释。建议主参考图 1 张 + 风格参考图 1-2 张就够了, 多张反而会让输出风格混乱。

Q3: 我提示词里写了"8K"反而不需要压缩?

提示词里的"8K"是无效关键词, 它既不能让输出变成 8K (那是 size 决定的), 也不能让 gpt-image-2 跳过压缩处理。我们建议通过 apiyi.com 控制台对比同一张图压缩前后的实际出图效果, 你会发现视觉上几乎无法区分。

Q4: 模型支持的最大输出分辨率是多少?

size 最大支持到 3840×2160, 但超过 2560×1440 的部分被官方标注为"实验性", 稳定性和一致性会下降。日常生产环境建议止步于 1536×1024 这一档, 既快又稳。

Q5: 上传后还能调整图片的细节区域吗?

可以, 通过 mask 参数可以指定一张同尺寸的蒙版图, 模型只会在蒙版透明区域生成新内容, 其他部分保留原样。这是 gpt-image-2 编辑接口非常强大的能力, 适合做局部重绘和换装。

Q6: 国内调用 gpt-image-2 失败率高怎么办?

直连 OpenAI 在国内确实容易遇到连接超时或 SSL 握手失败, 尤其是图片类接口因为 payload 较大, 比文本接口更容易中断。把 base_url 切到 apiyi.com 这类国内 IDC 部署的中转网关, 配合 1.5MB 压缩策略, 整体成功率可以稳定在 99% 以上。

Q7: 压缩后画质真的看不出区别吗, 有没有压缩过头的情况?

WebP 质量 85 以上、JPEG 质量 90 以上, 在自然图像 (人物、风景、产品) 上视觉无差; 但在文字密集 (海报、PPT 截图) 或锐利线条 (技术图、像素艺术) 场景, 建议把质量提到 92-95 或者直接保留 PNG, 否则可能在文字边缘出现轻微的振铃伪影。文章给出的 Python 压缩函数已经把上限设在 90 起点, 大多数场景都能稳定通过。

Q8: gpt-image-2 和 gpt-image-1.5 在上传策略上有什么区别?

整体策略是一致的, 单图 1.5MB / 优先 WebP / size 决定输出 这套规则两个模型都适用。差异主要在 gpt-image-2 支持自定义分辨率 (16 整数倍约束) 和实验性高分辨率, gpt-image-1.5 则只支持几个固定预设。如果你正在做迁移, 可以放心地把同一套压缩代码复用过来。

总结

回到文章开头的两个核心问题, 答案现在应该非常清晰了。

第一个问题: gpt-image-2 图片上传多大合适? 官方说 50MB, 但实战中请把硬性上限设在 1.5MB 以内, 这是综合传输延迟、413 风险、解码耗时和重试成本之后的最优甜点。压缩本身在现代算法下几乎不损失画质, 大可不必偏执地坚持上传原图。

第二个问题: 输出分辨率由什么决定? 唯一答案是 size 参数, 不是提示词。请把"8K""4K""ultra HD"这类分辨率描述词从你的提示词模板里彻底删除, 把宝贵的 token 预算留给真正有用的风格、构图、光影描述。

把这两条规则刻进肌肉记忆, 你的 gpt-image-2 调用速度和成功率都会有质的提升。我们建议直接用本文给出的 Python 压缩代码起步, 通过 apiyi.com 接入接口快速验证, 用一两天时间跑出自己的最佳参数组合。

📌 作者: APIYI Team — 长期关注 OpenAI / Anthropic / Google 多模态 API 的工程实践, 更多 gpt-image-2 高阶用法和 Prompt 模板见 apiyi.com 文档中心。