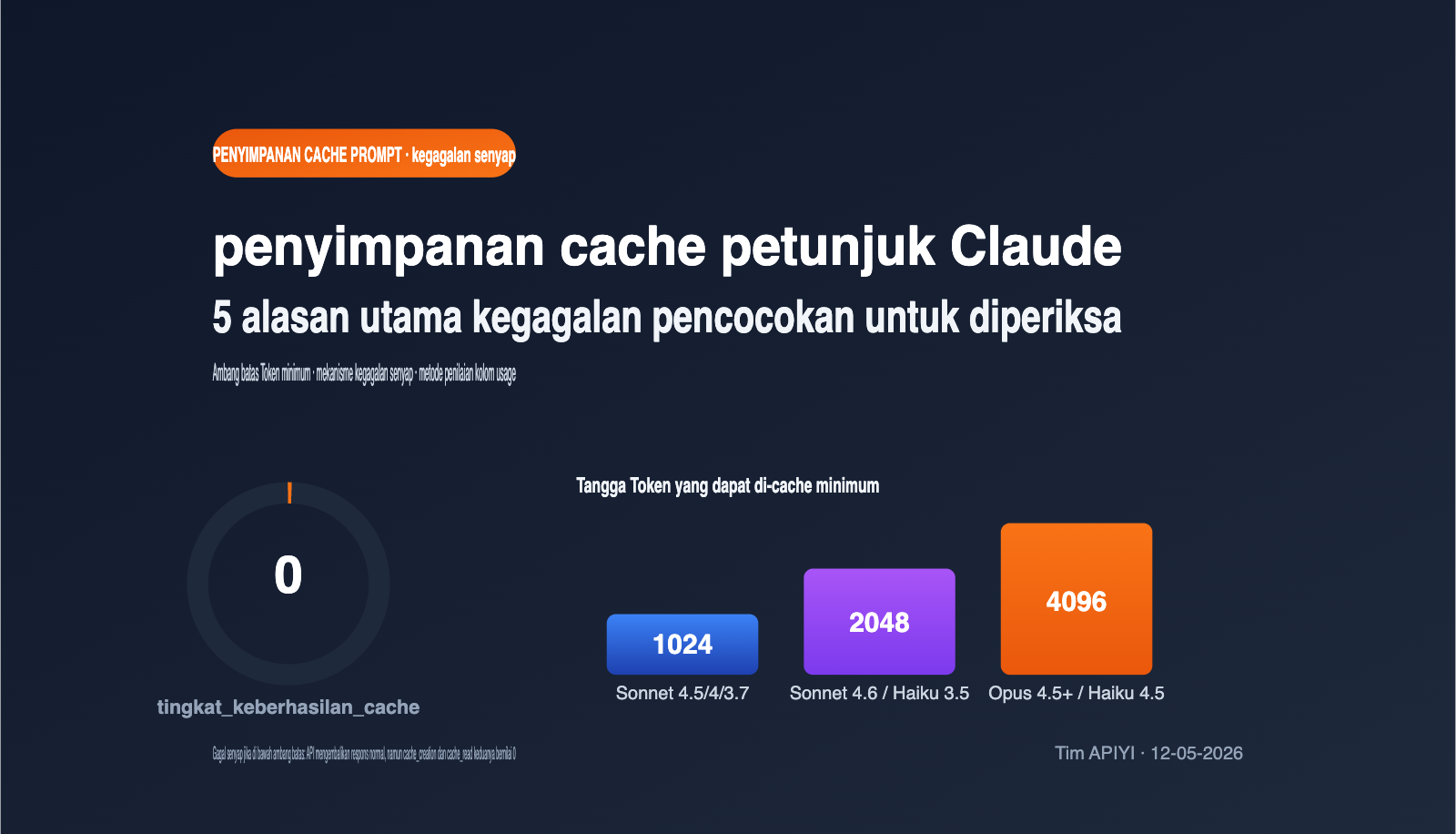

Saat menggunakan API Claude untuk pemanggilan dengan jendela konteks yang panjang, banyak pengembang sering mengalami kebingungan yang sama: meskipun sudah mendeklarasikan cache di kolom cache_control, nilai cache_creation_input_tokens dan cache_read_input_tokens pada respons tetap 0, dan diskon cache tidak terlihat di tagihan. Artikel ini akan membedah secara sistematis 5 alasan utama kegagalan Claude prompt caching, dengan fokus pada mekanisme "ambang batas minimum token yang dapat di-cache" dan "kegagalan senyap" (silent failure) yang paling sering terlewatkan.

Nilai Inti: Setelah membaca artikel ini, Anda akan memahami ambang batas minimum cache untuk berbagai model Anthropic, mengerti mengapa petunjuk singkat dengan cache_control tidak menghasilkan error namun juga tidak di-cache, serta mempelajari cara memastikan apakah cache benar-benar berhasil dengan 4 baris kode.

Poin Utama Claude Prompt Caching

Claude prompt caching adalah mekanisme caching petunjuk yang disediakan oleh Anthropic: menyimpan petunjuk sistem, dokumen panjang, dan definisi alat yang berulang ke dalam cache sementara. Saat hit berikutnya terjadi, biaya dihitung berdasarkan harga baca, yang sekitar 90% lebih murah daripada harga input normal. Fitur kuncinya adalah "pencocokan awalan + deklarasi eksplisit + kegagalan senyap", tiga poin ini menentukan arah Anda dalam memecahkan masalah.

| Poin | Penjelasan | Nilai Diagnostik |

|---|---|---|

| Deklarasi Eksplisit | Harus menyisipkan blok cache_control di dalam system, messages, atau tools |

Jika lupa menulis atau posisi salah, cache tidak akan terbentuk |

| Pencocokan Awalan | Memerlukan konsistensi byte demi byte untuk semua konten sebelum blok cache | Bahkan satu spasi tambahan akan menyebabkan kegagalan |

| Kegagalan Senyap | Permintaan yang tidak memenuhi syarat akan tetap merespons normal, tanpa error atau cache | Harus memverifikasi kolom usage secara proaktif |

| Batasan TTL | Default 5 menit, maksimal 1 jam | Pemanggilan dengan interval panjang akan kedaluwarsa secara alami |

"Kegagalan senyap" adalah bagian dari mekanisme ini yang paling sering membuat pengembang terjebak. Dokumentasi Anthropic dengan jelas menyatakan: ketika permintaan Anda tidak memenuhi syarat caching (misalnya panjang tidak cukup, awalan berubah), API akan tetap mengembalikan jawaban normal, tetapi tidak akan membuat cache, tidak membaca cache, dan tidak akan memunculkan error. Ini berarti Anda tidak akan melihat anomali apa pun dalam kode pemanggilan Anda, dan hanya bisa memeriksanya secara proaktif melalui objek usage dalam respons.

Jika Anda memanggil model seri Sonnet, Opus, atau Haiku dari Claude melalui platform APIYI (apiyi.com), logika caching-nya sepenuhnya konsisten dengan antarmuka resmi Anthropic. Disarankan untuk mencetak kolom usage sekali sebelum melakukan implementasi skala besar untuk memastikan cache benar-benar berfungsi.

Panduan Cepat Ambang Batas Token Minimum untuk Claude Prompt Caching

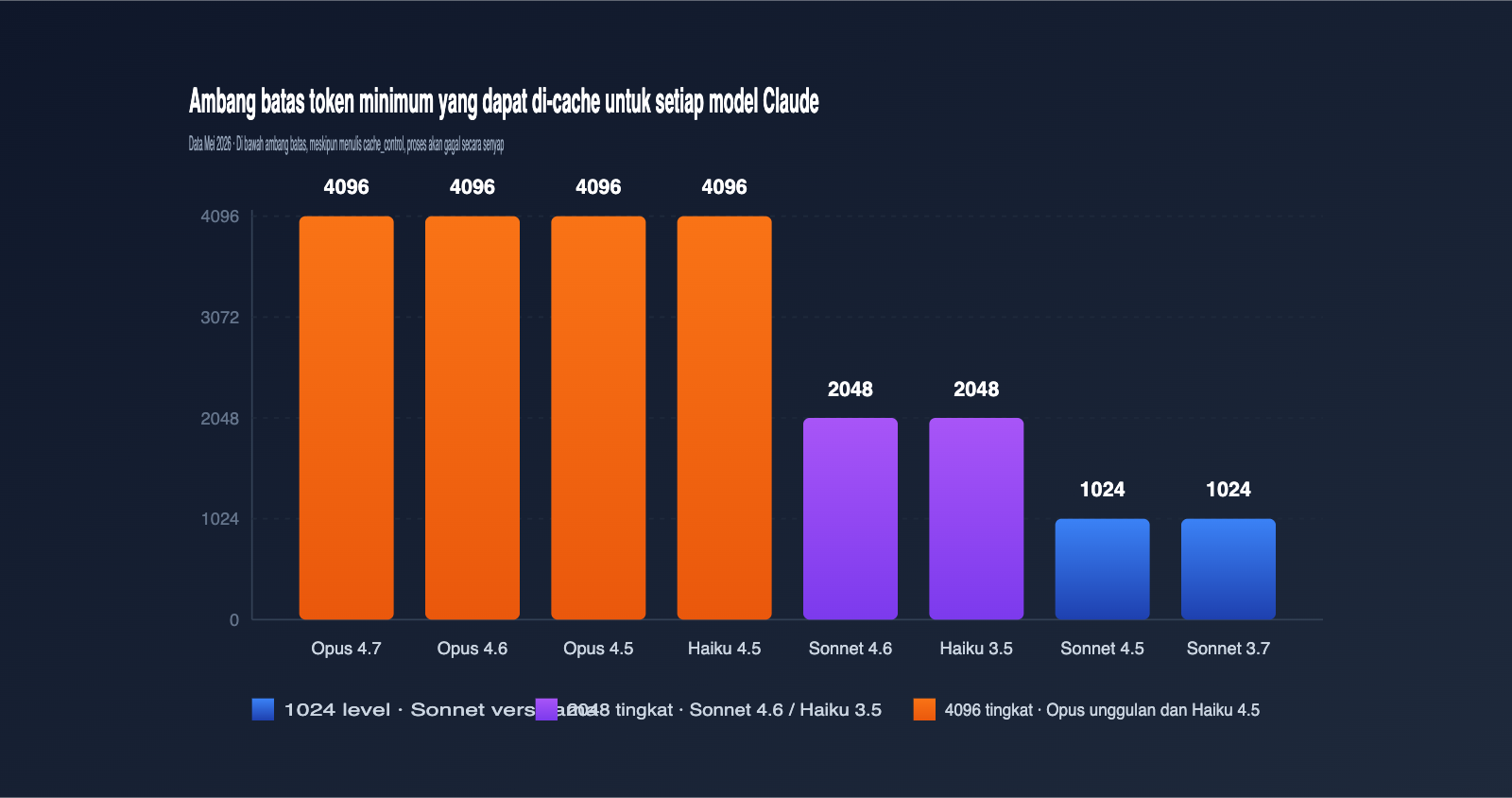

Penyebab paling sering terabaikannya kegagalan cache hit adalah panjang petunjuk yang tidak mencapai ambang batas "Token Minimum yang Dapat Di-cache" yang ditetapkan Anthropic untuk model tersebut. Jika panjangnya di bawah ambang batas ini, meskipun Anda telah menulis cache_control, permintaan tersebut hanya akan diproses sebagai permintaan biasa. Ambang batas antar model sangat bervariasi. Tabel di bawah ini adalah data resmi per Mei 2026, disarankan untuk disimpan.

| Model | Token Minimum Cache | Catatan |

|---|---|---|

| Claude Opus 4.7 / 4.6 / 4.5 | 4096 | Flagship terbaru, ambang batas tertinggi |

| Claude Sonnet 4.6 | 2048 | Sonnet utama saat ini, ambang batas dua kali lipat |

| Claude Sonnet 4.5 / Sonnet 4 / Sonnet 3.7 | 1024 | Seri Sonnet klasik |

| Claude Opus 4.1 / Opus 4 | 1024 | Opus generasi lama |

| Claude Haiku 4.5 | 4096 | Haiku justru lebih tinggi dari Sonnet |

| Claude Haiku 3.5 | 2048 | Model cepat yang stabil |

Banyak orang terkejut saat pertama kali melihat tabel ini: mengapa model "kecil" seperti Haiku 4.5 memiliki ambang batas yang sama tingginya dengan Opus 4.7? Alasannya adalah Haiku generasi baru menggunakan jendela perhatian (attention window) yang lebih panjang, di mana efektivitas cache hit hanya signifikan pada awalan yang lebih panjang, sehingga Anthropic menaikkan ambang batasnya dalam strategi produk.

Kesalahan penilaian yang paling umum dalam praktik adalah pengembang yang mendesain petunjuk berdasarkan kebiasaan 1024 token pada Sonnet 3.7, lalu tiba-tiba gagal saat beralih ke Sonnet 4.6, dan mengira ada kesalahan pada kode. Jika Anda menggunakan APIYI (apiyi.com) untuk memanggil berbagai generasi model Claude, sangat disarankan untuk menjadikan tabel ini sebagai bagian dari pemeriksaan parameter, dengan menentukan ambang batas secara dinamis berdasarkan field model.

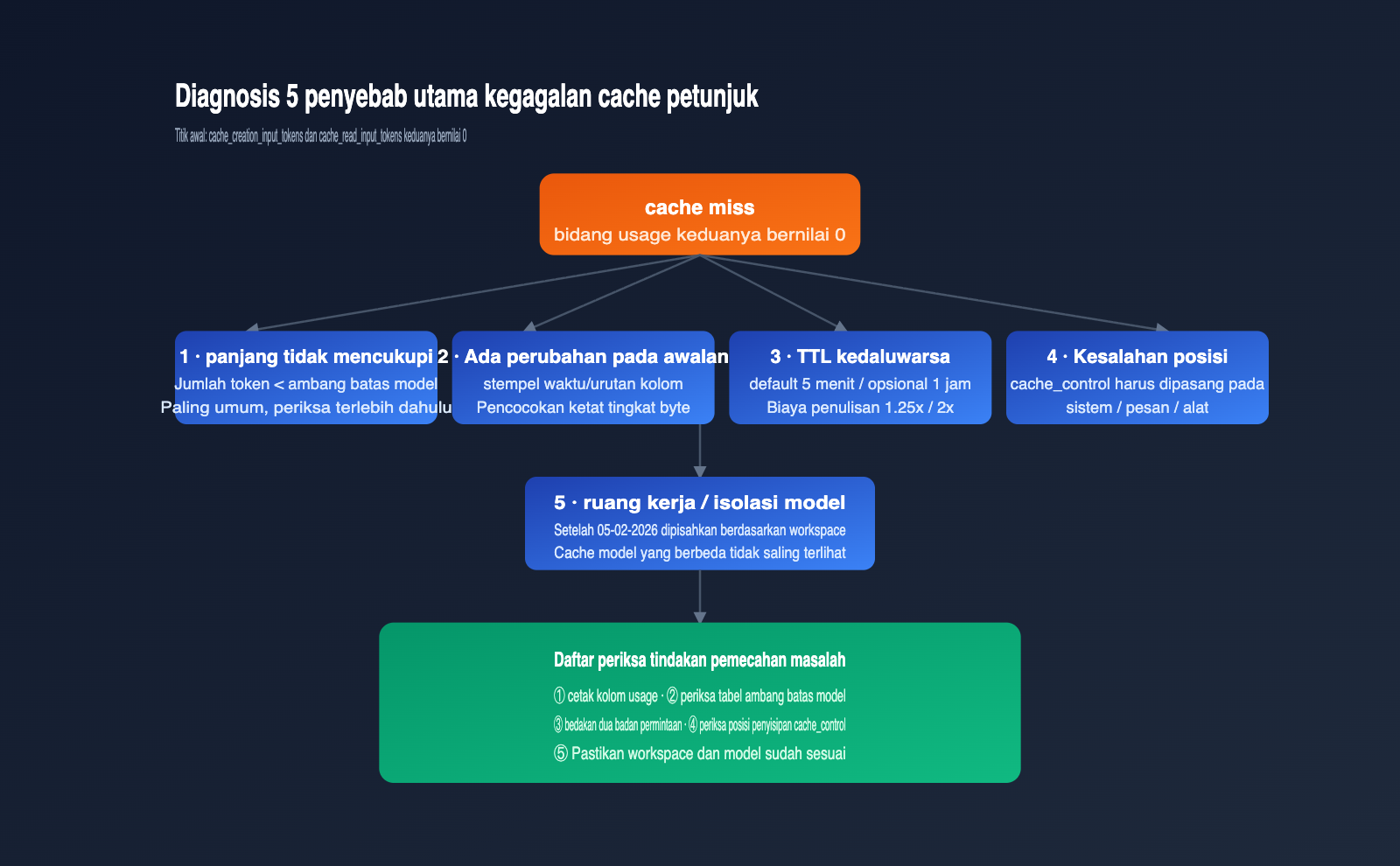

5 Penyebab Utama Kegagalan Claude Prompt Caching

Setelah memahami "Ambang Batas Token Minimum" dan "kegagalan senyap", Anda dapat melakukan pemeriksaan sistematis terhadap masalah cache miss. Berikut adalah 5 penyebab yang diurutkan berdasarkan frekuensi kemunculannya; dua penyebab pertama mencakup sebagian besar kasus yang kami temui dalam debugging harian.

Penyebab 1: Panjang petunjuk di bawah ambang batas minimum

Ini adalah penyebab nomor satu. Misalnya, Anda mendeklarasikan cache pada Sonnet 4.6, tetapi petunjuk sistem sebenarnya hanya 1500 token, maka cache tidak akan pernah dibuat. Metode diagnosisnya sederhana: gunakan tokenizer lokal untuk memperkirakan total token dari petunjuk sistem + definisi alat + bagian pesan yang di-cache, lalu bandingkan dengan ambang batas di tabel atas.

Situasi yang lebih tersembunyi adalah "penumpukan beberapa blok cache_control". Strategi Anthropic adalah "setiap titik henti cache harus membuat konten kumulatif di depannya mencapai ambang batas model", jika tidak, titik henti tersebut tidak valid. Disarankan bagi pemula untuk hanya menggunakan satu blok cache_control sampai Anda terbiasa dengan mekanismenya sebelum melakukan cache berlapis.

Penyebab 2: Adanya perubahan tingkat byte pada awalan cache

Prompt caching adalah pencocokan awalan yang ketat, yang berarti jika ada satu karakter saja yang berbeda pada petunjuk sistem, definisi alat, atau riwayat pesan Anda, cache akan dianggap tidak valid dan harus ditulis ulang. "Perubahan semu" yang umum meliputi:

- Logika rendering dengan stempel waktu yang disisipkan dalam petunjuk sistem, sehingga waktu permintaan selalu berbeda.

- Pergeseran urutan field karena kamus Python yang tidak berurutan saat definisi alat diserialisasi.

- Pemrosesan trim atau dedupe pada pesan riwayat, yang menyebabkan perbedaan kecil pada percakapan yang sama.

Cara paling langsung untuk memeriksa masalah ini adalah dengan melakukan perbandingan diff pada payload lengkap dari dua permintaan. Jika Anda menggunakan APIYI (apiyi.com) sebagai layanan proksi API terpadu di gateway mandiri, Anda dapat langsung melakukan hash pada badan permintaan di log gateway. Jika hash tidak konsisten, Anda biasanya dapat menemukan pergeseran awalan tersebut.

Penyebab 3: TTL telah kedaluwarsa

TTL default adalah 5 menit. Setelah interval ini terlampaui, entri cache lama akan dilepaskan dan permintaan berikutnya akan memicu penulisan ulang. Harga penulisan TTL 1 jam adalah 2 kali lipat dari harga input dasar, jadi pertimbangkan apakah layak diaktifkan berdasarkan frekuensi pemanggilan.

Ciri-ciri TTL kedaluwarsa adalah: cache_creation_input_tokens tiba-tiba menjadi nilai bukan nol, padahal Anda mengira permintaan tersebut seharusnya membaca cache. Jika Anda menemukan situasi ini, Anda dapat memperpendek interval antar permintaan atau beralih ke "ttl": "1h".

Penyebab 4: Kesalahan posisi cache_control

cache_control harus ditempatkan pada blok konten spesifik di dalam array system, messages, atau tools, dan tipenya harus ephemeral. Penggunaan yang salah yang umum meliputi:

- Menempatkan

cache_controlpada parameter tingkat atasmessages.create()alih-alih pada blok konten tertentu. - Mendeklarasikannya pada pesan user di dalam array

messages, padahal awalan yang sebenarnya ingin di-cache adalah system. - Menulis beberapa

cache_controldalam pesan yang sama tetapi tidak ada yang mencapai ambang batas 2048.

Cara yang benar adalah menyematkan cache_control langsung di dalam blok yang ingin Anda "kunci hingga titik ini". Cache akan terkunci dari awal prompt hingga akhir blok tersebut.

Penyebab 5: Cache tidak dibagikan antar ruang kerja atau model

Sejak 5 Februari 2026, Anthropic mengubah batas isolasi prompt cache menjadi "tingkat ruang kerja" (workspace level), yang berarti cache antar ruang kerja yang berbeda tidak terlihat satu sama lain. Jika dua panggilan Anda masing-masing menggunakan kunci API atau ruang kerja yang berbeda, cache tentu tidak dapat digunakan kembali.

Logika yang sama berlaku pada tingkat model. Menulis cache dengan petunjuk yang sama pada Sonnet 4.6, lalu beralih ke Sonnet 4.5 untuk pemanggilan berikutnya, tidak akan pernah menghasilkan cache hit. Saat melakukan penjadwalan multi-model, yang terbaik adalah memelihara skrip pemanasan cache secara terpisah berdasarkan dimensi model, atau menggunakan kembali ruang kerja hulu yang sama melalui platform agregasi seperti APIYI (apiyi.com) untuk menghindari fragmentasi cache.

Logika Verifikasi dan Pengecekan Hit Cache Claude

Langkah pertama untuk mendiagnosis masalah cache miss selalu dengan "mencetak bidang usage". Anthropic menyertakan objek usage dalam setiap respons messages.create, yang berisi 4 bidang kunci sebagai satu-satunya indikator andal untuk menentukan status cache.

Kode Verifikasi Minimalis

import anthropic

client = anthropic.Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com"

)

response = client.messages.create(

model="claude-sonnet-4-6",

max_tokens=1024,

system=[{

"type": "text",

"text": LONG_SYSTEM_PROMPT, # Harus ≥ 2048 token

"cache_control": {"type": "ephemeral"}

}],

messages=[{"role": "user", "content": "your question"}]

)

u = response.usage

print(f"Tulis cache: {u.cache_creation_input_tokens}")

print(f"Baca cache: {u.cache_read_input_tokens}")

print(f"Input tanpa cache: {u.input_tokens}")

Jadikan cuplikan kode ini sebagai templat pemecahan masalah. Setiap kali Anda curiga cache tidak berfungsi, jalankan kode ini terlebih dahulu untuk melihat bidang respons dan mengidentifikasi akar masalahnya.

Lihat versi lengkap yang dienkapsulasi

import anthropic

import logging

MIN_TOKENS = {

"claude-opus-4-7": 4096,

"claude-opus-4-6": 4096,

"claude-opus-4-5": 4096,

"claude-sonnet-4-6": 2048,

"claude-sonnet-4-5": 1024,

"claude-haiku-4-5": 4096,

"claude-haiku-3-5": 2048,

}

def call_with_cache_check(model: str, system_text: str, user_msg: str):

client = anthropic.Anthropic(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com"

)

response = client.messages.create(

model=model,

max_tokens=1024,

system=[{

"type": "text",

"text": system_text,

"cache_control": {"type": "ephemeral"}

}],

messages=[{"role": "user", "content": user_msg}]

)

u = response.usage

if u.cache_creation_input_tokens == 0 and u.cache_read_input_tokens == 0:

logging.warning(

f"Cache tidak aktif, kemungkinan di bawah ambang batas {MIN_TOKENS.get(model)} token"

)

return response

Tabel Penilaian Status Hit

cache_creation_input_tokens |

cache_read_input_tokens |

Kesimpulan |

|---|---|---|

| > 0 | = 0 | Penulisan cache pertama (normal) |

| = 0 | > 0 | Cache hit (ideal) |

| > 0 | > 0 | Hit parsial, bagian baru ditulis ke cache |

| = 0 | = 0 | Tidak ada cache, perlu periksa 5 penyebab utama |

Baris terakhir adalah tanda masalah. Jika Anda melihat ini, langsung lompat ke penyebab nomor 1 dan periksa satu per satu. Jika tim Anda memiliki kebutuhan stabilitas antarmuka yang tinggi, Anda dapat membungkus logika penilaian ini ke dalam middleware pada rantai pemanggilan API APIYI (apiyi.com) untuk mendapatkan notifikasi instan saat terjadi kegagalan.

4 Trik Praktis Memenuhi Ambang Batas Minimum Token

Setelah Anda memastikan bahwa "panjang teks tidak mencukupi" adalah penyebab cache miss, langkah selanjutnya adalah membuat awalan cache mencapai ambang batas. Berikut adalah 4 trik yang diurutkan berdasarkan rekomendasi; 3 cara pertama hampir tidak memiliki efek samping.

| Trik | Skenario Penggunaan | Tambahan Token | Catatan |

|---|---|---|---|

| Basis pengetahuan lengkap | Petunjuk sistem terlalu tipis | +2000–4000 | Harus benar-benar digunakan |

| Hosting definisi alat | Aplikasi multi-alat | +500–2000 | Bidang tools juga bisa di-cache |

| Contoh few-shot umum | Petunjuk berbasis tugas | +1000–3000 | Contoh harus memiliki nilai generalisasi |

| Mengisi teks tidak relevan | Darurat | Sembarang | Tidak disarankan, memengaruhi kualitas output |

Trik pertama, "Basis pengetahuan lengkap", adalah cara yang paling stabil. Jika aplikasi Anda memiliki basis pengetahuan internal (seperti FAQ produk, panduan gaya, atau SOP proses), Anda bisa memasukkannya sekaligus ke bagian atas blok system dan menambahkan cache_control. Ini akan membuat panjang teks melampaui 4096, memenuhi ambang batas untuk semua model.

Trik kedua, "Definisi alat", sering diabaikan. Bidang tools dari Anthropic juga mendukung cache_control, yang sangat efektif untuk aplikasi agen multi-alat. Deskripsi alat yang tipikal ditambah JSON Schema akan dengan mudah menembus 2048 token.

Trik ketiga, "Contoh few-shot", cocok untuk skenario tugas yang kompleks. Menempatkan 3-5 kasus standar di akhir system tidak hanya meningkatkan stabilitas output, tetapi juga menaikkan jumlah token dari 1500 ke 2500-3500, tepat melewati ambang batas Sonnet 4.6.

Trik keempat, "Mengisi teks tidak relevan", murni untuk keadaan darurat dan tidak disarankan untuk penggunaan sehari-hari karena model tetap akan membaca teks tersebut, yang berpotensi memengaruhi gaya output. Jika benar-benar tidak bisa mencukupi panjang teks, pertimbangkan untuk beralih ke Sonnet 4.5 atau Sonnet 3.7 yang memiliki ambang batas lebih rendah melalui platform APIYI (apiyi.com), sehingga petunjuk Anda saat ini bisa langsung masuk ke rentang ambang batas 1024.

Pertanyaan Umum

Q1: Saya sudah menambahkan cache_control tapi cache tidak berfungsi, apakah ada bug di API?

Kemungkinan besar bukan bug, melainkan mekanisme kegagalan senyap (silent failure). Langkah pertama, periksa ambang batas Token minimum untuk bidang model yang digunakan, lalu cetak objek usage. 99% kasus disebabkan oleh panjang teks yang kurang atau perubahan pada awalan (prefix).

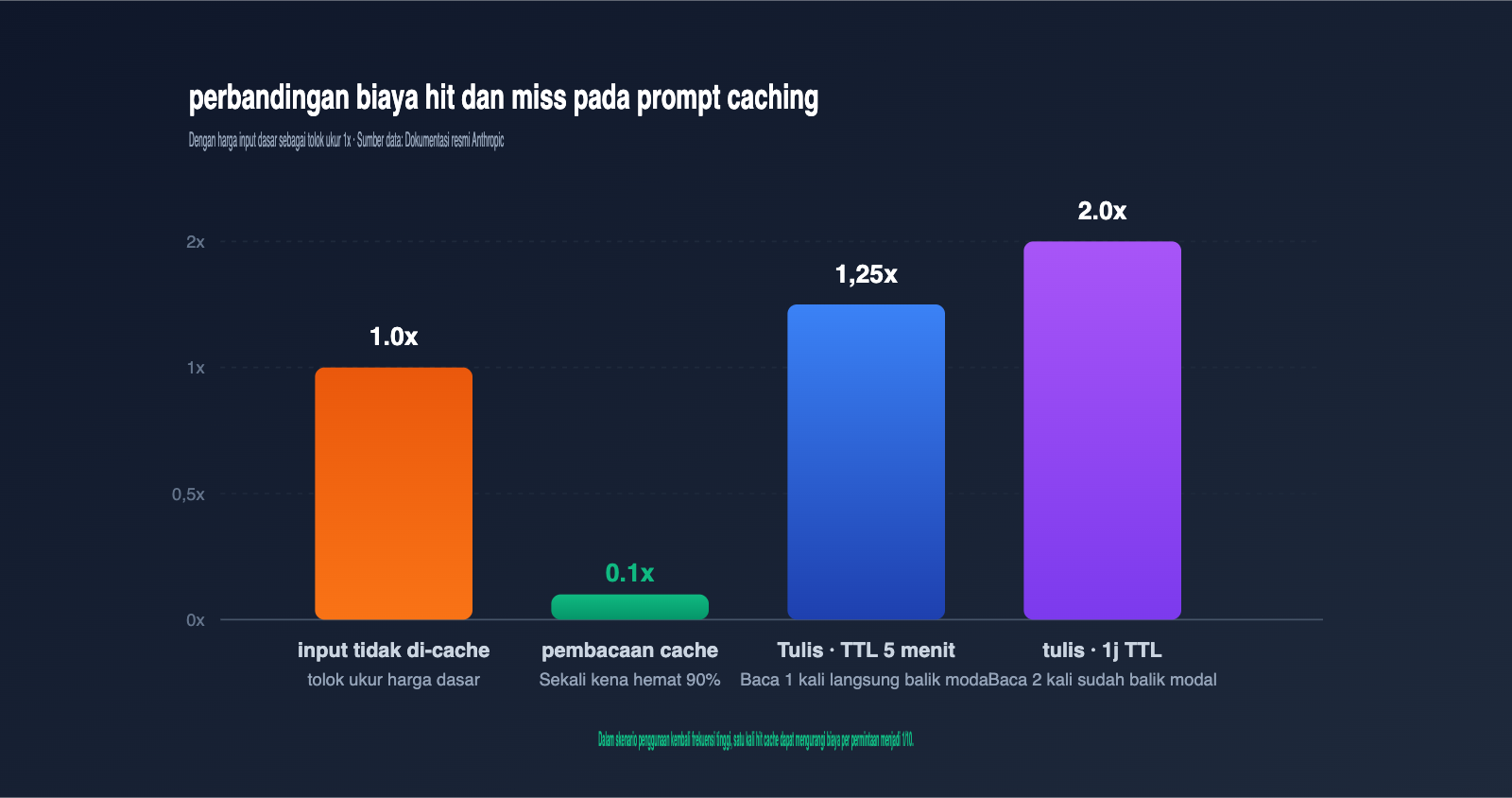

Q2: Apakah biaya cache_creation_input_tokens mahal?

Biaya penulisan untuk TTL 5 menit adalah 1,25 kali harga input dasar, sedangkan untuk TTL 1 jam adalah 2 kali lipat. Harga pembacaan adalah 0,1 kali lipat. Secara umum, cache 5 menit akan balik modal setelah 1 kali pembacaan, dan cache 1 jam setelah 2 kali pembacaan. Semakin sering digunakan kembali, semakin besar keuntungannya.

Q3: Dokumentasi lama menyebutkan Sonnet minimal 1024, kenapa versi baru jadi 2048?

Ini adalah ambang batas baru yang muncul sejak Sonnet 4.6. Versi Sonnet 4.5 dan yang lebih lama tetap menggunakan 1024. Disarankan untuk memelihara tabel pemetaan "model → ambang batas" dalam kode Anda dan menentukannya secara dinamis berdasarkan model yang dipanggil. Saat melakukan pemanggilan melalui APIYI apiyi.com, penamaan bidang model sama persis dengan Anthropic resmi, sehingga Anda bisa langsung menggunakan kembali logika pemetaan yang sama.

Q4: Bagaimana cara menggunakan beberapa blok cache_control dengan aman?

Setiap cache_control mengharuskan akumulasi awalan mencapai ambang batas, jika tidak, titik henti (breakpoint) tersebut akan gagal. Untuk pemula, disarankan hanya menggunakan satu titik henti dan menyimpan seluruh blok sistem dalam cache. Jika harus berlapis, Anda bisa menempatkan "basis pengetahuan yang jarang berubah" di lapisan pertama dan "definisi alat yang sesekali berubah" di lapisan kedua.

Q5: Bisakah saya menggunakan layanan proksi API lokal untuk menguji prompt caching?

Bisa. Antarmuka seri Claude pada platform agregator seperti APIYI apiyi.com sepenuhnya kompatibel dengan Anthropic resmi, termasuk bidang cache_control, ttl, dan usage. Pengembang dapat melakukan debugging dan peningkatan skala di platform proksi dengan logika cache dan aturan penagihan yang tetap konsisten.

Kesimpulan

Prompt caching pada Claude terlihat sederhana hanya dengan menambahkan bidang cache_control, namun saat digunakan, Anda mungkin akan terjebak oleh tiga hal: "kegagalan senyap + ambang batas Token minimum + pencocokan awalan yang ketat". Daftar periksa 5 alasan dan tabel penilaian hit yang diberikan dalam artikel ini dapat membantu pengembang mengidentifikasi 90% masalah kegagalan cache dalam waktu kurang dari 5 menit.

Saran implementasinya adalah menjadikan kode validasi sebagai middleware default, membuat tabel ambang batas model sebagai konstanta kode, dan membuat skrip terpisah untuk pemanasan cache (cache warming). Jika bisnis Anda sering berpindah-pindah antar model, Anda dapat mengelola pintu masuk pemanggilan Claude secara terpusat melalui platform APIYI apiyi.com, menggunakan kembali strategi cache dan logika pemantauan yang sama untuk menghindari biaya tersembunyi akibat fragmentasi cache dan ketidakkonsistenan ambang batas antar lingkungan.

Penulis: Tim Teknis APIYI

Kontak: Dapatkan dukungan penuh untuk debugging seri Claude dan prompt caching melalui APIYI apiyi.com

Waktu Pembaruan: 12-05-2026