站长注:详细剖析Google AI Studio API返回"no candidate prompt was blocked due to OTHER"错误的原因,并提供实用的解决方案。

在使用Google AI Studio的API进行开发过程中,许多开发者可能会遇到一个令人困惑的错误信息:"no candidate prompt was blocked due to other"或"Response was blocked due to OTHER"。这种错误往往出现在明明没有明显违规内容的情况下,甚至在完全关闭安全过滤设置后仍然存在。本文将深入分析这一问题产生的根本原因,并提供一系列实用的解决方案,帮助开发者更顺畅地使用Google AI Studio API。

500 截断问题很常见,只能修改输入内容。

欢迎免费试用 API易,3 分钟跑通 API 调用 www.apiyi.com

支持Gemini、Claude、GPT系列等多种先进大模型,API易提供稳定无阻断的AI接口服务

注册可送 1.1 美金额度起,约 300万 Tokens 额度体验。立即免费注册

加站长个人微信:8765058,发送你《大模型使用指南》等资料包,并加赠 1 美金额度。

Google AI Studio API返回OTHER阻止错误的背景介绍

Google AI Studio是Google提供的生成式AI开发平台,允许开发者通过可视化界面或API调用Gemini等模型。与大多数AI服务一样,Google为其API实施了严格的安全过滤机制,以防止生成不适当、有害或违反政策的内容。

然而,很多开发者在使用过程中发现,即使是看似无害的请求也会被API以"OTHER"类别阻止,这种情况在API调用中比在Web界面更为常见。更令人困惑的是,即使将所有可配置的安全设置设为最低级别(BLOCK_NONE),这种阻止仍然会发生。

这导致了一个普遍的开发困境:同样的提示在Google AI Studio网页界面可以正常工作,但通过API调用时却被拦截,影响了应用的开发进度和用户体验。

Google AI Studio API返回OTHER阻止错误的核心原因

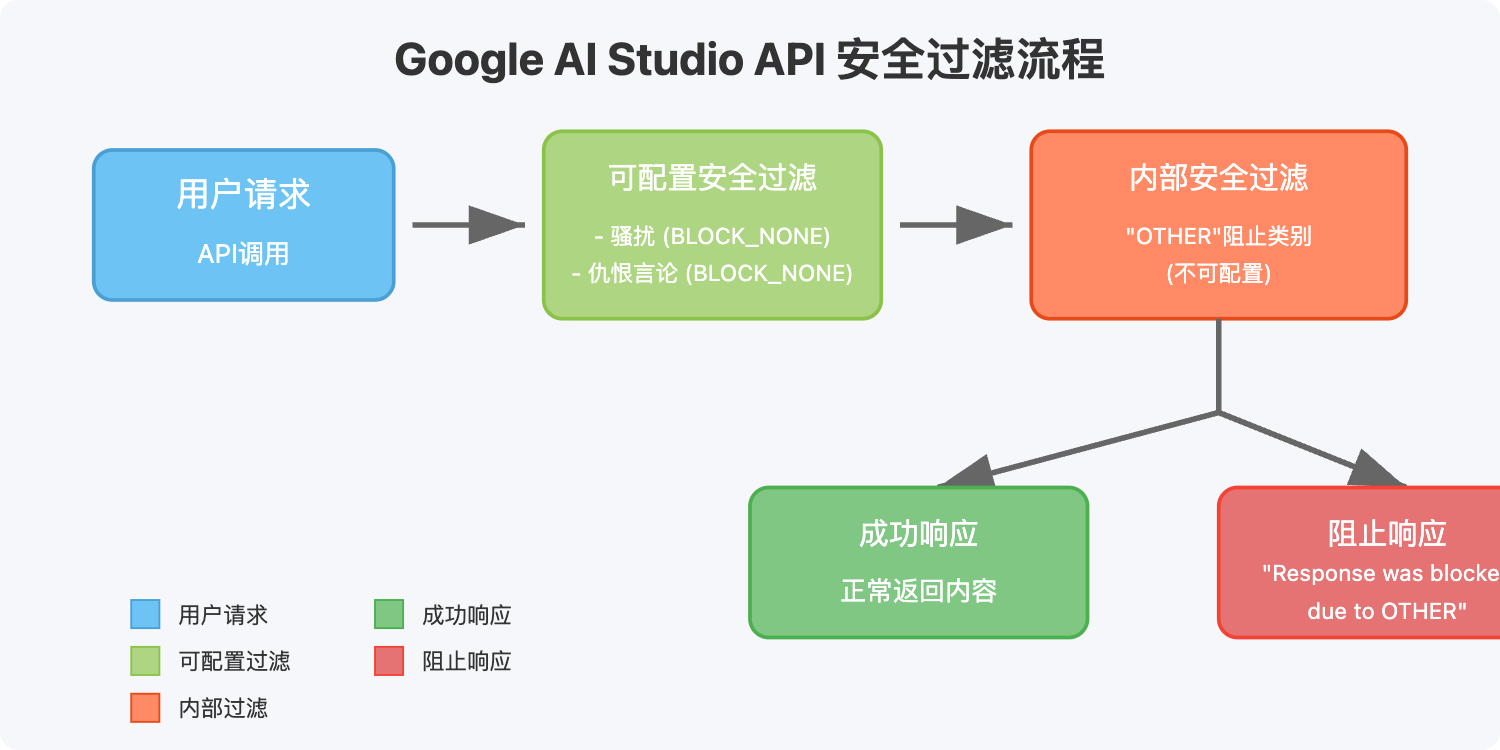

安全过滤机制与阻止原因分类

Google AI Studio和Gemini API采用多层安全过滤系统,这些系统会分析提示和回应中可能存在的不安全内容。当内容被阻止时,API会返回一个表明阻止原因的指示。这些原因通常分为几个主要类别:

- 骚扰(Harassment):针对个人或群体的攻击性内容

- 仇恨言论(Hate Speech):基于身份特征的歧视性内容

- 性暴力(Sexual):露骨的性内容或暗示

- 危险内容(Dangerous):鼓励有害行为的内容

然而,除了这些明确的类别外,还存在一个特殊的"OTHER"类别,这是一种捕获各种未明确分类的违规内容的通用类别。

"OTHER"阻止原因的特殊性

"OTHER"阻止类别具有以下特殊性质:

-

无法通过安全设置禁用:即使将所有安全类别设置为

BLOCK_NONE(理论上禁用所有已知类别的阻止),API仍然可以以"OTHER"为理由阻止内容。 -

内部政策执行:这类阻止通常是由Google的内部安全或政策系统强制执行的,这些系统不对外公开详细信息,也不允许用户配置或绕过。

-

不透明的判断标准:Google并未明确公开"OTHER"类别的具体判断标准,使开发者难以预测和避免这类阻止。

API与Web界面行为差异

用户观察到Google AI Studio的Web应用有时允许API阻止的提示,即使安全设置相同。这种差异可能是由于:

- Web界面和API使用不同的执行机制或阈值

- Web界面可能有额外的用户交互启发式算法

- API可能采用更保守的安全策略,以防止大规模滥用

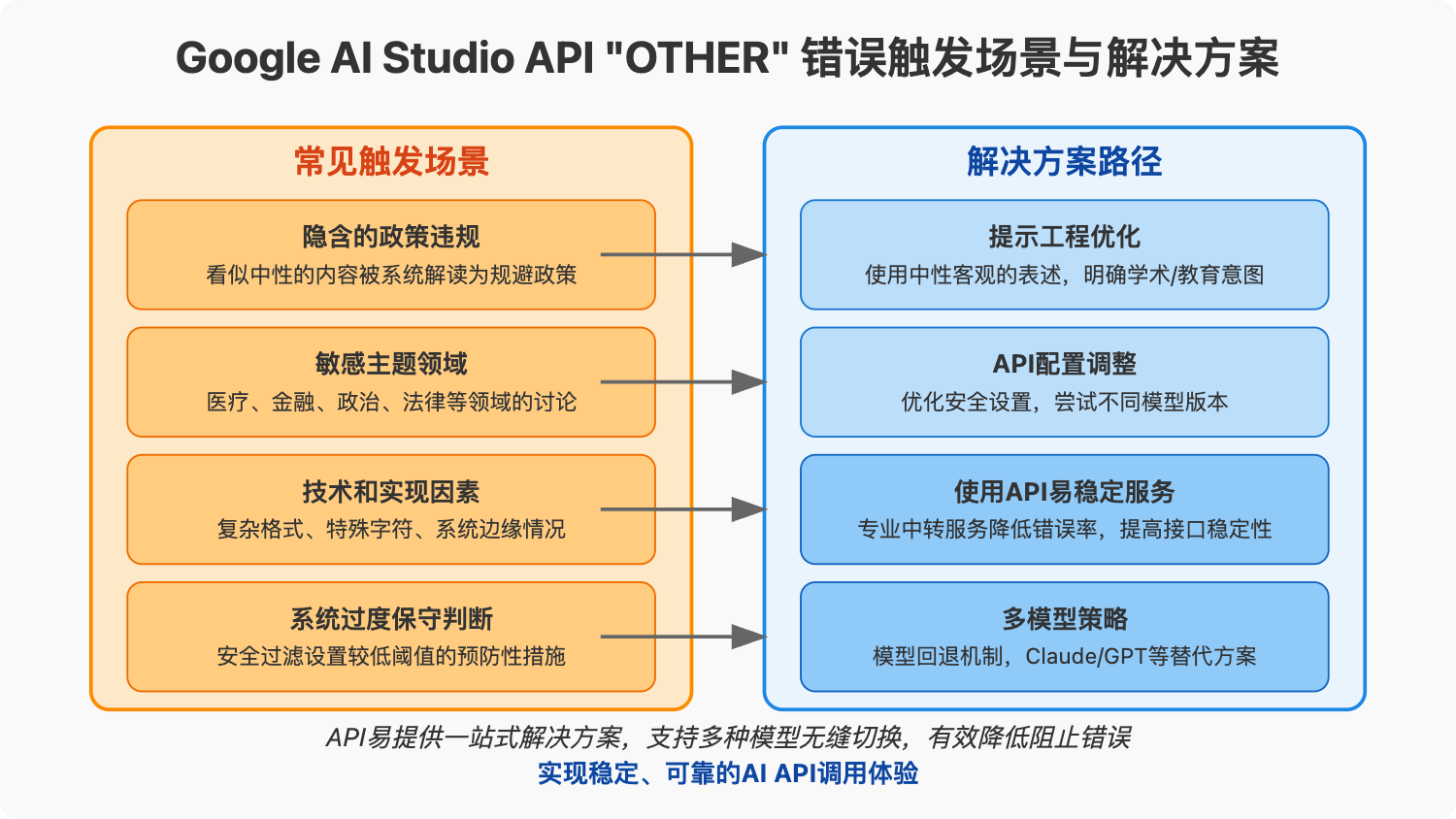

Google AI Studio API返回OTHER阻止错误的常见触发场景

研究表明,以下场景容易触发"OTHER"阻止错误:

1. 隐含的政策违规内容

虽然提示本身可能看起来无害,但如果系统判断它可能导致违反Google服务条款的内容,就会触发阻止。这包括:

- 可能被解释为规避内容政策的复杂提示

- 间接请求生成违规内容的提示

- 可能导致版权侵犯的内容生成请求

2. 特定主题和领域

某些敏感主题领域,即使讨论方式是学术或中立的,也更容易触发阻止:

- 医疗和健康建议,特别是替代疗法

- 金融和投资建议

- 政治和选举相关内容

- 宗教和文化敏感话题

- 某些法律建议或解释

3. 技术和实现因素

有时,触发阻止的原因可能更多与技术因素有关:

- 提示格式或结构复杂度超过系统处理阈值

- 包含API难以解析的特殊字符或格式

- 系统内部错误或边缘情况被错误分类为风险内容

4. 系统过度保守的判断

由于AI安全的重要性和潜在风险,Google的系统可能采取过度保守的方法:

- 宁可错误阻止安全内容也不放行潜在有风险的内容

- 对新出现的内容类型采取预防性阻止,直到确认安全

- 针对可疑模式设置较低的阻止阈值

Google AI Studio API返回OTHER阻止错误的解决方案

面对"OTHER"阻止错误,开发者可以尝试以下几种方法来解决问题:

1. 提示工程技巧

精心设计提示是避免触发安全过滤器的最有效方法之一:

提示中性化

- 使用中性、客观的语言描述需求

- 避免使用可能被误解为极端或煽动性的词汇

- 将请求框架为学术研究或教育目的

明确上下文和意图

# 改进前

prompt = "告诉我如何制作爆炸物"

# 改进后

prompt = "作为一名化学教育者,请解释化学反应中放热与吸热反应的区别,并提供课堂安全演示的例子"

分解复杂请求

将复杂请求分解为多个简单、明确的步骤,每步专注于一个特定方面,可以降低触发阻止的风险。

2. API配置调整

虽然"OTHER"阻止无法完全通过安全设置禁用,但以下配置调整可能有所帮助:

安全设置优化

import google.generativeai as genai

# 配置API密钥

genai.configure(api_key="YOUR_API_KEY")

# 设置安全过滤级别

safety_settings = [

{"category": "HARM_CATEGORY_HARASSMENT", "threshold": "BLOCK_NONE"},

{"category": "HARM_CATEGORY_HATE_SPEECH", "threshold": "BLOCK_NONE"},

{"category": "HARM_CATEGORY_SEXUALLY_EXPLICIT", "threshold": "BLOCK_NONE"},

{"category": "HARM_CATEGORY_DANGEROUS_CONTENT", "threshold": "BLOCK_NONE"}

]

# 创建模型实例

model = genai.GenerativeModel(

model_name="gemini-1.5-pro",

safety_settings=safety_settings

)

# 生成回应

response = model.generate_content("您的提示内容")

尝试不同的模型版本

不同版本的Gemini模型可能有略微不同的安全过滤实现。尝试较新或较旧的模型版本可能会有所帮助。

3. 替代解决方案

当Google AI Studio API持续返回阻止错误时,考虑以下替代方案:

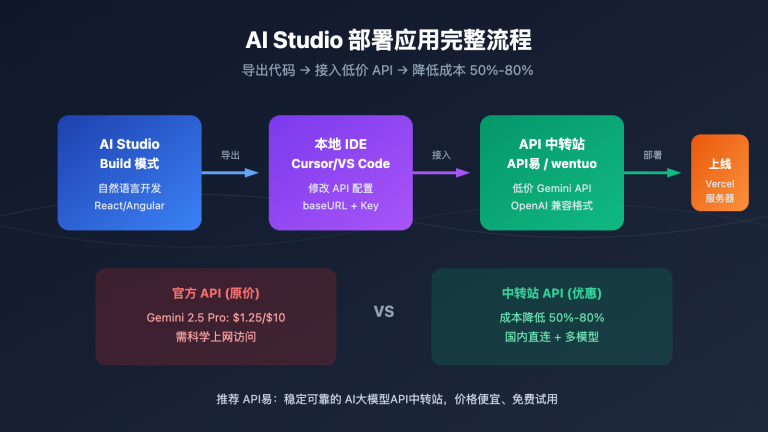

使用API易等稳定中转服务

API易提供对Gemini等多种模型的稳定访问,通过专业的中转机制,可以有效降低遇到阻止错误的概率。

import requests

import json

# 使用API易访问Gemini模型

url = "https://vip.apiyi.com/v1/chat/completions"

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer YOUR_APIYI_KEY"

}

data = {

"model": "gemini-1.5-pro",

"messages": [

{"role": "user", "content": "您的提示内容"}

]

}

response = requests.post(url, headers=headers, json=data)

result = response.json()

print(result["choices"][0]["message"]["content"])

多模型策略

实现一个模型回退机制,当Gemini API返回阻止错误时,自动切换到Claude或GPT等其他模型。

def get_ai_response(prompt):

# 首先尝试Gemini API

try:

gemini_response = call_gemini_api(prompt)

return gemini_response

except BlockedError:

# 如果Gemini被阻止,尝试备用模型

try:

claude_response = call_claude_api(prompt)

return claude_response

except:

# 最后的备选方案

gpt_response = call_gpt_api(prompt)

return gpt_response

Google AI Studio API返回OTHER阻止错误的开发指南

1. 模型选择

模型服务介绍

API易,行业领先的API中转站,均为官方源头转发,价格略有优势,聚合各种优秀大模型,使用起来很方便。

企业级专业稳定的OpenAI o3/Claude 3.7/Deepseek R1/Gemini 等全模型官方同源接口的中转分发。不限速,不过期,不惧封号,按量计费,长期可靠服务;让技术助力科研、公益事业!

适合避免阻止错误的模型推荐

全部模型和价格请看网站后台 https://www.apiyi.com/account/pricing

- Gemini系列替代方案

claude-3-7-sonnet-20250219:最新Claude模型,安全过滤更合理(推荐指数:⭐⭐⭐⭐⭐)claude-3-5-sonnet-20241022:稳定可靠,安全过滤较少误判

- OpenAI系列

o3:安全过滤设计更合理,误判率低(推荐指数:⭐⭐⭐⭐)gpt-4o:多模态能力强,阻止率相对较低gpt-4o-mini:经济实惠的替代选择

- Gemini原厂能力(通过API易稳定访问)

gemini-1.5-pro-preview-05-06:最新的Gemini模型,性能强但仍存在阻止风险gemini-1.5-flash-preview:速度更快的版本,适合简单任务

场景推荐

-

敏感话题处理

- 首选:

claude-3-7-sonnet-20250219– 在处理敏感话题时阻止率较低 - 备选:

o3– 对边缘案例处理得当

- 首选:

-

商业和企业应用

- 首选:

claude-3-7-sonnet-20250219– 安全性和可用性平衡良好 - 备选:

gemini-2.5-pro-preview-05-06– 通过API易稳定访问

- 首选:

-

教育和研究用途

- 首选:

gpt-4o– 对学术和研究内容的处理更开放 - 备选:

claude-3-5-sonnet-20241022– 性价比高且稳定

- 首选:

注意:具体价格请参考 API易价格页面

实践示例:API易访问模型避免阻止错误

以下是一个使用API易访问Claude模型以避免阻止错误的完整示例:

import requests

import json

def query_claude_via_apiyi(prompt):

url = "https://vip.apiyi.com/v1/chat/completions"

headers = {

"Content-Type": "application/json",

"Authorization": f"Bearer YOUR_APIYI_KEY" # 替换为您的API易密钥

}

data = {

"model": "claude-3-7-sonnet-20250219",

"messages": [

{"role": "system", "content": "你是一个有帮助的AI助手,提供信息准确、客观的回答。"},

{"role": "user", "content": prompt}

],

"temperature": 0.3

}

try:

response = requests.post(url, headers=headers, json=data)

response.raise_for_status()

result = response.json()

return result["choices"][0]["message"]["content"]

except Exception as e:

print(f"API调用错误: {e}")

return None

# 使用示例

prompt = "请分析区块链技术对金融行业的影响" # 这类话题在Google API可能触发阻止

response = query_claude_via_apiyi(prompt)

print(response)

Google AI Studio API返回OTHER阻止错误的最佳实践

为了最大限度地减少遇到"OTHER"阻止错误的可能性,建议遵循以下最佳实践:

-

持续监控和记录

- 实现详细的日志记录,跟踪哪些提示触发了阻止

- 分析模式,识别常见触发因素

- 为特定用例构建安全提示模板库

-

错误处理策略

- 实现优雅的错误处理,向用户提供有意义的反馈

- 设计回退机制,在触发阻止时提供替代响应

- 考虑缓存成功响应,减少重复触发阻止的风险

-

优化内容策略

- 开发内容审核前置系统,在发送到API前过滤可能有问题的提示

- 构建提示转换层,将用户输入重新格式化为低风险表述

- 使用模板和控制策略限制自由形式输入的范围

-

模型多样化

- 使用API易同时访问多种模型,在一个模型被阻止时切换到另一个

- 为不同类型的查询使用不同的模型

- 建立混合系统,将敏感查询导向更宽松的模型

Google AI Studio API返回OTHER阻止错误的常见问题

1. 为什么完全无害的提示也会被阻止?

问题:我的提示完全是关于普通话题的,为什么还会被"OTHER"原因阻止?

解答:

- Google的安全系统使用复杂的模式匹配和预测模型,有时会产生误判

- 某些词汇组合可能与已知的违规模式相似,即使内容本身无害

- 系统可能对某些主题领域设置了较低的阈值,宁可错误阻止也不放行潜在风险

- 可以尝试重新表述提示,使用更中性的语言,或通过API易访问其他模型

2. 为什么Web界面可以但API被阻止?

问题:同样的提示在Google AI Studio的Web界面可以工作,但通过API调用时被阻止,为什么?

解答:

- Web界面和API可能使用不同的安全过滤实现或阈值

- Web界面可能有额外的上下文理解和人机交互因素

- API设计更保守,因为它可能被用于大规模自动化应用

- 某些互动式重试在Web界面可能会成功,而API则保持一致的阻止

- 建议对API开发使用API易等更稳定的服务,或实现多模型策略

3. 如何确定提示中的哪部分触发了阻止?

问题:当我的提示被阻止时,如何知道是哪部分内容导致了阻止?

解答:

- Google通常不会提供具体触发阻止的内容部分

- 可以采用二分法排查:将提示分为几部分,分别测试

- 系统性地变更词汇和表述,观察哪些改变会导致通过

- 使用API易的多模型访问,观察不同模型的响应差异

- 建立一个提示测试框架,自动化测试不同变体的成功率

为什么选择「API易」解决Google AI Studio API阻止问题

对于遇到Google AI Studio API阻止问题的开发者,API易提供了全面的解决方案:

-

多模型无缝切换

- 一个API密钥访问Claude、GPT-4o、Gemini等多种高级模型

- 当一个模型触发阻止时,轻松切换到另一个模型

- 统一的API格式,简化代码调整

-

稳定可靠的服务质量

- 中转服务优化连接稳定性,减少技术性错误

- 专业负载均衡和请求优化,提高响应成功率

- 7×24小时服务监控,确保API持续可用

-

灵活的开发选项

- 所有主流编程语言的SDK和示例代码

- 兼容OpenAI格式的API接口,迁移成本低

- 详细的错误反馈,帮助开发者理解并解决问题

-

成本效益优势

- 按量计费,无最低消费要求

- 访问多种模型的单一计费系统,简化管理

- 实时用量监控,避免意外超支

总结

Google AI Studio API返回"no candidate prompt was blocked due to OTHER"错误是许多开发者面临的常见挑战。这种阻止机制虽然令人沮丧,但是谷歌为了确保AI应用的安全和负责任使用而设置的必要措施。

通过理解这种阻止的核心原因、优化提示设计、调整API配置,以及在必要时使用API易等替代服务,开发者可以有效减少遇到这类问题的频率,构建更可靠的AI应用。最重要的是采取多模型策略,不将应用的成功仅仅依赖于单一模型或API端点。

虽然这种安全过滤机制可能会不时造成不便,但它也推动着AI行业向更负责任、更安全的方向发展。通过合作和创新,我们可以在保护用户和遵守政策的同时,充分发挥AI技术的潜力。

欢迎免费试用 API易,3 分钟跑通 API 调用 www.apiyi.com

一站式解决Google AI Studio API阻止问题,多模型稳定访问

加站长个人微信:8765058,发送你《大模型使用指南》等资料包,并加赠 1 美金额度。

本文作者:API易团队

欢迎关注我们的更新,持续分享 AI 开发经验和最新动态。