最近在帮客户排查图像生成需求时,我们发现一个值得分享的现象:GPT-Image-2 已经无法生成真正的透明背景 PNG。无论你在提示词里写"背景必须是透明的",还是直接通过 API 传入 background: "transparent" 参数,最新一代的 GPT-Image-2 都会返回一张实色背景的图,或者直接报错。这跟它的上一代 sora_image / gpt-4o-image 形成了非常明显的能力反差,也让一批做电商 SKU 抠图、社交贴纸、PPT 插画的团队措手不及。

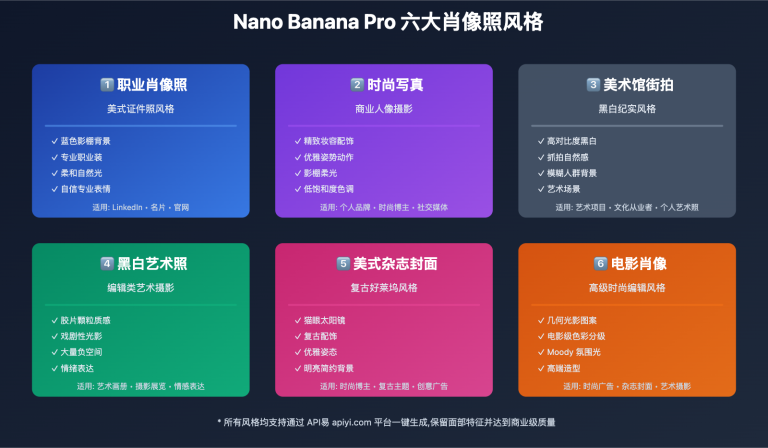

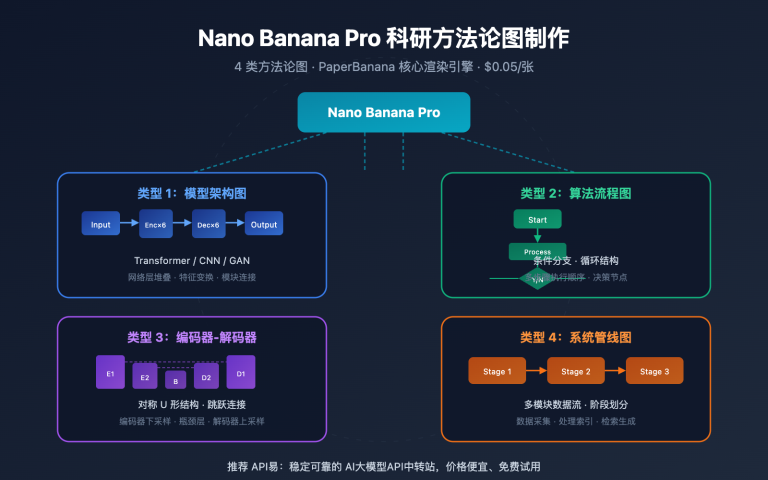

更巧的是,谷歌在 2025 年底推出的旗舰图像模型 Nano Banana Pro(基于 Gemini 3 Pro Image)同样不支持透明背景生成,连前一代的 Nano Banana 2 也是同样的限制。换句话说,目前业界两个最主流的图像生成基座,都把"透明背景"这个看似基础的功能给砍掉了。我们在 API易 apiyi.com 上跑了一整轮回归测试,把现象、根因、替代方案完整整理成本文,方便正在做产品集成的团队快速决策。

GPT-Image-2 透明背景失败的完整复现实验

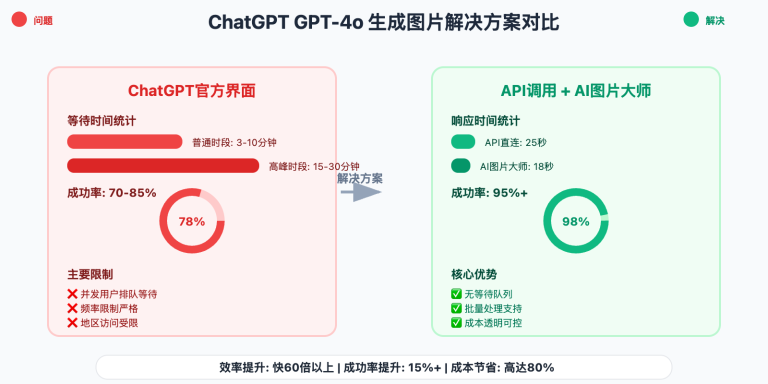

要理解这个能力差异,最直接的办法就是把它跑一遍。我们用 API易 网关同时调用 gpt-image-2、gpt-image-1.5 和 gpt-image-2-all 三个版本,提示词统一为"a cute orange cat sticker, transparent background",并把 background 参数都显式设置成 transparent。结果非常一致:gpt-image-2 系列要么返回 4xx 错误,要么生成实色或棋盘格底图,唯独 gpt-image-1.5 老老实实返回了带 alpha 通道的真透明 PNG。

# 通过 API易 网关一次性测试 3 个版本的透明背景能力

from openai import OpenAI

client = OpenAI(

api_key="your-apiyi-key",

base_url="https://api.apiyi.com/v1"

)

# ❌ gpt-image-2 不支持 transparent,会被网关层提前拒绝

client.images.generate(

model="gpt-image-2",

prompt="a cute orange cat sticker",

background="transparent",

output_format="png"

)

# ✅ gpt-image-1.5 仍然原生支持透明背景输出

client.images.generate(

model="gpt-image-1.5",

prompt="a cute orange cat sticker",

background="transparent",

output_format="png"

)

🎯 快速上手建议:如果你只是想把现成的工作流跑通,最低成本的做法是把 model 字段切回

gpt-image-1.5,base_url 指向 API易 apiyi.com,其它参数完全不动,5 分钟内就能恢复透明输出能力。

我们也复现了在提示词里硬塞"background must be transparent"、"isolated on transparent canvas"、"PNG with alpha channel"等表述的情况。GPT-Image-2 表现非常顽固:要么直接给一个白底,要么生成一张带灰白棋盘格"贴图"的实色图,相当于把"表示透明的可视化标记"画了上去。这点和 Nano Banana Pro 的失败模式高度一致,是模型语义对齐层面的硬伤,而不是 prompt 写得不够精确。

| 触发方式 | GPT-Image-2 表现 | gpt-image-1.5 表现 | 推荐做法 |

|---|---|---|---|

background="transparent" 参数 |

API 拒绝 / 实色 | 真透明 PNG | 直接换模型 |

| 提示词写"transparent background" | 白底或棋盘格图案 | 真透明 PNG | 不要依赖文字 |

| 提示词写"isolated subject on white" | 浅灰背景 | 主体白底 | 配合参数一起用 |

输出 output_format=webp |

仍为实色 | 真透明 webp | webp 不影响能力 |

| Edit 接口 + alpha 蒙版 | 无效 | 局部透明 | 仅 1.5 可用 |

GPT-Image-2 透明背景被砍掉的 3 个根本原因

第一是架构层面的取舍。OpenAI 在 GPT-Image-2 的官方文档中明确写了"gpt-image-2 doesn't currently support transparent backgrounds",原因没有公开,但行业内普遍推测和它升级到更强的"场景一致性"训练目标有关——模型被训练去补全一个真实世界的场景,而不是"抠图",因此在底层就少了 alpha 通道的监督信号。这是一项产品级的设计取舍,不是 bug。

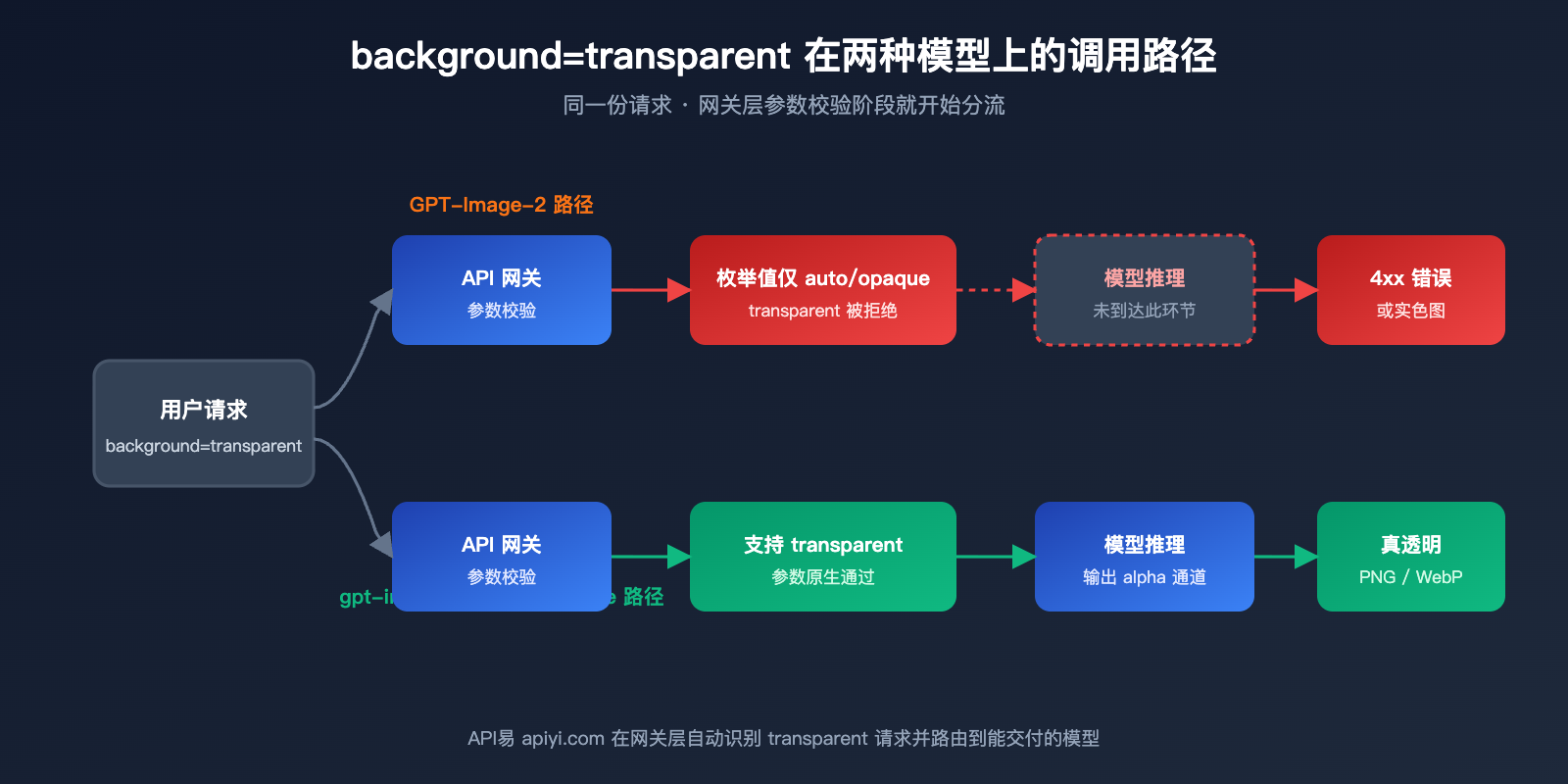

第二是API 网关的强制校验。我们抓了一下 OpenAI 官方端点的响应,gpt-image-2 的 background 参数枚举值只允许 auto 和 opaque,把 transparent 直接从参数空间里删掉了。这意味着任何上游平台(包括 API易 网关)都会在请求阶段就拒绝这种调用,根本到不了模型推理这一步。所以"换个第三方平台就能绕过"是一种幻觉,gpt-image-2-all、gpt-image-2-vip 等"官逆"通道走的也是同一个后端模型。

第三是安全与版权过滤策略。透明背景图常被用于二次合成,涉及肖像、品牌 Logo 的场景特别多。OpenAI 这两年明显在收紧"可二次合成素材"的输出权限,gpt-image-2 也搭载了更严格的内容审核流水线,这一定程度上和透明背景能力的下线是同向的。

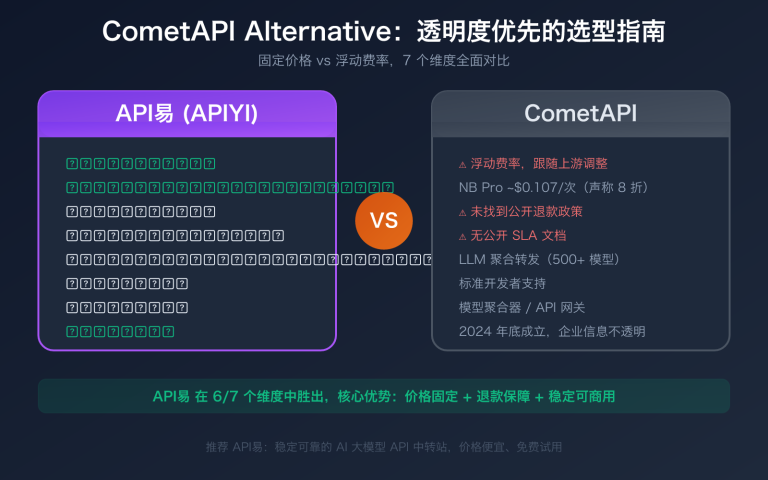

🎯 架构理解建议:在 API易 apiyi.com 这种统一网关里,我们会把 gpt-image-2 与 gpt-image-1.5 的参数空间分别校验,遇到

transparent请求时自动给出降级建议,避免业务侧出现"调用都失败但不知道为什么"的情况。

GPT-Image-2 与 Nano Banana Pro 透明背景能力对比

很多客户问我们:"换成 Google Nano Banana 2 / Nano Banana Pro 是不是就行了?"答案非常残酷——同样不行。Nano Banana Pro 的失败模式甚至比 GPT-Image-2 更"骚气":它会生成一张表面上看起来"是透明背景"的图,但仔细一看,那个棋盘格其实是被画进图片里的实色像素,等于把 Photoshop 里的透明指示图案"原样画"了一遍。

社区目前主流的解释是:模型的训练数据里大量出现"用棋盘格表示透明"的素材图(Stock 图库、Photoshop 截图、设计教程截图等),导致模型形成了"透明 = 棋盘格"的错误关联。Google 官方在 Gemini API 论坛里也证实过 Nano Banana 系列暂时不会原生支持透明背景输出,需要靠 Gemini 3 Flash + 代码执行的组合拳来"曲线救国"。

| 模型 | 发布时间 | 透明背景支持 | 失败时表现 | 推荐场景 |

|---|---|---|---|---|

| GPT-Image-2 | 2026 年初 | ❌ 不支持 | 实色背景 / 报错 | 写实场景图、海报 |

| GPT-Image-2-all(官逆) | 2026 年初 | ❌ 不支持 | 与官方一致 | 与 GPT-Image-2 等价 |

| GPT-Image-1.5 | 2025 年中 | ✅ 原生支持 | / | 贴纸、电商抠图 |

| sora_image / gpt-4o-image | 2025 年 3 月 | ✅ 支持 | / | 兼容老工作流 |

| Nano Banana 2 | 2025 年下半年 | ❌ 不支持 | 灰白棋盘格图案 | 二次创作、风格化 |

| Nano Banana Pro | 2025 年底 | ❌ 不支持 | 灰白棋盘格图案 | 高保真编辑 |

| Stable Diffusion + LoRA | 持续更新 | ✅ 间接支持 | 需要后处理 | 自托管批量生产 |

🎯 选型提示:如果你只是要"把主体抠出来",2026 年最划算的组合是 GPT-Image-1.5 / sora_image 直接出图,或者 Nano Banana Pro 出图后跑一次背景移除。这两条路在 API易 apiyi.com 上都能走统一的鉴权和计费,避免业务侧维护两套 key。

GPT-Image-2 透明背景的 4 种替代方案对比

虽然 GPT-Image-2 自己拒绝出透明图,但要让业务跑通其实有四种成熟的替代路径,每种都有自己的成本和质量曲线,可以根据场景灵活组合。

第一种是直接降级到 sora_image / gpt-image-1.5。这是改动最小的方案:客户端调用代码几乎不用动,只把 model 字段从 gpt-image-2 切到 gpt-image-1.5 或 sora_image,立刻就能恢复 alpha 通道输出。代价是写实度和长文本渲染能力会比 GPT-Image-2 弱一些,但对贴纸、Logo、电商主图这类场景完全够用。

第二种是GPT-Image-2 出图 + 后处理抠图。先用 GPT-Image-2 生成质量更高的实色背景图,再串接一个抠图模型(例如 851-labs/background-remover、RemBG、BiRefNet)做 alpha 通道剥离。这种方式能保留 GPT-Image-2 的写实长处,但延迟会增加 1-3 秒,复杂边缘(毛发、玻璃、烟雾)的精度看抠图模型本身。

第三种是Chroma Key 绿幕法。在提示词里强制要求"solid pure green background, hex #00ff00",让 GPT-Image-2 生成一张干净的纯色底图,再用代码做 HSV 色彩阈值替换。这种方式比通用抠图更快、更便宜,缺点是会"啃"主体里同色调的像素,不适合主体本身就是绿色的素材。

第四种是双底图相减法。让 GPT-Image-2 用同一个 seed 生成两张图,一张白底、一张黑底,然后逐像素计算颜色差,反推出 alpha 值。这是 OpenAI 社区里讨论度比较高的"硬核"方案,质量最稳定,但成本是双倍出图费用。

| 替代方案 | 实现复杂度 | 单图额外成本 | 边缘质量 | 适用场景 |

|---|---|---|---|---|

| 切回 GPT-Image-1.5 / sora_image | ⭐ | 0 | 高 | 贴纸、电商主图 |

| GPT-Image-2 + 通用抠图模型 | ⭐⭐ | +1 次抠图调用 | 中-高 | 写实人物、产品图 |

| Chroma Key 绿幕法 | ⭐⭐⭐ | 几乎为零 | 中 | 卡通形象、几何图形 |

| 双底图相减法 | ⭐⭐⭐⭐ | 2 倍出图费 | 高 | 玻璃、毛发等复杂边缘 |

🎯 工程化建议:我们在 API易 apiyi.com 后台默认会把"透明背景需求"路由到 gpt-image-1.5;如果客户希望保留 GPT-Image-2 的写实风格,可以通过统一接口把"出图 + 抠图"做成两步串行调用,整套链路只暴露一个 endpoint,便于业务侧封装。

如果项目对边缘质量和成本同时敏感,下面这张抠图工具能力对照表可以作为选型起点:

| 抠图工具 | 边缘精度 | 平均耗时 | 部署形态 | 推荐组合 |

|---|---|---|---|---|

| 851-labs/background-remover | 高 | 1.5-2 秒 | 云端 API | 配 GPT-Image-2 写实图 |

| RemBG(U2Net) | 中 | 0.5 秒 | 自托管 | 配纯色底图、批量任务 |

| BiRefNet | 极高 | 2-3 秒 | 自托管 | 毛发、复杂边缘 |

| HSV 色彩阈值 | 中 | <0.1 秒 | 几行 Python | 配 Chroma Key 绿幕 |

GPT-Image-2 透明背景常见问题 FAQ

Q1:在 GPT-Image-2 提示词里写"背景必须透明"为什么必定失败?

因为模型没有学习到"输出 alpha 通道"这个目标,它只能在 RGB 空间里画图。当你硬塞"transparent background"这种描述时,它会按字面意思去画一个能"代表透明"的视觉符号——也就是棋盘格底图。这是一种典型的语义对齐失败,跟提示词写得多详细无关。

Q2:gpt-image-2-all / gpt-image-2-vip 这种官逆通道为什么也不行?

官逆通道本质上还是调用同一个 OpenAI 后端模型,只是前端做了账号池或代理。模型层面不支持的能力,前端怎么包装都补不上。如果你看到某些第三方平台宣称"GPT-Image-2 支持透明背景",多半是它在 API 网关层偷偷做了背景移除后处理,并不是真的让 GPT-Image-2 原生输出透明。

Q3:如果项目刚好需要透明背景,应该选哪个 API?

我们在 API易 apiyi.com 上的实测推荐是:贴纸 / 表情包 / 电商主图选 GPT-Image-1.5,照片级写实抠图选 GPT-Image-2 配抠图模型,国产合规场景可以考虑 Stable Diffusion 系列自托管。这三条路都能在同一个网关里切换,便于做 AB 测试。

Q4:什么时候 GPT-Image-2 / Nano Banana Pro 会重新支持透明背景?

OpenAI 和 Google 都没有公开时间表。从过往迭代节奏看,OpenAI 通常会在小版本(如 GPT-Image-2.1、2.5)里把缺失的参数补回来;Google 的 Nano Banana 系列会更倾向于通过 Gemini 3 Flash + 代码执行的"组合拳"来解决,而不是改基座模型。

Q5:API易 apiyi.com 在这件事上能帮我做什么?

我们做了三件事:①在网关层自动识别 transparent 请求并提示降级;②同时打通 GPT-Image-1.5、GPT-Image-2、Nano Banana Pro 等多模型路由;③提供统一的计费、配额、日志,便于团队对比不同方案的真实成本,无需自己维护多套 SDK。

GPT-Image-2 透明背景问题的 3 条总结

第一,GPT-Image-2 不支持透明背景是一项确定的产品策略,不是 prompt 写法问题、也不是接入姿势问题。任何在提示词里反复尝试"transparent"措辞的工作流,都应该尽快迁移到 1.5 或者后处理流水线,否则只会在棋盘格图案里反复打转。

第二,Nano Banana 2 / Pro 同样不支持透明背景,目前这条赛道的"原生透明输出"只能依赖上一代 GPT-Image-1.5、sora_image / gpt-4o-image,或者 Stable Diffusion 自托管。把希望寄托在某个"暗藏开关"是不现实的。

第三,业务侧最稳的姿势是把模型抽象到一层网关后面,让"透明背景需求"在网关里自动路由到能交付的模型。这套路由策略我们已经做成了默认行为,团队可以省下一次次踩坑的时间,把精力留给真正的业务逻辑。

如果你正在重构图像生成相关的工作流,欢迎到 API易 apiyi.com 直接做一次回归测试:把现有提示词同时跑 GPT-Image-2 与 GPT-Image-1.5,10 分钟内就能拿到一份"什么场景该用什么模型"的对照表,再决定是直接降级、还是接抠图后处理。

📌 作者:APIYI 技术团队 — 持续追踪 OpenAI、Google、Anthropic 等主流模型的能力变更,为开发者提供统一的多模型 API 网关体验,了解更多请访问 API易 apiyi.com。