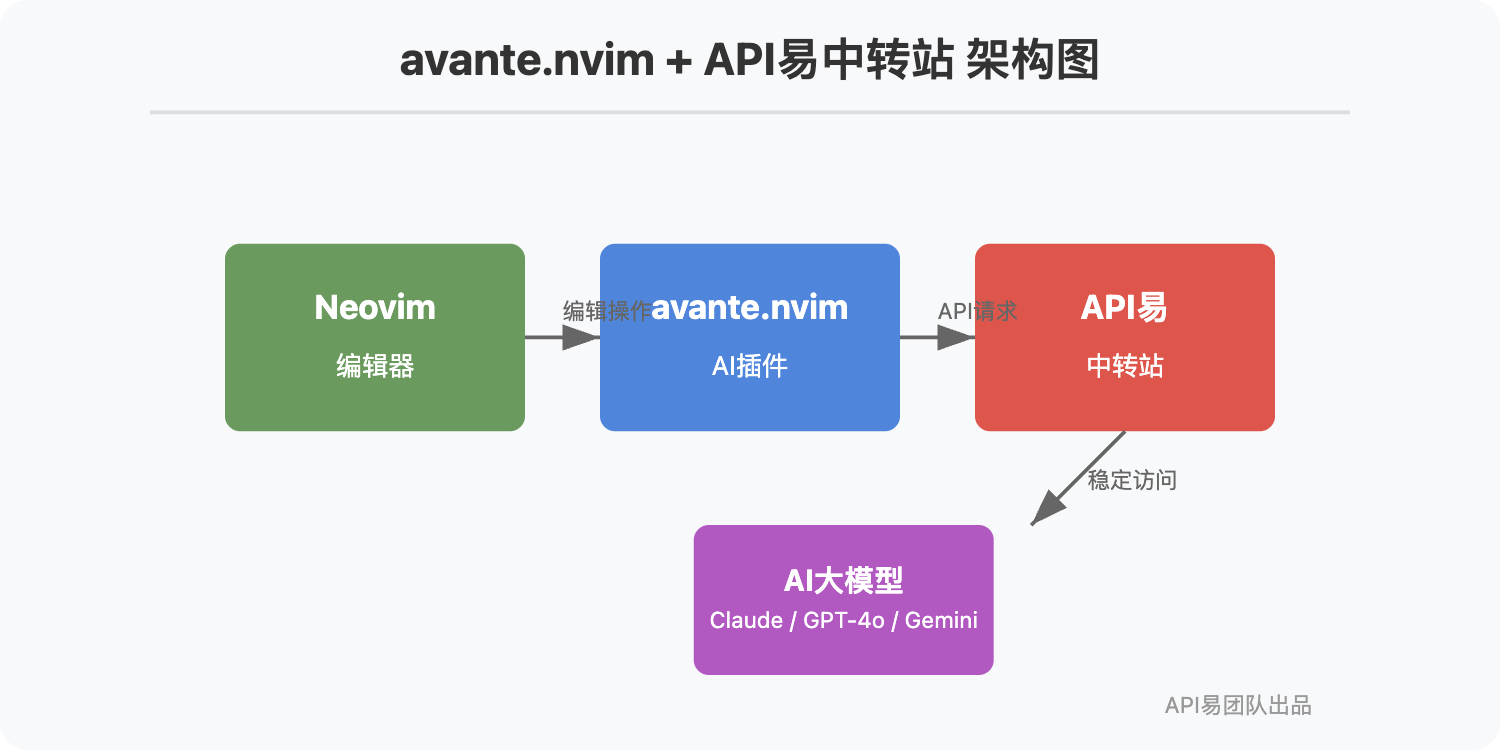

站长注:详细教程:如何配置avante.nvim插件使用API易中转站,实现类似Cursor AI的智能编程体验。

作为一名开发者,寻找高效的编程工具是提升生产力的关键。对于喜欢使用Neovim的开发者来说,avante.nvim插件是一个革命性的工具,它可以将Cursor AI IDE的强大功能带入到Neovim环境中。本文将详细介绍如何通过API易中转站配置avante.nvim插件,实现稳定高效的AI编程助手功能。

欢迎免费试用 API易,3 分钟跑通 API 调用 www.apiyi.com

支持Claude、GPT-4o等全系列模型,让Neovim插件配置更简单高效

注册可送 1.1 美金额度起,约 300万 Tokens 额度体验。立即免费注册

加站长个人微信:8765058,发送你《大模型使用指南》等资料包,并加赠 1 美金额度。

avante.nvim 插件配置中转站API 的背景介绍

avante.nvim 是一个备受欢迎的 Neovim 插件,目前在 GitHub 上已获得13.8k星标,它的核心目标是将 Cursor AI IDE 的智能功能集成到 Neovim 中。而Cursor IDE作为一款专注于AI编程辅助的编辑器,以其出色的代码生成、分析和重构能力而闻名。

然而,avante.nvim 默认需要直接连接到OpenAI等API服务,这对中国大陆的用户来说面临着几个挑战:

- 连接稳定性问题:直接连接海外API服务可能不稳定

- 账号注册困难:OpenAI等服务的账号注册对国内用户不友好

- 付款方式限制:需要国外信用卡等支付方式

- 多模型支持受限:默认配置难以灵活切换多种AI模型

这就是为什么我们需要通过API易中转站来解决这些问题,让国内开发者也能无障碍地使用这款强大的Neovim插件。

avante.nvim 插件配置中转站API 的核心功能

avante.nvim 通过API易中转站配置后,可以实现以下强大功能:

智能代码补全与建议

avante.nvim 最核心的功能是提供上下文感知的代码补全和建议。通过 API易 中转站连接到Claude、GPT-4o等大模型,它能够:

- 分析当前代码上下文,提供符合项目风格的代码补全

- 根据注释或自然语言描述生成完整的代码实现

- 提供多种可能的实现方案供开发者选择

代码解释与分析

当你遇到难以理解的代码片段时,avante.nvim 可以:

- 详细解释选中代码的功能和实现逻辑

- 指出代码中的潜在问题和优化空间

- 分析代码复杂度和性能瓶颈

代码重构与优化

对于需要重构的代码,avante.nvim 提供了强大的辅助能力:

- 根据你的要求重构选中的代码块

- 优化代码结构,提高可读性和维护性

- 转换代码风格,如将函数式代码转为面向对象风格

项目级对话与分析

除了处理单个文件外,avante.nvim 还支持:

- 与整个项目代码库进行对话(使用 @codebase 命令)

- 理解项目结构并提供全局优化建议

- 辅助解决跨文件的复杂问题

avante.nvim 插件配置中转站API 详细步骤

1. 安装 avante.nvim 插件

首先,我们需要安装 avante.nvim 插件。根据你使用的插件管理器,有多种安装方式:

使用 lazy.nvim 安装(推荐)

-- 在你的lazy.nvim配置文件中添加

return {

"yetone/avante.nvim",

event = "VeryLazy",

dependencies = {

"nvim-lua/plenary.nvim",

"nvim-treesitter/nvim-treesitter",

"nvim-telescope/telescope.nvim",

},

config = function()

-- 配置将在下一步添加

end,

}

使用 packer.nvim 安装

-- 在你的packer.nvim配置文件中添加

use {

'yetone/avante.nvim',

requires = {

'nvim-lua/plenary.nvim',

'nvim-treesitter/nvim-treesitter',

'nvim-telescope/telescope.nvim',

},

config = function()

-- 配置将在下一步添加

end

}

使用 vim-plug 安装

" 在你的vim-plug配置中添加

Plug 'nvim-lua/plenary.nvim'

Plug 'nvim-treesitter/nvim-treesitter'

Plug 'nvim-telescope/telescope.nvim'

Plug 'yetone/avante.nvim'

2. 注册并获取 API易 API密钥

在配置插件之前,你需要先在API易平台注册并获取API密钥:

- 访问 API易官网 注册账号

- 登录后进入个人中心,点击"API密钥管理"

- 创建一个新的API密钥并复制保存

- 查看可用的模型列表,为后续配置做准备

3. 配置 avante.nvim 使用 API易 中转站

现在,我们需要配置 avante.nvim 使用 API易 作为API提供者。以下是完整的配置示例:

-- 在你的config函数中添加以下配置

require("avante").setup({

-- 指定默认提供者为OpenAI(API易兼容OpenAI接口协议)

provider = "openai",

-- API易中转站配置

openai = {

-- API易的API端点

endpoint = "https://vip.apiyi.com/v1",

-- 使用你的API易API密钥

api_key = "your_apiyi_api_key_here",

-- 指定使用的模型,这里使用Claude 3.7 Sonnet

model = "claude-3-7-sonnet-20250219",

-- 温度参数,控制生成内容的随机性,0表示最确定性的输出

temperature = 0,

-- 最大生成令牌数

max_tokens = 4096,

},

-- 其他avante.nvim的设置

completion = {

-- 在补全中自动插入Tab字符

auto_insert_tab = true,

-- 启用类似Cursor风格的Tab自动补全流

cursor_flow = true,

},

-- UI设置

ui = {

-- 在侧边栏显示的最大行数

max_lines = 30,

-- 启用聊天模式

chat = true,

-- 输入框高度

input_height = 10,

},

-- 自定义快捷键(可选)

keymap = {

-- 在当前光标位置生成代码

code = "<leader>ac",

-- 打开侧边栏聊天界面

toggle = "<leader>at",

-- 编辑选中的代码块

edit = "<leader>ae",

},

})

4. 配置不同的 API易 模型选择

API易提供了多种模型选择,你可以根据需要灵活配置。以下是几种常用模型的配置示例:

Claude 3.7 Sonnet(推荐用于编程)

openai = {

endpoint = "https://vip.apiyi.com/v1",

api_key = "your_apiyi_api_key_here",

model = "claude-3-7-sonnet-20250219",

temperature = 0,

max_tokens = 4096,

}

GPT-4o(适合多模态编程场景)

openai = {

endpoint = "https://vip.apiyi.com/v1",

api_key = "your_apiyi_api_key_here",

model = "gpt-4o",

temperature = 0,

max_tokens = 4096,

}

Gemini 2.5 Pro(适合更经济的选择)

openai = {

endpoint = "https://vip.apiyi.com/v1",

api_key = "your_apiyi_api_key_here",

model = "gemini-2.5-pro-preview-05-06",

temperature = 0,

max_tokens = 4096,

}

avante.nvim 插件配置中转站API 开发指南

1. 模型选择

模型服务介绍

API易,行业领先的API中转站,均为官方源头转发,价格略有优势,聚合各种优秀大模型,使用起来很方便。

企业级专业稳定的OpenAI o3/Claude 3.7/Deepseek R1/Gemini 等全模型官方同源接口的中转分发。不限速,不过期,不惧封号,按量计费,长期可靠服务;让技术助力科研、公益事业!

适合avante.nvim的模型推荐

全部模型和价格请看网站后台 https://www.apiyi.com/account/pricing

- Claude 系列

claude-3-7-sonnet-20250219:最新 Claude 3-7 编程效果最佳!(推荐指数:⭐⭐⭐⭐⭐)claude-3-5-sonnet-20241022:适合日常编程需求的可靠选择

- 谷歌 Gemini 系列

gemini-2.5-pro-preview-05-06:谷歌最新Pro模型,性价比高(推荐指数:⭐⭐⭐⭐)gemini-2.5-flash-preview:速度快,适合需要快速响应的场景

- OpenAI系列

o3:强大的编程助手能力gpt-4o:多模态能力强,可处理代码和图像gpt-4o-mini:经济实惠,适合预算有限的用户

场景推荐

-

复杂编程场景

- 首选:

claude-3-7-sonnet-20250219– 代码生成质量最高 - 备选:

o3– 上下文理解能力出色

- 首选:

-

代码解释与文档生成

- 首选:

claude-3-7-sonnet-20250219– 解释最清晰 - 备选:

gpt-4o– 文档格式处理良好

- 首选:

-

快速代码辅助

- 首选:

gemini-2.5-flash-preview– 响应速度最快 - 备选:

gpt-4o-mini– 平衡速度和质量

- 首选:

注意:具体价格请参考 API易价格页面

实践示例:代码生成

以下是使用配置好的 avante.nvim 生成一个快速排序算法的示例:

- 在 Neovim 中,打开一个新的 Python 文件

- 输入以下注释:

# 实现一个快速排序算法

# 要求:

# 1. 使用分治策略

# 2. 包含详细注释

# 3. 添加性能优化

- 按下配置的快捷键

<leader>ac触发代码生成 - avante.nvim 将通过 API易 调用 Claude 3.7 生成高质量的快速排序实现

avante.nvim 插件配置中转站API 最佳实践

- 保存API密钥的安全实践

建议不要直接在配置文件中硬编码API密钥,而是使用环境变量或加密存储:

-- 从环境变量获取API密钥

local api_key = os.getenv("APIYI_API_KEY") or "your_default_key"

require("avante").setup({

openai = {

endpoint = "https://vip.apiyi.com/v1",

api_key = api_key,

-- 其他配置...

}

})

- 根据不同项目切换模型

可以创建不同的配置文件,根据项目需求加载不同的模型配置:

-- 在项目根目录创建 .nvim.lua 文件

-- 使用 nvim-projectconfig 插件自动加载

local project_type = "web_development" -- 可以根据目录自动检测

local model_configs = {

web_development = "claude-3-7-sonnet-20250219",

data_science = "gpt-4o",

quick_prototyping = "gemini-2.5-flash-preview",

}

require("avante").setup({

openai = {

model = model_configs[project_type],

-- 其他配置...

}

})

- 优化Token使用量

为了节省API调用成本,可以调整上下文窗口大小:

require("avante").setup({

openai = {

-- 其他配置...

},

completion = {

-- 限制发送到API的上下文大小

max_context_lines = 50,

}

})

avante.nvim 插件配置中转站API 常见问题

1. 配置后无法连接到API易服务?

问题: 配置完成后,avante.nvim 无法连接到API易服务。

解决方案:

- 确认API密钥是否正确

- 检查网络连接是否正常

- 验证端点URL是否正确,应为

https://vip.apiyi.com/v1 - 使用以下命令测试API连接:

curl https://vip.apiyi.com/v1/chat/completions \

-H "Content-Type: application/json" \

-H "Authorization: Bearer YOUR_APIYI_API_KEY" \

-d '{

"model": "claude-3-7-sonnet-20250219",

"messages": [{"role": "user", "content": "Hello"}]

}'

2. 代码生成质量不理想?

问题: 生成的代码质量不符合预期。

解决方案:

- 尝试降低温度参数,设置为0可获得最确定性输出

- 提供更详细的上下文和要求

- 切换到更强大的模型,如从Gemini切换到Claude 3.7

- 使用自定义系统提示优化输出风格

3. 响应速度较慢?

问题: AI响应时间较长,影响开发效率。

解决方案:

- 切换到更快速的模型,如

gemini-2.5-flash-preview - 减少发送的上下文大小

- 启用流式输出模式,边生成边显示结果

- 使用代理优化网络连接

-- 启用流式输出

require("avante").setup({

openai = {

-- 其他配置...

stream = true,

}

})

为什么选择「API易」作为avante.nvim的API提供者

对于avante.nvim用户,选择API易作为API提供者有几个显著优势:

-

无障碍访问顶级模型

- 不需要海外账号就能使用Claude、GPT-4o、Gemini等顶级模型

- 无需外币信用卡,支持支付宝、微信等国内支付方式

- 解决了网络连接问题,提供稳定高速的API访问

-

模型多样性与灵活切换

- 提供多种模型选择,一个API密钥可访问所有模型

- 可以根据不同编程任务灵活切换最适合的模型

- 支持最新的模型版本,如Claude 3.7、GPT-4o等

-

成本优势

- 按使用量计费,没有最低消费要求

- 相比直接使用原厂API价格略有优势

- 新用户赠送1.1美金额度,可以充分测试各种模型

-

专业的技术支持

- 提供中文技术支持和文档

- 7×24小时服务保障

- 解决配置过程中的各种问题

总结

通过API易中转站配置avante.nvim插件,我们成功将Cursor AI IDE的强大功能带入了Neovim环境。这种配置方式不仅解决了国内用户访问高级AI模型的障碍,还提供了更灵活的模型选择和更稳定的服务体验。

无论你是进行复杂的系统开发、算法设计,还是日常的代码编写,配置了API易的avante.nvim都能显著提升你的编程效率和代码质量。而且,随着AI模型的不断进化,这套配置还将持续获得性能提升,让你的Neovim成为越来越智能的编程助手。

欢迎免费试用 API易,3 分钟跑通 API 调用 www.apiyi.com

让你的Neovim拥有Cursor AI的强大能力,编程效率倍增

加站长个人微信:8765058,发送你《大模型使用指南》等资料包,并加赠 1 美金额度。

本文作者:API易团队

欢迎关注我们的更新,持续分享 AI 开发经验和最新动态。